大家好,今天继续讲述关于人工智能学习的基础篇。

(1)长短期记忆人工神经网络

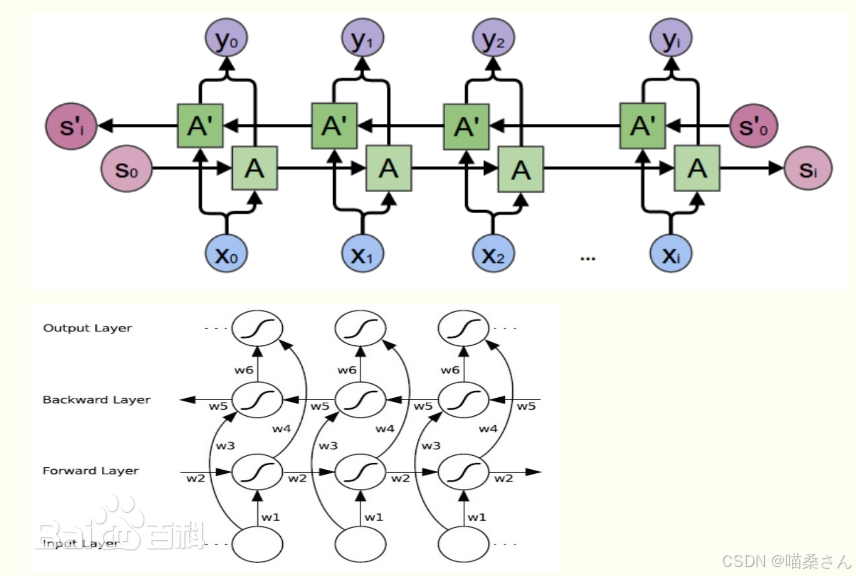

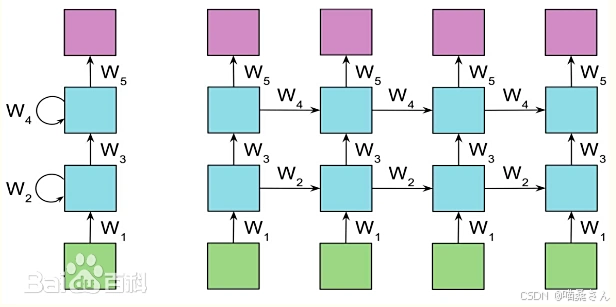

长短期记忆网络(LSTM,Long Short-Term Memory)是一种时间循环神经网络,是为了解决一般的RNN(循环神经网络)存在的长期依赖问题而专门设计出来的,所有的RNN都具有一种重复神经网络模块的链式形式。在标准RNN中,这个重复的结构模块只有一个非常简单的结构,例如一个tanh层。

LSTM是一种含有LSTM区块(blocks)或其他的一种类神经网络,文献或其他资料中LSTM区块可能被描述成智能网络单元,因为它可以记忆不定时间长度的数值,区块中有一个gate能够决定input是否重要到能被记住及能不能被输出output。

图1底下是四个S函数单元,最左边函数依情况可能成为区块的input,右边三个会经过gate决定input是否能传入区块,左边第二个为input gate,如果这里产出近似于零,将把这里的值挡住,不会进到下一层。左边第三个是forget gate,当这产生值近似于零,将把区块里记住的值忘掉。第四个也就是最右边的input为output gate,他可以决定在区块记忆中的input是否能输出 。

LSTM有很多个版本,其中一个重要的版本是GRU(Gated Recurrent Unit),根据谷歌的测试表明,LSTM中最重要的是Forget gate,其次是Input gate,最次是Output gate。

为了最小化训练误差,梯度下降法(Gradient descent)如:应用时序性倒传递算法,可用来依据错误修改每次的权重。梯度下降法在递回神经网络(RNN)中主要的问题初次在1991年发现,就是误差梯度随着事件间的时间长度成指数般的消失。当设置了LSTM 区块时,误差也随着倒回计算,从output影响回input阶段的每一个gate,直到这个数值被过滤掉。因此正常的倒传递类神经是一个有效训练LSTM区块记住长时间数值的方法。

(2)图神经网络

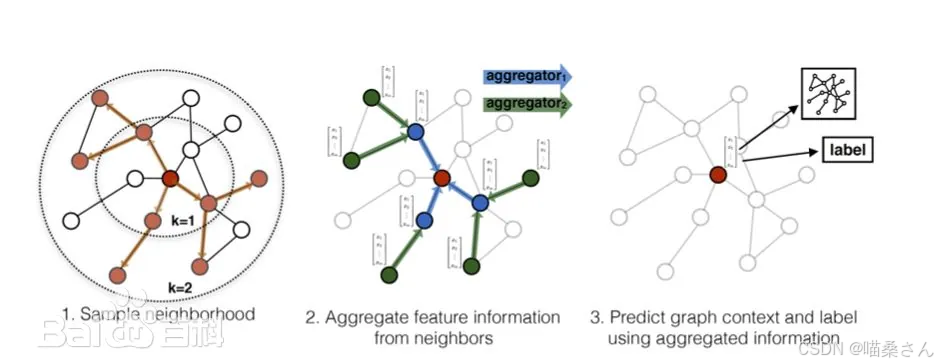

图神经网络(Graph Neural Network,GNN)是一种基于深度学习处理图结构数据的算法框架,通过提取节点、边及图整体特征,完成分类、预测、生成等任务。该框架可将非欧式图数据转化为规范化表示,应用于社交网络、交通网络、分子结构等多个领域,2025年浙江海盐供电公司基于GCN和GAT构建故障定位模型,实现配电网高精度故障研判并入选电力信息通信新技术大会典型案例。

GNN核心算法包括图卷积网络(GCN)、图注意力网络(GAT)、图自编码器(GAE)、图生成网络(GGN)和图循环网络(GRNN)等。其中GCN分为基于谱分解和空间变换两种方法,通过卷积操作实现局部感知与权值共享。Bruna团队将卷积神经网络引入图数据领域,提出GCN框架并衍生出多个变体。GAT引入多头注意力机制,动态识别节点关联性;GAE可无监督学习节点嵌入表示,GGN用于生成特定属性的目标图,GRNN则擅长处理时序图数据及动态交互场景。GNN+框架通过集成边特征、归一化等六项超参数技术,进一步提升经典GNNs在图分类与回归任务中的竞争力。

该概念于2005年由Gori等人首次提出并采用循环神经网络处理图数据。随着图池化、门控融合器等技术的发展,GNN在节点分类、链接预测、交通流量预测等场景中持续优化。

图神经网络(Graph Neural Network,GNN)是近年来出现的一种利用深度学习直接对图结构数据进行学习的框架,其优异的性能引起了学者高度的关注和深入的探索。通过在图中的节点和边上制定一定的策略,GNN 将图结构数据转化为规范而标准的表示,并输入到多种不同的神经网络中进行训练,在节点分类、边信息传播和图聚类等任务上取得优良的效果。

GNN 的历史最早可以追溯到 2005 年,Gori 等人第一次提出 GNN 概念,用 RNN 来处理无向图、有向图、标签图和循环图等。在这之后,Scarselli 等人和 Micheli 等人继承和发展了该模式的 GNN 算法,并做了一定程度的改进。早期阶段的 GNN 主要是以 RNN 为主体框架,通过简单的特征映射和节点聚集为每个节点生成向量式表达,不能很好地应对现实中复杂多变的图数据。针对此情况,Bruna等人提出将 CNN 应用到图上,通过对卷积算子巧妙的转换,提出了图卷积网络(Graph Convolutional Netwok,GCN),并衍生了许多变体。GCN 实现了 CNN 在图上的平移不变、局部感知和权值共享,为接下来其他GNN 框架的构造和改进提供思想上的指导和借鉴。

从 2005 年 Gori 等人提出 GNN 概念,到 GCN的出现为非欧式结构数据提供有效的处理范式,再到 GAE、GAT、GRN、GGN 等不同 GNN 框架变种的提出以及 GNN 在各个领域的应用,GNN 在理论和实践上经历一个从无到有、从有到优化的过程,GNN 的体系族也在不断地发展和完善。从这段历程中,可以看出许多研究人员对 GNN 算法和结构的不断改进和优化。

今天就讲这些,下篇文章见。