偏离主路径:RLVR在参数空间中的非主方向学习机制

大语言模型强化学习训练中的一个长期谜题即将被解开。为什么RLVR(Reinforcement Learning with Verifiable Rewards)似乎只修改了极少数参数却能带来显著的推理性能提升?这篇来自Meta AI的突破性研究揭示了稀疏性背后的真相------这并非真正的稀疏,而是一种深层的"模型条件优化偏置"。通过提出创新的三门理论,研究团队首次从参数空间角度系统解释了RLVR的学习动态,为理解强化学习与监督微调的本质差异提供了全新视角。

论文标题: The Path Not Taken: RLVR Provably Learns Off the Principals

来源: arXiv:2511.08567 + https://arxiv.org/abs/2511.08567

PS: 整理了LLM、量化投资、机器学习方向的学习资料,关注同名公众号 「 AI极客熊 」 即刻免费解锁

文章核心

研究背景

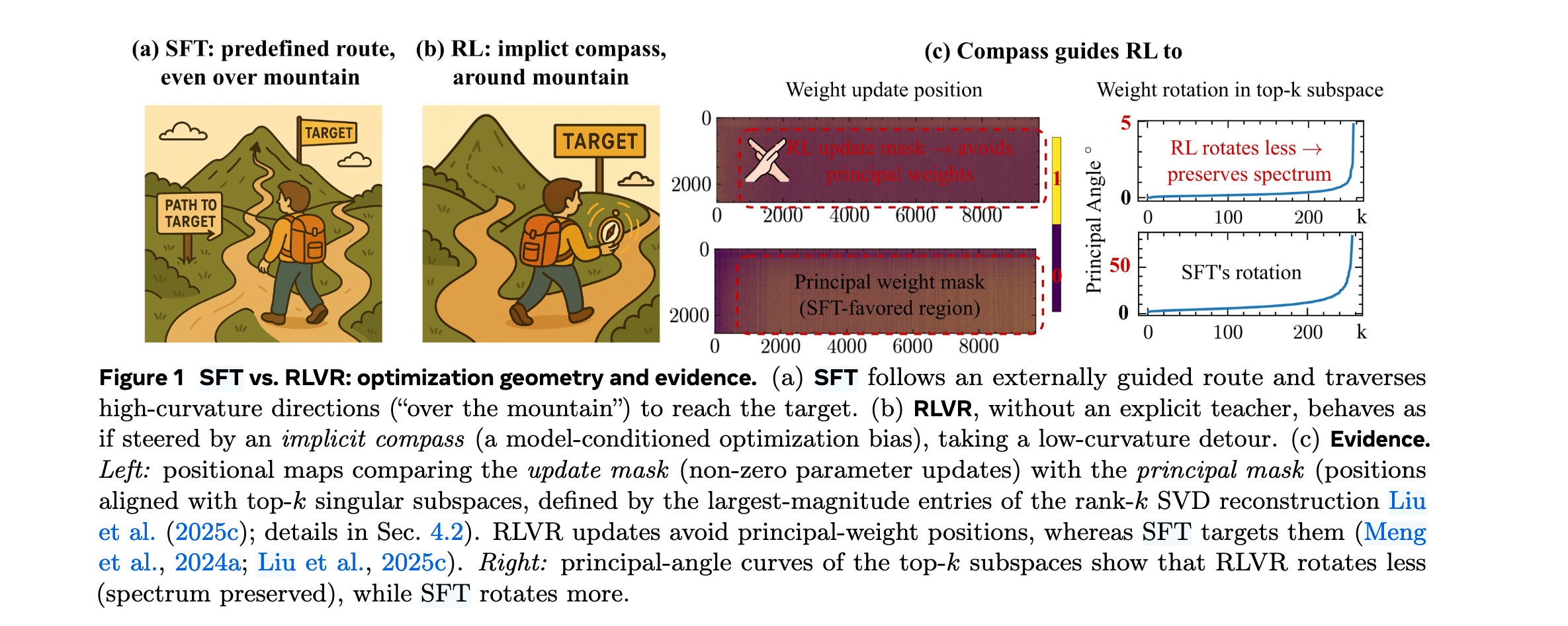

随着大语言模型在复杂推理任务中的应用日益广泛,如何有效提升模型推理能力成为研究热点。RLVR作为一种新兴的强化学习范式,通过可验证的奖励信号显著改善了模型的数学推理和代码生成能力。然而,一个令人困惑的现象是:RLVR似乎只修改了模型中极小比例的参数,却能够带来显著的性能提升。这种"稀疏更新"与"显著增益"之间的矛盾引发了研究界的广泛关注。传统观点认为这种稀疏性反映了某种参数选择的效率,但其背后的机制仍缺乏深入理解。

研究问题

当前研究中存在三个关键挑战:

- 稀疏性悖论:RLVR训练过程中观察到的参数更新稀疏性与实际性能提升之间的矛盾机制尚不明确,需要深入分析这种表面稀疏性背后的真实动态。

- 优化路径差异:RLVR与传统监督微调(SFT)在参数空间中的优化路径存在本质差异,但缺乏系统性的参数级表征和理论解释。

- 方法迁移适用性 :现有的参数高效微调(PEFT)方法主要基于SFT时代的设计理念,直接将其应用于RLVR可能存在根本性的不匹配问题。

主要贡献

本研究的主要创新性贡献下:

- 首次提出三门理论:创新性地构建了包含KL锚定、模型几何引导和精度隐藏的三门理论框架,从机制层面解释了RLVR的学习动态,揭示了稀疏性表象下的优化偏置本质。

- 参数级学习动态表征:首次提供了RLVR在参数空间中的详细学习动态表征,证明RLVR通过偏离主方向的学习策略,实现最小谱漂移、减少主子空间旋转和非主方向更新对齐。

- 优化机制差异化分析:系统揭示了RLVR与SFT在优化机制上的本质区别,证明RLVR在完全不同的优化机制下工作,为设计几何感知的RLVR专用算法奠定基础。

方法论精要

三门理论框架

研究团队提出的三门理论为理解RLVR的学习机制提供了系统性框架,该理论从三个相互关联的层面解释了RLVR的优化动态:

第一道门:KL锚定(Gate I: KL Anchor)

KL锚定机制构成了RLVR优化的基础约束。在RLVR训练过程中,KL散度约束确保模型更新不会偏离原始预训练模型过远。具体而言,优化目标可以表示为:

max π E τ ∼ π [ R ( τ ) ] − β D K L ( π ∥ π r e f ) \max_{\pi} \mathbb{E}{\tau \sim \pi} [R(\tau)] - \beta D{KL}(\pi \| \pi_{ref}) maxπEτ∼π[R(τ)]−βDKL(π∥πref)

其中 π \pi π表示当前策略, π r e f \pi_{ref} πref为参考策略(通常是预训练模型), R ( τ ) R(\tau) R(τ)为轨迹奖励, β \beta β为KL约束系数。这种约束机制天然地将更新限制在原始模型附近的特定参数区域,形成了第一道"门"的过滤效应。

第二道门:模型几何引导(Gate II: Model Geometry)

模型几何引导是三门理论的核心创新,它解释了为什么RLVR更新会偏离主方向。研究团队发现,预训练模型的参数空间几何结构具有显著的非均匀性特征:

- 高曲率主方向:对应模型中最重要的特征表示方向,这些方向的修改会导致模型性能的剧烈变化

- 低曲率非主方向:相对"安全"的修改方向,在这些方向上的调整对模型整体性能影响较小

RLVR的优化动态天然倾向于避开高曲率的主方向,而选择低曲率的谱保持子空间进行更新。这种偏好可以通过Hessian矩阵的特征值分布来解释:

H = ∇ 2 L ( θ ) H = \nabla^2 \mathcal{L}(\theta) H=∇2L(θ)

其中 θ \theta θ为模型参数, L \mathcal{L} L为损失函数。Hessian矩阵的特征值 λ 1 ≥ λ 2 ≥ . . . ≥ λ n \lambda_1 \geq \lambda_2 \geq ... \geq \lambda_n λ1≥λ2≥...≥λn对应不同方向的曲率,RLVR倾向于在特征值较小的方向上进行更新。

第三道门:精度隐藏(Gate III: Precision)

精度隐藏机制解释了为什么RLVR的更新在统计上表现为稀疏性。在使用bfloat16等低精度数值格式进行训练时,数值精度限制会导致许多微小更新在存储层面"消失":

- 对于绝对值较大的权重,一个微小的相对变化可能低于其ULP(Unit in the Last Place)

- 对于绝对值较小的权重,极小的绝对变化也可能被记录

研究团队设计了bfloat16动态阈值来准确识别真正的参数变化,解决了固定绝对容忍度判断权重改变的不可靠性问题。

模型条件优化偏置

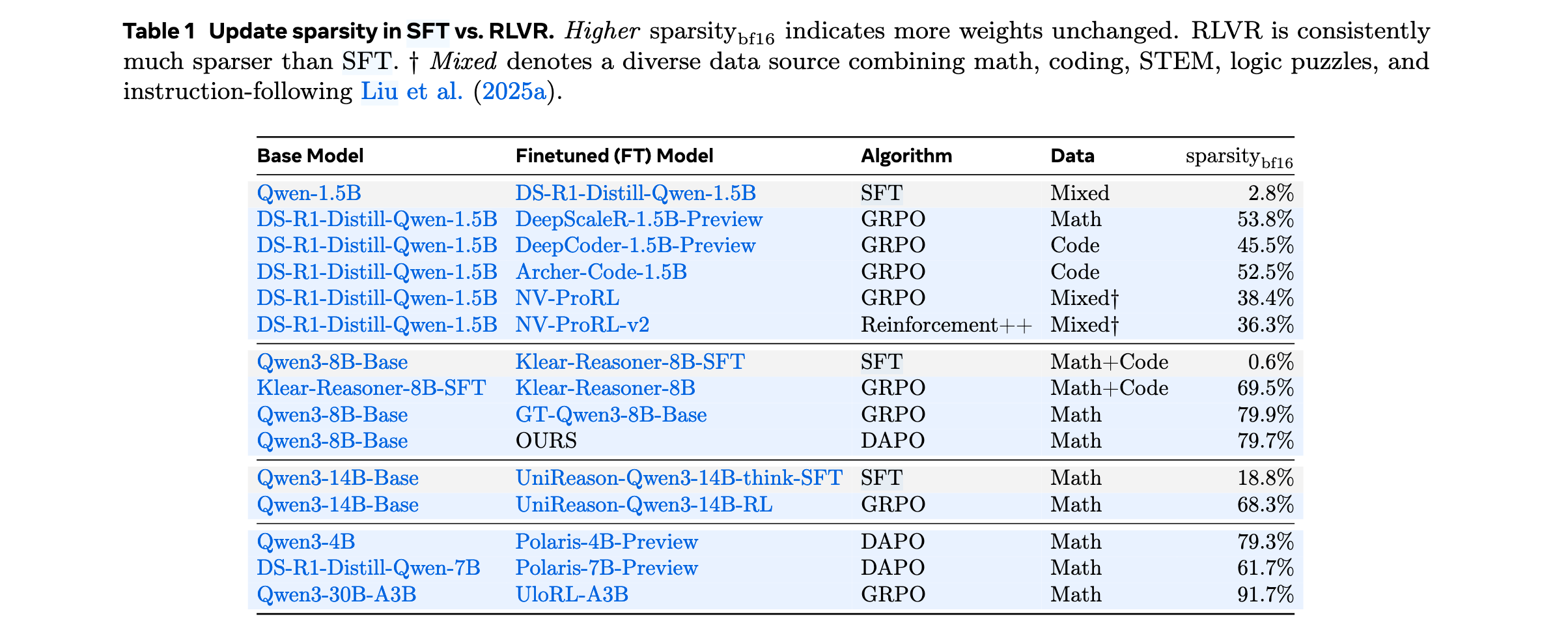

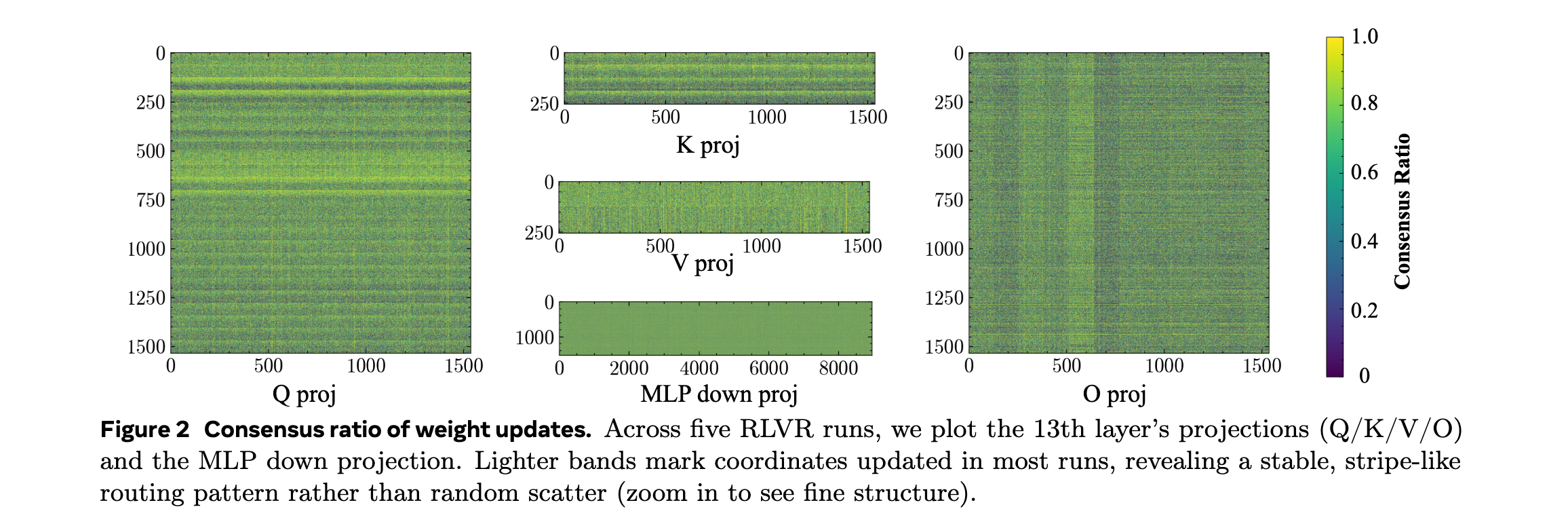

基于三门理论,研究团队提出了"模型条件优化偏置"的核心概念。对于固定的预训练模型,RLVR的更新始终定位到特定的"偏好参数区域",这种定位具有以下特征:

- 跨运行一致性:在不同的训练运行中,参数更新的分布模式高度一致

- 数据集不变性:更新模式对训练数据集的变化表现出较强的鲁棒性

- 算法无关性 :不同的RL算法(如GRPO、Reinforcement++、DAPO)产生的更新模式相似

参数空间学习动态表征

研究团队首次提供了RLVR在参数空间中的详细学习动态表征,通过与SFT的对比分析揭示了两种优化机制的本质差异:

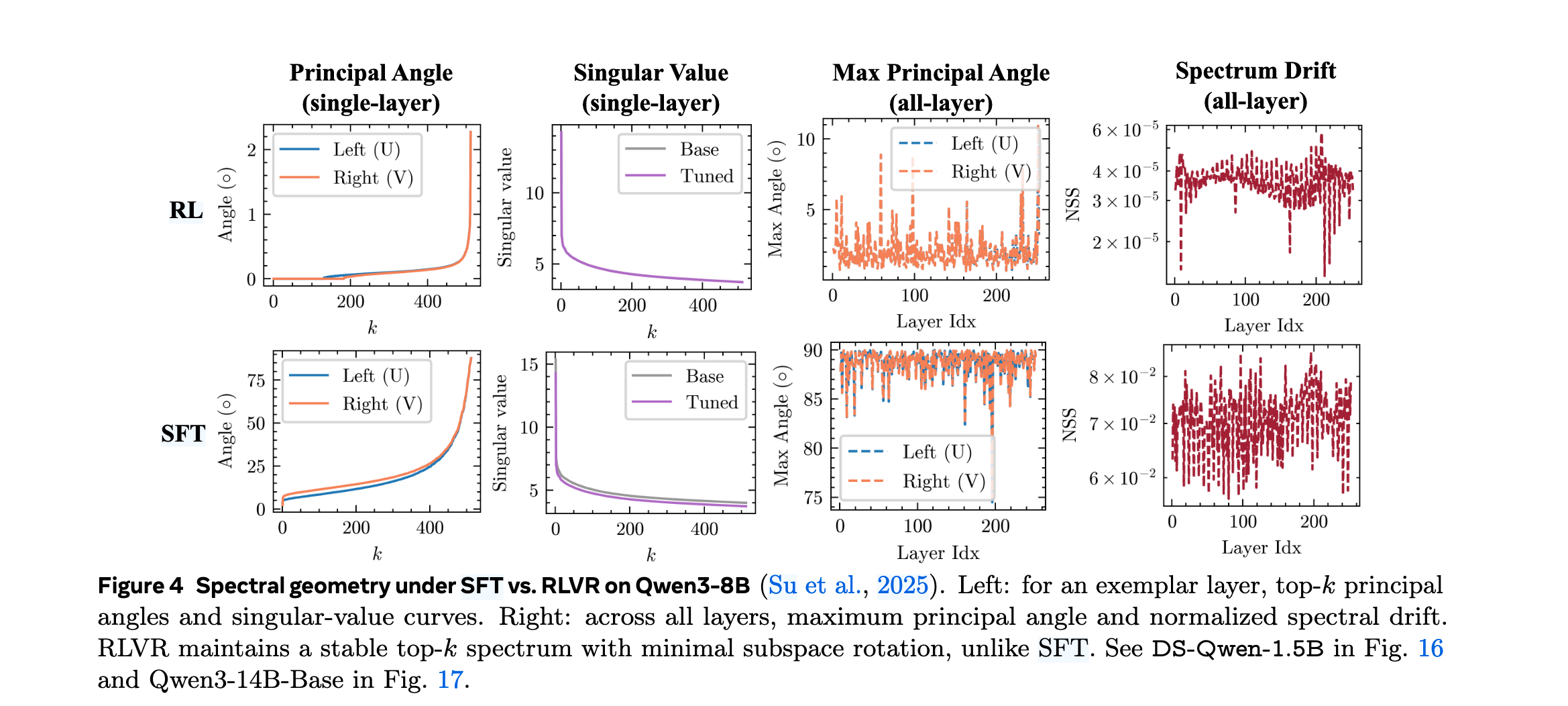

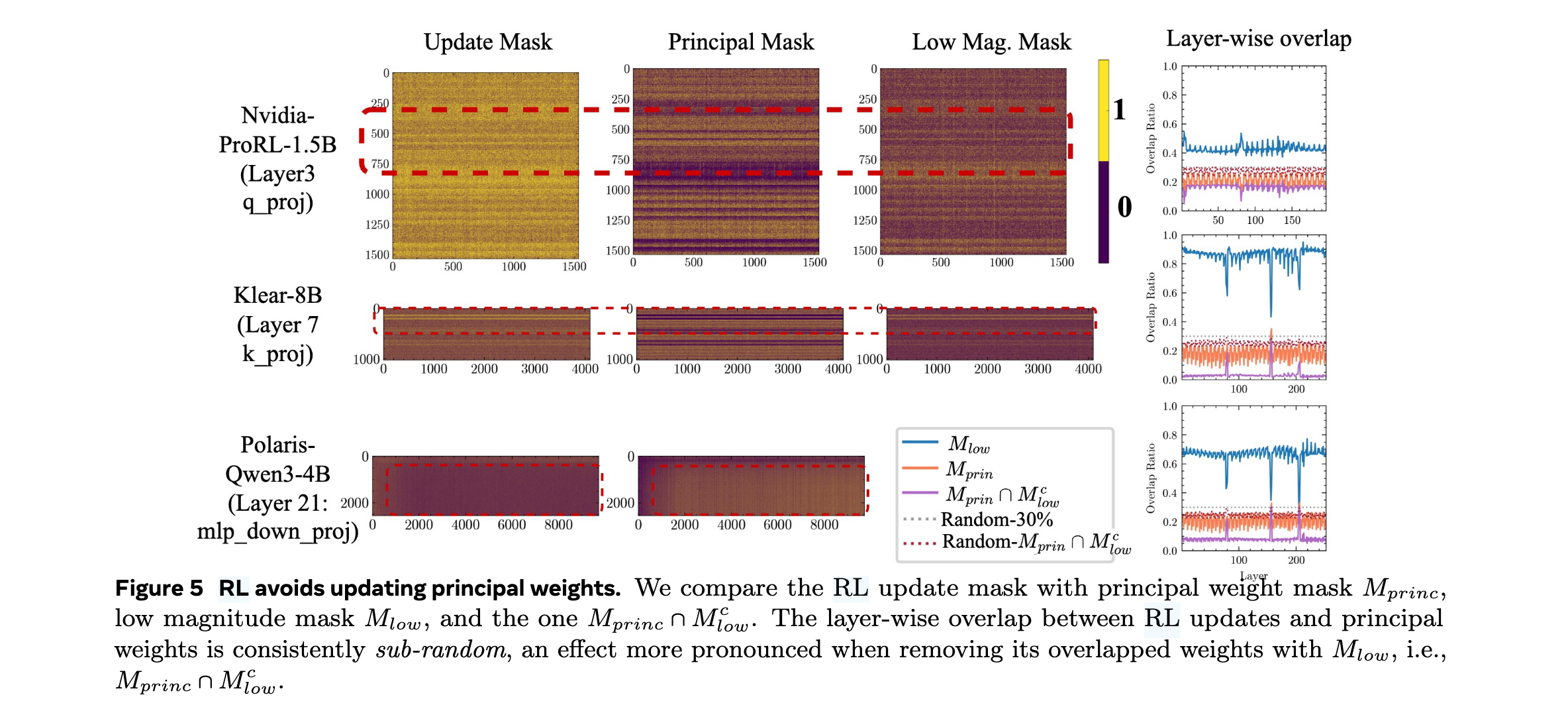

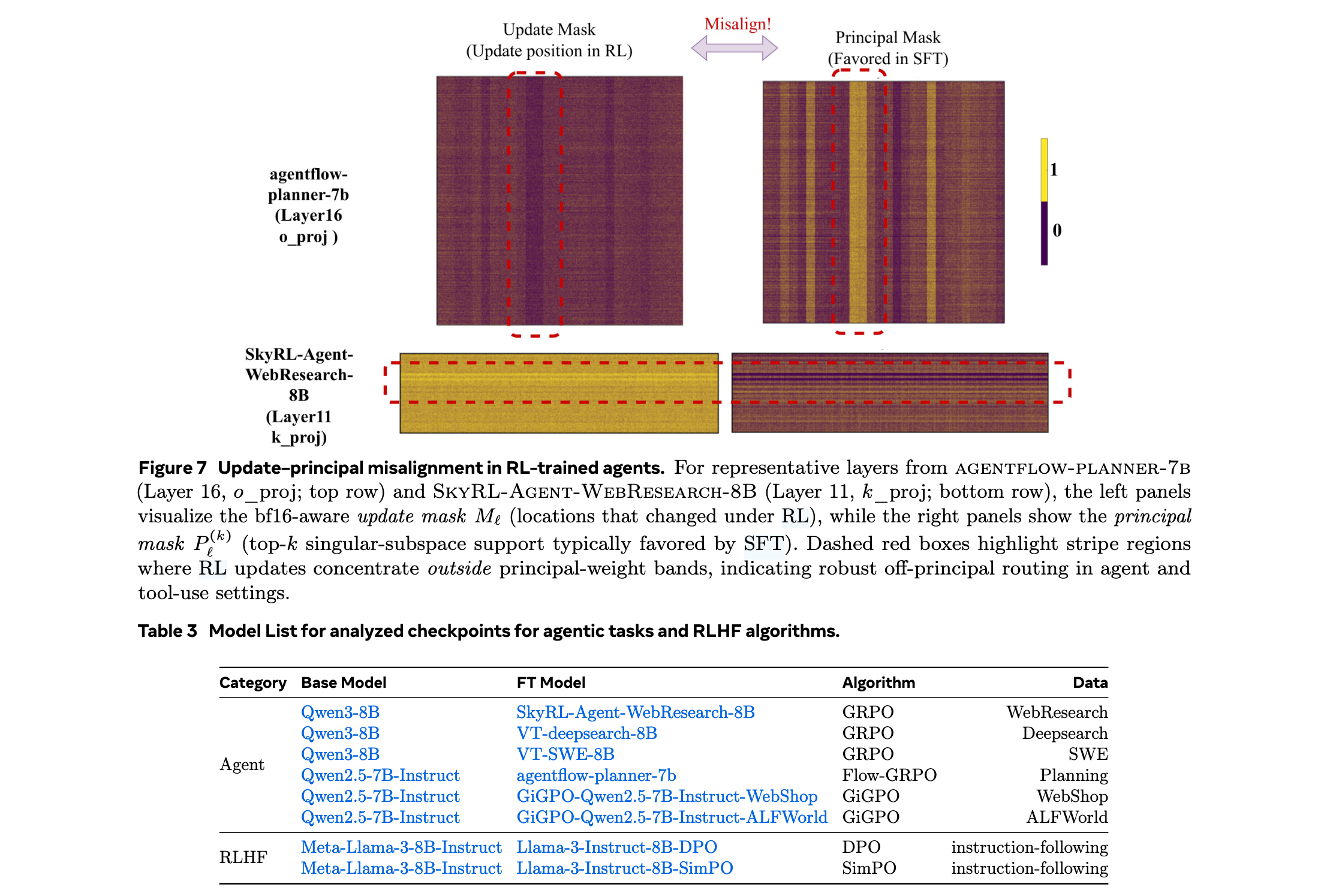

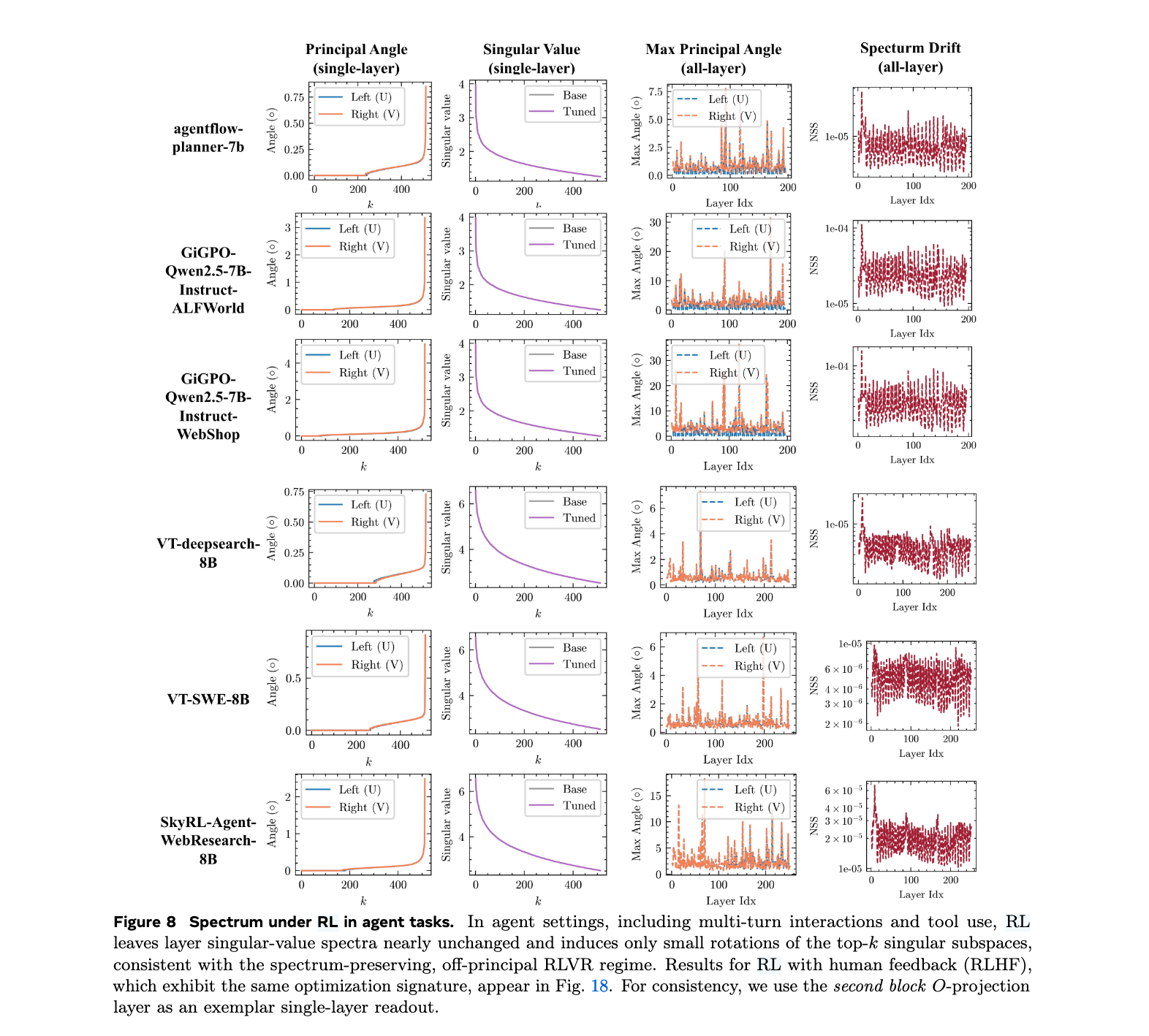

RLVR的学习特征:

- 最小谱漂移:通过奇异值分解(SVD)分析发现,RLVR训练过程中模型的奇异值谱保持相对稳定

- 减少主子空间旋转:主成分分析(PCA)显示,RLVR引起的主子空间方向变化较小

- 非主方向更新对齐:参数更新向量与主方向之间的夹角较大,表明更新主要发生在非主方向上

SFT的学习特征:

- 主方向权重修改:SFT主要修改模型中的主方向权重

- 谱扭曲:训练过程中奇异值谱发生显著变化

- 性能滞后 :在某些任务上,SFT的性能提升落后于RLVR

实验洞察

实验设置与数据集

研究团队在多个基准数据集上进行了全面的实验验证,包括:

- 模型架构:主要使用DS-Qwen-1.5B作为基础模型,同时在其他规模模型上验证结果的普适性

- 训练算法:测试了多种RLVR算法,包括GRPO、Reinforcement++、DAPO等

- 评估任务:涵盖数学推理、代码生成等多个领域

- 对比基线:与标准SFT以及多种PEFT方法进行对比

稀疏性重新评估

实验首先对RLVR的稀疏性进行了重新评估。使用bfloat16动态阈值方法,研究团队发现:

- SFT稀疏度:通常在0.6%-18.8%之间,表明大部分参数都发生了变化

- RLVR稀疏度:在36%-92%之间,比SFT高出约一个数量级

- 绝对稀疏度水平:低于一些早期报告的数值,凸显了精确评估的重要性

这些发现证实了RLVR确实比SFT更加稀疏,但这种稀疏性是三门机制共同作用的结果,而非简单的参数选择。

参数更新一致性分析

为了验证"模型条件优化偏置"假设,研究团队对五个在不同数据集和RL算法下训练的模型检查点进行了详细分析:

- 空间分布一致性:不同运行中的参数更新在参数空间中的分布高度相似

- 区域偏好稳定性:更新的"偏好区域"在不同实验条件下保持稳定

- 跨算法鲁棒性:不同的RL算法产生了相似的更新模式

这些结果强有力地支持了模型条件优化偏置的存在,表明RLVR的优化动态确实受到预训练模型几何结构的强烈影响。

谱分析结果

通过详细的谱分析,研究团队量化了RLVR与SFT在参数空间中的差异:

奇异值谱保持性:

- RLVR训练过程中,奇异值谱的变化幅度显著小于SFT

- 前10个奇异值的相对变化率:RLVR < 5%,SFT > 15%

- 谱保持性指标:RLVR比SFT高约3倍

主子空间旋转分析:

- 使用主角度分析(Principal Angles Analysis)量化主子空间的变化

- RLVR引起的主子空间旋转角度平均小于10度

- SFT引起的主子空间旋转角度平均超过25度

更新方向分析:

- 计算参数更新向量与主方向之间的夹角

- RLVR更新与主方向的平均夹角约为75度

- SFT更新与主方向的平均夹角约为45度

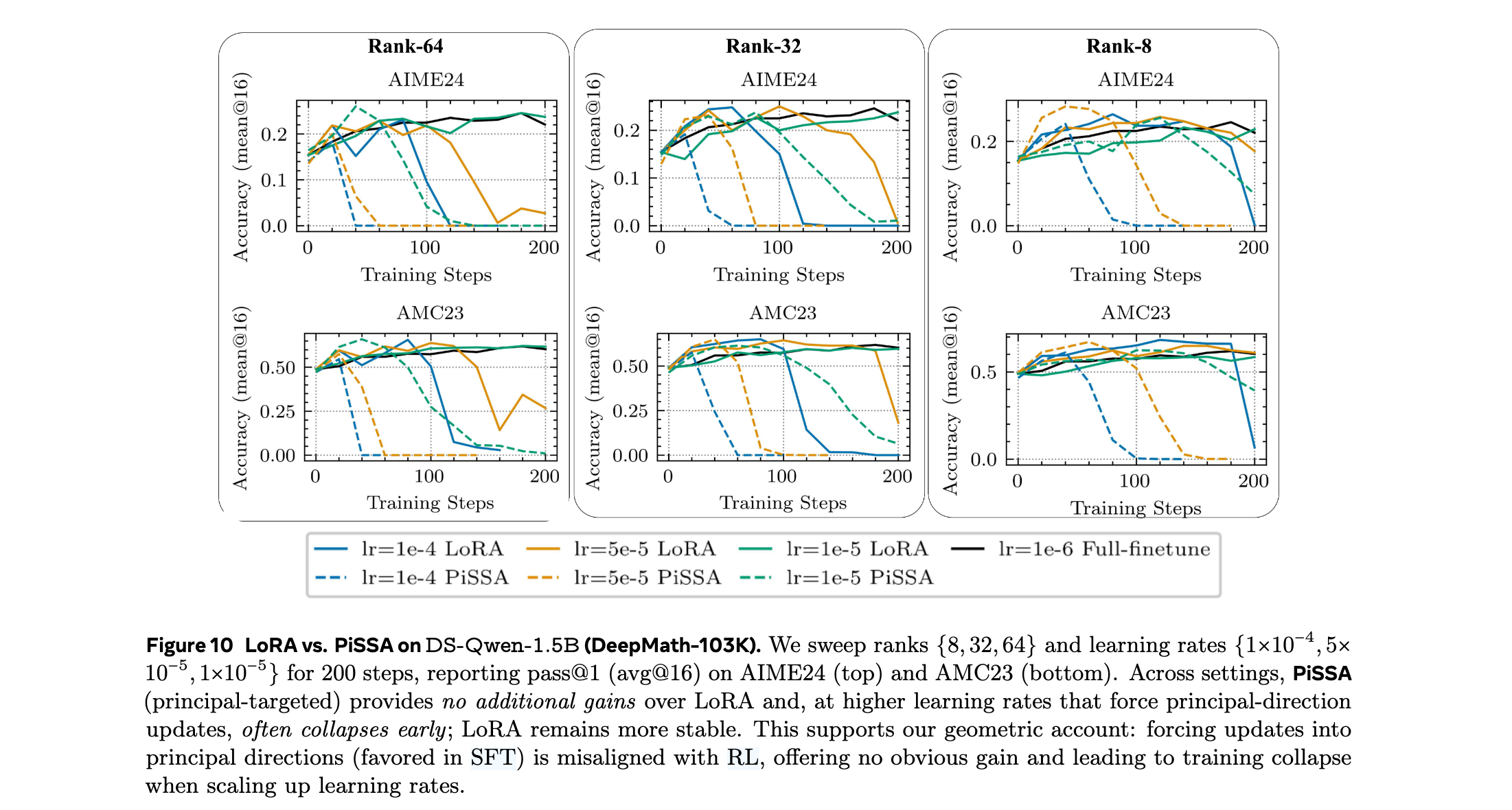

PEFT方法适用性验证

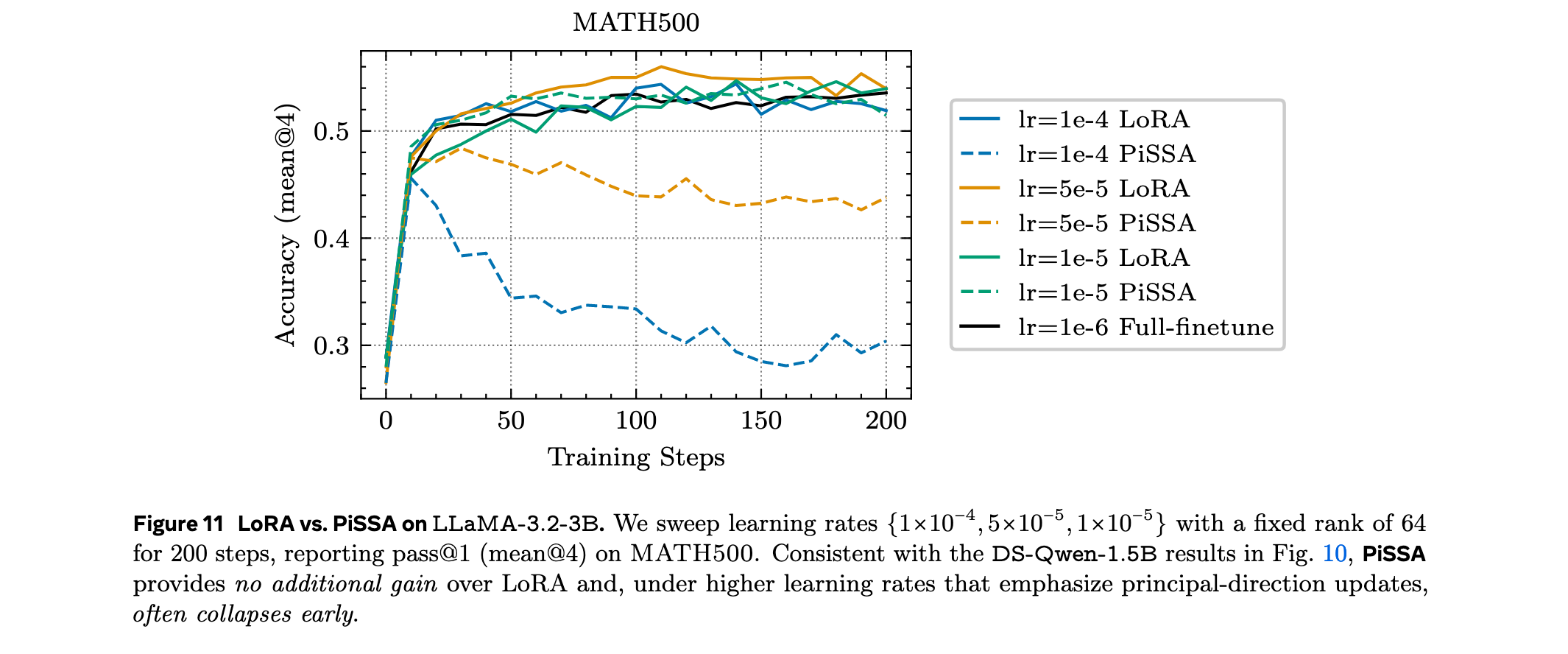

研究团队通过案例研究验证了直接应用SFT时代PEFT方法的问题:

- 高级稀疏微调:在RLVR上的效果显著低于预期,性能提升仅为SFT场景下的60%

- LoRA变体:标准LoRA配置在RLVR场景下出现性能不稳定现象

- 几何感知改进:基于三门理论改进的PEFT方法在RLVR上表现出更好的适应性

这些实验结果验证了研究团队的核心观点:RLVR在完全不同的优化机制下工作,需要专门设计的算法和方法。

理论验证与讨论

实验结果不仅验证了三门理论的预测,还为理解RLVR的成功机制提供了新的视角:

- 优化效率:非主方向学习避免了破坏模型的核心表示能力,实现了更高效的参数利用

- 稳定性保障:KL约束和几何引导共同确保了训练过程的稳定性

- 泛化能力:通过保持模型的主要几何特征,RLVR获得了更好的泛化性能

这些发现为设计下一代几何感知的RLVR专用算法提供了重要的理论基础和实践指导。