一、引言

作为一名 AI 应用开发者,我一直对智能体的 "从无到有" 充满好奇。最近深度体验了ModelEngine Nexent平台的智能体功能,从创建到部署的全流程走下来,被其 "知识库自动总结、提示词自动生成" 等自动化能力彻底圈粉。今天就把这份体验整理成一篇博客,带大家看看智能体开发如何从繁琐变丝滑~

官网地址:https://modelengine-ai.net/#/home

二、安装ModelEngine Nexent

在使用ModelEngine Nexent之前,我们需要将其官方的开源仓库代码克隆下来,用docker启动,所以我们需要电脑配置有docker。

GitHub仓库链接:https://github.com/ModelEngine-Group/nexent

由于我的是macbook,之前安装过了homebrew,所以安装docker直接使用一行命令即可:

python

brew install --cask docker安装完毕后,用 open -a Docker 启动docker即可。

安装好docker以后,我们在项目文件夹下的终端运行以下命令:

python

git clone https://github.com/ModelEngine-Group/nexent.git

cd nexent/docker

cp .env.example .env # fill only necessary configs

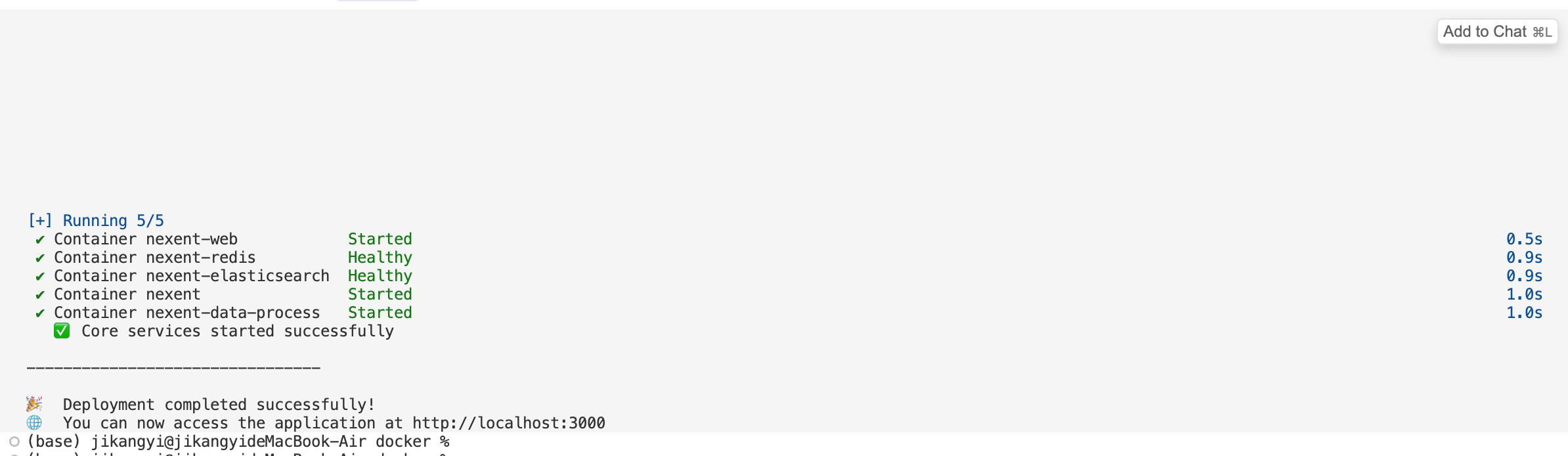

bash deploy.sh部署成功后如下图所示:

直接访问http://localhost:3000/zh既可成功进入页面。

三、ModelEngine Nexent实测

3.1 配置模型

点击快速配置:

进来可以看到如下界面:

这里我们需要做的是,修改智能体应用的名称为我们想要的智能体主题相关名称,然后添加详细的描述。这里我命名为:"AI技术趋势顾问",然后描述里填写如下内容:

AI技术趋势顾问是一款用来咨询近期AI发展趋势的专家顾问,在最近人工智能蓬勃发展的时期,我们需要一款这样的顾问,为你提供AI每日快讯,并回答你对于各种各样新型AI技术的提问。

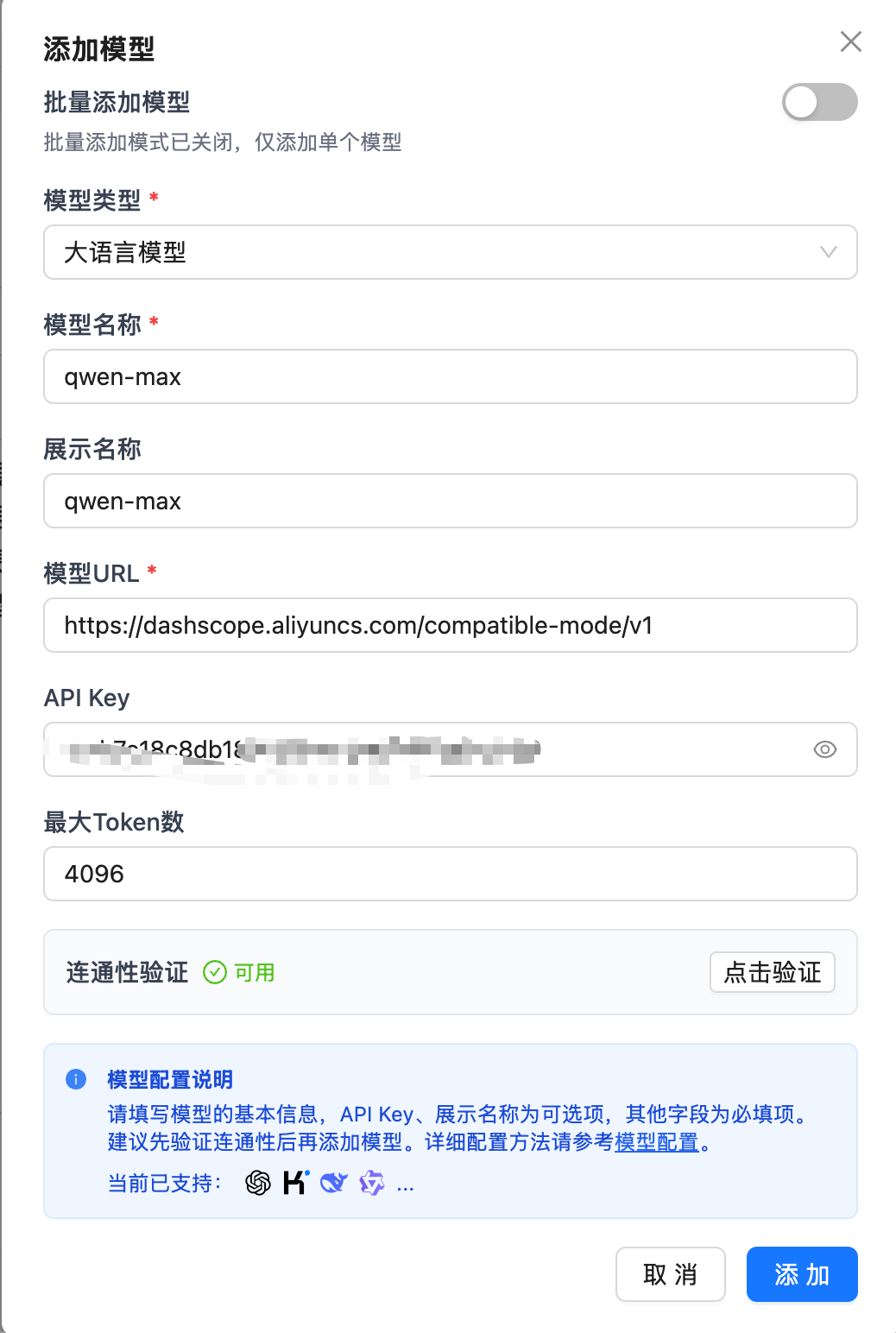

然后我们需要添加一款自定义的模型,这里我推荐使用阿里的qwen-max,可以访问https://bailian.console.aliyun.com/?spm=5176.29619931.J_SEsSjsNv72yRuRFS2VknO.2.775e405f0hhwJz&tab=model#/api-key创建自己的apikey,然后模型URL地址为:https://dashscope.aliyuncs.com/compatible-mode/v1。填写完url地址以及apikey以后,记得测试下连通性,如果显示可用,即为配置成功。

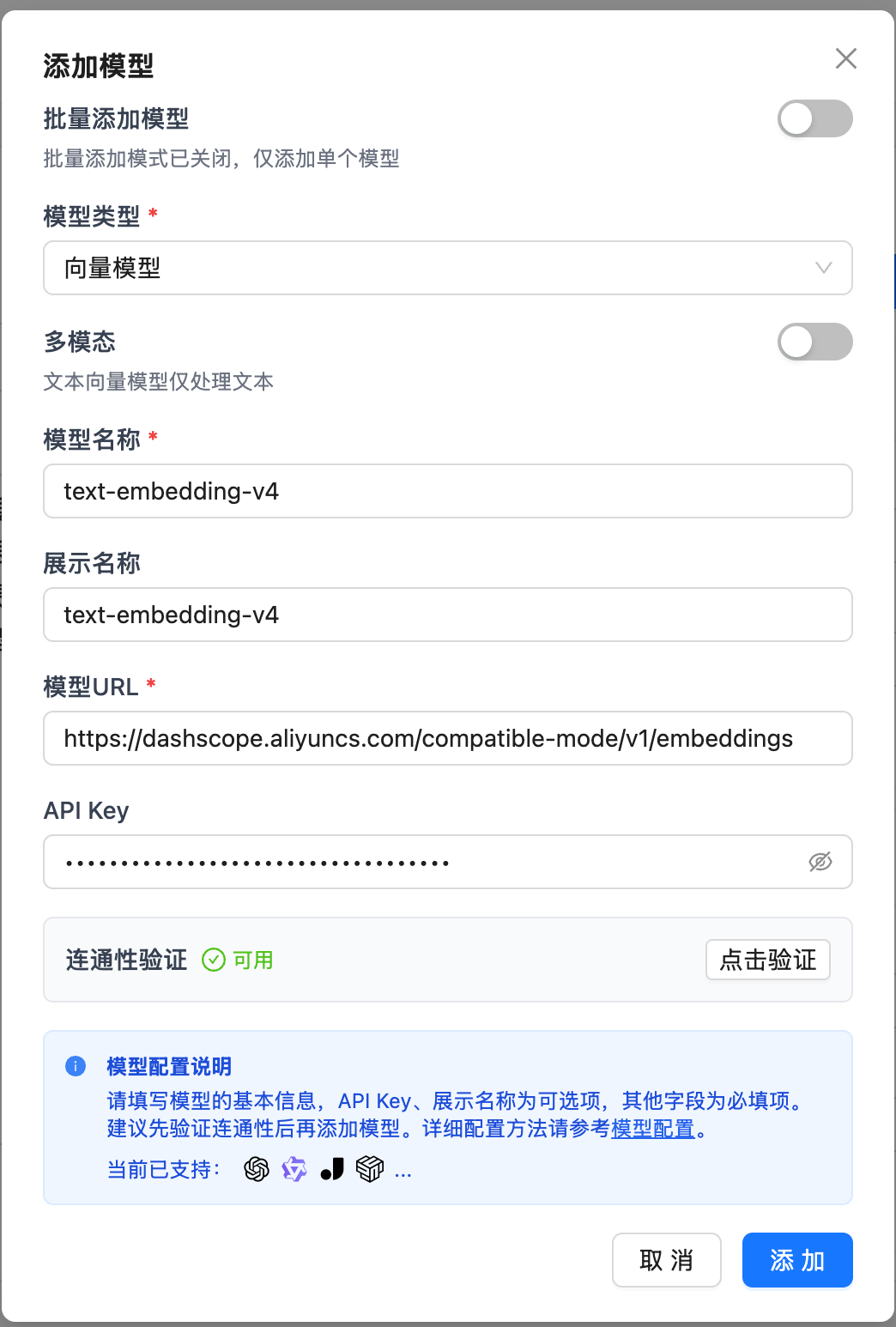

同理,我们也配置一个向量模型,这里向量模型还是用阿里的"text-embedding-v4"。

同理,我们也配置一个向量模型,这里向量模型还是用阿里的"text-embedding-v4"。

我们目前只需要配置一个大语言模型和文本向量模型即可,配置完成后点击下一步进行智能体创建。

3.2 创建智能体

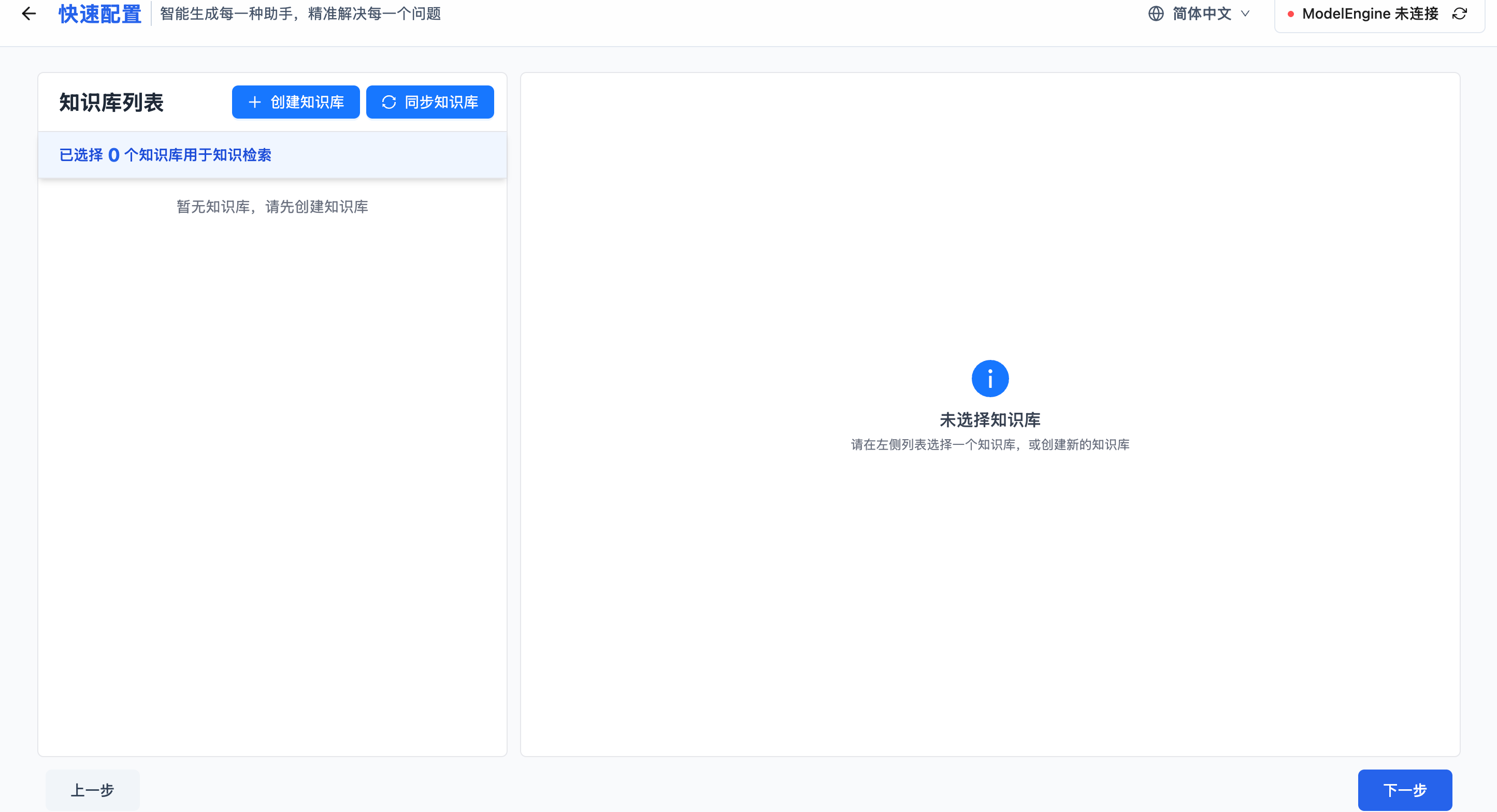

点击下一步后,会进入到知识库创建页面,在这里我们可以上传我们的知识库文件,让大模型用来检索回答一些专业领域的知识内容。

3.3 知识库创建

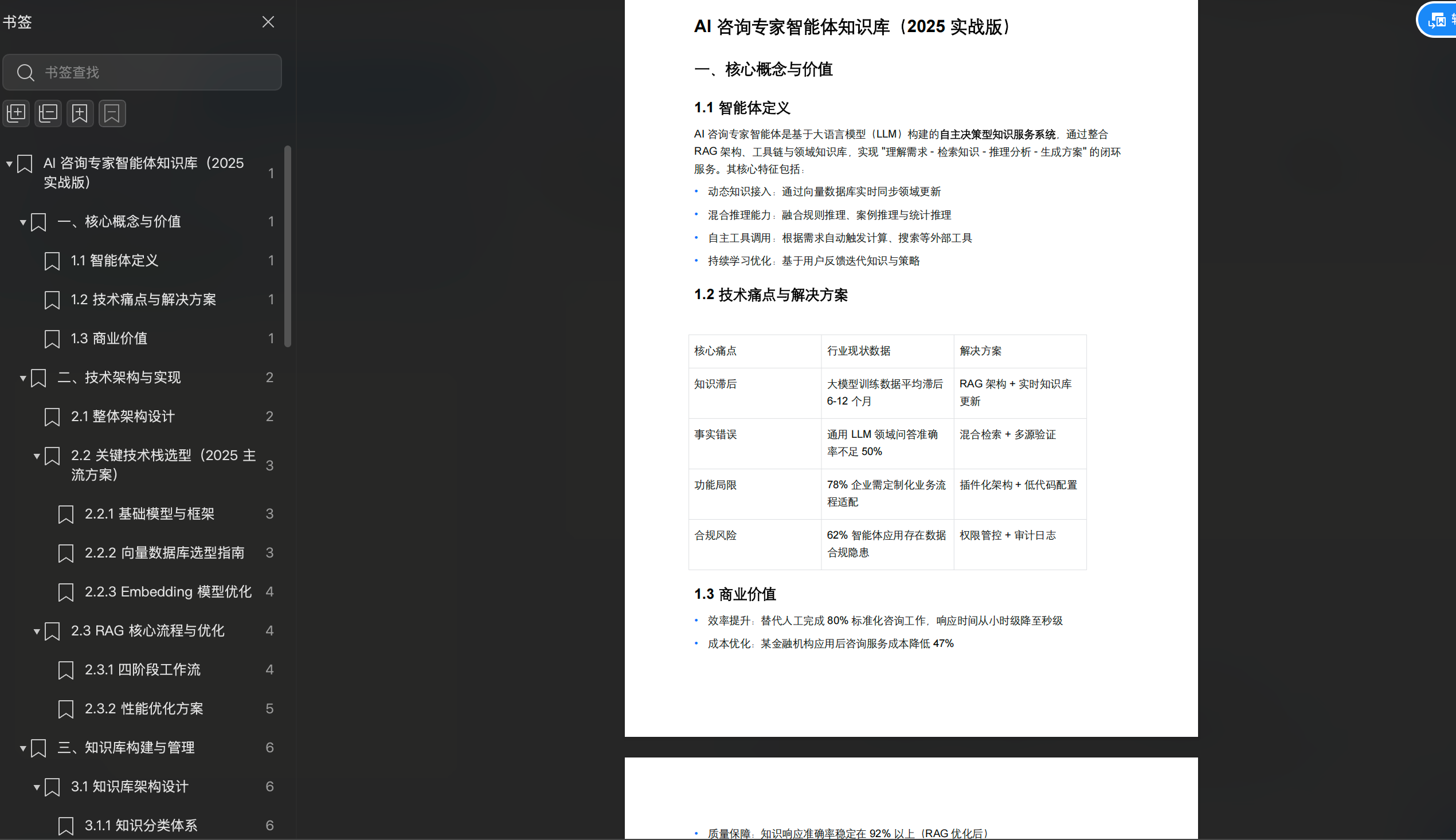

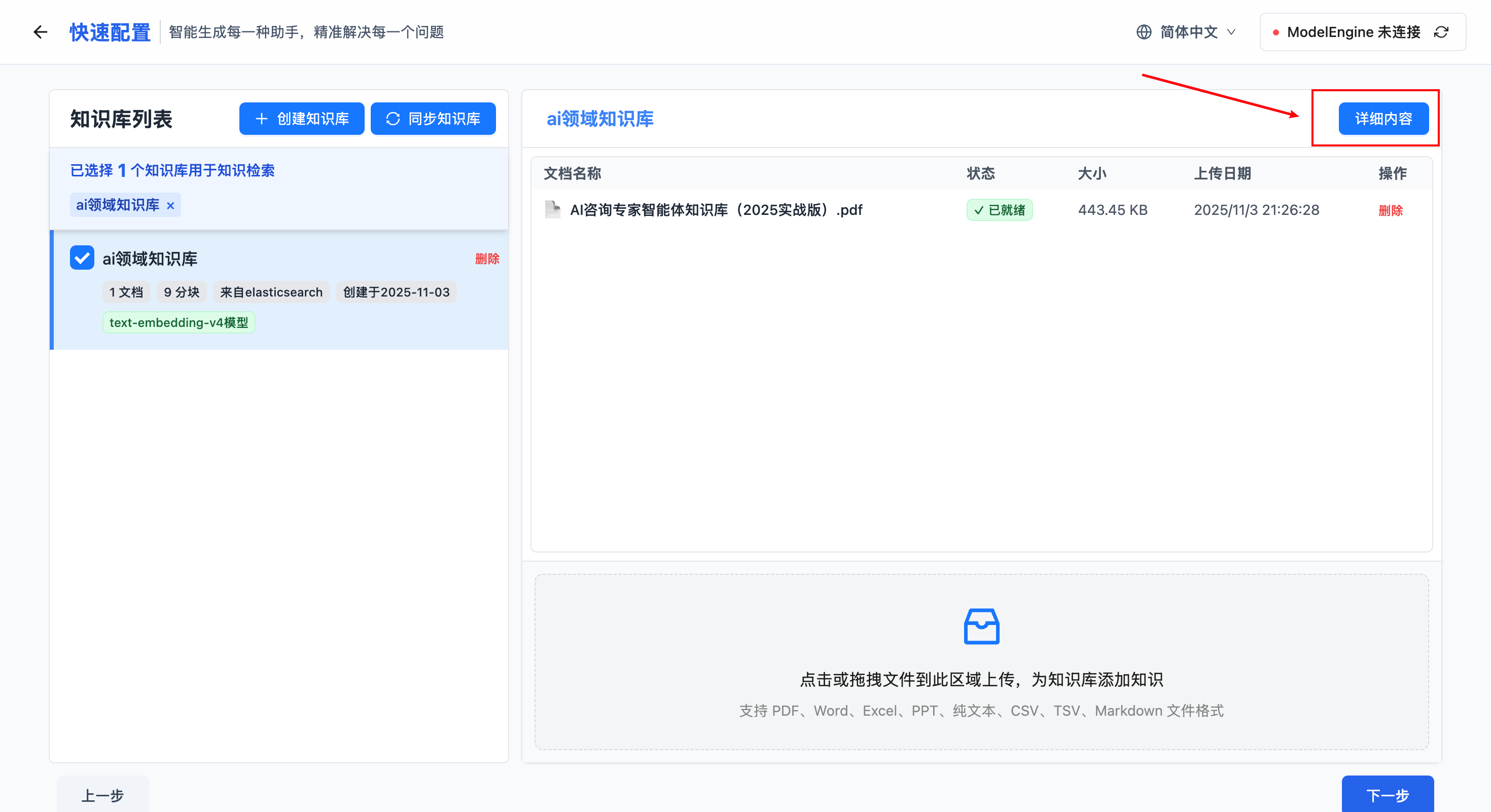

刚好我这里有一篇《AI咨询专家智能体知识库(2025实战版)》,就以此当知识库上传上去。

上传上去后,会先对文档进行一个解析,这里不得不提一点,ModelEngine Nexent可以支持上传的数据库文件类型特别丰富,基本囊括了所有我们常见的格式。这里我上传的就是pdf版本,众所周知pdf解析十分麻烦,但是ModelEngine Nexent还是以秒级响应的速度进行了解析并入库。

上传完数据库并看见状态为入库中,我们就可以点击下一步,配置我们自己的agent智能体了。

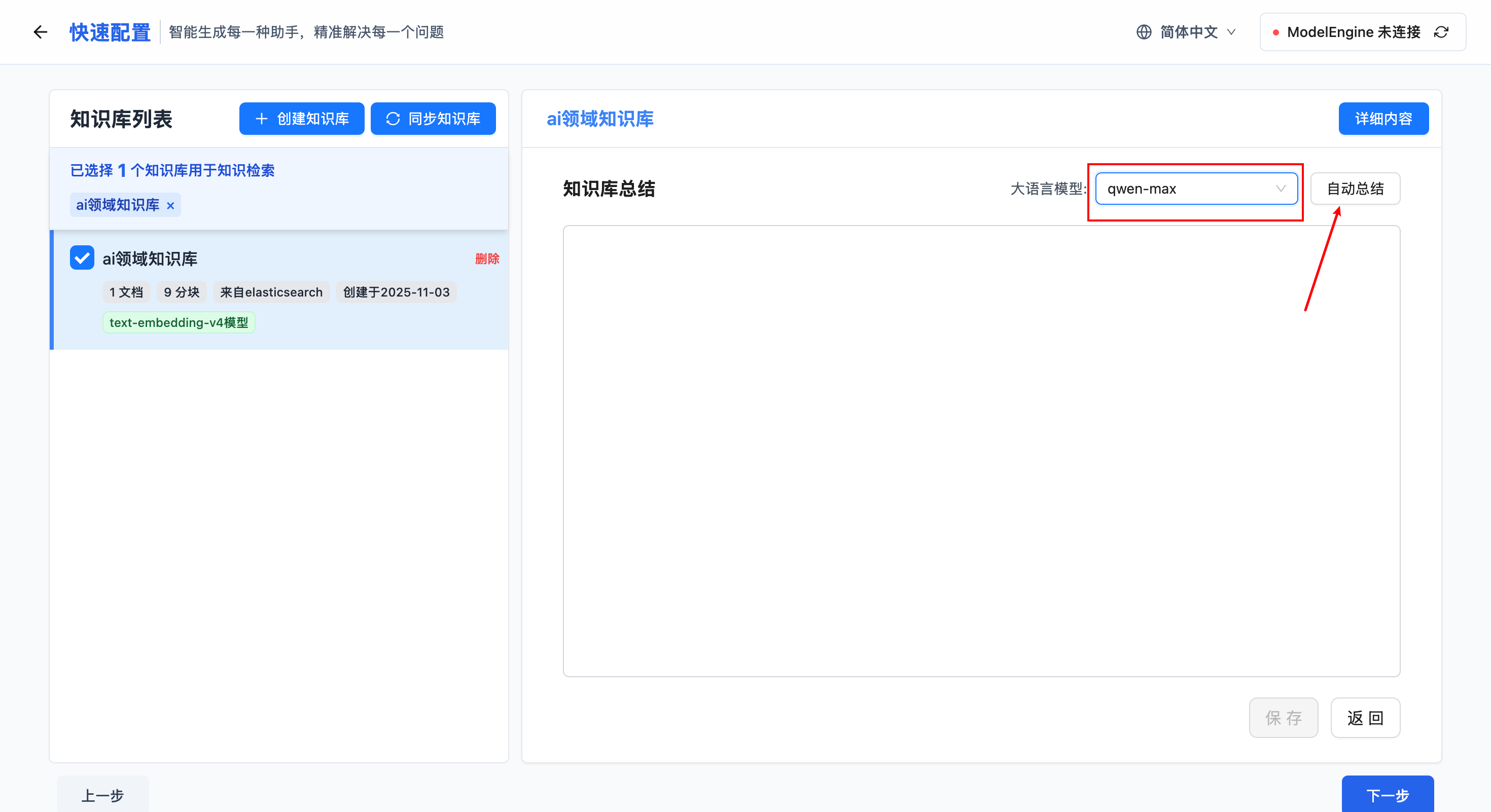

如果你想要进行知识库总结,我们可以在知识库文档状态变为已就绪时,点击右上角的详细内容。

然后我们就可以看到自动总结按钮,选好我们配置的大模型点击自动总结即可。

点击自动总结以后,大概等10s左右,即能完成总结。

可以看到我们大概2000多字的文档,这里的知识库总结只是把我们知识库文档的大概内容进行了一个总结,只需要短短四行内容即可完成整个文档的总结。这一总结可在检索时提供给LLM,理解每个不同知识库的内容,选择合适的知识库进行检索,提升准确率。

总结完知识库后,接下来我们就可以点击保存并点击下一步,进行智能体的详细配置操了。

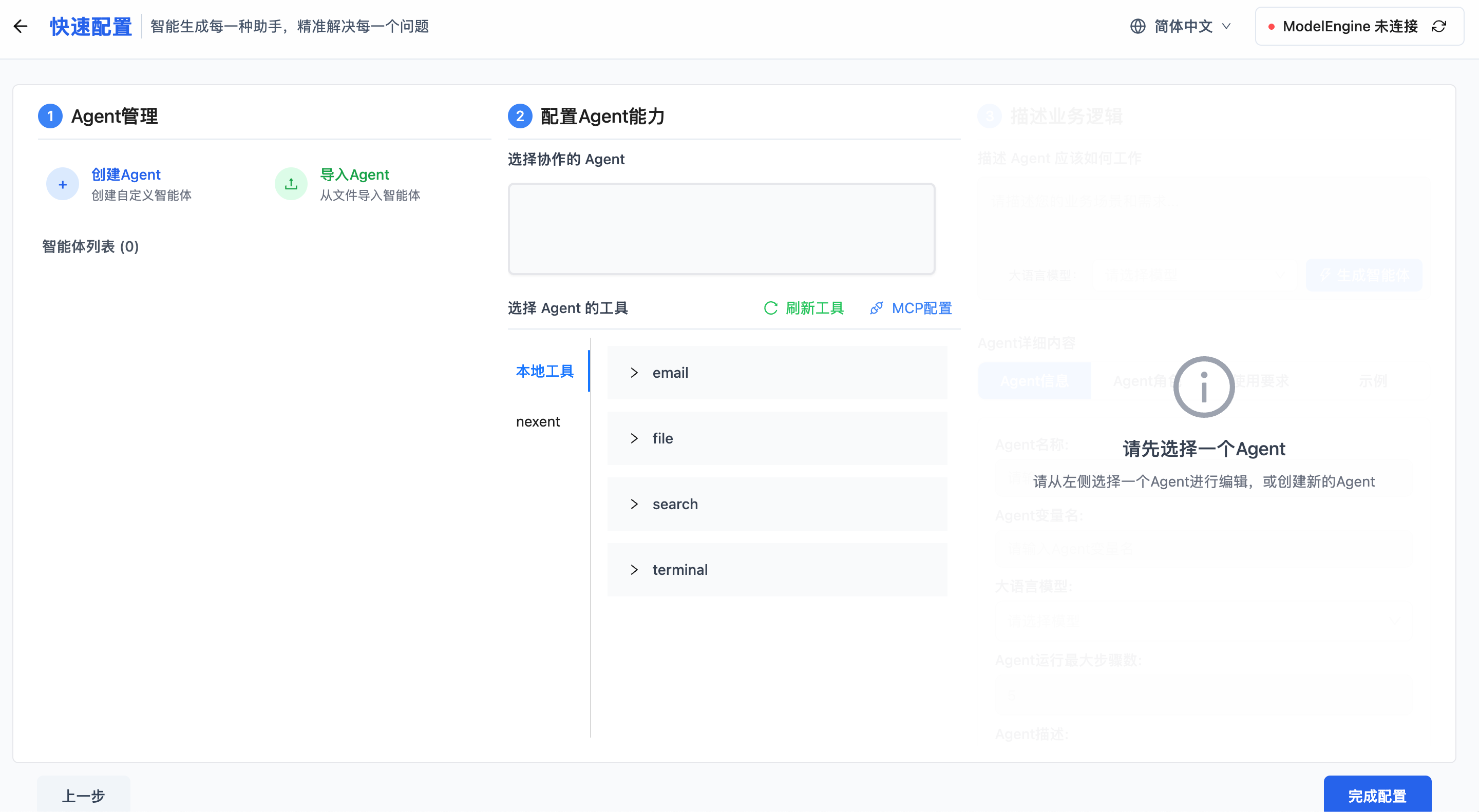

这里我们就不做什么多智能体协作了,因为AI顾问只需要一个专家智能体即可,如果我们需要复杂的项目开发智能体,那就可以用上ModelEngine Nexent的多智能体协助功能,这样会极大的提高开发效率以及开发质量。

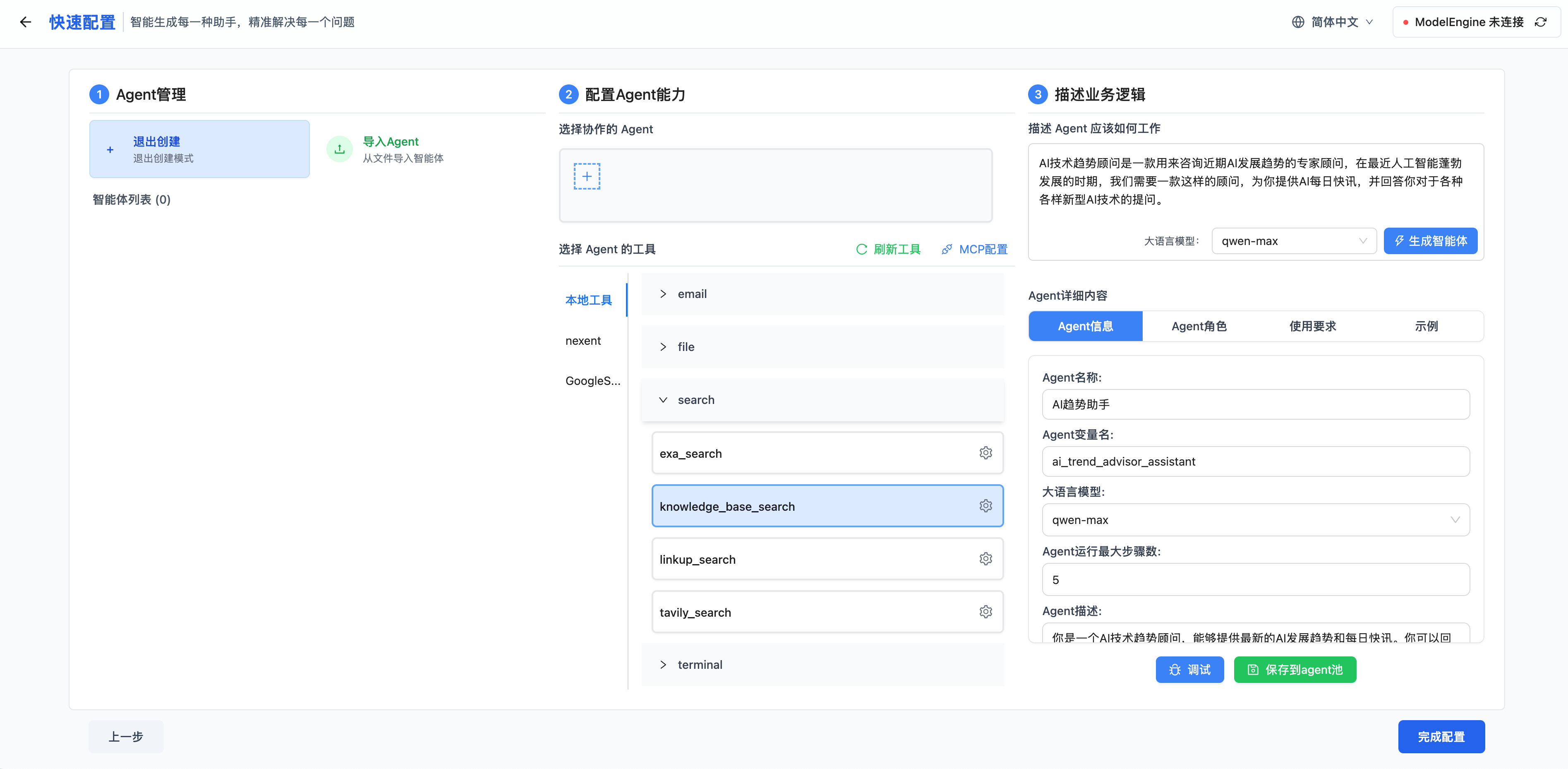

这里需要注意一个点,就是所有知识库以及工具的调用,都需要先开启其特定的功能才可以正常使用,比如这里我们需要用到知识库检索,那么就要开启知识库的knowledge_base_search工具。

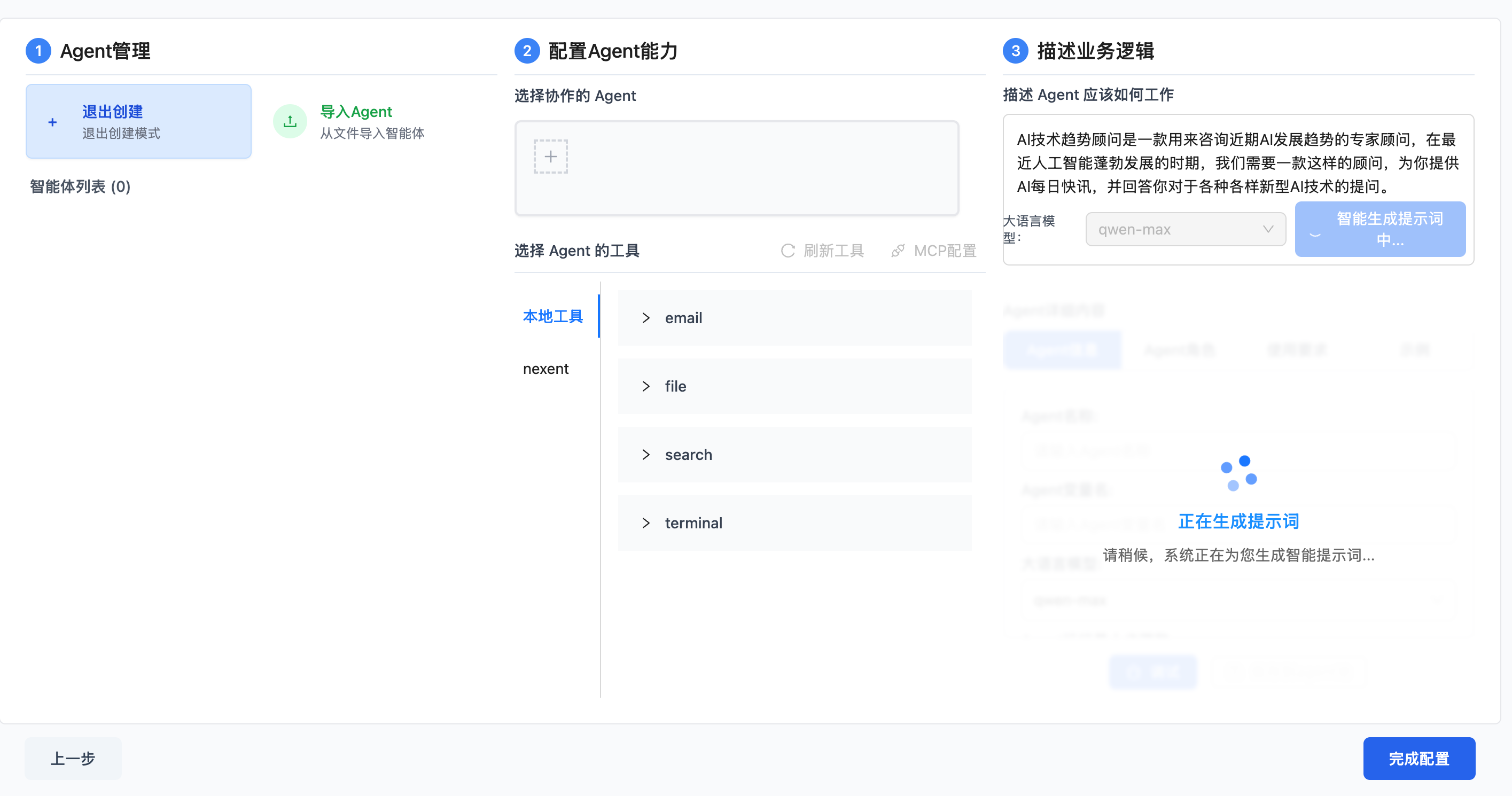

这里我在配置智能体的时候,发现点击创建智能体后,只需要在右边描述我们的智能体业务逻辑,即可一键生成智能体,这是我在coze等平台上无法体验到的,它支持一键生成提示词,这样我们就不需要每次为了写提示词而绞尽脑汁了~

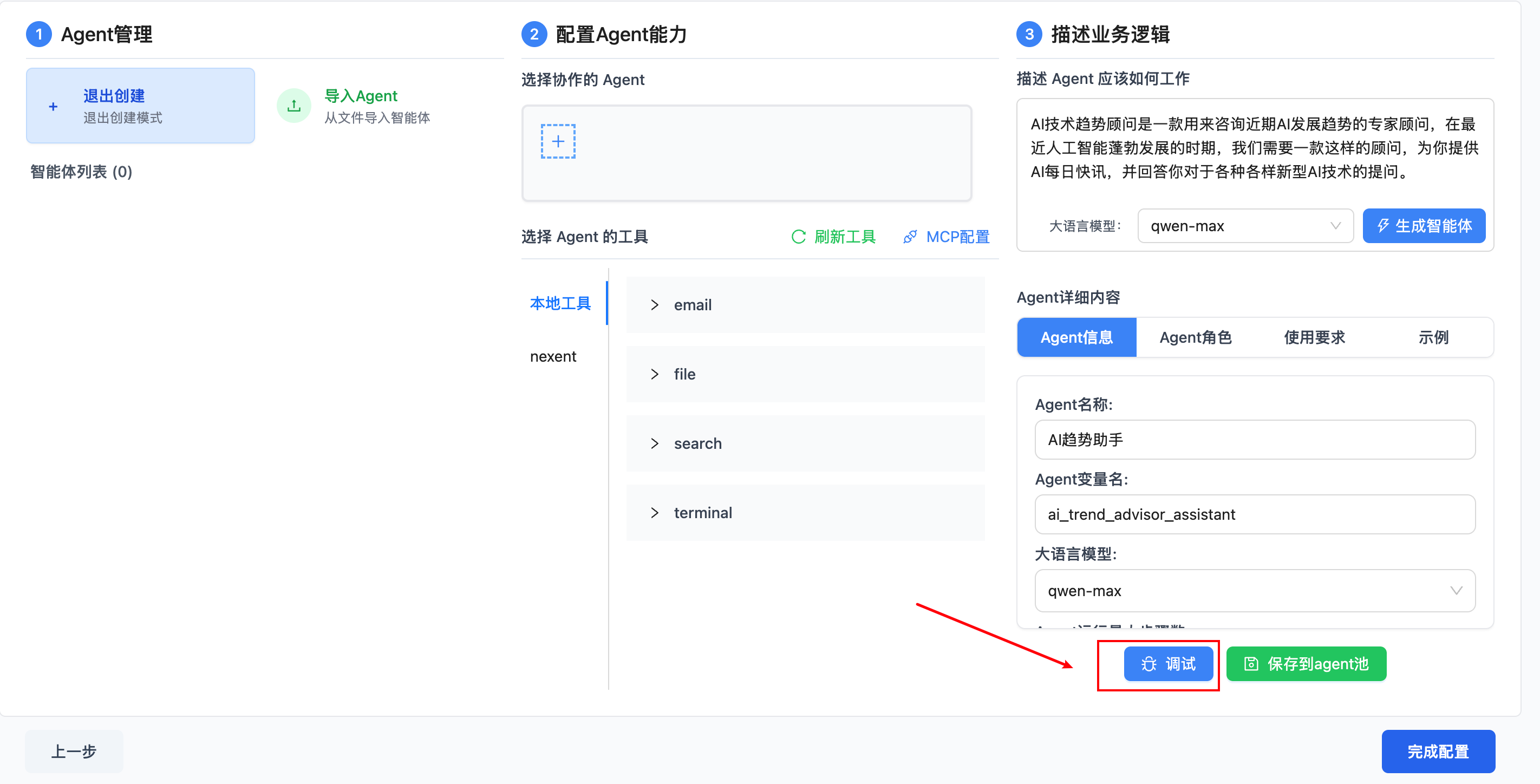

一键生成以后,我们先不要着急完成配置,可以先点击右下角的调试按钮,我们先进去调试一下,看看效果如何,如果效果不好,我们可以自己进行微调,毕竟智能体的真是需求,只有我们自己才知道,其他的便利操作都是辅助作用。

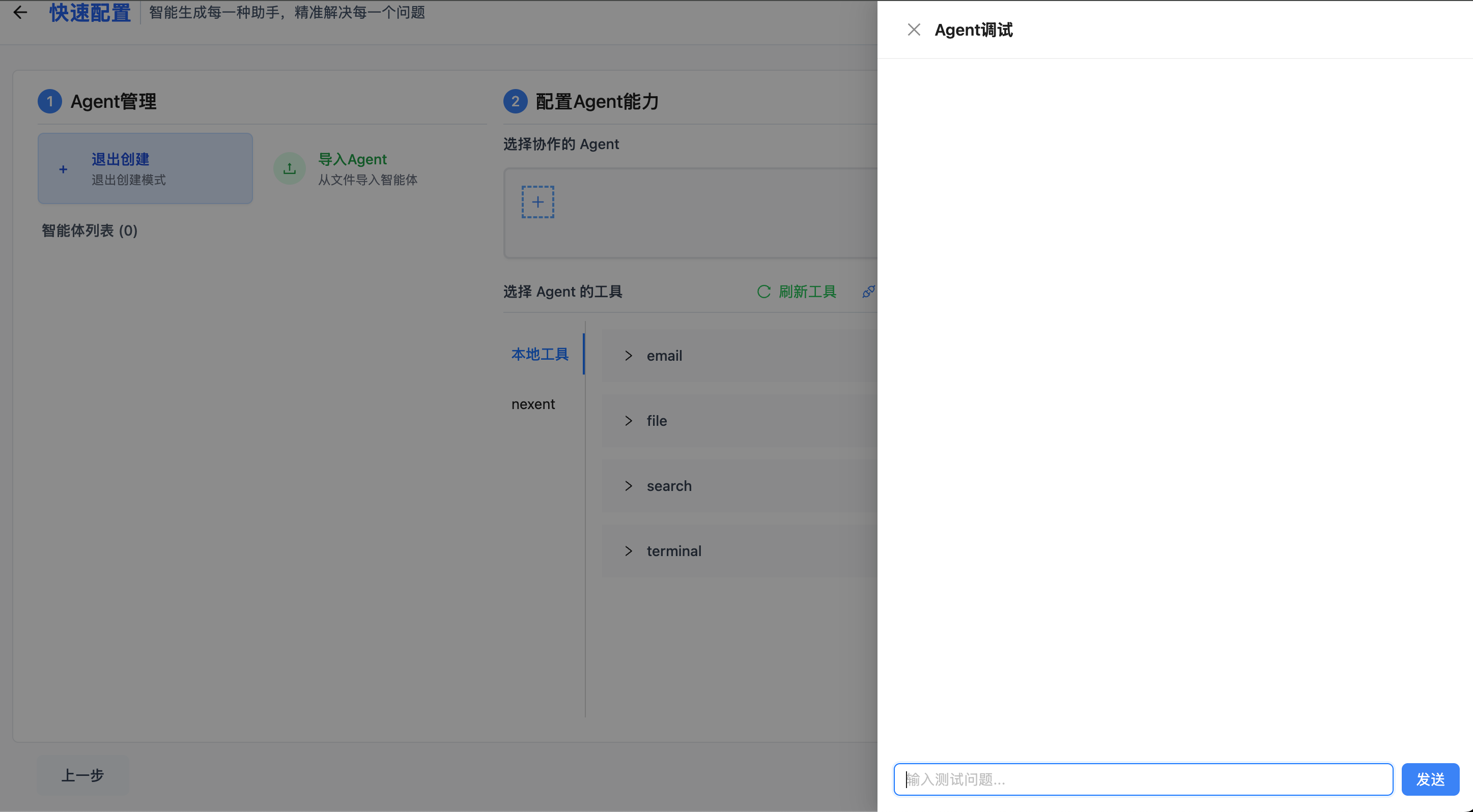

点击调试以后,我发现ModelEngine Nexent是直接在右边生成一个小窗口让我们测试,这跟其他平台的页面跳转截然不同,这种调试窗口更利于修改agent智能体的配置信息。

这里我们既然已经上传了自己的知识库,那么就提问它知识库里的相关内容,比如提问:"大模型存在'知识滞后'和'事实错误'两大痛点,知识库中提到的解决方案分别是什么?有具体数据支撑效果吗?"。

可以看到它确实从我的知识库里面检索了相关内容并进行了回答,而且实测速度特别快,我几千字的文档1s就检索到了我提问的问题在知识库里的答案。

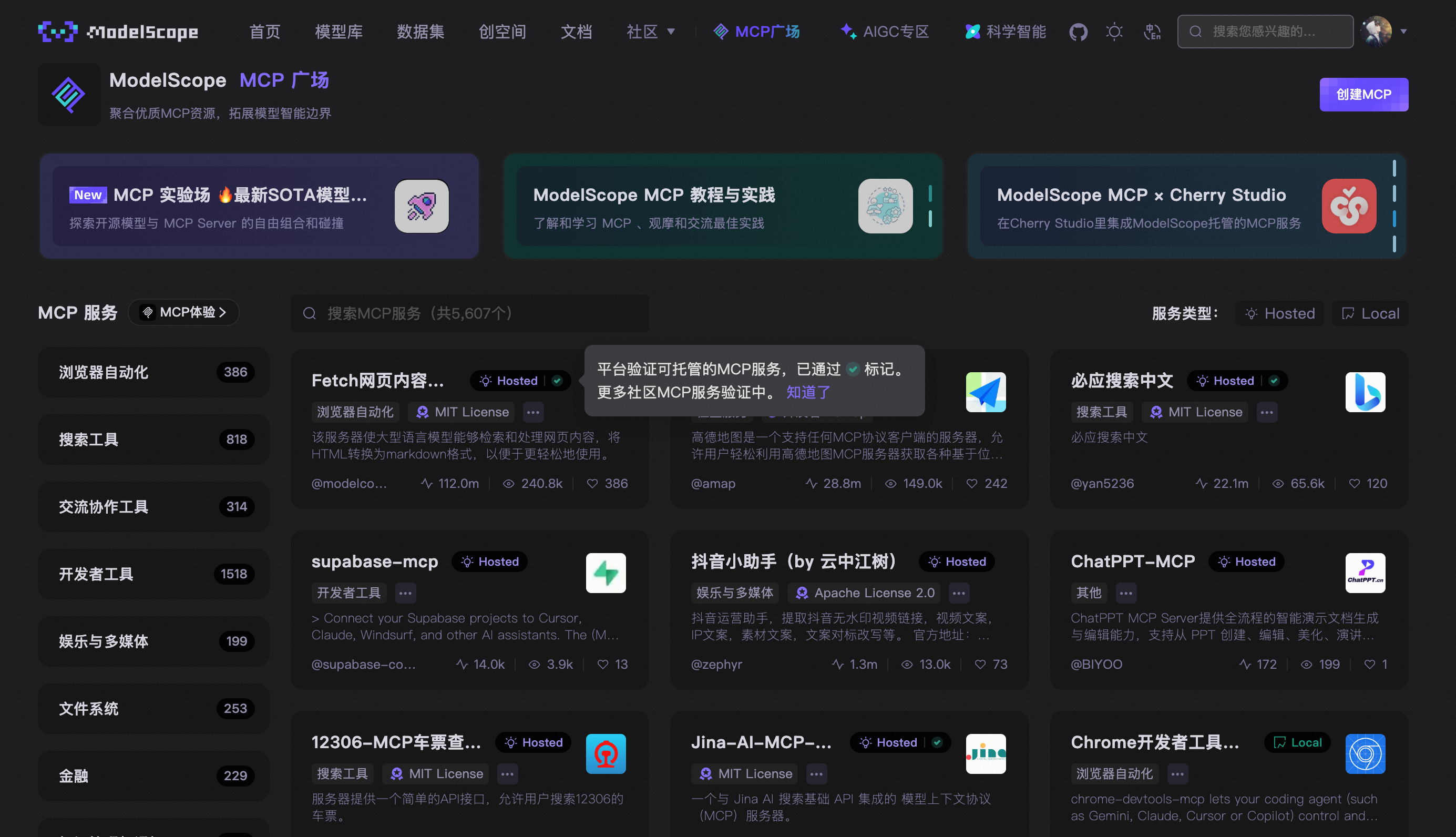

3.4 MCP服务接入

ModelEngine Nexent不仅能够配置工具,还可以接入MCP服务,众所周知,MCP服务是Agent智能体的"能力拓展中心",接入后能让智能体调用更多模型和工具。这里找寻MCP服务我特别推荐阿里的modelscope平台:

在这里我们可以找寻到任何自己想要的MCP服务,这里我选择了谷歌搜索引擎的mcp服务,配置起来也特别简单:

- 创建Google Cloud项目: 访问Google Cloud Console并创建一个新项目。

- 启用Custom Search API: 在你的项目中,导航至"API和服务" > "库",搜索并启用"Custom Search API"。

- 获取API Key: 在"API和服务" > "凭据"页面,创建一个新的API密钥并妥善保管。

- 创建自定义搜索引擎: 访问Programmable Search Engine页面,创建一个新的搜索引擎。在设置中,确保开启"在整个网络中搜索"选项,然后复制你的"搜索引擎ID"。

拿到apikey和搜索引擎id以后,我们可以直接在modelscope的谷歌搜索mcp站点最右边填入自己的apikey和搜索引擎id就可以生成ModelEngine Nexent所需的sse协议mcp服务。

将其配置以后就可以正常使用,测试下连通性也没有问题:

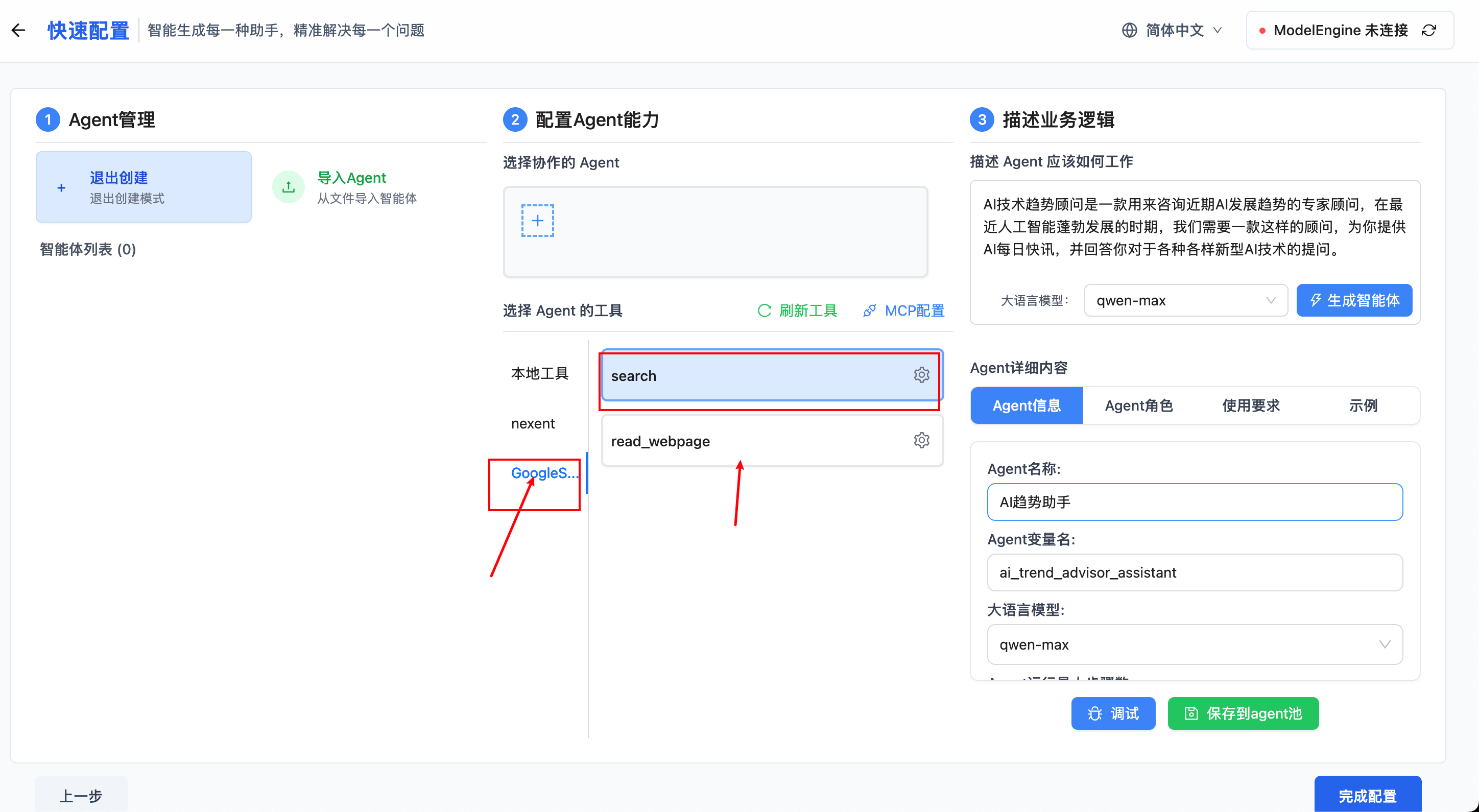

这里我们不要以为配置好mcp服务器就好了,其实还得我们自己选择开启下:

这里需要刷新下工具,然后选择我们自己配置的mcp工具,然后点击对应的功能,这里看到谷歌搜索mcp有两个功能,分别是网页搜索以及网页阅读功能,这里我们先开启网页搜索功能,让agent帮我们搜索下当今最火的低代码平台都有哪些:

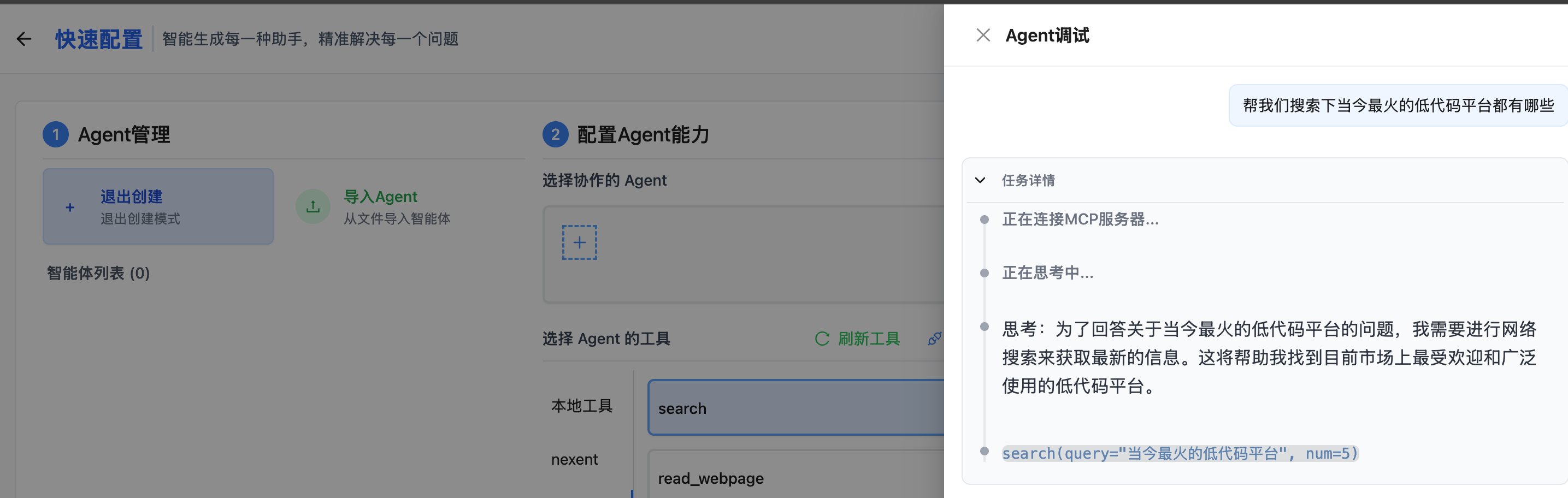

可以看到,这里agent会自己连接mcp服务器,然后开始调用工具去搜索相关内容,而且响应速度极快,给用户的体验特别好~

一切调试完毕以后,我们就可以点击右下角的发布按钮,将智能体进行发布,发布以后就会进入到类似于平时我们使用大模型聊天的一个界面,这时候我们需要再聊天框的左下角选择我们创建的智能体,然后就可以正常使用他了。

四、ModelEngine Nexent使用总结

从创建到部署,ModelEngine Nexent的智能体功能给我最大的感受是 "自动化驱动效率,模块化拓展能力":

● 知识库自动总结、提示词自动生成,把最耗时的 "知识整理、Prompt 设计" 工作自动化;

● 可视化开发、MCP 服务接入、多智能体协作,让开发者能快速组装出 "能力复合" 的智能体;

● 从调试到部署的全流程支持,保障了智能体从 "实验室" 到 "真实场景" 的落地性。

如果非要挑点改进空间,就是多智能体协作的 "逻辑配置" 对新手略复杂,若能增加 "场景化模板" 会更友好。但整体而言,ModelEngine Nexent的智能体功能已经把 "AI 应用开发" 的门槛降到了前所未有的高度 ------ 哪怕是非技术背景的从业者,也能快速打造出实用的智能体工具。

如果你也想体验 "从 0 到 1 打造智能体" 的乐趣,不妨试试 ModelEngine Nexent平台 ------ 亲测,真的会上瘾!