一、Zookeeper 概念

Zookeeper 是 Apache Hadoop 项目下的一个子项目,是一个树形目录服务。

Zookeeper 翻译过来就是 动物园管理员,他是用来管 Hadoop(大象)、Hive(蜜蜂)、Pig(小 猪)的管理员。简称zk

Zookeeper 是一个分布式的、开源的分布式应用程序的协调服务,属于CAP理论中的CP。

Zookeeper 提供的主要功能包括:

- 配置管理(配置中心)

- 分布式锁

- 集群管理(作为注册中心)

二、ZooKeeper 安装与配置

1、将下载的ZooKeeper放到/opt/ZooKeeper目录下

sh

mv apache-zookeeper-3.5.6-bin.tar.gz /opt/zookeeper/2、将tar包解压到/opt/zookeeper目录下

sh

tar -zxvf apache-ZooKeeper-3.5.6-bin.tar.gz 3、配置zoo.cfg

进入到conf目录拷贝一个zoo_sample.cfg并完成配置

sh

#进入到conf目录

cd /opt/zooKeeper/apache-zooKeeper-3.5.6-bin/conf/

#拷贝

cp zoo_sample.cfg zoo.cfg创建目录

sh

#打开目录

cd /opt/zooKeeper/

#创建zooKeeper存储目录

mkdir zkdata修改zoo.cfg

java

#修改zoo.cfg

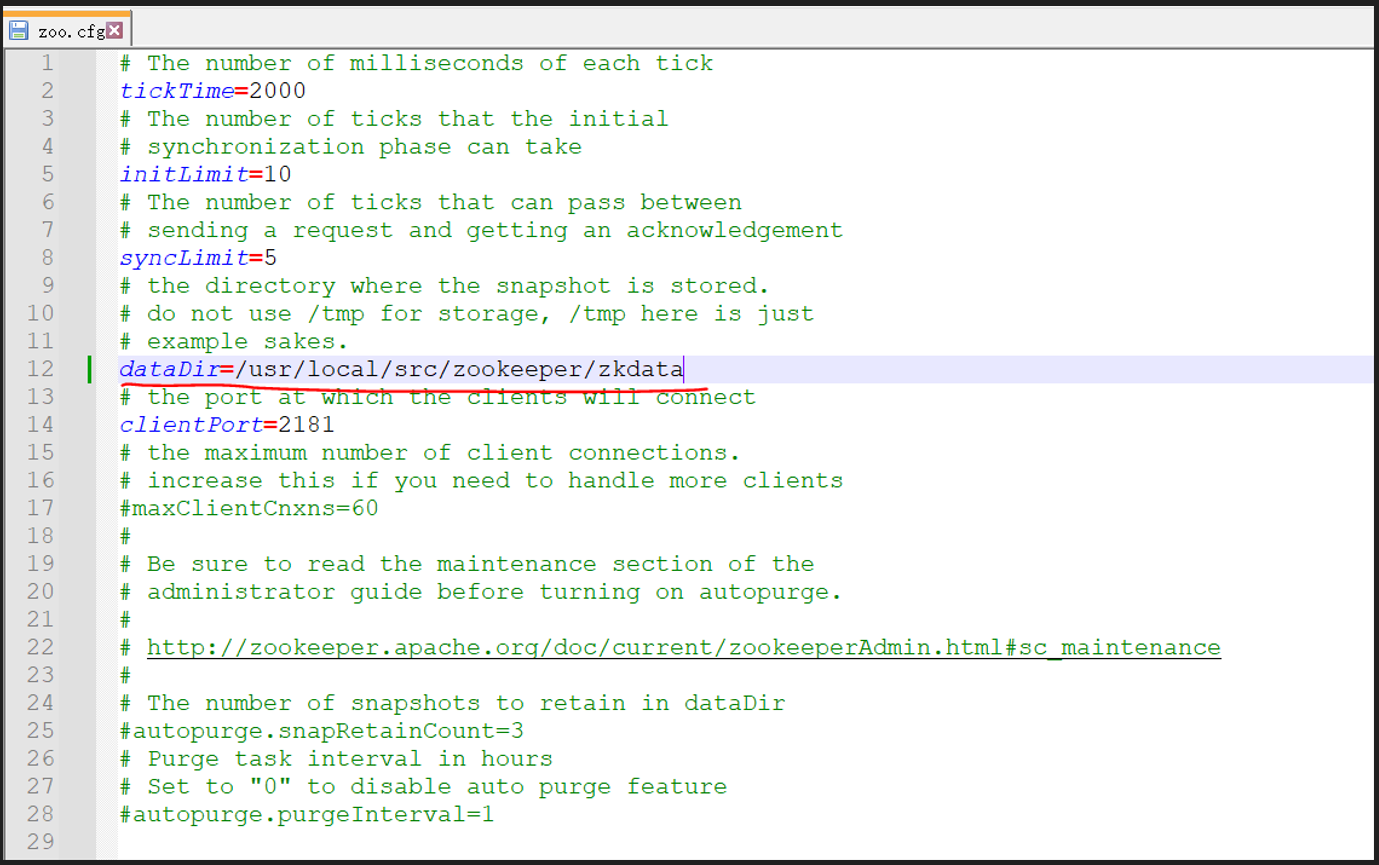

vi /opt/zooKeeper/apache-zooKeeper-3.5.6-bin/conf/zoo.cfg

修改dataDir为需要的路径后保存。

4、启动ZooKeeper

sh

cd /opt/zooKeeper/apache-zooKeeper-3.5.6-bin/bin/

#启动

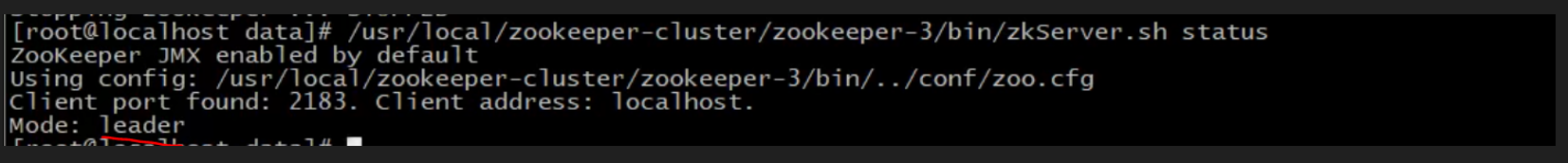

./zkServer.sh start5、查看ZooKeeper状态

java

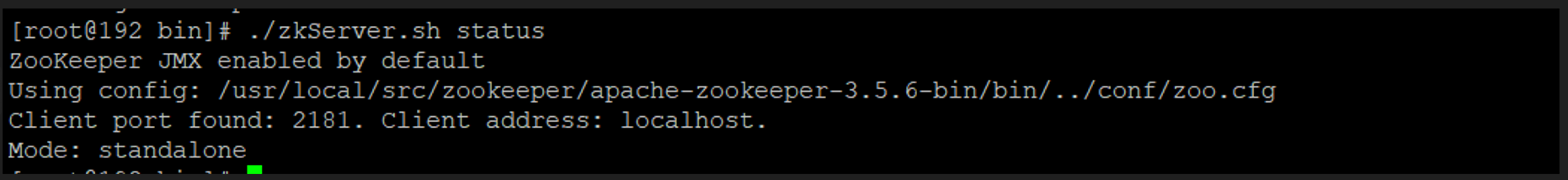

./zkServer.sh status

zookeeper启动成功。standalone代表zk没有搭建集群,现在是单节点

三、ZooKeeper 命令操作

3.1 Zookeeper数据模型

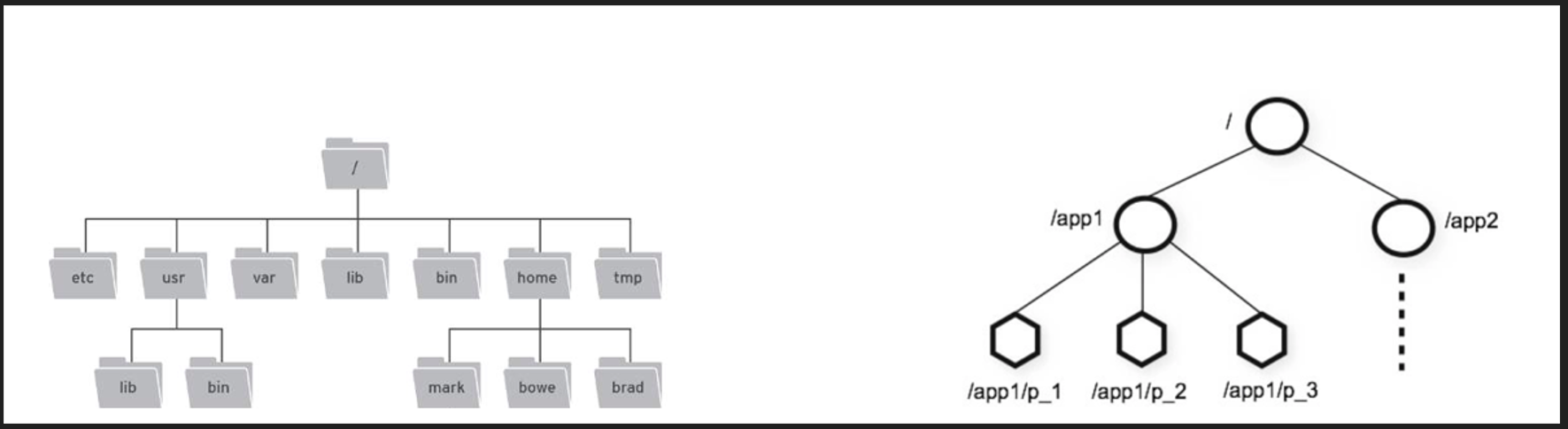

ZooKeeper 是一个树形目录服务,其数据模型和Unix的文件系统目录树很类似,拥有一个层次化结构。

这里面的每一个节点都被称为: ZNode,每个节点上都会保存自己的数据和节点信息。

节点可以拥有子节点,同时也允许少量(1MB)数据存储在该节点之下。

节点可以分为四大类:

- PERSISTENT 持久化节点

- EPHEMERAL 临时节点 :-e

- PERSISTENT_SEQUENTIAL 持久化顺序节点 :-s。顺序节点指的是,如上图,每个节点是有顺序编号的,1、2、3...

- EPHEMERAL_SEQUENTIAL 临时顺序节点 :-es

3.2 Zookeeper 服务端常用命令

sh

启动 ZooKeeper 服务: ./zkServer.sh start

查看 ZooKeeper 服务状态: ./zkServer.sh status

停止 ZooKeeper 服务: ./zkServer.sh stop

重启 ZooKeeper 服务: ./zkServer.sh restart 3.3 Zookeeper 客户端常用命令

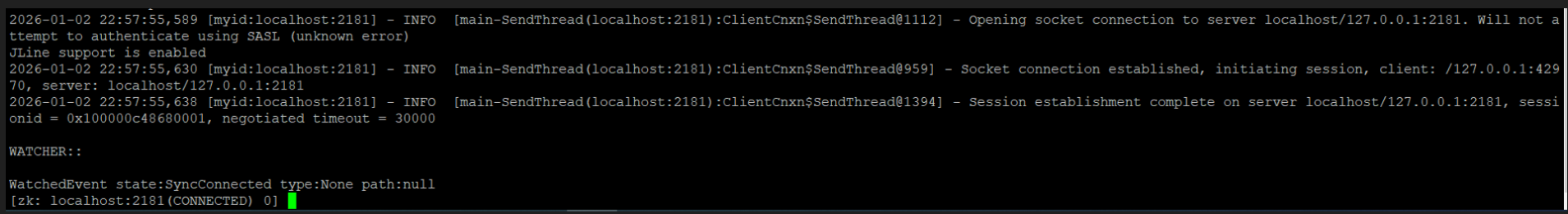

1、连接ZooKeeper服务端,默认端口2181

sh

./zkCli.sh --server ip:port连接成功

2、断开连接

sh

quit3、查看命令帮助

sh

help4、显示指定目录下节点

java

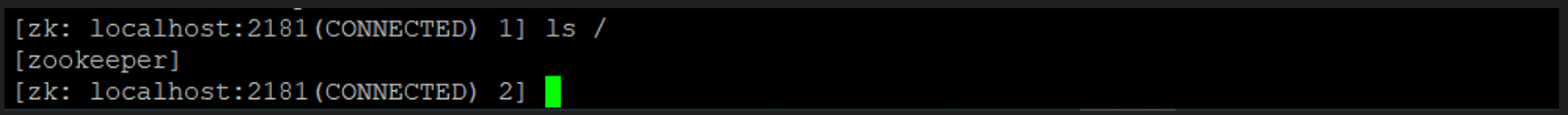

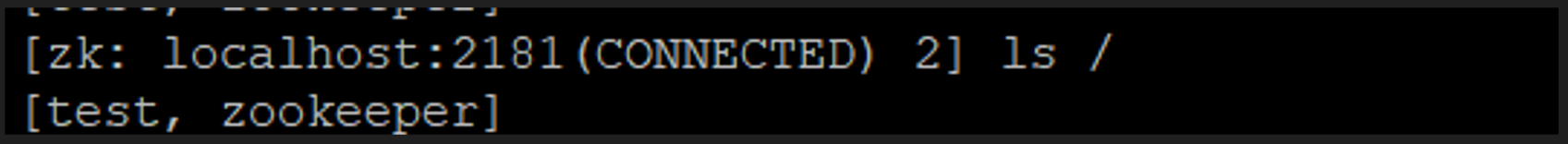

ls 目录

5、创建节点。这种方式默认创建的是持久化节点,即客户端断开重新连接,这个节点还是存在的

sh

create /节点path value6、获取节点值

sh

get /节点path7、设置节点值

sh

set /节点path value8、删除单个节点

sh

delete /节点path9、删除带有子节点的节点

sh

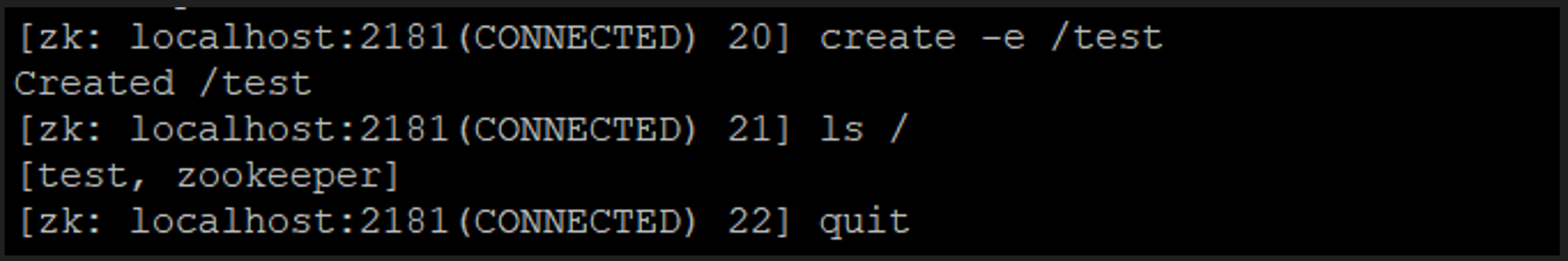

deleteall /节点path10、创建临时节点。临时节点在客户端断开连接后会被清除

sh

create -e /节点path value创建临时节点后退出

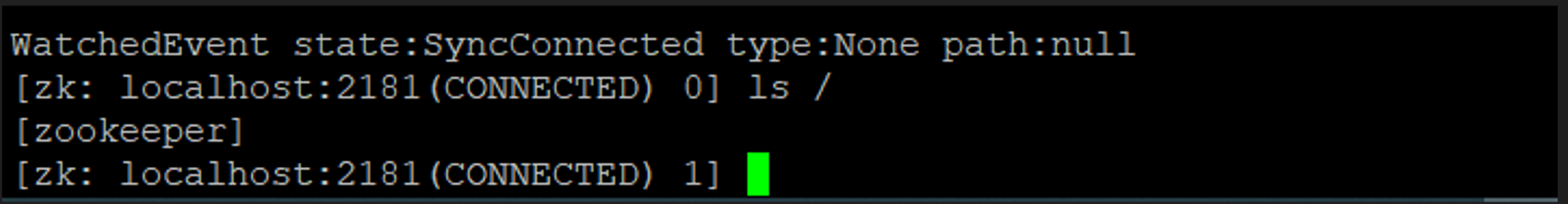

再次连接ZK,/test节点消失

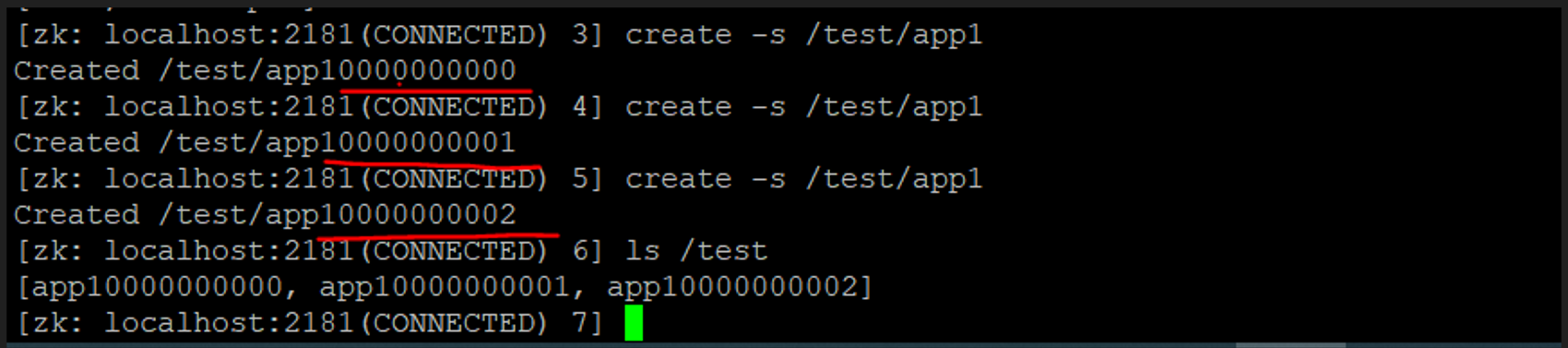

11、创建顺序节点

sh

create -s /节点path value可以看到是有顺序的

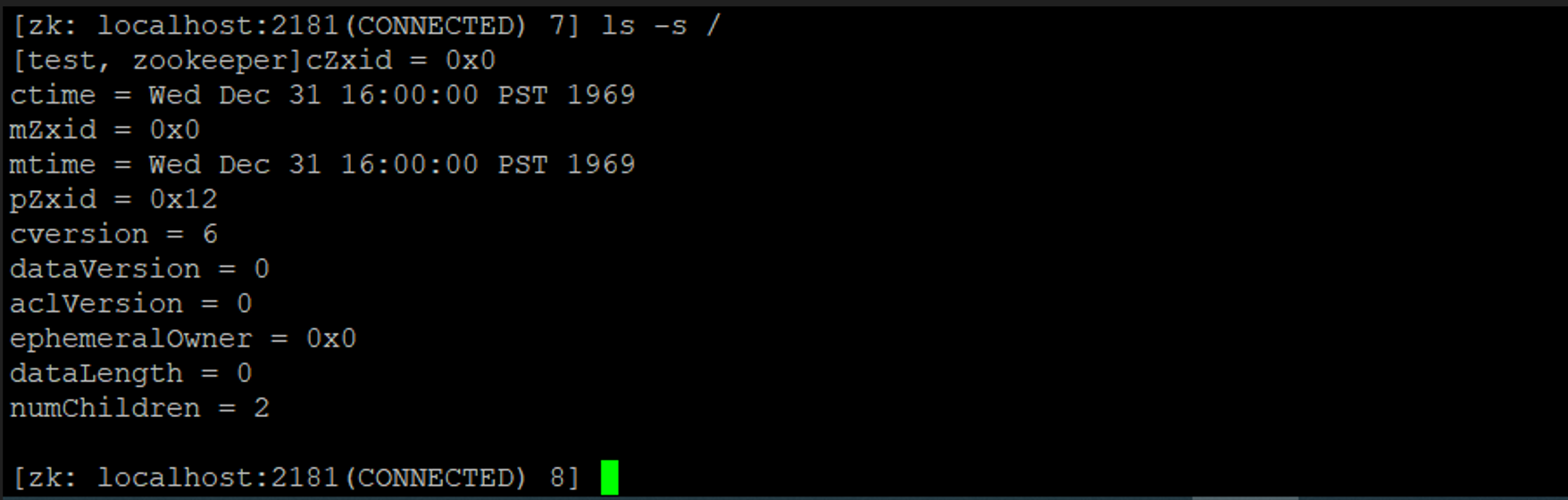

12、查询节点详细信息

java

ls --s /节点path

czxid:节点被创建的事务ID

ctime: 创建时间

mzxid: 最后一次被更新的事务ID

mtime: 修改时间

pzxid:子节点列表最后一次被更新的事务ID

cversion:子节点的版本号

dataversion:数据版本号

aclversion:权限版本号

ephemeralOwner:用于临时节点,代表临时节点的事务ID,如果为持久节点则为0

dataLength:节点存储的数据的长度

numChildren:当前节点的子节点个数

四、ZooKeeper JavaAPI 操作

4.1 Curator 介绍

Curator 是 Apache ZooKeeper 的Java客户端库。最初是 Netfix 研发的,后来捐献了 Apache 基金会,目前是 Apache 的顶级项目。Curator 项目的目标是简化 ZooKeeper 客户端的使用。

常见的ZooKeeper Java API :

- 原生Java API

- ZkClient

- Curator

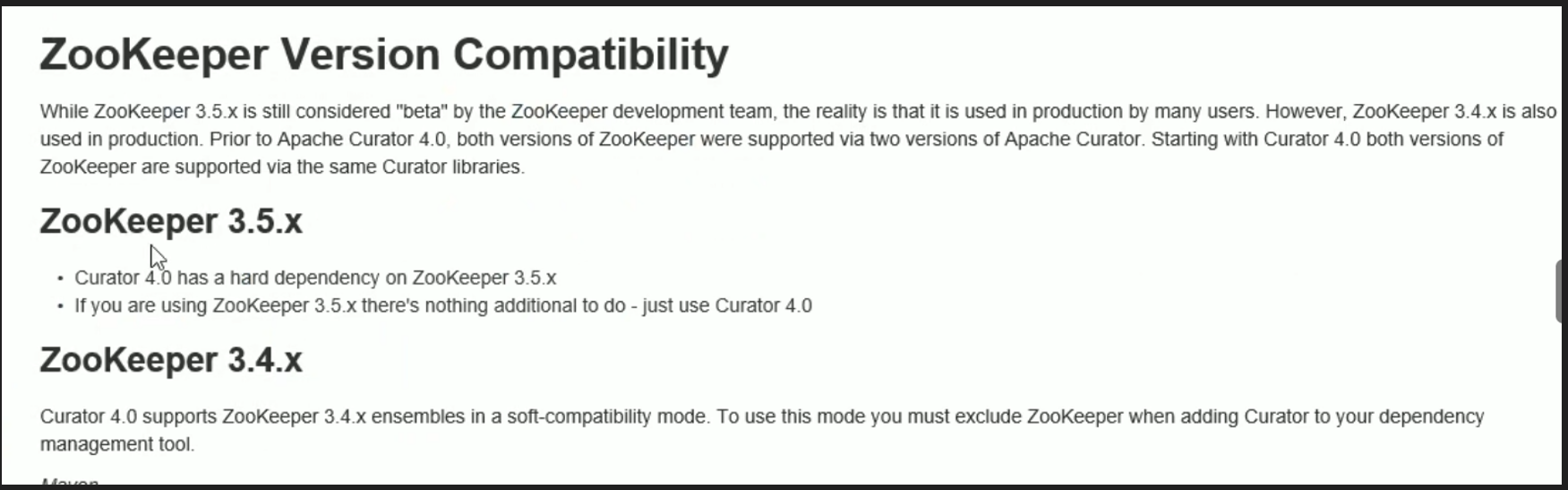

使用Curator来操作Zookeeper,所以对于二者的版本是有要求的。如果使用Zookeeper3.5版本,对应的Curator是4.0版本;同时Curator4.0版本兼容Zookeeper3.4版本

4.2 Curator API 常用操作

创建项目,pom.xml

xml

<dependencies>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.10</version>

<scope>test</scope>

</dependency>

<!--curator-->

<dependency>

<groupId>org.apache.curator</groupId>

<artifactId>curator-framework</artifactId>

<version>4.0.0</version>

</dependency>

<dependency>

<groupId>org.apache.curator</groupId>

<artifactId>curator-recipes</artifactId>

<version>4.0.0</version>

</dependency>

<!--日志-->

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-api</artifactId>

<version>1.7.21</version>

</dependency>

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-log4j12</artifactId>

<version>1.7.21</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>3.1</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

</configuration>

</plugin>

</plugins>

</build>4.2.1、建立连接

方式一

java

public class CuratorTest {

@Test

public void testConnect() {

/*

*

* @param connectString 连接字符串。zk server 地址和端口,多个地址的话中间以逗号隔开

* @param sessionTimeoutMs 会话超时时间 单位ms

* @param connectionTimeoutMs 连接超时时间 单位ms

* @param retryPolicy 重试策略

*/

//重试策略,3秒重试一次,一共重试10次

RetryPolicy retryPolicy = new ExponentialBackoffRetry(3000,10);

CuratorFramework client = CuratorFrameworkFactory.newClient("192.168.52.130:2181",

60 * 1000, 15 * 1000, retryPolicy);

client.start();

}

}方式二

java

public class CuratorTest {

@Test

public void testConnect() {

/*

*

* @param connectString 连接字符串。zk server 地址和端口,多个地址的话中间以逗号隔开

* @param sessionTimeoutMs 会话超时时间 单位ms

* @param connectionTimeoutMs 连接超时时间 单位ms

* @param retryPolicy 重试策略

*/

//重试策略,3秒重试一次,一共重试10次

RetryPolicy retryPolicy = new ExponentialBackoffRetry(3000,10);

CuratorFramework client = CuratorFrameworkFactory.builder()

.connectString("192.168.52.130:2181")

.sessionTimeoutMs(60 * 1000)

.connectionTimeoutMs(15 * 1000)

.retryPolicy(retryPolicy)

.namespace("itheima")

.build();

client.start();

}

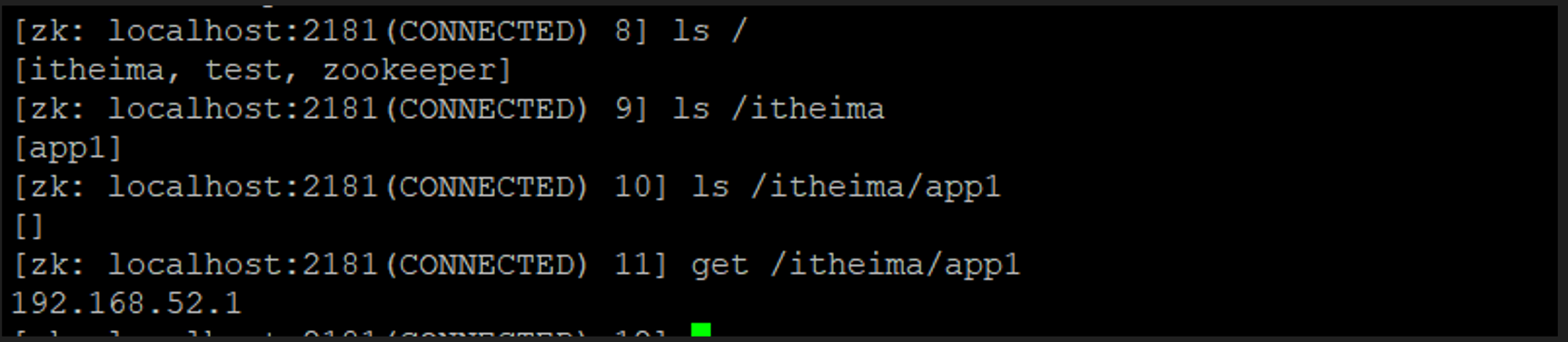

}.namespace("itheima"):指定命名空间,将itheima作为根目录,将来的一切操作都是基于itheima这个根目录进行操作的。

4.2.2、添加节点

- 基本创建

java

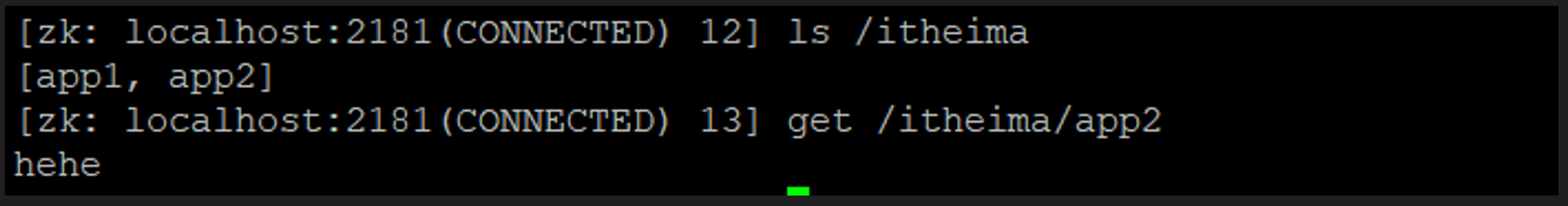

client.create().forPath("/app1");输出结果:

java

/app1运行代码之前:

运行代码之后:可以看到有了itheima和app1的路径,/itheima/app1这个节点的默认数据是这台机器的IP地址(创建节点没有指定数据,则将当前机器的IP作为数据)

- 创建带有数据的节点

java

client.create().forPath("/app2", "hehe".getBytes());

可以看到节点加上了,数据也有了。

- 设置节点的类型

上面调用create方法默认创建持久化节点。

下面代码创建了一个临时节点

java

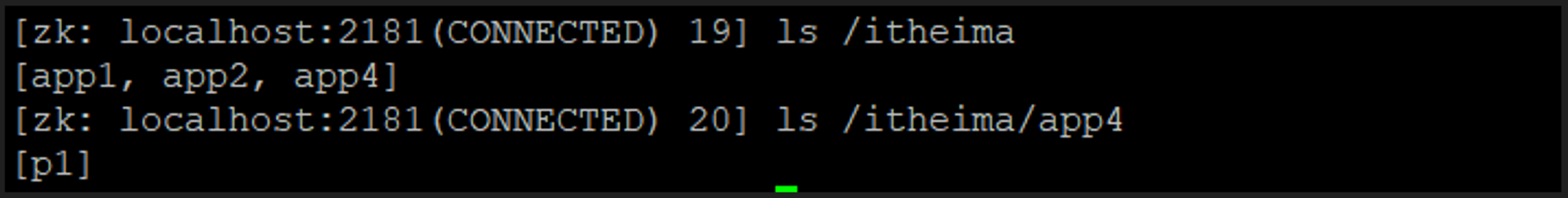

client.create().withMode(CreateMode.EPHEMERAL).forPath("/app3");- 创建多级节点

java

client.create().creatingParentsIfNeeded().forPath("/app4/p1");

4.2.3、查询节点

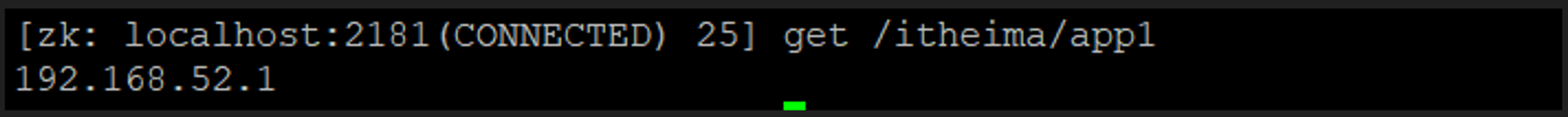

- 查询数据

java

public void testGet1() throws Exception {

//1. 查询数据:get

byte[] data = client.getData().forPath("/app1");

System.out.println(new String(data));

}输出结果:

java

192.168.52.1

- 查询子节点

java

@Test

public void testGet2() throws Exception {

// 2. 查询子节点: ls

List<String> path = client.getChildren().forPath("/");

System.out.println(path);

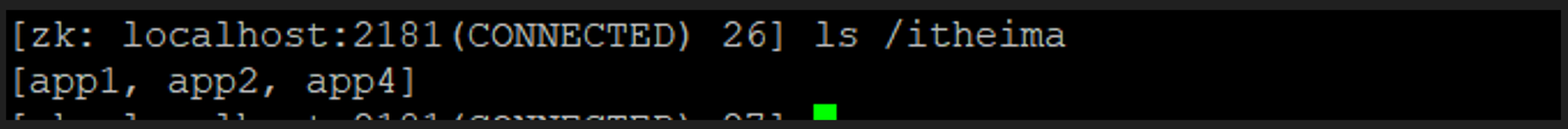

}输出结果:

java

[app2, app1, app4]

- 查询节点状态信息

java

@Test

public void testGet3() throws Exception {

Stat status = new Stat();

System.out.println(status);

//3. 查询节点状态信息:ls -s

client.getData().storingStatIn(status).forPath("/app1");

System.out.println(status);

}输出结果:

java

0,0,0,0,0,0,0,0,0,0,0

58,58,1767531369411,1767531369411,0,0,0,0,12,0,584.2.4、修改节点

- 修改数据

java

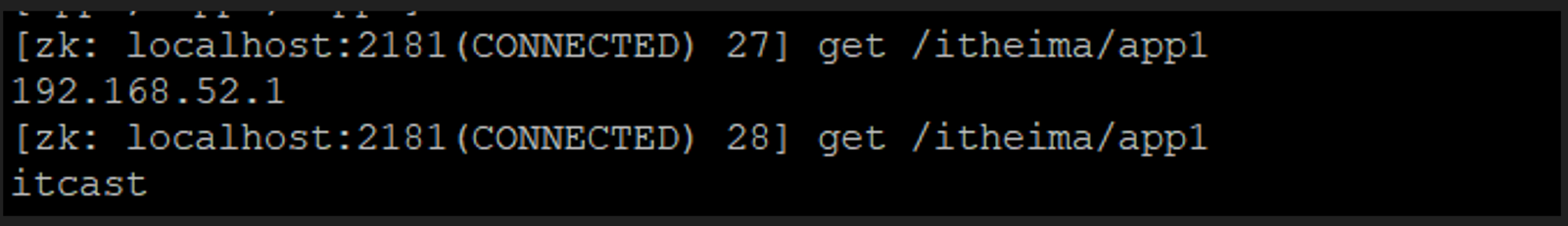

client.setData().forPath("/app1", "itcast".getBytes());修改前后的值

- 根据版本进行修改。和CAS乐观锁很像,如果在修改过程中其他人对数据做了修改,则本次修改会报错修改不成功;否则会修改成功。

java

@Test

public void testSetForVersion() throws Exception {

Stat status = new Stat();

client.getData().storingStatIn(status).forPath("/app1");

int version = status.getVersion();

System.out.println(version);

client.setData().withVersion(version).forPath("/app1", "hehe".getBytes());

}

可以看到,数据由itcast改为了hehe,版本号由1变成了2

4.2.5、删除节点

- 删除单个节点

java

client.delete().forPath("/app1");- 删除带有子节点的节点

java

client.delete().deletingChildrenIfNeeded().forPath("/app4");- 必须成功的删除

客户端发出的请求,很可能由于网络抖动导致请求超时了,导致这次请求失败。必须成功的删除。意思是如果请求超时了,可以再次重试

java

client.delete().guaranteed().forPath("/app2");- 回调

删除节点之后,自动执行回调函数里面的方法

java

public void testDelete4() throws Exception {

//4. 回调

client.delete().guaranteed().inBackground(new BackgroundCallback(){

@Override

public void processResult(CuratorFramework client, CuratorEvent event) throws Exception {

System.out.println("我被删除了~");

System.out.println(event);

}

}).forPath("/app1");

}运行结果:

java

我被删除了~

CuratorEventImpl{type=DELETE, resultCode=0, path='/app1', name='null', children=null, context=null, stat=null, data=null, watchedEvent=null, aclList=null, opResults=null}4.2.6、Watch事件监听

ZooKeeper 允许用户在指定节点上注册一些Watcher(监听器),并且在一些特定事件触发的时候,ZooKeeper 服务端会将事件通知到感兴趣的客户端上去,该机制是 ZooKeeper 实现分布式协调服务的重要特性。

ZooKeeper 中引入了Watcher机制来实现了发布/订阅功能能,能够让多个订阅者同时监听某一个对象,当一个对象自身状态变化时,会通知所有订阅者。

ZooKeeper 原生支持通过注册Watcher来进行事件监听,但是其使用并不是特别方便,需要开发人员自己反复注册Watcher,比较繁琐。

Curator引入了 Cache 来实现对 ZooKeeper 服务端事件的监听。

ZooKeeper提供了三种Watcher:

- NodeCache : 只是监听某一个特定的节点

- PathChildrenCache : 监控一个ZNode的子节点.

- TreeCache : 可以监控整个树上的所有节点,类似于PathChildrenCache和NodeCache的组合

NodeCache代码

java

public void testNodeCache() throws Exception {

//1. 创建NodeCache对象

final NodeCache nodeCache = new NodeCache(client,"/app1");

//2. 注册监听

nodeCache.getListenable().addListener(new NodeCacheListener() {

@Override

public void nodeChanged() throws Exception {

System.out.println("节点变化了~");

//获取修改节点后的数据

byte[] data = nodeCache.getCurrentData().getData();

System.out.println(new String(data));

}

});

//3. 开启监听.如果设置为true,则开启监听时,加载缓冲数据

nodeCache.start(true);

while (true){

}

}执行get /itheima/app1命令控制台没有输出结果

执行set /itheima/app1 123命令,控制台输出节点变化了~和123

执行delete /itheima/app1命令,控制台输出节点变化了

执行create /itheima/app1命令,控制台输出节点变化了

PathChildrenCache代码

java

@Test

public void testPathChildrenCache() throws Exception {

//1.创建监听对象

PathChildrenCache pathChildrenCache = new PathChildrenCache(client,"/app2",false);

//2. 绑定监听器

pathChildrenCache.getListenable().addListener(new PathChildrenCacheListener() {

@Override

public void childEvent(CuratorFramework client, PathChildrenCacheEvent event) throws Exception {

System.out.println("子节点变化了~");

System.out.println(event);

}

});

//3. 开启

pathChildrenCache.start();

while (true){

}

}执行create /itheima/app2/p1命令,控制台输出

java

子节点变化了~

PathChildrenCacheEvent{type=CHILD_ADDED, data=ChildData{path='/app2/p1', stat=121,121,1767534175534,1767534175534,0,0,0,0,0,0,121, data=null}}执行set /itheima/app2/p1 111命令,控制台输出

java

子节点变化了~

PathChildrenCacheEvent{type=CHILD_UPDATED, data=ChildData{path='/app2/p1', stat=121,122,1767534175534,1767534189998,1,0,0,0,3,0,121, data=null}}执行delete /itheima/app2/p1命令,控制台输出

java

子节点变化了~

PathChildrenCacheEvent{type=CHILD_REMOVED, data=ChildData{path='/app2/p1', stat=121,122,1767534175534,1767534189998,1,0,0,0,3,0,121, data=null}}执行set /itheima/app2 666命令,控制台没有输出。因为PathChildrenCache监听的是子节点,我们现在是修改父节点,不会触发监听。

只监听数据变化

java

@Test

public void testPathChildrenCache() throws Exception {

//1.创建监听对象

PathChildrenCache pathChildrenCache = new PathChildrenCache(client,"/app2",false);

//2. 绑定监听器

pathChildrenCache.getListenable().addListener(new PathChildrenCacheListener() {

@Override

public void childEvent(CuratorFramework client, PathChildrenCacheEvent event) throws Exception {

System.out.println("子节点变化了~");

System.out.println(event);

//监听子节点的数据变更,并且拿到变更后的数据

//1.获取类型

PathChildrenCacheEvent.Type type = event.getType();

//2.判断类型是否是update

if(type.equals(PathChildrenCacheEvent.Type.CHILD_UPDATED)){

System.out.println("数据变了!!!");

byte[] data = event.getData().getData();

System.out.println(new String(data));

}

}

});

//3. 开启

pathChildrenCache.start();

while (true){

}

}执行set /itheima/app2/p1 111命令,控制台输出:数据变了!!!

TreeCache 代码

java

@Test

public void testTreeCache() throws Exception {

//1. 创建监听器

TreeCache treeCache = new TreeCache(client,"/app2");

//2. 注册监听

treeCache.getListenable().addListener(new TreeCacheListener() {

@Override

public void childEvent(CuratorFramework client, TreeCacheEvent event) throws Exception {

System.out.println("节点变化了");

System.out.println(event);

}

});

//3. 开启

treeCache.start();

while (true){

}

}4.2.7 分布式锁实现

在我们进行单机应用开发,涉及并发同步的时候,我们往往采用synchronized或者Lock的方式来解决多线程间的代码同步问题,这时多线程的运行都是在同一个JVM之下,没有任何问题。

但当我们的应用是分布式集群工作的情况下,属于多JVM下的工作环境,跨JVM之间已经无法通过多线程的锁解决同步问题。

那么就需要一种更加高级的锁机制,来处理种跨机器的进程之间的数据同步问题------这就是分布式锁。

分布式锁常见实现

- 数据库。由于数据库性能本来就比较低,一般不推荐

- 缓存。redis、Memcache

- Zookeeper

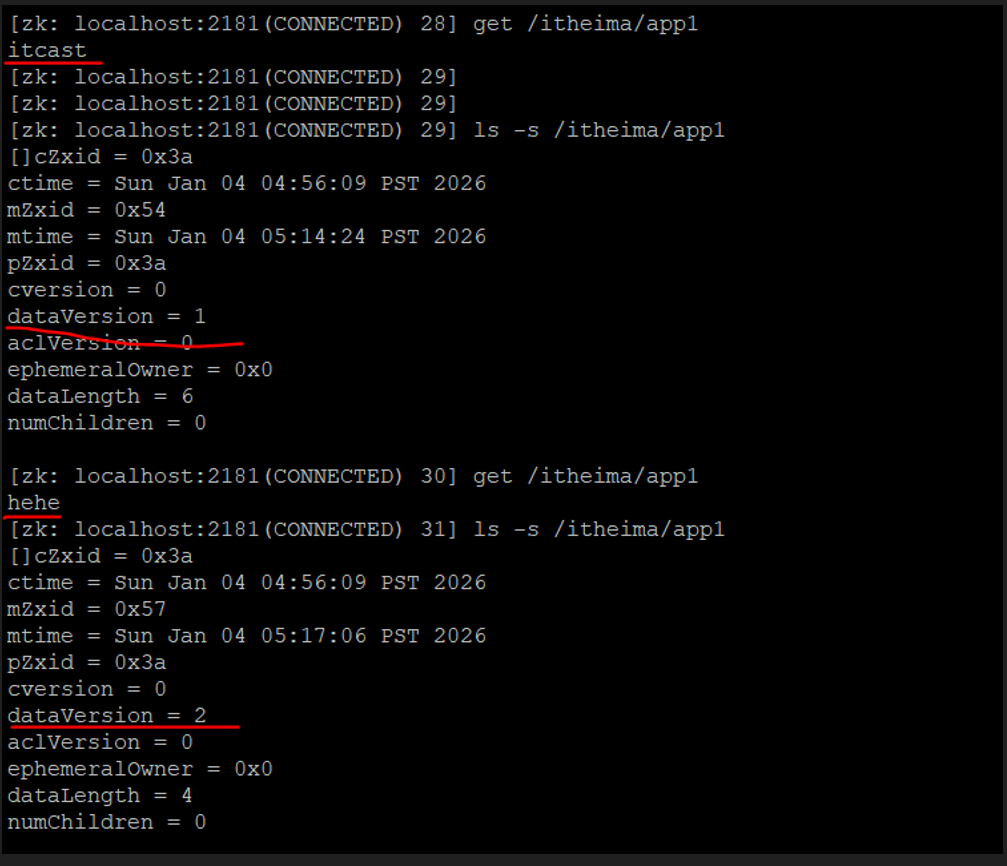

ZooKeeper分布式锁原理

核心思想:当客户端要获取锁,则创建节点,使用完锁,则删除该节点。

1.客户端获取锁时,在lock节点(这个节点的名字自定义)下创建==临时顺序节点。==比如上图,client1、client2、client3分别在lock节点下面创建了/lock/1、/lock/2、/lock/3节点。

为什么创建临时顺序节点?临时节点是为了防止加锁的客户端在处理业务过程中宕机导致锁永远得不到释放;顺序节点是保证最小的那个能够拿到锁

2.然后获取lock下面的所有子节点,客户端获取到所有的子节点之后,如果发现自己创建的子节点序号最小,那么就认为该客户端获取到了锁。使用完锁后,将该节点删除。上图中,是client1拿到锁,使用锁之后释放锁。

3.如果发现自己创建的节点并非lock所有子节点中最小的,说明自己还没有获取到锁,此时客户端需要找到比自己小的那个节点,同时对其注册事件监听器,监听删除事件。上图中,/lock/2节点向/lock/1节点注册事件监听器,/lock/3节点向/lock/2节点注册事件监听器

4.如果发现比自己小的那个节点被删除,则客户端的Watcher会收到相应通知,此时再次判断自己创建的节点是否是lock子节点中序号最小的,如果是则获取到了锁,如果不是则重复以上步骤继续获取到比自己小的一个节点并注册监听。

Curator实现分布式锁API

在Curator中有五种锁方案:

- InterProcessSemaphoreMutex:分布式排它锁(非可重入锁)

- InterProcessMutex:分布式可重入排它锁

- InterProcessReadWriteLock:分布式读写锁

- InterProcessMultiLock:将多个锁作为单个实体管理的容器

- InterProcessSemaphoreV2:共享信号量

分布式锁案例-模拟12306售票

java

public class Ticket12306 implements Runnable{

//数据库的票数

private int tickets = 10;

private InterProcessMutex lock ;

public Ticket12306(){

//重试策略

RetryPolicy retryPolicy = new ExponentialBackoffRetry(3000, 10);

//2.第二种方式

//CuratorFrameworkFactory.builder();

CuratorFramework client = CuratorFrameworkFactory.builder()

.connectString("192.168.52.130:2181")

.sessionTimeoutMs(60 * 1000)

.connectionTimeoutMs(15 * 1000)

.retryPolicy(retryPolicy)

.build();

//开启连接

client.start();

lock = new InterProcessMutex(client,"/lock");

}

@Override

public void run() {

while(true){

//获取锁

try {

lock.acquire(3, TimeUnit.SECONDS);

if(tickets > 0){

System.out.println(Thread.currentThread()+":"+tickets);

Thread.sleep(100);

tickets--;

}

} catch (Exception e) {

e.printStackTrace();

}finally {

//释放锁

try {

lock.release();

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

}

java

public class LockTest {

public static void main(String[] args) {

Ticket12306 ticket12306 = new Ticket12306();

//创建客户端

Thread t1 = new Thread(ticket12306,"携程");

Thread t2 = new Thread(ticket12306,"飞猪");

t1.start();

t2.start();

}

}输出结果:

java

Thread[携程,5,main]:10

Thread[飞猪,5,main]:9

Thread[携程,5,main]:8

Thread[飞猪,5,main]:7

Thread[携程,5,main]:6

Thread[飞猪,5,main]:5

Thread[携程,5,main]:4

Thread[飞猪,5,main]:3

Thread[携程,5,main]:2

Thread[飞猪,5,main]:1五、ZooKeeper 集群搭建

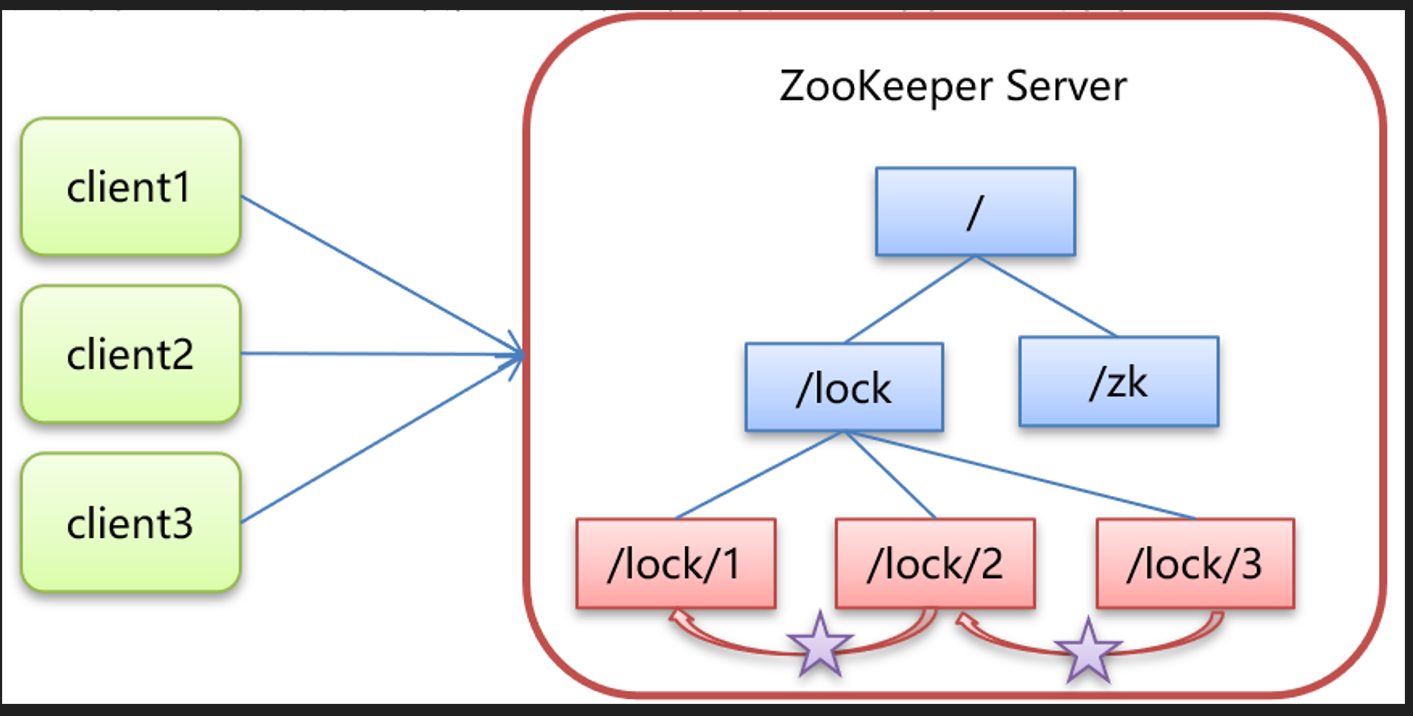

5.1 Zookeeper集群介绍

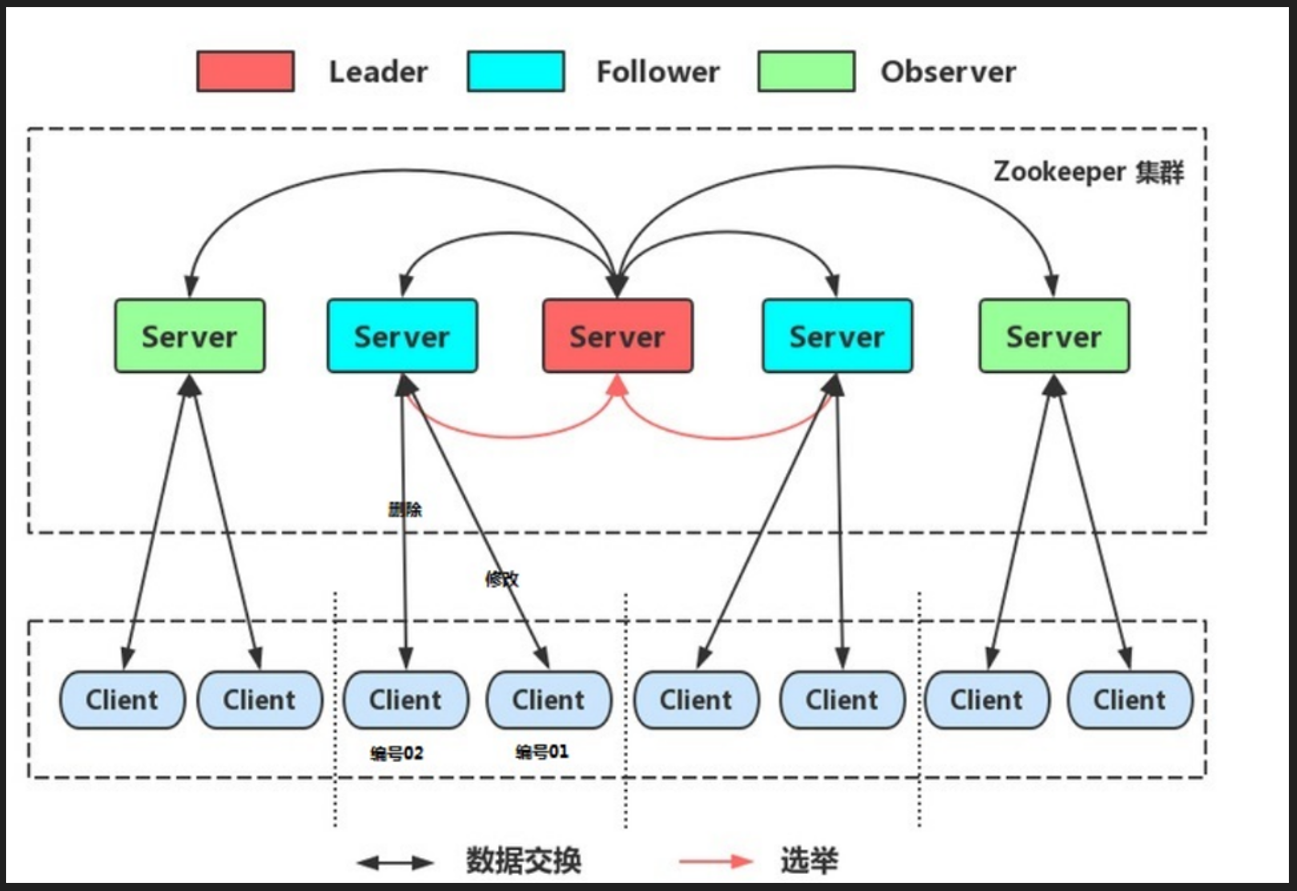

上图有5台ZK Server,需要在这5台机器中选出一个leader

Leader选举:

- Serverid:服务器ID。比如有三台服务器,编号分别是1,2,3。编号越大在选择算法中的权重越大。

- Zxid:数据ID。服务器中存放的最大数据ID.值越大说明数据 越新,在选举算法中数据越新权重越大。

- 在Leader选举的过程中,如果某台ZooKeeper获得了超过半数的选票,则此ZooKeeper就可以成为Leader了。

以上面5台机器为例,按照1、2、3、4、5的顺序先后启动。机器1启动,给自己投一票,发现票数没有过半,选举失败;机器2启动,给自己投一票,机器1给机器2投一票,发现票数没有过半,选举失败;机器3启动,给自己投一票,机器1、2都给机器3投一票,发现票数过半,选举机器3为leader;后面机器4、5启动,就不会有leader变动了,因为leader已经有人了。

5.2 ZooKeeper 集群搭建

我们这里要求搭建一个三个节点的Zookeeper集群

5.2.1 准备工作

1、安装JDK 【此步骤省略】。

2、Zookeeper压缩包上传到服务器

3、将Zookeeper解压 ,建立/usr/local/zookeeper-cluster目录,将解压后的Zookeeper复制到以下三个目录

/usr/local/zookeeper-cluster/zookeeper-1

/usr/local/zookeeper-cluster/zookeeper-2

/usr/local/zookeeper-cluster/zookeeper-3

sh

mkdir /usr/local/zookeeper-cluster

cp -r apache-zookeeper-3.5.6-bin /usr/local/zookeeper-cluster/zookeeper-1

cp -r apache-zookeeper-3.5.6-bin /usr/local/zookeeper-cluster/zookeeper-2

cp -r apache-zookeeper-3.5.6-bin /usr/local/zookeeper-cluster/zookeeper-34、创建data目录 ,并且将 conf下zoo_sample.cfg 文件改名为 zoo.cfg

sh

mkdir /usr/local/zookeeper-cluster/zookeeper-1/data

mkdir /usr/local/zookeeper-cluster/zookeeper-2/data

mkdir /usr/local/zookeeper-cluster/zookeeper-3/data

mv /usr/local/zookeeper-cluster/zookeeper-1/conf/zoo_sample.cfg /usr/local/zookeeper-cluster/zookeeper-1/conf/zoo.cfg

mv /usr/local/zookeeper-cluster/zookeeper-2/conf/zoo_sample.cfg /usr/local/zookeeper-cluster/zookeeper-2/conf/zoo.cfg

mv /usr/local/zookeeper-cluster/zookeeper-3/conf/zoo_sample.cfg /usr/local/zookeeper-cluster/zookeeper-3/conf/zoo.cfg5、配置每一个Zookeeper 的dataDir 和 clientPort 分别为2181 2182 2183

修改/usr/local/zookeeper-cluster/zookeeper-1/conf/zoo.cfg

sh

vim /usr/local/zookeeper-cluster/zookeeper-1/conf/zoo.cfg

clientPort=2181

dataDir=/usr/local/zookeeper-cluster/zookeeper-1/data修改/usr/local/zookeeper-cluster/zookeeper-2/conf/zoo.cfg

shell

vim /usr/local/zookeeper-cluster/zookeeper-2/conf/zoo.cfg

clientPort=2182

dataDir=/usr/local/zookeeper-cluster/zookeeper-2/data修改/usr/local/zookeeper-cluster/zookeeper-3/conf/zoo.cfg

shell

vim /usr/local/zookeeper-cluster/zookeeper-3/conf/zoo.cfg

clientPort=2183

dataDir=/usr/local/zookeeper-cluster/zookeeper-3/data5.2.2 配置集群

1、在每个zookeeper的 data 目录下创建一个 myid 文件,内容分别是1、2、3 。这个文件就是记录每个服务器的ID

shell

echo 1 >/usr/local/zookeeper-cluster/zookeeper-1/data/myid

echo 2 >/usr/local/zookeeper-cluster/zookeeper-2/data/myid

echo 3 >/usr/local/zookeeper-cluster/zookeeper-3/data/myid2、在每一个zookeeper 的 zoo.cfg配置客户端访问端口(clientPort)和集群服务器IP列表。

集群服务器IP列表如下

shell

vim /usr/local/zookeeper-cluster/zookeeper-1/conf/zoo.cfg

vim /usr/local/zookeeper-cluster/zookeeper-2/conf/zoo.cfg

vim /usr/local/zookeeper-cluster/zookeeper-3/conf/zoo.cfg

server.1=192.168.149.135:2881:3881

server.2=192.168.149.135:2882:3882

server.3=192.168.149.135:2883:3883解释:server.服务器ID=服务器IP地址:服务器之间通信端口:服务器之间投票选举端口

5.2.3 启动集群

启动集群就是分别启动每个实例。

shell

/usr/local/zookeeper-cluster/zookeeper-1/bin/zkServer.sh start

/usr/local/zookeeper-cluster/zookeeper-2/bin/zkServer.sh start

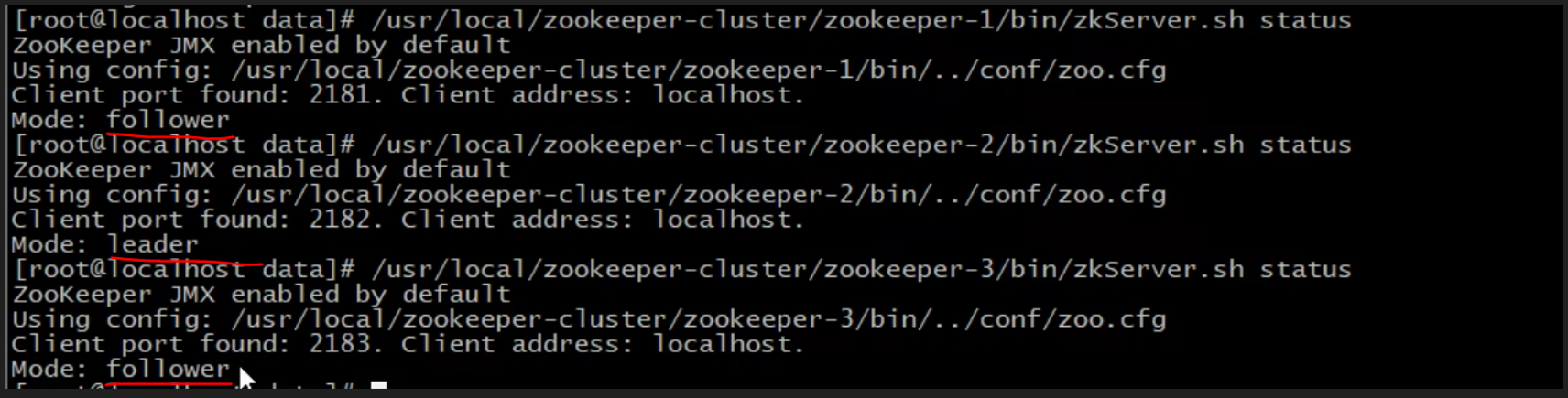

/usr/local/zookeeper-cluster/zookeeper-3/bin/zkServer.sh start启动后我们查询一下每个实例的运行状态

shell

/usr/local/zookeeper-cluster/zookeeper-1/bin/zkServer.sh status

/usr/local/zookeeper-cluster/zookeeper-2/bin/zkServer.sh status

/usr/local/zookeeper-cluster/zookeeper-3/bin/zkServer.sh statusMode 为leader表示是领导者 (主),Mode为follower表示是跟随者(从)

5.2.4 模拟集群异常

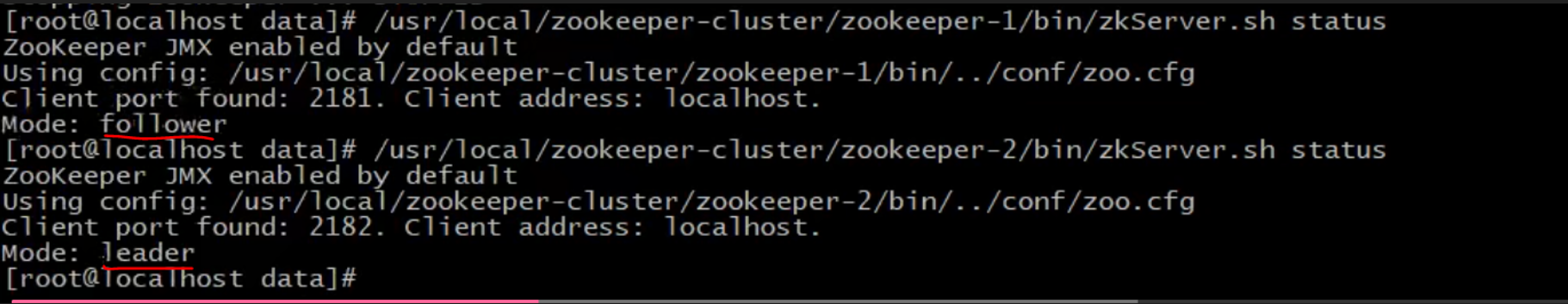

1、首先我们先测试如果是从服务器挂掉,会怎么样

把3号服务器停掉,观察1号和2号,发现状态并没有变化

java

/usr/local/zookeeper-cluster/zookeeper-3/bin/zkServer.sh stop

/usr/local/zookeeper-cluster/zookeeper-1/bin/zkServer.sh status

/usr/local/zookeeper-cluster/zookeeper-2/bin/zkServer.sh status

由此得出结论,3个节点的集群,从服务器挂掉,集群正常

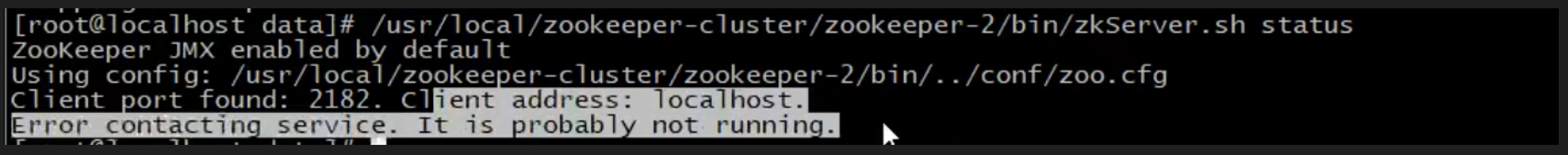

2、我们再把1号服务器(从服务器)也停掉,查看2号(主服务器)的状态,发现已经停止运行了。

java

/usr/local/zookeeper-cluster/zookeeper-1/bin/zkServer.sh stop

/usr/local/zookeeper-cluster/zookeeper-2/bin/zkServer.sh status

由此得出结论,3个节点的集群,2个从服务器都挂掉,主服务器也无法运行。因为可运行的机器没有超过集群总数量的半数。

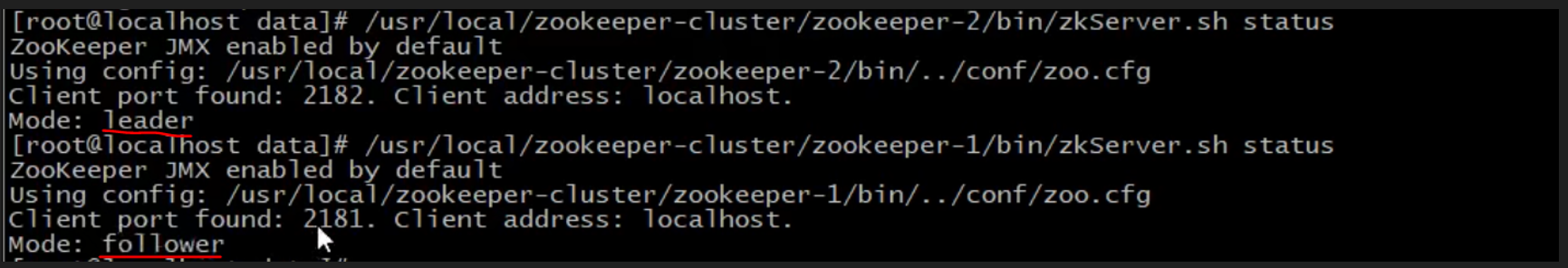

3、我们再次把1号服务器启动起来,发现2号服务器又开始正常工作了。而且依然是领导者。

java

/usr/local/zookeeper-cluster/zookeeper-1/bin/zkServer.sh start

/usr/local/zookeeper-cluster/zookeeper-2/bin/zkServer.sh status

4、我们把3号服务器也启动起来,把2号服务器停掉,停掉后观察1号和3号的状态。

java

/usr/local/zookeeper-cluster/zookeeper-3/bin/zkServer.sh start

/usr/local/zookeeper-cluster/zookeeper-2/bin/zkServer.sh stop

/usr/local/zookeeper-cluster/zookeeper-1/bin/zkServer.sh status

/usr/local/zookeeper-cluster/zookeeper-3/bin/zkServer.sh status

发现新的leader产生了。由此我们得出结论,当集群中的主服务器挂了,集群中的其他服务器会自动进行选举状态,然后产生新得leader

六、Zookeeper 核心理论

Zookeeper集群角色

ZooKeeper中各个server节点的数据是一样的,只是分工不同(角色不同)

在ZooKeeper集群服中务中有三个角色:

-

Leader 领导者 :

处理事务请求(增删改属于事务请求,查询不属于)

集群内部各服务器的调度者

-

Follower 跟随者 :

处理客户端非事务请求(查询),转发事务请求给Leader服务器(例如,客户端连接到follower,执行一个删除操作,follower会将这次操作转发给leader。leader执行完删除操作之后,还要向其他节点同步数据,保持各个节点数据的一致性)

参与Leader选举投票

-

Observer 观察者:

处理客户端非事务请求(查询),转发事务请求给Leader服务器(注意,它不参与投票)。加Observer是为了分担Follower查询的压力