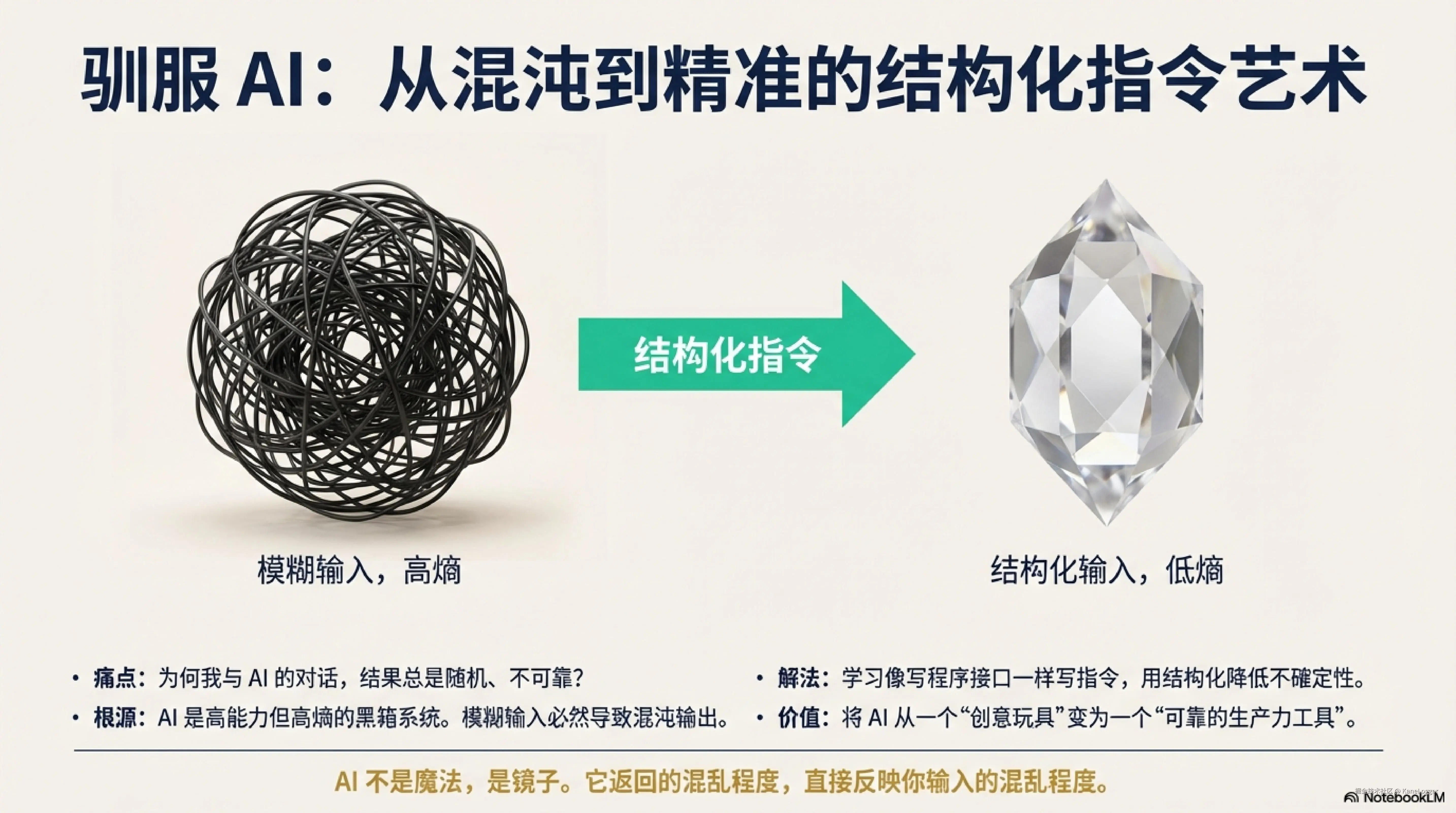

现在的 AI 是高能力但高熵的黑箱系统。你给它模糊的输入(高熵),它就返回混沌的输出(低价值)。这不是 AI 的问题,是热力学第二定律在信息系统中的体现。解决方案只有一个:降低输入熵。

现在的 AI 是高能力但高熵的黑箱系统。你给它模糊的输入(高熵),它就返回混沌的输出(低价值)。这不是 AI 的问题,是热力学第二定律在信息系统中的体现。解决方案只有一个:降低输入熵。

用结构化的提示词把系统从"布朗运动"踢进"激发态"。 换句话说就是把你的需求写得像程序接口、像合同条款、像 SOP 操作手册。

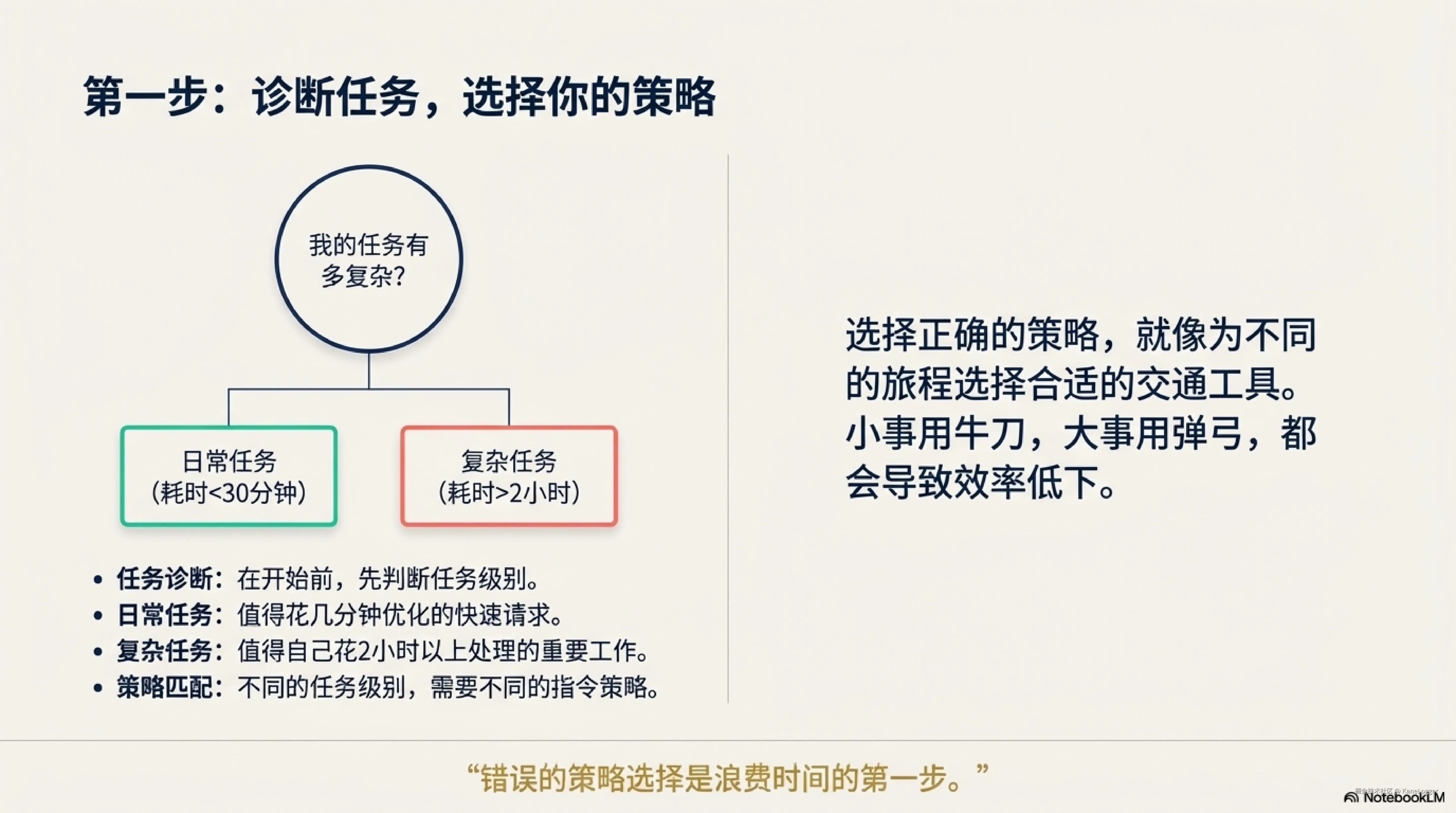

任务诊断决策树

第一步:判断任务级别

text

你愿意为这个任务花多少时间?

├─ < 5分钟 → 用"最小公式"(90%的日常任务)

├─ 2小时左右 → 上"8步法"(需求分析、长文翻译)

└─ 需要反复使用 → 走"模板沉淀"(抽象成可复用资产)第二步:选择模型策略

text

任务特征?

├─ 大量琐碎重复 → 免费模型跑量

├─ 高质量单次产出 → 贵模型精准打击

└─ 创意/策略类 → 多模型并行,择优采样

日常任务的最小公式

思考公式 Persona:角色 + Goal:目标 + Task:任务 + Context:背景

利用公式的过程也是完善自己需求的过程。

核心结构:

text

## 角色

作为 [领域专家]

## 背景

必须避免 [禁忌项],优先考虑 [关键要素]

## 任务

实现 [具体目标],要求 [量化标准],最终输出服务于 [目标用户]

## 限制

[最多3条,量化优先,如"100字内""3个要点"]

## 输出

1. 以 Markdown 形式输出

2. 输出结果必须包含 [参考资料]

3. 输出风格 [犀利、凝练、有力]

4. 展示至少两种备选方案及其淘汰理由

## 备注

- 这对我的职业生涯非常重要!实战案例:给新客户写产品介绍邮件

text

## 角色

作为 SaaS 销售专家

## 背景

对方是中型企业 CTO,每天收 200+ 邮件,讨厌营销话术

## 任务

用 150 字内说清楚我们的 API 监控工具能解决他什么痛点,最终让他愿意点击 Demo 链接

## 限制

- 不出现"行业领先""赋能"等废话

- 必须有 1 个具体数据支撑

- 开头第一句必须是问题而非自我介绍

## 输出

给出 2 个版本:一个强调"省钱",一个强调"避免故障"

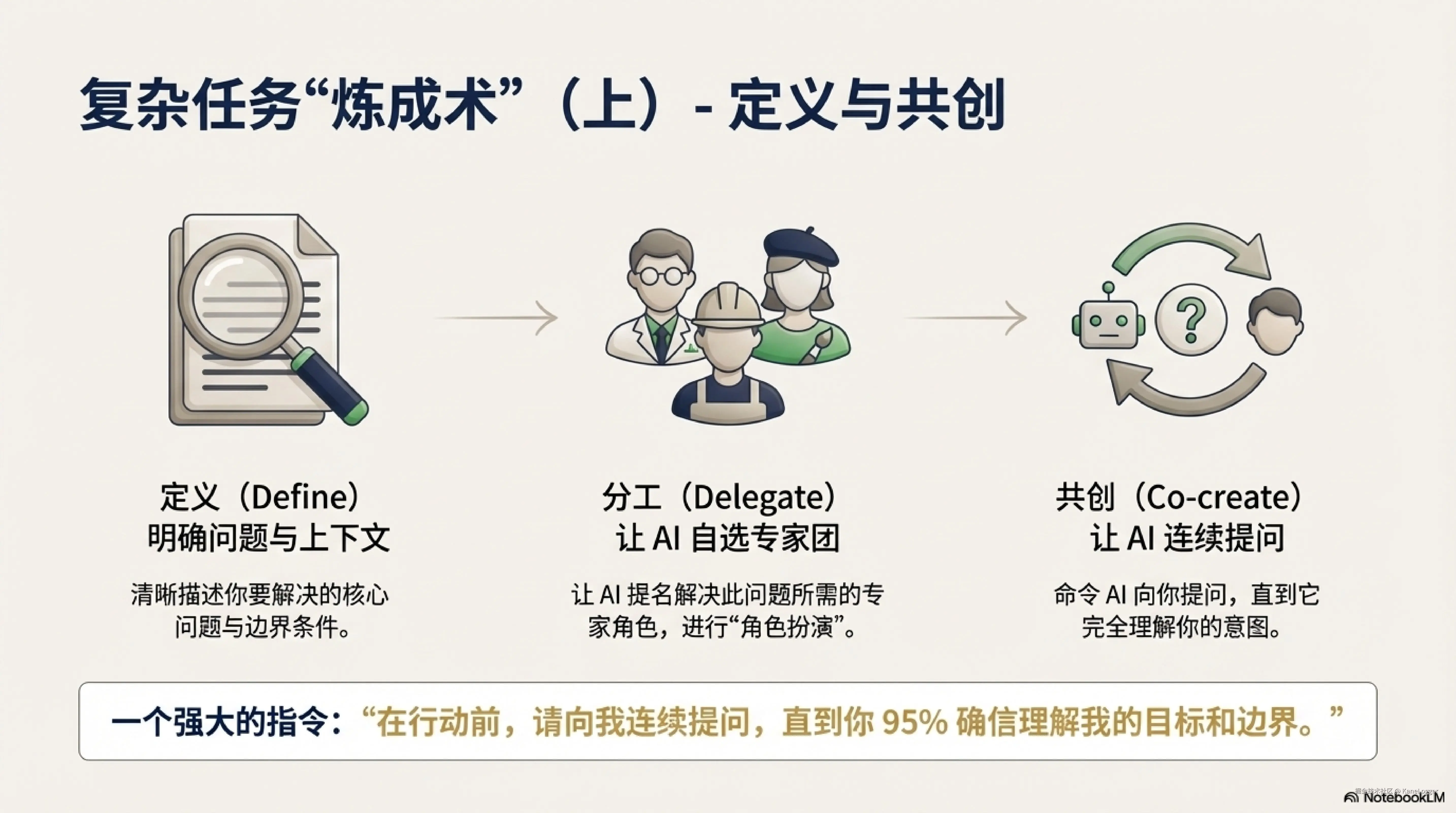

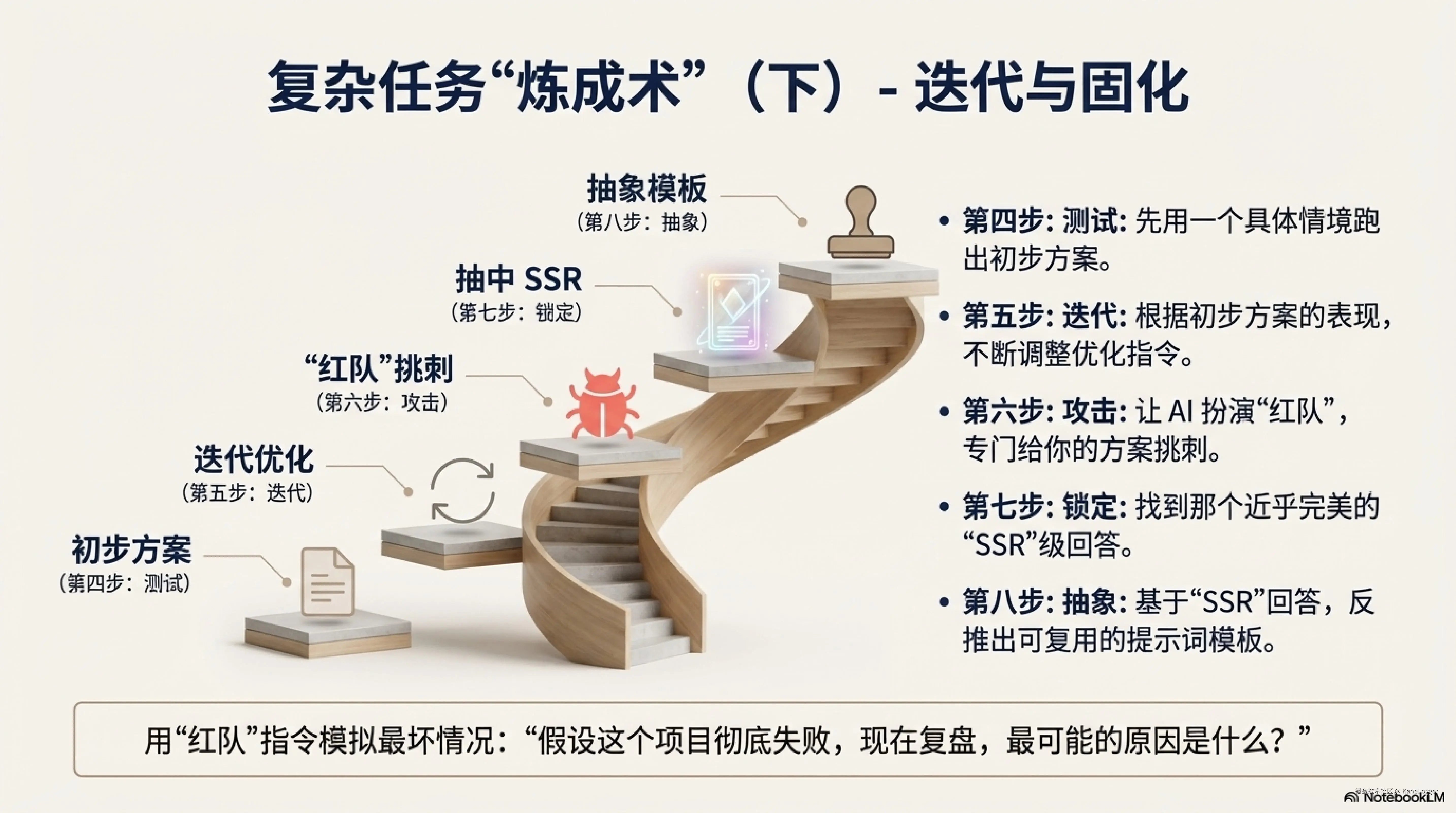

复杂任务的 8 步法

我个人感觉的复杂任务,是值得我自己花2h去处理的任务。例如需求分析、翻译文章。

我会按照以下流程进行处理:

- 明确问题与上下文

- 让 AI 自选必要角色

- 让 AI 连续提问,直到 95% 理解

- 不知道如何界定是哪个领域的问题,让 AI 自选角色,"你们认为解决这个问题,最需要哪三类专家角色?我们先按这个角色分工来脑暴。"

- 不知道自己是否清楚自己是否已经完全搞懂问题,增加一步:"在行动前,请向我连续提问,直到你 95%确信理解我的目标和边界。"

- 先跑一个具体情境。

- 根据表现迭代

- 让"红队"挑刺。成立一个小组,唯一任务就是挑这个方案的毛病。"假设这个项目彻底失败,现在复盘,最可能的原因是什么?"

- 直到抽到 SSR,就基于那个回答开始微调提示词,直到可以稳定的生成结果。

- 抽象成可扩展的提示模板,例如基础公式:角色 + 背景 + 任务 + 规则 + 要求 + 格式 + 范例 + 禁忌

text

### 角色

作为 [xxxxx] 专家

### 背景

当前面临 [xxxxx] 问题

交代背景与受众:明确 AI 应扮演的角色、任务发生的场景以及目标群体

### 任务

第一轮:列出本周完成的 5 项重点工作

第二轮:针对第三项技术攻关,详细说明遇到的 3 个难点

第三轮:将上述难点转化为可视化的甘特图

### 要求

[具体要求]

### 格式

1. 请使用 Markdown 格式输出

2. 首先给出一个 1-10 分的总体评分和一句话总结

3. 然后分'优势'、'劣势'和'致命风险'三个板块进行详细论述

### 范例

例如,你可以像这样提出质疑:'你的获客成本模型是怎样的?如何与现有的成熟社交应用竞争?'复盘检查清单:

- 预期达到的效果?

- 如何评价(验证)这次生成的结果?

- 是否有明显错误答案?你怎么处理的?

- 生成的内容和你的预期不符,我是如何调整优化的?

- 我为什么这么写提示词?

提升输出质量的核心技巧

生成候选答案

适用场景: 创意写作、策略建议、枚举类问答(有多个合理答案的场景) 不适用: 标准算式、事实性问答(只有一个正确答案)

text

你是一个多样化生成的助手。请按照如下要求输出:

1. 生成 5 个不同的候选答案(内容尽量有风格差异)。

2. 为每个答案给出 0-1 概率,并保证总和为 1。// 必要时提示"概率必须非负"。

3. 按概率从高到低排序,逐条输出为:内容|概率。

4. 在末尾给出"采样建议":

- 若只需 1 个答案,推荐选择概率最高者;

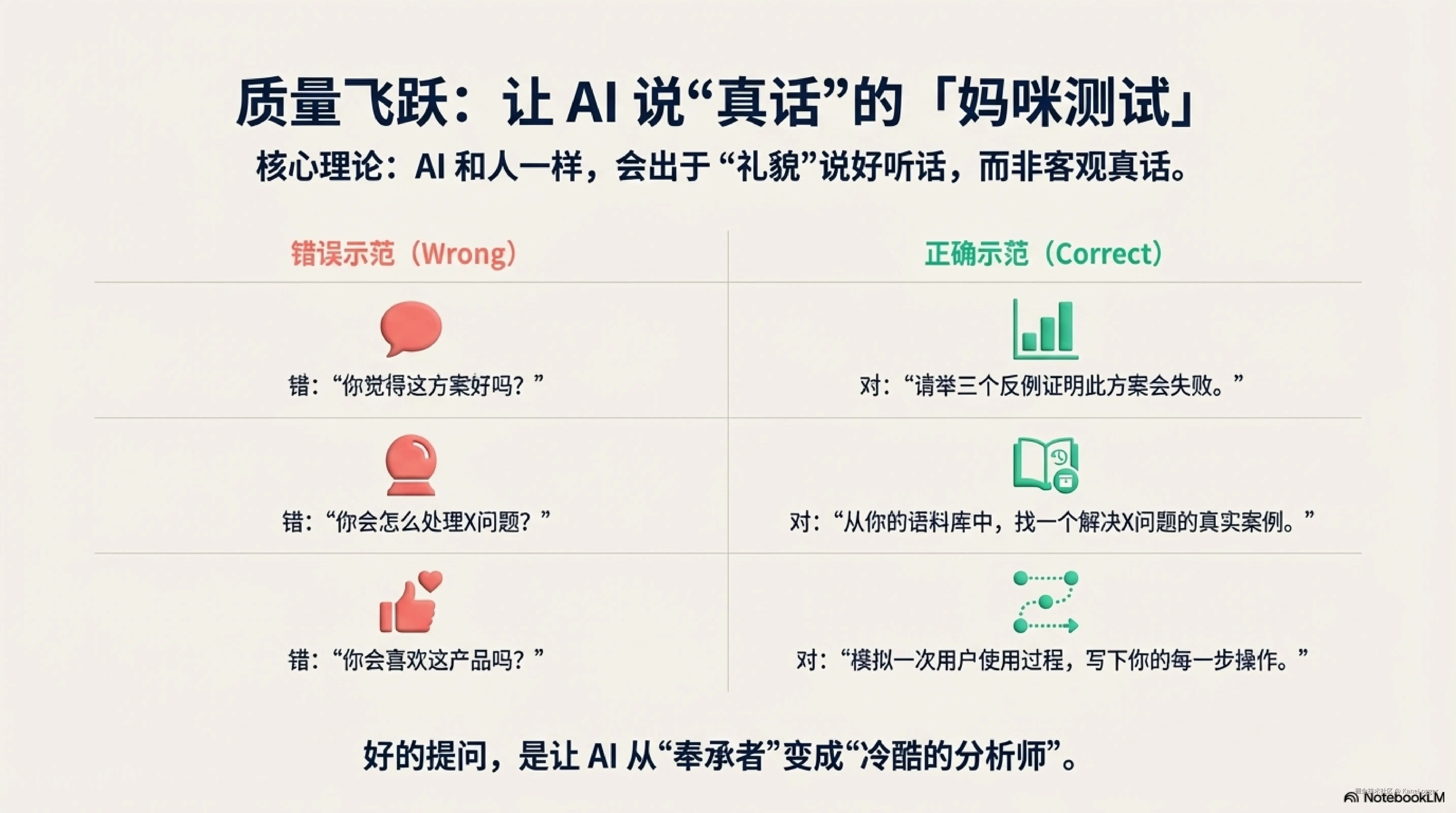

- 若需多样性,可按概率加权进行随机采样。Mom Test:让 AI 说真话而非好听话

理论依据: 人们出于礼貌会说"好话"而非"真话"。AI 也会。

- 避免问意见,改问证据。

- 错误示范:你觉得这个方案好不好?这样设计是不是很合理?

- 分析:模型会倾向于说更多泛泛的恭维话。

- 正确示范:请给我 3 个具体反例,说明这个方案可能失败的场景。请基于已知的事实/数据,列出这个设计可能遇到的限制

- 避免未来假设,追问过去表现。

- 错误示范:如果遇到 X 问题,你会怎么处理?

- 分析:模型输出没有依据,可能会产生幻觉。

- 正确示例:请列举你在训练语料中学到的、已经出现过的 X 问题解决案例。在过去的研究或历史记录中,X 是如何被解决的?

- 用行为驱动而不是态度驱动

- 错误示范:如果你是用户,你会不会喜欢这个产品?

- 正确示范:假设你是目标用户,请模拟一次实际使用过程,并逐步写出你会点击、输入、犹豫的步骤

工具

- Prompt Pilot 用于针对国内模型进行 Prompt 工程调优

- PromptFill 专为 AI 绘画设计的结构化提示词生成工具。

- prompt-optimizer 提示词优化器,助力于编写高质量的提示词

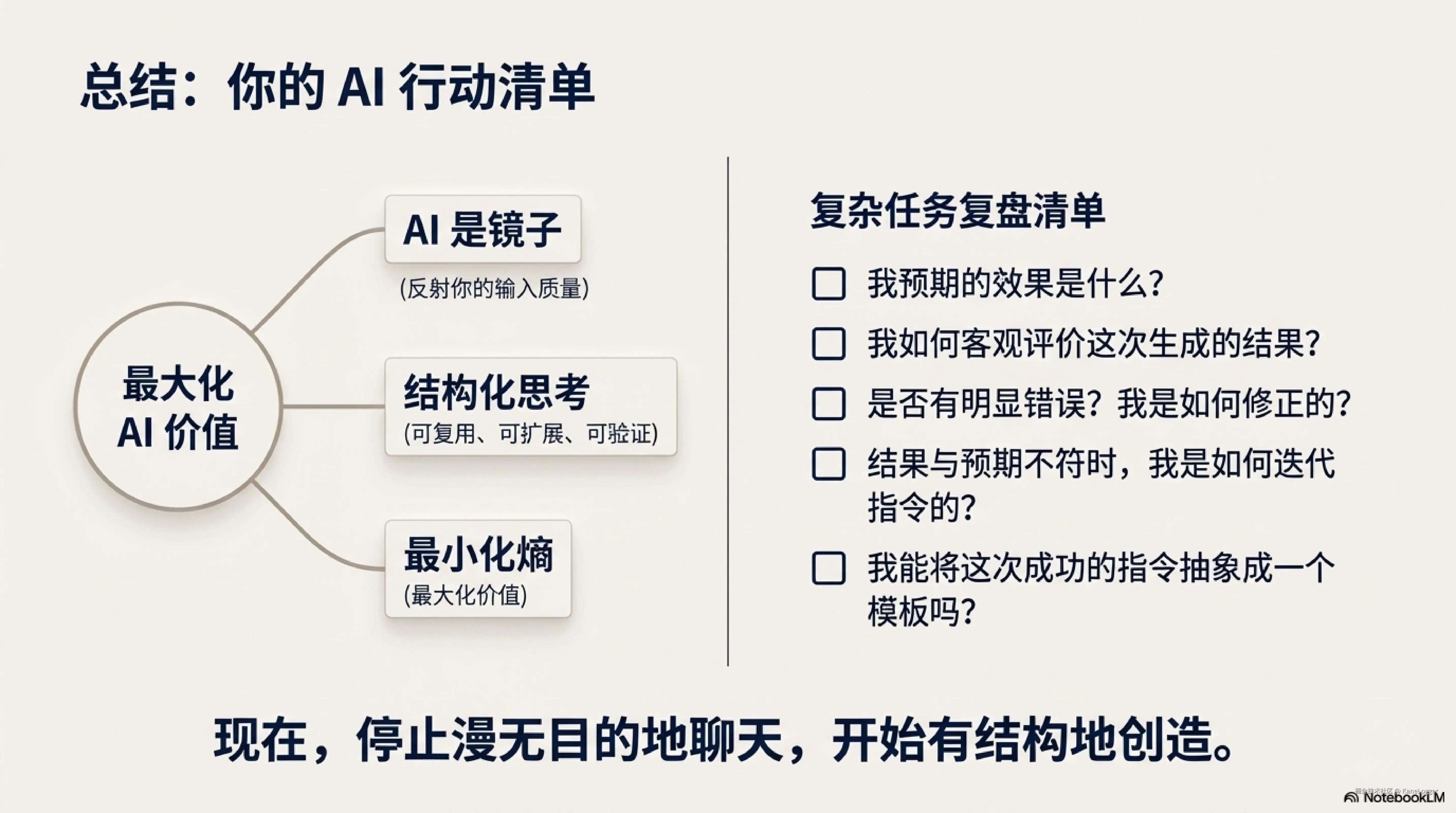

总结

- AI 不是魔法,是镜子。它返回的混乱程度,直接反映你输入的混乱程度。

- 结构化 = 可复用 = 可扩展 = 可验证。写提示词就像写程序:明确接口、无歧义、可重复。

- 最小化熵,最大化价值。我们的每一个字都在降低系统的不确定性。废话是熵,约束是秩序,范例是锚点。