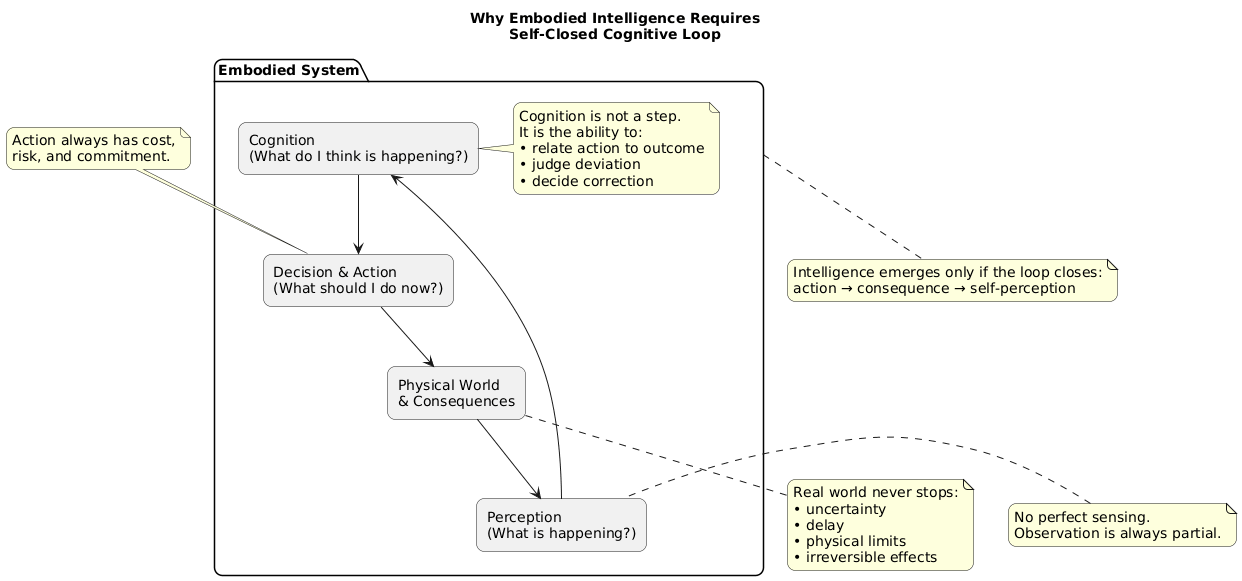

在很多人眼中,所谓"智能系统",无非是:

看得清楚、算得很快、决策很聪明。

只要感知模型足够好,规划算法足够复杂,系统自然就会"表现出智能"。

这种理解,在纯软件系统中或许还能勉强成立,但一旦系统长出身体、开始在真实世界中行动,就会迅速暴露问题。

具身智能系统,和传统软件最大的不同只有一条:

它必须为自己的行为承担物理后果。

而这,正是"自我闭环的认知机制"不可替代的原因。

一、真实世界不接受"一次性聪明"

在离线测试里,一个模型只需要在给定输入下输出一个最优结果。

但在现实世界中,系统面对的是:

-

不完整、不可靠的感知

-

持续变化的环境

-

随时可能失效的执行器

-

永远存在的时延、噪声和物理边界

现实世界不会告诉你:

"你这次决策是最后一次。"

它只会反复问你同一个问题:

现在这样做,还行吗?

如果一个系统的"认知"只存在于某一次决策中,那么它在现实世界里是不可持续的。

只有能不断修正自己行为的系统,才有资格谈智能。

这正是"闭环"的本质。

二、没有闭环,认知只是幻觉

很多具身智能系统,看起来很聪明,但一旦部署就开始"犯傻":

-

路口犹豫不前

-

工位前反复尝试失败

-

在异常情况下行为失控

问题通常不在于算法"算错了",而在于:

系统不知道自己正在失败。

它在"执行",但并未真正"感知自己行为的后果"。

这类系统的认知是单向的:

-

感知 → 决策 → 行动

-

然后就结束了

而真正的认知,必须是自我指向的:

-

行动之后,系统必须再次感知

-

并判断:这还是我想要的结果吗?

没有这种自我回看能力,所谓的认知只是一种外部观察者的投射。

三、闭环不是控制技巧,而是认知成立条件

人们常常把"闭环"理解为控制工程里的一个技巧:

PID、反馈增益、稳定性分析。

但在具身智能系统中,闭环的意义远不止于此。

闭环意味着三件事:

-

系统知道自己在做什么(目标与状态)

-

系统知道自己是否做成了(结果与偏差)

-

系统能在偏差出现时改变行为(修正与干预)

这三点合在一起,才构成最低限度的认知闭合。

如果一个系统只能"算出下一步",却无法判断这一步是否仍然合理,

那它的行为只能被称为反应,而不是认知。

四、约束之下,闭环才有意义

有人会说:

"那我把决策做得足够复杂,不就行了吗?"

问题在于,具身智能系统从来不是在理想条件下运行的。

它始终处在约束之中:

-

实时性约束

-

能耗与力学边界

-

安全规则与协作约束

-

法规与责任边界

这些约束不会等你算完最优解。

如果认知机制不把这些约束当作自身的一部分,闭环就会在现实中断裂。

因此,自我闭环的认知机制,必须是:

在约束中运行的闭环,而不是忽略约束的理想闭环。

这正是具身智能与传统 AI 最大的分野。

五、没有自我闭环,就谈不上责任

最后一个问题,往往被技术讨论刻意回避:

如果系统出事了,谁负责?

一个没有自我闭环的系统:

-

无法说明自己当时"认为发生了什么"

-

无法解释为何会采取某个行为

-

也无法复现导致失败的条件

这种系统在工程上是不可治理的。

而不可治理,就意味着不可规模化部署。

自我闭环的认知机制,至少能做到一件事:

让系统对自己的行为留下结构化证据。

这不仅是工程问题,也是社会问题。

结语:闭环不是为了更聪明,而是为了"活得下去"

具身智能系统需要自我闭环的认知机制,并不是为了显得更高级,

而是因为:

只有能在真实世界中持续修正自己的系统,才可能长期存在。

闭环不是锦上添花,

而是具身智能赖以生存的认知底座。

当我们真正接受这一点,

"智能"这个词,才第一次从演示走向工程。