有些原理看着简单,做个记录吧,需要的时候再细看吧

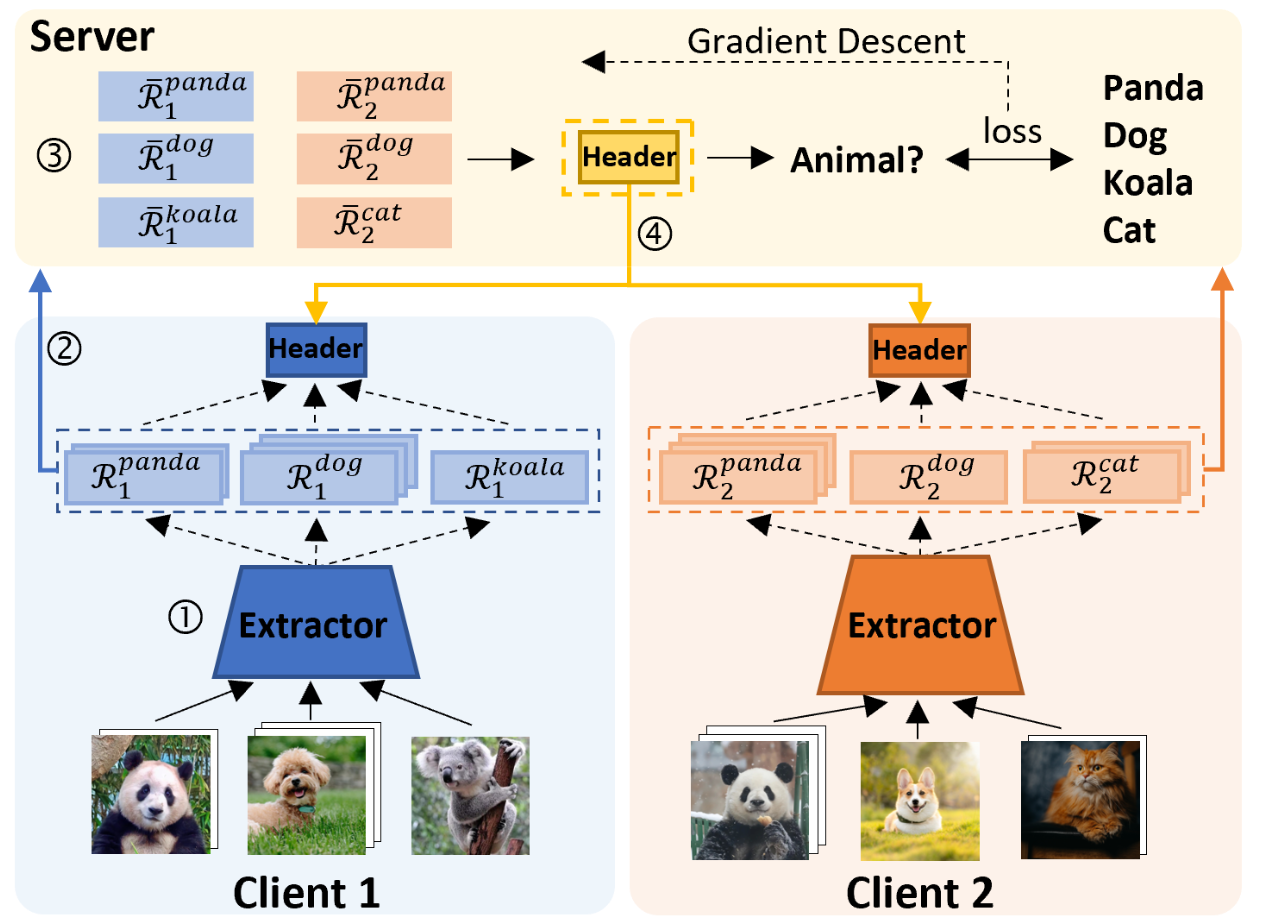

FedGH: Heterogeneous Federated Learning with Generalized Global Header

论文:arxiv ACMMM2023

code: 作者开源

上传类别原型,server用原型训练分类器,广播分类器。本地训练时,特征提取器和分类器同时更新(没有看到交替更新啥的对比实验)。

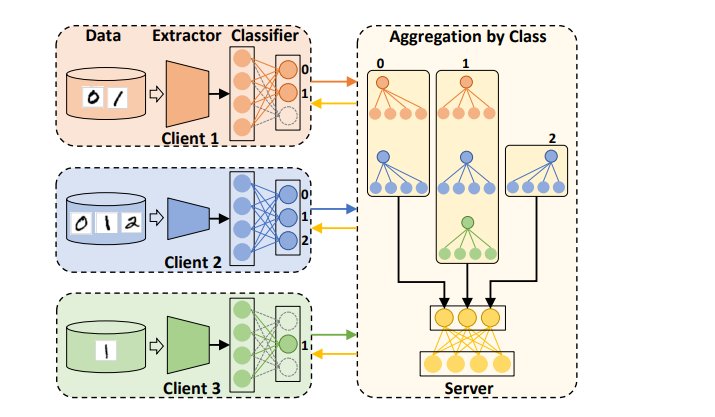

FedSSA: Semantic Similarity-based Aggregation for Efficient Model-Heterogeneous Personalized Federated Learning

论文:arxiv IJCAI2024

code: 作者开源

将最后一层的fc(分类器)拆分上传,没有对应的类别就不用上传。按找类别进行聚合,最后拼成完整的fc,广播回传。

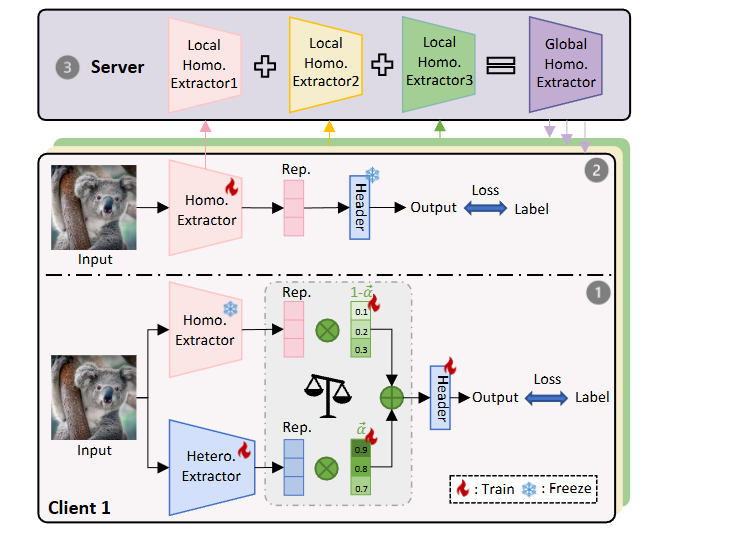

pFedAFM: Adaptive Feature Mixture for Batch-Level Personalization in Heterogeneous Federated Learning

论文:arxiv ICDE2025

code: 作者开源

服务端使用同构的辅助模型聚合。本地训练时,先固定辅助模型,训练异构模型Hetero. Extractor+分类器header+特征加权参数 α \alpha α,只计算标签损失。然后固定其他仅训练同构的辅助模型,也仅用标签损失。