《人工智能安全治理框架》2.0版于2025年9月15日发布[1][4][5],由国家互联网应急中心牵头制定,秉持"以人为本、智能向善"理念,强化风险识别精细化,提升动态适应能力,为全球治理贡献中国方案[6]。

++详答++

一、出台背景与发布信息

-

发布时间与场合

- 2025年9月15日,在云南昆明举办的2025年国家网络安全宣传周网络安全技术高峰论坛主论坛上正式发布[3][4][5]。

- 发布机构:国家互联网应急中心牵头,联合人工智能专业机构、科研院所、行业企业共同制定,国家网信办指导[2][3][6]。

-

版本迭代背景

- 1.0版基础:2024年9月发布《全球人工智能治理倡议》配套文件,受到国内外广泛关注45。

- 升级必要性:人工智能技术快速演进(如高性能推理模型、轻量级模型开源、具身智能等),应用场景拓展,安全治理面临新挑战[7][12][16]。

二、核心理念与原则

-

基本理念

- "以人为本、智能向善":强调技术发展需服务于人类福祉,避免滥用与伦理风险[6][12][16]。

- 全流程治理与动态调整:覆盖研发、部署、运营、使用全生命周期,适应技术迭代需求,降低企业合规成本[6][13]。

-

五大原则

- 风险导向:以风险识别为核心,细化分类与分级治理[11][14]。

- 技术可控:强化模型算法、数据标注、开源模型等关键环节的安全规范[7][12]。

- 开放合作:推动多边机制下国际治理合作,促进技术普惠共享[6][13]。

- 伦理融合:将公平性、透明性、可解释性等伦理要求嵌入技术标准14。

- 韧性治理:构建覆盖技术、社会、环境的全谱系风险防控体系[12]。

三、核心内容与升级亮点

-

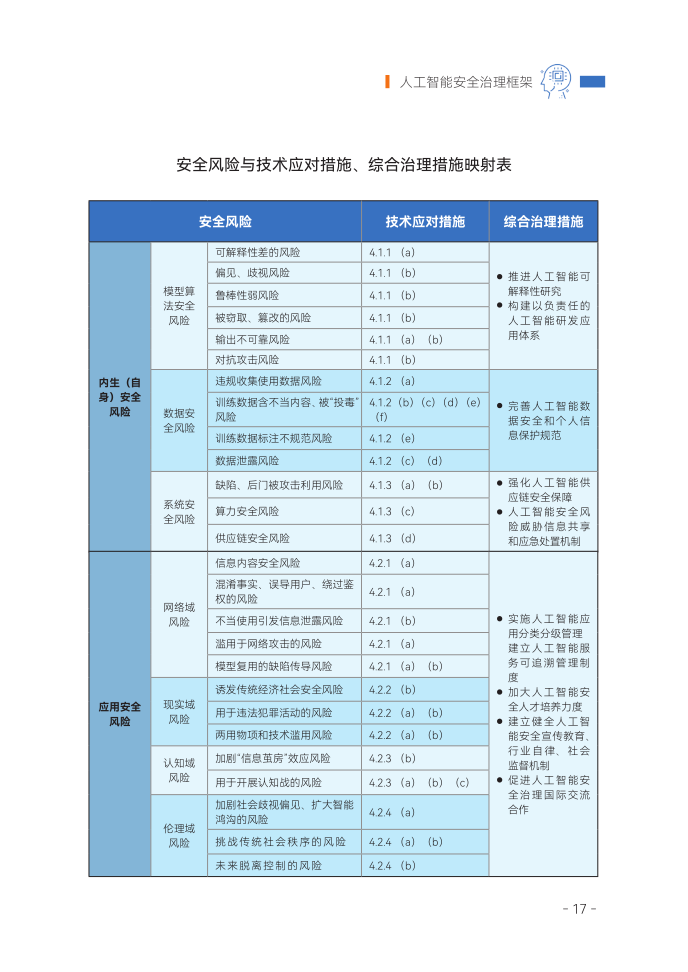

风险分类细化

- 新增"应用衍生安全风险":关注AI大规模应用对社会(如就业结构、资源消耗)和环境(如偏见放大、教育冲击)的次生影响[11][14]。

- 调整风险分级方法:探索提出分级治理原则,强化高风险场景的管控力度[11]。

-

技术治理强化

- 模型算法安全:新增数据标注流程规范、开源模型缺陷管理要求,防范训练数据污染与模型滥用712。

- 应用部署安全:明确智能体与业务融合、具身智能等新兴场景的安全边界16。

- 全生命周期管理:覆盖研发、部署、运营、使用各环节,提出差异化安全指南[15][17]。

-

国际规则衔接

- 提升框架动态适应能力,与国际治理标准(如欧盟《AI法案》、OECD原则)对接,增强中国方案的全球兼容性[6]。

四、实施目标与战略价值

-

国内治理支撑

- 为产业发展提供明确方向,平衡创新与风险,推动AI技术在安全可控前提下健康发展[6][10]。

- 降低企业合规不确定性,提升治理效率[13]。

-

全球治理贡献

- 提供系统化中国方案,展现负责任大国担当,推动构建开放、公正、非歧视的全球治理环境[6][13]。

- 通过多边合作机制(如G20、UN)输出治理经验,促进技术成果普惠共享[6]。

五、具体条款示例

-

研发阶段安全指南

- 模型算法设计需嵌入公平性、鲁棒性验证机制[15][17]。

- 数据标注流程需符合隐私保护与标注质量标准[7]。

-

应用阶段安全指南

- 智能体部署需通过安全评估,防范自主决策风险[16]。

- 具身智能设备需满足物理安全与伦理约束[16]。

-

风险分级原则

- 高风险场景(如自动驾驶、医疗诊断)需强制第三方审计与透明度报告11。

- 低风险场景(如推荐系统)以行业自律为主,政府抽查为辅[11]。