迁移学习

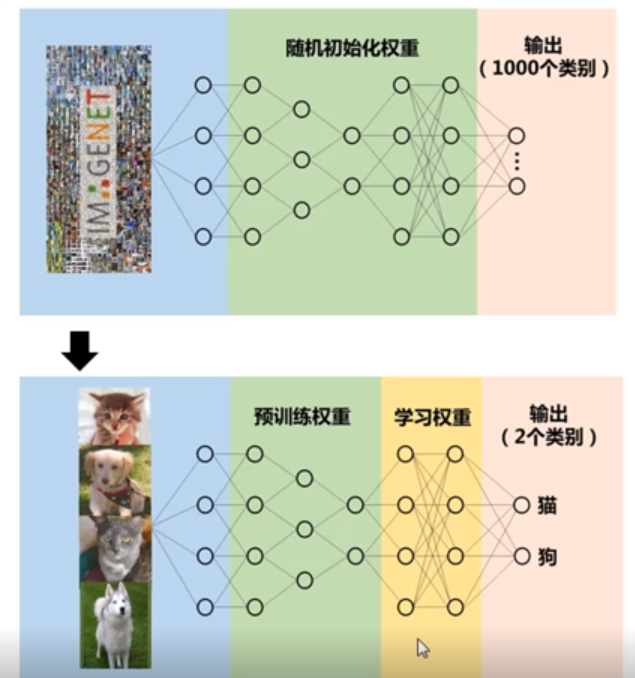

利用已经训练好的模型作为新模型训练的初始化的学习方式。

为什么使用迁移学习呢?1.所需要的样本更少;2.模型达到收敛所需的耗时更短;

什么时候适合迁移学习?1.当新数据集比较小且和原数据集相似时,2.算力有限时

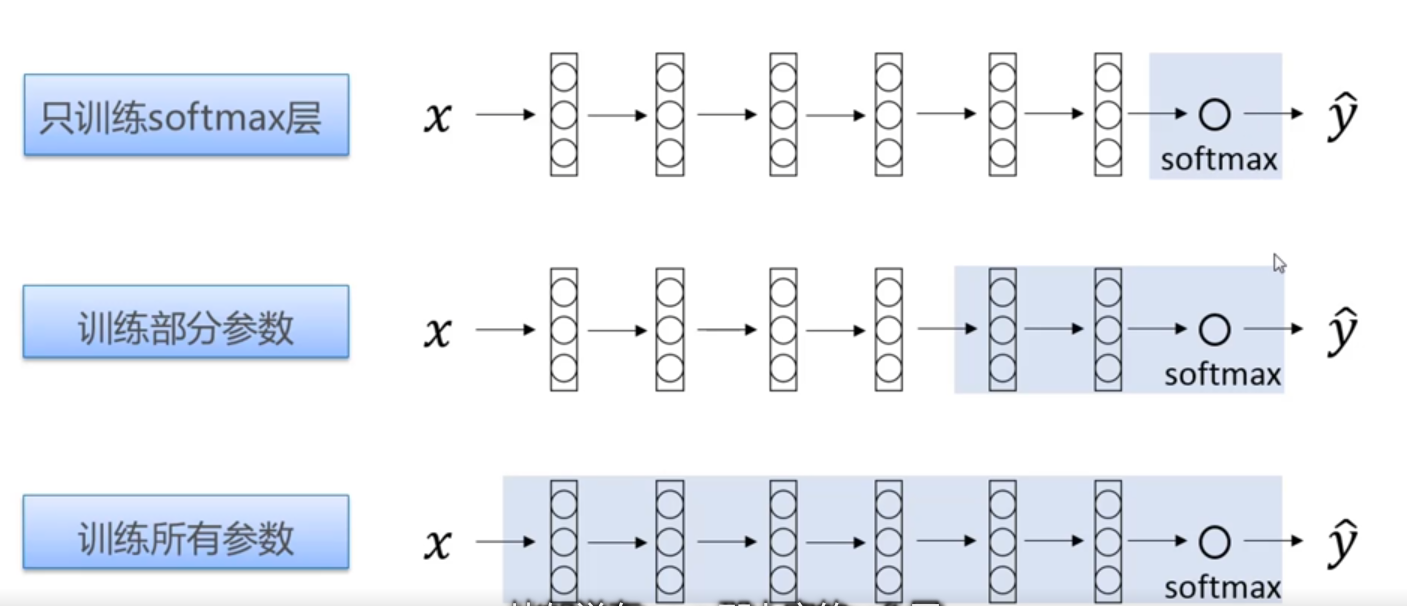

怎么使用迁移学习?

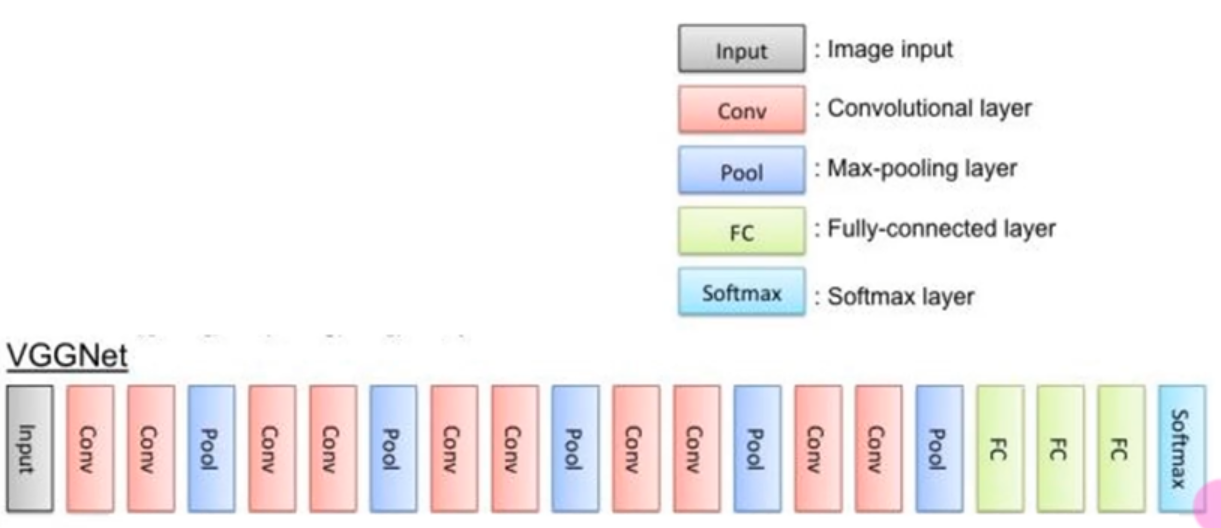

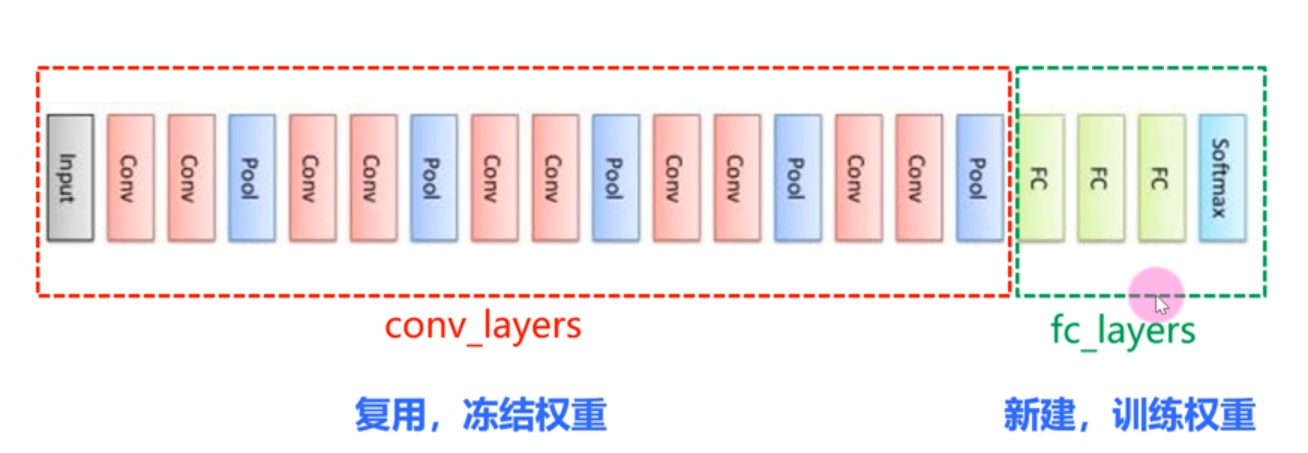

基于VGG16模型迁移学习构建

def vgg16_model(input_shape=(224,224,3)):

vggl6 = tf.keras.applications.vgg16.VGG16(include_top=False,weights='imagenet',input_shape=input_shape)

for layer in vggl6.layers:

layer.trainable = False

last = vggl6.output

x = tf.keras.layers.Flatten()(last)

x = tf.keras.layers.Dense(128,activation='relu')(x)

x = tf.keras.layers.Dropout(0.3)(x)

x = tf.keras.layers.Dense(32,activation='relu')(x)

x = tf.keras.layers.Dropout(0.3)(x)

x = tf.keras.layers.Dense(2,activation='softmax')(x)

model =tf.keras.models.Model(inputs = vggl6.input,outputs=x)

model.summary()

return model微调(finetuining)

1.trainable参数变动

在进行Finetuning对模型重新训练时,对于部分不需要训练的层可以通过设置trainable=False来确保其在训练过程中不对呗修改权值

2.加上特定的全连接层

预训练的VGG实在ImageNet数据集上进行训练的,对1000个类别进行判定,若希望利用已经训练的模型用于其他分类任务,需要修改最后的全连接层。