论文题目:Advances in Machine Learning Models for Predicting Enzyme Kinetic Parameters

酶动力学参数预测的机器学习模型研究进展(Ali Malli, Denys Vasyutyn, and Jin Ryoun Kim*)JCIM

Enzyme Kinetic Parameters 酶动力学参数

个人总结:

酶动力学参数是量化酶催化反应规律、表征酶功能特性的核心数值指标:

周转数 (Kcat,催化常数,只和酶本身的催化机制、结构稳定性有关,和底物浓度无关。),酶的工作效率上限,表示单位时间内单个酶分子能够转化多少个底物分子。kcat=100 s⁻¹,意味着 1 个酶分子每秒能催化 100 个底物分子转化为产物。

麦克力斯常数 (Km,酶对底物的 "亲和力"------ 酶能 "抓牢" 底物的能力)Km 是 "让工厂达到一半产能所需的原料浓度"------Km 越小,说明工厂对原料的 "抓取能力" 越强,只需要很少的原料就能高效运转 ;Km 越大,说明酶对底物的亲和力越弱,需要很高的底物浓度才能达到半饱和。Km 是底物特异性的核心指标,对主要抓的目标底物km要小

催化效率 (kcat/Km,又称特异性常数,酶的 "综合性价比"------ 兼顾催化速度和底物亲和力的核心指标)反映酶在 "底物浓度不饱和" 条件下的催化能力

抑制常数 (Ki,酶对 "抑制剂" 的 "抵抗能力"------ 酶在工业环境中抗干扰的指标)反映抑制剂对酶催化活性的抑制强度 ------Ki 越小,说明抑制剂与酶的亲和力越强 ,酶越容易被抑制;Ki 越大,说明酶对抑制剂的抵抗力越强,越不容易被抑制。

使用大语言模型去预测通过指标判断,现阶段存在的主要问题就是数据集的问题,

为什么用ai来预测:传统计算方法太复杂,做实验耗材成本和测试成本都高

主要研究方法:1先把酶-底物进行特征表示:序列特征,将氨基酸序列变为高维;结构特征:预测3D结构。底物有采取分子指纹:把底物的化学结构变成固定长度的向量,或者用类似gan网络构建一个分子图

核心模型分类:主要是全局模型(能覆盖多种酶)局部模型(指定某一类酶)

现在的主要缺陷:1数据问题,2模型的泛化能力差(使用全局模型和局部模型结合的方式),可解释性差(加入结构特征)3特定的参数预测薄弱

摘要

- 酶动力学参数,包括kcat、Km、kcat/Km和Ki ,对于指导酶工程、代谢建模和合成生物学的应用至关重要,因为它们提供了关于酶在各种条件下活性的定量信息。

- 介绍了基于多种酶类训练 的全局模型以及针对特定酶家族 的局部模型。这些模型已被应用于多种应用领域,包括预测突变效应、加速酶挖掘以及参数化基因组 级代谢模型。虽然数据稀缺 仍是这些模型的主要限制,但我们提出了高通量数据生成 和半监督学习等新兴机会,作为克服这一问题的手段。

- 总之,本综述为利用机器学习提升酶动力学参数预测的性能、鲁棒性和范围提供了路线图,从而实现目标功能蛋白质序列的准确注释。

引言

酶是天然催化剂,通过加速化学反应选择性且高效地转化化合物。重组DNA和基因克隆技术的进步促进了酶在微生物宿主中的可扩展表达,使其成为合成增值化学品的有吸引力的候选材料。在向循环经济转型的背景下,这些生物工艺为材料和能源生产提供了可持续的路径。

工艺的有效性取决于一套动力学参数,这些参数决定酶催化底物成产物的速度和效率。

酶特点与局限性

酶通常仅由20个氨基酸 组成,但它们表现出极大的多样性。例如,典型肽链 由100个残基 组成,有20100种组合可能性,超过了宇宙中已知粒子的数量。然而,估计只有1077个序列中有1个折叠成稳定且功能性结构 。传统上,通过实验方法如定向进化 来寻找已知酶的增强突变体,有助于导航这些序列或宏基因组挖掘以发现新酶。虽然这些策略缩小了搜索空间,但它们依赖于昂贵、耗时且反复的检测方法,成为扩展的障碍。鉴于序列空间的庞大,这使得大量酶无法被表征。

现阶段方法

尽管上述局限性存在,序列空间的实验搜索结果导致可用数据规模激增 。这使得使用统计方法能够揭示隐藏的模式和关系 。因此,近年来越来越受关注的一种有前景的替代方案依赖人工智能的进步,将模型拟合到现有数据中,并对酶的特性进行计算机模拟预测 。17,18 在这方面,机器学习(ML)和深度学习(DL)模型已被成功用于预测酶结构,函数,和适应度,适应度景观由多种特征组成,如活性、稳定性和表达水平 ,这些因素共同影响整体表现。然而,适应度评分并不能直接量化反应条件下的催化性能 。此外,预测活动的计算工具仍不足于用于预测稳定性和表达。因此,从通用适应度代理 转向参数特异性预测,代表了一种更具可解释性的方式,用于工程出具所需催化特性的酶。

机器学习相关方法

在量化活性方面,机器学习模型用来预测动力学参数,如周转数(kcat )、迈克利斯常数 (Km)、催化效率 (kcat/Km)和抑制常数 (Ki)。每个参数代表酶在不同条件下的活性,例如底物浓度变化以及抑制剂的有无 。简而言之,kcat表示单位时间内每个活性位点转化为产物的最大底物分子数 ,而Km等效于酶以最大催化速率一半功能时底物的浓度 。这两个常数的比值代表酶将底物转化为产物的效率,考虑了酶的速度和对底物的亲和力。同时,当存在抑制剂时,需要考虑Ki,它量化了抑制剂阻断酶活性的强度。在某些情况下, kcat和Km分别可通过活化自由能和底物结合能理论确定 。然而,在实际中,大多数酶在计算上具有原子级精度 的计算挑战。此外,Km并不总是直接反映底物-酶结合亲和力,因为它也可能受到其他动力学步骤的影响。这些挑战使得从物理直接可靠估计酶动力学参数变得困难原则,强调基于实验数据训练的机器学习方法弥合这一差距的潜力。

酶动力学中机器学习的基本要素

A.酶在机器学习中的基本原理

文章作者在这里提到去看Kouba, P.; et al. Machine Learning-Guided Protein Engineering. ACS Catal. 2023, 13, 13863−13895。

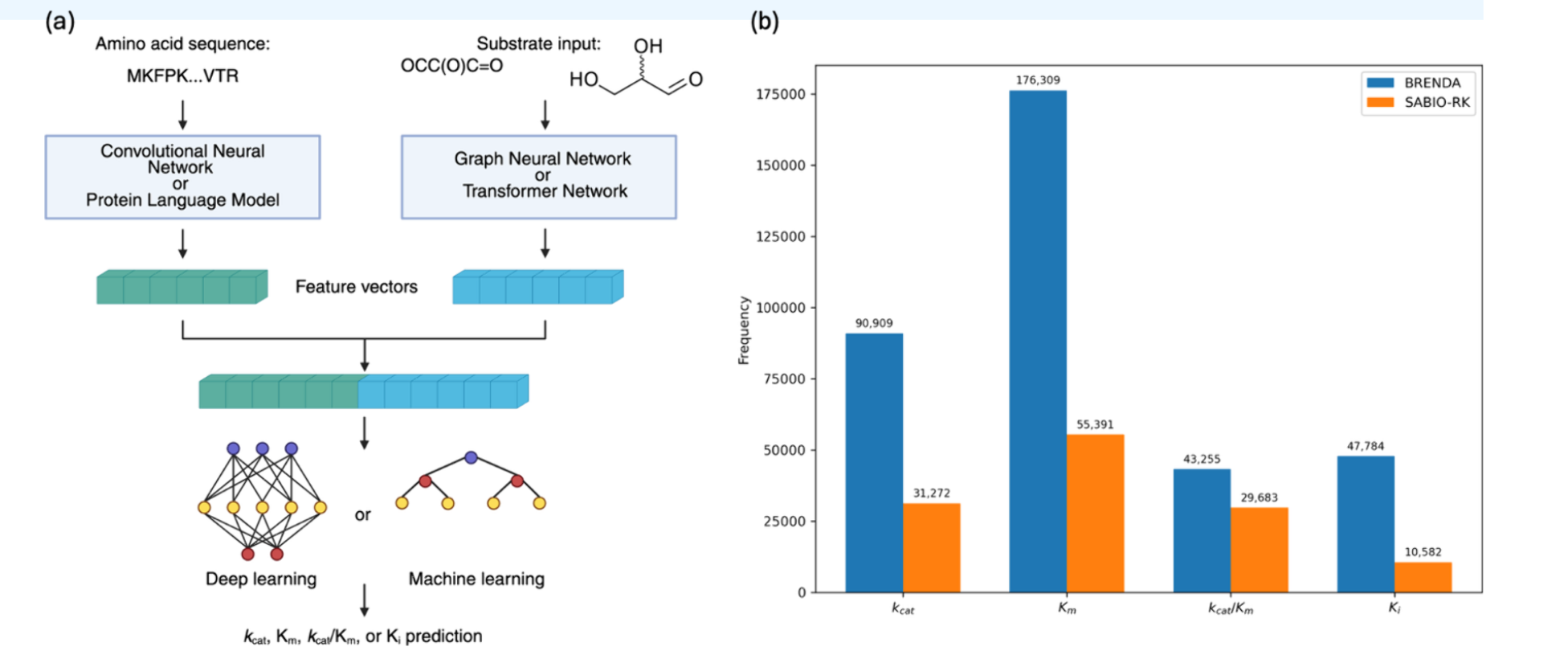

用于酶动力学预测的机器学习模型通常接受两个主要输入 :酶,由氨基酸序列或三维结构表示 ;底物,由化学结构 表示,即简化分子输入线输入系统**(SMILES)字符串** ,或分子指纹。这些表示将关于酶和底物的分子信息转换为数学上可处理的格式,同时最小化信息丢失(见图2a)。各种神经网络架构在编码每种模态方面表现出色,但通常需要较大的数据集进行训练以实现高性能。

左边是典型模型架构示意图,

B酶的编码情况

提取酶序列特征的一种简单方法是使用单热编码 ,其中每个氨基酸以二进制载体 表示,其中"1"表示其存在,"0"表示在残基位置i处缺失。然而,这导致特征向量稀疏且高维 ,从而降低计算效率。与此同时,卷积神经网络(CNN)通过滑动核提取局部基序 ,输出n-gram频率或催化位点模式 。 n-gram的特征数量 可能极大,随着n的增加,可能成为高维特征空间。

虽然CNN在检测短功能基序方面高效 ,但它们无法捕捉长距离依赖 关系,例如在初级序列中较远的氨基酸之间的分子内相互作用。这个问题可以通过蛋白质语言模型(pLMs) 来克服。在自然语言处理(NLP)中,语言模型将句子视为单词序列,并通过一种称为变换器网络的自监督学习 方式学习其上下文关系。同样,酶序列也可以被解释为句子,并通过其组成的单个氨基酸进行分词化 。这种并行性为创建训练预测酶序列中掩蔽氨基酸的pLMs打开了大门。最终,pLMs的输出称为嵌入 ,包含了关于酶序列的关键功能和结构信息 ,涵盖了短期和长期的关系。为了预测酶的动力学参数,可以使用预训练的pLMs (如进化尺度建模2,ESM2)、23 ProtT5,49和UniRep.50对酶序列进行数值编码。 这些模型训练于数百万未标记的蛋白质序列上,以学习与生物学相关的序列无需功能标签的特征。这些模型为每个氨基酸残基生成高维嵌入。然而,由于机器学习模型通常需要每个酶一个向量 ,而非每个残基一个,这些嵌入通过在最终变换器层上应用池化作,压缩为固定长度的酶级表示。平均而言,这些特征被视为高维特征,因为基于最后一层变压器层的pLM矢量长度约为1000−1300。

当使用结构数据时,可以采用多种信息编码 策略。捕捉结构信息的一种简单方法是统计兴趣点(如活性位点)半径内的特定残基数量 。或者,酶结构可以转换为残基-残基图,称为接触图,节点代表氨基酸,边表示空间接近和相互作用。这些信息可以通过图卷积网络(GCN)或图注意力网络(GAN)进行编码。GCNs聚合图中邻近残基的信息,并将局部结构特征传播到酶中。与此同时,GAN通过引入注意力权重扩展GCNs,使模型能够聚焦于重要的邻居,如催化残基和底物结合位点,而非一视同仁地对待所有邻居。

至于底物,它们可以通过各种简单的分子描述符编码为指纹 ,这些描述符历史上被化学界用来描述小分子,如MACCS键,将亚结构和官能团的存在归入固定长度的矢量 。为了将底物结构编码为分子图,GCN和GAN用于聚合原子层面特征,如部分电荷、芳香性以及原子-原子连接的重量,这些特征由化学作用归因于相关的互动。此外,消息传递神经网络(MPNNs)通过显式建模原子间的迭代消息交换,进一步描绘分子中的长程效应。最后,类似于 pLM,基于变换器的网络如 SMILES transformer55 和 ChemBERTa56 已被开发出来,通过从大量分子数据集学习亚结构关系和化学语法,将 SMILES 字符串标记为数值特征。

数据集

用于复杂任务(如预测酶动力学参数)的机器学习模型,需要大量训练数据 才能有效泛化并产生可靠的预测。此类信息公开存在于大型数据库中,如布伦瑞克酶DAtabase(BRENDA )、生物化学通路分析系统-反应动力学**(SABIO-RK)** 以及通用PROTein资源**(UniProt)**。

BRENDA是从10万多篇文献中提取的最全面的实验酶数据库之一。 除了动力学参数外,数据库还包含酶的分类 (EC)编号、来源生物和检测条件等信息。同样,SABIO-RK是一个包含酶反应及其动力学参数数据的数据库,这些数据由文献手动检索。而BRENDA则关注酶和其动力学参数SABIO-RK以反应为中心,超越动力学常数,涵盖速率定律和实验条件。值得注意的是,这些数据库中kcat/Km和Ki条目数量较kcat和Km少。

至于UniProt,它是包含蛋白质序列、结构和功能及其功能参数信息的最大蛋白质数据库。 UniProt中的酶动力学数据稀少,仅约1%的酶具有实验确定的kcat值。 然而,其重要性在于通常用作锚点的UniProt识别码,用于将BRENDA和SABIO-RK的动力学记录与对应序列比对。例如,Krishnan及其同事(2025)提出了一个结构导向动力学数据库(SKiD),将kcat和Km及其对应的3D结构数据整合,涵盖13,654对酶-底物,涵盖六类酶类。在该数据库中,从BRENDA检索动力学数据,并通过UniProt ID映射到其蛋白质数据库(PDB)结构。确定底物的催化和结合位点后,结合能量被计算并利用GNINA存储到数据库中。

还有一个类似但规模较小的1050酶-底物对数据库,名为IntEnzyDB 。此外,Boorla和Maranas(2025)编制了CatPred-DB,这是一个包含kcat、Km和Ki值的综合数据集,将UniProt ID映射为BRENDA和SABIO-RK的条目与其对应的氨基酸序列标识符及预测的三维数据AlphaFold-2.0数据库中的结构。19,40 CatPred-DB涵盖23197 kcat、41174 Km和11929 Ki条目,与其他机器学习动力学数据集相比,酶序列空间扩展了多达60%。

与讨论中汇编实验测量值的数据库不同,GotEnzyme和GotEnzyme2 代表了一类新的预测动力学参数库。原始的GotEnzyme数据库通过在经过精选的实验数据上重新训练一组机器学习模型以及对未表征的酶-底物组合预测的8099个生物体,提供了超过2570万对酶-化合物对的kcat值。GotEnzyme2通过在经过筛选的实验数据集上重新训练一组机器学习模型,并采用最佳策略预测未表征的酶-底物组合,将该数据库扩展到更广泛的参数集,包括Km和kcat/Km。需要注意的是,这些数据库中的大多数动力学常数缺乏实验验证,因为这些值来自机器学习回归模型,其对未完成实验测量的预测表现达到R2≈0.5−0.7。因此,尽管GotEnzyme和GotEnzyme2大幅扩展了被描述的酶序列空间,但它们不应被视为真实的动力学数据,因为预测误差的传播可能具有误导性。相反,这些资源可以补充而非取代实验整理的数据库,用于假设生成和酶学应用中的初步筛选。

为此,近期提出了提升数据可查找性、可访问性、互作性和可重用性(FAIR)的举措。贝尔斯坦研究所提出了一套名为"酶学报告标准"(STRENDA)的指南,用于报告酶相关测量结果,范围从指定反应条件到将实验信息与所选动力学模型及估计动力学参数连接起来。这些标准针对以下内容进行调整用于合成的酶,确保报告的数据涵盖酶的催化参数,这在一般蛋白质数据库中仍属可选。尽管这些标准在BRENDA和SABIO-RK等数据库中越来越多地被采用,但其使用范围仍有限,由研究人员自行决定。为促进这一转变,开发了如 EnzymeML76 和 STRENDA DB77 等验证工具,自动检查并确保酶学数据在发表于期刊或数据库前完整有效。

最后,需要注意的是,上述数据库中的大多数动力学条目均来自体外测量 。由于体内酶行为因分子拥挤、蛋白质-蛋白相互作用和翻译后调控而显著不同,基于体外预测训练的代谢模型可能无法完全捕捉生理动力学特性。因此,在使用这些数据库训练应用于体内系统的模型时,应考虑这一限制。

现有的模型路线图

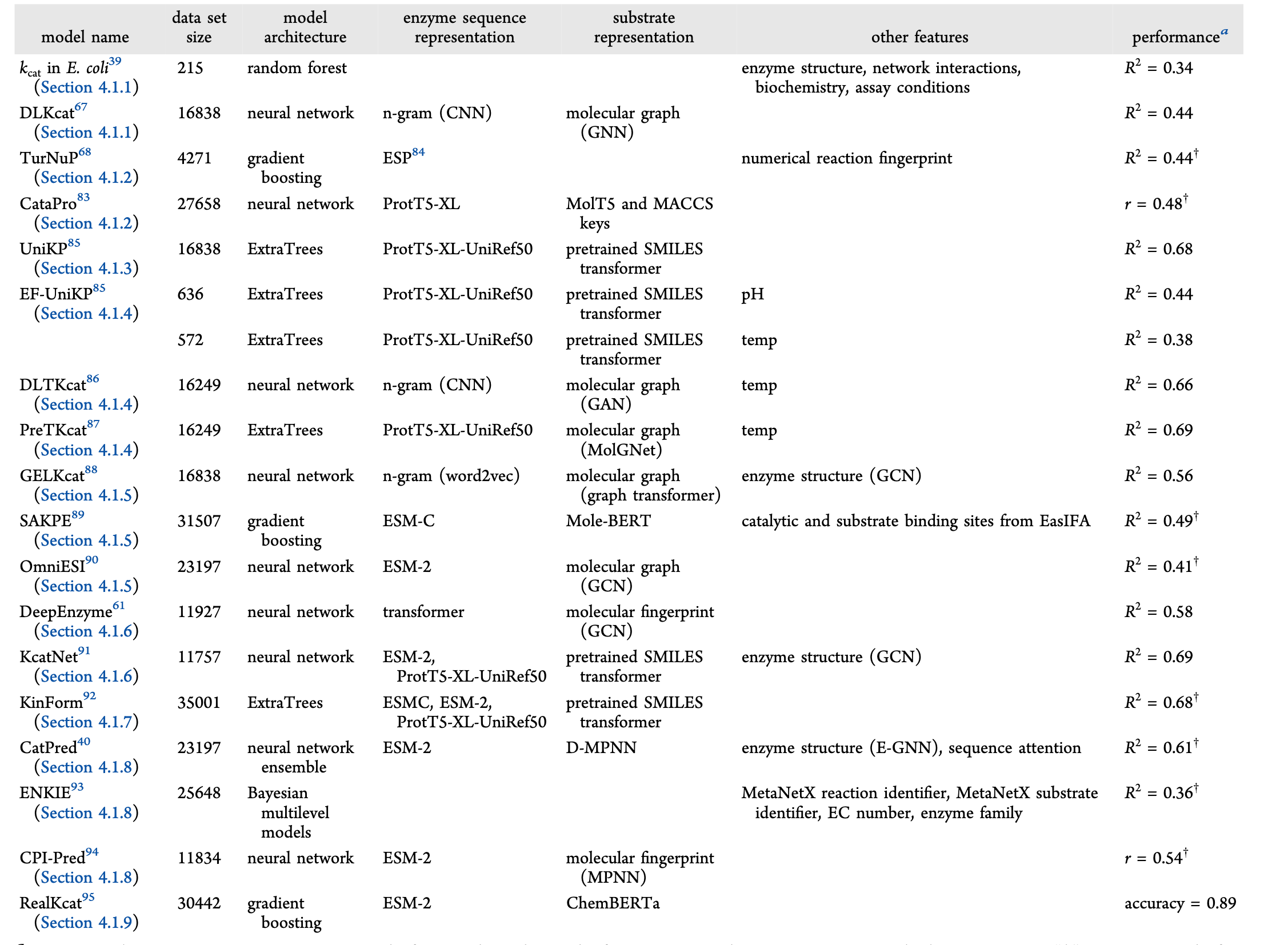

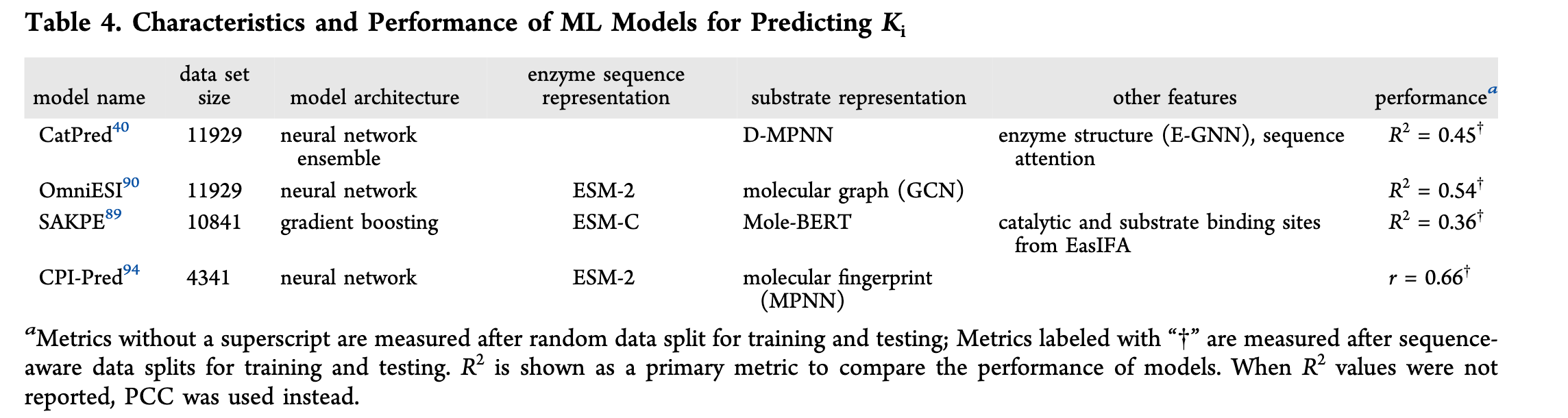

大多数用于酶动力学参数预测的机器学习模型本质上具有预测性质。它们旨在量化现有生化环境中的催化性质,而非新生成酶,尽管生成框架正开始作为补充工具出现。在这一预测环境中,机器学习模型大致可根据训练数据的范围和预期适用性分为全局或局部。全局模型在跨越多个酶家族、多个类别和生物体的大型数据集上训练。理论上,这使它们能够推广到多种序列和反应 。它们的优势在于捕捉序列-功能关系的广泛趋势,并应用于远缘酶 。相比之下,局部模型则针对更狭窄的序列空间,聚焦于单一酶及其变异体或一系列密切相关的酶。通过利用这一有限领域的高质量数据,局部模型有潜力捕捉细粒度交互,尽管代价是普遍性。本节重点介绍了全局模型在预测kcat、Km、kcat/Km和Ki方面的最新进展,并分别总结了表1、表2、表3和表4中的模型及其表现细节。未详细讨论的kcat和Km模型总结见表S4和S5。

Kcat模型预测 周转数

早期2023年以前

最早预测kcat的机器学习模型之一是Heckmann及其同事于2018年开发的。他们采用随机森林模型 ,利用多种结构和生化特征,预测大肠杆菌中各种酶反应的体外kcat值。由于大肠杆菌酶促反应的kcat值仅占所有催化反应的10%,训练数据包含172个内源性大肠杆菌酶的kcat值,模型在独立测试集上实现了测定系数R2 = 0.34。作者发现,预测kcat最重要的特征是通过简约通量平衡( 传统 FBA 需要全基因组代谢模型,计算复杂;sFBA 会聚焦 "核心代谢路径"(比如和酶功能直接相关的路径),忽略次要支路,用数学方法计算每个反应的 "发生强度"------ 不用依赖大量实验数据,效率更高,适合作为 AI 模型的特征输入**)分析计算出的反应通量(?** 通俗说就是代谢网络中某一步反应的 "流量" 或 "活跃程度" :反应通量是细胞给酶的 "任务量",kcat 是酶的 "工作能力上限"------ 任务量越大,酶的能力上限通常越高,这种进化关联让反应通量成为预测 kcat 的重要特征。)。然而,该模型的适用性有限,因为所用输入特征仅适用于大量研究的模式生物(如大肠杆菌、酿酒酵母和智人)的酶促反应。

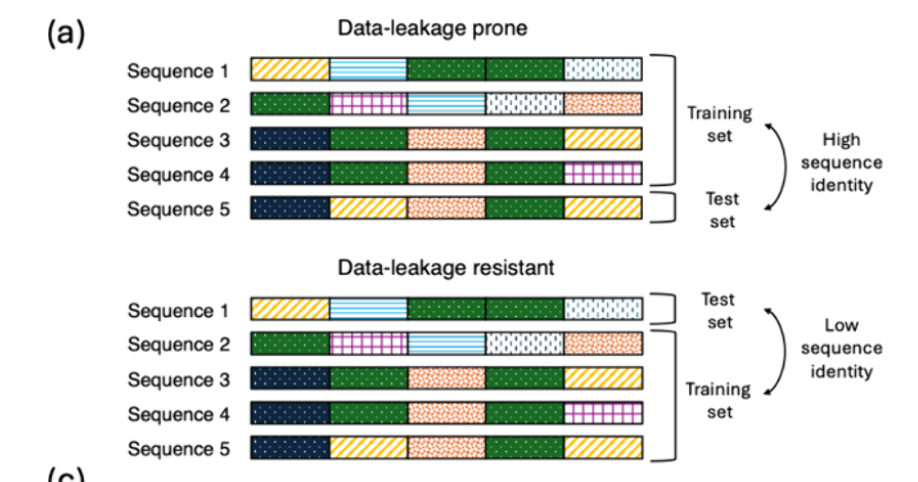

2022年,李及其同事开发了DLKcat模型,这是一种需要更易获取输入的生物体无关DL模型。该模型仅依赖酶的氨基酸序列和其中一种反应底物 ,以在所有可能的酶类空间中进行预测反应模型预测的对数kcat值平均与实验值相差在一个数量级以内,并在用作测试集的完整数据集的随机子集上达到了R² = 0.44。然而,数据集包含多个野生型酶及其突变体与同一底物配对,以及同一酶序列与不同底物配对的条目(告诉我数据集很重要数据集很重要)。由于数据被随机拆分,未考虑测试序列与训练序列间共享序列身份,模型存在数据集间的数据泄漏,测试集中67.9%的酶序列也存在于训练集,90%的酶序列与训练序列共享>99%)。因此,DLKcat难以推广到共享序列的未见序列<与训练集中序列的60%相同性:R2值为负,这意味着对某一酶-底物对的预测比使用所有反应的平均kcat值更差。

处理数据泄漏这个完全没懂

通过将数据集拆分为训练数据和测试数据集**,避免训练和测试序列中出现相同或高度相似的酶** (见图3a)来避免DLKcat中观察到的数据泄漏。最早实现这一点的模型之一是Kroll及其同事于2023年发布的TurNuP。其关键创新是结合数值反应指纹和酶序列的pLM嵌入,预测野生型酶的kcat。 尽管训练在较小数据集(n = 4271),TurNuP在序列与训练序列不同的测试集(R² = 0.44)上表现优于DLKcat(n = 16838)。 包括对序列识别率<40%的序列训练序列,R2 = 0.33。与Heckmann等人(2018年)发布的模型不同,39个反应通量并未提升TurNuP的性能。类似于TurNuP中使用的序列感知拆分,Wang等人(2025年)在通过聚类kcat条目创建的10折交叉验证数据集上训练了一个名为CataPro的模型,使同一集群中没有两个序列共享超过40% 该模型在训练序列与测试序列间低序列同一性时实现了皮尔逊相关系数(PCC)r = 0.48,进一步证实对未见酶的推广关键依赖于无泄漏的分裂。

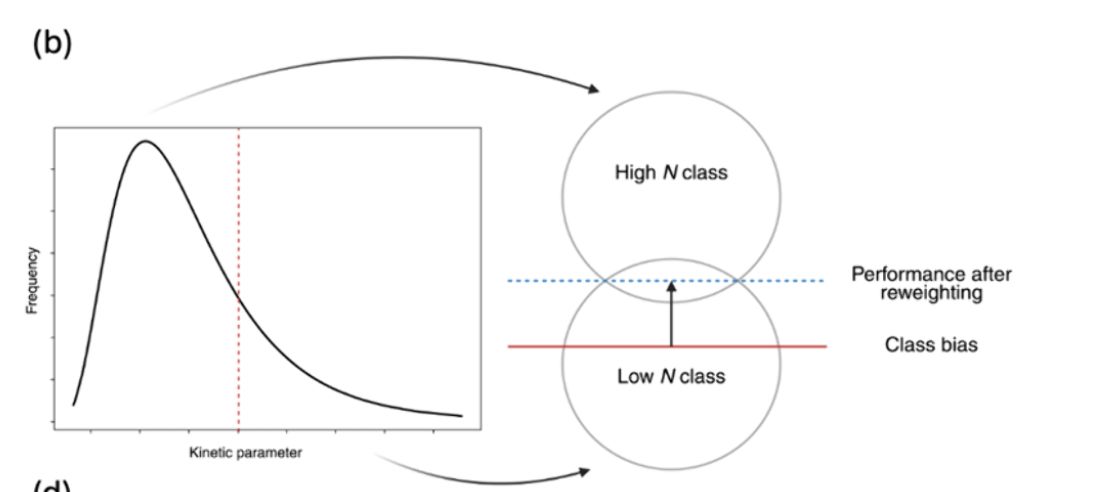

处理数据不平衡

TurNuP 的一个局限是其倾向于高估极低的 kcat 值,低估极高的 kcat 值,这可归因于数据中的不平衡和噪声。Yu 及其同事(2023)在其模型 UniKP 中通过加权方法解决了数据不平衡问题。该模型因采用减少方差的集合模型而取得了不错的性能, 使模型对训练数据更具鲁棒性。然而,在分析数据集的KCAT值分布时,作者发现两端的绝对误差都比中间的条目更大。因此,他们采用类别平衡重权,通过降低高密度中段kcat值的相对权重,提升模型预测kcat高值的能力 。重新加权的动机是基于这样一个观点:由于数据集中信息重叠,额外的数据点与其对应类别的收益递减(见图3b)。重加权模型中高kcat条目RMSE比未加权模型低6.5%。

考虑环境因素

数据集中的噪声可能源于数据集中kcat的值是在温度和pH等不同实验条件下测量的。这些环境因素未被用作之前模型的输入,主要是因为它们在现有数据集中不可得。因此,Yu 及其同事(2023)创建了修订版 UniKP,这是一个基于较小数据集的重新训练 UniKP,数据包含测量 kcat 的温度或 pH,并在从 UniProt获取实验条件后,UniKP 和修订版 UniKP 作为基层,其输出输入线性回归层,以得到目标 pH 或温度下的最终 kcat 预测。该两层框架称为EF-UniKP,在严格测试集上评估时,pH数据集的R² = 0.45,温度数据集的R² = 0.31,且该测试集中未包含酶或底物。

虽然EF-UniKP未在其模型中评估环境因素的特征重要性,但它对kcat提供了更为现实的预测,因为它高度依赖于温度。另一个考虑温度效应的模型是DLTKcat。该模型采用双向注意力块,通过计算原子到残基和残基到原子方向的注意力权重来描绘底物原子与酶残基之间的相互作用,而非简单地串接向量。温度值被添加到加权矢量中,输入一组密集层以生成kcat预测。尽管该模型表现优于EF-UniKP,达到R² = 0.66,但在数据准备过程中,由于低温(<20°C)和高温(>40°C)的过采样,仍存在数据泄漏问题。由于测试集是随机选择的,部分条目在训练中出现完全相同的匹配,导致DLTKcat的性能指标膨胀。一个更稳健的温度依赖性kcat预测模型是PreTKcat.87。PreTKcat使用ExtraTrees系似模型,在随机分配生成的10折检验集中实现了R² = 0.69,比UniKP.87提升了2.98%。作者报告称,增加pH并未显著提升PreTKcat的性能。

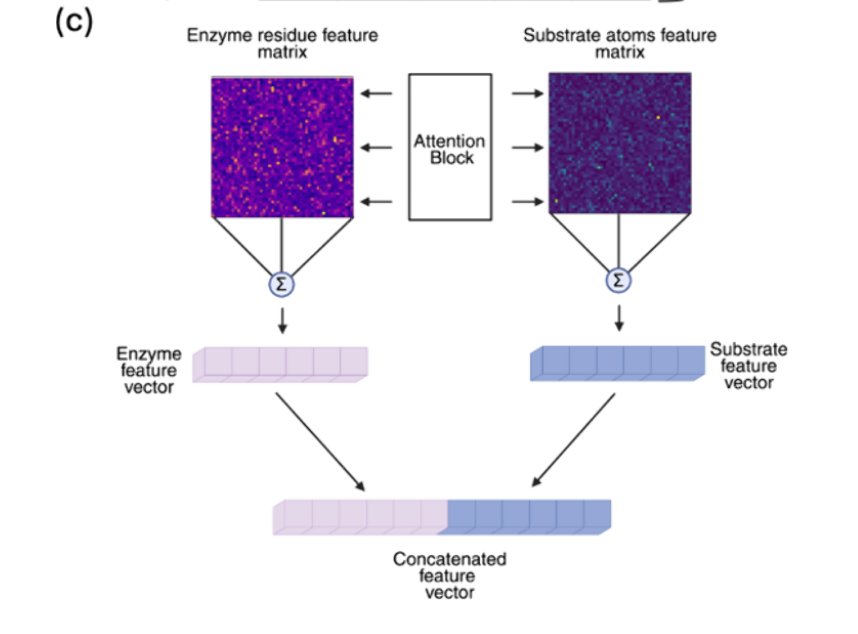

使用交互感知特性

类似于DLTKcat,Du及其同事(2025)认为,仅仅将底物和序列编码向量串接,会限制捕捉底物与酶之间复杂特征相互作用的能力(见图3c)。因此,他们开发了GELKcat,采用门网络,在将酶和底物编码赋予权重后,将载体融合并传递给完全连接的神经网络。消融研究显示,门网络的R2提升率比无门网络的模型提升了3.92%。尽管门网络发挥了作用,GELKcat并未优于仅将特征向量串接的机器学习模型,如UniKP和PreTKcat,这很可能是因为它们使用n-gram来表示酶序列,而非pLM嵌入。Qiu及其同事(2025)选择直接将酶的重要位点(如催化位点和底物结合位点)作为其模型SAKPE的特征,取代注意力块和门网络。该过程使用EasIFA算法,该算法将pLM与结构编码整合,以确定并赋予酶序列中重要残基的权重。消融研究显示,其他位点特征也被纳入考量R2 提升了 0.02 个版本,并且该模型的表现优于 DLKcat 和 UniKP.

最近,OmniESI被引入为一种利用条件DL方法预测酶-底物相互作用的框架。与以往使用连接静态嵌入作为特征向量的模型不同,OmniESI依赖新颖的特征调制策略,如双向条件特征调制(BCFM)和催化感知条件特征调制(CCFM),以细化联合酶−底物表征,朝向催化相关的潜空间进行优化。酶序列和底物的嵌入被送入BCFM,该酶作为底物侧网络的条件, 底物作为酶侧网络的条件。然后,调制特征并行进入CCFM,其联合表示作为条件,基于细粒度生化依赖性重新加权特征。消融研究显示,这两个模块将OmniESI的R2从0.57提升到0.64.

结合酶结构特征

在很大程度上,酶的功能受其三维结构控制 ,上述模型均未考虑这一点。基于结构的机器学习模型已被广泛应用于蛋白质科学的其他领域,如预测蛋白质功能和配体结合位点,但很少有研究将这一方法扩展到酶促动力学领域。Wang及其同事(2024)开发了DeepEnzyme,除了蛋白质序列和底物结构外,还利用蛋白质结构特征来预测kcat。由于大量动力学表征酶缺乏实验确定的三维结构,作者使用ColabFold105预测了数据集中所有酶的结构。模型在测试集上获得了R² = 0.58,并且当测试序列与训练序列共享<50%的序列同一性时,R² = 0.42也保持了令人印象深刻的R² = 0.42。作者将这一卓越表现归因于从三维结构中学习到的特征,声称这些特征与功能密切相关 。另一个考虑结构特征的模型是KcatNet。它还包含一种注意力机制,捕捉酶与底物之间的相互作用,以实现特征编码。该模型在同一数据集上比UniKP高出18%。尽管这些模型通过考虑测试序列与训练序列之间的序列身份来测试数据泄漏,但由于接触图中嵌入的结构相似性导致的数据泄漏并未被考虑。例如,两个同源酶尽管因进化路径分歧而共享较低的序列相似性,却能表现出高度保守的三维结构。

高维pLM下的稳定性建模

有些模型可能对训练数据进行过度拟合,由于数据大小与特征向量尺寸不匹配,表现得异常强大 。本文重点介绍了改进基于pLM表示的策略,无论是选择更具信息量的层,还是降低嵌入的维度以减少过拟合。Alwer和Fleming(2025)构建了KinForm,解决了pLM表示酶序列时的常见问题。由于催化活性通常由少数残基决定,pLM输出的均匀聚会稀释相关信号。 此外,迄今讨论的大多数模型使用pLM的最后一层变压器,这对动力学参数预测可能并非最有参考价值。 相反,残基级信息从KinForm中的pLM中间层(如ESMC和ESM-2)提取。此外,作者用结合位点加权池替代了均匀池化,以表示更依赖底物的相关嵌入,并与底物表示向量串接。底物结合位点权重分别使用Pseq2Sites模型计算。108 为解决pLM载体的高维性,采用主成分分析(PCA)将载体减少至200⁻400个组分,稳定了模型免受过拟合的压力。值得一提的是,KinForm表现优于UniKP,R2值约为其两倍,尤其是在低相似度序列区间。

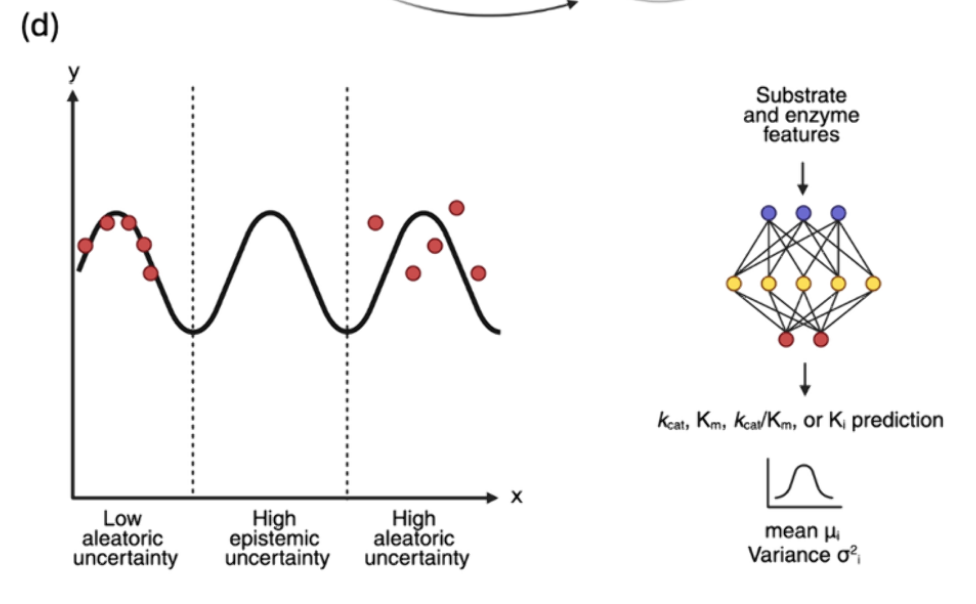

不确定性感知模型

之前所有模型都是确定性的,意味着它们使用传统回归方法来输出单一值kcat预测。最近,Boorla和Maranas(2025)开发了CatPred模型,这是一种利用概率回归为kcat预测添加置信度量,通过估计相关的不确定性 。他们将预测性不确定性分解为偶然性和认识论不确定性 。前者与训练数据中的任何固有噪声相关,而后者则源于潜空间某一区域训练样本的稀缺(见图3d)。作者在数据集准备时施加了更宽松的约束,最终形成了23197个kcat条目,称为CatPred-DB。模型输入被传递到一个概率回归器中,回归器输出一个kcat预测的高斯分布,均值和方差为一(见图3d)。**由于该方差仅反映了偶然性不确定性,作者训练了一个由十个模型组成的模型集合,采用不同初始权重,均值的平均值为最终预测,均值方差捕捉认知不确定性。(这算不算缝合)**该模型在保留测试集(不含用于训练的酶底物对)和分布外测试集(不含与训练序列>99%认同的酶)上分别实现了R² = 0.61和R2 = 0.39。此外,76%的预测kcat值与实际值相差一个数量级。大多数预测的偶然性不确定性更高, 这表明实验数据中的噪声水平较高。有趣的是,与DeepEnzyme不同,结构特征并未提升CatPred的预测性能。作者将这一发现归因于他们的pLM特征不仅编码序列信息,还编码结构信息。然而,另一个名为DEKP的模型通过消融研究显示,尽管使用pLM编码酶序列,结构特征仍使其R2提升了0.08。总体而言,CatPred在分布集中表现优于DLKcat和UniKP等模型,并在类似条件下表现与TurNuP相当。这很可能是由于CatPred采用的集成架构,为模型的预测提供了稳健性。

将KCAT预测任务表述为分类问题

最近,RealKcat被引入为一种新颖的机器学习框架,用于利用序列和底物嵌入预测kcat。 与之前的模型不同,该预测任务被作为一个分类问题,将kcat值聚类到生物学意义的数量级区间。这种方法与工业实践相符,工业实践主要关注酶活性数量级,而非精确数值。由于缺乏低效或无活性酶数据导致的类别失衡,作者采用合成少数过采样技术(SMOTE),即用丙氨酸替代可用序列的活性位点, 创建一个"零活动"类。该模型的准确率达到了89%,其中95%的预测距离真实值相差不到一个数量级。

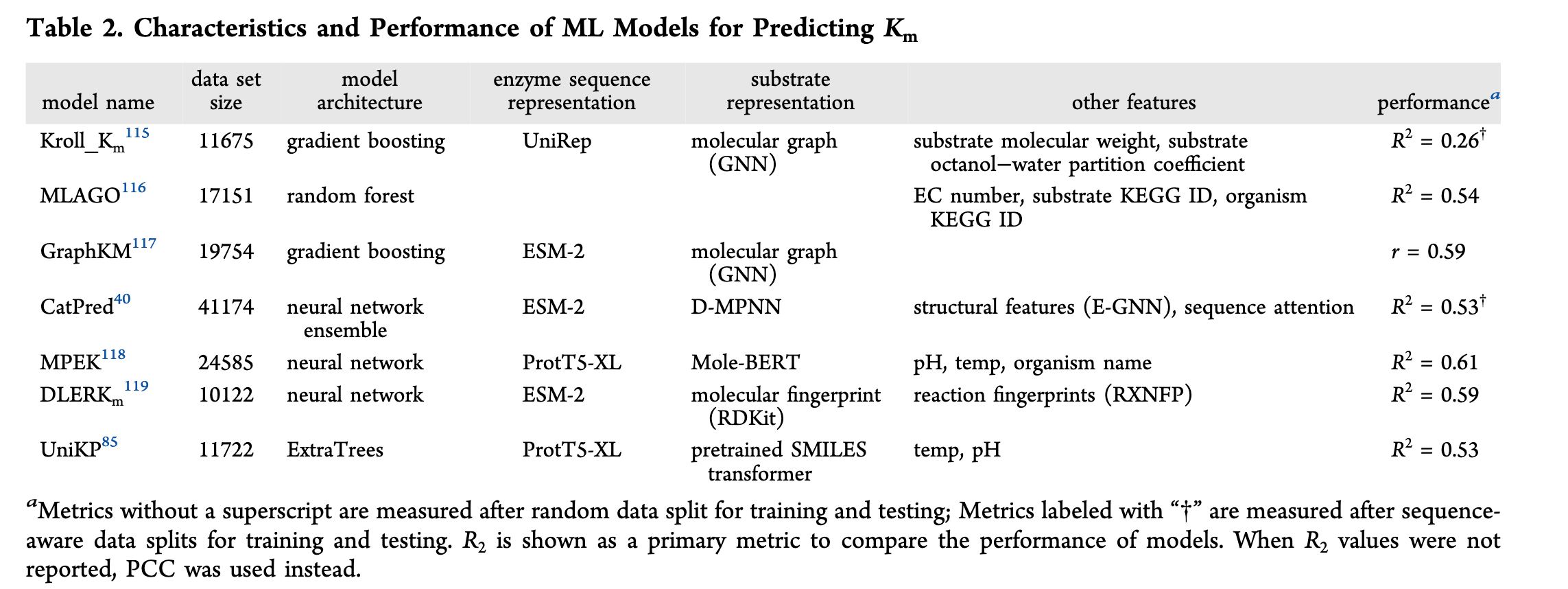

Km预测模型

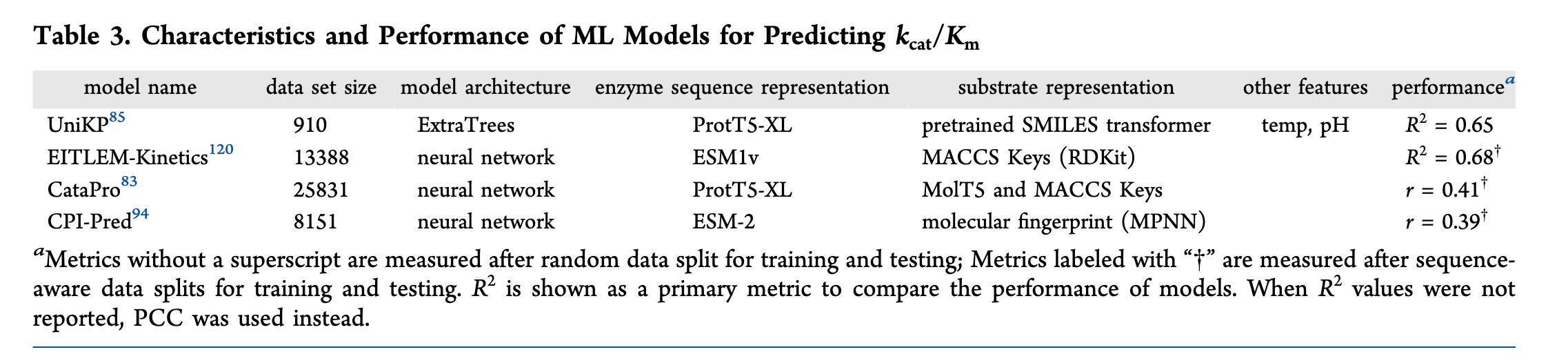

Kcat/Km预测模型

Ki预测模型

全局模型的应用

突变效应预测

天然酶的催化效率常常不足以满足工业过程的需求。因此,优化酶活性对于降低生产和运营成本至关重要。酶反应的动力学参数可以通过突变游走的概念景观映射到酶序列 。突变对功能的影响非可加性 ,因此模型预测多突变对酶活性影响的能力,直接表明其是否理解残基-残基相互作用及其与目标动力学参数的关系。DLKcat通过神经注意力机制评估氨基酸替换对kcat值的注意力权重,并实现了测试集中突变体的r = 0.78。然而,已证明模型表现夸大,在与不存在但与训练序列相似度超过99%的序列测试时,记录了R² = −0.18。 DLTKcat的作者报告称增强KCAT值的有益突变分布在其GAN注意力权重高峰附近。然而,由于模型也存在数据泄漏问题,具有高注意力权重的残基很可能对应训练集中相同序列的残基。此外,在未引入突变的残基处观察到一些高注意力位点,凸显了数据中的噪声。

更稳健的模型已证明能够捕捉酶突变体动力学参数变化趋势,凸显突变效应预测成功程度的差异。例如,DeepEnzyme预测高活性磷酸碱性磷酸酶突变体的中位kcat值比低活性突变体高出15%。MPEK将突变体数据分为野生型、增加型和降低kcat或Km类别。该模型在所有类别中均实现了PCC值,突变类别在两个参数中均为0.8至0.9。与此同时,CataPro的作者展示了其模型能够根据突变对特定底物反应的有利度(r > 0.7)对突变体进行排名。然而,当对整个数据集进行全面评估(r ≈ 0)时,未能定量捕捉这些突变的影响。83 同样,OmniESI通过将β-内酰胺酶中的单突变和双突变分类为有益或有害,定性地展示了其模型对突变体的强力,对多种底物的准确率达到>85%。90 EITLEM-Kinetics在大多数突变体中表现出一致的预测表现,且在kcat数据集上,最多六个突变可实现R² = 0.85。它还在突变体上实现了R² = 0.66的检测结果,且KCAT数量增加了十倍以上。该模型在预测突变效应方面的高效能,可归因于EITLEM-Kinetics中每个氨基酸的特征是单独表示,而非通过特征池整体呈现。这加上所使用的注意力网络,使模型对突变更为敏感,能够捕捉酶特异性残基效应和更广泛的序列-底物相互作用

酶工程与挖掘

工程化具有特定生化反应活性增强的突变酶 ,是蛋白质工程和合成生物学领域中一个关键且典型的目标。然而,识别有效的进化路径需要对反应机制的卓越理解,以便在生物和物理约束下(如蛋白质折叠和表达)导航序列空间。同样,采用实验室导向进化既昂贵又耗时且劳动密集,且往往只取得有限的成功。例如,通过构建和筛选4800个突变体,从谷氨酸杜丝虫定向进化出酪氨酸氨裂解酶(TAL)文库,最终鉴定出一个kcat为142 s−1的变异株,仅比野生型的114 s−1.126略有提升。为解决实验方法的有限成功, 通过BLAST搜索识别出野生型序列的前1000个同源物,并利用UniKP预测其在计算机模拟酶开采中的kcat值。前五个预测经过实验验证,其中两条序列的kcat值超过了野生型kcat值的约4倍。同时,UniKP被用于预测来自R. glutinis的所有可能单点变体的kcat/Km值,用于计算机合成酶的演化。最终,作者鉴定并实验描述了两种突变体,其效率高出野生型的3.5倍。这表明UniKP获得了关于酶的深层信息,因为TAL突变体库中的序列与训练序列有<35%的相同性。同样,KcatNet也被用于α-葡萄糖苷酶的计算机演化,筛选了所有可能的单点突变体,最高结果显示kcat比野生型提升了47%。最后,CataPro被用于酶挖掘更高效的类胡萝卜素切割加氧酶。作者从Caulobacter segnis的类胡萝卜素断裂加氧酶(CSO2)出发,利用BLAST鉴定出1500个同源物。实验验证证实,CataPro预测中最成功的Sphingobium sp. CSO(SsCSO)活性是CSO2的19.53倍。此外,使用CataPro对SsCSO进行了两轮计算机导向进化,发现了一个双点突变体,其活性比CSO2.83提升了65倍。然而,需要注意的是,这些模型更可靠地识别相对趋势,比如哪些突变体更可能活跃。 而不是用来预测突变效应的精确大小。

虽然这些机器学习模型在预测酶突变体的动力学参数方面表现出潜力,但它们并非专门设计用来提示增强酶活性的突变。Yu及其同事(2024)通过构建扩散模型解决了这一局限,该模型提出多种氨基酸替代以优化活性。6他们将该目标表述为一个反折叠任务,结合了一个以回归子为导向的扩散模型,称为kcatDiffuser。换句话说,kcat扩散器生成若干酶序列与给定主链结构相容,同时通过有利于提高Kcat值的氨基酸组合的采样过程引导。它在15603个BRENDA蛋白结构和CATH128数据库条目上训练,使用ESMFold.。kcat扩散器表现优于其他扩散模型,如ProteinMPNN, PiFold和GraDe-IF,产生突变体,log kcat整体提升0.21。例如,kcatDiffuser将undecaprenyl焦磷酸合成酶活性的log kcat提升了0.486,而上述模型在执行相同任务时产生的活性突变体较少。生成的结构与原始酶结构高度匹配,凸显了kcatDiffuser在增强kcat且不损害结构完整性方面的优势。

尽管取得了这些成功,大多数模型显示对训练集中代表性不足的酶家族的插值有限。例如,当被要求预测260种β-葡萄糖苷酶的kcat/Km时,UniKP仅对所有酶序列预测相同值(R2 = 0.05),而EITLEM-Kinetics和CataPro分别获得了0.19和0.27的R2值。132 同样,当DLKcat被要求预测175种腺苷酸激酶的kcat值时,其Spearman系数为−0.09.133。这些结果远低于模型各自测试集报告的性能, 而这种不准确的模型会极大阻碍酶开采和进化的序列探索,尤其是在针对特定催化功能时。因此,需要更现实的指标来评估机器学习模型是否有效支持酶筛选。字面理解,回归指标如R2和RMSE可能导致变异的错误排名,或未能识别出真正的顶尖表现者。对于酶挖掘或突变扫描等应用,评估序列空间中表现最佳区域富集的指标,如富集因子(EF)、precision@k和recall@k,提供了更可作的评估,尽管它们主要用于评估功能适应度,而非预测动力学参数。值得注意的是,高R2的模型可能表现出较差的排名准确度或富集性,使其在酶工程工作流程中效果较差。这在UniKP等模型中尤为明显,酶挖掘和进化各仅带来kcat/Km.85的<3倍)提升

最后,在当前机器学习模型中,无法在特定温度下演化出增强催化活性的酶,实验方法需要及时且繁重的表征步骤。最近,Erkanli及其同事(2025年)引入了一个三模块机器学习框架,预测β-葡萄糖苷酶的最佳温度、kcat/Km和活性-温度曲线。132 通过整合内在序列信息和外在温度效应,该框架提供了穿越序列-温度-活性景观的强大工具。展望未来,类似模型有潜力通过引导在庞大的序列和温度空间中同步搜索,加速酶的进化,发现在所需反应条件下工作的新型功能突变体。

基因组级代谢建模

基因组级代谢模型(GEMs)是通过注释基因组序列重建的生物体内完整代谢反应的数学表示。它们在模拟不同环境条件、指导代谢工程工作以及蛋白质组分配研究下的代谢通量方面具有优势通常,GEMs基于基于反应网络和质量平衡原理的化学计量约束,利用通量平衡分析等方法估算可行反应通量 。然而,其准确性受限于一个关键假设:**酶被视为无限快的催化剂,或酶存在过量。**为此,酶约束基因组尺度代谢模型(ecGEMs)整合酶容量约束,最常见的是通过kcat值和酶丰度,从而将最大可达通量与催化代谢反应酶的催化效率联系起来。尽管前景看好,ecGEMs仍受动力学数据不完整或噪声较大的阻碍,因为许多酶缺乏实验测量的kcat值。此外, 可用数据通常来自不同的生物体、检测条件和底物,增加了额外的不确定性。虽然ecGEMs已为多种研究充分的生物(如大肠杆菌)开发,但只有10%的酶促反应在BRENDA中kcat值完全匹配。此外,体外实验中对kcat值的体内估计较为困难,尤其是由于其非相关关系。在没有此类数据的情况下,ecGEM通常采用相似底物的动力学参数值, 反应或生物体,使这些模型偏离实验观察。

缓解ecGEM构建动力学数据瓶颈的一种方法是利用上述机器学习模型的预测kcat,以扩大基因组规模重建的覆盖范围。Heckmann及其同事(2018)开发的模型旨在参数化大肠杆菌的GEMs,iML1515.39将机器学习导出的kcat值整合进来,而非从现有数据集中推算的中间数据,带来了显著改进(即其模型的RMSE降低了34%)39。该方法的一个局限是ML预测的kcat值来自体外而非体内条件下。同样,DLKcat 是基于体外数据训练的,这意味着模型也能预测体外值。67 DLKcat 被用于重建343种酵母/真菌物种的ecGEMs,预测约三百万酶-底物对的kcat值。为解决体外预测与体内值之间的差异并确保预测的生物学相关性,作者采用了贝叶斯基因组尺度建模方法,其中DLKcat预测作为均值,模型的RMSE作为先前kcat分布的方差。然后,这些值基于实验测量的表型数据集迭代更新,生成后验分布,捕捉kcat预测中的不确定性。总体而言,基于DLKcat的ecGEM的RMSE比原始ecGCM低30%。67 KcatNet的作者使用其模型参数化了相同的ecGEM,并在4种不同酵母种类的22种碳源和氧气条件下降低了原模型的RMSE方面优于DLKcat。

同时,DLTKcat被用来演示机器学习模型如何用于温度敏感的代谢建模。8作者证明,DLTKcat预测乳酸菌MG1363在温度升高时分解代谢活性会下降,这与实验观察结果一致。此外,它还捕捉到了温度升高时,热链球菌酶kcat值的增加. 然而,在定量估计生长速率时,模型的准确性极低,很可能是由于误差传播所致。除了稳态ecGEMs外,动态动力学模型还受完整的酶速率定律支配,直接依赖所有动力学参数和平衡常数。这些模型能够对代谢物动力学和瞬态行为进行时间解析模拟,这些模拟在稳态假设下无法捕捉。由于数据稀缺,动力学模型一直局限于较小的子系统,但近年来的进展已产生了近基因组级动力学重建,整合了组学数据、热力学约束和参数估计框架,推断出大量动力学常数。著名例子包括大肠杆菌代谢的大规模动力学模型,1 酿酒珠菌代谢模型,甚至人类癌症。这些动力学模型展示了大规模参数化常微分方程系统的日益可行性,并凸显了机器学习预测的kcat、Km和Ki在实现基因组级动态模拟中可能发挥越来越核心的作用。

为了展示机器学习模型如何填补动力学模型中缺失的Km值,Kroll及其同事(2021)利用他们的模型预测了与47种GEMs相关的酶的Km,这些酶涵盖大肠杆菌、酿酒酵母、M.musculus和H. sapiens。虽然这些生物属于不同的生物领域,但它们的训练数据主要由细菌数据占据主导。因此,他们按域划分测试集,展示了模型在不同领域中同样能做出Km预测,古菌、细菌和真核生物分别实现了R2值0.37、0.51和0.56。最后,MLAGO负责参数化碳和氮代谢模型,因为反应对应的Km值未包含在训练集中。虽然Km预测准确度较高(碳和氮代谢的RMSE分别为0.62和0.73),但基于机器学习的代谢模型未能充分拟合实验代谢数据。当这些Km预测作为MLAGO方法的参考时,所得代谢模型很好地拟合了实验数据,同时仍保持了Km预测的合理准确性(碳和氮代谢的RMSE分别为0.79和0.57)。

局部模型

局限性与未来方向

有限数据的困境

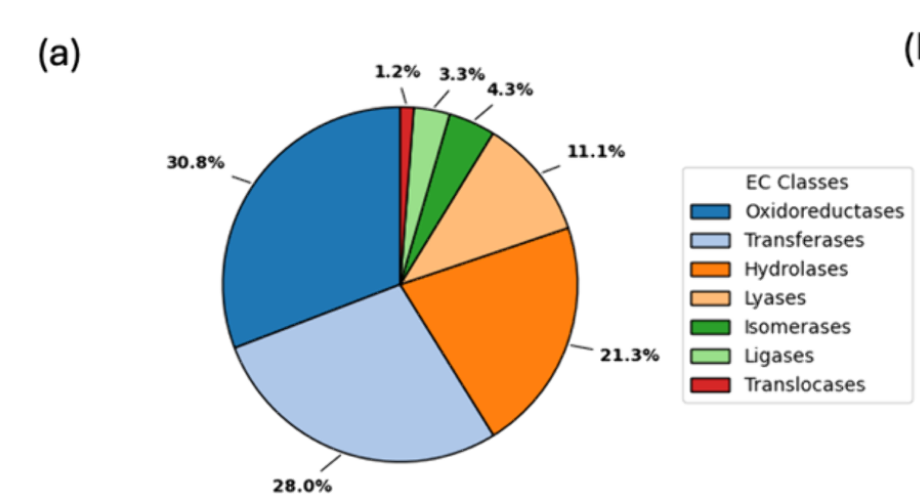

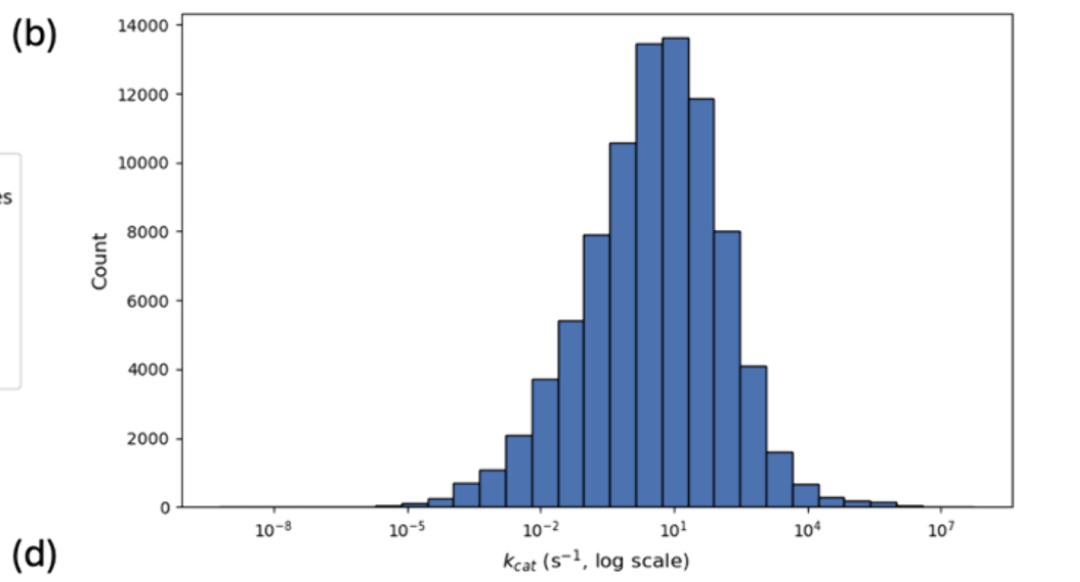

尽管现有数据库价值巨大,但酶类动力学测量的稀疏性和分布不均仍 是主要挑战,这一点从我们对BRENDA的分析中可见一斑(见图4)。大多数已鉴定的kcat和Km值属于一小部分水解酶、氧化还原酶和转移酶 ,针对其天然底物(见图4a)。因此,大多数机器学习模型在插值这些家族方面表现良好,但在推广到代表性不足的酶家族和非天然底物方面却难以实现。此外,从已发表文献收集动力学数据集的主要问题是对中间值参数的固有偏向,使得低效或极高效酶的参数稀缺 (见图4b)。这不可避免地影响了机器学习模型推广到极端情况的能力。为解决此问题,可以通过高通量系统(如生物铸造)和微流控平台自动化检测,获得大量均匀分布的高质量数据。生物铸造厂提供了一个自主驱动的实验室,代理设计酶并将其部署到特征单元中进行合成、表达和动力学测量。随后,代理的序列-活性关系通过学习周期更新,直到收敛到满足查询要求的酶。微流控平台可以通过微型化和复用反应来补充这一努力,实现数千种酶-底物组合的动力学参数并行测量。这些方法共同有潜力以最小的实验室差异生成大量高质量动力学数据,涵盖研究充分和代表性不足的酶类,从而促进机器学习模型的性能和泛化。这些自动化方法还为动力学建模的实用闭环设计-构建-测试-学习(DBTL)循环提供了切实可行的路径。机器学习模型可用于提出预测改善动力学参数的候选序列、突变或酶-底物对 。设计输出随后通过自动应变构建或无细胞合成平台执行,并可通过微流控分析或生物晶体厂进行表征。自主驱动实验室实施的主动学习策略优先考虑降低目标区域不确定性并加速趋同于高性能变体的实验,这些变体可用于重新训练和微调原始机器学习预测变量。 为了使这些循环对动力学参数学习保持可靠性,需要多项工程考虑,如严格的不确定性定量、40个标准化检测元数据以控制环境条件、77个校准步骤以协调无细胞和体外测量与体内行为、以及有效的停止标准以避免对检测伪影的过度拟合。

混合模型的需求

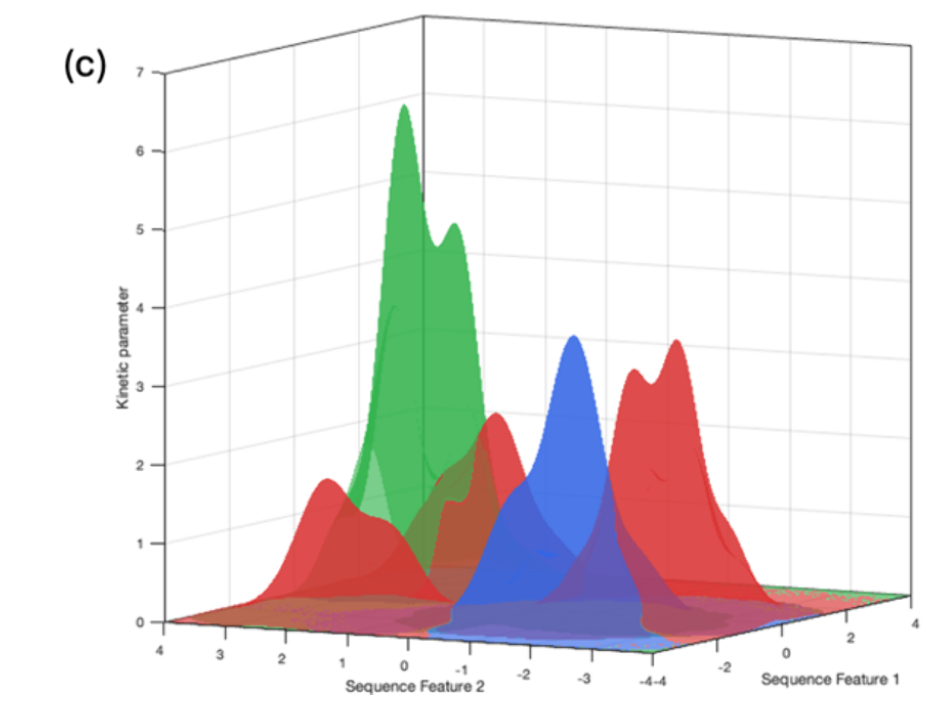

综合此处回顾的所有模型,显然大多数机器学习方法探索的是序列空间的局部或全局视角 (图4c)。这一区别反映了搜索范围:全局模型旨在覆盖广泛且多样化的酶家族和类别,而局部模型则仅关注特定家族。在不同酶家族上训练的全局模型能够泛化到广泛的序列区域。然而,在预测与训练数据高度不同的序列参数时,它们常常存在较低的准确性 。相反,在野生类型或突变体高质量数据集上训练的局部模型可以捕捉细微差别的序列-功能或结构-功能关系。然而,它们的预测能力仅限于序列空间的狭窄区域。这体现在第4和第6节模型性能差异中,体现了精度与范围之间的权衡。因此,一个有前景的方向是开发混合模型,利用全球蛋白质语言模型对序列空间进行广泛的上下文描绘,同时对家族特异性动力学数据集进行微调以保留局部信息。

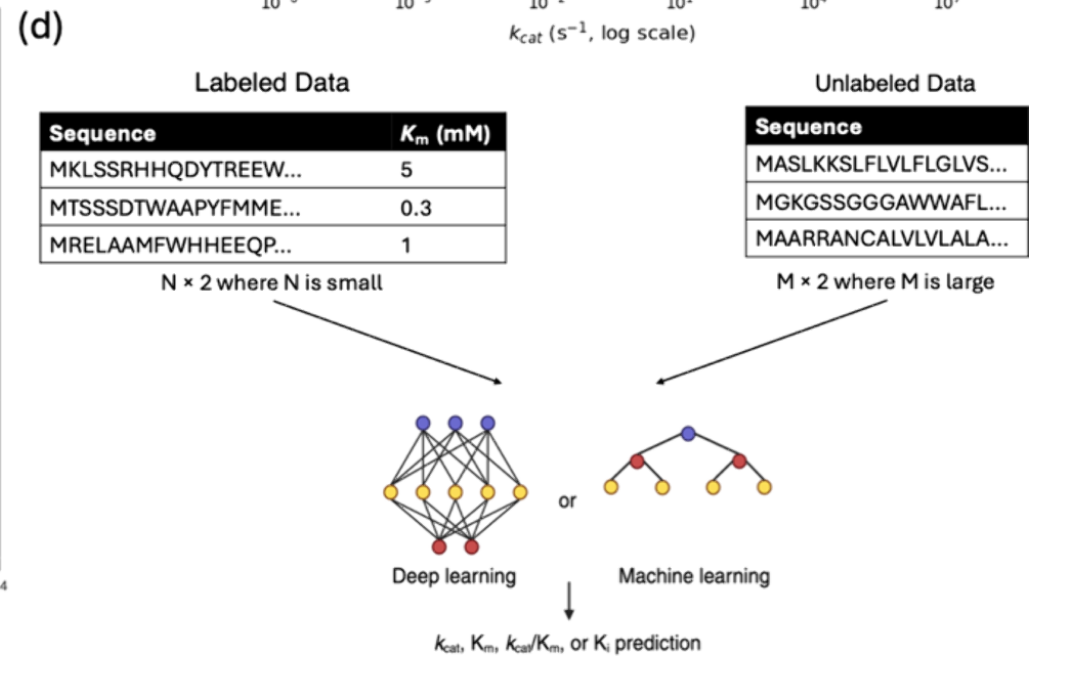

利用半监督式学习

当前用于动力学参数预测的机器学习模型几乎完全依赖监督学习,这需要大量带标签的数据进行训练。鉴于上述局限性,**半监督学习通过利用有限的带标记动力学数据和数据库中大量未标记的酶序列(如UniProt59,见图4d)提供了有前景的替代方案。**通过利用序列空间中的功能模式和有限的标记实例,半监督框架可以扩展模型的适用性,提高对数据稀缺性的鲁棒性。

结合基于物理的机器学习

另一种有前景的酶动力学预测方法是基于物理的ML。与本综述中讨论的纯数据驱动方法不同,基于物理的机器学习将生物物理约束嵌入学习过程,确保预测与酶催化原理保持一致。例如,活化自由能与kcat之间的关系可以在模型训练中作为约束纳入。这可以通过使用惩罚项对神经网络进行正则化,强制其与过渡态理论保持一致,要求kcat预测落在可行的激活能量范围内。 此外,将DL模型与量子力学/分子力学(QM/MM)描述符结合,有助于捕捉控制酶动力学的分子机制。

**除了基于回归的预测模型外,最近出现了明确纳入生物物理约束的生成框架,以确保预测动力学参数的机制合理性。**在2022年的工作中,Choudhury及其同事引入了一种条件生成对抗网络,结合生物物理和物理化学约束,创建满足热力学要求、稳定性约束和实验观测时间尺度极限的生物相关动力学模型。 他们2024年的工作将化学计量、调控信息、通量分析和动态时间尺度约束整合进生成过程,实现估计缺乏动力学参数。总体而言,这些模型为下一代机器学习方法提供了蓝图,将统计学习与酶工程基础相结合。