在数字化浪潮席卷全球的今天,文档处理已成为个人与企业日常工作中的重要环节。从扫描版论文到业务合同,从发票账单到产品手册,我们每天需要与大量非结构化文档打交道。然而,传统OCR技术往往只能做到"识别文字",却难以理解文档的内在结构与逻辑顺序。这种局限性导致我们经常需要手动整理识别结果,大大削弱了OCR工具的实际价值。

DeepSeek-OCR 2的发布,标志着OCR技术从"机械扫描"向"逻辑阅读"的重要跃进。这款由DeepSeek团队打造的新型OCR模型,通过引入融合"视觉因果流"机制的 DeepEncoder V2 架构,让AI能够像人类一样理解文档的阅读逻辑,而非简单地从左到右逐行扫描。本文将深入解析这项技术的创新点,并提供实用的部署与使用建议,帮助读者在实际场景中充分释放其价值。

一、OCR技术发展:从1.0到2.0的范式转变

要理解DeepSeek-OCR 2的技术突破,我们首先需要回顾OCR技术的发展历程。

传统OCR(OCR 1.0)主要由两个独立模块组成:文字检测与文字识别,通常基于CNN+LSTM结构。这类系统的优势在于识别准确率高、字体鲁棒性强、多语言支持完善,但缺点同样明显------它们只能识别文字,无法理解文字在页面中的位置关系和逻辑顺序。例如,一张包含表格和图片的文档,传统OCR只能将文字按从左到右、从上到下的顺序输出,无法正确反映表格的行列关系或图片与文字的对应关系。

而DeepSeek-OCR 2作为OCR 2.0的代表作,采用了全新的技术路线。它不再将OCR视为纯粹的文字识别任务,而是将其视为文档理解与信息提取的综合问题。这一范式转变使得模型不仅能"看到"文字,更能"理解"文字之间的关系,从而提供结构化的识别结果。

具体来说,DeepSeek-OCR 2在OmniDocBench v1.5基准测试中取得了91.09%的成绩,较前代提升了3.73%。特别是在阅读顺序准确度方面,编辑距离从0.085降至0.057,表明新模型能够更合理地理解文档内容结构。这种提升看似数字不大,但实际应用中却能带来显著的效率改善。

二、DeepEncoder V2架构:让AI学会"阅读"而非"扫描"

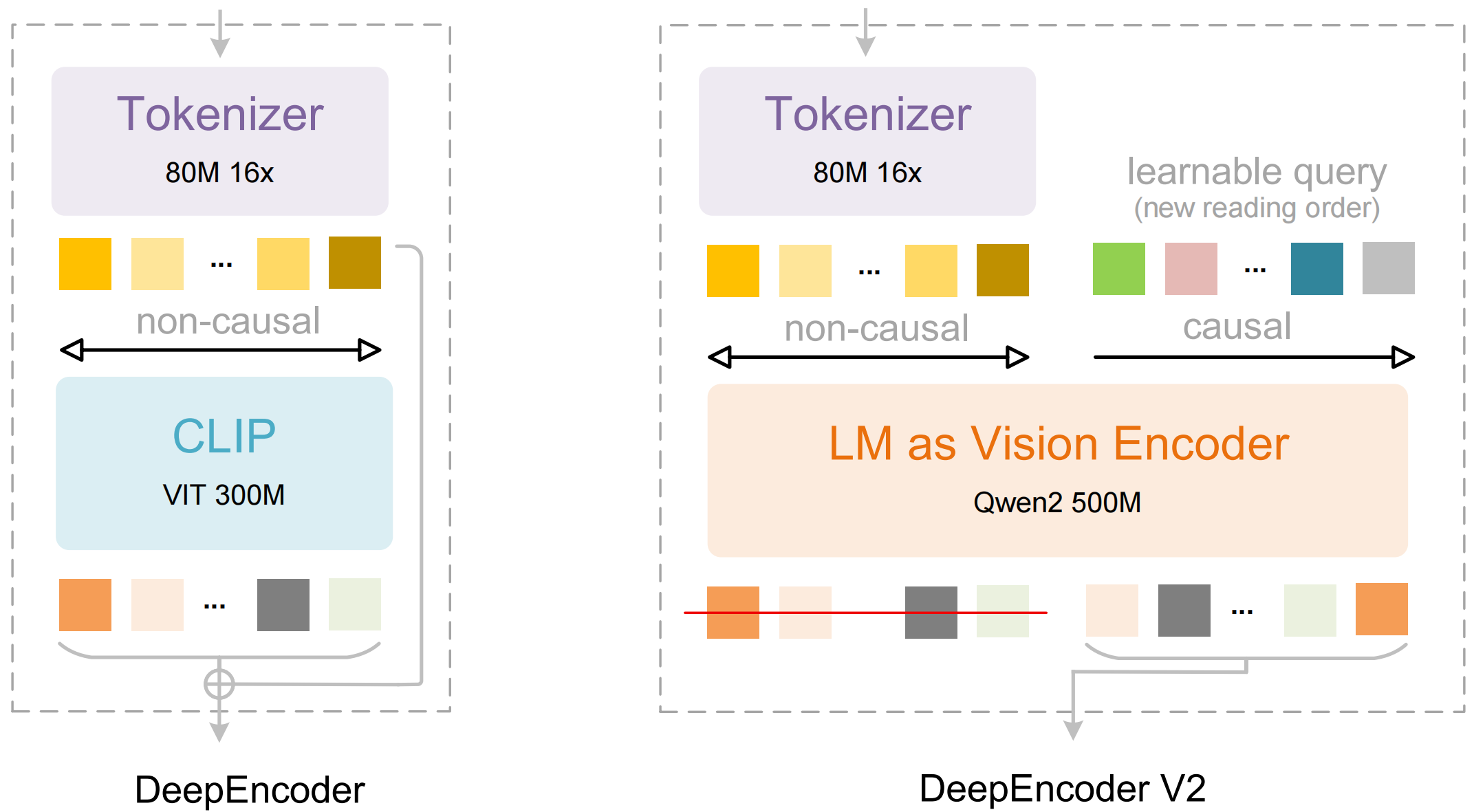

DeepSeek-OCR 2的核心创新在于其DeepEncoder V2架构,特别是其中的"视觉因果流"技术。要理解这项技术,我们可以先了解传统OCR模型的处理方式。

传统OCR模型处理图像时,通常采用光栅扫描顺序(raster-scan order),即将图像从左上角到右下角逐行切分为固定尺寸的Patch,然后按顺序送入模型处理。这种方法类似于我们阅读报纸时从左到右、从上到下逐字逐句阅读,但在面对复杂文档时,这种机械式处理方式存在明显缺陷:

- 多栏文档中,无法正确识别栏间切换点

- 表格中,难以正确理解行列关系

- 公式混排时,无法捕捉数学符号间的逻辑关联

- 图表说明与图表本身的位置关系难以准确表达

相比之下,DeepSeek-OCR 2的DeepEncoder V2架构采用了一种更智能的方式处理图像信息。我们可以将其理解为**"视觉压缩+动态重排"的两阶段处理流程**:

-

视觉压缩阶段:模型将整张图像压缩为少量"视觉词元"(visual tokens),每个视觉词元代表图像中一个语义单元。根据实测,对于一张书页或报告截图,仅需约100个视觉词元就能保持高精度识别。

-

动态重排阶段 :这是DeepSeek-OCR 2最核心的创新点。模型引入了可学习的"因果流查询token",这些查询token通过定制化的注意力机制,在保留视觉token全局双向注意力的同时,自身采用因果注意力,只能访问已有信息。这种机制使模型能够根据文档内容的逻辑关系,动态调整视觉token的处理顺序,而非机械地按照固定栅格扫描。

我们可以用一个生活化的比喻来理解这一过程:想象你正在阅读一份包含图表和表格的报告。传统OCR就像一个只会按页码顺序逐页阅读、按行号逐行理解的机器人,不管内容如何复杂,都只会按部就班地处理。而DeepSeek-OCR 2则像一个有经验的研究者,它会先快速浏览整份报告,识别出标题、摘要、图表说明等关键部分,然后根据这些信息构建出一个"阅读路线图",再按照这个逻辑顺序详细理解每个部分的内容。

这种动态重排机制使得模型能够更好地处理复杂文档,例如:

- 多栏文档:模型能够识别栏间切换点,而非简单地按行号从左到右处理

- 表格文档:模型能理解行列关系,而非将表格内容按从左到右、从上到下的顺序简单拼接

- 公式混排文档:模型能捕捉数学符号间的逻辑关联,而非将其视为孤立的字符

三、实际应用场景:从学术研究到企业办公

DeepSeek-OCR 2的技术突破不仅停留在理论层面,更在实际应用中展现出显著价值。以下是几个典型应用场景的实测效果:

- 学术研究场景:论文解析效率提升

对于学术研究人员,DeepSeek-OCR 2能够将复杂的学术论文(包含公式、图表、表格)转换为可编辑的Markdown格式,大大简化文献综述和知识整理工作。

实测案例:使用DeepSeek-OCR 2处理一篇包含45个公式的62页Nature论文。传统OCR工具的公式识别率仅为76.3%,且格式混乱,需要逐个公式进行修正。而DeepSeek-OCR 2的识别率达到92.1%,生成的LaTeX代码可直接用于论文写作,无需人工干预,大幅提高了研究效率。

- 企业文档管理场景:合同质检与发票处理

在企业环境中,DeepSeek-OCR 2可以大幅提升文档处理效率,实现合同、发票、报告等各类文档的自动化处理。

- 个人办公场景:手机端实时文档处理

DeepSeek-OCR 2的轻量化设计使其非常适合移动端使用。例如:

-

展会资料收集:在展会现场用手机拍摄展商资料照片,通过预配置的DeepSeek-OCR 2网页服务上传,几秒钟后即可返回结构化文本,包含标题、正文、价格表等内容,可直接复制粘贴到备忘录或分享给同事。

-

会议记录整理:使用手机拍摄白板或投影内容照片,DeepSeek-OCR 2能够识别并理解文字的布局与逻辑关系,自动将会议要点按结构化格式输出,方便后续整理和分享。

-

多语言文档处理:DeepSeek-OCR 2支持72种语言(包括中、英、日、韩、荷兰语、越南文等),在处理多语言混合文档时表现出色。例如,一份包含中文说明和英文技术参数的产品手册,模型能够准确识别并区分不同语言内容,按逻辑顺序输出。

四、总结与展望

DeepSeek-OCR 2的发布,标志着OCR技术从"机械扫描"向"逻辑阅读"的重要跨越。通过DeepEncoder V2架构和"视觉因果流"技术,模型能够像人类一样根据文档内容的逻辑关系动态调整视觉token的处理顺序,而非简单地按照固定栅格扫描。

从部署角度看,DeepSeek-OCR 2提供了从云端API到本地Docker镜像的多种方案,最低仅需512×512像素的输入图像,推荐使用消费级显卡(如RTX 3090/4090)即可流畅运行,无需高端专业GPU。这种轻量化设计使其能够广泛应用于各种场景,包括边缘设备和资源有限的环境。

DeepSeek-OCR 2的发布不仅是OCR性能的升级,更具有深远的架构探索意义。DeepEncoder V2初步验证了使用语言模型架构作为视觉编码器的潜力,这种架构自然继承了大规模语言模型社区在基础设施优化方面的成果,如混合专家(MoE)架构和高效注意力机制。

展望未来,随着DeepSeek-OCR 2技术的不断成熟和应用场景的不断扩展,我们有理由相信,OCR技术将从单纯的"文字识别"工具,逐步发展为能够真正理解文档内容、支持多模态信息处理的智能系统,为各行业数字化转型提供更加强大的支持。