一、MySQL的安装与配置

换源:

最下面附加部分

1、在master上直接使用yum命令在线安装MySQL数据库:

sudo yum install mysql-server途中会询问是否继续,输入Y并按回车。

2、启动MySQL服务:

sudo service mysqld start3、设置MySQL的root用户密码:

MySQL安装完成后,默认root用户是没有密码的,需要先登录并设置其密码:

mysql -u root -p不用输密码直接回车,登录进去以后执行以下命令设置root用户密码:(标红的才是命令,蓝色的123456则是要设置的密码,你可以按需更改)

mysql>set password for root@localhost=password('123456');尝试quit退出并重新使用root用户登录MySQL,

如果成功输入密码登录,就说明密码设置成功。

二、Hive的安装与配置

1、先把hive安装包apache-hive-2.3.7-bin.tar.gz发送到master的主目录上,然后在master上解压该安装包:

cd ~

tar -zxvf apache-hive-2.3.7-bin.tar.gz2、由于解压出来的文件夹名字比较长,可以将其改名为hive,或者自行创建软连接也可:

mv ~/apache-hive-2.3.7-bin ~/hive3、复制hive配置文件:

hive的配置文件是hive-site.xml,该文件位于hive安装路径下的conf文件夹中。但一开始该配置文件并不存在,直接使用vim新建一个配置文件即可:

cd ~/hive/conf

vim hive-site.xml配置文件内容如下:

<configuration>

<property>

<name>hive.exec.local.scratchdir</name>

<value>/home/hadoop/hive/iotmp</value>

</property>

<property>

<name>hive.downloaded.resources.dir</name>

<value>/home/hadoop/hive/iotmp</value>

</property>

<property>

<name>hive.querylog.location</name>

<value>/home/hadoop/hive/iotmp</value>

</property>

#指定连接驱动为MySQL的jdbc

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

#配置连接MySQL的URL

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost/hive?createDatabaseIfNotExist=true</value>

</property>

#配置登录MySQL的用户名

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

#配置登录MySQL的密码

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>123456</value>

</property>

</configuration>6、配置环境变量

在.bashrc文件中添加内容。先执行以下命令打开.bashrc文件:

vim ~/.bashrc在文件末尾加上以下语句:

export HIVE_HOME=/home/hadoop/hive

export PATH=$HIVE_HOME/bin:$PATH添加完成后保存,然后控制台执行以下命令刷新即可:

source ~/.bashrc7、添加MySQL驱动包

将mysql-connector-java-5.1.38.jar驱动包上传到master主机上,并把它放到hive安装目录下的lib文件夹内即可:

mv ~/mysql-connector-java-5.1.38.jar ~/hive/lib/三、Hive的初始化

第一次启动Hive需要先进行初始化,后续再次启动则不用。具体操作命令如下:

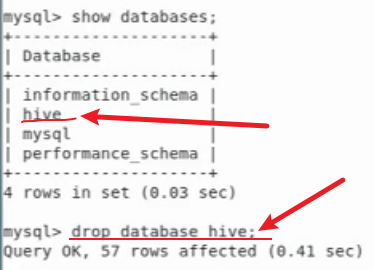

schematool -dbType mysql -initSchema如果初始化不成功,第二次,第三次的时候要提前删除在mysql的hive数据库,如图所示:

四、Hive的启动

启动Hive时,必须保证Hadoop集群已经正确启动。

Hadoop启动后,使用以下命令打开Hive的CLI:

hive

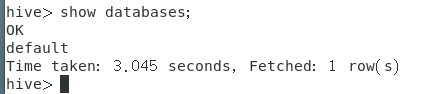

hive>show databases;如果上述操作没问题,则hive客户端已经安装成功。

如图:

附加:yum仓库换源

如果你的CentOS系统yum命令无法访问默认仓库地址,则可以按照这里的操作步骤进行换源。这里把yum仓库更换为阿里源,以便于国内进行访问。

输入以下命令,使用vim编辑器修改yum配置:

sudo vim /etc/yum.repos.d/CentOS-Base.repo然后把里面的内容修改为以下:

[base]

name=CentOS-$releasever - Base

baseurl=http://mirrors.aliyun.com/centos/$releasever/os/$basearch/

gpgcheck=1

gpgkey=http://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7

#released updates

[updates]

name=CentOS-$releasever - Updates

baseurl=http://mirrors.aliyun.com/centos/$releasever/updates/$basearch/

gpgcheck=1

gpgkey=http://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7

#additional packages that may be useful

[extras]

name=CentOS-$releasever - Extras

baseurl=http://mirrors.aliyun.com/centos/$releasever/extras/$basearch/

gpgcheck=1

gpgkey=http://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7

#additional packages that extend functionality of existing packages

[centosplus]

name=CentOS-$releasever - Plus

baseurl=http://mirrors.aliyun.com/centos/$releasever/centosplus/$basearch/

gpgcheck=1

gpgkey=http://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7

enabled=0修改完成后保存关闭,执行以下命令清理yum的缓存并更新软件包索引:

sudo yum clean all

sudo yum makecache

sudo wget http://repo.mysql.com/mysql-community-release-el7-5.noarch.rpm

sudo rpm -ivh mysql-community-release-el7-5.noarch.rpm

sudo yum update