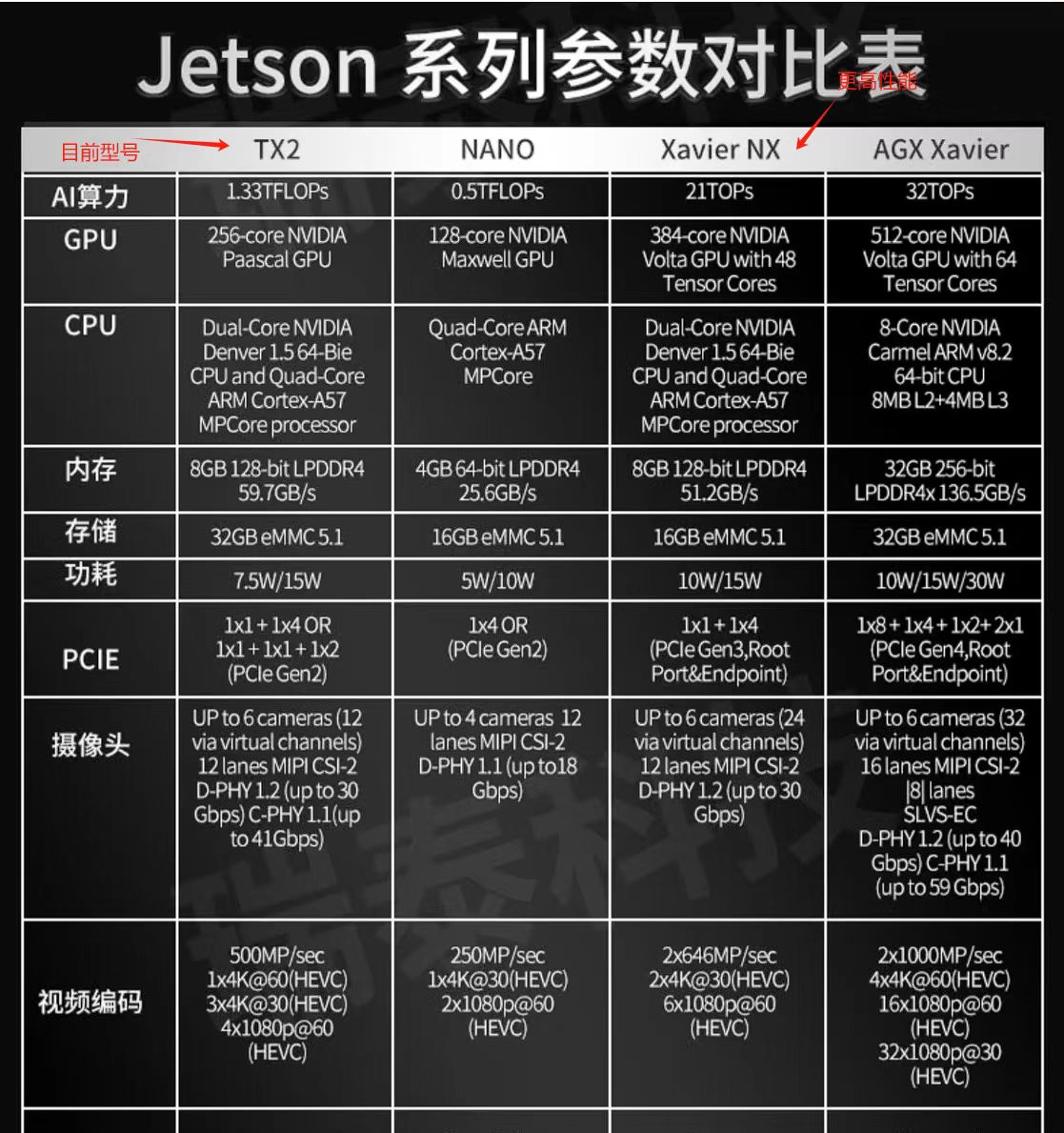

1.jetson系列各种型号简介:

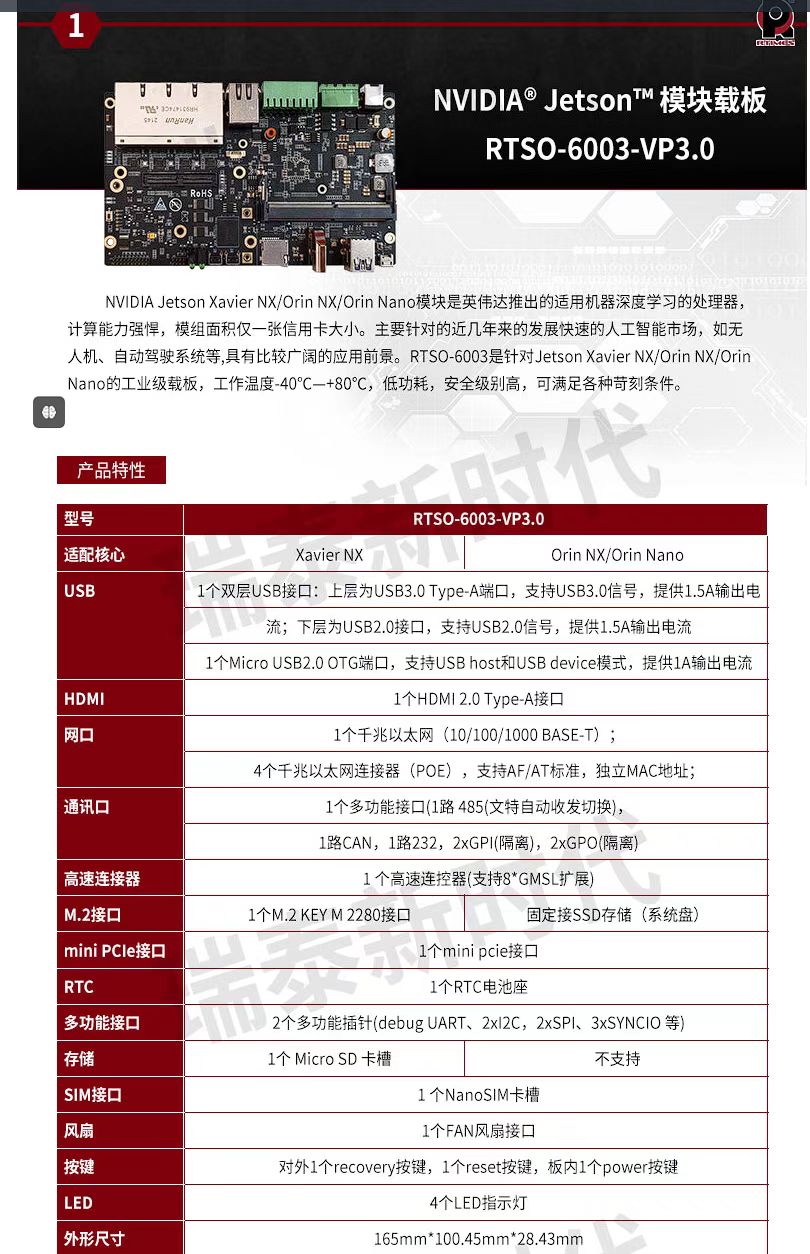

2.nvidia jetson模块载板:

3.cuda, cudnn,tensorrt二次开发包安装:

MIC-332 的BSP是基于Jetpack 5.1.2的,关于cuda, cudnn,tensorrt等二次开发包,是不默认放置到BSP中的,会造成发布的BSP体积较大,不适合上传下载。

安装命令:

sudo apt install -y cuda-11-4 libfreeimage-dev libcudnn8 libcudnn8-dev libcudnn8-samples tensorrt tensorrt-dev tensorrt-libs python3-libnvinfer python3-libnvinfer-dev uff-converter-tf onnx-graphsurgeon graphsurgeon-tf python3-pip