这个博客将学习如何构建一层神经网络,一单掌握了这一点,就可以将这些构建块组合起来,形成一个大型的神经额网络,让我们俩看看神经网络时=是如何工作的

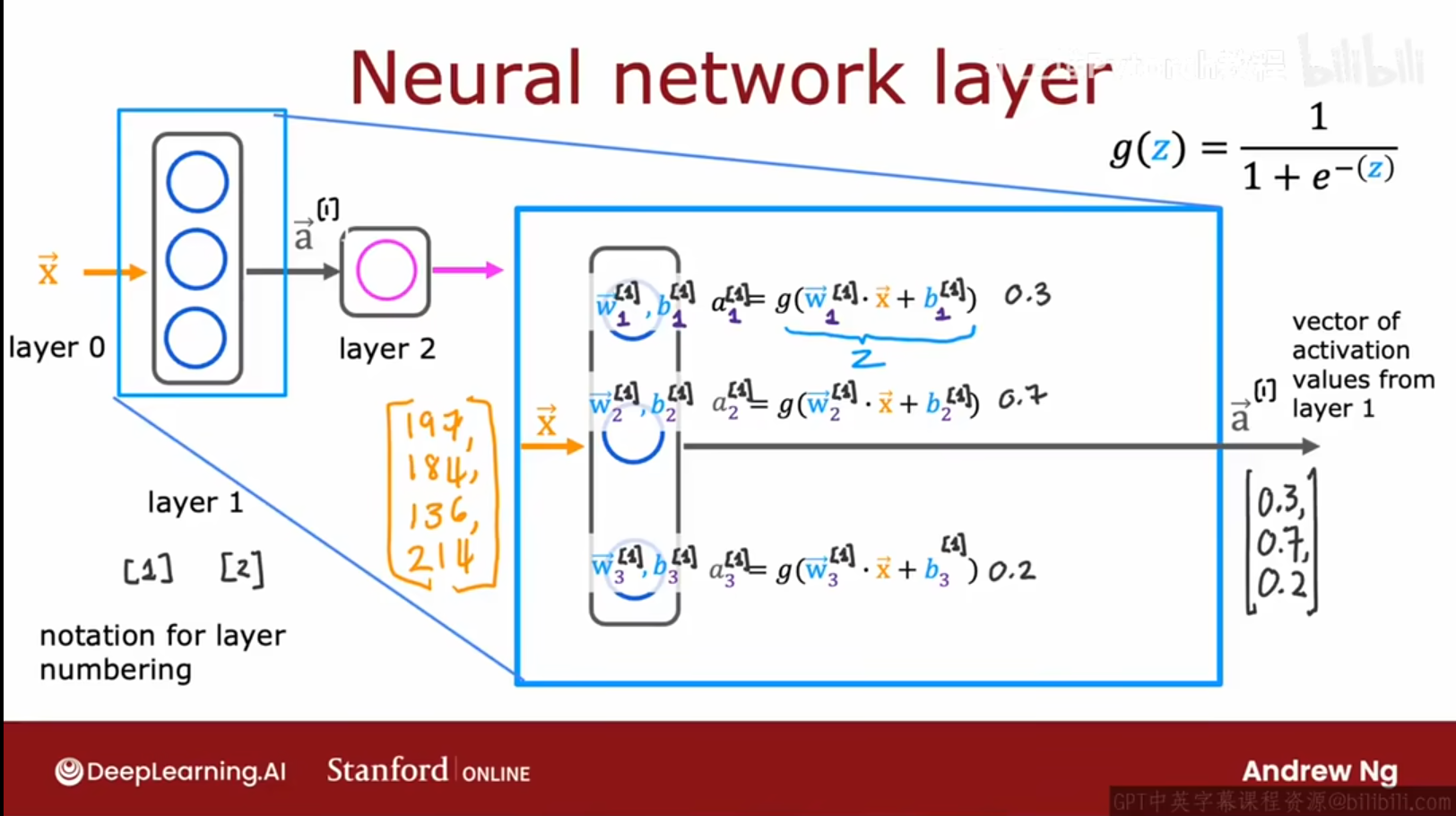

每一个神经单元就是实现了一个小小的逻辑回归单元,或者小小的逻辑回归函数,所以我们取第一个神经元为了表示这是第一个神经单元我们用W1,B1来表示这是第一个神经单元,同一层中的每个神经元的输出,组合成了一个向量,我们将这个向量作为输入,传入到第第二层中,以此类推,

为了区分参数是属于那一层的,我们在右上角用中括号\[\]表示神经网络的层数,如图所示,对一输出的向量 我么也在右上角加上中括号的数字,表示具体是哪一层输出的结果,构成的向量,

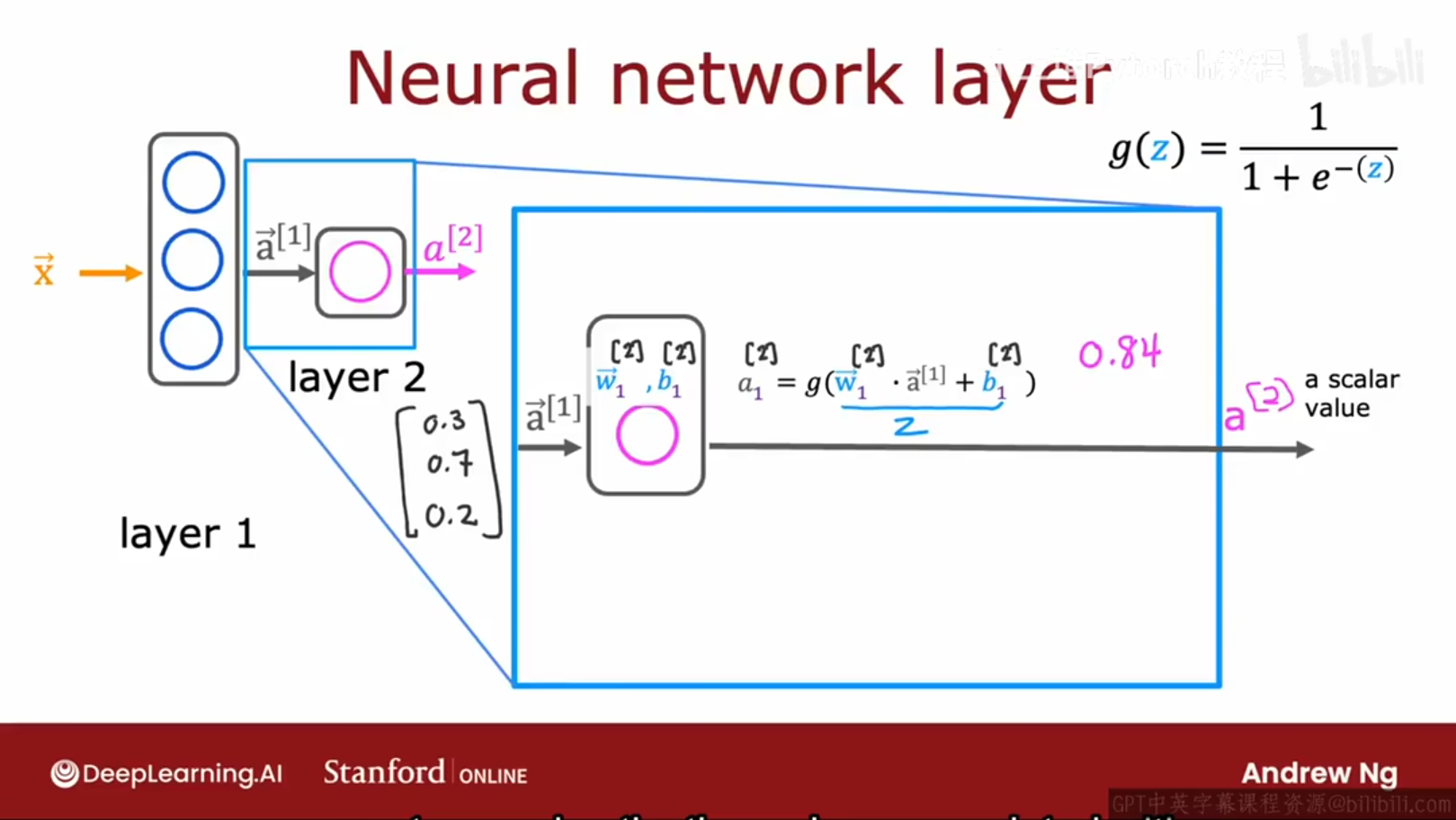

对于输出层,他的输入就是隐藏层的输出,输出的向量1

对于一个神经网络,有几十到上百层,一般第一层也叫输入成,中间的叫隐藏层,最后的叫输出层,隐藏层是处理的逻辑,

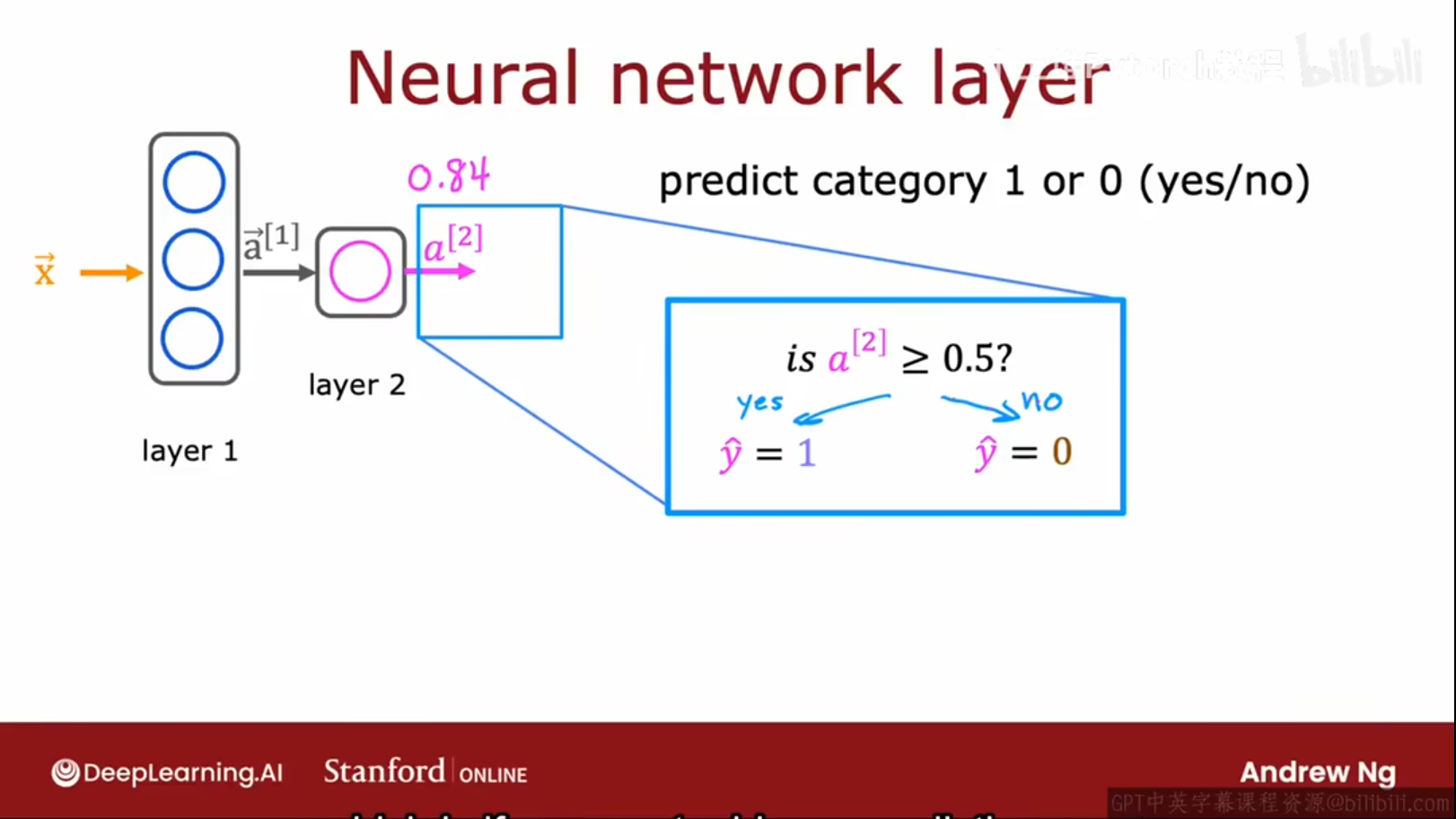

最后还有一个步骤,就是根据输出的概率,设定决策边界,然后进项二分类的输出,设定阈值,判断他到底是否是畅销品,

激活向量,是通过激活函数处理后的神经元输出向量,他会最为下一层的输入。在这里面,激活商量就是 向量a。

激活向量的维度,有这一层神经单元的数量决定,

在神经网络总每个神经元学习一个特征,通过反向传播和梯度下降神经元慢慢知道他要关注设么特征,有的神经元关注边缘,有的则关注局部,有段的关注整体,

在确定神经元要关注特征的过程中昂,用成本函数预测预测与真的得差距,,反向传播吧差距分配给每个神经元,调整他们的权重和偏置,其中w就是权重衡量重要性,B是偏置衡量整个加强和的基准值,然后使用梯度梯度下降更新梯度和偏置。