基于 YOLOv8 的多水果智能识别系统工程化实战 目标检测完整源码

引言:为什么"水果识别"值得单独做一个完整系统?

在很多计算机视觉教学或示例项目中,"水果识别"往往被当作一个简单的目标检测 Demo:跑个模型、画个框就结束了。但在真实应用场景中,水果识别远不止"识别出是什么"这么简单。

在 智能农业 中,它关系到果实成熟度统计、病虫害监测与产量评估; 在 智慧零售 中,它影响自助收银的识别准确率与结算效率; 在 分拣与物流场景 中,它又直接决定了自动化设备的执行准确性。

因此,一个真正可用的水果识别系统,必须同时满足:

- 算法精度稳定、速度足够快

- 支持多输入源(图片 / 视频 / 摄像头)

- 具备清晰、易用的人机交互界面

- 能够被"非算法人员"直接运行和部署

本文将从系统工程视角 出发,完整拆解一个基于 YOLOv8 + PyQt5 的多水果种类识别系统,覆盖从模型选择、数据组织、推理逻辑到桌面级应用封装的全过程。

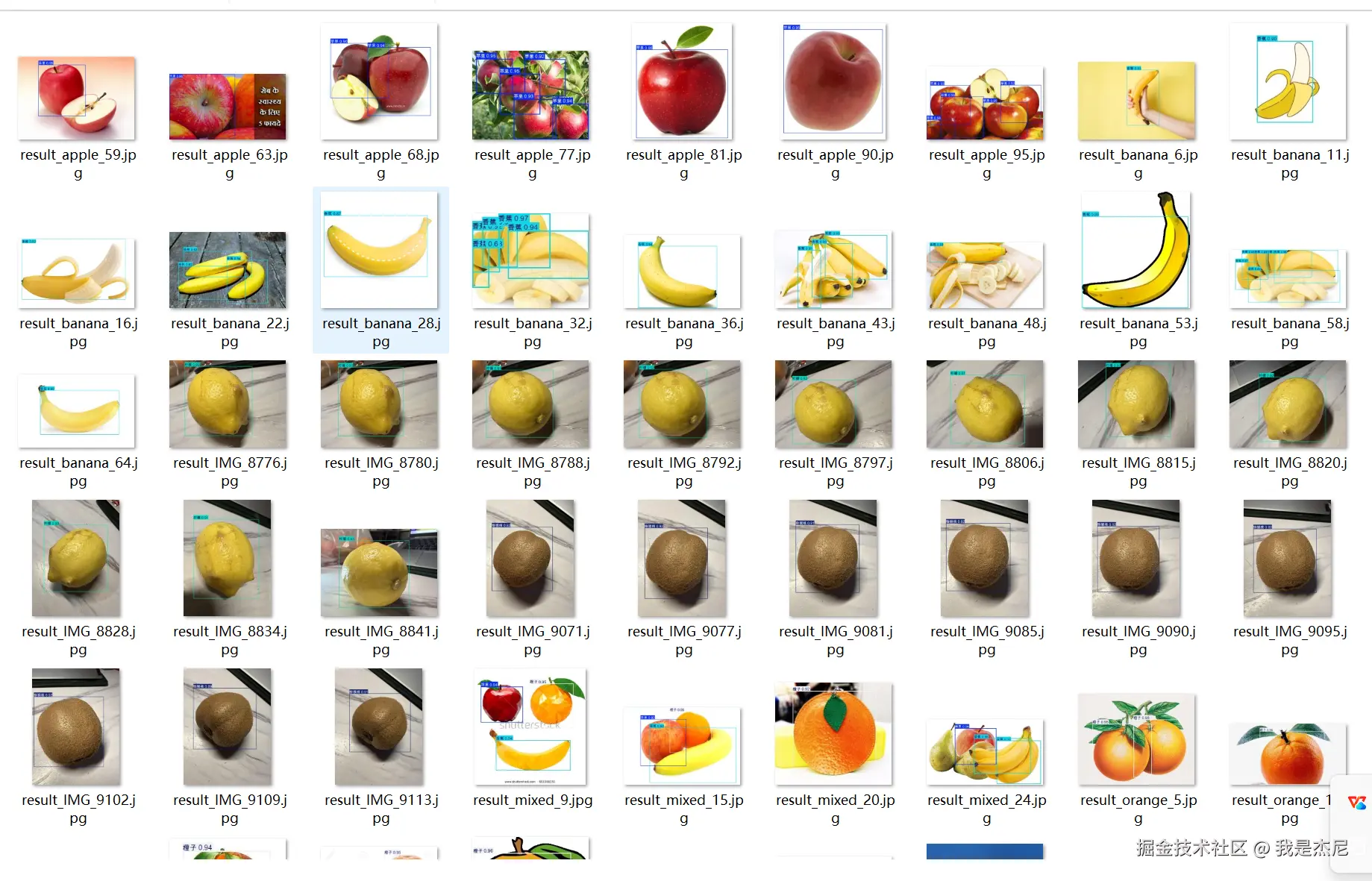

源码下载与效果演示

哔哩哔哩视频下方观看: www.bilibili.com/video/BV16j...

包含:

📦完整项目源码

📦 预训练模型权重

🗂️ 数据集地址(含标注脚本

一、系统整体架构设计

在工程设计阶段,我们首先将系统划分为三个相互解耦的核心层次:

swift

┌──────────────────────────┐

│ 表现层(UI) │ PyQt5

├──────────────────────────┤

│ 业务逻辑与推理层 │ YOLOv8 推理接口

├──────────────────────────┤

│ 模型与数据层 │ 训练权重 / 数据集

└──────────────────────────┘1. 表现层:PyQt5 图形界面

- 负责用户交互与结果展示

- 不直接参与模型计算

- 支持多输入源切换

2. 推理层:YOLOv8 Detection

- 统一封装模型加载与预测接口

- 接收不同数据源并输出标准化检测结果

- 保证实时性与稳定性

3. 模型与数据层

- 包含训练好的权重文件

- 数据集采用标准 YOLO 格式,方便复用与扩展

这种分层设计的好处在于: 算法可以独立升级,界面无需重写;UI 可重构,模型逻辑不受影响。

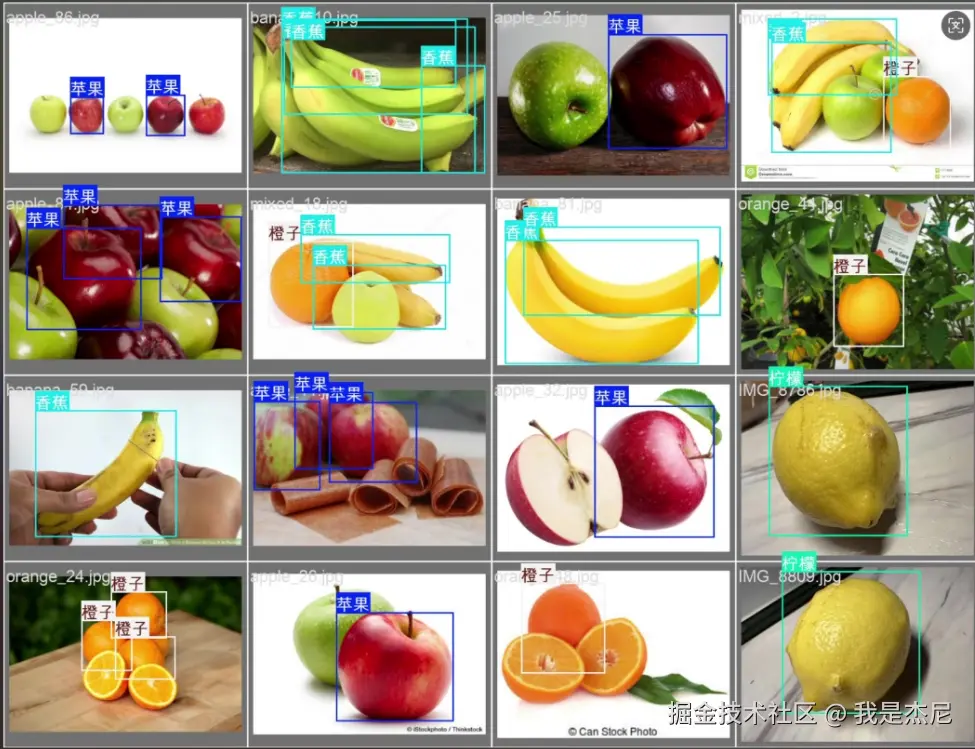

二、YOLOv8 在水果识别场景中的优势分析

2.1 为什么选择 YOLOv8?

与传统 YOLOv5 / YOLOv7 相比,YOLOv8 在水果识别这类"多目标、小尺度、实时性要求高"的任务中具有明显优势:

-

Anchor-Free 架构 对不同大小水果的适应性更强,减少锚框设计成本

-

更合理的正负样本分配策略 在水果密集、遮挡场景下,分类更稳定

-

原生支持多任务扩展 后续可扩展至分割(如果实轮廓)、姿态或成熟度分析

2.2 检测目标的特点与挑战

水果识别并非"简单目标检测",主要难点包括:

- 不同水果外观相似(如橙子 / 柚子)

- 同一水果在不同成熟阶段颜色变化大

- 堆叠、遮挡、反光等复杂场景

YOLOv8 的高分辨率特征融合能力,正好适配这类复杂视觉输入。

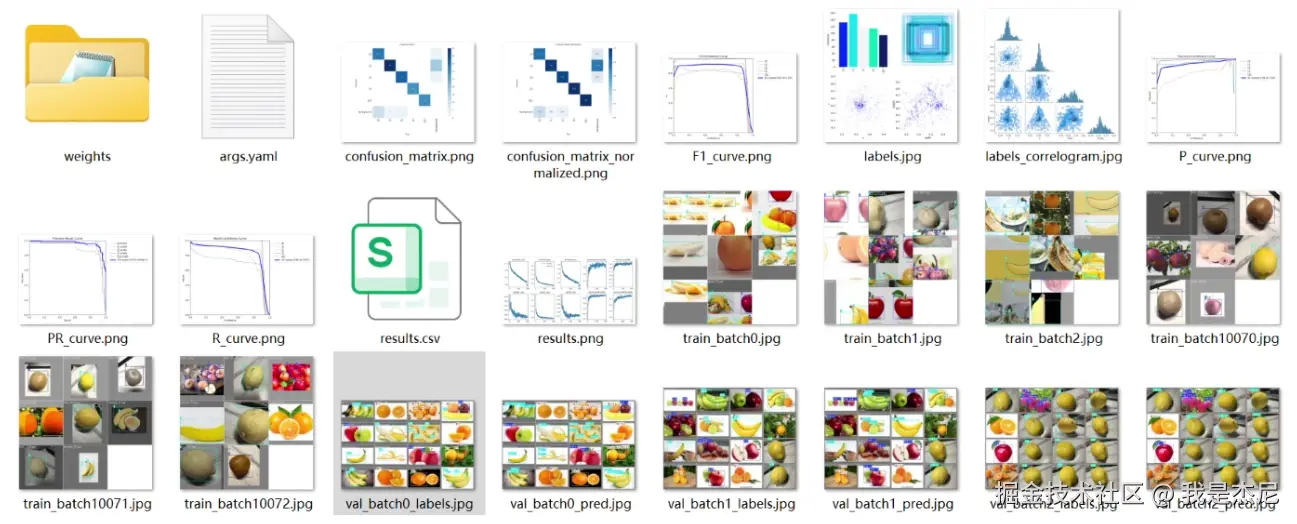

三、数据集组织与训练流程设计

3.1 数据集结构设计

项目采用标准 YOLO 数据组织方式:

kotlin

dataset/

├── images/

│ ├── train/

│ └── val/

├── labels/

│ ├── train/

│ └── val/这种结构的优势在于:

- 与 Ultralytics 官方训练流程完全兼容

- 可直接迁移到其他 YOLO 项目

- 方便后期自动化数据增强与再训练

3.2 标注格式说明

每个目标使用一行文本描述:

arduino

class_id x_center y_center width height所有数值均归一化到 [0,1] 区间,这使得模型在不同分辨率输入下具有一致性。

3.3 训练策略要点

在实际训练中,针对水果检测任务,通常需要关注以下几点:

- 适当增大输入分辨率,提高小目标识别率

- 使用较低的初始学习率,保证收敛稳定

- 关注 mAP@0.5 与混淆矩阵,而非单一 loss

当验证集 mAP@0.5 稳定在较高水平时,模型即可进入部署阶段。

四、统一推理接口设计与实现

为了适配多种输入形式,推理层并未为"图片 / 视频 / 摄像头"分别实现逻辑,而是抽象为统一流程:

- 获取输入帧(image / frame)

- 调用 YOLOv8 模型进行预测

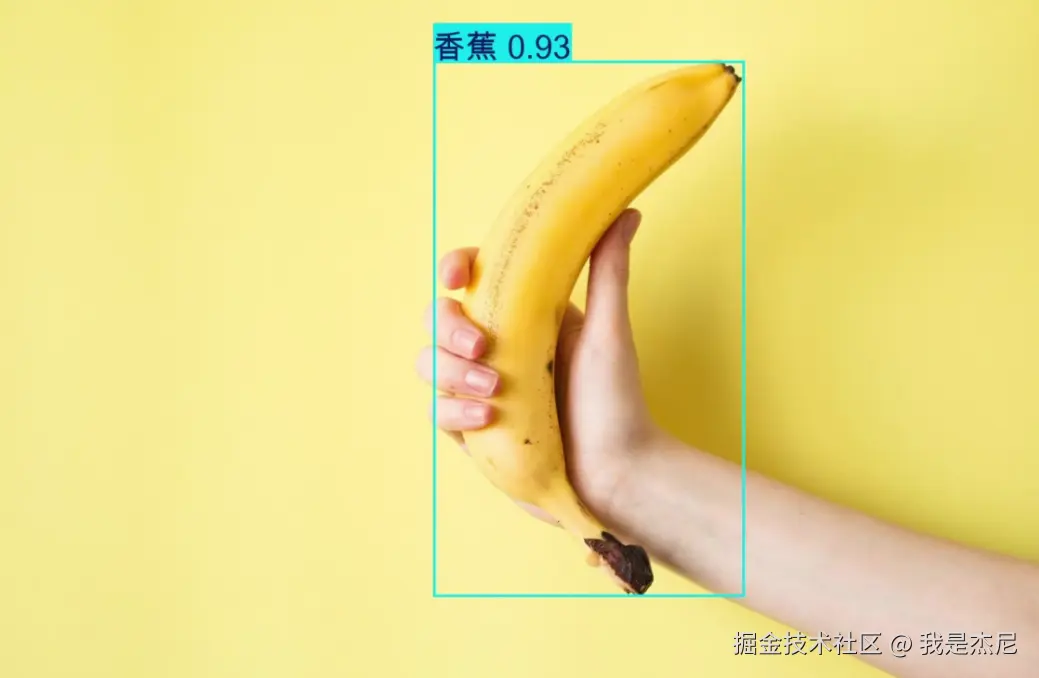

- 解析检测结果(类别、置信度、坐标)

- 渲染并输出结果

4.1 PyTorch 推理核心示例

python

from ultralytics import YOLO

model = YOLO("best.pt")

results = model(

source=frame,

conf=0.25,

device=0

)

for box in results[0].boxes:

cls_id = int(box.cls)

score = float(box.conf)

x1, y1, x2, y2 = map(int, box.xyxy[0])通过这种方式,推理层对输入来源完全无感,只关注"当前帧"。

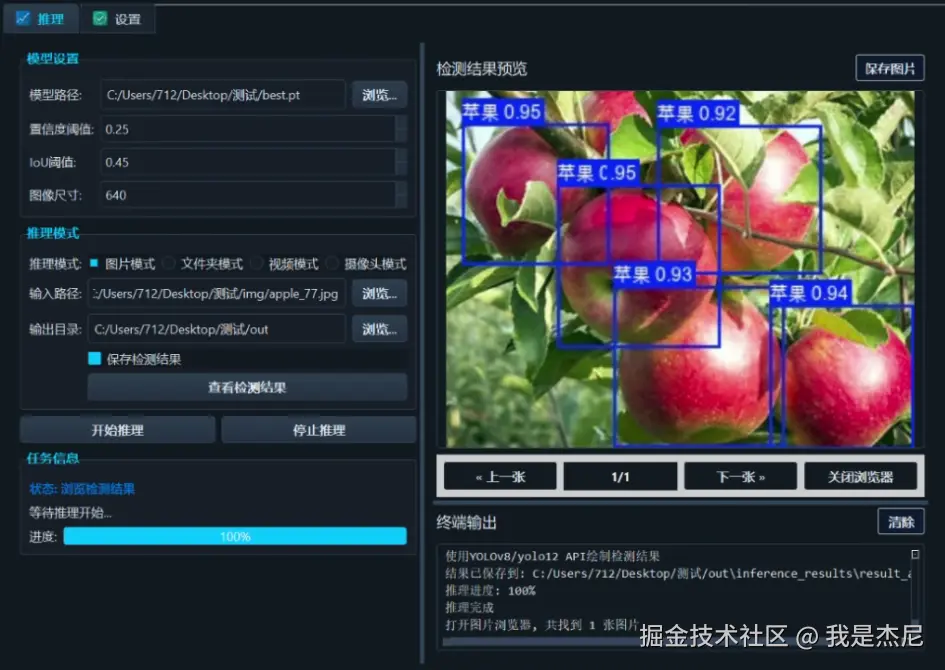

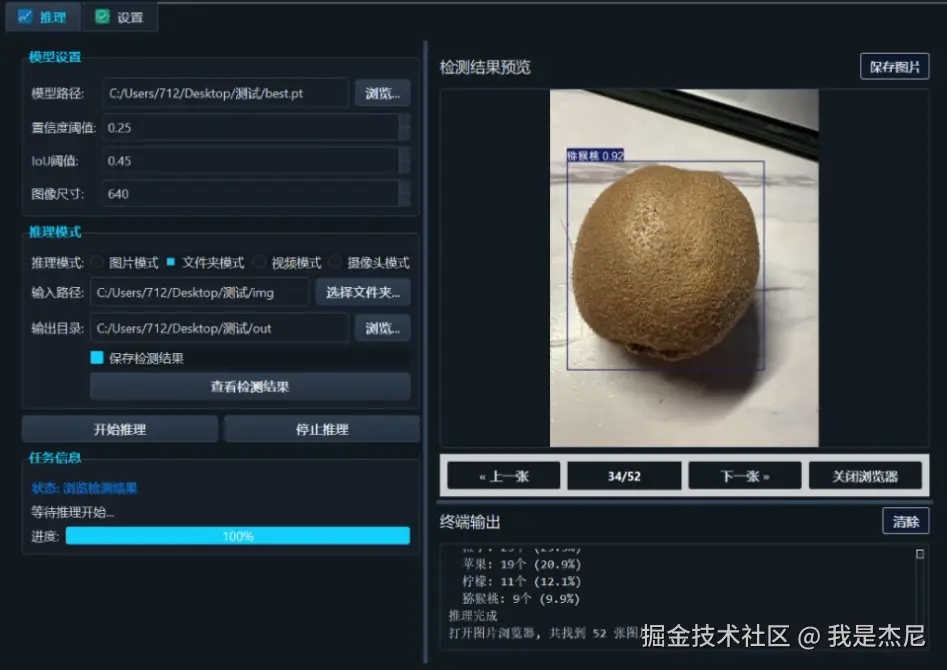

五、PyQt5 图形界面与工程落地

5.1 为什么需要 GUI?

对于非算法背景用户而言:

- 命令行工具不友好

- 参数配置门槛高

- 无法直观查看结果

PyQt5 的引入,解决了模型"最后一公里"的问题。

5.2 界面核心功能模块

- 输入源选择(图片 / 文件夹 / 视频 / 摄像头)

- 实时画面预览

- 检测结果与置信度展示

- 结果保存控制

通过信号与槽机制,将界面操作与推理逻辑解耦,保证系统响应流畅。

六、性能与部署实践

6.1 实时性能表现

在普通 GPU 或高性能 CPU 环境下:

- 单帧推理可达到实时级别

- 摄像头检测无明显延迟

- 适合嵌入式边缘设备部署

6.2 多平台部署能力

YOLOv8 原生支持模型导出:

- ONNX

- TensorRT

- OpenVINO

这为后续部署到 Jetson、工控机或云端服务提供了良好基础。

七、可扩展性与二次开发方向

该系统并不局限于"水果识别",其整体架构可直接迁移到:

- 农作物病害检测

- 工业零部件缺陷检测

- 超市商品识别

- 医疗图像目标检测

只需替换数据集与类别配置,即可快速复用。

总结:一个真正"能用"的视觉项目应该长什么样?

相比单纯的算法 Demo,本项目更强调 工程完整性与实用价值:

- 算法层:YOLOv8 提供稳定高效的检测能力

- 系统层:统一推理逻辑,支持多输入源

- 产品层:PyQt5 GUI 降低使用门槛

- 工程层:源码、权重、数据集一体化交付

对于学习计算机视觉的开发者,这是一个理解 "从模型到产品"完整链路 的极佳范例; 对于实际应用场景,它同样具备直接落地和扩展的现实意义。

本文从工程化与产品化的视角,系统讲解了一个基于 YOLOv8 的多水果种类智能识别系统的完整实现路径。通过将目标检测算法、统一推理逻辑与 PyQt5 图形界面进行解耦设计,项目不仅实现了对图片、视频和实时摄像头的高效识别,也真正完成了从模型训练到可交互应用的落地闭环。实践表明,YOLOv8 在多类别水果识别场景下兼顾了精度与实时性,而图形化封装显著降低了算法使用门槛,使系统具备良好的复用性与扩展性。整体方案对希望将计算机视觉技术应用于农业、零售或工业场景的开发者而言,具有明确的参考价值与实践意义。