《博主简介》

小伙伴们好,我是阿旭。

专注于计算机视觉领域,包括目标检测、图像分类、图像分割和目标跟踪等项目开发,提供模型对比实验、答疑辅导等。

《------往期经典推荐------》

二、机器学习实战专栏【链接】 ,已更新31期,欢迎关注,持续更新中~~

三、深度学习【Pytorch】专栏【链接】

四、【Stable Diffusion绘画系列】专栏【链接】

五、YOLOv8改进专栏【链接】,持续更新中~~

六、YOLO性能对比专栏【链接】,持续更新中~

《------正文------》

目录

- 基本功能演示

- 研究背景

- 应用场景

- 主要工作内容

- 一、软件核心功能介绍及效果演示

- 二、模型的训练、评估与推理

-

- 1.YOLO26介绍

- YOLO26创新点

-

- [1. 移除DFL模块,简化预测流程](#1. 移除DFL模块,简化预测流程)

- [2. 端到端无NMS推理,降低 latency](#2. 端到端无NMS推理,降低 latency)

- [3. ProgLoss+STAL,提升检测精度](#3. ProgLoss+STAL,提升检测精度)

- [4. MuSGD优化器,强化训练稳定性](#4. MuSGD优化器,强化训练稳定性)

- 数据集准备与训练

-

- 2.模型训练

- [3. 训练结果评估](#3. 训练结果评估)

- [4. 使用模型进行推理](#4. 使用模型进行推理)

- 四、可视化系统制作

- 【获取方式】

基本功能演示

项目演示视频:https://www.bilibili.com/video/BV1QEcfzMEpp

摘要:城市拥堵或事故时,交警手势是关键指挥指令。但传统系统依赖固定信号,难以实时识别灵活手势,致车辆反应滞后,易引发拥堵或事故。本文基于

YOLO26的深度学习框架,通过5162张实际场景中交警手势相关图片,训练了一个交警手势检测识别模型,可检测常见的8类手势。最终基于训练好的模型制作了一款带UI界面的交警手势识别系统,更便于实际应用。该系统是基于python与PyQT5开发的,支持图片、视频以及摄像头进行目标检测,并保存检测结果。本文提供了完整的Python代码和使用教程,给感兴趣的小伙伴参考学习,完整的代码资源文件获取方式见文末。

研究背景

在城市交通日益拥堵、信号灯故障或突发事故导致交通指挥依赖人工疏导的复杂场景下,交警手势是维持秩序的关键指令。然而,传统交通感知系统多依赖固定信号灯或车道线检测,难以实时理解交警灵活多变的手势指令,导致自动驾驶车辆"不知所措"或驾驶员反应滞后,易引发二次拥堵甚至交通事故。基于YOLO深度学习框架研发的交警手势检测识别系统,能够精准识别变道、左转、左转弯待转、直行、靠边停车、右转、减速、停止等8种核心手势,填补了动态人工指挥与智能交通感知之间的空白。该系统的应用不仅提升了车辆(尤其是自动驾驶车辆)对现场指挥的响应速度与合规性,实现了"人车协同"的智能化升级,还能辅助交管部门量化评估指挥效率、留存执法证据,对于构建高适应性、高安全性的智慧交通生态系统具有里程碑式的重要意义。

应用场景

自动驾驶与辅助驾驶系统交互:作为L3级以上自动驾驶车辆的"视觉大脑"组件,使车辆能实时"读懂"现场交警的变道、停止或减速指令,在信号灯失效或复杂路口平滑接管控制权,避免急刹或违章,提升自动驾驶的安全性与拟人化水平。

智能路口信号优先控制:在早晚高峰或事故路段,系统实时监测交警手势,当识别到"直行"或"左转"等疏导指令时,自动联动路口信号灯系统调整配时方案或切换为黄闪模式,实现人工指挥与电子信号的无缝协同,最大化通行效率。

驾驶员行为预警与辅助:集成于车载ADAS(高级驾驶辅助系统)或导航APP中,当检测到前方交警做出"靠边停车"、"减速"或"停止"手势时,立即向驾驶员发出语音和视觉强预警,防止因分心未注意到人工指挥而导致的违章或事故。

交警培训与考核仿真系统:利用该模型构建虚拟仿真训练平台,实时评估受训交警手势的标准度(如动作幅度、持续时间),或模拟各种极端路况下的手势识别测试,为交警队伍的规范化培训提供量化数据支持。

主要工作内容

本文的主要内容包括以下几个方面:

搜集与整理数据集:搜集整理实际场景中交警手势的相关数据图片,并进行相应的数据标注与处理,为模型训练提供训练数据集;训练模型:基于整理的数据集,根据最前沿的YOLO26目标检测技术训练目标检测模型,实现对需要检测的对象进行有效检测的功能;模型性能评估:对训练出的模型在验证集上进行了充分的结果评估和对比分析,主要目的是为了揭示模型在关键指标(如Precision、Recall、mAP50和mAP50-95等指标)上的表现情况。可视化系统制作:基于训练出的目标检测模型,搭配Pyqt5制作的UI界面,用python开发了一款界面简洁的软件系统,可支持图片、视频以及摄像头检测,同时可以将图片或者视频检测结果进行保存。其目的是为检测系统提供一个用户友好的操作平台,使用户能够便捷、高效地进行检测任务。

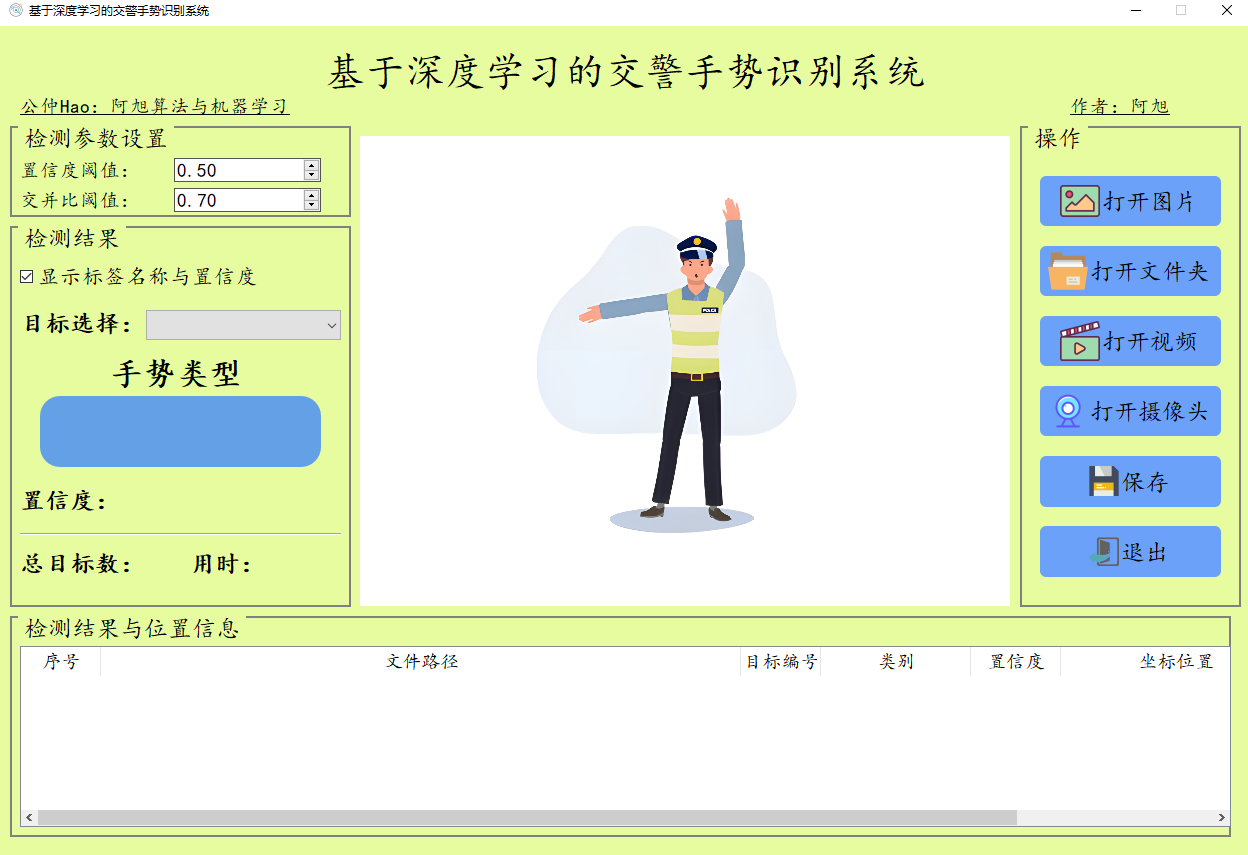

软件初始界面如下图所示:

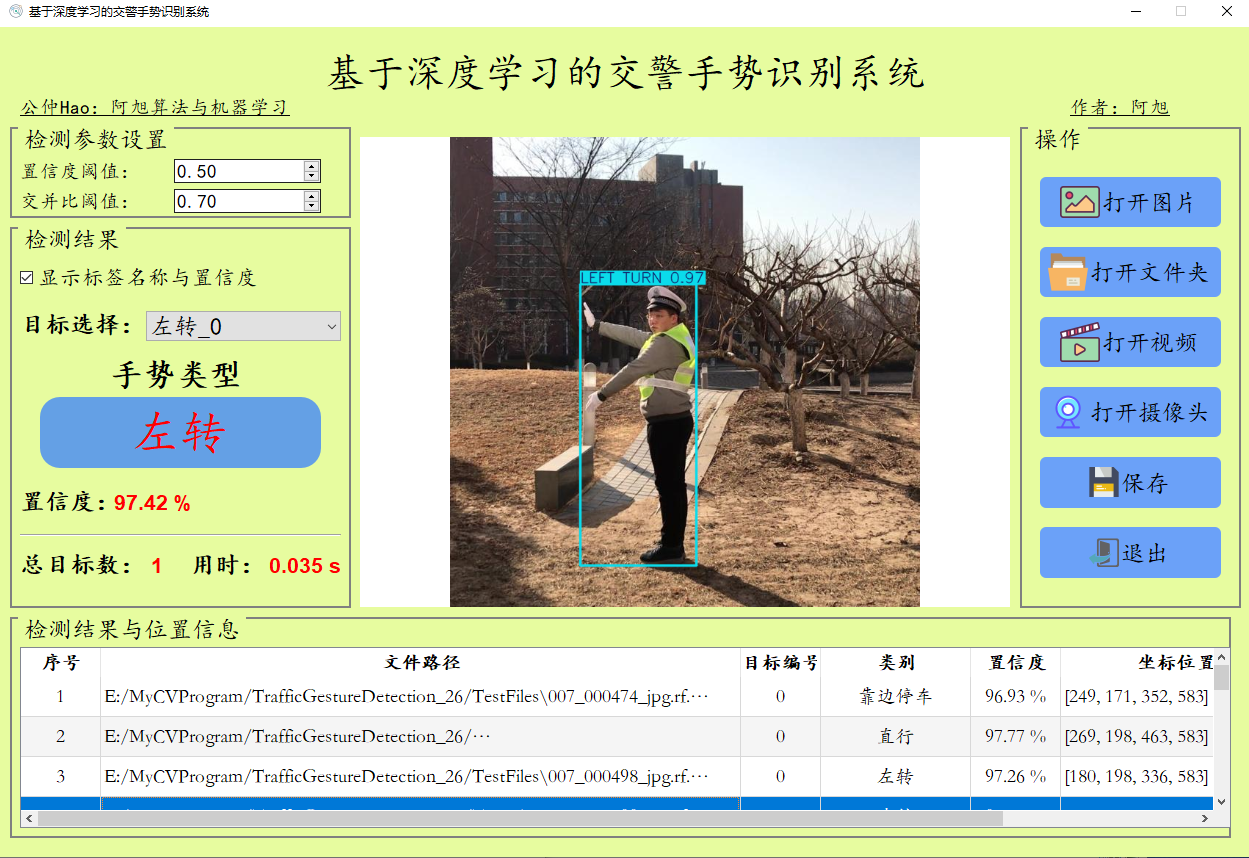

检测结果界面如下:

一、软件核心功能介绍及效果演示

软件主要功能

1. 可用于实际场景中的交警手势检测,分8个检测类别:['变道', '左转', '左转弯待转', '直行', '靠边停车', '右转', '减速', '停止'];

2. 支持图片、视频及摄像头进行检测,同时支持图片的批量检测;

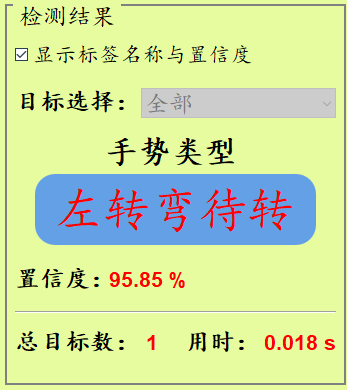

3. 界面可实时显示手势类型、置信度、用时、检测结果等信息;

4. 支持图片或者视频的检测结果保存;

5. 支持将图片的检测结果保存为csv文件;

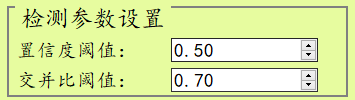

界面参数设置说明

置信度阈值:也就是目标检测时的conf参数,只有检测出的目标框置信度大于该值,结果才会显示;

交并比阈值:也就是目标检测时的iou参数,对检测框重叠比例iou大于该阈值的目标框进行过滤【也就是说假如两检测框iou大于该值的话,会过滤掉其中一个,该值越小,重叠框会越少】;

检测结果说明

显示标签名称与置信度:表示是否在检测图片上标签名称与置信度,显示默认勾选,如果不勾选则不会在检测图片上显示标签名称与置信度;

总目标数:表示画面中检测出的目标数目;

目标选择:可选择单个目标进行位置信息、置信度查看。

主要功能说明

功能视频演示见文章开头,以下是简要的操作描述。

(1)图片检测说明

点击打开图片按钮,选择需要检测的图片,或者点击打开文件夹按钮,选择需要批量检测图片所在的文件夹,操作演示如下:

点击目标下拉框后,可以选定指定目标的结果信息进行显示。

点击保存按钮,会对检测结果进行保存,存储路径为:save_data目录下,同时会将图片检测信息保存csv文件。

注:1.右侧目标位置默认显示置信度最大一个目标位置,可用下拉框进行目标切换。所有检测结果均在左下方表格中显示。

(2)视频检测说明

点击视频按钮,打开选择需要检测的视频,就会自动显示检测结果,再次点击可以关闭视频。

点击保存按钮,会对视频检测结果进行保存,存储路径为:save_data目录下。

(3)摄像头检测说明

点击打开摄像头按钮,可以打开摄像头,可以实时进行检测,再次点击,可关闭摄像头。

(4)保存图片与视频检测说明

点击保存按钮后,会将当前选择的图片【含批量图片】或者视频的检测结果进行保存,对于图片图片检测还会保存检测结果为csv文件,方便进行查看与后续使用。检测的图片与视频结果会存储在save_data目录下。

【注:暂不支持视频文件的检测结果保存为csv文件格式。】

保存的检测结果文件如下:

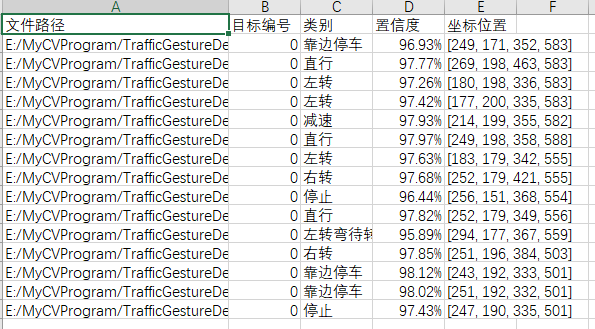

图片文件保存的csv文件内容如下,包括图片路径、目标在图片中的编号、目标类别、置信度、目标坐标位置。

注:其中坐标位置是代表检测框的左上角与右下角两个点的x、y坐标。

二、模型的训练、评估与推理

1.YOLO26介绍

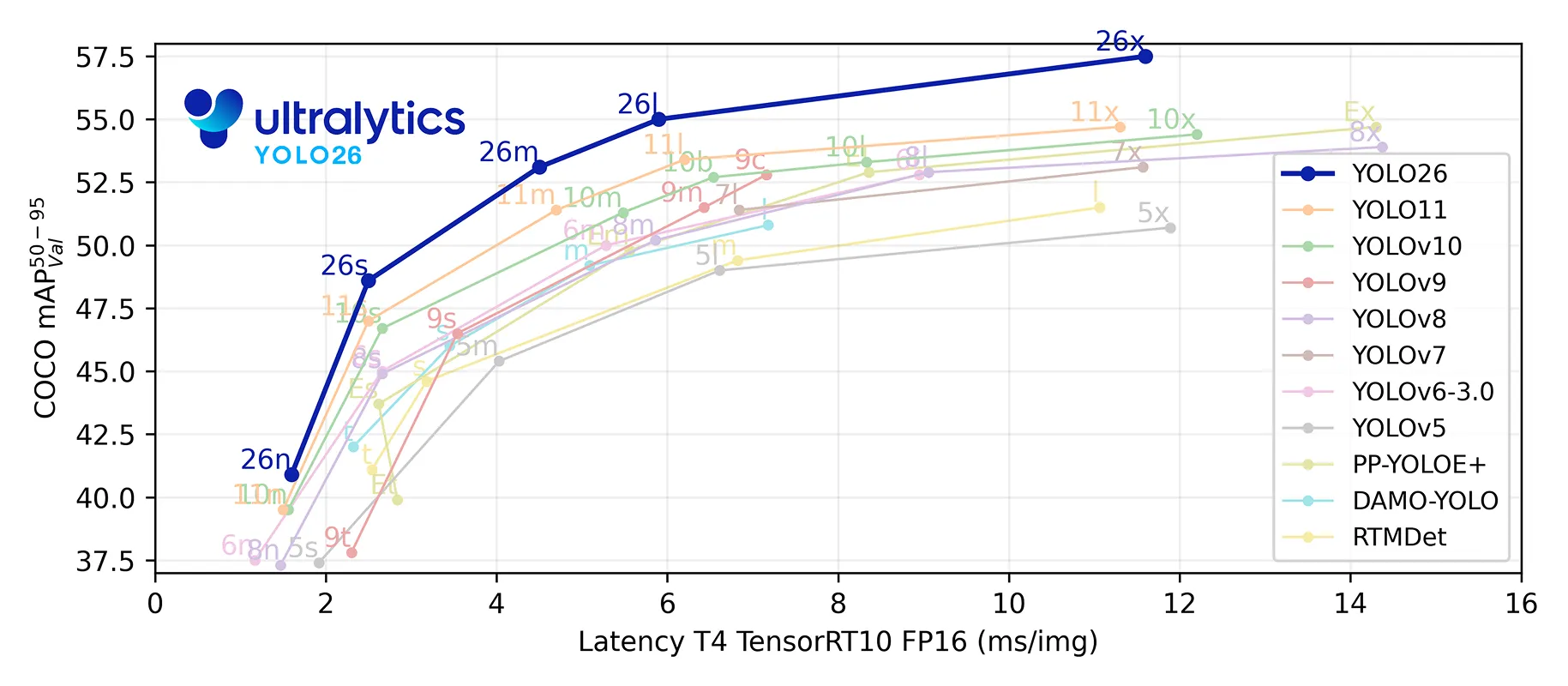

本项目采用的是最新的YOLO26模型。YOLO26 是 Ultralytics 2026 年 1 月推出的新一代计算机视觉模型,主打边缘优先、高效部署。它采用端到端免 NMS 架构,移除 DFL 模块,CPU 推理速度较前代提升 43%;搭配 MuSGD 优化器与 ProgLoss+STAL 损失策略,强化小目标检测能力,支持检测、分割、姿势估计等多任务,可无缝适配树莓派、嵌入式设备等终端,广泛应用于智慧农业、安防监控等领域。

YOLO各版本性能对比:

YOLO26创新点

YOLO26的性能飞跃源于四大核心技术创新,从模型架构到训练机制全面优化:

1. 移除DFL模块,简化预测流程

早期YOLO模型依赖分布焦点损失(DFL)提升边界框精度,但这一模块增加了部署复杂度,且存在固定回归限制。YOLO26彻底移除DFL,不仅简化了边界框预测逻辑,提升了硬件兼容性,还解决了超大目标检测的可靠性问题,让模型在边缘设备上的导出与运行更顺畅。

2. 端到端无NMS推理,降低 latency

传统目标检测需通过非极大值抑制(NMS)进行后处理,过滤重叠预测框------这一步骤会增加延迟、提升部署难度。YOLO26采用原生端到端架构,直接输出最终预测结果,内部自动处理重复预测,彻底省去NMS环节,大幅降低推理延迟与集成风险,完美适配实时边缘场景。

3. ProgLoss+STAL,提升检测精度

- 渐进式损失平衡(ProgLoss):让模型训练过程更稳定,收敛更平滑,减少训练波动

- 小目标感知标签分配(STAL):针对小目标、低可见度目标优化学习机制,解决边缘场景中"难检测"问题

两项技术结合,让YOLO26在复杂场景中仍能保持高可靠检测,尤其适用于物联网、机器人、航拍等小目标密集场景。

4. MuSGD优化器,强化训练稳定性

YOLO26采用全新混合优化器MuSGD,融合传统随机梯度下降(SGD)的强泛化能力与大语言模型(LLM)训练中的先进优化思路。该优化器灵感源自Moonshot AI的Kimi K2,能让模型更快达到高性能水平,同时降低训练不稳定性,尤其在大型复杂数据集训练中表现突出。

数据集准备与训练

本文主要基于YOLO26n模型进行模型训练,训练完成后对模型在验证集上的表现进行全面的性能评估及对比分析。总体流程包括:数据集准备、模型训练、模型评估。

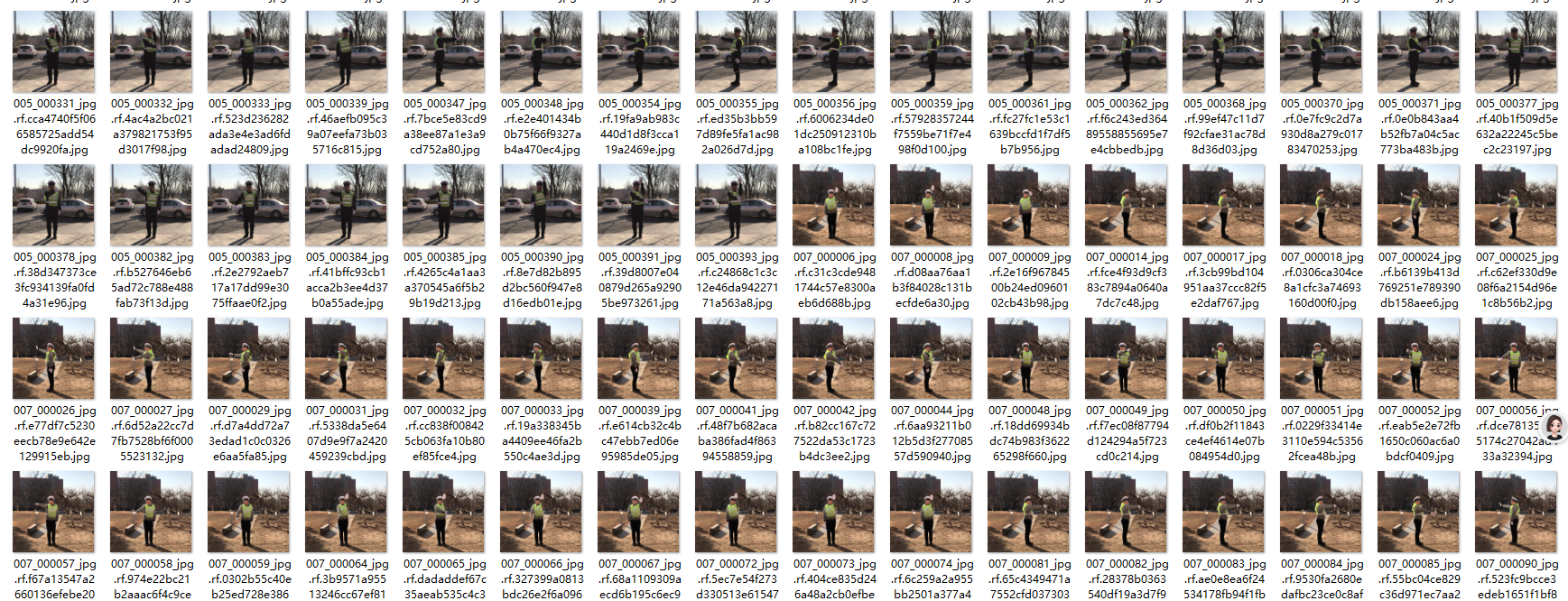

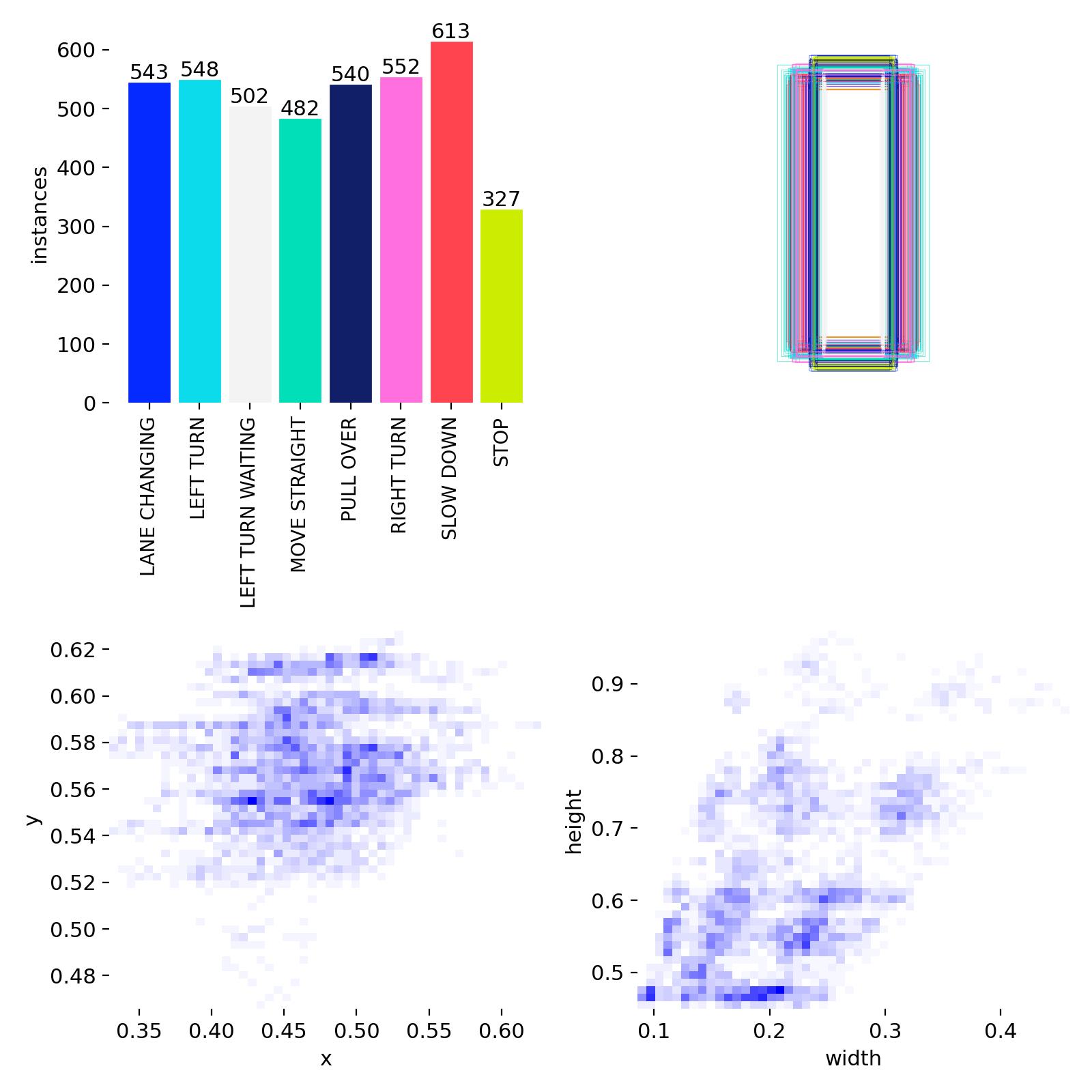

通过网络上搜集关于实际场景中交警手势的相关图片,并使用Labelimg标注工具对每张图片进行标注,分8个检测类别:['变道', '左转', '左转弯待转', '直行', '靠边停车', '右转', '减速', '停止']。

该数据集一共包含5162张图片,其中训练集包含4106张图片,验证集包含1056张图片。

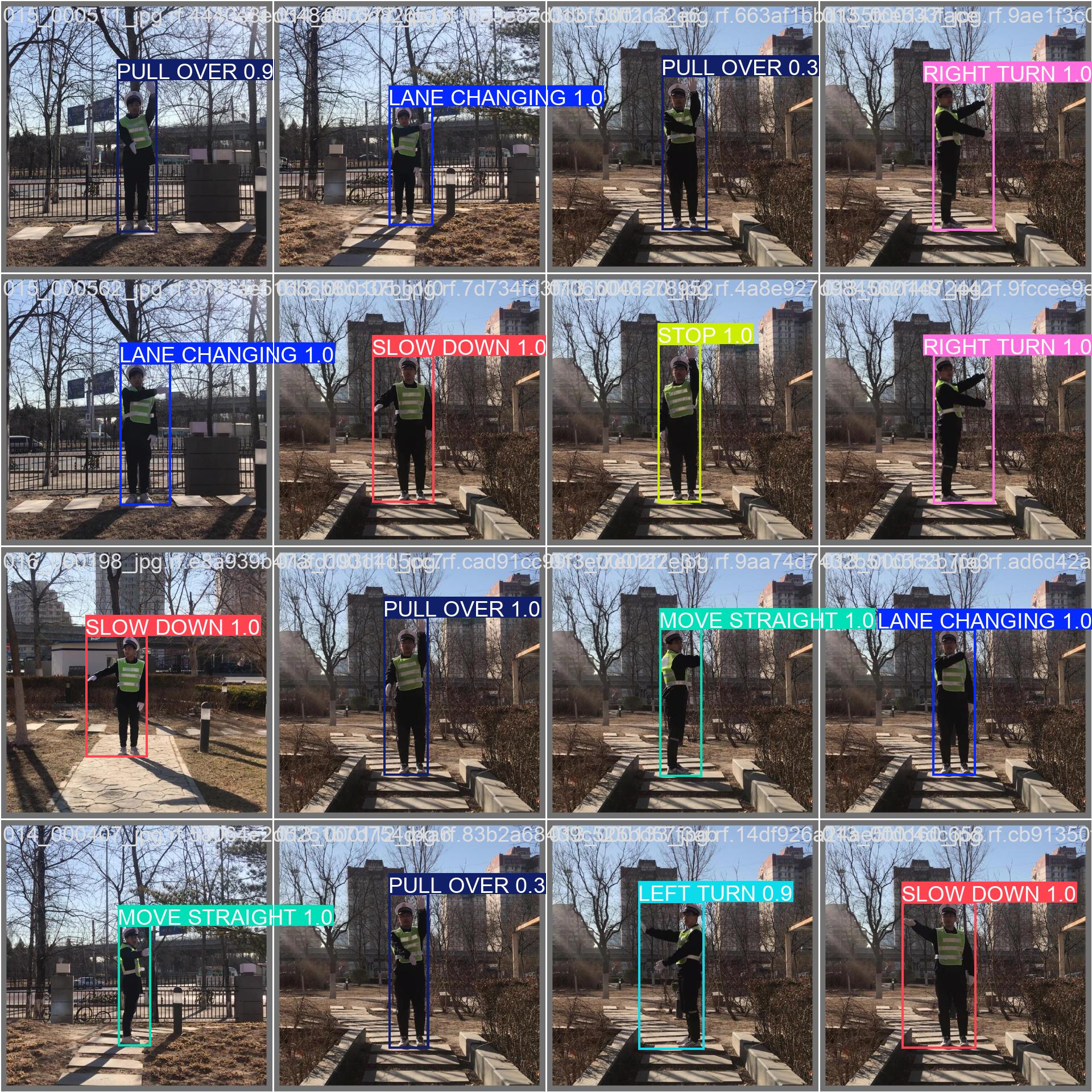

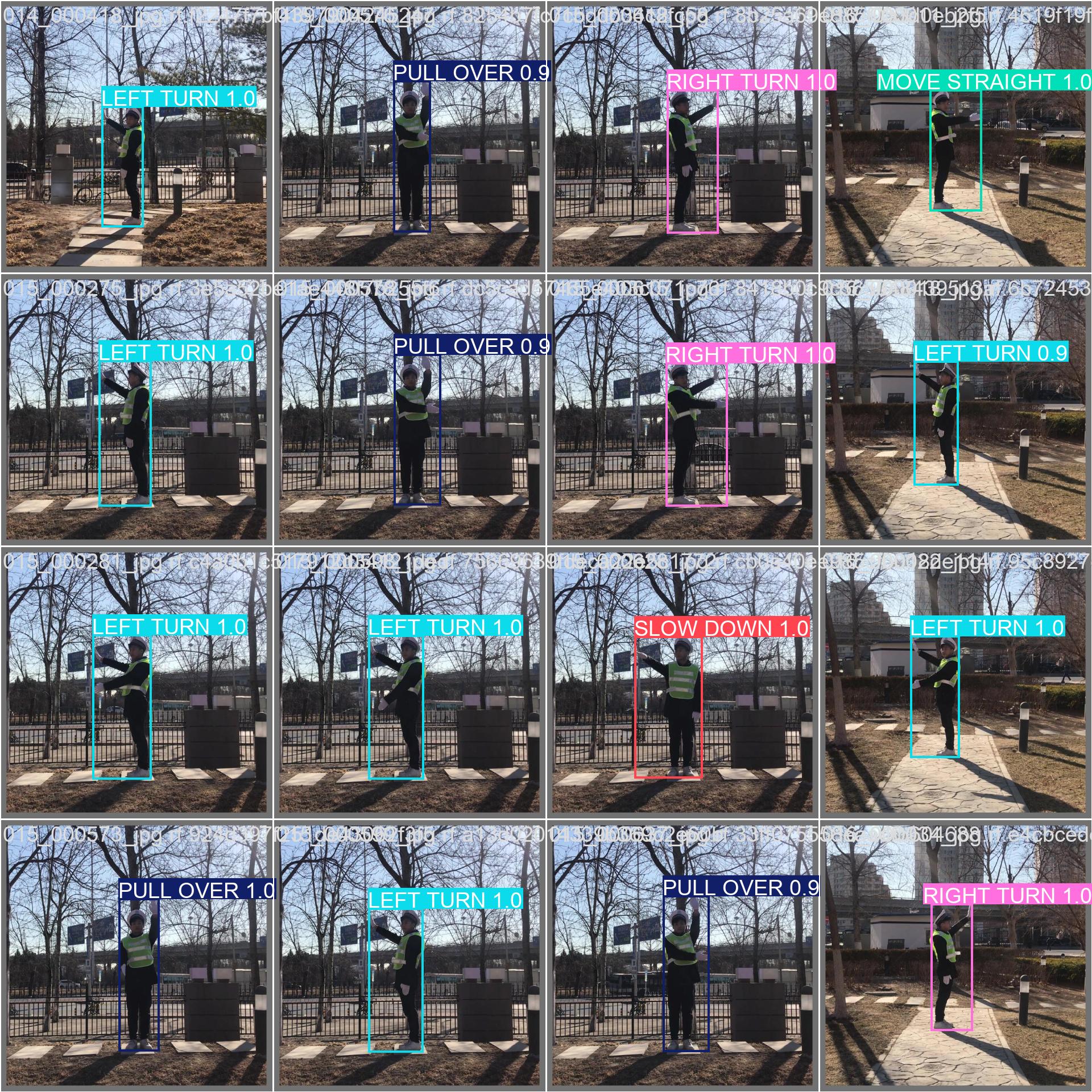

部分图像及标注如下图所示:

数据集各类别数目分布情况如下:

2.模型训练

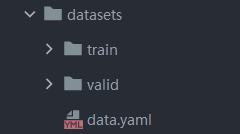

准备好数据集后,将图片数据以如下格式放置在项目目录中。在项目目录中新建datasets目录,同时将检测的图片分为训练集与验证集放入Data目录下。

同时我们需要新建一个data.yaml文件,用于存储训练数据的路径及模型需要进行检测的类别。在进行模型训练时,会读取该文件的信息,用于进行模型的训练与验证。data.yaml的具体内容如下:

python

train: E:\CVProgram\00datasets\Detection\TrafficGesture\datasets\train\images

val: E:\CVProgram\00datasets\Detection\TrafficGesture\datasets\valid\images

nc: 8

names: ['LANE CHANGING', 'LEFT TURN', 'LEFT TURN WAITING', 'MOVE STRAIGHT', 'PULL OVER', 'RIGHT TURN', 'SLOW DOWN', 'STOP']注:train与val后面表示需要训练图片的路径,建议直接写自己文件的绝对路径。

数据准备完成后,通过调用train.py文件进行模型训练,epochs参数用于调整训练的轮数,batch参数用于调整训练的批次大小【根据内存大小调整,最小为1】,optimizer设定的优化器为SGD,训练代码如下:

python

#coding:utf-8

from ultralytics import YOLO

import matplotlib

matplotlib.use('TkAgg')

# 模型配置文件

model_yaml_path = "ultralytics/cfg/models/26/yolo26.yaml"

#数据集配置文件

data_yaml_path = r'PuddleSeg/data/data/data.yaml'

#预训练模型

pre_model_name = 'yolo26n.pt'

if __name__ == '__main__':

#加载预训练模型

model = YOLO(model_yaml_path).load(pre_model_name)

#训练模型

results = model.train(data=data_yaml_path,

epochs=150,

batch=32,

name='train_26')模型常用训练超参数参数说明:

YOLO11 模型的训练设置包括训练过程中使用的各种超参数和配置。这些设置会影响模型的性能、速度和准确性。关键的训练设置包括批量大小、学习率、动量和权重衰减。此外,优化器、损失函数和训练数据集组成的选择也会影响训练过程。对这些设置进行仔细的调整和实验对于优化性能至关重要。

以下是一些常用的模型训练参数和说明:

| 参数名 | 默认值 | 说明 |

|---|---|---|

model |

None |

指定用于训练的模型文件。接受指向 .pt 预训练模型或 .yaml 配置文件。对于定义模型结构或初始化权重至关重要。 |

data |

None |

数据集配置文件的路径(例如 coco8.yaml).该文件包含特定于数据集的参数,包括训练数据和验证数据的路径、类名和类数。 |

epochs |

100 |

训练总轮数。每个epoch代表对整个数据集进行一次完整的训练。调整该值会影响训练时间和模型性能。 |

patience |

100 |

在验证指标没有改善的情况下,提前停止训练所需的epoch数。当性能趋于平稳时停止训练,有助于防止过度拟合。 |

batch |

16 |

批量大小,有三种模式:设置为整数(例如,' Batch =16 '), 60% GPU内存利用率的自动模式(' Batch =-1 '),或指定利用率分数的自动模式(' Batch =0.70 ')。 |

imgsz |

640 |

用于训练的目标图像尺寸。所有图像在输入模型前都会被调整到这一尺寸。影响模型精度和计算复杂度。 |

device |

None |

指定用于训练的计算设备:单个 GPU (device=0)、多个 GPU (device=0,1)、CPU (device=cpu),或苹果芯片的 MPS (device=mps). |

workers |

8 |

加载数据的工作线程数(每 RANK 多 GPU 训练)。影响数据预处理和输入模型的速度,尤其适用于多 GPU 设置。 |

name |

None |

训练运行的名称。用于在项目文件夹内创建一个子目录,用于存储训练日志和输出结果。 |

pretrained |

True |

决定是否从预处理模型开始训练。可以是布尔值,也可以是加载权重的特定模型的字符串路径。提高训练效率和模型性能。 |

optimizer |

'auto' |

为训练模型选择优化器。选项包括 SGD, Adam, AdamW, NAdam, RAdam, RMSProp 等,或 auto 用于根据模型配置进行自动选择。影响收敛速度和稳定性 |

lr0 |

0.01 |

初始学习率(即 SGD=1E-2, Adam=1E-3) .调整这个值对优化过程至关重要,会影响模型权重的更新速度。 |

lrf |

0.01 |

最终学习率占初始学习率的百分比 = (lr0 * lrf),与调度程序结合使用,随着时间的推移调整学习率。 |

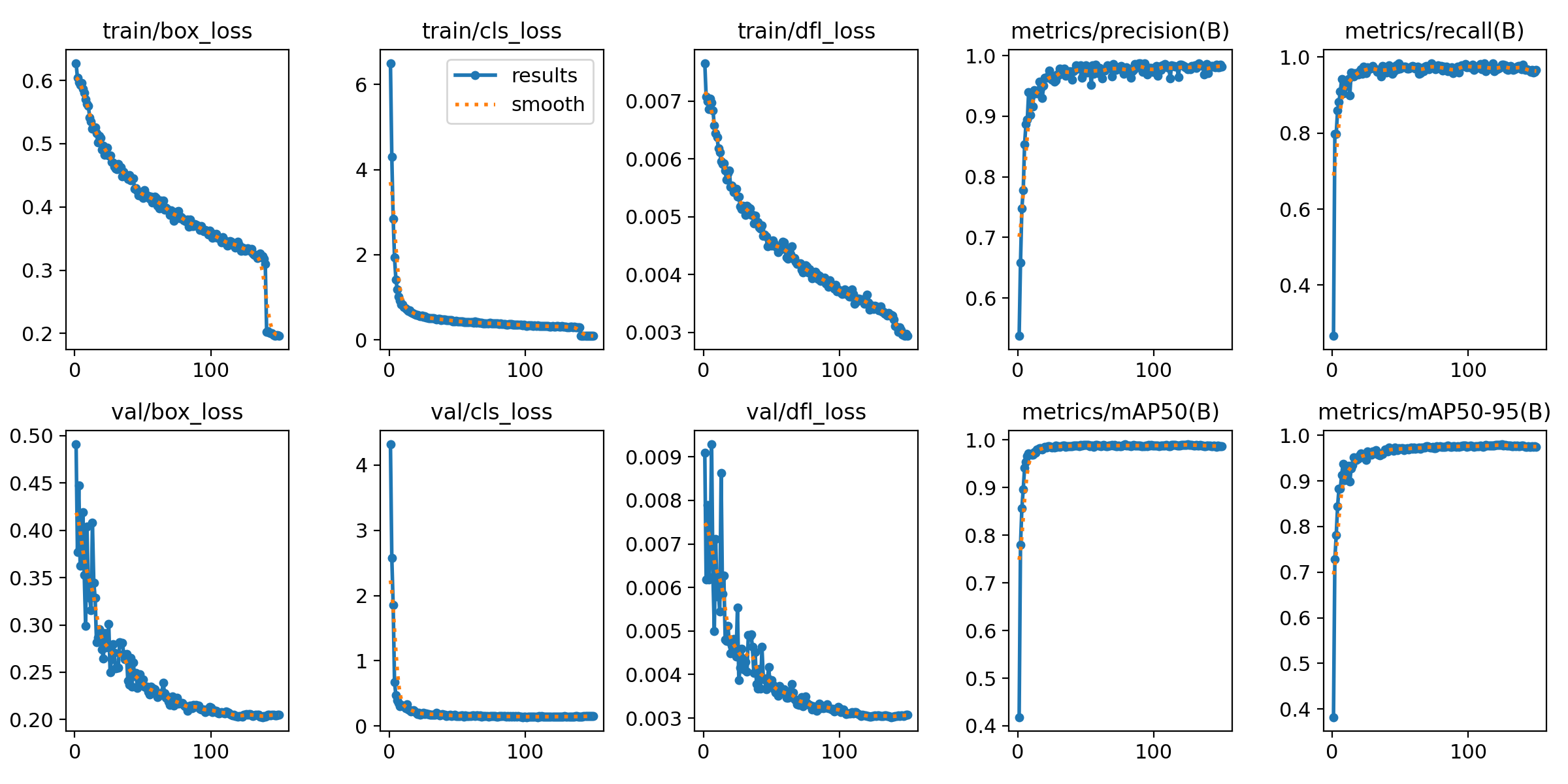

3. 训练结果评估

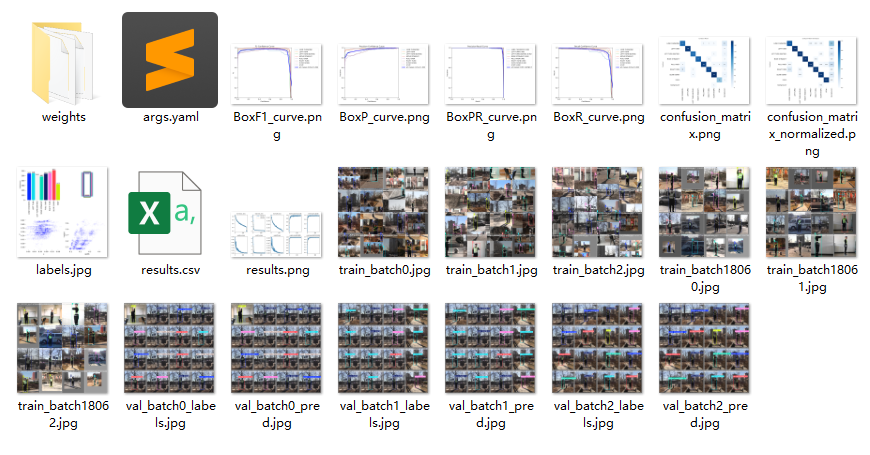

在深度学习中,我们通常用损失函数下降的曲线来观察模型训练的情况。YOLOv11在训练时主要包含三个方面的损失:定位损失(box_loss)、分类损失(cls_loss)和动态特征损失(dfl_loss),在训练结束后,可以在runs/目录下找到训练过程及结果文件 ,如下所示:

各损失函数作用说明:

定位损失box_loss:预测框与标定框之间的误差(GIoU),越小定位得越准;

分类损失cls_loss:计算锚框与对应的标定分类是否正确,越小分类得越准;

动态特征损失(dfl_loss):DFLLoss是一种用于回归预测框与目标框之间距离的损失函数。在计算损失时,目标框需要缩放到特征图尺度,即除以相应的stride,并与预测的边界框计算Ciou Loss,同时与预测的anchors中心点到各边的距离计算回归DFLLoss。

本文训练结果如下:

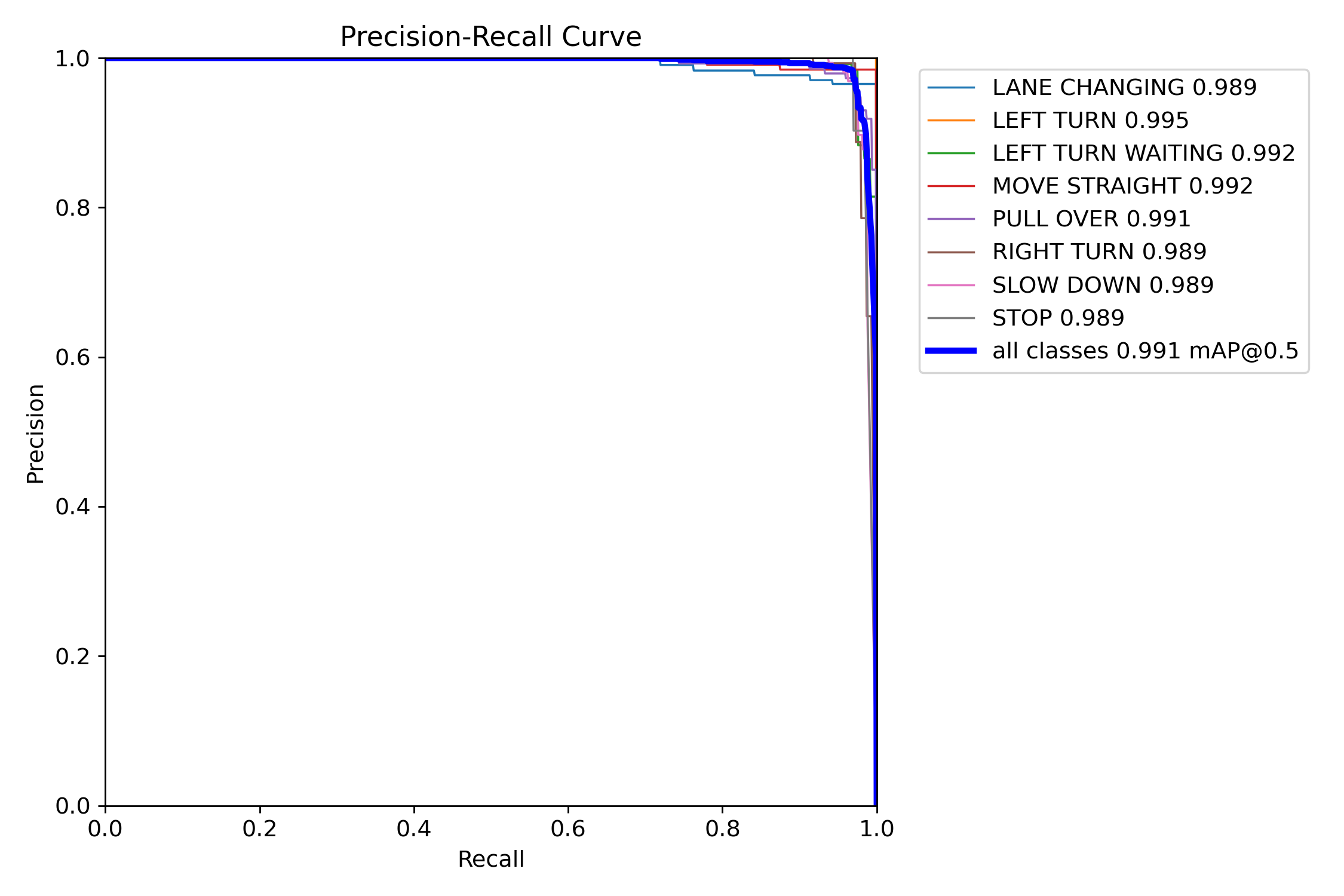

我们通常用PR曲线来体现精确率和召回率的关系,本文训练结果的PR曲线如下。mAP表示Precision和Recall作为两轴作图后围成的面积,m表示平均,@后面的数表示判定iou为正负样本的阈值。mAP@.5:表示阈值大于0.5的平均mAP,可以看到本文模型目标检测的mAP@0.5值为0.991,结果还是十分不错的。

4. 使用模型进行推理

模型训练完成后,我们可以得到一个最佳的训练结果模型best.pt文件,在runs/train/weights目录下。我们可以使用该文件进行后续的推理检测。

图片检测代码如下:

python

#coding:utf-8

from ultralytics import YOLO

import cv2

# 所需加载的模型目录

path = 'models/best.pt'

# 需要检测的图片地址

img_path = "TestFiles/007_000498_jpg.rf.990e6e442797db63462c849255db80f3.jpg"

# 加载预训练模型

model = YOLO(path, task='detect')

# 检测图片

results = model(img_path,conf=0.3)

res = results[0].plot()

# res = cv2.resize(res,dsize=None,fx=0.5,fy=0.5,interpolation=cv2.INTER_LINEAR)

cv2.imshow("Detection Result", res)

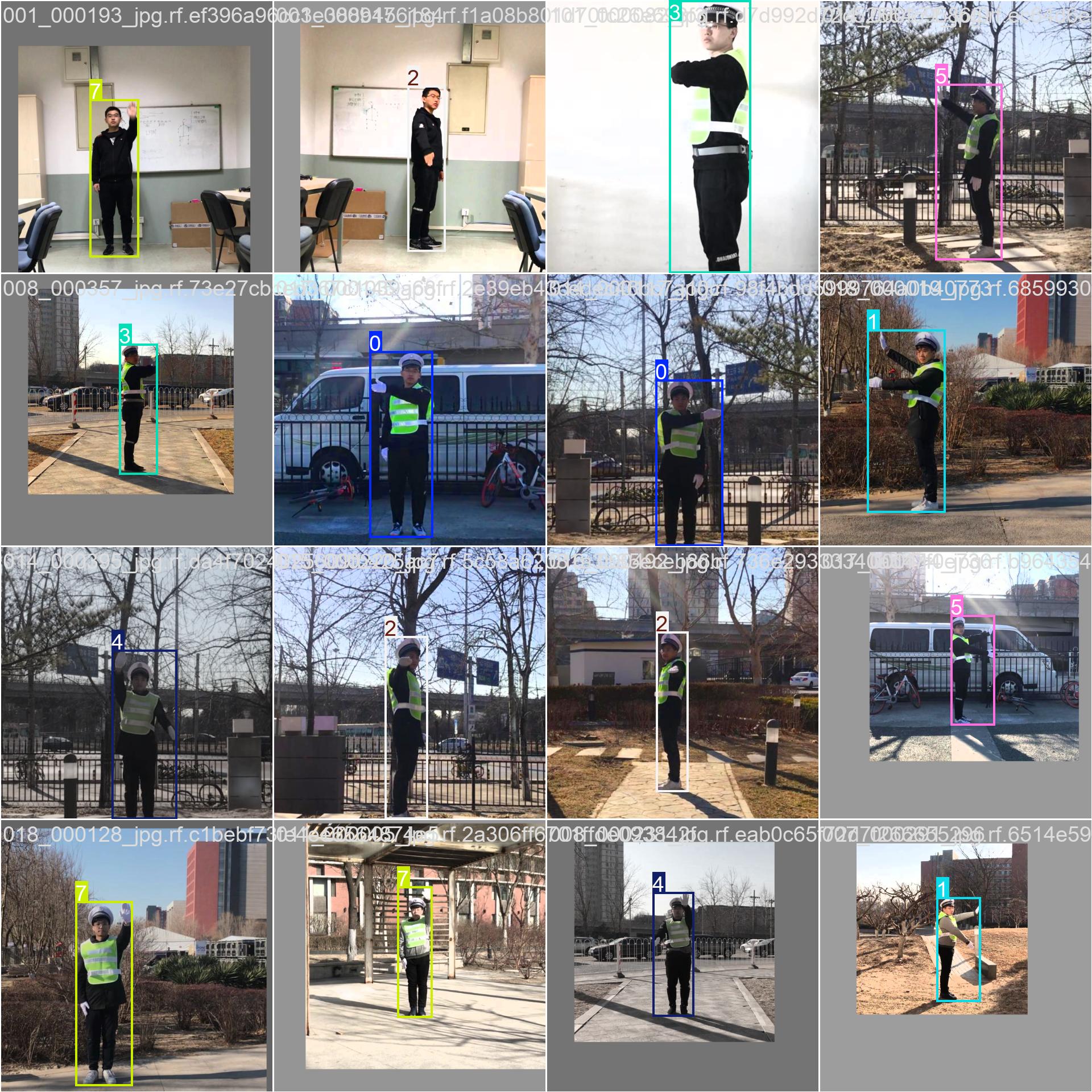

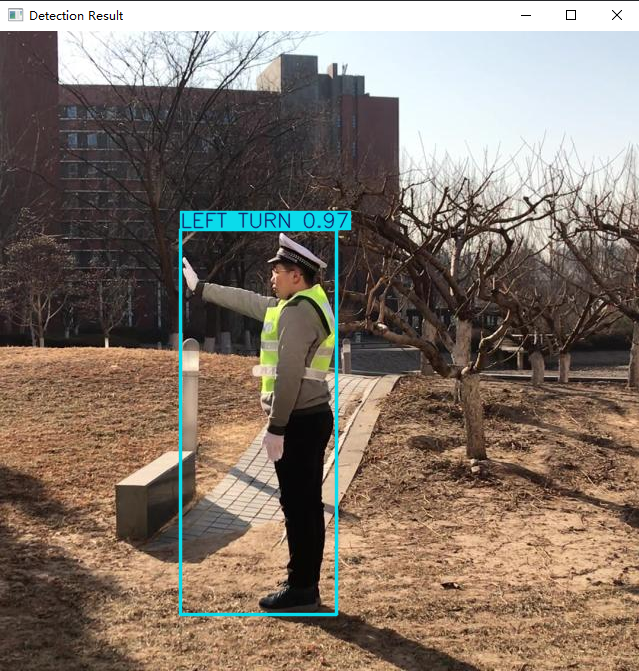

cv2.waitKey(0)执行上述代码后,会将执行的结果直接标注在图片上,结果如下:

更多检测结果示例如下:

四、可视化系统制作

基于上述训练出的目标检测模型,为了给此检测系统提供一个用户友好的操作平台,使用户能够便捷、高效地进行检测任务。博主基于Pyqt5开发了一个可视化的系统界面,通过图形用户界面(GUI),用户可以轻松地在图片、视频和摄像头实时检测之间切换,无需掌握复杂的编程技能即可操作系统。【系统详细展示见第一部分内容】

Pyqt5详细介绍

关于Pyqt5的详细介绍可以参考之前的博客文章:《Python中的Pyqt5详细介绍:基本机构、部件、布局管理、信号与槽、跨平台》,地址:

系统制作

博主基于Pyqt5框架开发了此款交警手势识别系统,即文中第一部分的演示内容 ,能够很好的支持图片、视频及摄像头进行检测,同时支持检测结果的保存。

通过图形用户界面(GUI),用户可以轻松地在图片、视频和摄像头实时检测之间切换,无需掌握复杂的编程技能即可操作系统。这不仅提升了系统的可用性和用户体验,还使得检测过程更加直观透明,便于结果的实时观察和分析。此外,GUI还可以集成其他功能,如检测结果的保存与导出、检测参数的调整,从而为用户提供一个全面、综合的检测工作环境,促进智能检测技术的广泛应用。

关于该系统涉及到的完整源码、UI界面代码、数据集、训练代码、训练好的模型、测试图片视频等相关文件,均已打包上传,感兴趣的小伙伴可以通过下载链接自行获取。

【获取方式】

关注末尾名片GZH【阿旭算法与机器学习】,发送【源码】获取下载方式

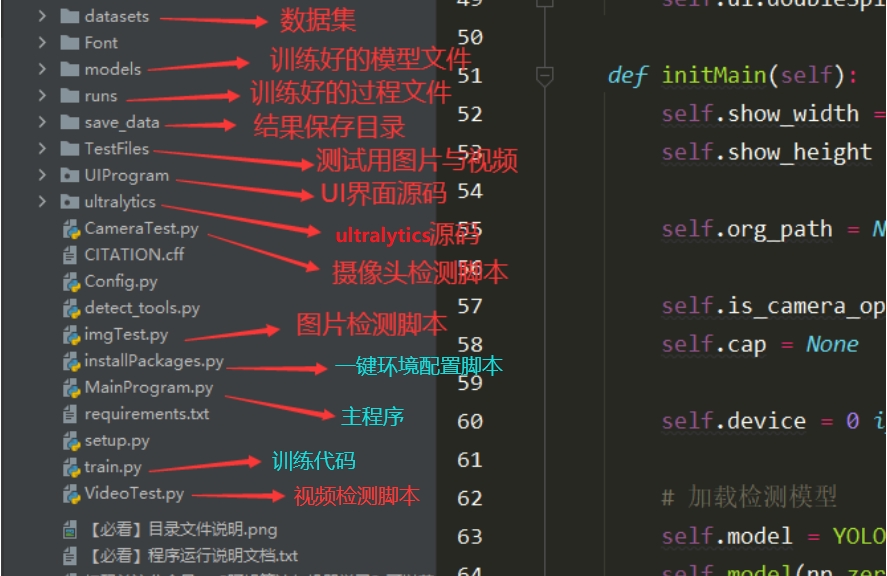

本文涉及到的完整全部程序文件:包括python源码、数据集、训练好的结果文件、训练代码、UI源码、测试图片视频 等(见下图),获取方式见文末:

注意:该代码基于Python3.9开发,运行界面的主程序为

MainProgram.py,其他测试脚本说明见上图。为确保程序顺利运行,请按照程序运行说明文档txt配置软件运行所需环境。