在计算机视觉领域,目标检测是核心任务之一,需同时完成 "识别目标类别" 与 "定位目标位置" 两大需求。传统目标检测算法多采用 "区域提议 + 分类" 的两阶段模式,虽精度尚可,但速度难以满足实时场景需求。2016 年,Joseph Redmon 等人提出的 YOLO(You Only Look Once)算法,开创性地采用单阶段检测思路,将目标检测转化为端到端的回归问题,实现了速度与精度的平衡,彻底改变了目标检测的技术格局。本文将从核心原理、组件细节、发展迭代到应用场景,全面拆解 YOLO 算法,帮你快速掌握这一经典技术。

一、YOLO 算法核心思想:单阶段端到端检测

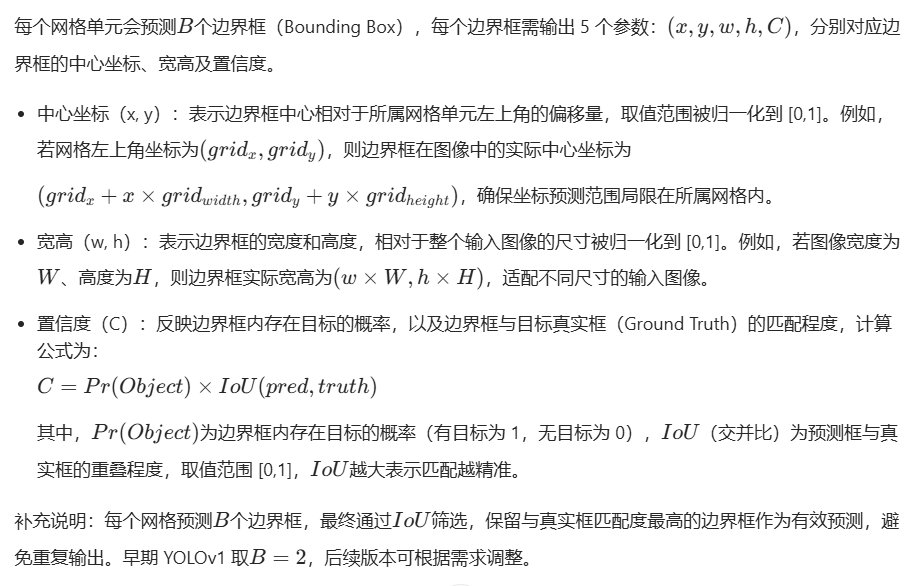

YOLO 的核心突破在于 "一次遍历完成检测"------ 与两阶段算法(如 R-CNN 系列)先生成大量候选区域、再对区域分类定位不同,YOLO 直接将输入图像送入神经网络,通过一次前向传播就输出所有目标的位置、置信度及类别概率。这种设计大幅减少了计算冗余,让算法具备实时检测能力,其核心逻辑可概括为:将图像网格化,每个网格负责预测其覆盖区域内的目标,同时直接回归目标的边界框参数与类别信息。

相较于传统算法,YOLO 的核心优势集中在三点:一是速度快,可满足实时场景(如视频监控、自动驾驶)需求;二是全局视野,基于整图特征预测,减少局部区域误判;三是端到端训练,无需单独训练区域提议、分类器等模块,模型优化更高效。

二、YOLO 核心组件详解

YOLO 算法的核心由 "网格划分、边界框预测、类别预测" 三大组件构成,各组件协同工作,实现从图像到检测结果的转化,同时搭配损失函数完成模型训练。

1. 网格划分(Grid Division):目标归属定位

YOLO 首先将输入图像均匀划分为S×S个网格单元(Grid Cell),每个网格单元负责预测其中心位置落在该网格内的目标。例如,若输入图像为 448×448 像素,取S=7,则图像被划分为7×7=49个网格,每个网格尺寸为 64×64 像素。

这种设计的核心逻辑是:目标的中心坐标决定其归属网格,该网格将全权负责该目标的边界框、置信度及类别预测,避免多个网格重复预测同一目标,同时简化目标定位的计算逻辑。

2. 边界框预测(Bounding Box Prediction):位置与置信度

3. 类别预测(Class Prediction):目标类别概率

例如,若数据集中包含 20 个类别(C=20),则每个网格会输出 20 个类别概率,与 2 个边界框的置信度结合后,可得到 40 个类别置信度,最终筛选出置信度高于阈值(如 0.5)的结果作为有效检测输出。

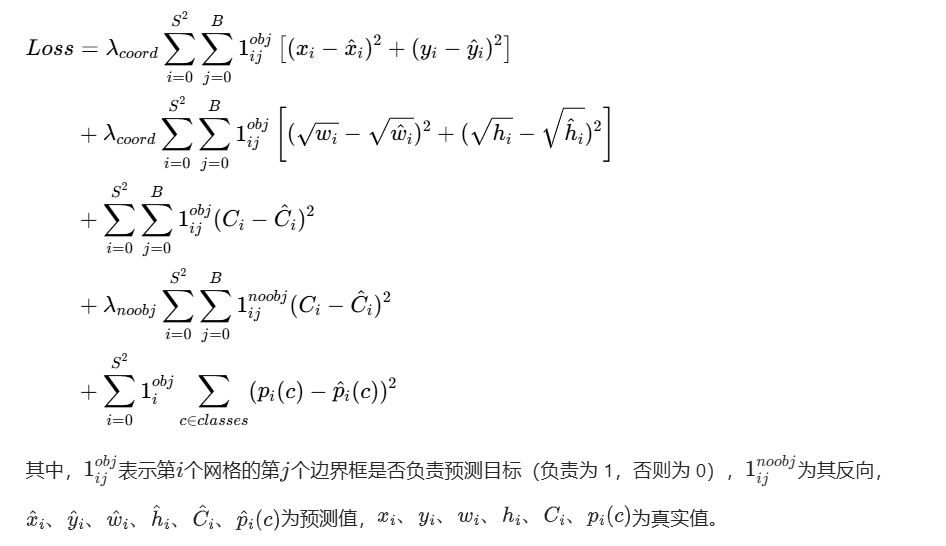

4. 损失函数(Loss Function):模型优化核心

YOLO 的损失函数采用均方误差(MSE),将边界框坐标、宽高、置信度、类别概率的误差整合为统一损失,实现端到端优化。为解决 "正负样本不平衡"(多数网格无目标)、"小目标误差敏感" 等问题,损失函数对不同部分设置了权重系数:

- 坐标误差:赋予较高权重(如λcoord=5),尤其是小目标,避免因尺寸归一化导致误差被稀释;

- 有目标边界框置信度误差:权重为 1,无目标边界框置信度误差:赋予较低权重(如λnoobj=0.5),缓解无目标网格过多导致的模型偏向性;

- 类别概率误差:权重为 1,确保类别预测的准确性。

YOLOv1 完整损失函数公式如下,更直观体现各部分权重设计:

三、YOLO 算法发展迭代:从 v1 到后续主流版本

YOLOv1 虽开创了单阶段检测思路,但存在小目标检测精度低、边界框预测不准、对密集目标处理不佳等问题。后续研究者基于 YOLO 核心思想,不断优化模型结构与策略,衍生出多个主流版本,核心迭代方向如下:

1. YOLOv2:精度与速度的平衡优化

YOLOv2 针对 v1 的缺陷进行了多项改进:引入锚框(Anchor Box)替代手动设置边界框,提升边界框预测精度;采用高分辨率输入(416×416),强化小目标特征捕捉;使用 Batch Normalization(批归一化),加速模型收敛并提升泛化能力;通过 "passthrough" 层融合浅层特征,增强小目标检测能力。

2. YOLOv3:多尺度检测与特征融合

YOLOv3 采用 Darknet-53 作为主干网络,加深网络层数以提取更丰富的特征;引入多尺度检测(3 种不同尺度特征图),分别适配大、中、小目标;将 softmax 分类器改为 sigmoid,支持多标签分类(如目标同时属于 "猫" 和 "动物");优化损失函数,用交叉熵替代均方误差计算类别损失。

3. YOLOv4/YOLOv5:工程化与效率升级

YOLOv4 引入注意力机制(如 Spatial Attention)、加权特征融合等模块,进一步提升精度;采用 Mosaic 数据增强、CIoU 损失函数,优化模型鲁棒性与边界框回归精度。YOLOv5 则更侧重工程化优化,支持动态锚框、自适应图片缩放,同时提供轻量版(YOLOv5n/s)与高性能版(YOLOv5l/x),适配不同硬件场景,成为工业界主流选择。

四、YOLO 与其他目标检测算法的对比

目标检测算法主要分为单阶段(YOLO 系列、SSD)与两阶段(R-CNN 系列、Faster R-CNN)两大类,YOLO 作为单阶段算法的代表,与其他算法的核心差异如下:

1. 与两阶段算法(Faster R-CNN)对比

Faster R-CNN 需先通过 RPN(区域提议网络)生成候选区域,再对候选区域分类定位,精度较高但速度较慢(难以达到实时);YOLO 跳过区域提议环节,一次前向传播完成检测,速度远超 Faster R-CNN(YOLOv5 可达到数百 FPS),但早期版本在小目标、密集目标检测精度上略逊于两阶段算法,后续版本通过多尺度特征融合已大幅缩小差距。

2. 与其他单阶段算法(SSD)对比

SSD(Single Shot MultiBox Detector)通过多尺度特征图预测边界框,小目标检测精度优于 YOLOv1/v2,但对上下文信息利用不足,易出现误判;YOLO 基于整图特征预测,全局视野更强,误判率更低,且后续版本融合多尺度特征后,综合性能全面超越 SSD。

五、YOLO 算法的优缺点与应用场景

1. 优点

- 实时性优异:单阶段检测逻辑,计算冗余少,YOLOv5 及后续版本在普通 GPU 上可实现实时检测(30FPS 以上),适配视频流场景;

- 端到端训练高效:无需拆分模块训练,模型优化更便捷,易迁移至不同数据集;

- 全局特征感知:基于整图特征预测,减少局部区域误判,对遮挡目标、复杂背景的适应性更强;

- 工程化成熟:后续版本迭代优化了精度与速度的平衡,提供多版本模型,适配不同硬件资源(从嵌入式设备到高性能 GPU)。

2. 缺点

- 小目标检测精度不足:网格划分对小目标不友好,若小目标中心未落在网格内,易被漏检;

- 密集目标处理不佳:每个网格仅负责预测少数边界框,密集场景下易出现目标重叠、漏检;

- 边界框回归精度有限:早期版本依赖均方误差损失,对边界框坐标的回归精度不如两阶段算法,需通过锚框、CIoU 损失等优化。

3. 典型应用场景

YOLO 凭借速度与精度的平衡,在工业界与学术界应用广泛,核心场景包括:

- 实时监控:视频流中的目标识别、异常行为检测(如人员闯入、车辆违规);

- 自动驾驶:车辆、行人、障碍物的实时检测与定位,为决策系统提供支撑;

- 智能交通:交通流量统计、车牌识别、违章车辆检测;

- 移动端 / 嵌入式设备:轻量版 YOLO(如 YOLOv5n、YOLOv8n)可部署在手机、无人机等设备,实现端侧实时检测;

- 医疗影像分析:医学图像中的病灶检测(如肿瘤、病变区域定位),辅助医生诊断。

六、总结

YOLO 算法的核心贡献在于开创了 "单阶段端到端目标检测" 的思路,打破了传统两阶段算法的速度瓶颈,实现了实时检测与精度的平衡。其三大核心组件(网格划分、边界框预测、类别预测)构建了简洁高效的检测逻辑,后续版本通过锚框、多尺度特征融合、注意力机制等优化,不断弥补精度缺陷,成为目标检测领域的主流技术。

对于学习者而言,理解 YOLO 的核心原理,不仅能掌握一种实用的目标检测算法,更能领悟 "端到端优化""特征融合" 等深度学习核心思想。无论是工业界的实时检测场景,还是学术界的算法创新,YOLO 都具有极高的学习与应用价值,后续可结合具体版本(如 YOLOv5/v8)的代码实战,进一步深化对算法的理解。