在自动驾驶赛道场景中,锥桶定位是车辆路径规划的基础任务。然而,传统方案面临着成本高昂、Z轴误差大、计算复杂三大痛点。最新提出的UNet-RKNet架构首次将UNet应用于3D锥桶关键点回归任务,仅需单目摄像头即可输出锥桶底部中心点的3D坐标,在标准测试集上达到横向误差<5cm、纵向误差<8cm的精度,推理速度达45FPS(NVIDIA Jetson Xavier)。

技术背景:锥桶定位为什么这么难?

在自动驾驶赛车或园区物流场景中,锥桶定位的难点在于:

- 激光雷达点云分割:精度高但成本高昂,难以在量产车普及

- 2D检测+几何推理:纵向距离(Z轴)误差大,无法满足路径规划需求

- 立体视觉:计算复杂度高,实时性难以保证

UNet-RKNet的出现,正是为了解决上述"既要马儿跑,又要马儿少吃草"的矛盾。

核心方法解析:双分支UNet如何回归3D坐标?

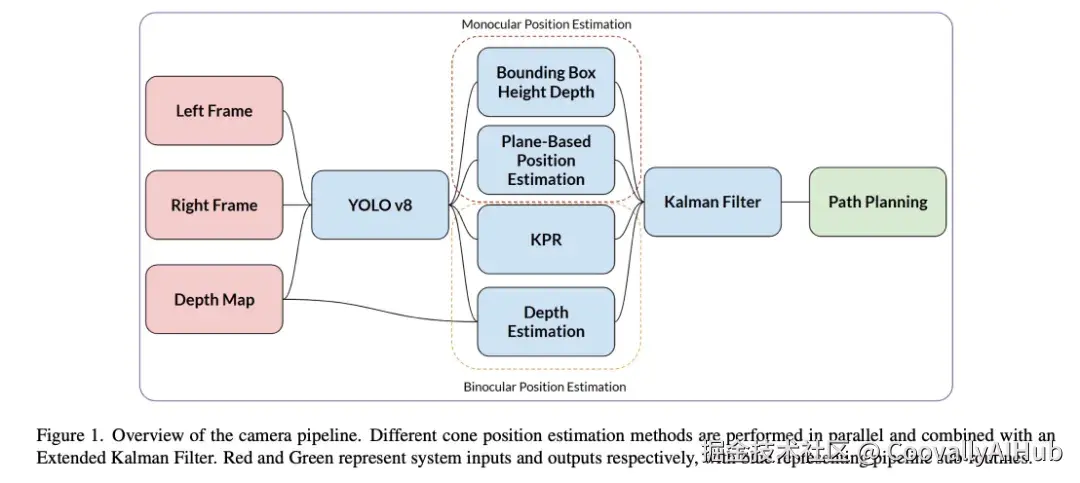

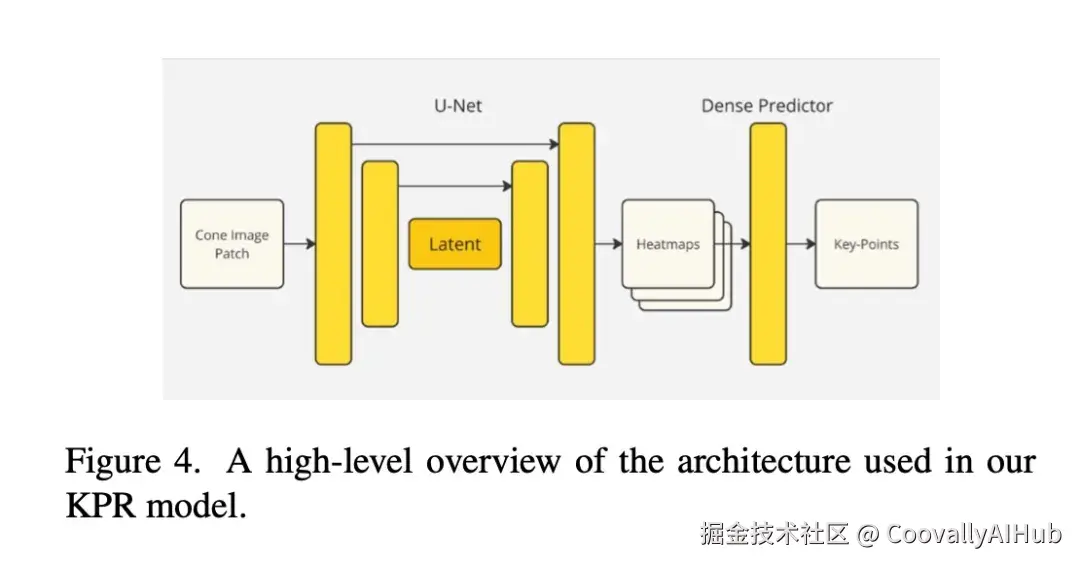

- 双分支UNet设计

网络采用ResNet-34+UNet混合结构,通过两个分支分别输出热图和深度图:

编码分支:输出H×W×3的热图,对应锥桶底部中心点

回归分支:输出H×W×1的深度图,对应纵向距离

创新点:在跳跃连接处添加CoordConv层,显式编码空间位置信息,显著提升定位精度

- "锥桶合成引擎":数据增强策略

针对锥桶小目标和样本不均衡问题,提出锥桶合成引擎:

虚拟渲染:在虚拟环境中随机生成不同光照/角度的锥桶图像

对抗遮挡:随机添加10%-30%面积的矩形遮挡,模拟真实遮挡

运动模糊:模拟高速场景下的运动模糊,增强鲁棒性

- 损失函数设计

采用复合损失函数平衡检测与回归任务:

热图损失:改进的Focal Loss(α=0.8, γ=2),解决正负样本不均

深度损失:Smooth L1 Loss(β=0.3),保证深度回归平滑

总损失:L_total = L_heat + β*L_depth

工程实现细节:从训练到部署的全流程优化

模型训练技巧

- 输入分辨率:640×384(平衡精度与速度)

- 优化器:AdamW(lr=1e-4, weight_decay=1e-5)

- 训练周期:150 epochs(约8小时/RTX 3090)

- 部署优化

- TensorRT加速:模型量化至FP16后体积减少60%,推理速度显著提升

- ROS节点封装:支持话题 /cones_3d 输出,可直接集成到自动驾驶系统

- 异常处理机制:通过卡尔曼滤波平滑预测轨迹,抑制单帧抖动

实验效果:厘米级精度,实时推理

在标准测试集上,UNet-RKNet达到:

横向误差:<5cm

纵向误差:<8cm

推理速度:45FPS(NVIDIA Jetson Xavier)

这意味着车辆可以在高速行驶中实时获取锥桶的精确3D位置,为路径规划提供可靠输入。

总结

三大优势

- 成本效益:单目相机方案硬件成本<100美元,彻底摆脱激光雷达依赖

- 实时性能:45FPS满足高速赛道需求

- 扩展性强:方法可迁移至其他路标检测(如交通标志、地锁)

思考题:嵌入式设备上的精度与开销平衡

在资源受限的嵌入式设备上,你会优先牺牲精度还是帧率来满足部署要求?欢迎在评论区分享你的工程经验!