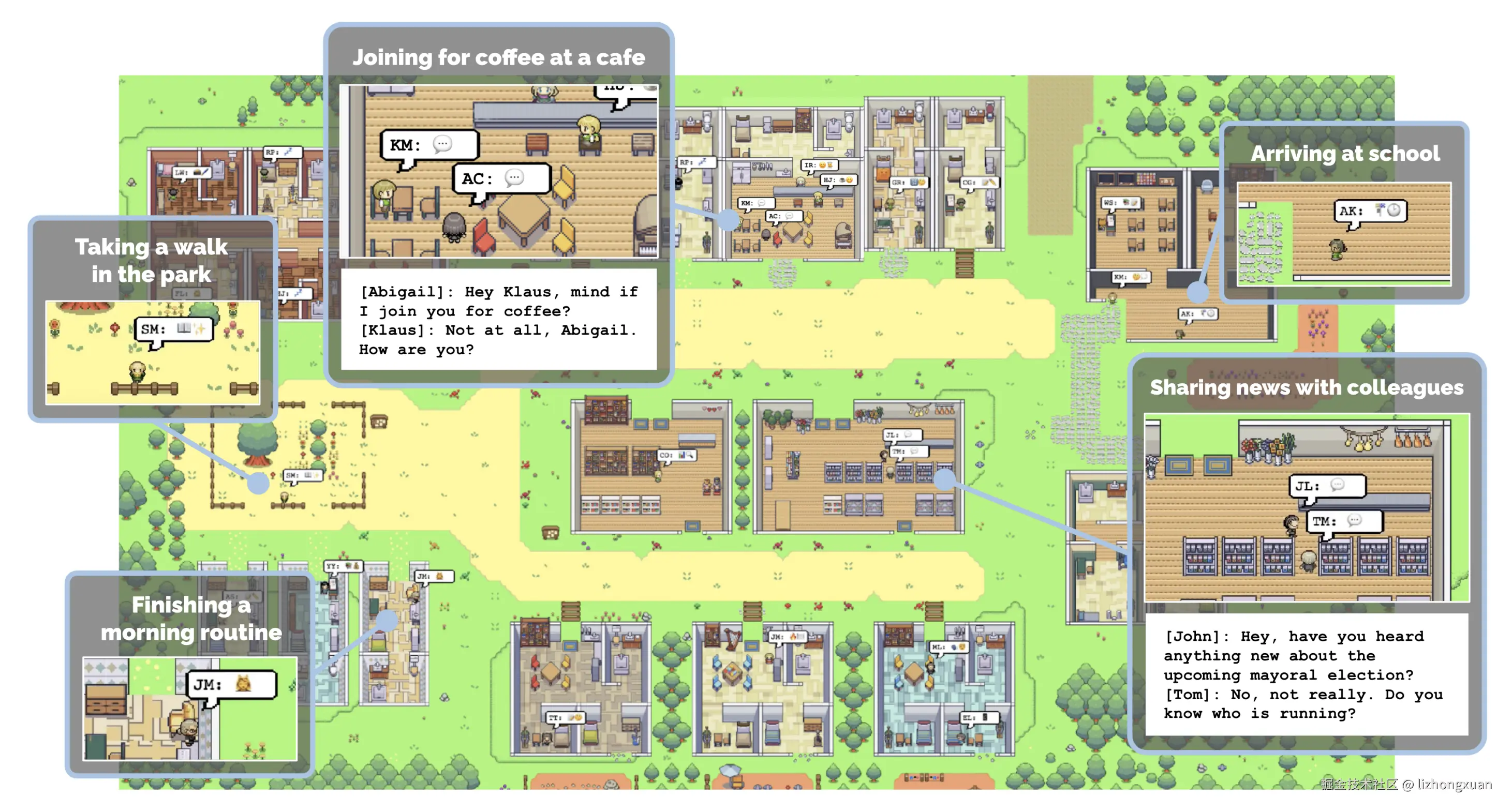

2023 年,斯坦福大学与谷歌的研究人员联合发表了论文 Generative Agents: Interactive Simulacra of Human Behavior,在 AI 领域引发了广泛关注。研究团队构建了一个名为 Smallville(斯坦福小镇) 的沙盒 RPG 世界,并在其中放入了 25 个由大语言模型(LLM)驱动的虚拟角色(NPC)。

这些 NPC 不再按照程序员预设的固定脚本运行,而是拥有自己的工作、性格和人际关系,甚至会自发组织情人节派对、互相串门八卦、在市长选举中拉票。

斯坦福小镇之所以成为 AI 发展史上的里程碑,是因为它展示了一个关键事实:当给大语言模型加入 记忆 与 自主规划 能力后,系统会涌现出复杂、逼真且令人惊叹的社会行为。

本文将从以下几个方面拆解斯坦福小镇:

- 它的核心到底是什么

- 它背后的工程设计原理

- 它最重要的底层认知架构:观察 - 记忆 - 反思 - 行动

一、斯坦福小镇的核心究竟是什么?

斯坦福小镇的核心,可以概括为三个关键词:

- 可信模拟

- 涌现性

- 自然语言计算

1. 从"脚本驱动"到"认知驱动"的可信模拟

传统游戏中的 NPC,例如《上古卷轴》或《赛博朋克 2077》中的角色,本质上依赖于 状态机(State Machine) 或 行为树(Behavior Tree)。无论设计得多复杂,只要玩家重复同样的动作,NPC 通常都会给出几种预设好的机械反应。

而 Smallville 的核心变化在于:它把 LLM 当作智能体的大脑。

这意味着角色不只是"触发脚本",而是能够:

- 听懂自然语言

- 理解当前的社会语境

- 结合自身过往经历和性格做判断

- 生成更符合逻辑的人性化反应

因此,这些角色不再只是游戏背景板,而更像是具备持续行为逻辑的数字生命。

2. 社会行为的"涌现性"

这是整个实验最迷人的部分。

研究人员并没有在代码里硬编码诸如"Isabella 必须在 2 月 14 日举办派对并邀请 Maria"这样的剧情脚本。相反,他们只是给 Isabella 设定了如下条件:

- 她喜欢社交

- 她经营一家咖啡馆

- 情人节即将到来

在这些前提下,Isabella 会自己决定举办派对、装饰咖啡馆,并在路上遇到朋友时主动发出邀请。被邀请的人也会根据自己的日程安排来决定是否参加,并把这个消息继续告诉其他人。

这就是 涌现(Emergence) :

当一组简单的个体规则彼此交织时,会自然生成复杂的群体社会现象。

3. 自然语言作为通用操作系统

在 Smallville 中,没有复杂的底层 API 作为智能体的直接操作接口。相反,系统把几乎所有状态都翻译成自然语言文本,包括:

- 环境变化,例如"咖啡机正在煮咖啡"

- 人物感受,例如"Tom 今天心情很差"

- 互动事件,例如"Maria 刚刚听说 Isabella 要举办派对"

LLM 通过处理这些文本来"理解世界",再输出自然语言形式的行动意图,最后由系统把这些意图转换成游戏引擎中的具体动作。

换句话说,在这个系统里,自然语言既是感知介质,也是推理介质,还是行动接口。

二、核心设计原理:解耦与桥接

斯坦福小镇在工程设计上最精妙的地方,在于它把:

- 物理世界(沙盒引擎)

- 意识世界(认知架构)

进行了明确解耦,并通过一个桥接层把两者连接起来。

1. 物理层:Phaser 游戏引擎

物理层负责真实可见的世界,包括:

- 渲染 2D 像素风画面

- 维护所有物品状态

- 管理 25 个角色在地图中的坐标

- 跟踪门是否打开、床是否有人、角色是否在移动等具体状态

2. 意识层:生成式代理架构

意识层运行在后端,通常是一个 Python 系统,通过 API 与 GPT-3.5 或 GPT-4 通信。它负责:

- 记忆管理

- 检索相关经历

- 推理和判断

- 生成计划

- 决定下一步行动

3. 桥接层:翻译器

桥接层的职责是把两个世界互相翻译:

- 游戏引擎把物理世界发生的事情翻译成文字,发送给意识层

- 意识层完成思考后,把行动意图再翻译回结构化指令,交给游戏引擎执行

例如:

[走到: 咖啡馆][动作: 擦桌子][对话: "你好啊"]

因此,整个系统形成了一个非常清晰的闭环:

text

物理世界 -> 文本感知 -> LLM 认知处理 -> 文本行动 -> 游戏执行三、深度拆解:感知、记忆、反思、行动的认知生命周期

为了让 LLM 像人一样"生活",单靠 Prompt 是不够的。原因很简单:

- 模型上下文窗口有限

- 模型会遗忘

- 模型缺乏长期一致的人格和目标

因此,研究团队设计了一套非常有启发性的四步认知框架,这也是 Smallville 最核心的灵魂。

1. 观察与感知(Observation / Perception)

核心问题是:"我看到了什么?"

Smallville 里的智能体并不是全知全能的上帝视角。游戏引擎只会向角色提供它在"视线范围内"能够感知到的信息。

例如,角色 John 走进厨房时,系统可能会给出这样的输入:

John 看到了冰箱(关着)John 听到了妻子在客厅唱歌

这些实时感知会立刻被转化为文本,并送入下一步处理流程。

2. 记忆流与检索机制(Memory Stream & Retrieval)

核心问题是:"这让我想起了什么?"

这是整个架构的基石。

记忆流(Memory Stream)

记忆流是一个包含角色所有经历的持续积累型数据库。每一次感知、每一段对话、每一个动作,都会被记录下来并附带时间戳,就像一个人的"人生流水账"。

检索(Retrieval)

当 John 遇到邻居 Sam 时,系统不可能把 John 一生的全部记忆都塞进模型上下文里。它必须筛选出与当前情境最相关的那部分记忆。

研究团队通过一个评分函数来选择记忆,主要考虑三个维度:

- 近期性(Recency):刚刚发生的事权重更高,通常按指数衰减

- 重要性(Importance):重大事件比日常琐事更值得记住

- 相关性(Relevance):当前情境与历史记忆之间的语义相似度更高

例如:

- "喝了一口水" 可能只值 1 分

- "和妻子大吵一架" 可能值 9 分

最终,系统会把综合得分最高的几条记忆提取出来,作为 LLM 当前生成对话和行动的上下文。

3. 反思机制(Reflection)

核心问题是:"我是个怎样的人?我有什么信念?"

如果一个角色只有零散的记忆,它会显得非常肤浅。比如它可能记得:

- 昨天去了图书馆

- 前天去了书店

- 大前天在看文学书

但如果别人问它"你的爱好是什么",它不一定能回答出来,因为这些信息还只是碎片。

反思机制的作用,就是把这些碎片整理成更高层次的自我认知。

反思的触发

当角色积累了足够多的重要记忆后,系统会在后台触发一次反思。

归纳与升华

系统会让 LLM 回看最近的一批记忆,并提出类似这样的问题:

根据这些记忆,你能得出关于这个角色的什么高层次结论?

生成新的高级记忆

模型可能会总结出:

John 是一个非常热爱文学和阅读的人。

这条结论随后会作为一条新的、高级别记忆重新写回记忆流。

正是这个机制,让角色逐步形成:

- 价值观

- 连贯的人格

- 更稳定的自我认知

也正因为如此,Smallville 的 NPC 才会显得更像"有灵魂的个体"。

4. 计划与反应(Planning & Reacting)

核心问题是:"我接下来该做什么?"

如果让 LLM 每隔 1 秒钟都重新决定一次动作,它很快就会行为混乱。真实的人类行为不是纯粹的即时反射,而是带有长期目标和阶段计划的。

自上而下的分解式规划

每天早晨,系统会根据角色身份和性格,先生成一份粗粒度日程,例如:

- 7 点起床

- 9 点去药店上班

- 18 点吃晚饭

- 22 点睡觉

随着时间推进,系统会把粗粒度日程继续细化。例如"去药店上班"可以被分解为:

09:00开门09:10清点库存10:00站到收银台前

反应与修正

计划并不是刚性的。

如果 John 正在清点库存时,突然观察到"药店着火了",系统就会立即:

- 触发新的观察输入

- 检索与危险、紧急事件相关的记忆

- 打断当前计划

- 生成新的行动

例如:

- 停止清点库存

- 拨打火警电话

- 迅速跑出药店

这说明 Smallville 的角色并不是只会"照表演出",而是能在突发事件中动态修正行为。

四、斯坦福小镇的深远意义与未来展望

斯坦福小镇绝不仅仅是一个有趣的沙盒游戏实验,它更像是通往通用人工智能道路上的一次重要工程探索。

1. 重塑游戏与元宇宙行业

未来的游戏世界不一定需要大量编剧手工编写海量分支剧情。只要开发者构建好:

- 世界观

- 角色设定

- 初始记忆

- 基础规则

整个世界就可能自然运转起来。

这意味着每个玩家进入游戏时,看到的都可能是一个独一无二、持续演化的社会生态。

2. 社会科学的终极模拟器

这种架构不仅能用于娱乐,也可能成为社会科学研究工具。

例如,研究者可以在虚拟社会中测试:

- 提高税收会带来什么连锁反应

- 发布一条假新闻会引发怎样的群体情绪变化

- 某种政策会如何影响合作、竞争和信任

这种能力对经济学家、社会学家和政策制定者都极具价值。

3. 大模型能力的工程化落地

Smallville 还证明了一点:大模型的能力瓶颈,往往不只在模型本身,也在于外部系统是否为它提供了合适的认知工程框架。

真正让模型看起来"像一个有心智的角色"的,不只是 Prompt,而是这些组件的组合:

- 记忆

- 检索

- 反思

- 规划

当这些模块组合在一起时,原本只能做"文字接龙"的模型,就开始具备了模拟人类日常生活的能力。

结语

斯坦福小镇的灯光依然在虚拟服务器中闪烁。

它不仅是一场代码实验,更像是一扇窗口,让我们得以窥见数字生命如何在合适的认知架构中逐步演化。它告诉我们,未来真正重要的,可能不只是更强大的模型,而是如何为模型构建一个能承载记忆、反思、计划与社会互动的世界。