【新智元导读】OpenClaw 推出 v2026.3.7-beta.1,史上最密集一次更新:89 项提交、200+Bug 修复,核心亮点是全新 ContextEngine 插件接口------上下文管理终于可以「自由插拔」,不动核心代码就能换策略。这次更新值得每一个做 AI Agent 的人认真看。

龙虾热之后,OpenClaw 在国内的热度直线飙升。

就在刚刚,OpenClaw 官方发布了全新 v2026.3.7-beta.1 版本,创始人 Peter Steinberger 亲自下场在 X 上高调官宣。

89 项代码提交,200 + 个 Bug 修复,全新的 ContextEngine 插件接口,GPT-5.4 与 Gemini 3.1 Flash 双首发适配------这一刀,切得非常稳。

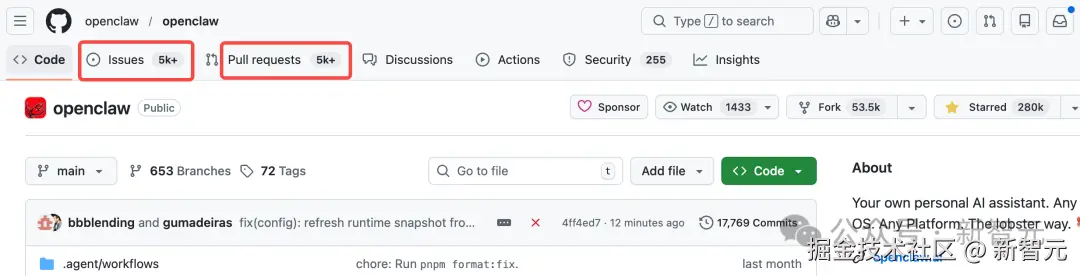

顺带一提,OpenClaw 不仅 Star 数狂飙冲向 3w+,而且 issues 和 pr 数量也是冠绝全球。

OpenClaw,可以说是开源的一次里程碑,也可以看作是全世界极客们的封神制作。地球上有什么项目能够联合如此多的狂热极客们?

废话不多说,先来看下这次都更新了什么。

OpenClaw 变更最密集的一次更新

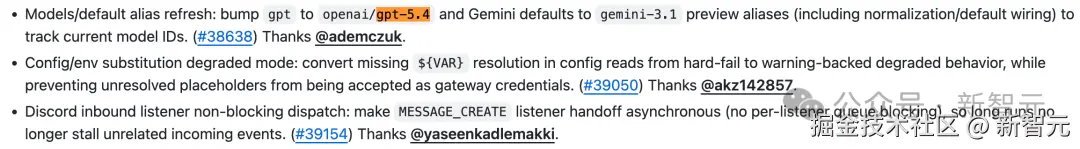

看点一:GPT-5.4+Gemini 3.1 双引擎上线

新版全面适配了 OpenAI 最新的 GPT-5.4 以及 Google 的 Gemini 3.1 Flash。

在模型切换层面,OpenClaw 还优化了模型降级与重试机制------当某个模型限流或过载时,系统会自动切换到备选模型,而不是直接报错让用户干等。

这意味着什么?你可以把 OpenClaw 想象成一个「模型路由器」。前端对接的是你习惯的聊天工具,后端则可以灵活挂载 Claude、GPT、Gemini、DeepSeek 等任意大模型。哪个好用用哪个,哪个便宜切哪个。这种架构的灵活性,是单一厂商的 AI 助手做不到的。

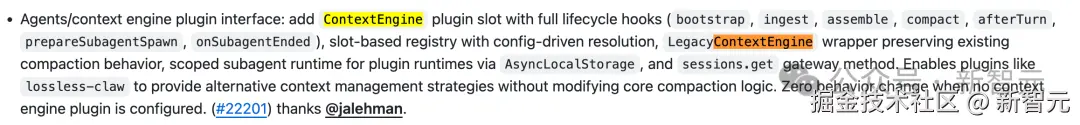

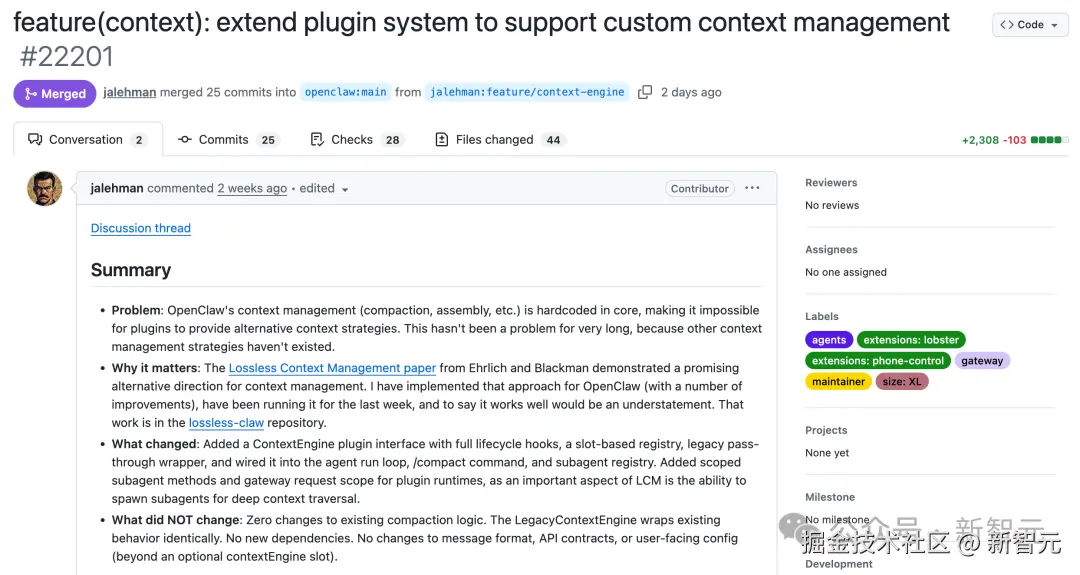

看点二:ContextEngine------开发者等了很久的东西

这次最硬核的技术亮点,是全新推出的 ContextEngine 插件接口。

做过 AI 应用的朋友都知道,上下文管理是智能体开发中最让人头疼的问题之一。

对话轮次一多,token 就炸;信息一压缩,关键细节就丢。

OpenClaw 这次开放了一组完整的生命周期钩子:bootstrap(初始化)、ingest(注入)、assemble(组装)、compact(压缩)、afterTurn(回合后处理),甚至包括 prepareSubagentSpawn(子智能体生成前)和 onSubagentEnded(子智能体结束后)。

翻译成人话:开发者现在可以在不修改 OpenClaw 核心代码的情况下,完全自定义上下文的处理逻辑。你想用 RAG?可以。想做激进压缩?随意。想让不同子任务拥有隔离的记忆空间?接口都给你准备好了。

这对整个社区生态的意义是巨大的------它把 OpenClaw 从一个工具变成了一个平台。

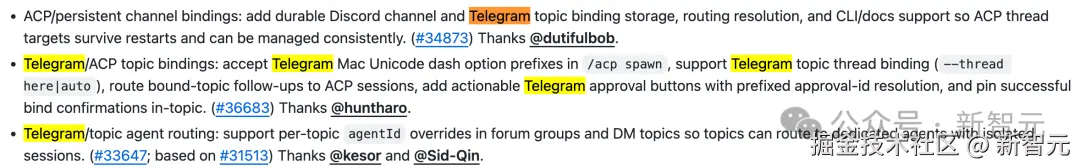

看点三:Discord+Telegram 深度整合

多渠道一直是 OpenClaw 的核心卖点,而这次更新在两个最活跃的社区平台上做了重大升级:

Discord 端修复了断连后无法恢复的死机问题,优化了频道解析和机器人心跳检测。Telegram 端新增了主题级别(Topic)的智能体路由隔离------这意味着你可以在同一个 Telegram 群组的不同主题里,分别运行不同的 AI 智能体,互不干扰。

同时,两个平台都新增了持久化频道绑定功能。以前重启 OpenClaw 后,频道绑定关系可能丢失;现在这个状态会被持久化存储,重启后自动恢复。

看点四:200 多项 Bug 修复,几乎翻修了一遍

这次的修复清单长得让人咋舌。粗略分类一下:

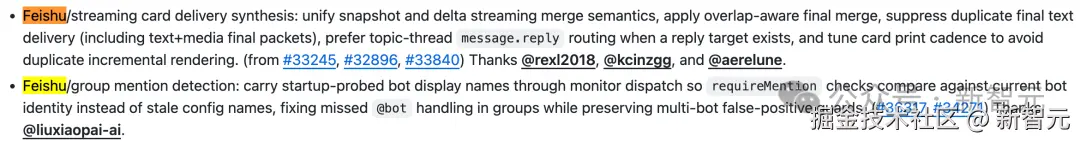

渠道层面,覆盖了 Telegram 草稿流重复、Discord 断连死机、Slack 消息路由、飞书 Webhook 兼容性、WhatsApp 自聊天前缀注入、iOS/macOS 端的各种边界情况。

核心智能体层面,修了工具调用的参数解析问题(包括 xAI 的参数解码)、上下文压缩时的截断提示丢失、OpenAI 流式输出的兼容性。

网关与内存层面,解决了 Token 防连环掉线、QMD 内存检索去重、SQLite 锁冲突。

安全层面,包括依赖库的安全升级(Hono、tar 等)、沙盒逃逸防范、系统命令执行的白名单鉴权。

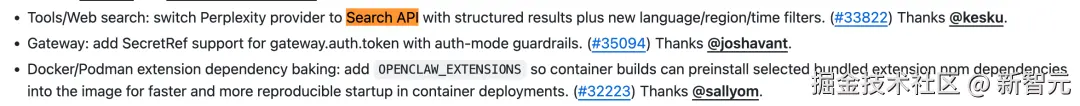

此外,新版还引入了西班牙语界面支持、将 Web 搜索功能升级为更强的 SearchAPI,以及通过 Docker 多阶段构建优化了镜像体积和启动速度。

89 项更新是什么概念?

先给不熟悉的朋友再补个课:OpenClaw 是什么?

简单说,它是目前开源社区里影响力最大的 AI Agent 框架之一,可以理解为让 AI 帮你打工的底层平台。

你可以把它部署在自己的服务器上,连上各种大语言模型,再接入 Slack、Discord、Telegram、飞书等渠道,让 AI Agent 替你处理用户消息、执行任务、管理上下文,甚至协调多个智能体协同作战。

它的开源属性,是它最大的杀手锏。你不需要向任何厂商交租子,数据在自己手里,连接哪个模型你说了算。

这次 3.7 beta,89 项代码提交不是堆数字玩,每一条都实打实------

最重头的一条:ContextEngine 插件接口上线。

对开发者来说,上下文管理是 AI Agent 工程中最头疼的问题。当对话轮次多了,Token 堆积超出模型窗口限制,你要么截断、要么压缩、要么想其他办法。而这些处理逻辑一旦写死在核心代码里,日后每次调整都是高风险手术。

OpenClaw 3.7 的 ContextEngine 接口,解决的就是这个问题。

它给开发者提供了全生命周期的上下文管理能力,允许你在不动底层核心逻辑的前提下,插入自定义的压缩策略。用官方的话说,这叫零阻碍接入。

翻译成人话:以后换个上下文处理算法,像换插件一样简单,不用再担心改一处崩全程。

开发者社区的反应很直接------项目 Issues 下面,有人评论等这个接口等了快半年,点赞数秒过百。

200 + 个 Bug 修复,这才是硬核

一个开源项目能不能长线运营下去,Bug 修复的密度和质量是照妖镜。

这次 3.7 beta,官方更新日志在 Fixes 板块下拉出了 200 多条具体修复记录,覆盖了平台几乎所有核心模块。

当大语言模型的能力已经足够强,那么如何把它真正用起来这件事的门槛,决定了谁能先跑起来。OpenClaw 解决的,正是跑起来这一步。

龙虾爆红,引爆的不只是某个产品的热度,而是整个自托管 AI Agent 赛道的关注度。

创始人的气质

一个有点跩的开源人

说说 Peter Steinberger 这个人,非常有必要。

他是 iOS 开发者出身,当年靠 PSPDFKit(PDF 处理 SDK)在欧洲独立开发者圈出了名,后来转型做 AI,带着小团队把 OpenClaw 做起来,成了开源 AI Agent 领域的知名项目。

他的 X(推特)账号风格很典型:高度技术化、直接、偶尔毒舌。这次 3.7 Beta 发布,他的配文是:我不记得上次有哪个版本有这么多提交了。但这是值得的。这种克制中的自信,在开源社区里有自己的分量。

更关键的是,他带领的团队在市场推广上几乎不花时间,靠的是产品质量和社区口碑滚起来的。这在当下 AI 圈一半做产品一半做 PR 的环境里,显得有点异类。

好的底层工具不需要等待大厂推荐,真实场景的使用者会替你传播。

下一个版本还能期待什么?

从这次 3.7 beta 的更新方向,能推断出几个未来值得关注的点:

多语言界面扩展加速。

这次新增了西班牙语界面,背后的逻辑是 OpenClaw 正在有意拓展非英语市场。中文界面的全面支持,如果做好,对国内用户的吸引力将是数量级的提升。

模型生态接入继续扩大。

GPT-5.4 和 Gemini 3.1 Flash 的首发适配是信号,说明主流大模型实验室已经开始主动配合 OpenClaw 推进适配工作,这个生态飞轮一旦转起来,壁垒会越来越高。

企业级稳定性持续补课。

200 + 的 Bug 修复说明社区使用量在高速增长,问题暴露越多说明用户越多。这个阶段的修复密度,是在为下一阶段的企业大客户打地基。

插件生态的爆发点将至。

ContextEngine 接口正式开放后,第三方开发者会开始贡献各种上下文管理插件。这是 OpenClaw 从一个框架变成一个平台的关键拐点。

尾声:开源的边界在哪里?

OpenClaw 的故事,某种程度上是开源如何对抗大厂闭源产品的一个截面。

大厂的优势显而易见:超强算力、一流团队、巨大用户基础、精美的产品体验。这些都是小团队很难在短期内追平的。

但开源有一个大厂始终无法复制的东西:信任。

当你把 AI 部署在自己的服务器上,当你可以随时查看源码、随时修改逻辑、随时切换模型------这种控制感,是大厂产品永远给不了的。

越来越多的工程师和创业者,也在做同样的选择。

OpenClaw 3.7 这次更新,或许没有改变什么赛道格局,但它实实在在地让这个工具更稳了、更开放了、更可信了。

而可信,在 AI 时代,是稀缺品。

你的下一个 AI 工具,会把数据交给大厂,还是留在自己手里?

参考资料: