据说第一批养龙虾的人已经后悔了。因为养不起了。

OpenClaw 是个开源智能体,下载和安装都不花钱,但是要养它,那就要狠狠地烧Token了。

因为龙虾的费用不只来自核心模型回复,还有网页读取、记忆检索、压缩总结、工具调用,以及系统提示里塞进去的 workspace 文件和 bootstrap 配置,上下文一长,账单冷不丁就是梆梆两拳。

用 Claude Sonnet 跑 OpenClaw,单月累计一千万输入加一千万输出 token,光费用就接近上百美元。真把它当全天候执行 Agent、用高阶模型跑难度较高的任务,一个月烧掉几千块也不奇怪了。就比如 OpenRouter 处理的 token 量从每周 6.4 万亿直接涨到 13 万亿。

本来想让AI帮自己打工,结果工资全上交给了AI。

因为云端 Token 的支出太贵了,所以本地化运行就是一个不错的选择。OpenClaw 与 Ollama 配合食用。

Ollama 负责在本地机器上运行 Llama、Mistral 或 DeepSeek 等开源模型,API 不就降下来了嘛。除了显卡的风扇转得快点,没其他毛病,而且所有私有数据和代码处理都留在本地,无需上传至云端,在实现成本可控的同时,也保障了隐私安全。

实战:OpenClaw 与 Ollama 的本地结合

OpenClaw 是一个基于 Node.js 开发的框架,要求环境必须使用 Node.js 22 或更高版本。

那可以选择 ServBay 来部署 Node.js 环境。

作为一个本地 Web 开发环境管理工具,ServBay 能够管理不同版本的 Node.js。通过其图形化界面,用户就可以快速切换到 Node.js 22 环境,避免了手动配置环境变量或处理版本冲突的过程。

在环境准备就绪后,通过简单的命令即可完成 OpenClaw 的部署。

bash

curl -fsSL https://molt.bot/install.sh | bash

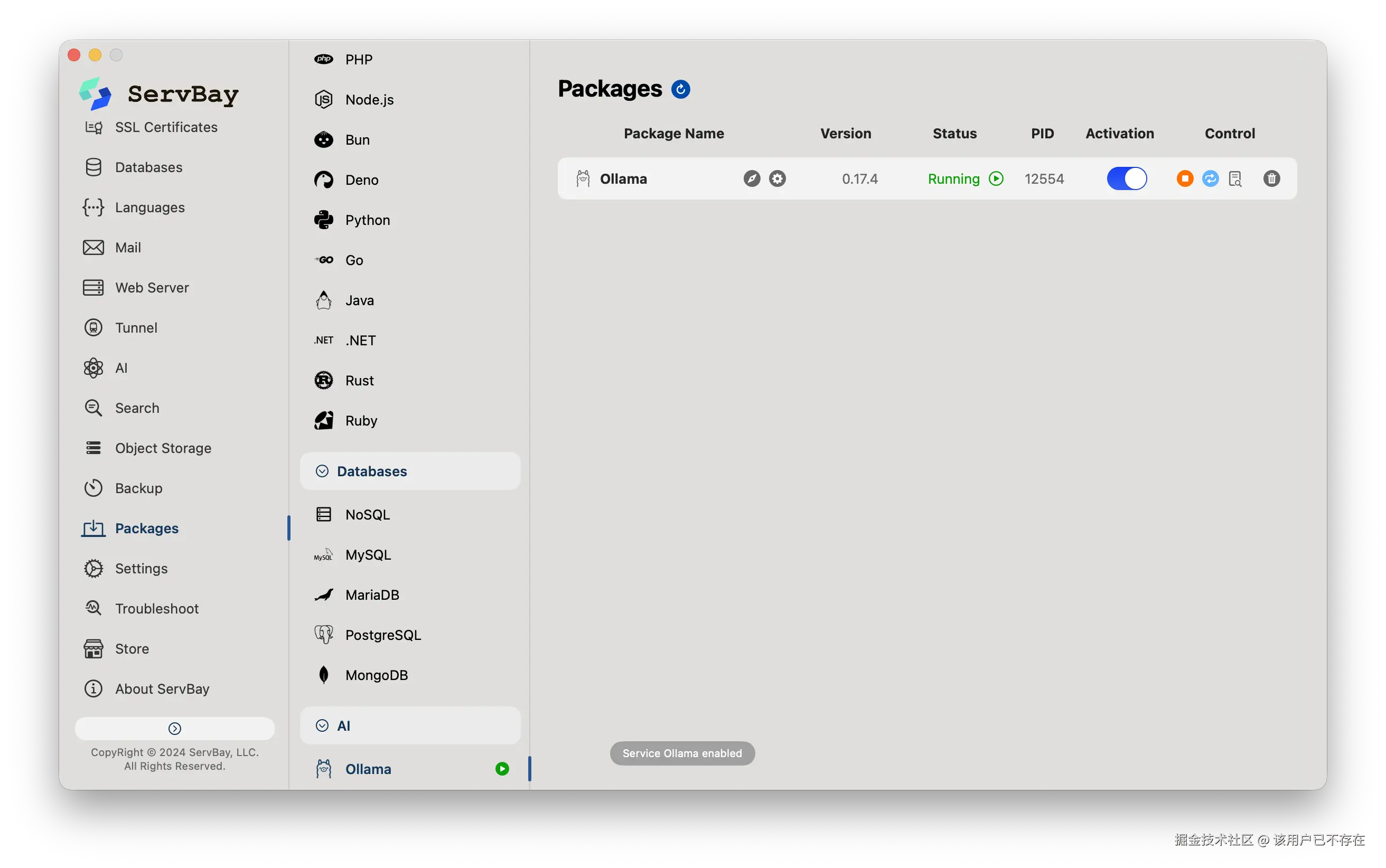

openclaw onboard --install-daemon还是通过 ServBay,可以一键下载并安装Ollama。

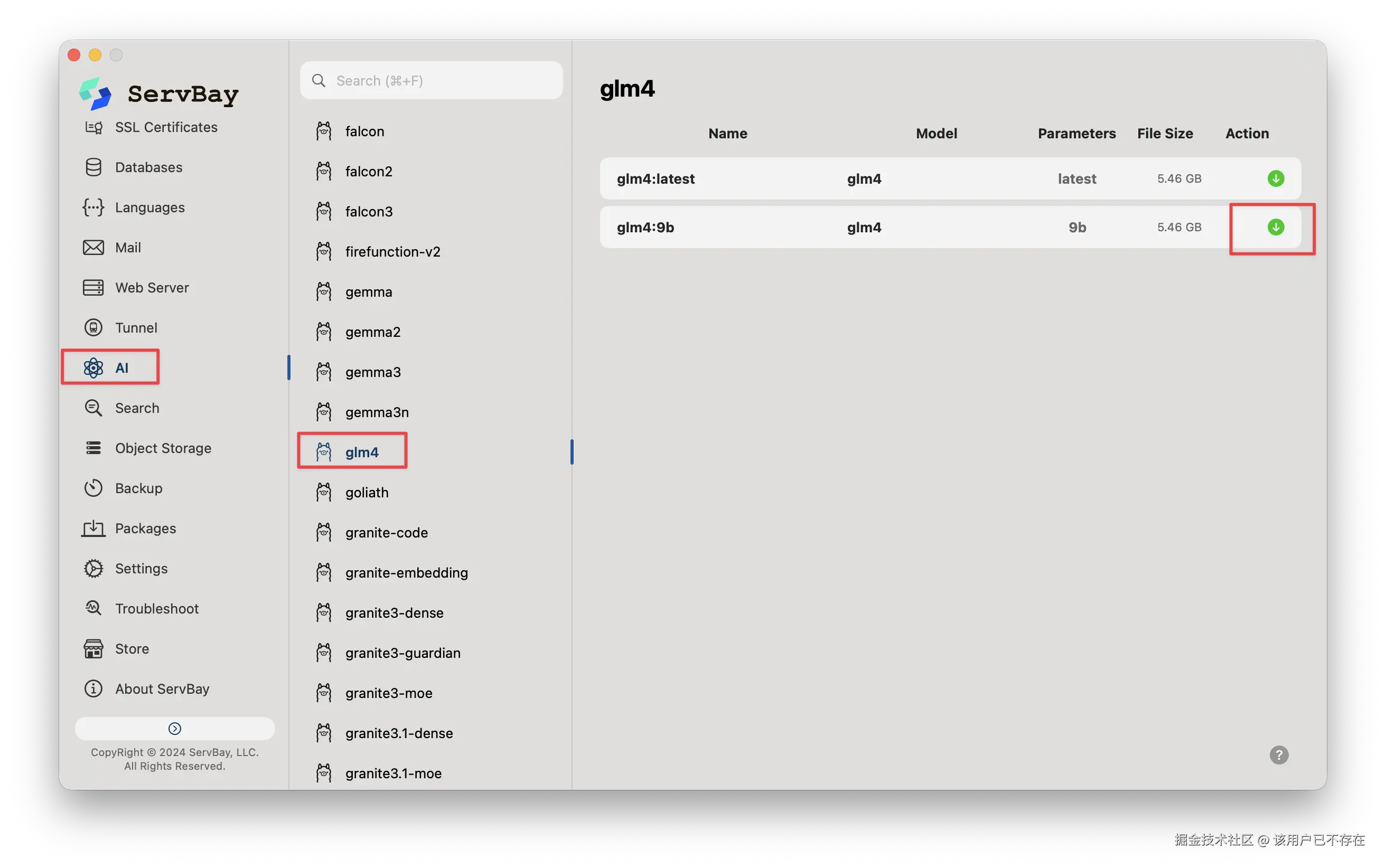

然后在 ServBay 左侧的菜单栏中,选择合适的大模型下载即可。

OpenClaw 并不直接具备思考能力,它需要通过以下命令连接 Ollama:

bash

ollama launch openclaw这个命令会将 OpenClaw 配置为使用本地 Ollama 提供的模型。

安全防护:Git 兜底与权限控制

当 AI 获得系统操作权限时,安全风险也随之升级。相信大家也没少看 OpenClaw 误删邮件的新闻。

一个拥有执行权限的智能体如果误解了指令,会对系统造成破坏。为了应对这些潜在风险,我们要做好防护机制。

Git 作为安全网

OpenClaw 建议将整个工作空间(包括配置文件和记忆日志)纳入 Git 管理。

bash

git init

git add AGENTS.md SOUL.md memory/

git commit -m "初始化智能体工作空间"如果智能体在执行任务时安装了错误的技能,或者对配置文件进行了异常修改,开发者可以利用 git revert 快速将系统状态回滚到安全的时间点。这种版本控制化的演变让 AI 的行为变得透明且可逆。

权限限制与沙箱模式

智能体的能力来源于技能系统。为了防止第三方技能携带恶意代码,在安装前应人工审核其源代码,确认其执行的命令。此外,对于处理复杂任务的智能体,建议将其运行在虚拟机或 Docker 容器等隔离环境中。

身份验证与私有访问

Gateway 服务不应直接暴露在公网。安全的做法是开启网关认证,并通过 openclaw doctor 进行风险诊断。在远程访问时,配合 VPN 或内网穿透工具,确保只有授权用户能向智能体发送指令。

总结

OpenClaw 挺好的,拿来做一个玩具还行,但是真正要它成为一个24小时的雇员,成本和风险都还是挺高的。