一、前言

一家来自杭州的中国AI公司,在2023年成立后迅速崛起,以惊人的成本效益挑战着OpenAI、Anthropic等硅谷巨头 。其核心产品DeepSeek-V3凭借独特的混合专家架构和创新的训练策略,在多项基准测试中达到了与GPT-4o、Claude-3.5-Sonnet相当的水平。

更令人瞩目的是,它仅用278.8万H800 GPU小时就完成了训练,总成本约557.6万美元------这个数字在动辄数千万甚至上亿美元的大模型训练成本中,显得格外"经济"。

二、技术架构:效率与性能的平衡艺术

DeepSeek的技术路线选择体现了对"性价比"的极致追求。与盲目堆砌参数不同,它通过精巧的架构设计,在保持高性能的同时大幅降低了计算成本。

2.1 混合专家架构

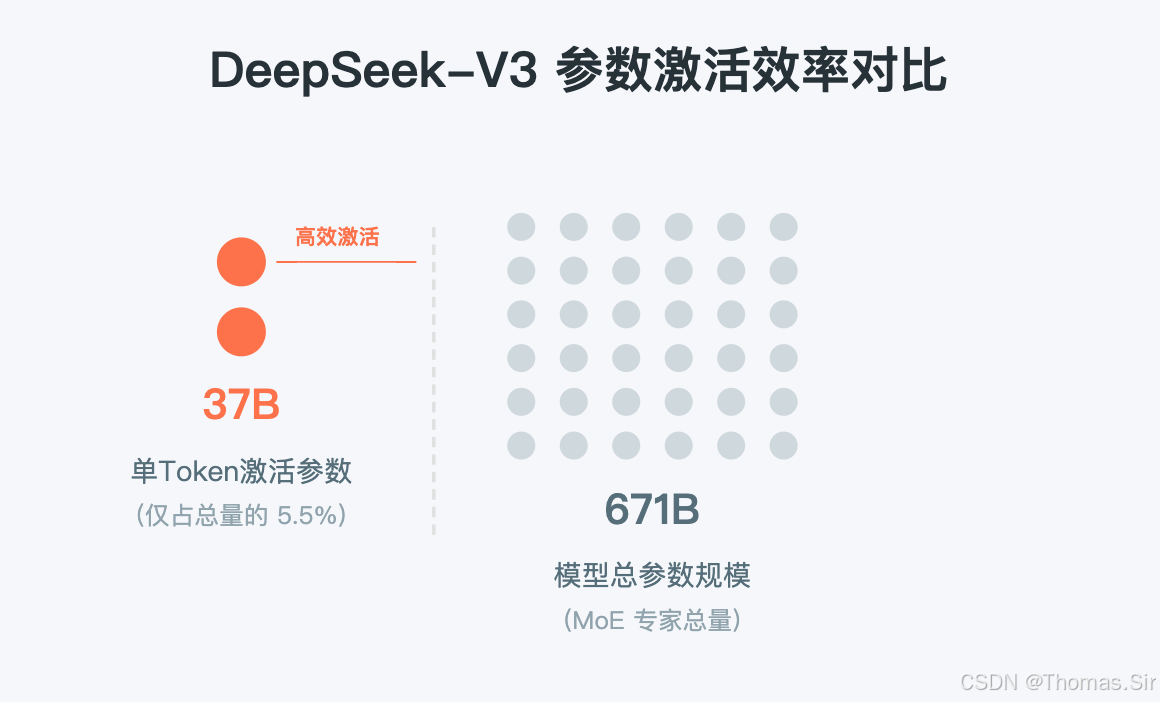

DeepSeek-V3采用6710亿参数的混合专家模型,但每个token只激活370亿参数。这种"稀疏激活"策略类似于大脑的运作方式------不需要同时动用所有神经元,而是根据任务需求智能选择最相关的专家网络。

2.2 多头部潜在注意力

MLA架构在DeepSeek-V2中已验证有效,V3继续沿用这一设计。与传统注意力机制相比,MLA通过共享键值对来减少计算量,同时保持模型的表达能力,实现了推理效率的显著提升。

2.3 无辅助损失负载均衡

这是DeepSeek-V3的创新之一。传统MoE模型需要额外的损失函数来平衡专家使用率,但这可能损害模型性能。V3通过架构层面的优化,在不添加辅助损失的情况下实现了良好的负载均衡。

三、性能表现:开源模型的里程碑

在权威基准测试中,DeepSeek-V3展现出了令人印象深刻的性能。特别是在数学和代码领域,它甚至在某些任务上超越了部分闭源模型。

| 测试领域 | 基准测试 | DeepSeek-V3得分 | 对比表现 |

|---|---|---|---|

| 知识理解 | MMLU | 88.5 | 超越所有开源模型,接近GPT-4o水平 |

| 专业问答 | GPQA | 59.1 | 在开源模型中领先 |

| 数学推理 | MATH-500 | 超越o1-preview | 在特定基准上表现优异 |

| 代码生成 | LiveCodeBench | 领先水平 | 在编程竞赛基准中表现最佳 |

四、模型演进:从V2到R1的持续进化

DeepSeek的迭代速度令人瞩目。从2024年6月的V2到12月的V3,再到2025年的R1推理模型,每个版本都有显著的能力提升。

- 2024年6月:DeepSeek-V2发布,在Arena-Hard测评中对战GPT-4-0314的胜率从41.6%提升到68.3%

- 2024年9月:V2.5模型发布,Chat和Coder模型合并,通用能力和代码能力显著提升

- 2024年12月:DeepSeek-V3正式发布,采用671B MoE架构

- 2025年1月:DeepSeek-R1推理模型推出,支持思维链生成

- 2025年3月:V3-0324版本在MMLU-Pro上从75.9提升到81.2,数学能力大幅增强

- 2025年5月:R1-0528版本发布,AIME 2025得分从70.0跃升至87.5

- 2025年8月:V3.1采用混合推理架构,一个模型同时支持思考与非思考模式

4.1:V3基础模型

671B参数MoE架构,37B激活参数,128K上下文长度

4.2:R1推理模型

专门优化思维链生成,在复杂推理任务上表现突出

4.3:API 服务架构

支持硬盘缓存技术,大幅降低API调用成本

五、创新亮点:技术突破与工程实践

DeepSeek的成功不仅在于模型性能,更在于其在工程实现上的多项创新。这些技术突破为大模型训练提供了新的思路。

5.1:FP8混合精度训练

首次在超大规模模型上验证FP8训练的有效性,通过支持FP8计算和存储,实现了训练加速和GPU内存使用减少的双重效益。

5.2:DualPipe流水线并行

设计DualPipe算法减少流水线气泡,通过计算-通信重叠隐藏大部分通信开销,即使模型规模进一步扩大,只要保持恒定的计算-通信比,仍能实现接近零的全对全通信开销。

5.3:多token预测目标

采用多token预测训练目标,不仅提升了模型在评估基准上的整体性能,还可用于推测解码以实现推理加速。

5.4:从R1蒸馏推理能力

创新性地从DeepSeek-R1系列模型的长思维链中蒸馏推理能力到标准LLM,将R1的验证和反思模式优雅地融入DeepSeek-V3,显著提升了其推理性能。

六、生态影响与未来展望

DeepSeek的出现正在改变开源AI的竞争格局。其"长期主义"的开源路线和极致的成本控制,为更多研究机构和小团队提供了接触前沿AI技术的机会。

6.1:对行业的影响:DeepSeek证明了通过算法、框架和硬件的协同设计,完全可以在有限预算内训练出世界级的大模型。这打破了"大模型必须烧钱"的迷思,为AI民主化提供了新的可能性。

6.2:技术局限性:尽管性能出色,DeepSeek-V3在部署上仍面临挑战。为确保高效推理,推荐的部署单元相对较大,可能对小规模团队构成负担。此外,虽然推理速度已是DeepSeek-V2的两倍以上,但仍有进一步提升空间。

6.3:未来方向:DeepSeek团队计划在多个方向持续投入:改进模型架构以支持无限上下文长度、突破Transformer的架构限制、迭代训练数据的数量和质量、探索更全面的多维模型评估方法等。

七、与GPT-4对比分析

7.1、架构与效率:两种不同的哲学

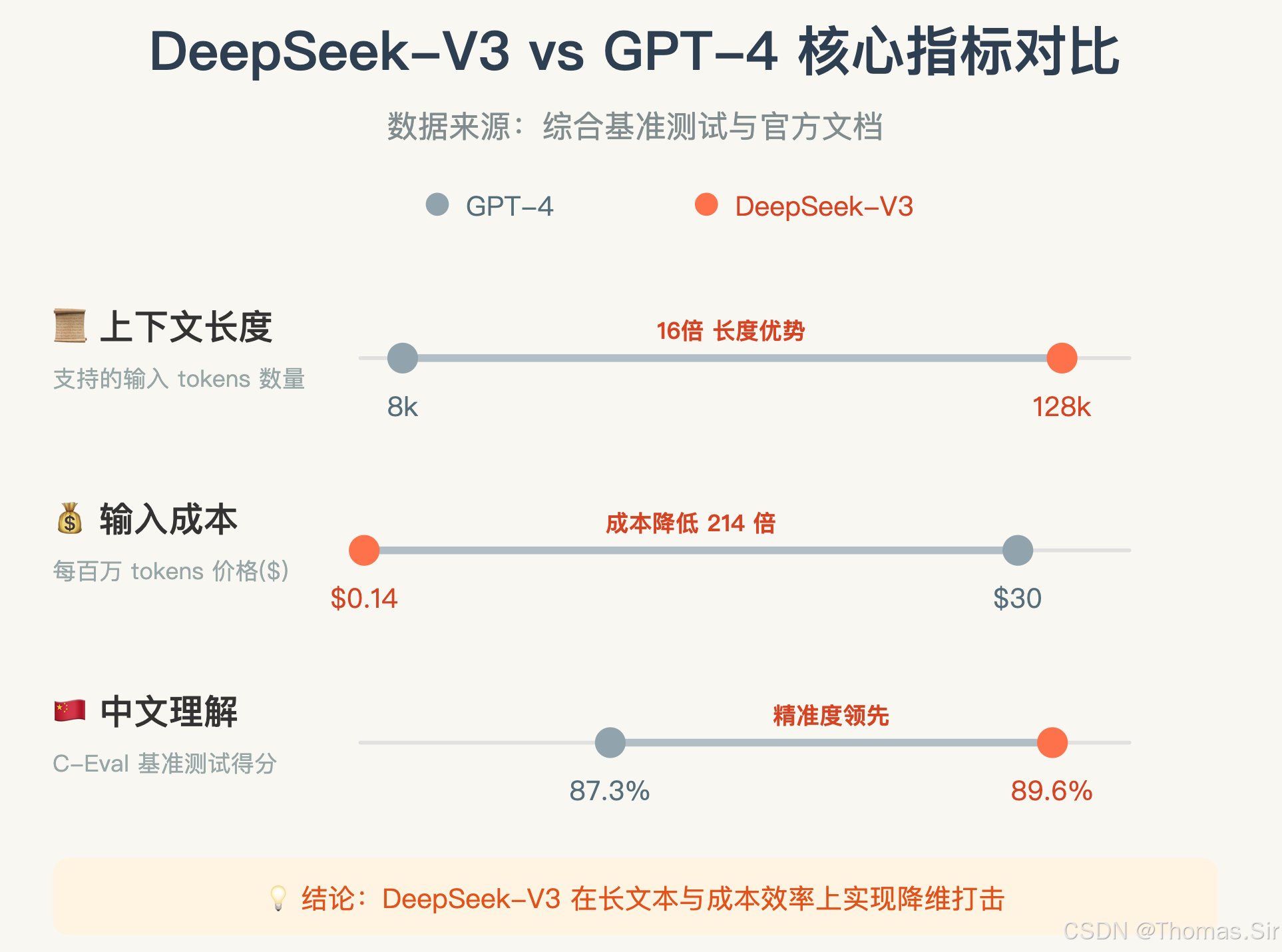

DeepSeek-V3与GPT-4选择了截然不同的技术路径,这直接决定了它们在性能、成本和适用场景上的差异。

混合专家 vs 稠密模型

DeepSeek-V3 采用创新的混合专家架构,总参数达6710亿,但每个token仅激活370亿参数。这种"稀疏激活"策略类似于大脑的运作方式,只在需要时调用相关专家网络,大幅降低了计算成本。

成本与能耗的悬殊差距

GPT-4 作为传统的稠密模型,训练成本高达数千万甚至上亿美元。而DeepSeek-V3仅用278.8万H800 GPU小时完成训练,总成本约557.6万美元,实现了惊人的成本效益。

7.2、性能实测:各有所长的能力版图

在多项基准测试中,两个模型展现出了不同的优势领域,形成了互补的能力图谱。

| 测试项目 | DeepSeek-V3 | GPT-4 | 优势方 |

|---|---|---|---|

| MMLU(跨学科理解) | 88.5% | 86.4% | DeepSeek |

| 中文能力(C-Eval) | 89.6% | 82.3% | DeepSeek |

| 数学推理(GSM8K) | 88.7% | 92.1% | GPT-4 |

| 代码生成(HumanEval) | 82.6% | 67% | DeepSeek |

| 响应延迟(A100) | 420毫秒/token | 680毫秒/token | DeepSeek |

从数据可以看出,DeepSeek在中文理解、代码生成和推理效率上表现突出,而GPT-4在数学推理和英文综合能力上仍保持优势。

7.3、商业化与成本:颠覆性的价格优势

在商业化落地方面,两者的策略和定价形成了鲜明对比,这直接影响着开发者和企业的选择。

API成本对比

$0.14 DeepSeek-V3 / 百万token

$30.00 GPT-4 / 百万token

GPT-4的输入成本是DeepSeek-V3的214倍

部署资源需求

DeepSeek-V3 显存需求 12.5GB 16GB消费级显卡可运行

GPT-4 显存需求 19.8GB 需要专业级硬件

7.4、应用场景:不同的市场定位

基于技术特性和成本结构,两个模型在实际应用中形成了差异化的定位。

DeepSeek的优势领域

• 中文场景应用 :在法律、医疗、政务等中文专业领域表现优异,在C-Eval中文测试中领先GPT-4约2.3个百分点

• 代码开发辅助 :HumanEval测试中82.6%的通过率显著高于GPT-4的67%,特别擅长复杂代码生成和重构

• 实时响应需求:420毫秒/token的响应速度,适合对延迟敏感的应用场景

GPT-4的坚守阵地

• 复杂数学推理 :GSM8K测试中92.1%的准确率,在需要多步逻辑推导的数学问题上表现稳定

• 多模态能力 :支持图像处理,在视觉问答和文档理解任务中具备优势

• 生态成熟度:完善的API体系、插件生态和开发者社区,商业化应用更加成熟