比如Ollama当前地址是192.168.0.98 ,在本地可以用127.0.0.1:11434 连访问,但是远程的其它服务器连不上,浏览器打不开这个地址网页。同样用curl也打不开,这样不需要在AI Agent软件里测试,就知道其服务不可用。

其实这是一个不是问题的问题,因为只要像下面那样,到Ollama的配置里面处理一下就行了。

之所以单独拿出来记录,是因为还需要穿过NAT路由器,这样实践的时候就颇废了一些周折。

配置Ollama

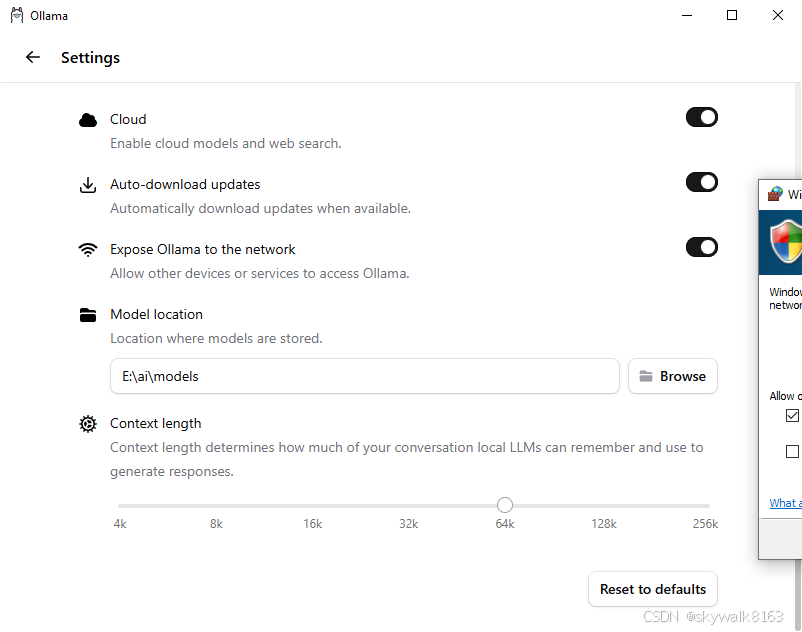

针对Windows系统,打开Ollama,进入Settings配置:

打开"Expose Ollama to the network"选项,并save

这时候再本地打开网页,ok

Ollama is running但是现在本机可以,远程还是不行。对很多人来说,其实这时候应该远程已经能访问了。

防火墙配置

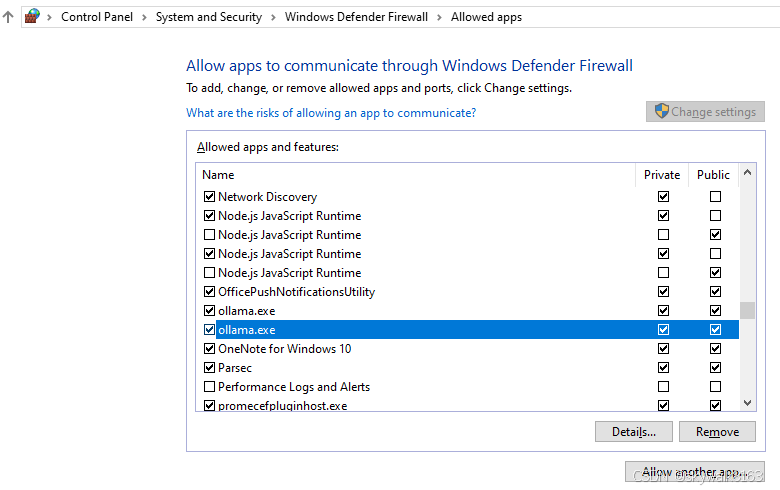

如果不能访问,这时候就可以看下本机的防火墙配置。

查看Ollama的端口是否放开:

不明白为什么有两个Ollama.exe,一个打开了Private,一个打开了Public。于是把它们都打开。理论上这样做就应该能访问了。

检查网络配置

很不巧,配置完防火墙,还是不行。 这里跨了一个NAT路由器,而且是外网想访问内网,所以用了Easytier组网,组网参考:https://skywalk.blog.csdn.net/article/details/149661717

后来检查网络配置,发现是easytier的网卡ip地址配置错了。没有把网卡设为同一网段。Ollama放在了10.1.2网段,而客户端放在了10.1.20网段,两个网段不在同一网段,所以无法连通。这里是废了很大周折才发现,因为一开始根本没有往这方面想。根本原因是客户端那边配置的时候大意敲错了,当时没能及时发现错误并修改。

重新配置成同一网段,终于ok了。

(这里跨了一个NAT路由器,而且是外网想访问内网,所以用了Easytier组网,组网参考:https://skywalk.blog.csdn.net/article/details/149661717)

测试一下:

curl 10.1.2.98:11434输出

skywalk@ub19:~$ curl 10.1.2.98:11434

Ollama is runnings证明可以跨nat路由器访问了!