过去数年,生成式 AI 已经在 2D 内容------图像、视频、文本上实现了规模化应用,但 3D 生成却始终是那块看似近在眼前、却迟迟难以跨越的高地,因其不仅是维度的提升,更是对表示方式、学习目标和工程可用性的一次全面考验。

3D 生成模型面临的核心难题,从来不只是「能否生成一个看起来像物体的结果」,而是「如何在高维空间中同时维持几何一致性、语义稳定性与结构可用性」。 一个模型可以在单一视角下呈现出合理的外观,却在视角变化时迅速崩塌;也可以在视觉上高度逼真,却无法导出可编辑、可复用的标准 3D 资产。这些问题直接限制了 3D 生成技术走向真实生产场景。

近年来,行业在不同技术路径之间不断尝试与摇摆。例如,基于 NeRF 的方法在视觉连续性上表现突出, 却天然偏向渲染而非建模,难以满足下游对 mesh、拓扑和物理属性的需求;基于 voxel 或显式 mesh 的生成方式结构清晰, 但在分辨率、细节表达和泛化能力上长期受限;单视角或少视角 3D 生成方法则在效率上取得突破, 却普遍面临多视角一致性不足、几何结构不稳定的问题。

这些路线的反复演进,暴露出的并不是单一模型或训练技巧的不足,而是一个更深层次的事实:3D 生成的问题本质上是表示、生成路径与训练目标之间的系统性失配。当模型的优化目标主要服务于「看起来合理」,而非「结构上成立」时,生成结果就很难跨越从展示到应用的那道鸿沟。

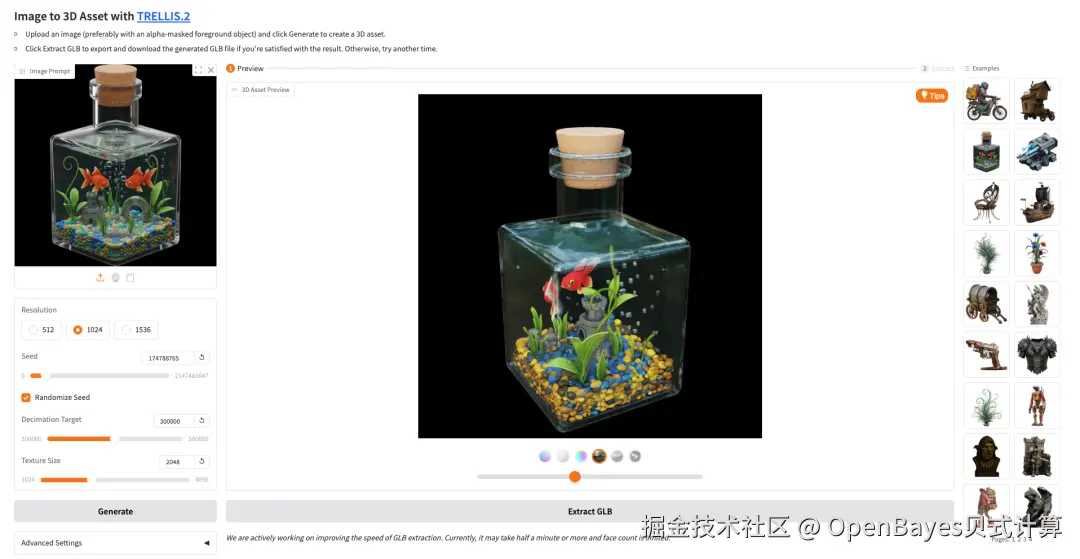

针对于此,微软亚洲研究院近期发布了 TRELLIS.2,不仅能够生成涵盖金属、塑料、玻璃、木材、水纹等丰富材质的 3D 物体,更能完整构建物体内部的几何结构。 与传统基于场表达的 3D 生成方法不同,TRELLIS.2 创新性地提出了非场(field-free)的新表达------稀疏体素结构 O-Voxel,这一表示方法可以生成具有任意拓扑结构和丰富材质属性的高分辨率 3D 资产,并且大幅减轻了开发者在预处理阶段的负担。

同时,TRELLIS.2 还实现了 16 倍的空间压缩,让拥有 40 亿参数的大型生成模型也能高效完成训练和推理。在实际性能表现上,生成 512³ 分辨率的全纹理资产仅需约 3 秒。

目前,「TRELLIS.2 3D 生成 Demo」已上线 OpenBayes 官网的教程版块,点击下方链接即可体验一键部署教程 ⬇️

在线运行:

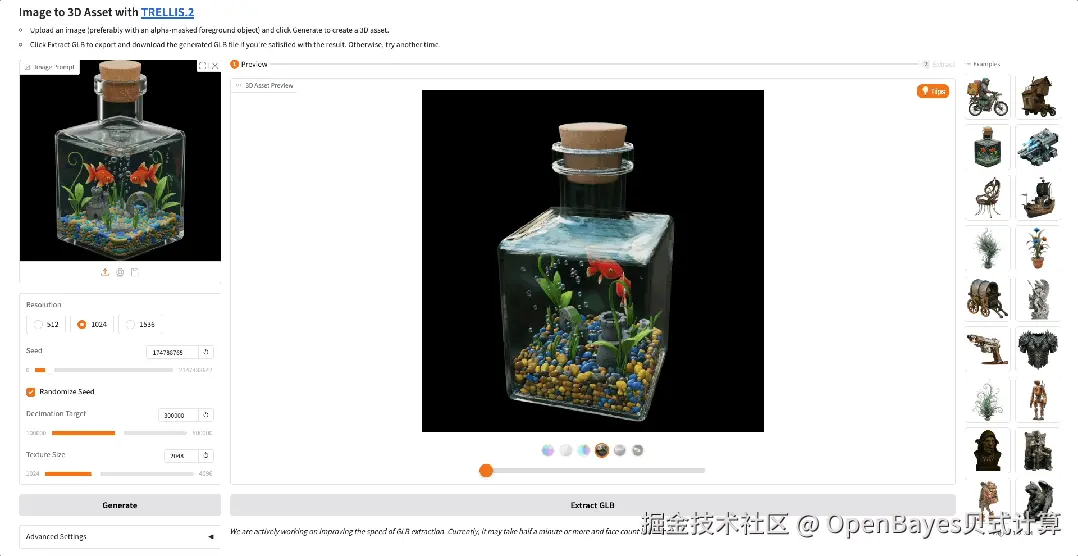

效果展示:

Demo 运行

01

Demo 运行阶段

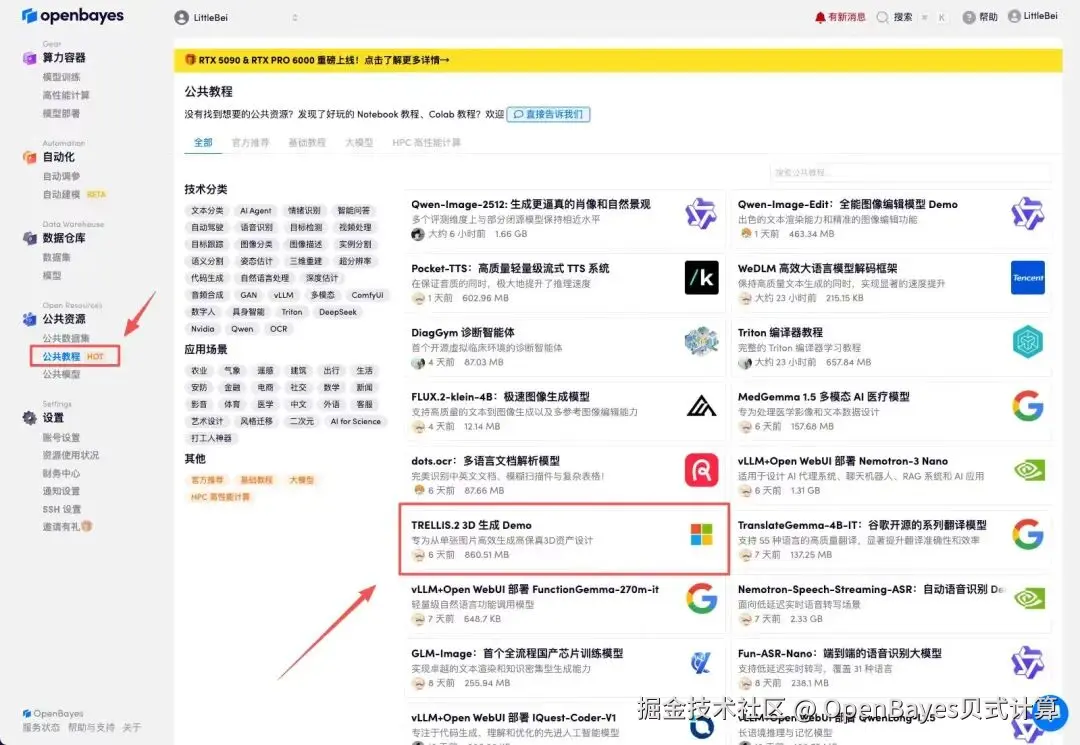

1.登录 OpenBayes.com,在「公共教程」页面,选择「TRELLIS.2 3D 生成 Demo」教程。

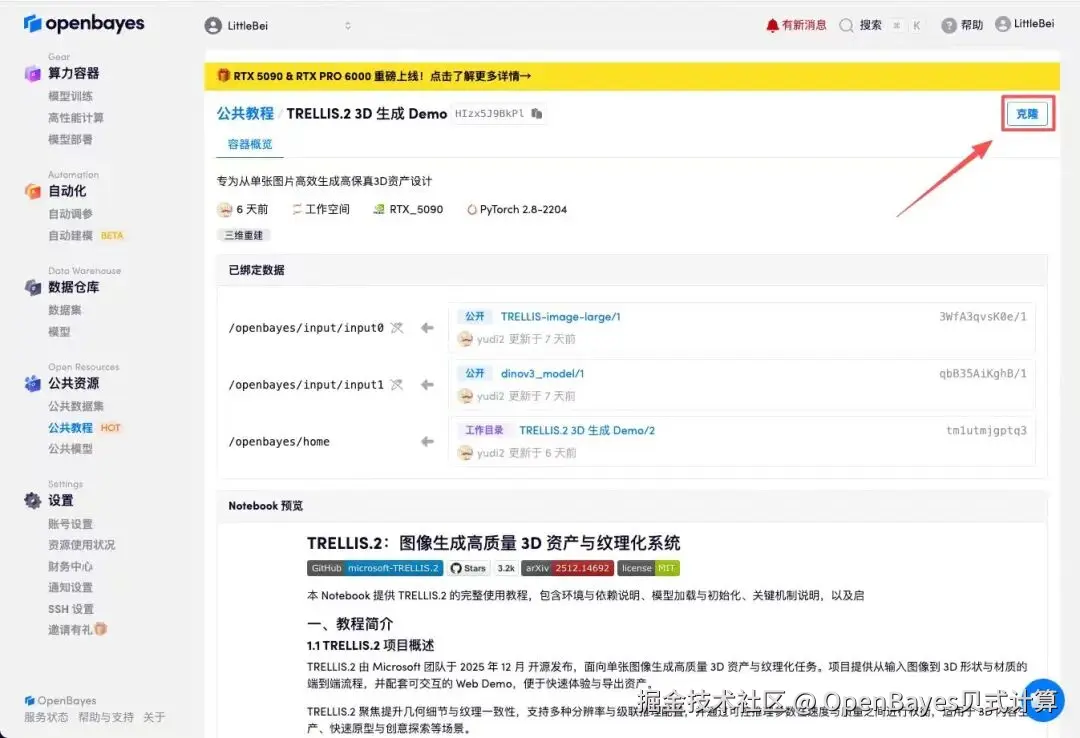

2.页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

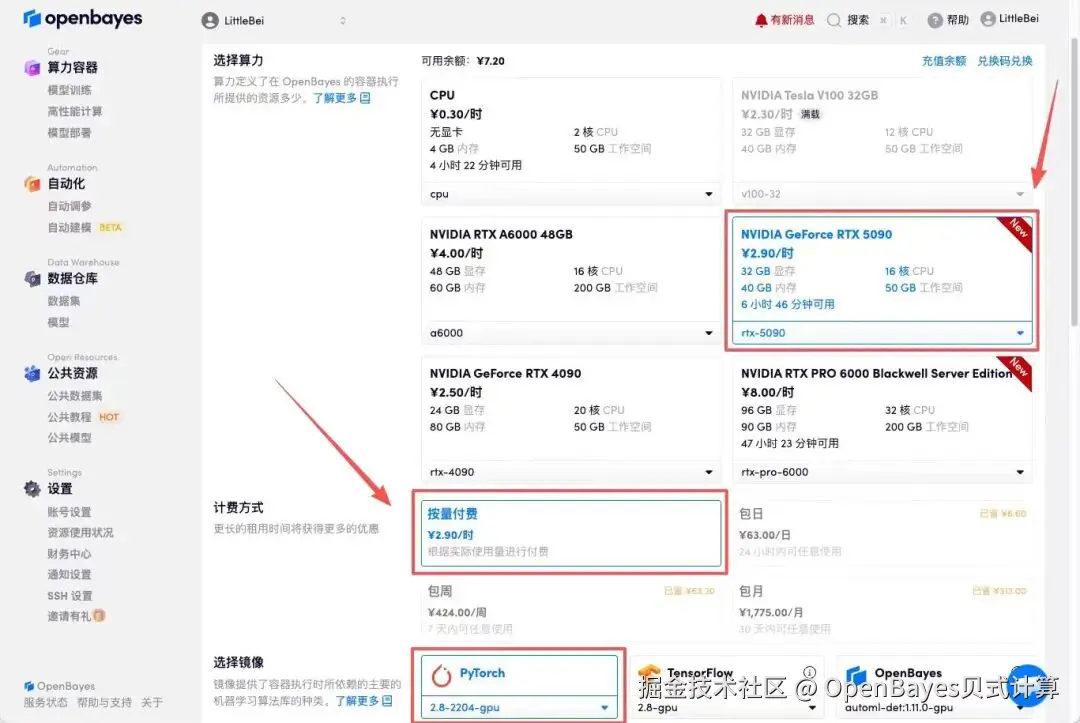

3.选择「NVIDIA RTX 5090」以及「PyTorch」镜像,按照需求选择「按量付费」或「包日/周/月」,点击「继续执行」。新用户使用下方邀请链接注册,即可获得满 ¥10 赠 ¥10 优惠券,更有机会获得 ¥15 赠金!

小贝总专属邀请链接(直接复制到浏览器打开):

4.等待分配资源,当状态变为「运行中」后,点击「打开工作空间」进入 Jupyter Workspace。

02

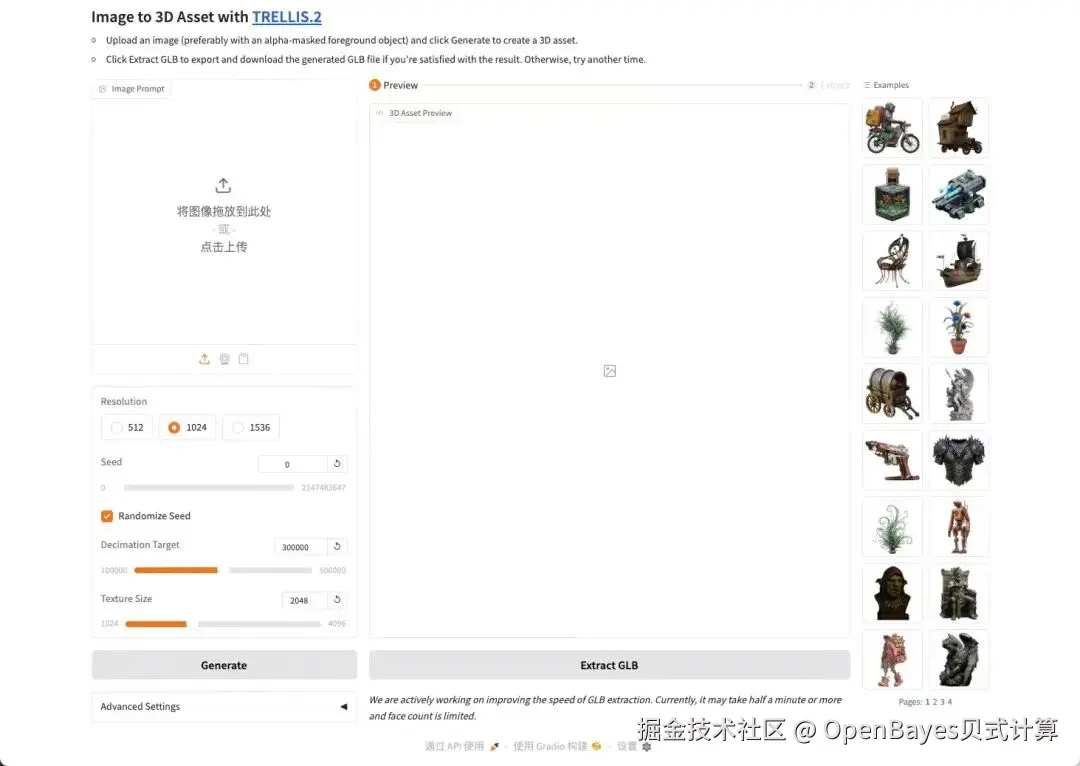

效果演示

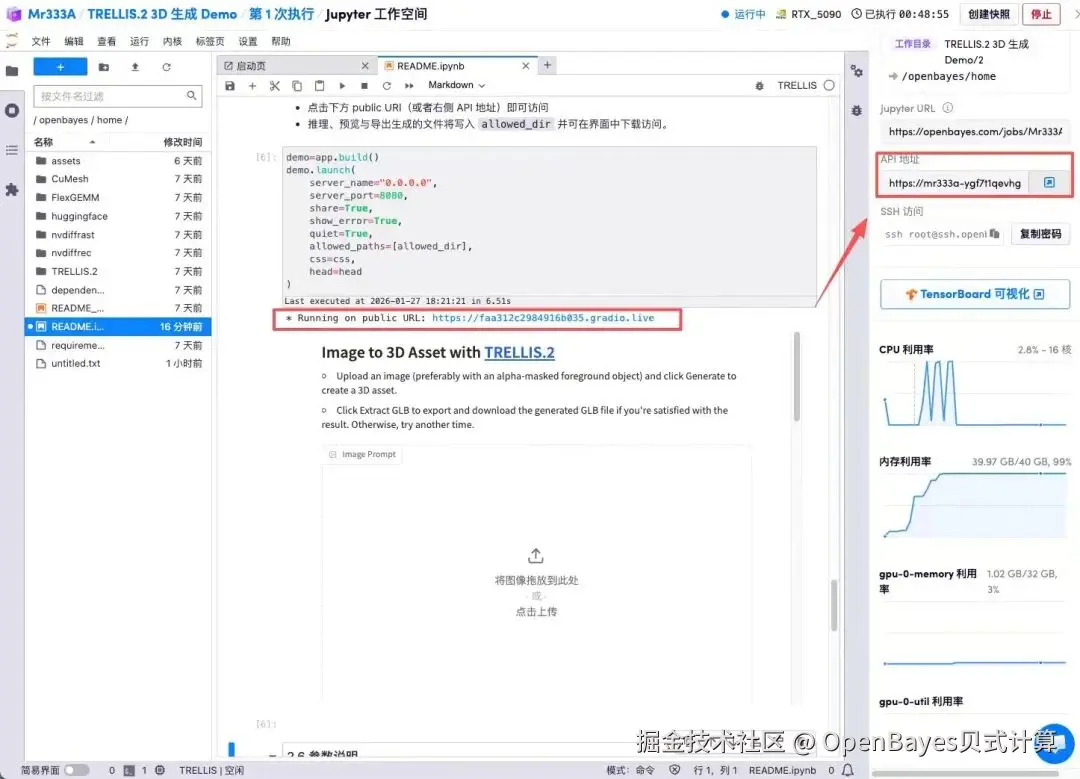

页面跳转后,点击左侧 README 页面,进入后点击上方「运行」。

待运行完成,即可点击右侧 API 地址跳转至 demo 页面。

教程链接: