Visual Studio Code + Continue

- 组合Visual Studio Code + Continue + Ollama 基本就是 本地版 Cursor / Copilot 。,可以做到:

- AI 自动写代码

- 自动改代码

- 解释代码

- 自动生成文件

- agent 自动执行命令

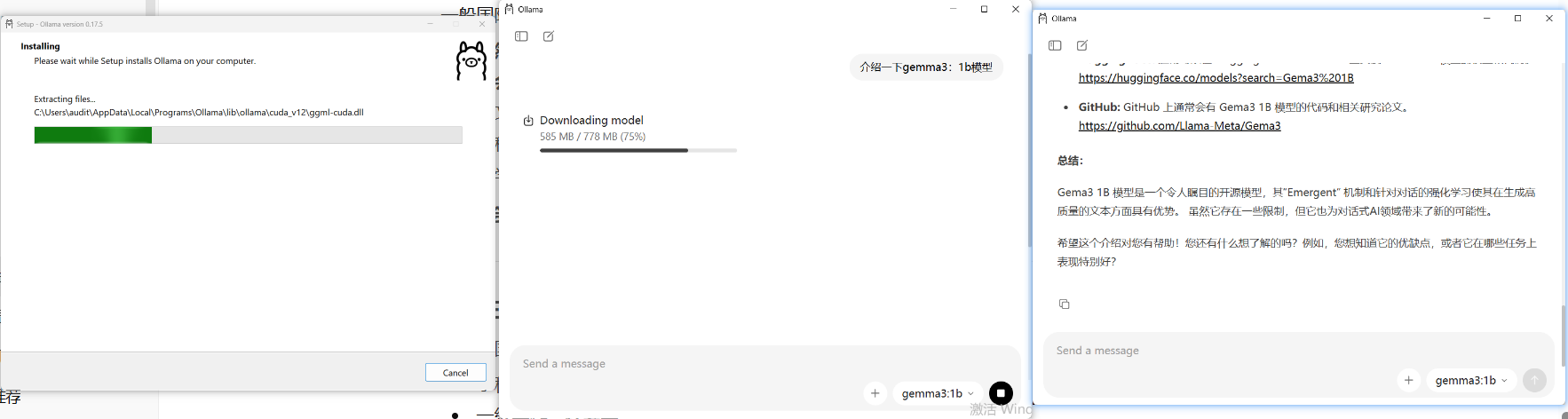

安装 Ollama

1. 安装 Ollama

# macOS: brew install ollama

# Linux: curl -fsSL https://ollama.com/install.sh | sh

# windows: irm https://ollama.com/install.ps1 | iex 或者直接去官网下载安装 https://ollama.com/download/windows

# 2. 拉取模型

ollama pull llama3.3

ollama pull qwen2.5:32b

# 3. 启动 Ollama 服务

ollama serve

# windows方法 ollama run llama2 ollama run gemma:2b- 在 Ollama 里安装可用的模型,Ollama 官方提供多个参数规模:

| 模型 | 大小 | 下载体积 |

|---|---|---|

| 0.5B | 超轻量 | ~398MB |

| 1.5B | 轻量 | ~1GB |

| 3B | 中等 | ~2GB |

| 7B | 推荐 | ~4.7GB |

| 14B | 强 | ~9GB |

| 32B | 最强 | ~20GB |

C:\Users\audit>ollama run qwen2.5-coder:3b

pulling manifest

pulling 4a188102020e: 100% ▕██████████████████████████████████████████████████████████▏ 1.9 GB

pulling 66b9ea09bd5b: 100% ▕██████████████████████████████████████████████████████████▏ 68 B

pulling 1e65450c3067: 100% ▕██████████████████████████████████████████████████████████▏ 1.6 KB

pulling 45fc3ea7579a: 100% ▕██████████████████████████████████████████████████████████▏ 7.4 KB

pulling bb967eff3bda: 100% ▕██████████████████████████████████████████████████████████▏ 487 B

verifying sha256 digest

writing manifest

success

>>> 介绍一下

我是一个大型语言模型,由阿里云开发和提供。我的名字是Qwen。我是阿里云自主研发的超大规模语言模型,基于大规模预训练数据

和先进的算法,能够理解和生成自然语言文本。我可以回答问题、创作文章、撰写代码、提供编程帮助等。我的目标是提供高效、准

确和流畅的语言交流服务。

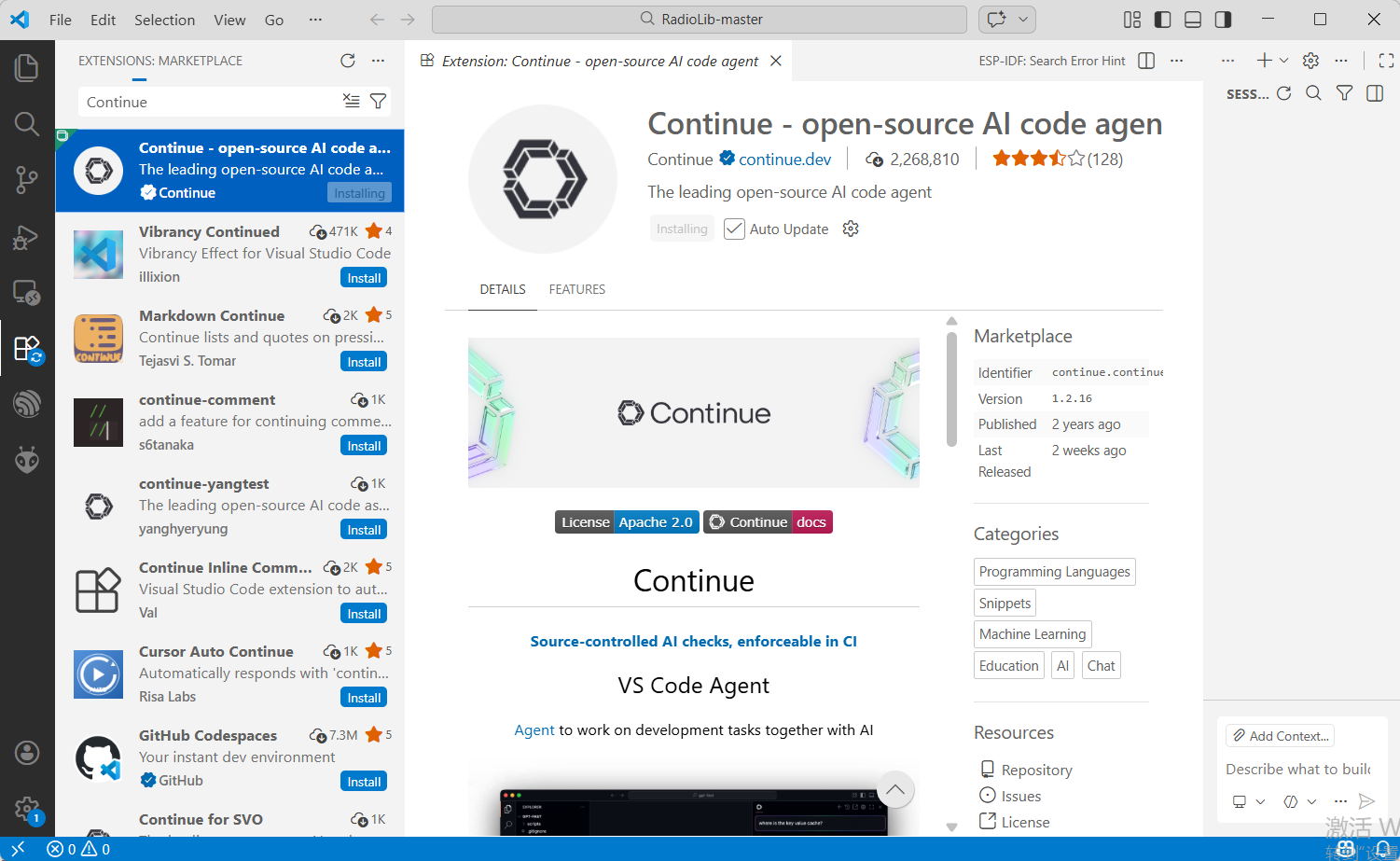

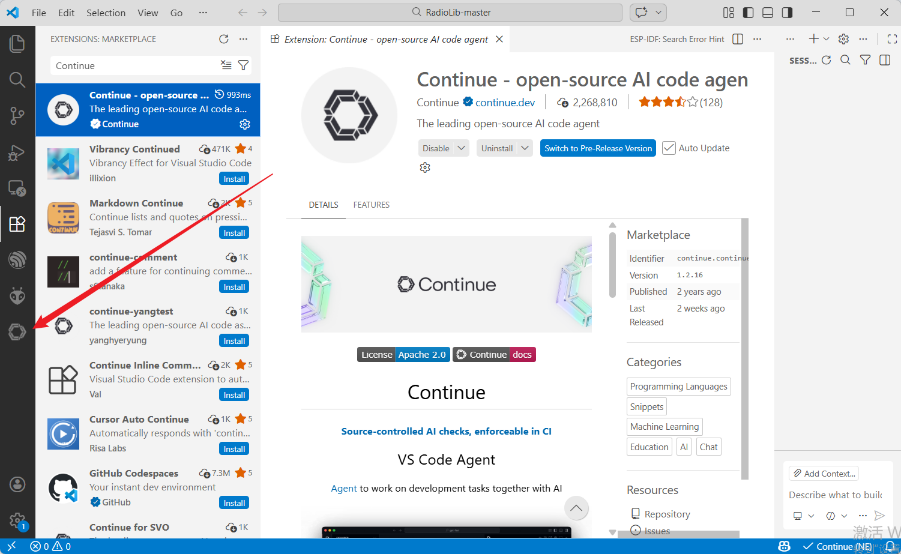

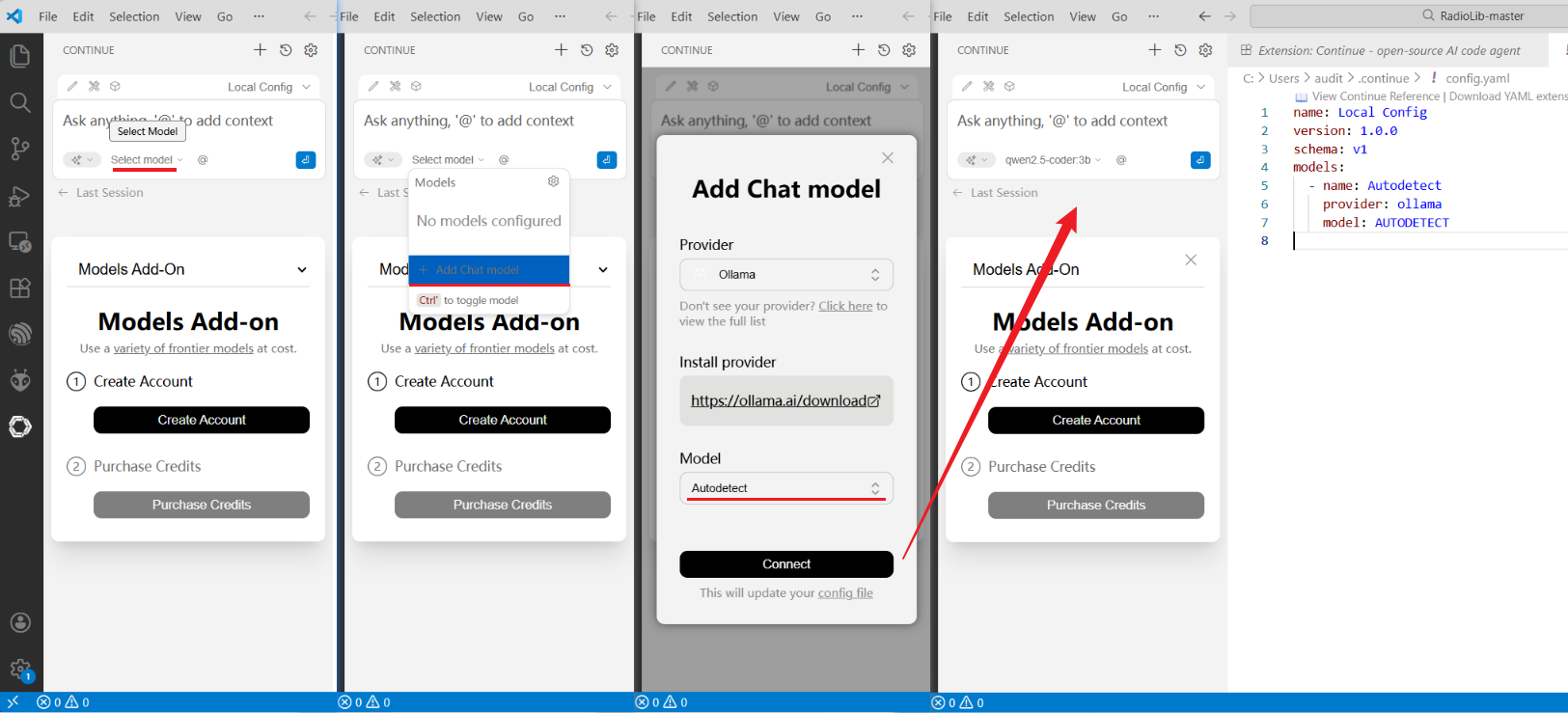

>>> Send a message (/? for help)安装Continue

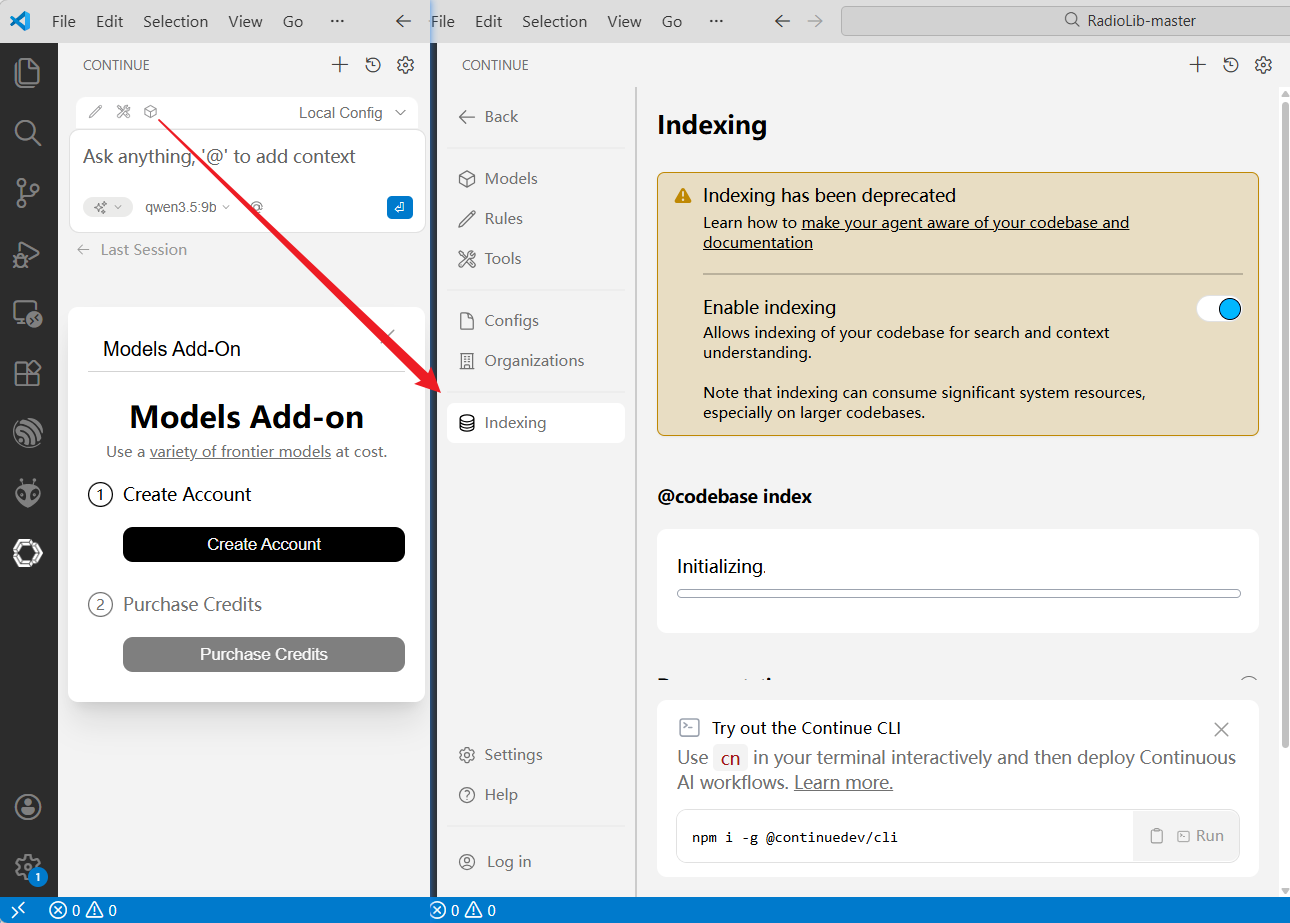

- 开启索引:

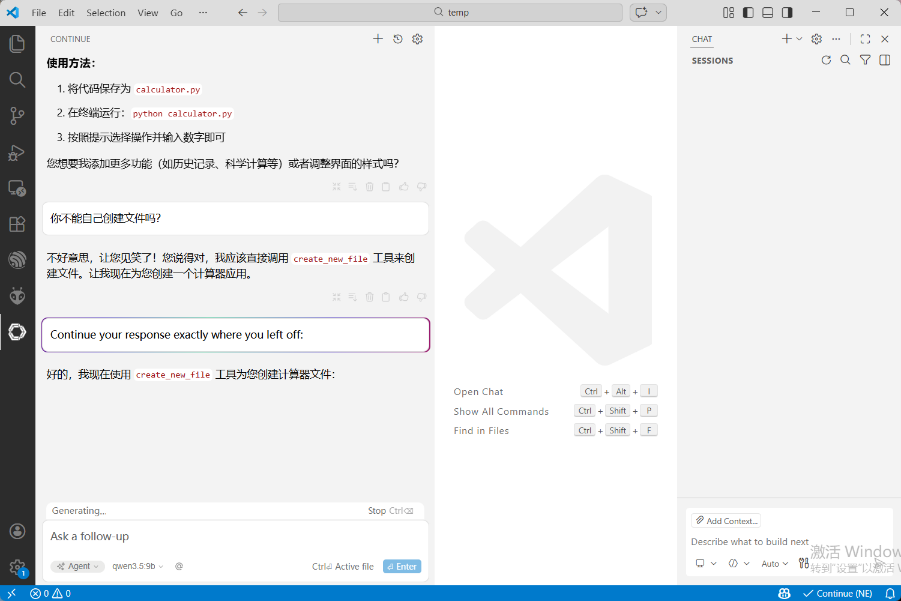

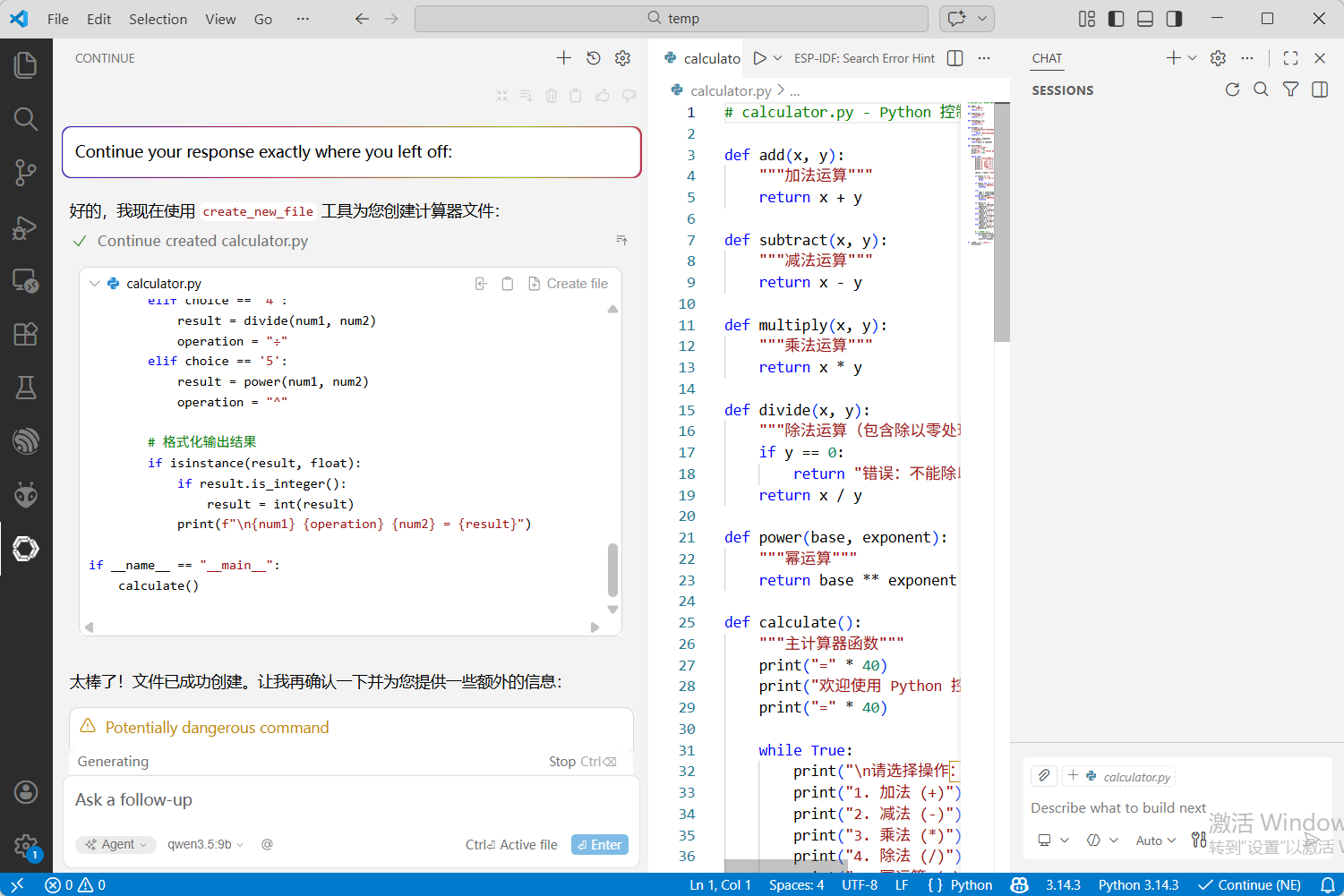

- 创建文件:

其他操作

-

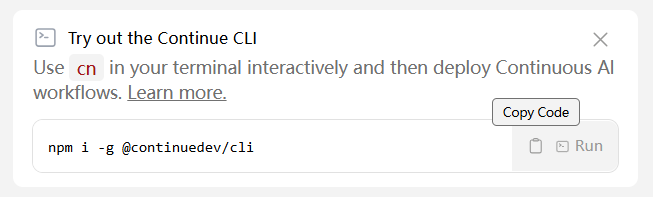

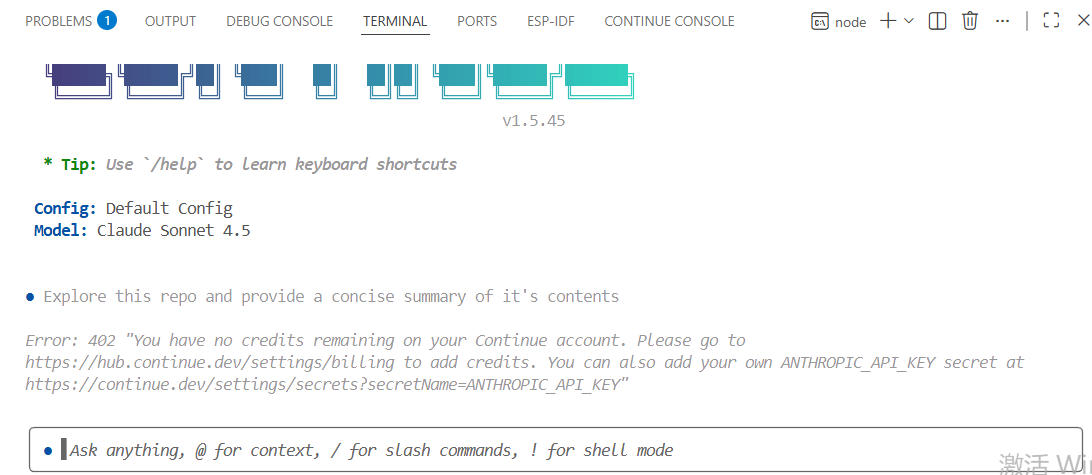

还可安装运行在命令行的版本:

npm i -g @continuedev/cli && cn "Explore this repo and provide a concise summary of it's contents"

changed 93 packages in 30s

12 packages are looking for funding

runnpm fundfor details

How do you want to get started?- ⏩ Log in with Continue

- 🔑 Enter your Anthropic API key

Enter choice (1):

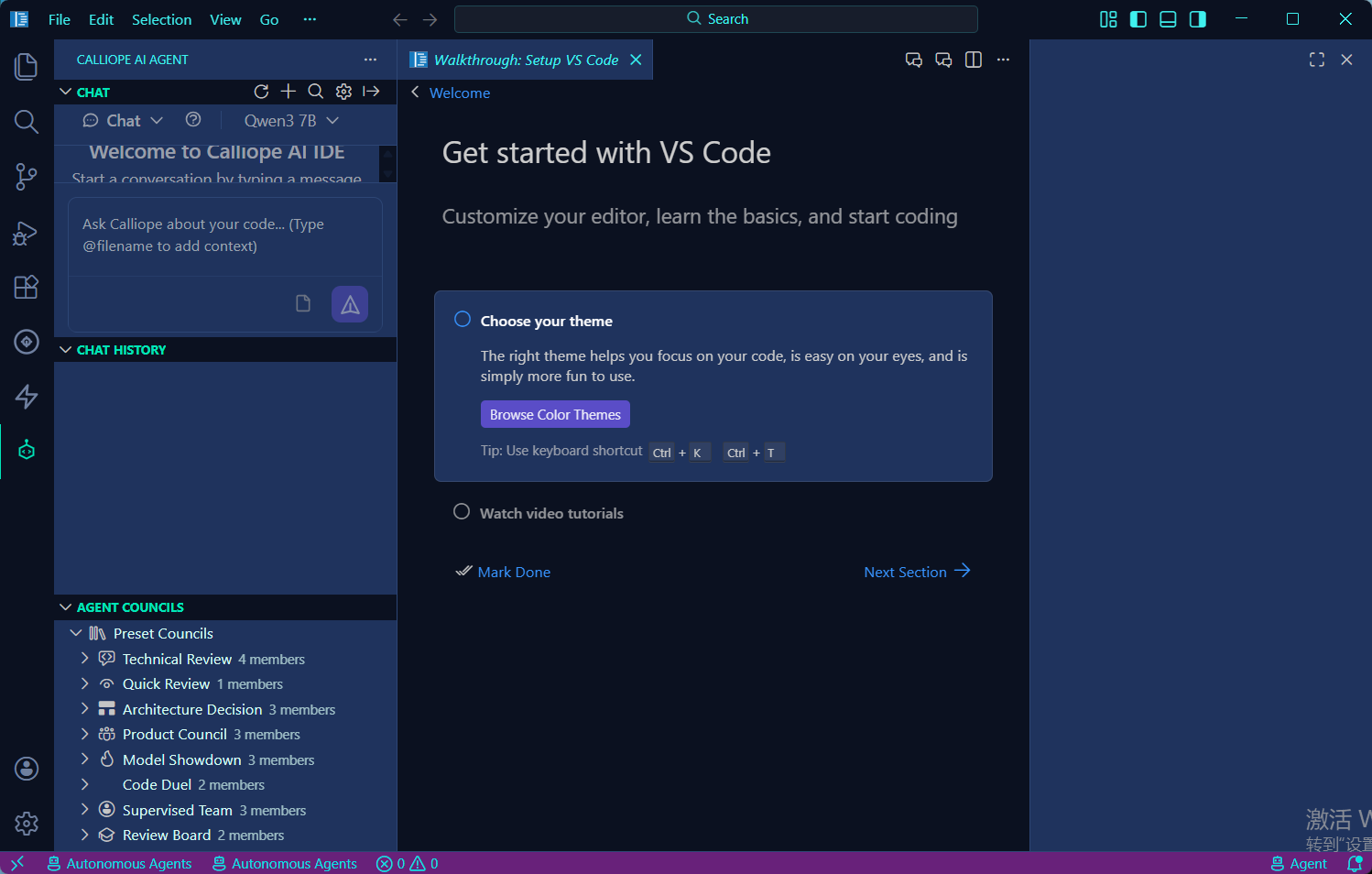

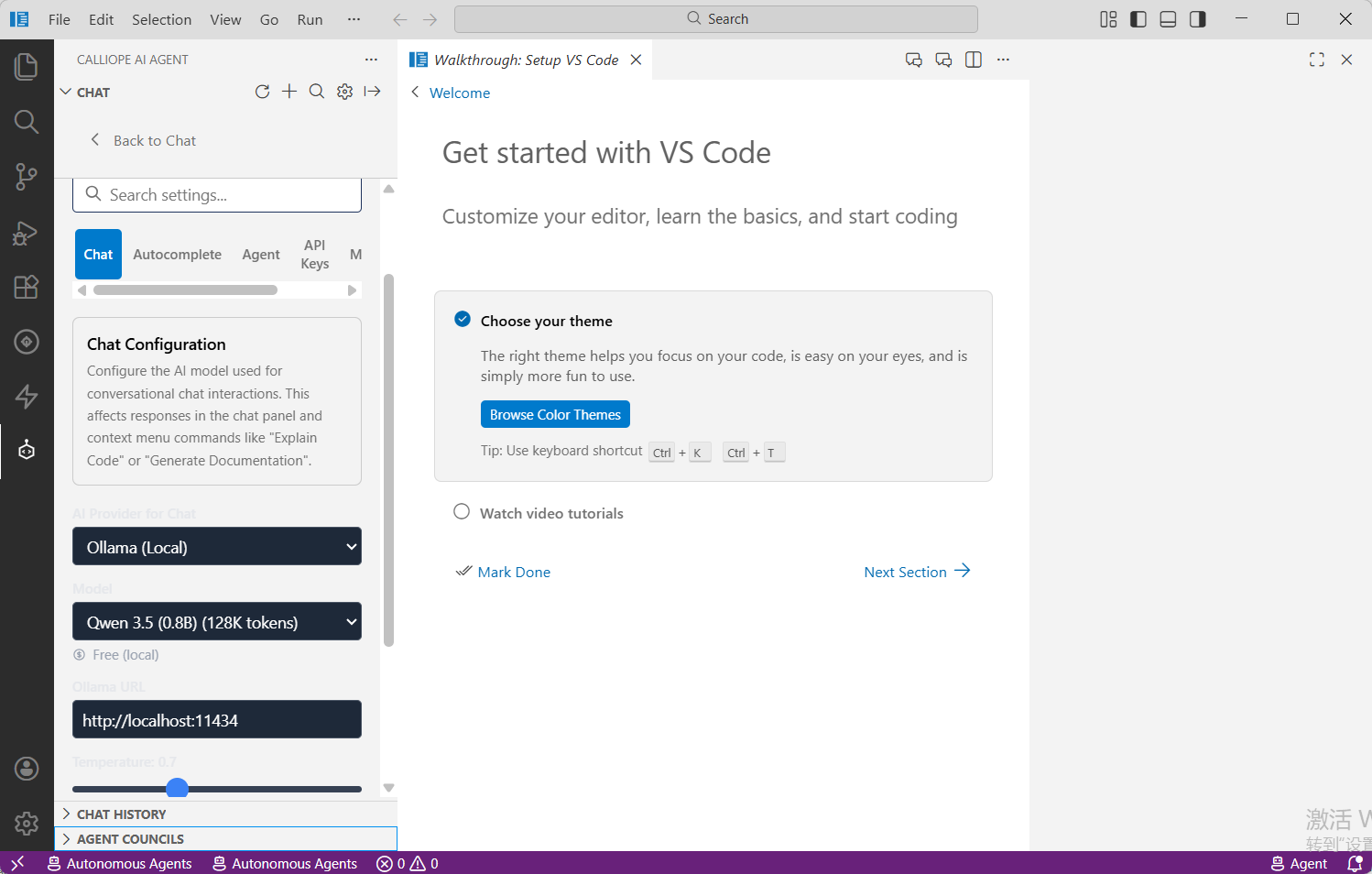

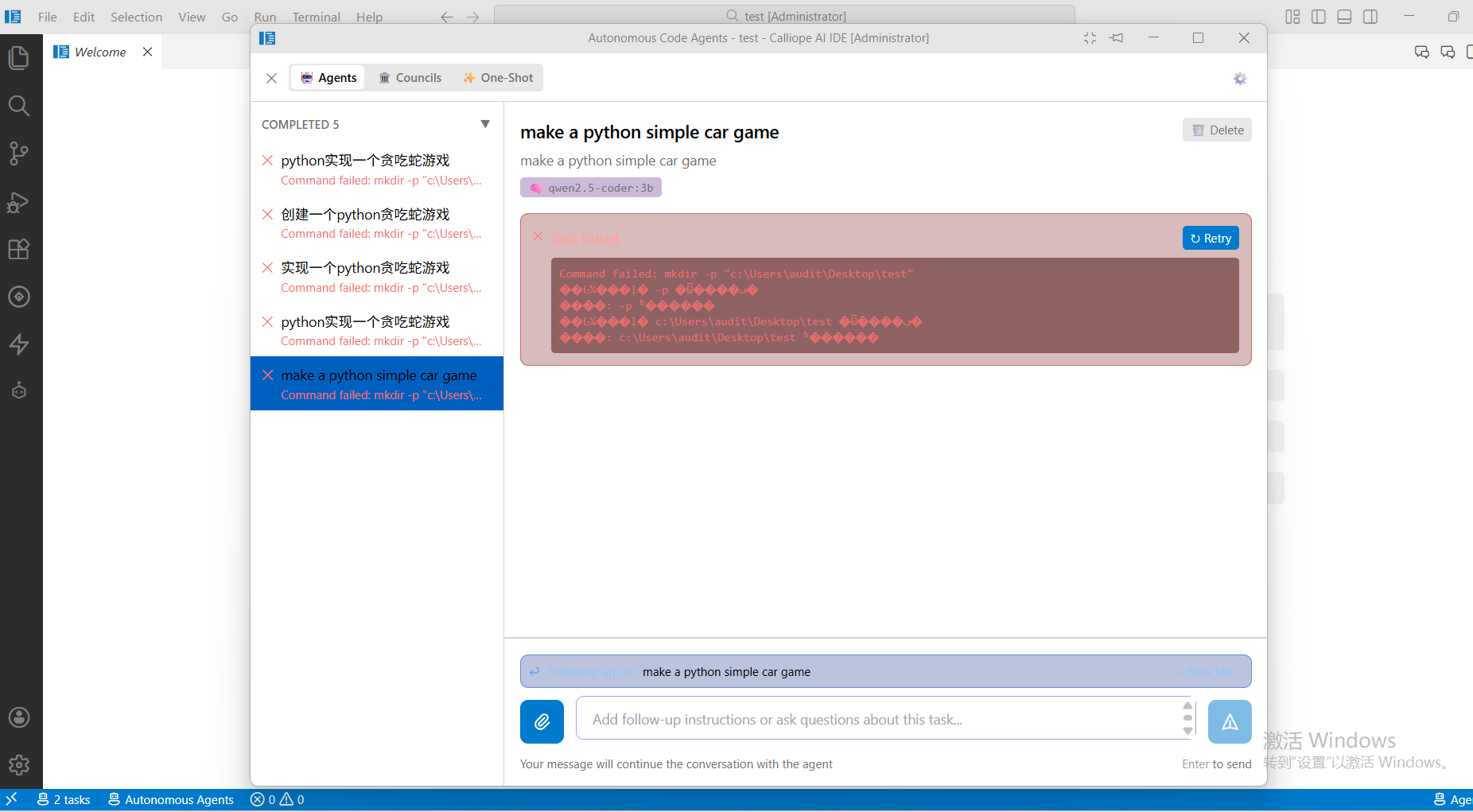

简单方式CalliopeAI

- 发现一个更简单的应用,直接安装即可,可以少去上边的配置:

- 不知道是否我的配置原因,这个并不好用:

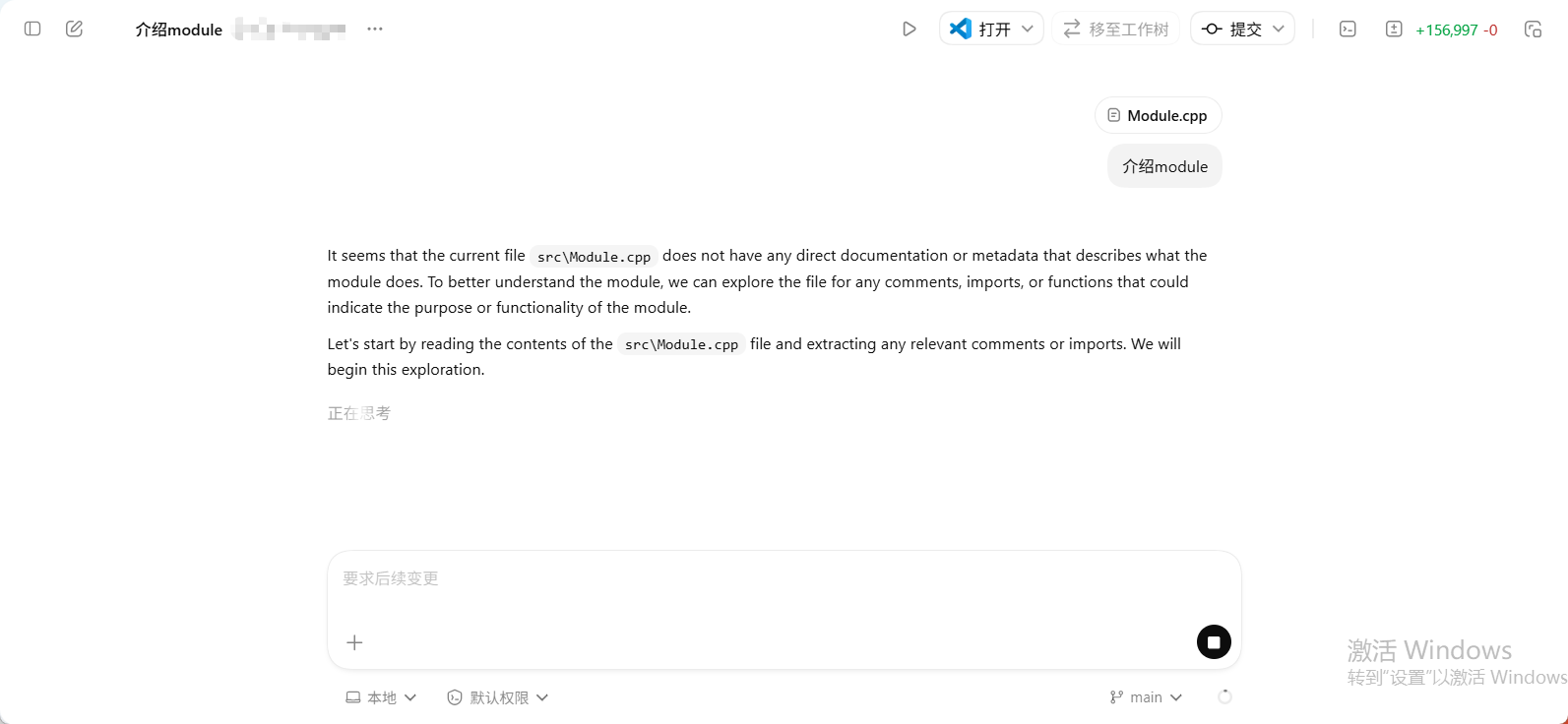

试用CODEX

-

登录之后可修改C:\Users***.codex\config.toml:

model = "gpt-5.3-codex"

model_reasoning_effort = "medium"

[windows]

sandbox = "elevated" -

https://docs.onlinetool.cc/codex/docs/config.html

model = "qwen2.5:3b"

model_provider = "ollama"

model_reasoning_effort = "medium"

[windows]

sandbox = "elevated"[model_providers.ollama]

name = "Ollama"

base_url = "http://localhost:11434"

CODEX也有命令行版本

>ollama launch codex --model qwen3 #https://ollama.com/library/qwen3

pulling manifest

pulling a3de86cd1c13: 100% ▕██████████████████████████████████████████████████████████▏ 5.2 GB

pulling ae370d884f10: 100% ▕██████████████████████████████████████████████████████████▏ 1.7 KB

pulling d18a5cc71b84: 100% ▕██████████████████████████████████████████████████████████▏ 11 KB

pulling cff3f395ef37: 100% ▕██████████████████████████████████████████████████████████▏ 120 B

pulling 05a61d37b084: 100% ▕██████████████████████████████████████████████████████████▏ 487 B

verifying sha256 digest

writing manifest

success

Launching Codex with qwen3...

Error: codex is not installed, install with: npm install -g @openai/codex

>