目录

环节1:输入处理与嵌入模块 (Input Processing & Embedding)

[环节2:Transformer 解码器 (核心)](#环节2:Transformer 解码器 (核心))

环节3:多模态预测头 (Multi-modal Prediction Heads)

[SimpliHuMoN 的解决方案:一个"统一大脑"](#SimpliHuMoN 的解决方案:一个"统一大脑")

[1. "查询"机制------像搜索引擎一样提问](#1. "查询"机制——像搜索引擎一样提问)

[2. 统一注意力------让过去和未来"互相看见"](#2. 统一注意力——让过去和未来"互相看见")

[3. 多模态输出------不只猜一个答案](#3. 多模态输出——不只猜一个答案)

[误区1:"四个象限都有强注意力 = 有交叉注意力"](#误区1:"四个象限都有强注意力 = 有交叉注意力")

[二、严格对应:通俗理解 ↔ 技术实现](#二、严格对应:通俗理解 ↔ 技术实现)

[三、对比:SimpliHuMoN vs 其他架构](#三、对比:SimpliHuMoN vs 其他架构)

[1. vs 标准编码器-解码器(如原始Transformer用于翻译)](#1. vs 标准编码器-解码器(如原始Transformer用于翻译))

[2. vs DETR(Detection Transformer)](#2. vs DETR(Detection Transformer))

[3. vs SAM2(Segment Anything Model 2)的跟踪机制](#3. vs SAM2(Segment Anything Model 2)的跟踪机制)

[Q1: "四个象限都有强注意力"怎么理解?](#Q1: "四个象限都有强注意力"怎么理解?)

[Q2: 有没有"从未来推测过去"?](#Q2: 有没有"从未来推测过去"?)

[Q3: 为什么强调"堆叠L层Self-Attention"?](#Q3: 为什么强调"堆叠L层Self-Attention"?)

[关键区分:物理连续性 ≠ 架构必须统一](#关键区分:物理连续性 ≠ 架构必须统一)

[二、SimpliHuMoN vs GPT:核心联系与区别](#二、SimpliHuMoN vs GPT:核心联系与区别)

[三、更深层的联系:都是"Next Token Prediction"?](#三、更深层的联系:都是"Next Token Prediction"?)

[2.1 核心分类维度](#2.1 核心分类维度)

[2.2 历史演进路线图](#2.2 历史演进路线图)

[3.1 路线一:生成式统一(GPT范式)](#3.1 路线一:生成式统一(GPT范式))

[3.2 路线二:理解式统一(BERT范式)](#3.2 路线二:理解式统一(BERT范式))

[3.3 路线三:检索-生成混合(Enc-Dec范式)](#3.3 路线三:检索-生成混合(Enc-Dec范式))

[3.4 路线四:状态空间与线性化(Mamba范式)](#3.4 路线四:状态空间与线性化(Mamba范式))

[5.1 统一性:都是"动态加权聚合"](#5.1 统一性:都是"动态加权聚合")

[5.2 分歧的根本原因:任务本质不同](#5.2 分歧的根本原因:任务本质不同)

[5.3 历史周期律:复杂化→简化→再复杂化→再简化](#5.3 历史周期律:复杂化→简化→再复杂化→再简化)

[1.1 早期尝试:T5与BART(2019-2020)](#1.1 早期尝试:T5与BART(2019-2020))

[1.2 GPT-4与大型多模态模型(2023-2024)](#1.2 GPT-4与大型多模态模型(2023-2024))

[1.3 真正的双向-生成融合:XLNet, UniLM](#1.3 真正的双向-生成融合:XLNet, UniLM)

[1.4 最新的"真统一"尝试:Mamba-2, Zamba, Griffin](#1.4 最新的"真统一"尝试:Mamba-2, Zamba, Griffin)

[1.5 视觉-语言-动作的"大一统":Gato, RT-2, GPT-4o](#1.5 视觉-语言-动作的"大一统":Gato, RT-2, GPT-4o)

[3.1 信息论视角](#3.1 信息论视角)

[3.2 因果性视角](#3.2 因果性视角)

[3.3 计算复杂度视角](#3.3 计算复杂度视角)

[4.1 方案一:生成主导(GPT路线)](#4.1 方案一:生成主导(GPT路线))

[4.2 方案二:架构混合(UniLM路线)](#4.2 方案二:架构混合(UniLM路线))

[4.3 方案三:多专家混合(MoE路线)](#4.3 方案三:多专家混合(MoE路线))

[5.1 理论路径:因果表示学习](#5.1 理论路径:因果表示学习)

[5.2 计算路径:自适应计算图](#5.2 计算路径:自适应计算图)

[5.3 表示路径:统一潜空间](#5.3 表示路径:统一潜空间)

[7.1 弱统一:已实现](#7.1 弱统一:已实现)

[7.2 强统一:理论可能,工程困难](#7.2 强统一:理论可能,工程困难)

[7.3 我的判断](#7.3 我的判断)

一、前言

仅供参考,未经实验验证。

二、SimpliHuMoN

标题: SimpliHuMoN: Simplifying Human Motion Prediction(简化人类运动预测)

作者: Aadya Agrawal, Alexander Schwing

论文地址 : https://arxiv.org/pdf/2603.04399

Github地址: https://github.com/aadya-agrawal/SimpliHuMoN

发表时间: 2026年3月5日

研究背景与问题

人类运动预测包含两个核心子任务:

轨迹预测(Trajectory Forecasting):预测人体在三维空间中的移动路径

人体姿态预测(Human Pose Prediction):预测人体的骨骼姿态变化

现有方法通常为这两个任务分别设计专门的模型,但将它们结合起来进行整体人类运动预测时面临挑战,难以在各自的基准测试中取得理想性能。

核心贡献

SimpliHuMoN 提出了一种简单而有效的基于Transformer的统一模型,具有以下特点:

特性 说明 统一架构 单一端到端模型,无需任务特定修改 自注意力机制 堆叠自注意力模块,同时捕捉空间和时间依赖 空间关系 捕捉单帧内姿态各关节间的空间依赖 时序关系 建模跨时间步的运动序列时序关系 多任务兼容 支持仅姿态预测、仅轨迹预测、联合预测三种模式

实验验证

在多个主流基准数据集上验证,包括:

Human3.6M(室内人体动作)

AMASS(大规模动作捕捉数据集)

ETH-UCY(行人轨迹预测)

3DPW(野外3D姿态)

实验结果 :在所有任务上均达到了**最先进(State-of-the-Art)**的性能。

研究意义

简化性:证明了简单的Transformer架构足以处理复杂的人体运动预测任务

统一性:打破了任务专用模型的传统范式,实现了真正的端到端联合预测

实用性:单一模型可灵活应对不同应用场景,降低了部署复杂度

总结

这篇论文的核心思想是**"简化即强大"**------通过精心设计的自注意力机制,用一个简洁的Transformer模型统一解决了人类运动预测中的多个子任务,并在多个权威基准上刷新了性能记录。这为人体运动预测领域提供了一个新的、更简洁的baseline方案。

二、怎么做的,各个环节输入输出是什么

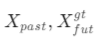

一、整体架构概览

SimpliHuMoN 采用 Decoder-only Transformer 架构,核心思想是统一处理历史观测和未来预测,通过自注意力机制同时捕捉:

空间依赖:单帧内各关节的空间关系

时序依赖:跨时间步的运动动态

┌─────────────────────────────────────────────────────────────────┐

│ SimpliHuMoN 架构 │

├─────────────────────────────────────────────────────────────────┤

│ 输入处理模块 (Sec 2.1) → Transformer解码器 (Sec 2.2) → 多模态预测头 (Sec 2.3) │

└─────────────────────────────────────────────────────────────────┘

二、各环节详细解析

环节1:输入处理与嵌入模块 (Input Processing & Embedding)

输入定义:

历史时间范围:H 个时间步

轨迹输入 Tpast∈RH×3 :根关节(如髋部)的3D坐标序列

姿态输入 Ppast∈RH×M×3 :M 个关节相对于根关节的3D坐标

任务模式(灵活配置):

任务类型 输入组成 输出组成 仅轨迹预测 只用 Tpast Tfut 仅姿态预测 只用 Ppast Pfut 联合预测 Tpast+Ppast Tfut+Pfut 处理流程:

1.1 历史上下文编码 (Past Context Encoding)

┌─────────────────┐ ┌──────────────────┐ ┌─────────────────┐ │ 根轨迹处理 │ │ 相对姿态处理 │ │ 特征融合 │ ├─────────────────┤ ├──────────────────┤ ├─────────────────┤ │ 1. 归一化:减去 │ │ 1. 归一化:减去 │ │ 1. 添加位置编码 │ │ 最后一帧根位置 │ │ 根关节位置 │ │ (正弦编码) │ │ 2. 线性层投影到 │ │ 2. 两层MLP+GELU │ │ 2. 添加可学习类型 │ │ d_model维度 │ │ 投影到d_model │ │ 嵌入(E) │ └────────┬────────┘ └────────┬─────────┘ └────────┬────────┘ │ │ │ └───────────────────────┴────────────────────────┘ │ ┌────────────▼────────────┐ │ 拼接形成上下文张量 C │ │ 形状: ℝ^(2H × d_model) │ └─────────────────────────┘1.2 未来查询生成 (Future Query Generation)

┌─────────────────────────────────────────────────────────────┐ │ 可学习查询参数 Q_in ∈ ℝ^(F × 3) (类似DETR的对象查询) │ │ ↓ │ │ 线性层投影到 d_model 维度 │ │ ↓ │ │ 分割为轨迹查询 Q_T 和 姿态查询 Q_P (如果联合预测) │ │ ↓ │ │ 添加位置编码 + 类型嵌入(E) │ │ ↓ │ │ 拼接形成查询张量 Q ∈ ℝ^(2F × d_model) │ └─────────────────────────────────────────────────────────────┘输出:

上下文张量 C∈R^(2H)×dmodel (联合输入时)或 R^H×dmodel (单输入时)

查询张量 Q∈R^(2F)×dmodel (联合预测时)或 R^F×dmodel (单预测时)

环节2:Transformer 解码器 (核心)

关键创新 :统一自注意力机制(非标准编码器-解码器架构)

标准编码器-解码器: SimpliHuMoN 统一注意力: ┌─────────┐ ┌─────────────────────────────┐ │ 编码器 │ ← 自注意力 │ │ │ C │ │ 拼接 [C; Q] → 统一序列 │ └────┬────┘ │ 形状: ℝ^((H+F)×d_model) │ │ 交叉注意力 │ │ ↓ │ ↓ 堆叠 L 层自注意力 │ ┌─────────┐ │ ↓ Pre-RMSNorm + FFN │ │ 解码器 │ │ ↓ GELU激活 │ │ Q │ │ │ └─────────┘ │ 输出 Z ∈ ℝ^(F×d_model) │ └─────────────────────────────┘机制优势:

双向信息流:每个token(无论来自历史还是未来)可以直接 attend 到所有其他token

消融实验验证 (Table 11):统一自注意力比标准交叉注意力提升 APE 6.6%,JPE 7.1%

注意力可视化(Figure 5):

[C] 过去上下文 [Q] 未来查询 ┌─────────────┬─────────────┐ [C] │ 自注意力 │ 交叉注意力 │ │ (历史-历史) │ (历史-未来) │ ├─────────────┼─────────────┤ [Q] │ 交叉注意力 │ 自注意力 │ │ (未来-历史) │ (未来-未来) │ └─────────────┴─────────────┘ ↑ 四个象限都有强注意力,证明双向学习输出:

- 解码器输出 Z∈RF×dmodel :包含上下文感知的未来表示

环节3:多模态预测头 (Multi-modal Prediction Heads)

目标:生成 K 个不同的未来假设,捕捉运动的不确定性

┌─────────────────────────────────────────────────────────────┐ │ Z ∈ ℝ^(F × d_model) │ │ ↓ │ │ 线性投影到 ℝ^(F × K × C) (C为输出维度) │ │ ↓ │ │ 重塑为 K 个并行分支,每个分支: │ │ ├─ 轨迹头:线性层 → T_fut^[k] ∈ ℝ^(F × 3) │ │ └─ 姿态头:两层MLP → P_fut^[k] ∈ ℝ^(F × M × 3) │ │ (k ∈ {1, 2, ..., K}) │ └─────────────────────────────────────────────────────────────┘输出:

K个未来假设 Xfut={Xfut[1],...,Xfut[K]}

每个 Xfut[k] 包含完整的未来轨迹和/或姿态

三、训练机制

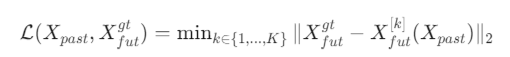

损失函数 :Winner-Takes-All (WTA) 损失

只通过误差最小的那个假设反向传播梯度

鼓励 K 个模式各自特化,覆盖不同的合理未来

模式利用率验证(Figure 4):

训练集和验证集上,6个模式的使用率都接近均匀分布(~16.7%)

证明没有发生模式崩溃(mode collapse)

四、模型配置

配置 层数 L 维度 dmodel 参数量 适用场景 Wide 6 192 4.0M 姿态细节捕捉(最佳APE) Deep 16 48 642K 长程时序依赖(最佳JPE)

五、各环节输入输出总结表

环节 输入 输出 关键操作 输入处理 Tpast 和/或 Ppast C (上下文), Q (查询) 归一化、MLP/线性投影、位置编码、类型嵌入 Transformer [C;Q]∈R(H+F)×dmodel Z∈R^F×dmodel 统一自注意力、Pre-RMSNorm、FFN 预测头 Z 线性投影→K分支→轨迹/姿态头 训练 损失值 WTA损失,仅优化最佳假设

六、核心创新点总结

统一架构:单一模型处理三种任务(轨迹/姿态/联合),无需任务特定修改

统一注意力:拼接历史和未来进行自注意力,实现双向信息流

端到端训练:避免多阶段管道的误差传播

多模态输出:K个假设捕捉不确定性,WTA损失确保多样性

计算高效:比专门设计的轻量级模型(如EMPMP)训练吞吐量高14.3%,测试速度快1.8倍

这种"简化即强大"的设计理念,通过标准的Transformer组件实现了state-of-the-art的性能,挑战了人体运动预测领域日益复杂的架构趋势。

三、通俗解释一下

一句话总结

SimpliHuMoN 就是一个"超级简单的预测器"------它用一个最基础的 Transformer 模型,同时搞定了"人往哪走"和"身体怎么动"这两个任务,而且效果比那些复杂设计的专用模型还要好。

用人话拆解核心思想

问题背景:以前的做法太"割裂"了

想象你要预测一个人接下来的动作:

以前的做法 问题 A团队专门研究"人往哪走"(轨迹预测) 只看脚的位置,不管身体姿态 B团队专门研究"身体怎么摆"(姿态预测) 只看关节角度,不管整体移动 C团队想把两者结合 设计很复杂的多阶段流水线,效果反而变差 核心矛盾:人的行走是一个整体------你怎么摆手臂会影响平衡,进而影响你走哪条路。分开研究就像"盲人摸象"。

SimpliHuMoN 的解决方案:一个"统一大脑"

┌─────────────────────────────────────────┐ │ 你的观察(过去2秒) │ │ [他在(x,y,z)位置,身体各关节角度] │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ 简单处理:把位置和姿态变成数字向量 │ │ (就像把照片变成手机能理解的二进制) │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ 核心:一个 Transformer "解码器" │ │ │ │ 关键创新:把"过去的信息"和"未来的问题" │ │ 拼接在一起,让模型自己学会"联想" │ │ │ │ 过去:"他刚才在走路,左手摆动..." │ │ 问题:"接下来2秒他会怎样?" │ │ → 模型自己找出"过去→未来"的规律 │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ 输出:K个可能的未来(不是只猜一个) │ │ 猜测1:继续直走,手臂正常摆动 │ │ 猜测2:突然转弯,身体倾斜 │ │ 猜测3:停下来,站直了 │ │ ... │ │ 训练时只优化最接近真相的那个猜测 │ └─────────────────────────────────────────┘

三个关键设计(大白话版)

1. "查询"机制------像搜索引擎一样提问

模型内部有一组可学习的"问题模板"(叫做 Queries),就像:

"第1秒他在哪?身体什么姿态?"

"第2秒他在哪?身体什么姿态?"

...

这些模板一开始是随机的,但训练后学会了**"应该怎么问才能得到好的预测"**。

💡 类比:就像你问 ChatGPT 问题时,学会加"请详细解释"会得到更好的回答

2. 统一注意力------让过去和未来"互相看见"

传统做法:

过去信息 → [编码器] → 压缩 → [解码器] → 未来预测 (单向流动,像流水线)SimpliHuMoN:

过去信息 + 未来查询 → [统一处理] → 预测 (所有人互相交流,像开讨论会)好处:模型可以灵活地"回头看"任何时刻的信息,而不是被固定流程限制。

3. 多模态输出------不只猜一个答案

人未来的动作是不确定的。比如一个人站在路口:

可能直走

可能左转

可能停下打电话

模型同时输出 K=6(或20)个可能版本,覆盖各种合理情况。

训练技巧(Winner-Takes-All):

6个猜测中,哪个最接近真实未来,就只优化那个

其他5个"自生自灭",自然学会覆盖不同的可能性

结果:6个模式使用率几乎均匀(各~16.7%),没有"偷懒"只学一种

为什么简单反而更强?

复杂模型的做法 SimpliHuMoN 的做法 用图神经网络(GCN)强行编码人体骨骼结构 让注意力机制自己学关节间的关系 用离散余弦变换(DCT)在频域处理 直接在时域用Transformer学 多阶段流水线(先预测轨迹→再预测姿态) 端到端一次预测 引入预训练大模型(如CLIP)提供先验知识 只从运动数据本身学习 核心洞察:Transformer 的注意力机制本身就足够强大,不需要人为设计的"先验知识"来限制它。给它足够的数据,它能自己发现"左手和右手通常反向摆动"这样的规律。

实际效果(量化对比)

在多个基准测试上,这个"简单模型"打败了各种"花里胡哨"的专用模型:

表格

任务 数据集 相比之前最好的方法 姿态预测 Human3.6M FDE 降低(更好) 轨迹预测 ETH-UCY 平均ADE/FDE并列第一 联合预测 MOCAP-UMPM APE降低10.3%,JPE降低15% 计算速度 - 比轻量级EMPMP快1.8倍

一个形象的类比

想象你要教机器人预测人类动作:

以前的方法:请三个专家(轨迹专家、姿态专家、融合专家),让他们接力工作,还要设计复杂的沟通协议

SimpliHuMoN:雇一个聪明的实习生,给他看大量视频,让他自己悟出"人走路的规律"

结果:实习生不仅学得更快,预测还更准确------因为他不受"专家偏见"的限制,能从整体角度理解运动。

总结

这篇论文的核心启示:

"不要把简单问题复杂化。Transformer 本身就很强,给它合适的数据和训练方式,它能自己搞定人体运动预测的各种任务。"

这也是为什么作者把模型叫做 SimpliHuMoN (Simplifying Human Motion)------简化,而不是复杂化,才是前进的方向。

四、注意力机制

我想问几个问题,你说的这个通俗理解我理解了,你说的通俗理解就是说把过去的信息作为经验,基于这个经验去提问然后得到可能的预测对吧,但是我还不理解你说的这个通俗理解跟作者设计的注意力机制怎么对应起来,因为你前面提到了标准编码器-解码器,这个怎么通俗理解呢?然后你还提到 SimpliHuMoN堆叠 L 层自注意力,还可视化了四个象限都有强注意力,证明双向学习,那这不就是有交叉注意力了吗,怎么会是说堆叠 L 层自注意力?还有如果真的是四个象限都有强注意力,跟你的通俗理解对不上啊,你的通俗理解看起来像是"理解过去的自注意力"+"基于过去查询未来的交叉注意力",难道说有一个对称的关系使得模型也可以从未来推测过去吗?还有就是能不能对比一下SimpliHuMoN在运用注意力机制和可学习权重矩阵方面与标准编码器-解码器、DETR、SAM2跟踪的区别和联系?

非常好的问题!你抓住了关键矛盾。让我重新梳理,把通俗理解 和技术实现严格对应起来,并澄清那些容易混淆的概念。

一、先澄清核心误区

误区1:"四个象限都有强注意力 = 有交叉注意力"

不是! 这里的关键在于:统一自注意力(Self-Attention)本身就是"全连接"的。

标准交叉注意力(Cross-Attention): - 查询(Query)来自一个序列 - 键/值(Key/Value)来自另一个序列 - 信息流是单向的:KV序列 → Q序列 统一自注意力(Unified Self-Attention): - 查询、键、值都来自同一个拼接序列 [C; Q] - 信息流是多向的:序列中的每个位置都能看到所有其他位置可视化解释:

拼接序列 [C; Q] = [c1, c2, c3, ..., cH, q1, q2, ..., qF] ↑_________↑ 这整个东西一起做Self-Attention 注意力矩阵((H+F) × (H+F)): c1 c2 c3 q1 q2 q3 ┌────┬────┬────┬────┬────┬────┐ c1 │ ● │ ● │ ● │ ● │ ● │ ● │ ← c1能看到所有人(包括未来查询) ├────┼────┼────┼────┼────┼────┤ c2 │ ● │ ● │ ● │ ● │ ● │ ● │ ├────┼────┼────┼────┼────┼────┤ c3 │ ● │ ● │ ● │ ● │ ● │ ● │ ├────┼────┼────┼────┼────┼────┤ q1 │ ● │ ● │ ● │ ● │ ● │ ● │ ← q1也能看到所有人(包括过去上下文) ├────┼────┼────┼────┼────┼────┤ q2 │ ● │ ● │ ● │ ● │ ● │ ● │ ├────┼────┼────┼────┼────┼────┤ q3 │ ● │ ● │ ● │ ● │ ● │ ● │ └────┴────┴────┴────┴────┴────┘ ● = 可以有注意力连接(Self-Attention允许全连接)论文中的"四个象限":

左上(C→C):过去看过去(时序依赖)

右上(C→Q):过去看未来(这是对称结构自然产生的,不是显式设计的交叉注意力)

左下(Q→C):未来看过去(主要的信息流)

右下(Q→Q):未来看未来(未来时刻间的依赖,比如第2秒依赖第1秒的预测)

关键 :这不是"编码器-解码器"架构,而是把两个序列拼成一个序列,做纯粹的Self-Attention。

误区2:"从未来推测过去"是对称的?

不是对称学习! 虽然注意力矩阵在数学上是对称的(A能看到B,B就能看到A),但实际信息流是有方向的:

训练时的真实流向: - 查询Q(代表"未来时刻")主要去Attend上下文C("过去发生了什么") - 上下文C也会Attend Q,但Q在初始时几乎是随机噪声(可学习参数) - 随着训练,模型学会:Q应该"询问"C来获取预测信息 所以有效信息流主要是:C → Q论文可视化显示四个象限都有注意力,说明:

C→C:模型在学习时序动态(比如走路的周期性)

Q→C:主要预测依据(查询历史)

Q→Q:未来时刻间的自洽性(比如第3秒的预测要与第2秒连贯)

C→Q:相对较弱,可能是噪声或辅助信息

二、严格对应:通俗理解 ↔ 技术实现

通俗说法 技术对应 具体是什么 "把过去信息作为经验" 上下文张量 C 历史轨迹+姿态的嵌入表示 "基于经验去提问" 查询张量 Q 可学习的"问题模板",代表未来F个时刻的"空位" "模型回答问题" Transformer解码器 通过Self-Attention让Q从C中提取信息并填充 "得到多个可能预测" 多模态预测头 把Z投影到K个分支,每个分支是一个完整预测 "双向学习" 统一Self-Attention Q和C在同一个序列中,互相都能看到对方 关键理解 :Q 不是"问题",而是**"待填充的答案模板"**。

更准确的白话:

C = "这是过去2秒的事实"

Q = "这是接下来3秒的6个空位(第1秒在哪、第2秒在哪...),请根据事实填写"

Self-Attention = "空位们互相讨论,并查阅事实档案,最终填上合理的答案"

三、对比:SimpliHuMoN vs 其他架构

1. vs 标准编码器-解码器(如原始Transformer用于翻译)

标准Enc-Dec(如英译德): ┌─────────┐ ┌─────────┐ ┌─────────┐ │ 英文句子 │ → │ 编码器 │ → │ 上下文 │ │ (输入) │ │ (Self-Attn)│ │ 记忆 │ └─────────┘ └────┬────┘ └────┬────┘ │ │ │ ┌──────┴──────┐ │ │ 交叉注意力 │ │ │ (Cross-Attn) │ │ │ Q来自德语, │ │ │ KV来自英文 │ │ └──────┬──────┘ │ │ │ ┌──────┴──────┐ └────────→│ 解码器 │ │ (Masked Self-Attn │ + Cross-Attn) │ └──────┬──────┘ ↓ 德语句子(输出) 关键:编码器和解码器是分离的,信息通过专门的Cross-Attn流动 SimpliHuMoN: ┌─────────────────────────────────────────┐ │ 输入:过去轨迹+姿态 (C) + 未来空位 (Q) │ │ 直接拼接:[C; Q] │ │ │ │ ↓ 统一Self-Attention(L层) │ │ 没有单独的编码器/解码器 │ │ 没有显式的Cross-Attention │ │ │ │ 输出:填充好的未来预测 │ └─────────────────────────────────────────┘ 关键:端到端,一个模块搞定,C和Q地位平等(虽然功能不同)

对比项 标准Enc-Dec SimpliHuMoN 模块数量 2个(编码器+解码器) 1个(统一解码器) 注意力类型 Self-Attn + Cross-Attn 只有Self-Attn 信息流 单向:编码器→解码器 多向:全连接,但有效流是C→Q 典型应用 机器翻译 时间序列预测 为什么这样设计 语言有明确的源/目标分离 运动预测中过去和未来是连续的

2. vs DETR(Detection Transformer)

DETR(目标检测): ┌─────────┐ ┌─────────┐ ┌─────────┐ │ 图片特征 │ → │ 编码器 │ → │ 全局记忆 │ │ (CNN提取)│ │ (Self-Attn)│ │ │ └─────────┘ └────┬────┘ └────┬────┘ │ │ │ ┌──────┴──────┐ │ │ 解码器 │ │ │ - 可学习对象查询│ │ │ - Cross-Attn │ │ │ (查询看图片) │ │ │ - Self-Attn │ │ │ (查询间交互) │ │ └──────┬──────┘ │ ↓ │ 检测框+类别 │ ↓ 严格分离:编码器处理图像, 解码器处理查询 SimpliHuMoN vs DETR: - 相似点:都有"可学习查询"(Object Queries / Future Queries) - 不同点:DETR保留Enc-Dec分离,SimpliHuMoN完全统一 - 原因:DETR处理的是图像(空间)→检测框(空间), SimpliHuMoN处理的是时间序列→时间序列,连续性更强

对比项 DETR SimpliHuMoN 查询用途 代表"可能的物体位置" 代表"未来的时间步" 查询数量 100个(固定候选框) F个(预测的时间步数) 架构 Enc-Dec分离 完全统一 注意力 Cross-Attn + Self-Attn 只有统一Self-Attn 查询间交互 解码器中有Self-Attn 统一序列中自然发生

3. vs SAM2(Segment Anything Model 2)的跟踪机制

SAM2(视频对象分割): ┌─────────────────────────────────────────┐ │ 记忆编码器(处理过去帧) │ │ - 空间编码 + 时间编码 │ │ - 存储到记忆库 │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ 当前帧提示(点击/框选) │ │ ↓ │ │ 交叉注意力:当前提示 ←→ 记忆库 │ │ (查询当前特征,键/值来自记忆) │ └─────────────────┬───────────────────────┘ ↓ 分割掩码输出 关键:有显式的"记忆库"和"当前帧"分离,Cross-Attn是核心

对比项 SAM2 SimpliHuMoN 记忆机制 显式记忆库(存储过去帧特征) 隐式记忆(C就是压缩的过去) 注意力类型 大量Cross-Attn 只有Self-Attn 查询来源 当前帧特征 + 用户提示 完全可学习参数(随机初始化) 时间处理 记忆库有复杂的时间位置编码 简单正弦位置编码 设计哲学 显式分离"记忆"和"当前" 统一处理,让模型自己决定怎么用

四、核心区别总结表

架构 注意力机制 查询(Query)来源 键/值(Key/Value)来源 核心设计思想 标准Enc-Dec Self-Attn + Cross-Attn 解码器输入 编码器输出(Cross时) 源/目标严格分离 DETR Self-Attn + Cross-Attn 可学习对象查询 图像特征 对象查询检测物体 SAM2 Cross-Attn为主 当前帧+用户提示 记忆库 显式记忆检索 SimpliHuMoN 统一Self-Attn 可学习未来查询(与C拼接) 同一拼接序列 端到端统一,无显式分离

五、回答你的具体问题

Q1: "四个象限都有强注意力"怎么理解?

A : 这是Self-Attention的数学性质,不是设计选择。

Self-Attention公式:Attention(Q,K,V) = softmax(QK^T/√d)V 当Q, K都来自同一个序列[C;Q]时: - 序列中每个位置都能attend到其他所有位置 - 所以C能看到Q,Q也能看到C - 但训练后,有效的注意力权重(softmax后的值)会集中在有用的连接上论文可视化显示四个象限都有"亮色",说明:

模型没有"浪费"任何连接

C→C:学习时序模式(走路周期)

Q→C:主要预测依据

Q→Q:保证预测连贯性

C→Q:辅助信息(较弱)

Q2: 有没有"从未来推测过去"?

A: 数学上有,物理意义上没有。

训练时,未来Q是随机初始化的可学习参数,不含真实信息

所以C→Q的注意力,早期是"看噪声",后期可能学到"辅助验证"

没有监督信号要求模型"预测过去",所以不会真正发展出这个能力

Q3: 为什么强调"堆叠L层Self-Attention"?

A : 为了强调简单性------作者刻意避免使用:

显式Cross-Attention(省掉一个模块)

编码器-解码器分离(省掉一半架构)

复杂的位置编码或记忆机制

只用最基本的Transformer组件(Self-Attn + FFN)堆叠,证明"简单即强大"。

六、最精确的通俗理解(修正版)

┌─────────────────────────────────────────┐ │ 输入:过去2秒的运动视频帧 │ │ (包含:人在哪 + 身体各关节怎么摆) │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ Step 1: 数字化 │ │ - 位置数据:变成3维坐标序列 │ │ - 姿态数据:变成关节角度序列 │ │ - 统一格式:都投影到192维的向量空间 │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ Step 2: 创建"未来空位" │ │ - 不是真的未来,是6个"待填充的槽位" │ │ - 每个槽位代表"第t秒的位置+姿态" │ │ - 这些槽位是"可学习的问号" │ │ (训练前:随机;训练后:知道怎么问) │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ Step 3: 统一处理(核心!) │ │ │ │ 把"过去事实"和"未来空位"拼成一个长列表: │ │ [过去1帧, 过去2帧, ..., 过去H帧, │ │ 未来1空位, 未来2空位, ..., 未来F空位] │ │ │ │ ↓ 扔进6层(或16层)Self-Attention │ │ │ │ 规则:列表中的每个位置都可以"看"其他所有位置│ │ │ │ 实际发生的学习: │ │ - 未来空位主要"偷看"过去事实(Q→C) │ │ - 过去事实互相"确认"时序关系(C→C) │ │ - 未来空位互相"协调"保持一致(Q→Q) │ │ │ │ 输出:填充好的未来序列 │ └─────────────────┬───────────────────────┘ ↓ ┌─────────────────────────────────────────┐ │ Step 4: 生成多个版本 │ │ - 把填充结果复制K份(如6份) │ │ - 每份微调成不同的合理未来 │ │ (直行版、转弯版、停下版...) │ │ - 训练时只保留最接近真相的版本 │ └─────────────────────────────────────────┘最核心的一点 :SimpliHuMoN的查询(Q)不是去"询问"外部知识库 ,而是在同一个序列内部通过Self-Attention让信息自然流动。没有专门的"提问-回答"机制,而是"大家坐在一起讨论,各自填好自己的答案"。

这就是为什么它比Enc-Dec更简单,却更有效------减少了人为设计的信息流限制,让模型自己发现最优的信息传递路径。

五、与GPT的区别和联系

你提到其他使用交叉注意力机制的原因是两个事物是分离的,比方说SAM2中显式分离"记忆"和"当前",这我就不理解了,SAM2作为跟踪任务,它的记忆跟当前也是有显著的连续关系的呀,包括你提到的因为空间的关系而分离的,空间跟时间不也一样也是有连续关系的吗?还有就是你能说一下跟GPT又有什么区别和联系吗?GPT是预测下一个token的,它难道也有类似这种自注意力的做法吗?

非常好的追问!你触及了这些架构设计背后的核心哲学差异。让我逐一澄清这些看似矛盾的地方。

一、为什么"有连续关系"还要分离?

你的困惑很合理:既然记忆和当前、空间和时间都有连续性,为什么还要显式分离?

关键区分:物理连续性 ≠ 架构必须统一

场景 连续性的本质 为什么可以/需要分离 SimpliHuMoN的时间 同一人体运动的连续帧 必须统一:过去和未来是同一物理过程的延续,不可分割 SAM2的记忆vs当前 视频帧的时间连续,但对象可能变化 可以分离:过去帧是"已冻结的历史",当前帧是"正在处理的新输入" 翻译的源语言vs目标语言 语义连续,但符号系统完全不同 必须分离:英语和德语是不同的表示空间 SAM2的具体例子

场景:跟踪一个人在视频中走动 SAM2的分离逻辑: ┌─────────────────────────────────────────┐ │ 记忆库(过去帧1,2,3...) │ │ - 这个人已经"被理解"过了 │ │ - 存储的是"已知对象的特征" │ │ - 历史是静态的、可靠的 │ └─────────────────┬───────────────────────┘ ↓ Cross-Attention ┌─────────────────────────────────────────┐ │ 当前帧(新看到的图像) │ │ - 需要"识别这是谁" │ │ - 查询当前图像特征 │ │ - 去记忆库中"检索"相似对象 │ └─────────────────────────────────────────┘ 关键差异:SAM2处理的是"识别匹配"问题 - 记忆是固定的参考数据库 - 当前是查询请求 - 类似于"人脸识别系统中,用当前照片去数据库匹配"对比SimpliHuMoN:

SimpliHuMoN的场景: - 没有"识别"问题,只有"延续"问题 - 过去和未来是同一个数学流形上的点 - 不需要"检索",只需要"外推"空间任务为什么也可以分离?

以DETR为例:

图像(空间)→ 检测框(空间)看似连续,但: - 图像特征是密集的、局部的(CNN提取的像素级特征) - 检测框是稀疏的、全局的(4个坐标+类别) - 这是两种不同的"表示空间"(像素空间 vs 语义空间) 所以需要: 1. 编码器:把像素空间编码成语义特征 2. 解码器:用对象查询在语义空间中"搜索"SimpliHuMoN的特殊性:

输入和输出是同质的(都是3D坐标序列)

都在同一个欧几里得空间中

不需要"空间转换",只需要"时间外推"

二、SimpliHuMoN vs GPT:核心联系与区别

这是最有深度的问题。两者确实非常相似,但有微妙而关键的区别。

架构对比

GPT(Decoder-only LM): ┌─────────────────────────────────────────┐ │ 输入:token序列 [t1, t2, t3, ..., tn] │ │ │ │ 因果掩码(Causal Masking): │ │ t1 t2 t3 t4 │ │ t1 [●] [ ] [ ] ← t1只能看自己 │ │ t2 [●] [●] [ ] ← t2看t1,t2 │ │ t3 [●] [●] [●] [ ] │ │ t4 [●] [●] [●] [●] ← t4看所有过去 │ │ │ │ 训练任务:预测下一个token │ │ t1→t2, t2→t3, t3→t4(每个位置都训练) │ │ │ │ 推理时:自回归生成 │ │ 生成t1 → 拼接 → 生成t2 → 拼接 → ... │ └─────────────────────────────────────────┘ SimpliHuMoN: ┌─────────────────────────────────────────┐ │ 输入:[过去C | 未来Q] │ │ [c1,c2,c3 | q1,q2,q3] │ │ │ │ 无掩码(或双向掩码): │ │ c1 c2 c3 q1 q2 q3 │ │ [●] [●] [●] [●] [●] [●] 全连接 │ │ [●] [●] [●] [●] [●] [●] 所有人看所有人 │ │ ... │ │ │ │ 训练任务:填充未来空位 │ │ 只优化Q部分的输出,C部分输入固定 │ │ │ │ 推理时:一次前向传播 │ │ 不需要自回归,直接输出完整未来 │ └─────────────────────────────────────────┘核心区别表

特性 GPT SimpliHuMoN 注意力掩码 因果掩码(只看过去) 无掩码/双向(看全部) 查询来源 前一个token的隐藏状态 可学习参数(随机初始化) 训练目标 逐token预测(多步监督) 一次性填充(单步监督) 推理方式 自回归(逐个生成) 非自回归(一次出全序列) 序列位置 训练时滑动窗口,位置可变 固定长度,位置固定 输出确定性 条件生成(依赖已生成的) 并行多假设(K个独立分支) 为什么有这些区别?

1. 因果掩码 vs 双向注意力

GPT必须用因果掩码的原因: - 语言是"真正的序列生成":说第N个词时,只能基于已说的N-1个词 - 如果让t3看到t4,就是"作弊"(看到了未来的自己) SimpliHuMoN可以不用掩码的原因: - 运动预测是"一次性外推":给定2秒历史,直接预测3秒未来 - 未来帧在输入时只是"空位标记",不是真实信息 - 没有"作弊"问题,因为q1,q2,q3初始是随机噪声,不含真实未来2. 自回归 vs 非自回归

GPT自回归的优劣: + 优势:可以生成任意长度,适合开放式文本 - 劣势:慢(必须逐个生成),错误累积(前面错了后面跟着错) SimpliHuMoN非自回归的优劣: + 优势:快(一次前向),并行生成K个假设 - 劣势:固定输出长度(F帧),不适合变长生成3. 可学习查询 vs 隐藏状态传递

GPT的"查询": - 第N个位置的查询 = 第N-1个位置的输出隐藏状态 - 是"内容驱动的",依赖已生成的语义 SimpliHuMoN的查询: - 是"结构驱动的"固定槽位 - 学习的是"这个时间步应该问什么" - 类似于BERT的[MASK]标记,但扩展到了整个序列

三、更深层的联系:都是"Next Token Prediction"?

从广义上看,两者都是预测未来,但操作方式不同:

GPT的视角: "给定上下文,下一个token是什么?" → 迭代应用,得到完整序列 SimpliHuMoN的视角: "给定历史,这个固定长度的未来序列是什么?" → 一次应用,并行预测所有时刻数学上的统一性:

都可以看作是在学习条件分布 P(Xfuture∣Xpast)

GPT用链式法则分解:P(t1)P(t2∣t1)P(t3∣t1,t2)...

SimpliHuMoN直接建模联合分布:P(q1,q2,q3∣c1,c2,c3)

四、为什么SimpliHuMoN不用GPT的方式?

关键原因:运动的物理约束

语言的特点: - 离散符号(词汇表几万) - 组合性无限(可以造新句子) - 语义连贯即可,物理约束弱 人体运动的特点: - 连续数值(3D坐标) - 强物理约束(骨骼长度固定、关节活动范围有限) - 时序连贯性强(第2秒的pose必须与第1秒物理连续) GPT的自回归方式对运动的问题: 1. 误差累积严重:第1帧预测偏了1cm,第10帧可能偏了10cm 2. 物理约束难保证:逐帧生成容易违反骨骼约束 3. 多模态难表达:语言通常是单义的,运动是多义的(可直走可转弯) SimpliHuMoN的并行预测优势: 1. 一次性优化整个序列,可以加入全局物理约束 2. K个并行分支自然表达多模态(多个合理未来) 3. 注意力机制可以看到完整上下文,保持长期连贯性

五、总结:架构选择的哲学

设计选择 背后的假设 适用场景 Enc-Dec分离 输入/输出是不同表示空间 翻译、图像→文本 Cross-Attention 需要显式检索/匹配 跟踪、检测、检索 因果掩码+自回归 开放式生成,长度不定 文本、语音 双向注意力+并行 固定长度,强物理约束 运动预测、时间序列 可学习查询 输出结构固定且已知 检测、预测、分割 SimpliHuMoN的核心洞察:

人体运动预测不是"检索问题"(去记忆里找相似),也不是"开放式生成问题"(想说多长说多长),而是**"物理外推问题"**------给定过去状态,用物理规律推算未来状态。

因此它选择了最简化的方案:

不用Enc-Dec(不是检索)

不用因果掩码(不是自回归生成)

只用统一Self-Attention(端到端外推)

这就是为什么作者强调"Simplifying"------去掉所有不必要的架构复杂性,让模型专注于学习运动动力学本身。

六、模型架构设计问题

你能不能总结一下(不仅基于这个上下文而是AI发展史)优秀的模型架构通常有哪些设计路线,尤其是注意力的机制如何设计,它们的区别是因为什么,联系是什么

这是一个非常有深度的问题。让我从AI发展史的角度,系统梳理优秀模型架构的设计路线,特别是注意力机制的演进。

一、架构演进的三大范式

┌─────────────────────────────────────────────────────────────────┐ │ AI架构演进时间线 │ ├─────────────────────────────────────────────────────────────────┤ │ │ │ 2017前:专用架构时代 │ │ ├── CNN(图像)→ 局部感知,权重共享 │ │ ├── RNN/LSTM/GRU(序列)→ 时序建模,梯度传播困难 │ │ └── GNN(图结构)→ 关系推理 │ │ │ │ 2017:Transformer革命 │ │ └── "Attention is All You Need" → 统一架构的曙光 │ │ │ │ 2020-2023:统一化与专业化拉锯 │ │ ├── 视觉:ViT(2020)→ 纯Transformer做图像 │ │ ├── 多模态:CLIP(2021)→ 对比学习统一图文 │ │ ├── 生成:Diffusion(2022)→ 新的生成范式 │ │ └── 专业化:各种领域专用Transformer变体 │ │ │ │ 2023-至今:收敛与再统一 │ │ ├── GPT-4/Claude → 大统一模型(AGI尝试) │ │ ├── Mamba/RWKV → 线性注意力挑战二次复杂度 │ │ └── 本文SimpliHuMoN → "回归简单"的宣言 │ │ │ └─────────────────────────────────────────────────────────────────┘

二、注意力机制的设计谱系

2.1 核心分类维度

注意力设计的四个关键选择: 1. 查询(Q)的来源 ├── 来自输入本身(Self-Attention) ├── 来自外部引导(Cross-Attention) └── 可学习参数(Learnable Queries) 2. 键值(K,V)的来源 ├── 与Q同源(Self) ├── 与Q异源(Cross) └── 混合来源(Hybrid) 3. 连接模式(Connectivity) ├── 全连接(Full) ├── 因果/单向(Causal) ├── 局部窗口(Local/Sliding Window) ├── 稀疏/随机(Sparse/Random) └── 分层/金字塔(Hierarchical) 4. 计算复杂度 ├── 二次复杂度 O(n²) → 标准Attention └── 线性复杂度 O(n) → Linear Attention, Mamba, RWKV2.2 历史演进路线图

┌─────────────────────────────────────────────────────────────────┐ │ 注意力机制演进树 │ ├─────────────────────────────────────────────────────────────────┤ │ │ │ 根节点:Bahdanau Attention (2015) │ │ └── 软注意力机制,用于Seq2Seq的RNN │ │ ↓ │ │ 节点1:Self-Attention / Transformer (2017) │ │ ├── 核心创新:Q,K,V都来自同一序列,并行计算 │ │ ├── 设计哲学:"注意力就是全部"(抛弃RNN/CNN) │ │ └── 复杂度:O(n²d),n为序列长度 │ │ ↓ │ │ ├─分支A:生成式建模(Decoder-only) │ │ │ ├── GPT系列 (2018-2024) │ │ │ │ └── 因果掩码Self-Attn → 自回归生成 │ │ │ ├── PaLM/Gemini (2022-2024) │ │ │ │ └── 多查询注意力(MQA)/分组查询注意力(GQA) │ │ │ │ → 推理加速,减少KV Cache │ │ │ └── 本文SimpliHuMoN (2026) │ │ │ └── 无掩码Self-Attn → 非自回归并行预测 │ │ │ │ │ ├─分支B:理解式建模(Encoder-only) │ │ │ └── BERT (2018) │ │ │ └── 双向Self-Attn + [MASK]标记 → 填空式理解 │ │ │ │ │ ├─分支C:序列转换(Encoder-Decoder) │ │ │ ├── 原始Transformer (2017) │ │ │ │ └── Self-Attn + Cross-Attn分离 │ │ │ ├── BART/T5 (2019-2020) │ │ │ │ └── 去噪/前缀语言建模 │ │ │ ├── DETR (2020) │ │ │ │ └── 对象查询 + Cross-Attn → 集合预测 │ │ │ ├── SAM/SAM2 (2023-2024) │ │ │ │ └── 记忆库 + Cross-Attn → 视频分割 │ │ │ └── Perceiver/Perceiver IO (2021-2022) │ │ │ └── 潜在瓶颈 + 深层Cross-Attn → 任意输入输出 │ │ │ │ │ └─分支D:高效注意力变体 │ │ ├── Linear Attention (2020) │ │ │ └── 核技巧:softmax(QK^T)V → φ(Q)(φ(K)^TV) │ │ │ → 复杂度O(nd²) │ │ ├── Performer (2021) │ │ │ └── 随机特征映射近似核函数 │ │ ├── BigBird/Longformer (2020) │ │ │ └── 全局token + 局部滑动窗口 + 随机稀疏 │ │ ├── FlashAttention (2022) │ │ │ └── IO感知的分块计算,不改变理论复杂度但大幅加速 │ │ ├── Mamba (2023) │ │ │ └── 选择性状态空间模型(S6),O(n)复杂度 │ │ │ → "Attention is not All You Need"的回潮 │ │ └── RWKV (2023) │ │ └── RNN-like并行训练 + Transformer-like推理 │ │ │ └─────────────────────────────────────────────────────────────────┘

三、四大设计路线深度对比

3.1 路线一:生成式统一(GPT范式)

设计哲学:所有任务都是"下一个token预测" 架构特征: ┌─────────────────────────────────────────┐ │ 纯Decoder,因果掩码Self-Attention │ │ ├── 只能看过去,不能看未来 │ │ ├── 自回归生成:逐个token输出 │ │ └── 训练:每个位置都预测下一个 │ │ (t1→t2, t2→t3, ..., tn→tn+1) │ └─────────────────────────────────────────┘ 注意力设计: - Q:前一层的隐藏状态 - K,V:所有过去位置的隐藏状态 - 掩码:上三角为-∞(softmax后≈0) 优势: + 天然适合开放式生成(文本、代码、音乐) + 训练数据极易获取(任何文本都行) + 规模效应显著(越大越强) 劣势: - 推理慢(必须串行) - 错误累积(前错后错) - 对结构化/连续数据不友好(如3D坐标) 代表:GPT-4, Claude, Llama, SimpliHuMoN(借用其Decoder-only但改造)3.2 路线二:理解式统一(BERT范式)

设计哲学:所有任务都是"填空" 架构特征: ┌─────────────────────────────────────────┐ │ 纯Encoder,双向Self-Attention │ │ ├── 看全部上下文(过去+未来) │ │ ├── [MASK]标记表示待填的空 │ │ └── 训练:预测被mask掉的token │ └─────────────────────────────────────────┘ 注意力设计: - Q,K,V:全部来自同一序列 - 无掩码(或双向掩码) - 位置编码:绝对/相对/旋转(RoPE) 优势: + 理解能力强(分类、抽取、匹配) + 训练稳定(双向监督信号密集) + 适合有标注数据的任务 劣势: - 不直接支持生成(需要额外解码策略) - 被GPT范式在通用性上超越 代表:BERT, RoBERTa, ALBERT, DeBERTa3.3 路线三:检索-生成混合(Enc-Dec范式)

设计哲学:先理解/编码,再检索/生成 架构特征: ┌─────────────────────────────────────────┐ │ Encoder + Decoder分离 │ │ ├── Encoder:双向处理输入,建"记忆" │ │ ├── Cross-Attention:Decoder查询Encoder│ │ └── Decoder:自回归生成输出 │ └─────────────────────────────────────────┘ 注意力设计(双层): Encoder层:Self-Attn(输入→输入) Decoder层: - Self-Attn(输出→输出,因果掩码) - Cross-Attn(输出→输入,Q来自输出,KV来自输入) 优势: + 输入输出异构时的桥梁(如翻译、图像描述) + 可显式控制信息流(检索vs生成) + 适合需要"查找+综合"的任务 劣势: - 架构复杂,训练不稳定 - 信息瓶颈(Encoder压缩可能损失细节) 变体演进: ┌─────────────────────────────────────────┐ │ DETR (2020):对象查询替代RPN/Anchor │ │ ├── 查询是可学习参数(非来自输入) │ │ └── 集合预测(无序输出,匈牙利匹配) │ ├─────────────────────────────────────────┤ │ SAM (2023):提示编码器 + 掩码解码器 │ │ ├── 查询 = 用户点击/框的编码 │ │ └── 轻量级解码,实时交互 │ ├─────────────────────────────────────────┤ │ Perceiver (2021):潜在数组瓶颈 │ │ ├── 查询 = 固定数量的潜在token │ │ └── 处理超长输入(如视频、点云) │ └─────────────────────────────────────────┘ 代表:T5, BART, DETR, SAM, 原始Transformer3.4 路线四:状态空间与线性化(Mamba范式)

设计哲学:RNN的并行训练 + Transformer的表达能力 核心问题:标准Attention的O(n²)复杂度是瓶颈 架构演进: RNN(1986)→ LSTM/GRU(1997)→ Transformer(2017)→ S4/Mamba(2023) S4/Mamba的关键洞察: ┌─────────────────────────────────────────┐ │ 连续系统视角:ẋ = Ax + Bu │ │ ├── A:状态转移矩阵(捕捉长程依赖) │ │ ├── B:输入投影 │ │ └── 离散化后:h_t = Āh_{t-1} + B̄x_t │ │ │ │ 选择性机制(Mamba): │ │ ├── B, C, Δ(离散化步长)都变成输入依赖 │ │ └── 每个token有自己的A,B,C → 选择性记忆 │ └─────────────────────────────────────────┘ 与Attention的关系: - Attention:所有过去token平等竞争(QK^T) - Mamba:通过状态压缩,隐式选择重要信息 优势: + O(n)复杂度,超长序列(百万token) + 推理快(像RNN一样常数时间迭代) + 适合连续信号(音频、DNA、传感器) 劣势: - 表达能力理论上弱于Full Attention - 对离散符号任务(如代码)优势不明显 代表:S4, Mamba, RWKV, RetNet, Griffin

四、注意力设计的决策树

当你设计一个新模型时,如何选择注意力? ┌─────────────────┐ │ 输入输出是否同质? │ └────────┬────────┘ │ ┌─────────────────┼─────────────────┐ │是 │否 ↓ ↓ ┌─────────────┐ ┌─────────────┐ │ 序列是否很长?│ │ 需要检索吗? │ │ (>10k tokens)│ │ (从记忆找信息) │ └──────┬──────┘ └──────┬──────┘ │ │ ┌──────┼──────┐ ┌──────┼──────┐ │是 │否 │是 │否 ↓ ↓ ↓ ↓ ┌───────┐ ┌─────────┐ ┌───────┐ ┌─────────┐ │Mamba/ │ │ 生成? │ │Cross- │ │Enc-Dec │ │RWKV │ └────┬────┘ │Attention│ 分离 │ │ │ │ │+记忆库 │ (T5风格) │ └───────┘ ┌────┼────┐ └───────┘ └─────────┘ │是 │否 ↓ ↓ ┌─────────┐ ┌─────────┐ │GPT风格 │ │BERT风格 │ │因果 │ │双向 │ │Self-Attn│ │Self-Attn│ │+MQA/GQA│ │ │ └─────────┘ └─────────┘ 特殊设计: - 需要多模态并行预测 → SimpliHuMoN风格(统一Self-Attn) - 需要集合输出(无序)→ DETR风格(对象查询) - 需要实时交互 → SAM风格(轻量解码器)

五、联系与区别的本质

5.1 统一性:都是"动态加权聚合"

所有注意力机制的通用形式: 输出 = Σ (相似度(查询, 键) × 值) i Self-Attention: Q,K,V来自同一序列 → "自我更新" Cross-Attention: Q≠K,V → "外部查询" Linear Attention: 核技巧近似 → "效率优先" State Space: 递归状态压缩 → "在线压缩" 共同点:都是根据相似性动态选择信息 区别点:相似性怎么算、信息从哪来、计算多快5.2 分歧的根本原因:任务本质不同

┌─────────────────────────────────────────────────────────────┐ │ 任务类型决定架构 │ ├─────────────────────────────────────────────────────────────┤ │ │ │ 任务特征 推荐架构 注意力设计 │ │ ───────────────────────────────────────────────────────── │ │ 开放式生成 GPT/Decoder-only 因果Self-Attn │ │ (文本、代码) + 自回归 │ │ │ │ 理解/填空 BERT/Encoder-only 双向Self-Attn │ │ (分类、NER) + [MASK] │ │ │ │ 异构转换 T5/Enc-Dec Self + Cross │ │ (翻译、摘要) 分离 │ │ │ │ 集合预测 DETR 可学习查询 │ │ (检测、分割) + Cross-Attn │ │ │ │ 连续信号预测 SimpliHuMoN 统一Self-Attn │ │ (运动、时间序列) Mamba 无掩码/线性 │ │ │ │ 超长序列 Mamba/RWKV 线性复杂度 │ │ (基因组、视频) 选择性状态 │ │ │ │ 实时交互 SAM 轻量解码器 │ │ (跟踪、编辑) + 记忆Cross-Attn │ │ │ └─────────────────────────────────────────────────────────────┘5.3 历史周期律:复杂化→简化→再复杂化→再简化

AI架构的钟摆效应: 2017-2020: 复杂化 ├── Transformer提出,大家疯狂加模块 ├── 各种Inductive Bias(先验知识)注入 │ (图结构、卷积、循环、显式物理约束) └── 模型越来越重,越来越专 2020-2023: 简化尝试 ├── "Attention is All You Need"被重新诠释 ├── ViT: 纯Transformer做视觉,不要CNN ├── GPT-3: 纯Scale,不要架构创新 └── 发现:简单+大数据 > 复杂+小数据 2023-2024: 再复杂化 ├── 多模态融合(图文音代码) ├── MoE(专家混合)、多Agent系统 └── 推理时计算增加(Test-time compute) 2024-至今: 再简化(本文SimpliHuMoN的位置) ├── "我们太复杂了,回到简单" ├── 去掉Cross-Attn,统一Self-Attn ├── 去掉Enc-Dec分离,端到端 └── 核心洞察:任务匹配 > 架构复杂 → 这不是倒退,而是"螺旋上升": 每次简化都基于对任务本质的更深刻理解

六、SimpliHuMoN的历史定位

┌─────────────────────────────────────────┐ │ SimpliHuMoN在架构史中的位置 │ ├─────────────────────────────────────────┤ │ │ │ 继承自: │ │ ├── GPT的Decoder-only简洁性 │ │ ├── DETR的可学习查询思想 │ │ └── Transformer的原始统一性 │ │ │ │ 区别于: │ │ ├── GPT的因果掩码(不需要,因为不是生成) │ │ ├── DETR的Cross-Attn(不需要,因为同质) │ │ └── 专用模型的复杂Inductive Bias │ │ │ │ 启示: │ │ "当任务足够明确(连续数值预测), │ │ 且输入输出同质时, │ │ 最简统一架构(纯Self-Attn) │ │ 优于复杂分离架构" │ │ │ │ 可能的影响: │ │ ├── 时间序列预测领域回归简单Transformer │ │ ├── 挑战"必须加物理约束"的教条 │ │ └── 推动"任务分析→架构选择"的理性化 │ │ │ └─────────────────────────────────────────┘

七、给实践者的建议

选择注意力架构的 checklist: □ 1. 明确定义任务的"时间方向性" - 必须自回归?→ 因果掩码 - 可以并行?→ 双向或无掩码 □ 2. 分析输入输出的"同质性" - 同质(同空间/同模态)→ 统一Self-Attn - 异质(图→文,文→图)→ Cross-Attn分离 □ 3. 评估序列长度的"压力" - <2k tokens → 标准Attention - 2k-10k → FlashAttention优化 - >10k → Linear Attention/Mamba □ 4. 确定输出的"结构性" - 序列(有序)→ 标准解码 - 集合(无序)→ 对象查询+匈牙利匹配 - 图/树 → 图神经网络+Attention □ 5. 考虑推理的"实时性要求" - 离线批处理 → 复杂度次要 - 实时交互 → 优先RNN-like/Mamba □ 6. 最后问自己: "我真的需要这个复杂设计吗?" "SimpliHuMoN的简化思路适用吗?"

优秀架构设计的终极原则:

"架构是假设的显式化。选择简单的假设,直到数据迫使你看复杂。" ------ 这是对SimpliHuMoN精神的最好概括。

七、理解、生成、预测

那些号称理解与生成统一的架构是怎样的呢?你认为能统一理解、生成、预测吗?存在这种架构吗?

这是一个触及AI终极愿景的问题。让我从历史和理论角度,系统分析"理解与生成统一"的架构,以及三者(理解、生成、预测)统一的可能性。

一、号称"理解与生成统一"的架构盘点

1.1 早期尝试:T5与BART(2019-2020)

plain

复制

T5(Text-to-Text Transfer Transformer): ┌─────────────────────────────────────────┐ │ 核心思想:所有NLP任务都是"文本到文本" │ │ │ │ 输入:"翻译:Hello world to French" │ │ 输出:"Bonjour le monde" │ │ │ │ 输入:"分类:This movie is great" │ │ 输出:"positive" │ │ │ │ 架构:标准Encoder-Decoder │ │ ├── 理解:Encoder双向处理 │ │ └── 生成:Decoder自回归输出 │ │ │ │ 统一性:接口统一(都是text2text) │ │ 非统一性:内部架构仍是分离的Enc-Dec │ └─────────────────────────────────────────┘ BART:类似思路,去噪自编码器预训练评价 :接口统一,架构分离。不是真正的统一。

1.2 GPT-4与大型多模态模型(2023-2024)

plain

复制

GPT-4/Claude/Gemini: ┌─────────────────────────────────────────┐ │ 核心思想:足够大的生成模型自动获得理解能力 │ │ │ │ 架构:纯Decoder-only(因果Self-Attn) │ │ 训练:下一个token预测(生成任务) │ │ │ │ 如何"理解"? │ │ ├── 通过生成预训练,内部形成丰富表示 │ │ ├── 理解任务被转化为生成任务 │ │ │ 例:"这句话的情感是→positive" │ │ └── In-context learning:通过提示"理解" │ │ │ │ 统一性: │ │ + 单一架构(Decoder-only) │ │ + 单一目标(next token prediction) │ │ - 理解是"涌现"的,非显式设计 │ │ - 效率问题:理解也要走自回归流程 │ └─────────────────────────────────────────┘评价 :生成主导,理解涌现。统一但不完美。

1.3 真正的双向-生成融合:XLNet, UniLM

plain

复制

XLNet(2019): ┌─────────────────────────────────────────┐ │ 核心:排列语言建模(Permutation LM) │ │ │ │ 训练:随机排列token顺序, │ │ 每个位置只能看到排列中的前面位置 │ │ (但排列是随机的,所以实际能看到 │ │ 上下文中的任意子集) │ │ │ │ 结果:兼具BERT的双向性和GPT的生成能力 │ │ │ │ 局限:训练复杂,实际效果不如纯GPT规模化 │ └─────────────────────────────────────────┘ UniLM(2019,微软): ┌─────────────────────────────────────────┐ │ 核心:统一语言模型 │ │ │ │ 架构:单一Transformer,通过掩码控制行为 │ │ ├── 双向掩码 → 理解(BERT模式) │ │ ├── 单向掩码 → 生成(GPT模式) │ │ └── 混合掩码 → Seq2Seq(翻译模式) │ │ │ │ 统一性:同一模型,不同掩码,多任务训练 │ │ 局限:需要显式指定模式,非自动切换 │ └─────────────────────────────────────────┘评价 :掩码控制的多模态统一,但不够优雅。

1.4 最新的"真统一"尝试:Mamba-2, Zamba, Griffin

plain

复制

Mamba-2(2024): ┌─────────────────────────────────────────┐ │ 核心:状态空间模型(SSM)与注意力的统一 │ │ │ │ 理论突破:证明SSM是线性注意力的特例 │ │ ├── 标准注意力:QK^T softmax → O(n²) │ │ ├── 线性注意力:核技巧 → O(n) │ │ └── SSM:递归状态压缩 → O(n) │ │ │ │ 统一框架: │ │ ├── 短程:类注意力机制(选择性) │ │ ├── 长程:类SSM机制(状态传递) │ │ └── 同一参数空间,动态切换 │ │ │ │ 意义:从理论上统一了"看全部"和"压缩历史" │ └─────────────────────────────────────────┘ Zamba(2024): ┌─────────────────────────────────────────┐ │ Mamba + Attention的显式混合 │ │ ├── 层级别交替:Mamba层 → Attention层 │ │ └── 试图结合两者优势 │ └─────────────────────────────────────────┘评价 :理论统一的开端,但工程化仍在探索。

1.5 视觉-语言-动作的"大一统":Gato, RT-2, GPT-4o

plain

复制

Gato(DeepMind, 2022): ┌─────────────────────────────────────────┐ │ 野心:一个模型做所有事 │ │ ├── 文本生成 │ │ ├── 图像分类 │ │ ├── 游戏操作(Atari) │ │ ├── 机器人控制 │ │ └── ... │ │ │ │ 方法:全部token化,统一序列建模 │ │ ├── 文本 → BPE tokens │ │ ├── 图像 → ViT patches │ │ ├── 动作 → 离散token │ │ └── 拼接成序列,因果自回归 │ │ │ │ 结果:通才但非专家,规模效应不明显 │ └─────────────────────────────────────────┘ GPT-4o(2024): ┌─────────────────────────────────────────┐ │ 端到端多模态:文本+音频+图像统一处理 │ │ ├── 统一神经网络处理所有模态 │ │ ├── 原生音频输出(非先转文本) │ │ └── 统一表示空间 │ │ │ │ 局限:仍是生成主导,理解是隐式的 │ │ 未知:是否内部有分离的"理解模块" │ └─────────────────────────────────────────┘

二、理解、生成、预测的本质差异

要谈统一,必须先理解这三者的计算本质:

plain

复制

┌─────────────────────────────────────────────────────────────┐ │ 三大任务的计算特征对比 │ ├─────────────────────────────────────────────────────────────┤ │ │ │ 维度 理解(Understanding) 生成(Generation) │ │ ─────────────────────────────────────────────────────────── │ │ 目标 提取/压缩信息 扩展/创造信息 │ │ 信息流 双向(看全部上下文) 单向(因果,过去→未来) │ │ 输出确定性 通常确定(分类/抽取) 内在随机(多模分布) │ │ 监督信号 密集(每个输入有标签) 稀疏(序列级损失) │ │ 评估标准 准确率、F1 多样性、质量、连贯性 │ │ 典型架构 Encoder/BERT Decoder/GPT │ │ 注意力模式 全可见 因果掩码 │ │ │ │ ───────────────────────────────────────────────────────── │ │ │ │ 维度 预测(Prediction) │ │ ─────────────────────────────────────────────────────────── │ │ 目标 基于历史外推未来 │ │ 信息流 历史→未来(单向),但未来结构已知 │ │ 输出确定性 物理约束强(连续值),但多模(多种可能) │ │ 监督信号 未来有真实值(监督学习) │ │ 评估标准 误差距离、物理合理性 │ │ 典型架构 SimpliHuMoN, 时间序列模型 │ │ 注意力模式 历史可见+未来并行填充(非自回归) │ │ │ │ 关键洞察: │ │ 理解 = 压缩(高维输入→低维表示) │ │ 生成 = 扩展(低维提示→高维输出) │ │ 预测 = 外推(同维历史→同维未来) │ │ │ └─────────────────────────────────────────────────────────────┘

三、统一的障碍:理论分析

3.1 信息论视角

plain

复制

理解 vs 生成的信息流向: 理解(如BERT): X → Z = argmax P(Z|X) (后验推断,压缩) ↑高维 ↑低维 生成(如GPT): Z → X ~ P(X|Z) (先验采样,扩展) ↑低维 ↑高维 预测(如SimpliHuMoN): X_past → X_future (同维映射) ↑同维 ↑同维 统一的问题: - 理解和生成是逆操作(压缩vs扩展) - 同一网络同时优化两者,梯度方向可能冲突 - 预测介于两者之间,但要求物理一致性3.2 因果性视角

plain

复制

Judea Pearl的因果阶梯: Level 1: 关联(Seeing) → 理解任务(识别模式) Level 2: 干预(Doing) → 预测任务(如果...会怎样) Level 3: 反事实(Imagining) → 生成任务(如果当初...) 关键:这三层需要不同的因果推理能力 - 纯关联(Attention可以学) - 干预(需要模型结构支持因果分离) - 反事实(需要内部生成模型) 统一架构必须同时支持三层,这是巨大挑战3.3 计算复杂度视角

plain

复制

三种任务的最优复杂度: 理解: O(n) 或 O(n²) 都可以,因为输入固定 → 可以用Full Attention(BERT) 生成: 理想O(1)每步,但需O(n)内存(KV Cache) → 用因果Attention,但优化为线性(MQA/GQA) 预测: 理想O(1)整体,一次性输出 → 用无掩码Attention(SimpliHuMoN) 统一架构的复杂度困境: - 支持生成(因果)会损害理解(双向) - 支持理解(双向)会损害生成(需掩码) - 预测介于两者之间,但要求非自回归

四、现有的"统一"方案及其局限

4.1 方案一:生成主导(GPT路线)

plain

复制

策略:用生成架构"覆盖"所有任务 实现: - 理解任务 → 转化为生成(问答格式) - 预测任务 → 转化为生成(逐步预测) 局限: ┌─────────────────────────────────────────┐ │ 1. 效率损失 │ │ 理解也要自回归,浪费计算 │ │ 例:判断情感需要生成"positive"而不是直接输出logits │ │ │ │ 2. 确定性任务的不稳定性 │ │ 理解任务需要确定输出,但生成是随机的 │ │ 需要采样温度=0,失去生成多样性 │ │ │ │ 3. 物理预测的不精确性 │ │ 连续数值生成困难,量化误差累积 │ │ 不如直接回归(SimpliHuMoN方式) │ │ │ │ 4. 可解释性差 │ │ 理解是隐式的,无法显式提取表示 │ └─────────────────────────────────────────┘4.2 方案二:架构混合(UniLM路线)

plain

复制

策略:同一模型,不同模式切换 实现: - 训练时:混合双向/单向/混合掩码 - 推理时:根据任务选择掩码 局限: ┌─────────────────────────────────────────┐ │ 1. 非真正统一 │ │ 内部仍是不同计算路径,只是共享参数 │ │ │ │ 2. 模式切换开销 │ │ 需要显式指定任务类型 │ │ 无法自动适应混合任务(如边理解边生成) │ │ │ │ 3. 容量竞争 │ │ 不同任务争夺同一参数空间 │ │ 规模小时互相干扰,规模大时才缓解 │ └─────────────────────────────────────────┘4.3 方案三:多专家混合(MoE路线)

plain

复制

策略:不同任务激活不同专家 实现: - 理解专家(双向Attention) - 生成专家(因果Attention) - 预测专家(无掩码Attention) - 门控网络动态路由 局限: ┌─────────────────────────────────────────┐ │ 1. 不是架构统一,是功能分离的伪装 │ │ 内部仍是多个专用模块 │ │ │ │ 2. 路由决策困难 │ │ 混合任务时(如"理解后预测")路由模糊 │ │ │ │ 3. 负载均衡问题 │ │ 某些专家可能过载,某些闲置 │ └─────────────────────────────────────────┘

五、可能的真正统一路径

5.1 理论路径:因果表示学习

plain

复制

核心思想:学习因果变量,三者都是因果推理的特例 因果图:Z(隐变量)→ X(观测) 理解: P(Z|X) (推断原因) 生成: P(X|Z) (从原因产生结果) 预测: P(X_future|X_past) = ∫P(X_future|Z)P(Z|X_past)dZ 统一架构:因果推断引擎 ┌─────────────────────────────────────────┐ │ 编码器:X → Z(因果变量) │ │ (双向,理解) │ │ │ │ 转换器:Z_past → Z_future │ │ (因果推断,预测) │ │ │ │ 解码器:Z → X │ │ (生成) │ │ │ │ 关键:Z是低维因果空间,统一了三种操作 │ └─────────────────────────────────────────┘ 挑战:如何从数据学习因果变量(无监督因果发现)5.2 计算路径:自适应计算图

plain

复制

核心思想:动态计算结构,根据任务自动选择路径 架构:可微分神经计算机(Differentiable Neural Computer) ┌─────────────────────────────────────────┐ │ 输入 → 控制器(LSTM/Transformer) │ │ ↓ │ │ ┌────────┼────────┐ │ │ ↓ ↓ ↓ │ │ 读头 写头 注意力头 │ │ (理解)(生成)(预测) │ │ 双向 因果 无掩码 │ │ ↓ │ │ 外部记忆(可微分读写) │ │ ↓ │ │ 输出 │ │ │ │ 关键:控制器学习何时使用哪种注意力模式 │ │ 端到端训练,自动适应任务 │ └─────────────────────────────────────────┘ 代表:Neural Turing Machine, Differentiable Neural Computer 局限:训练不稳定,难以规模化5.3 表示路径:统一潜空间

plain

复制

核心思想:所有任务在潜空间中统一 架构:变分自编码器(VAE)+ 扩散模型(Diffusion)的扩展 ┌─────────────────────────────────────────┐ │ │ │ 编码器 q(Z|X) ← 理解(推断后验) │ │ │ │ 潜空间 Z │ │ ├── 分类头 → 理解输出 │ │ ├── 转移模型 P(Z_future|Z_past) → 预测 │ │ └── 解码器 P(X|Z) → 生成 │ │ │ │ 关键:所有操作在Z空间,Z是连续、可微、可干预的 │ │ │ │ 现代版本:Stable Diffusion, DALL-E, Sora │ │ ├── 理解:CLIP编码器(文本→潜空间) │ │ ├── 生成:扩散模型(潜空间→图像) │ │ └── 预测:视频扩散(潜空间时序转移) │ │ │ │ 局限:预测时物理一致性不如专用模型(如SimpliHuMoN)│ │ 潜空间缺乏显式物理约束 │ └─────────────────────────────────────────┘

六、SimpliHuMoN的启示与统一可能性

SimpliHuMoN对统一问题的启示:

plain

复制

┌─────────────────────────────────────────┐ │ SimpliHuMoN的"统一"本质 │ ├─────────────────────────────────────────────────┤ │ │ │ 它统一了: │ │ ├── 轨迹预测(生成路径) │ │ ├── 姿态预测(生成姿态) │ │ └── 联合预测(同时生成两者) │ │ │ │ 但它没有统一: │ │ ├── 理解(没有编码器提取表示) │ │ └── 开放式生成(固定长度输出) │ │ │ │ 关键洞察: │ │ "预测"是生成的一种受限形式 │ │ - 输出结构已知(固定帧数) │ │ - 输出空间连续(3D坐标) │ │ - 物理约束强(骨骼结构) │ │ │ │ 这种受限性使得"非自回归"成为可能 │ │ → 一次性并行生成,而非逐步 │ │ │ │ 对统一问题的启示: │ │ 真正的统一可能需要"分层": │ │ 底层:通用表示学习(理解) │ │ 中层:任务特定转换(预测是生成的子集) │ │ 顶层:输出生成 │ │ │ │ 而非强制所有任务走同一计算路径 │ └─────────────────────────────────────────┘

七、终极判断:三者能统一吗?

7.1 弱统一:已实现

plain

复制

当前状态(GPT-4, Sora等): ┌─────────────────────────────────────────┐ │ 弱统一 = 同一模型能执行三种任务 │ │ 但不是同一机制、同一最优 │ │ │ │ 代价: │ │ - 理解不如专用编码器(BERT) │ │ - 生成需要提示工程引导 │ │ - 预测缺乏物理精确性 │ │ │ │ 适用:通用助手场景(ChatGPT) │ │ 不适用:科学计算、机器人控制(需要SimpliHuMoN)│ └─────────────────────────────────────────┘7.2 强统一:理论可能,工程困难

plain

复制

强统一 = 同一机制,三种任务都是最优或接近最优 可能路径: 1. 因果表示学习成熟 → 发现通用因果变量Z → 理解/生成/预测都是Z空间的操作 2. 神经符号AI融合 → 神经网络学习符号规则 → 符号层保证物理一致性(预测) → 神经层处理不确定性(生成) → 联合支持查询(理解) 3. 世界模型(World Model)成熟 → 学习环境的通用转移模型 → 理解 = 状态推断 → 预测 = 状态转移 → 生成 = 从状态渲染观测 → 参考:Yann LeCun的JEPA架构7.3 我的判断

plain

复制

┌─────────────────────────────────────────┐ │ 统一的可能性评估 │ ├─────────────────────────────────────────┤ │ │ │ 短期(3-5年):弱统一主导 │ │ ├── GPT路线继续扩展 │ │ ├── 专用模型(如SimpliHuMoN)在垂直领域 │ │ │ 保持优势 │ │ └── 两者通过API/工具调用协作 │ │ │ │ 中期(5-10年):分层统一 │ │ ├── 底层:通用世界模型(理解+预测) │ │ ├── 中层:任务适配器(轻量微调) │ │ └── 顶层:应用接口 │ │ │ │ 长期(10年+):强统一可能 │ │ ├── 前提是因果表示学习突破 │ │ ├── 或新的计算范式(量子?神经形态?) │ │ └── 统一于"智能的第一性原理" │ │ │ │ 根本障碍: │ │ 理解需要压缩,生成需要扩展,预测需要外推 │ │ 这三者的最优计算结构在数学上就是不同的 │ │ │ │ 可能的出路: │ │ 不是"同一架构做所有事",而是 │ │ "同一智能体动态调用不同计算模块" │ │ → 类似大脑:统一意识,但不同任务激活不同脑区 │ │ │ └─────────────────────────────────────────┘

八、对研究者的建议

plain

复制

如果你要设计"统一架构": 1. 先问自己:是真需要统一,还是接口统一就够了? - 产品需求 → 接口统一(GPT路线) - 科学问题 → 探索真统一(因果/世界模型) 2. 如果是真统一,选择分层策略: ┌─────────────────────────────────────────┐ │ 表示层:双向,理解为主(BERT风格) │ │ ↓ │ │ 转换层:因果或并行,任务决定 │ │ ↓ │ │ 输出层:自回归或非自回归,输出类型决定 │ └─────────────────────────────────────────┘ 3. 关键设计决策: - 潜空间维度:低维(理解)vs 高维(生成) - 信息流:双向 vs 单向 vs 并行 - 监督信号:密集(理解)vs 稀疏(生成) 4. 不要忽视SimpliHuMoN的教训: - 简单架构 + 任务匹配 > 复杂架构 + 强行统一 - 有时候"不统一"才是对的

最终结论:

完全的强统一可能是一个"圣杯"式的追求。 理解、生成、预测在计算本质上的差异,暗示了最优架构的分化是必然的。未来的"统一"更可能是分层协作 (类似大脑的分工)而非强制同质化。SimpliHuMoN的价值在于,它展示了在特定任务子集(预测)内,极致的简化可以带来卓越的性能------这比盲目追求大一统更具务实意义。