目录

- [1. 基本原理](#1. 基本原理)

- [2. 适用场景和优缺点](#2. 适用场景和优缺点)

- [3. 细节解释](#3. 细节解释)

-

- [3.1 为什么逻辑回归容易受到多重共线性影响](#3.1 为什么逻辑回归容易受到多重共线性影响)

- [3.2 为什么逻辑回归适用于大模型稀疏数据?](#3.2 为什么逻辑回归适用于大模型稀疏数据?)

- [3.2 LR与树模型之间异同点](#3.2 LR与树模型之间异同点)

- [4. 常见面试题目](#4. 常见面试题目)

1. 基本原理

- 基本思想:从线性回归演变到概率预测的过程,其核心在于通过一个非线性映射(Sigmoid函数)将线性组合的结果压缩到 0 0 0 到 1 1 1 之间。

- 函数表达式为:

h θ ( x ) = σ ( z ) = 1 1 + e − z h_{\theta}(\text{x})=\sigma(z)=\frac{1}{1+e^{-z}} hθ(x)=σ(z)=1+e−z1

其中, z = θ T x = θ 0 + θ 1 x 1 + θ 2 x 2 + ⋯ + θ n x n = θ T x z=\theta^{T}\text{x}=\theta_{0}+\theta_{1}x_{1}+\theta_{2}x_{2}+\cdots+\theta_{n}x_{n}=\theta^{T}\text{x} z=θTx=θ0+θ1x1+θ2x2+⋯+θnxn=θTx, z ∈ ( − ∞ , ∞ ) z\in(-\infty,\infty) z∈(−∞,∞)为对数几率, z = ln ( p 1 − p ) z=\ln(\frac{p}{1-p}) z=ln(1−pp)

- 损失函数:交叉熵损失函数(Cross-Entropy Loss),也叫对数损失(Log Loss)。通过最大化似然函数或最小化交叉熵损失来求解参数。以下是其损失函数及梯度下降法的推导与实现:

J ( θ ) = − 1 m ∑ i = 1 m y i log ( h θ ( x i ) ) + ( 1 − y i ) log ( 1 − h θ ( x i ) ) J(\theta) = -\frac{1}{m} \sum_{i=1}^m \left y_i \\log(h_\\theta(\\mathbf{x}_i)) + (1 - y_i) \\log(1 - h_\\theta(\\mathbf{x}_i)) \\right J(θ)=−m1i=1∑myilog(hθ(xi))+(1−yi)log(1−hθ(xi))

其中 m m m:样本数量, y i ∈ { 0 , 1 } y_i \in \{0, 1\} yi∈{0,1}:第 i i i 个样本的真实标签

- 梯度下降法更新参数:

损失函数对参数 θ j \theta_j θj 的偏导数为:

∂ J ( θ ) ∂ θ j = 1 m ∑ i = 1 m ( h θ ( x i ) − y i ) x i j \frac{\partial J(\theta)}{\partial \theta_j} = \frac{1}{m} \sum_{i=1}^m \left( h_\theta(\mathbf{x}i) - y_i \right) x{ij} ∂θj∂J(θ)=m1i=1∑m(hθ(xi)−yi)xij

向量化形式:

∇ θ J ( θ ) = 1 m X ⊤ ( σ ( X θ ) − y ) \nabla_\theta J(\theta) = \frac{1}{m} \mathbf{X}^\top \left( \sigma(\mathbf{X}\theta) - \mathbf{y} \right) ∇θJ(θ)=m1X⊤(σ(Xθ)−y)

梯度下降法更新参数

θ : = θ − α ∇ θ J ( θ ) \theta := \theta - \alpha \nabla_\theta J(\theta) θ:=θ−α∇θJ(θ)

- Python 实现

python

import numpy as np

from sklearn.preprocessing import StandardScaler

def sigmoid(z):

# 数值稳定版本

z = np.clip(z, -50, 50) # 防止溢出

return 1 / (1 + np.exp(-z))

def compute_loss(X, y, theta):

m = len(y)

h = sigmoid(X @ theta) ## 矩阵乘法,与np.matmul(等价)

epsilon = 1e-15 # 避免 log(0)

h = np.clip(h, epsilon, 1 - epsilon)

loss = -np.mean(y * np.log(h) + (1 - y) * np.log(1 - h))

return loss

def compute_gradient(X, y, theta):

m = len(y)

h = sigmoid(X @ theta)

gradient = (X.T @ (h - y)) / m

return gradient

def gradient_descent(X, y, alpha=0.1, num_iters=1000):

# 添加偏置项并标准化特征(偏置列不缩放)

X = np.hstack([np.ones((X.shape[0], 1)), X])

scaler = StandardScaler()

X[:, 1:] = scaler.fit_transform(X[:, 1:])

theta = np.zeros(X.shape[1])

losses = []

for _ in range(num_iters):

gradient = compute_gradient(X, y, theta)

theta -= alpha * gradient

loss = compute_loss(X, y, theta)

losses.append(loss)

return theta, losses

# 生成示例数据

from sklearn.datasets import make_classification

X, y = make_classification(n_samples=100, n_features=2, n_redundant=0, random_state=42)

# 训练模型

theta, losses = gradient_descent(X, y, alpha=0.1, num_iters=1000)

print("最优参数 theta:", theta)2. 适用场景和优缺点

适用与不适用场景

适用场景:最适合处理特征与目标之间存在线性逻辑关系,且需要概率预测的二分类任务。

| 场景类型 | 为什么适用? | 具体示例 |

|---|---|---|

| 概率预测 | 给0出1到之间的概率 | 预测违约概率 |

| 大规模稀疏特征 | 在特征维度极高(如百万维)时,逻辑回归计算效率极高且不易过拟合 | 广告点击率 (CTR) 预测 |

| 可解释性要求高 | 每一个特征对应的权重代表影响程度 | 医疗诊断 |

适用核心原因:

- 计算开销小: 训练和预测速度极快。

- 线性关系明确: 如果你通过散点图发现特征和对数几率(Log-odds)呈近似线性关系,LR 表现非常稳健。

不适用场景:当数据特征变得复杂、非线性或特征间干扰较多时,逻辑回归往往表现不佳。

| 场景类型 | 为什么不适用? | 建议替代方案 |

|---|---|---|

| 非线性空间 | 本质上是线性分类器,无法通过直线划开"环形"或"螺旋形"分布的数据 | 核SVM、深度学习 |

| 特征高度相关 | 多重共线性会导致模型权重极其不稳定,无法解释特征的真实影响 | 树模型(如随机森林) |

| 缺失值较多 | 对缺失值非常敏感,无法像 XGBoost 那样自动处理缺失数据 | 缺失值填充或决策树 |

| 特征交互复杂 | 如果结果取决于"特征A和特征B同时满足"这种非线性组合,LR 需要手动做特征工程 | 因子分解机 (FM)、GBDT |

不适用核心原因:

- 表达能力有限: 它的决策边界是线性的。即便使用 L 1 L_{1} L1或 L 2 L_{2} L2正则化,也无法弥补其在捕捉复杂非线性模式上的天然弱势。

- 容易欠拟合: 在数据量极大、模式极复杂的场景(如图像识别、自然语言处理)下,LR 的准确率上限较低。

优缺点

| 优点 | 缺点 |

|---|---|

| 可解释性强,根据特征系数可知重要性 | 难以处理复杂或非线形问题 |

| 直接输出概率值,根据风险偏好自由调整判定阈值 | 对特征工程高度依赖,无法自动捕捉特征间的交叉效应 |

| 计算效率高,计算复杂度低 | 易受异常值和多重共线性干扰 |

3. 细节解释

3.1 为什么逻辑回归容易受到多重共线性影响

- 回答

多重共线性是指模型中的两个或多个特征之间存在高度的相关性(比如同时输入了"摄氏度"和"华氏度"作为特征)

从参数估计的稳定性和数学矩阵两个层面解释:

- 参数估计的稳定性:无法确定相关特征之间的权重系数,会剧烈波动

逻辑回归的本质是给每个特征分配一个权重(系数)。

正常情况下: 每个特征都有独特的贡献,模型能清晰地分辨出谁在起作用。

存在共线性时: 假设特征A和特征 B几乎完全一样。模型在优化时会发现,把权重全部给A,全部给 B,或者给 A 加 100 给 B 减 100,得到的效果(Loss)都差不多。

后果: 这会导致系数变得极其不稳定。数据微小的变化,就会导致权重在 A 和 B 之间剧烈跳动。这不仅让模型失去了解释性(你无法判断谁才是真正的影响因素),还会让模型在测试集上的鲁棒性变得极差。

- 数学层面:海森矩阵(Hessian Matrix)接近奇异

逻辑回归通常使用极大似然估计(MLE)来求解,而在寻找最优解的过程中(如使用牛顿法),需要计算目标函数的二阶导数矩阵,即 Hessian 矩阵。

在逻辑回归中,参数更新的步长与 H − 1 H^{-1} H−1(Hessian 矩阵的逆)有关:如果特征之间存在高度线性相关,特征矩阵就会趋向于奇异矩阵(Singular Matrix)。这会导致 Hessian 矩阵的行列式接近于 0。当矩阵接近奇异时,其逆矩阵 H − 1 H^{-1} H−1中的元素会变得无穷大。

后果: 权重系数的方差(Variance)会变得非常大。数学上,这代表参数估计的精度极低,模型根本无法确定正确的参数值。

- 对模型表现的具体影响

| 影响维度 | 表现 |

|---|---|

| 解释性崩溃 | 某个本应是正相关的特征,其系数可能变成负数,完全违背业务逻辑 |

| 预测不稳定 | 训练集上表现良好,但遇到新数据时,由于权重过大或过小,预测结果会产生剧烈波动 |

- 如何解决多重共线性?

- 手动剔除: 检查相关性矩阵,将相关系数大于 0.8 或 0.9 的特征删掉其中一个

- L 2 L_{2} L2正则化:在损失函数中加入惩罚项 λ ∑ i β i 2 \lambda \sum_{i}\beta_{i}^{2} λ∑iβi2,强迫模型平摊权重,防止任何一个 β \beta β变得极端大,从而稳定参数估计

- PCA 主成分分析: 将高度相关的特征压缩成相互正交的新变量,从根本上消除线性相关。

- 特征变换: 将两个相关变量合并为一个(如:不再分别输入"身高"和"体重",而是输入"BMI")。

3.2 为什么逻辑回归适用于大模型稀疏数据?

- 回答

- 计算结构 :采用点积的形式 z = w T x + b = ∑ i w i x i + b z=\text{w}^{T}\text{x}+b=\sum_{i}\text{w}{i}\text{x}{i}+b z=wTx+b=∑iwixi+b, 在稀疏数据中,只需遍历 x \text{x} x 的非零项

- L 1 L_{1} L1正则化剪枝 :让不重要的特征权重 w i \text{w}_{i} wi 直接变为 0 0 0

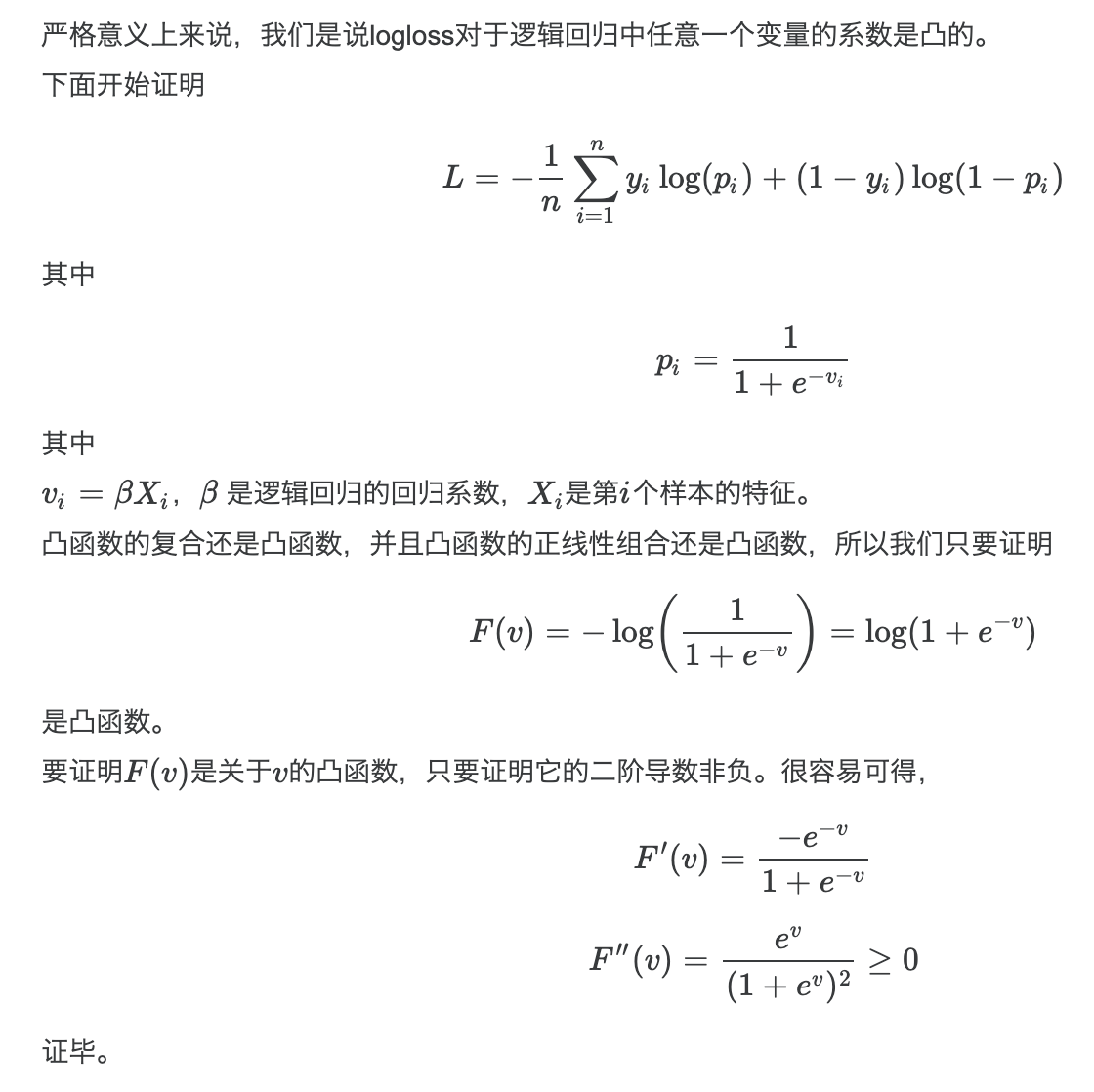

- 损失函数(Log Loss)为凸函数:在稀疏数据这种极端空间中,逻辑回归的收敛过程更加可靠且可控。(非凸函数容易陷入局部最小值或鞍点)

- 泛化能力: 相比于复杂的非线性模型(如深度树模型),LR 捕捉的是特征与结果之间的直接统计联系,在样本稀疏的情况下,这种简单的联系往往比复杂的推断更具泛化性。

ref:凸函数证明

3.2 LR与树模型之间异同点

- 核心差异

| 维度 | LR | 树模型 |

|---|---|---|

| 模型本质 | 参数模型。假设特征与对数几率呈线性关系。 | 非参数模型。基于"if-then"规则的空间划分 |

| 决策边界 | 线性:一条直线或一个平面 | 非线性:阶梯状或矩形组合的复杂边界 |

| 特征交互 | 无法自动处理。必须人工进行特征组合(如 x 1 × x 2 x_{1}\times x_{2} x1×x2) | 天然支持。通过树的层级结构自动捕获特征间的交叉关系。 |

| 数据分布敏感度 | 高。受异常值、多重共线性影响大,需归一化。 | 低。对异常值鲁棒,不关心量纲,无需归一化 |

| 输出结果 | 连续的概率值,平滑且稳定 | 往往是阶梯状预测,对微小变化的响应不够平滑 |

-

为什么有以上的差异?

- 关于"非线性"的处理

- LR: 它是通过全局的加权求和来决策。如果要拟合非线性,你得手动告诉它。

- 树模型: 它是通过不断"切分"空间。每一层分叉都是一次条件的叠加,这使得它能轻易拟合出复杂的曲面。对于特征之间有复杂依赖关系的业务(如:金融风控),树模型通常效果更好。

- 关于"数据预处理"

- LR: 非常挑食。如果一个特征范围是 0 , 1 0,1 0,1,另一个是 0 , 10000 0,10000 0,10000,LR 会倾向于被大的那个带偏,所以必须做归一化。

- 树模型: 很不挑食。它只关心数值的相对顺序(秩),不关心具体数值。所以缩放特征对树模型没有影响。

- 关于"稀疏数据"

- LR: 擅长处理上百万维的稀疏特征(如 ID 类特征),因为每个特征只分配一个权重,计算非常直接。

- 树模型: 在极度稀疏的高维数据上表现较差。因为树在切分时,如果某个特征大部分是 0,这个特征的信息增益会很小,导致树长得很深且容易过拟合。

- 关于"非线性"的处理

-

共同点 (Similarities)

- 监督学习: 两者都用于有监督的分类或回归任务。

- 损失优化: 现代树模型(如 GBDT)在优化时,其损失函数(Loss Function)可以采用与 LR 完全相同的对数损失(Log Loss)。

- 防止过拟合: 两者都需要正则化。LR 靠惩罚项,树模型靠限制深度、叶子节点数或学习率。

-

模型选择

- 选逻辑回归 (LR) 当:

- 数据集非常稀疏(如点击率预测、文本分类)。

- 需要极高的预测速度(毫秒级响应)。

- 业务要求极强的可解释性(必须明确每个因素的影响百分比)。

- 数据量相对较小,且特征与目标基本呈线性关系。

- 选树模型 (Tree) 当:

- 特征之间存在复杂的相互作用(例如:年龄和收入共同决定购买力)。

- 数据中有较多缺失值或异常值,且你不想花太多时间做数据清洗。

- 追求更高的预测准确率(通常 GBDT/XGBoost 是结构化数据竞赛的标配)。

- 选逻辑回归 (LR) 当:

4. 常见面试题目

- LR 的损失函数是什么?为什么不选均方误差 (MSE)?

- 关键词: 对数损失 (Log Loss)、交叉熵、凸优化、非凸、梯度消失。

- 要点: MSE 在 LR 中是非凸的,易陷入局部最优;且在分类错误时梯度过小,收敛慢。

- 为什么 LR 需要对连续特征进行离散化?

- 关键词: 鲁棒性、非线性表达能力、特征交叉、模型简化、稀疏向量计算。

- 要点: 离散化后每个区间有独立权重,相当于引入非线性;且能增加模型稳定性,降低异常值干扰。

- 请口述或推导 LR 损失函数的来源。

- 关键词: 极大似然估计 (MLE)、伯努利分布 (Bernoulli Distribution)。

- 要点: 假设数据服从伯努利分布,写出似然函数,取对数并加负号即得到交叉熵。

- LR 的参数求解方法有哪些?

- 关键词: 随机梯度下降 (SGD)、牛顿法、拟牛顿法 (L-BFGS)。

- 要点: 工业界常用 SGD(在线学习),二阶方法(如 L-BFGS)收敛快但计算 Hessian 矩阵代价大。

- L1 和 L2 正则化在 LR 中有什么区别?

- 关键词: 拉普拉斯分布、高斯分布、稀疏性、特征选择、权重衰减。

- 要点: L1 产生稀疏解(部分权重归零),适用于特征选择;L2 防止权重过大,提升泛化能力。

- 逻辑回归如何处理多分类问题?

- 关键词: OvR (One-vs-Rest)、OvO (One-vs-One)、Softmax。

- 要点: 拆解为多个二分类(OvR)或直接升级为 Softmax 回归。

- 如何发现并处理 LR 模型中的多重共线性?

- 关键词: VIF (方差膨胀因子)、相关系数、L2 正则化、PCA。

- 要点: 共线性导致权重波动大、解释性差。首选 L2 正则化缓解,或剔除高相关变量。

- 当正负样本极度不平衡(1:1000)时,如何改进 LR?

- 关键词: 采样(SMOTE)、损失函数加权 (Class Weight)、调整判定阈值。

- 要点: 调整代价函数,给少数类更高的惩罚权重。

- LR 与 SVM (支持向量机) 的异同点?

- 关键词: 结构风险 vs 经验风险、全局信息 vs 边界信息、核函数、概率输出。

- 要点: LR 考虑全局点(Log Loss),SVM 只考虑支持向量(Hinge Loss);SVM 天然支持核技巧处理非线性。

注意:以上内容由大模型生成