****论文题目:****Connecting the Dots: Multivariate Time Series Forecasting with Graph Neural Networks(多变量时间序列预测与图神经网络)

会议:KDD2020

****摘要:****长期以来,多变量时间序列建模一直是一个吸引了包括经济、金融和交通在内的各个领域研究人员的课题。多元时间序列预测背后的一个基本假设是,它的变量相互依赖,但仔细观察,可以说现有的方法无法充分利用变量对之间潜在的空间依赖性。与此同时,近年来,图神经网络(GNN)在处理关系依赖方面表现出了很高的能力。GNN需要定义良好的图结构来进行信息传播,这意味着它们不能直接应用于预先不知道依赖关系的多变量时间序列。本文提出了一种针对多元时间序列数据的通用图神经网络框架。我们的方法通过图学习模块自动提取变量之间的单向关系,变量属性等外部知识可以很容易地集成到图学习模块中。进一步提出了一种新的混合跳传播层和扩展初始层来捕获时间序列中的时空依赖关系。图学习、图卷积和时间卷积模块在端到端框架中共同学习。实验结果表明,我们提出的模型在4个基准数据集中的3个上优于最先进的基线方法,并在两个提供额外结构信息的交通数据集上达到与其他方法相同的性能。

用图神经网络预测多变量时间序列------MTGNN 论文详解

一、背景与问题

1.1 多变量时间序列预测的重要性

现代社会中,传感器无处不在------温度计、电表、交通流量探测器、股票行情终端......来自不同传感器的数据汇聚在一起,形成多变量时间序列(Multivariate Time Series, MTS)。如何准确预测这些时间序列的未来走势,在经济、金融、交通、生物信息等领域都有着极其重要的应用价值。

多变量时间序列预测的核心假设是:各变量之间存在相互依赖关系。例如,某路段的交通拥堵状况,不仅取决于该路段自身的历史数据,还受到相邻路段的影响。如何有效地建模这种变量间的空间依赖关系,是该领域长期以来的核心挑战。

1.2 现有方法的不足

论文梳理了三类主流方法,并逐一指出其局限:

统计方法(如 ARIMA、VAR、VARMA、GP):

- 假设变量之间存在线性依赖,无法捕捉非线性模式;

- 模型复杂度随变量数量平方级增长,面对大量变量时容易过拟合,扩展性差。

深度学习方法(如 LSTNet、TPA-LSTM):

- 使用 CNN 捕捉局部依赖、RNN 保留长期时序信息,能够建模非线性模式;

- 但 CNN 将变量间的交互编码为一个全局隐状态,无法显式建模变量对之间的依赖关系,可解释性弱。

时空图神经网络(如 DCRNN、STGCN、Graph WaveNet):

- 将图结构引入时间序列建模,显式利用空间依赖,效果显著提升;

- 致命缺陷 :这些方法都依赖预先定义好的图结构,而在大多数多变量时间序列场景中,变量之间的依赖关系根本就是未知的、需要从数据中挖掘的。

1.3 论文聚焦的两大核心挑战

- 挑战一(未知图结构):多数多变量时间序列没有现成的图结构,变量间关系必须从数据中自动学习。

- 挑战二(图学习与 GNN 协同训练) :即使图结构已知,现有 GNN 方法也只关注消息传递(GNN Learning),忽视了图结构本身的优化------如何在一个端到端框架中同时学习图结构和 GNN 参数,是亟待解决的问题。

二、MTGNN:模型框架总览

为了解决上述挑战,论文提出了 MTGNN(Multivariate Time series Graph Neural Network)。

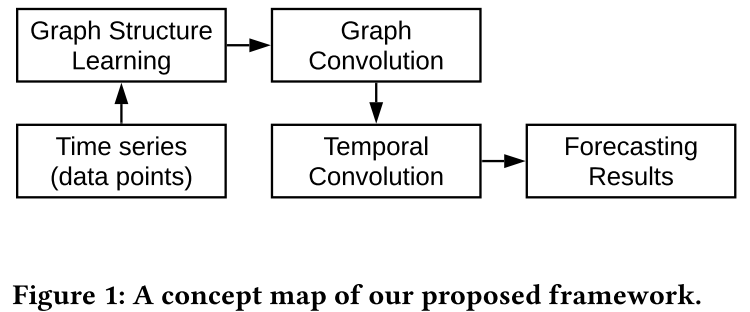

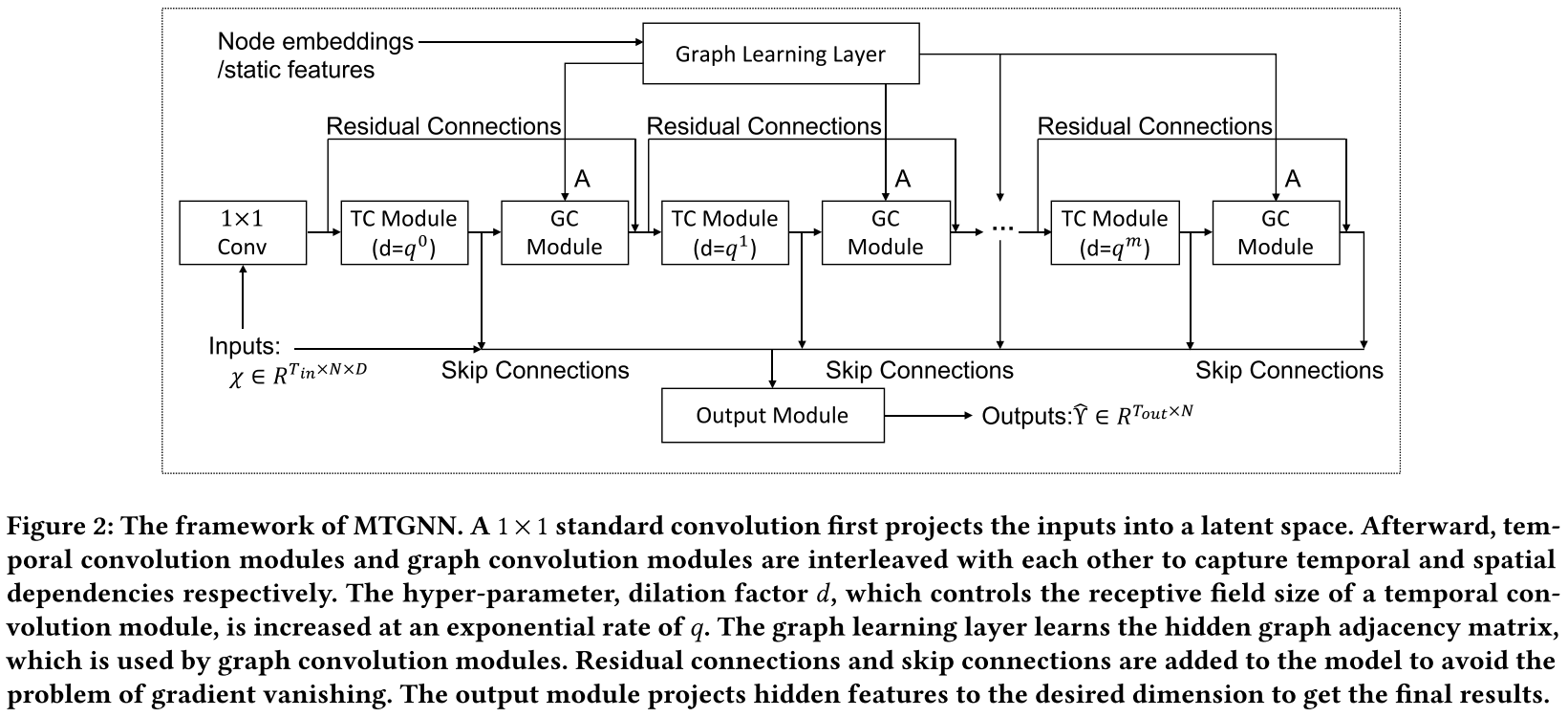

MTGNN 的整体框架如下图所示,由四个核心模块构成:

- 图学习层(Graph Learning Layer):自适应地从数据中学习变量间的依赖关系,输出稀疏的有向图邻接矩阵。

- 图卷积模块(Graph Convolution Module):利用学习到的图结构,聚合邻居节点信息,捕捉变量间的空间依赖。

- 时间卷积模块(Temporal Convolution Module):通过扩张卷积捕捉多尺度的时序模式。

- 输出模块(Output Module):将隐藏特征投影到目标输出维度,生成预测结果。

各模块通过**残差连接(Residual Connection)和跳跃连接(Skip Connection)**连接,有效避免梯度消失问题。

三、核心模块详解

3.1 图学习层------自适应提取单向依赖关系

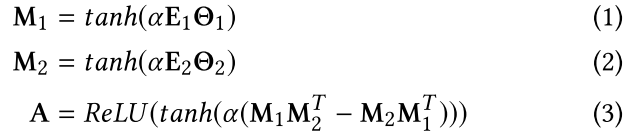

图学习层是 MTGNN 最核心的创新之一。其目标是从数据中自动学习一个**稀疏、有向(非对称)**的图邻接矩阵。

为什么要非对称? 在多变量时间序列中,依赖关系往往是单向的。例如,上游路段的交通状况会影响下游路段,反之则不一定成立。现有的相似度度量(如点积、欧氏距离)天然产生对称结果,无法捕捉这种单向性。

论文设计了如下计算公式:

其中E是可学习的节点嵌入, 是模型参数,α控制激活函数的饱和率。

是模型参数,α控制激活函数的饱和率。

非对称性的实现机制 :减法项 ReLU 激活函数共同作用,使得若

ReLU 激活函数共同作用,使得若 ,则其对角项

,则其对角项 ,从而保证了邻接矩阵的非对称性。

,从而保证了邻接矩阵的非对称性。

稀疏化:通过 top-k 采样策略,对每个节点只保留与其最相关的 k 个邻居,其余权重置零。这不仅降低了图卷积的计算量,还避免了无关噪声的引入。

融入外部知识:若存在节点的静态属性信息(如传感器的地理坐标),可以直接令 E1 = E2 = Z(静态特征矩阵),将外部知识融入图学习过程。

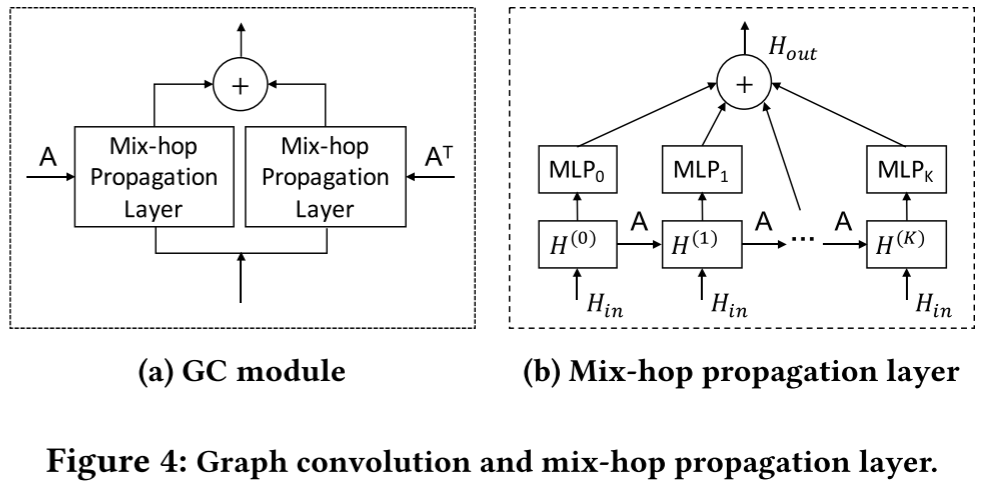

3.2 图卷积模块与 Mix-hop 传播层

图卷积模块通过两个 Mix-hop 传播层分别处理节点的入流(inflow)和出流(outflow)信息,最终将两者相加得到净入流信息。

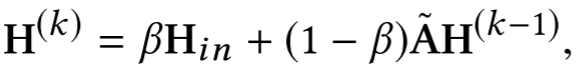

Mix-hop 传播层包含两个步骤:

(1)信息传播步骤:

β控制节点保留自身原始信息的比例。这一设计来自个性化 PageRank 的思想,使节点在深度传播过程中不会完全"遗忘"自身状态,从而缓解了图卷积网络的过平滑(over-smoothing)问题------传统 GCN 随着层数加深,节点表示会趋于一致,失去区分性。

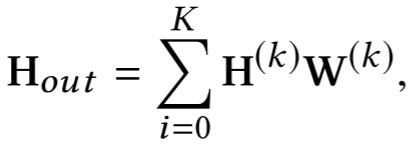

(2)信息选择步骤:

通过可学习的参数矩阵 W^(k) 对不同跳数的信息进行加权融合,相当于一个特征选择器。当图结构不包含有用的空间依赖时,模型可以通过将 k > 0 时的 W^(k) 置零,退化为只使用节点自身信息,保持了模型的鲁棒性。

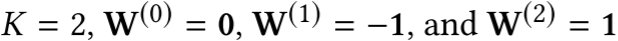

值得一提的是,Mix-hop 的求和方式比拼接(concatenation)更高效------通过设置 ,单个传播层即可表示相邻两跳信息的差分,而拼接方法则需要两层才能实现。

,单个传播层即可表示相邻两跳信息的差分,而拼接方法则需要两层才能实现。

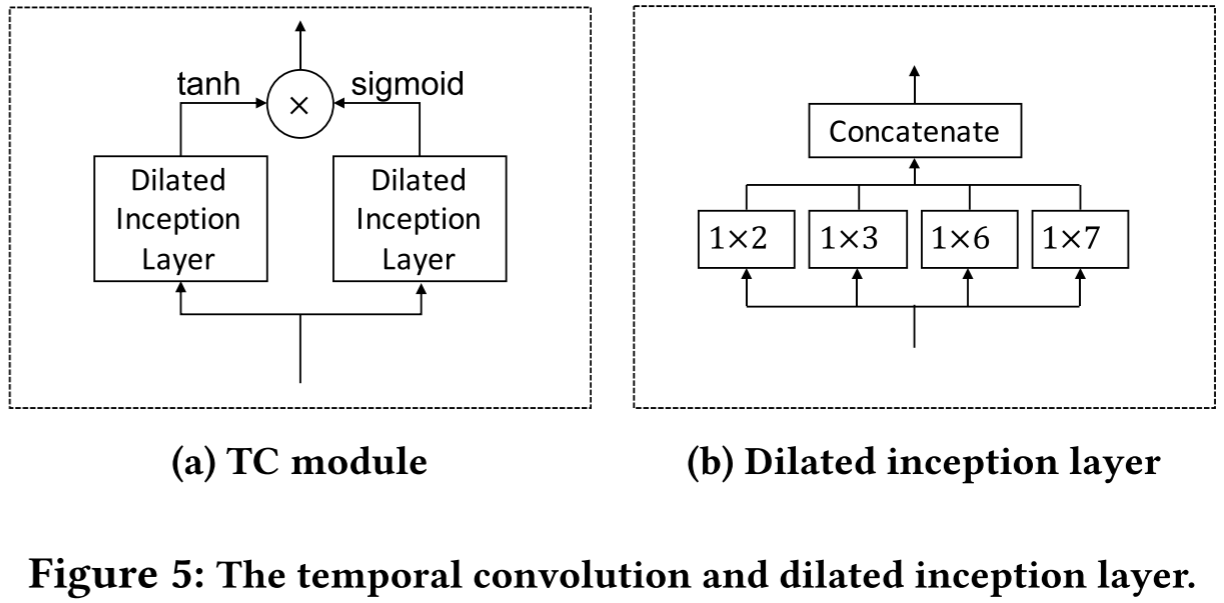

3.3 时间卷积模块与扩张初始卷积层

时间卷积模块(TC Module)由两个**扩张初始卷积层(Dilated Inception Layer)**组成,一个接 tanh 激活(滤波器),一个接 sigmoid 激活(门控单元),二者相乘形成门控卷积结构。

扩张初始卷积层是两种经典技术的结合:

Inception(多尺度卷积):时间信号通常存在多种内在周期(如 7天、12小时、24小时等)。传统 CNN 需要手工选择卷积核大小------核太大则无法细粒度捕捉短期模式,核太小则无法覆盖长期模式。论文设计了包含 4 种核大小的卷积组合,通过不同核的组合可以覆盖多种常见周期。

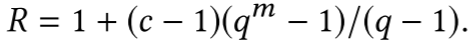

Dilated Convolution(扩张卷积) :普通卷积网络的感受野随网络深度线性增长:R = m(c-1)+1。而扩张卷积通过对输入进行下采样,让感受野指数级增长:

以指数因子 q 逐层扩大膨胀率,用较少的层数和参数即可处理极长的时间序列。

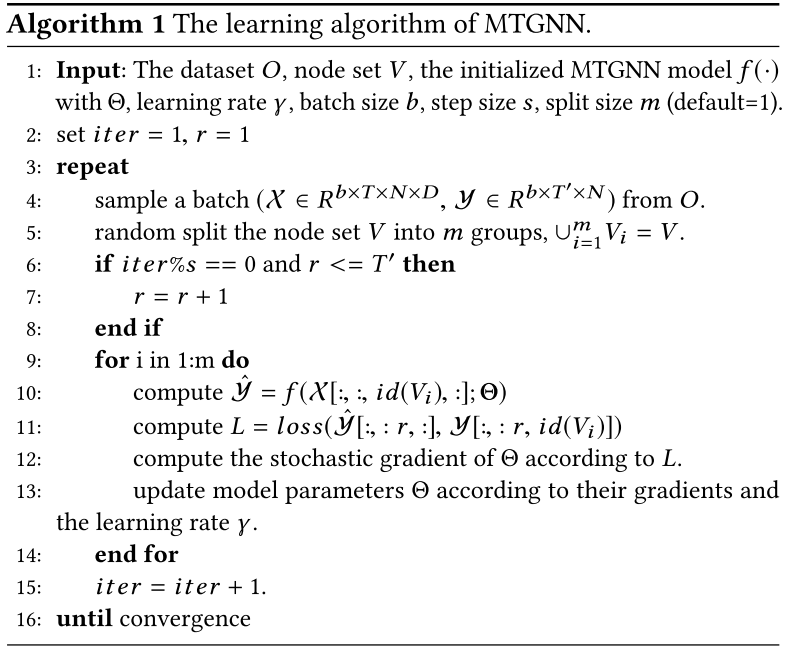

四、学习算法:课程学习 + 子图采样

4.1 子图采样------解决大图内存瓶颈

图学习层的时间复杂度为 O(N^2)(需要计算所有节点对的相似度)。当节点数量N很大时,内存消耗极为可观。

论文提出在每次迭代中随机将节点分成 s 组,只在组内计算节点相似度,将图学习层的每次迭代复杂度从 O(N^2) 降至 O((N/s)^2)。同时,随机分组保证了每个节点都有机会与任意其他节点被分到同一组,从而使所有节点对的相似度都能被更新。训练完成后,利用全部训练好的节点嵌入构建全局图,供推理时使用。

4.2 课程学习策略------提升多步预测的收敛质量

在多步预测任务中,论文发现:模型容易过度关注长期预测(因为长期误差绝对值更大),而忽略短期预测的精度。

受课程学习(Curriculum Learning)思想启发,论文提出从易到难的训练策略:训练初期只预测下一步,随着迭代数增加,逐步延长预测长度,直到覆盖全部目标步数。这使模型先找到良好的初始点,再逐步适应更难的任务,有效提升了收敛质量。

五、实验结果

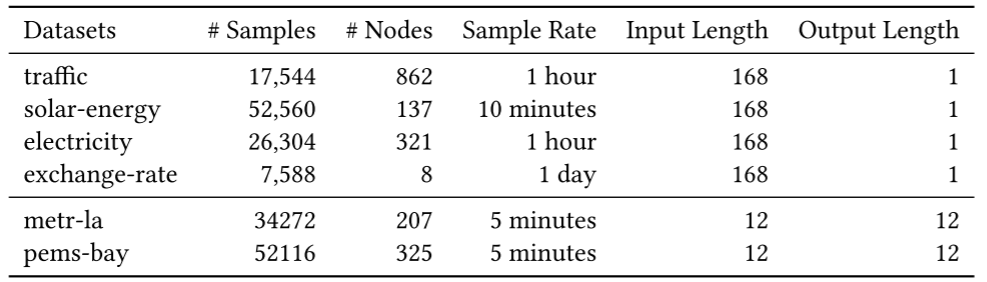

5.1 数据集

论文在 6 个公开数据集上进行了评测,覆盖交通、太阳能、电力、汇率等多个领域:

- 单步预测(Traffic、Solar-Energy、Electricity、Exchange-Rate):输入长度 168,预测第 3、6、12、24 步。

- 多步预测(METR-LA、PEMS-BAY):输入 12 步,预测未来 12 步。

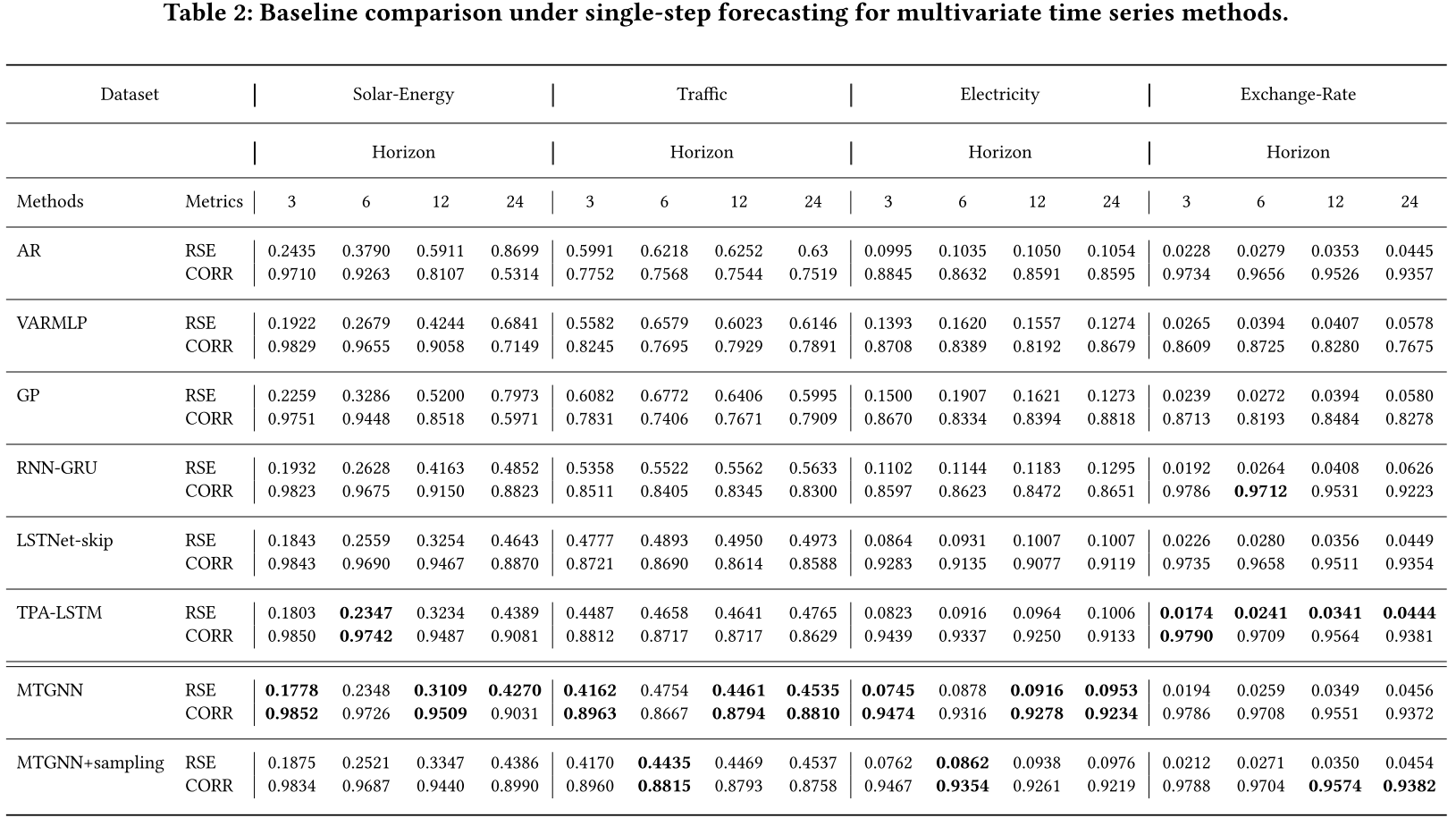

5.2 单步预测结果

MTGNN 在 Solar-Energy、Traffic、Electricity 三个数据集上均取得了最优或次优 的预测性能。以 Traffic 数据集为例,MTGNN 在 horizon=3、12、24 时分别将 RSE 降低了 7.24%、3.88%、4.83%(相比最优 baseline TPA-LSTM)。这一显著提升说明,交通数据天然具有空间依赖特性,MTGNN 的图建模能力在此类数据上优势明显。

在 Exchange-Rate 数据集上,MTGNN 效果略逊于最优 baseline,论文分析认为这是因为该数据集图规模较小(仅 8 个节点)、训练样本较少,限制了图学习层的效果。

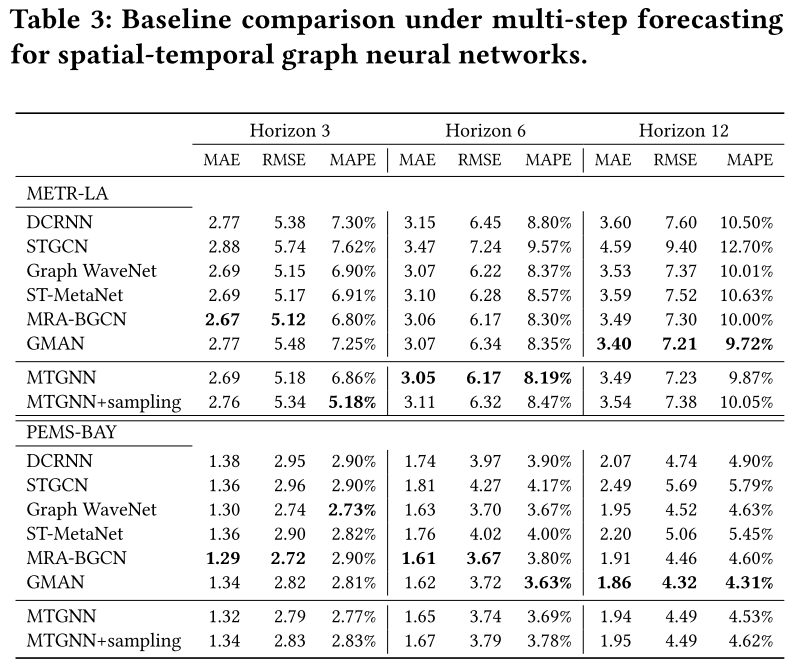

5.3 多步预测结果

在多步预测任务上,MTGNN 与使用预定义图结构 的最先进方法(Graph WaveNet、MRA-BGCN 等)性能相当,甚至在部分指标上更优。这一结果意义重大:

- DCRNN、STGCN、MRA-BGCN 完全依赖预定义图;

- Graph WaveNet 虽然提出了自适应邻接矩阵,但仍需结合预定义图才能达到最优;

- MTGNN 无需任何预定义图结构,完全从数据中自动学习图,即可达到与使用完整图信息的方法相当的性能。

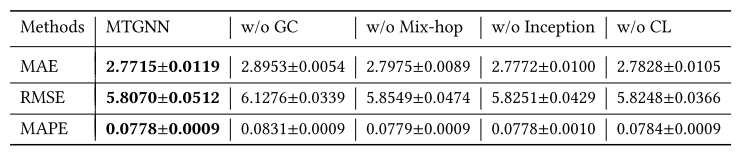

5.4 消融实验

论文在 METR-LA 数据集上进行了消融实验,每组实验重复 10 次取均值,结论如下:

- 去掉图卷积模块(w/o GC):MAE 从 2.7715 升至 2.8953,提升幅度最大。说明图卷积对于捕捉孤立但相互依赖节点之间的信息流至关重要。

- 去掉 Mix-hop 信息选择步骤(w/o Mix-hop):MAE 升至 2.7975,说明信息选择步骤能够有效过滤无用的传播信息。

- 去掉 Inception(w/o Inception):RMSE 有明显上升,MAE 变化相对较小。

- 去掉课程学习(w/o CL):MAE 升至 2.7828,说明课程学习策略对收敛质量有正向贡献。

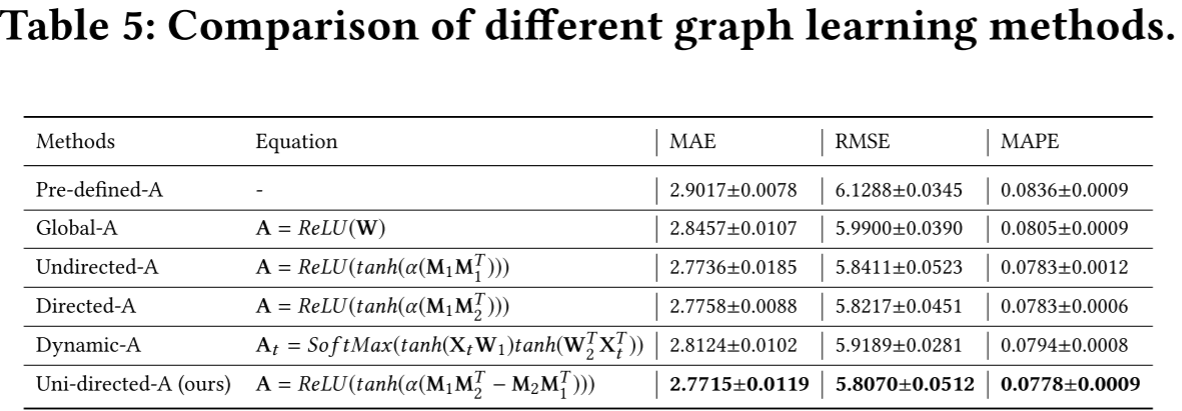

5.5 图学习层的有效性验证

论文对比了 6 种不同的图邻接矩阵构建方式。实验结果表明,Uni-directed-A(论文提出的单向非对称图)在 MAE、RMSE、MAPE 三项指标上均取得最低均值,且标准差较小,鲁棒性更好。尤其是与 Pre-defined-A(基于路网距离的传统图)相比,学习到的图在 MAE 和 RMSE 上均有显著提升,说明从数据中自动学习的图结构比人工定义的图结构更能反映真实的依赖关系。

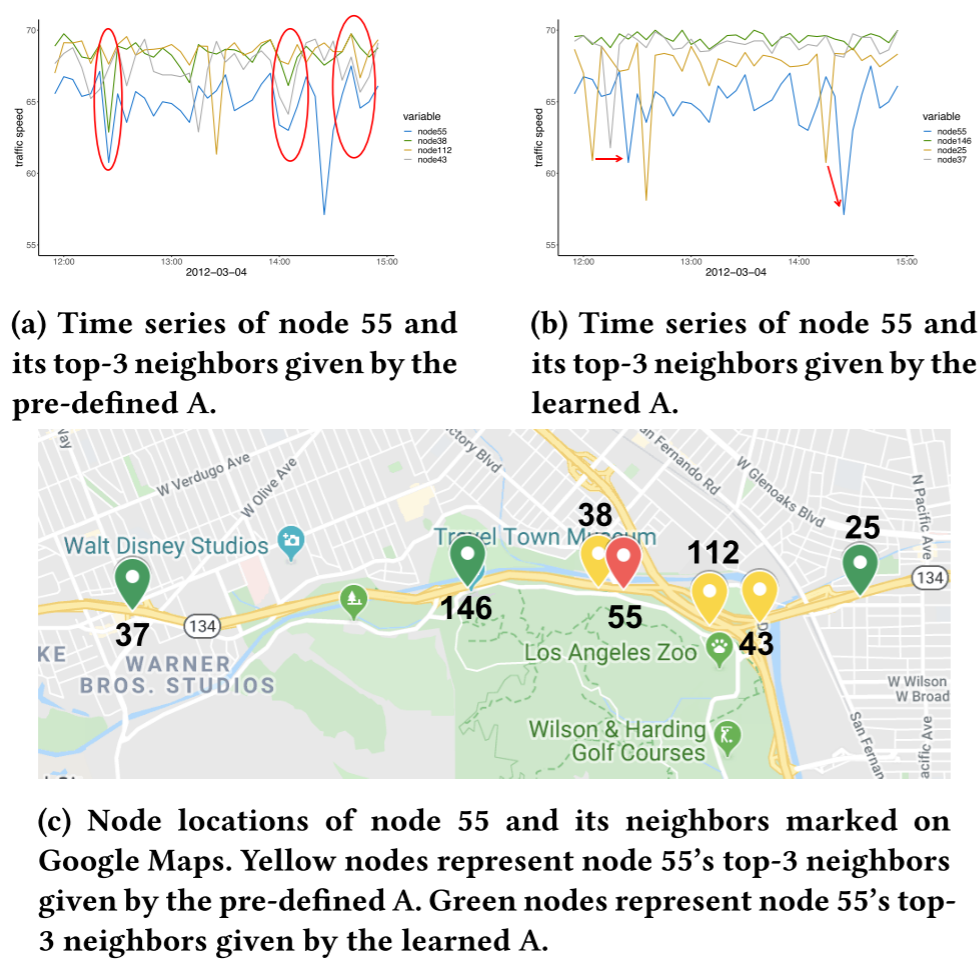

5.6 案例分析:学习到的图 vs. 预定义图

论文以 METR-LA 数据集中的节点 55 为例,将预定义邻居(基于路网距离最近的节点)与学习到的邻居进行了可视化对比,得出了一个非常直观的发现:

- 预定义邻居 在地理上离节点 55 更近,因此时间序列同步相关性更强(几乎同时变化);

- 学习到的邻居 虽然地理位置更远,但它们位于同一条道路的上游 ,其时间序列能够提前预示节点 55 的极端交通状况(如拥堵)。

这一发现说明,MTGNN 学习到的图结构捕捉的是因果/预测性依赖(上游路况领先下游),而非单纯的同步相关,具有更高的预测价值和可解释性。

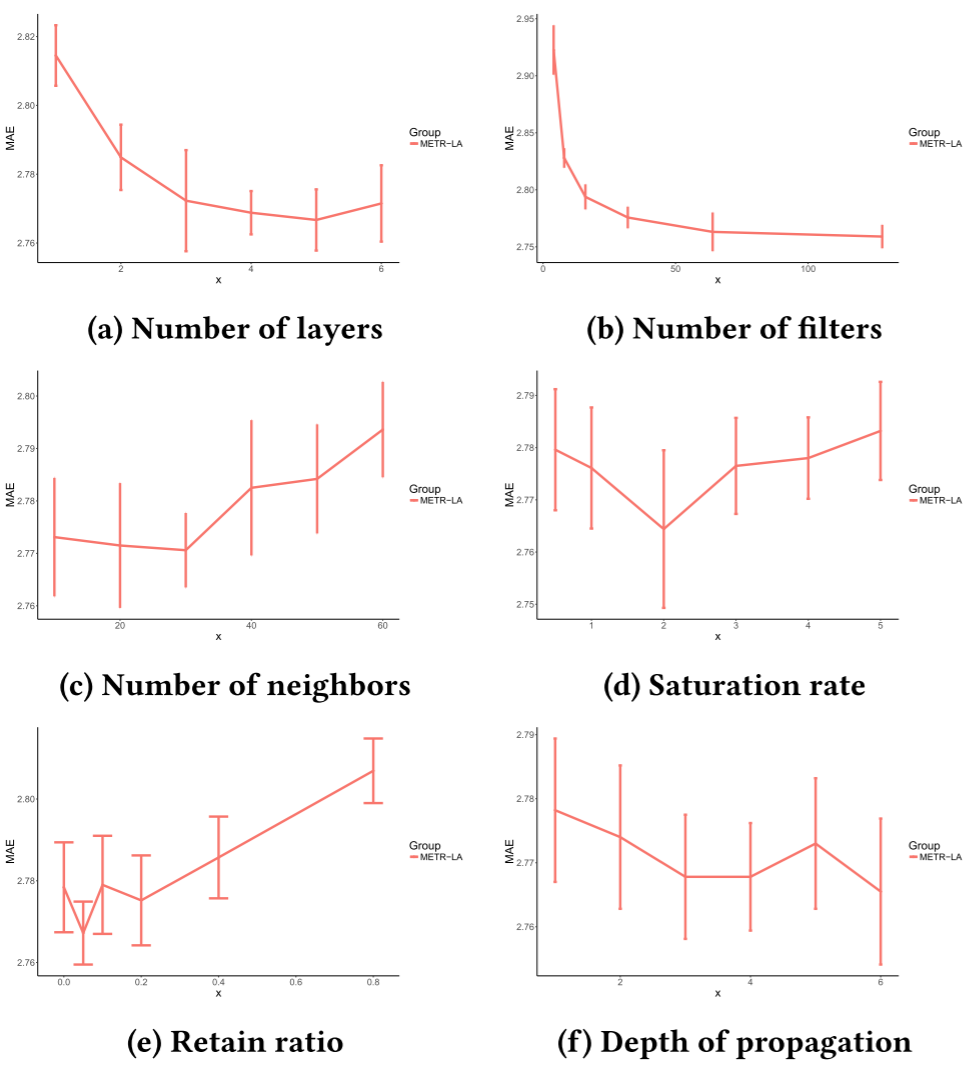

六、参数敏感性分析

论文对 8 个核心超参数进行了系统的敏感性分析,主要结论如下:

- 层数与滤波器数:增加层数和滤波器数量能提升模型表达能力,降低 MAE;

- 邻居数量:选择较少的邻居(约 20 个)效果更好,过多邻居引入噪声;

- 饱和率:模型对饱和率不敏感,但过高的饱和率会导致邻接矩阵值趋向 0 或 1,失去连续性;

- 保留比例:高保留比例会严重降低性能,因为它限制了节点探索其邻域的能力;

- 传播深度(K):2~3 步传播已足够,且 Mix-hop 层在深度增加时不会出现过平滑问题。

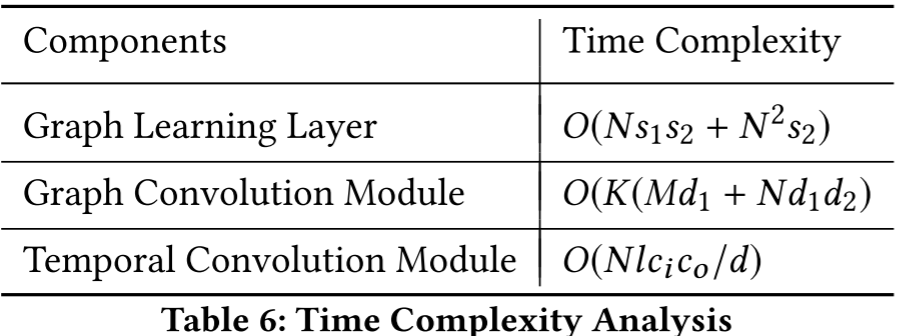

七、复杂度分析

通过子图采样,图学习层的实际复杂度可降至 O((N/s)^2)。

八、总结与贡献

MTGNN 是第一个从图视角对多变量时间序列进行端到端建模的通用框架,主要贡献可归纳为以下四点:

- 首创性:率先将图神经网络与多变量时间序列预测结合,开创了无需预定义图结构的 GNN 建模新范式。

- 图学习层:提出自适应学习单向稀疏图结构的方法,支持融入外部属性知识,泛用性强。

- 端到端框架:图学习、图卷积、时间卷积三大模块在统一框架内联合优化,无需分阶段训练。

- 实验性能 :在 4 个多变量时间序列基准数据集中的 3 个上取得最优结果;在 2 个交通数据集上,在不使用任何预定义图结构的情况下达到了与依赖预定义图的 SOTA 方法相当的性能。