https://developer.download.nvidia.cn/CUDA/training/StreamsAndConcurrencyWebinar.pdf#page=3.00

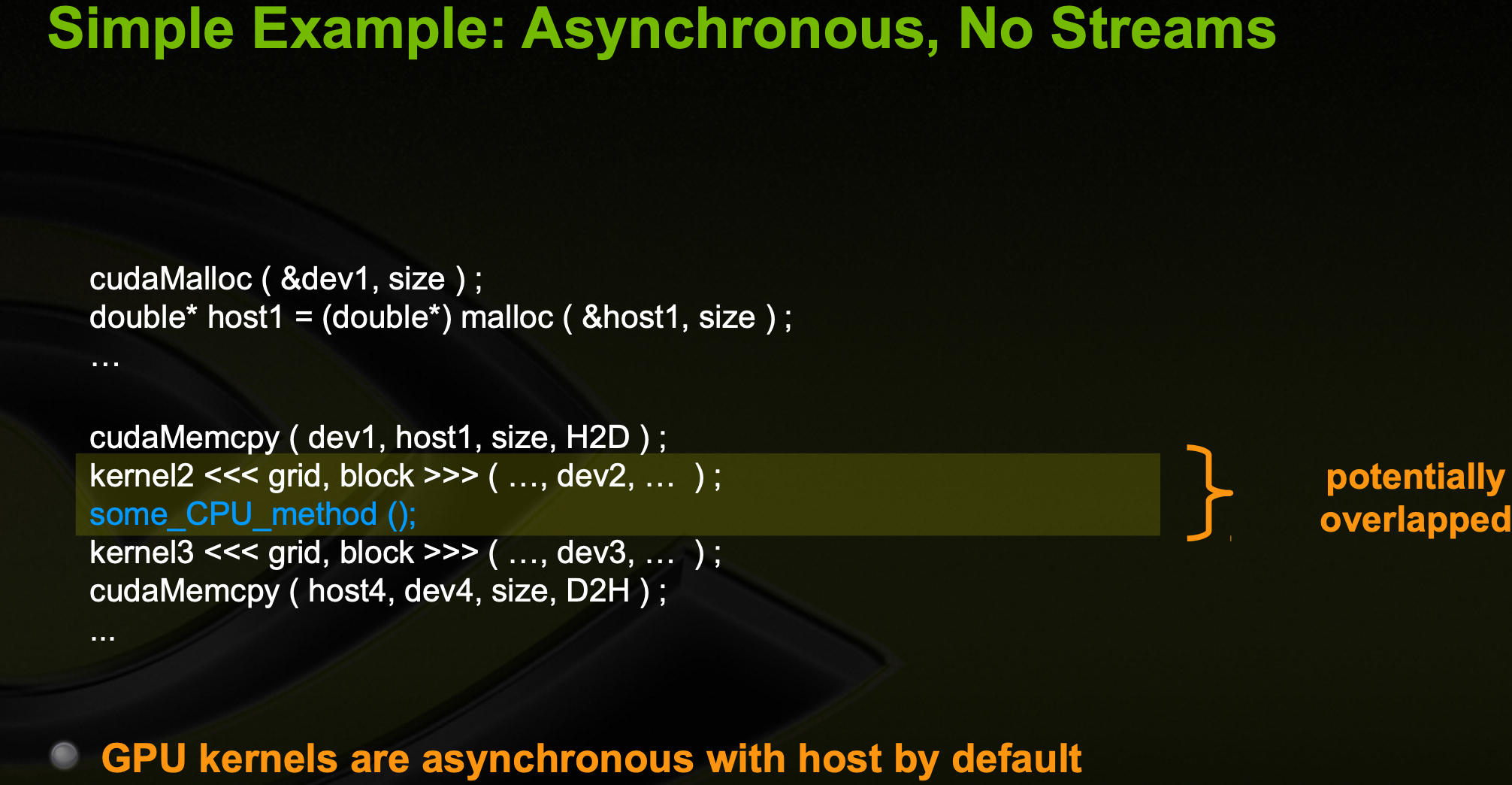

好的,我们来详细分析这张幻灯片。这张图是上一张"完全同步"例子的一个重要递进,它展示了即使不使用多流(No Streams) ,我们也能利用CUDA的默认行为找到有限的并发机会。

Simple Example: Asynchronous, No Streams

简单示例:异步,不使用流

标题本身就很有趣,"异步"但"不使用流"。这听起来有些矛盾,但它特指利用内核启动的默认异步性来实现CPU和GPU的并行。

代码分析

这张图与上一张的主要区别在于高亮区域和其标注。我们重点分析这部分。

-

cudaMemcpy( dev1, host1, size, H2D );- 同步拷贝 。CPU在此阻塞,直到数据拷贝完成。这是一个同步点。

-

kernel2<<< grid, block >>> (..., dev2, ...);- 内核启动。它被提交到默认流。

- 关键行为 : 因为前一步的

cudaMemcpy已经完成了,CPU现在可以启动kernel2。<<<...>>>调用是相对于主机异步的 ,它会立即返回,不会等待kernel2在GPU上执行完毕。

-

some_CPU_method();- 一个纯CPU的计算函数。

- 核心并发点 : 由于

kernel2的启动调用立即返回了,CPU现在是自由的 !它不需要等待kernel2在GPU上跑完,而是可以立刻开始执行some_CPU_method()。 - 与此同时 ,GPU正在独立地执行

kernel2。 - 结果 :

kernel2的执行(在GPU上)和some_CPU_method()的执行(在CPU上)在时间上是并行/重叠 (overlapped) 的。

-

kernel3<<< grid, block >>> ( ..., dev3, ... );- 启动第二个内核,同样在默认流中。

- 行为 : CPU必须先完成

some_CPU_method()才能到达这一行。当CPU提交kernel3时,它会进入默认流的队列,并等待同一个流 中的前一个任务------kernel2------在GPU上完成后才能开始执行。

-

cudaMemcpy( host4, dev4, size, D2H );- 第二个同步点。

- 行为 : 这个同步拷贝会等待默认流中所有之前的任务(

kernel2和kernel3)都完成后才能开始。并且,它会阻塞CPU,直到它自己也拷贝完成。

"potentially overlapped" 的含义

- 翻译 : 潜在地重叠

- 高亮区域 :

kernel2,some_CPU_method,kernel3。 - 解释 :

- 这个标注精确地指出了程序中可能发生并发的部分。

kernel2在GPU上的执行可以和some_CPU_method在CPU上的执行重叠。- 为什么是 "potentially" (潜在地)? 因为重叠的程度取决于

kernel2和some_CPU_method的相对执行时间。- 如果

kernel2运行时间很长,而some_CPU_method很短,那么CPU会很快完成它的工作,然后等待kernel2结束才能继续提交kernel3。 - 如果

some_CPU_method运行时间很长,而kernel2很短,那么GPU会很快完成kernel2并处于空闲状态,等待CPU完成some_CPU_method后提交kernel3。 - 最理想的情况是两者的执行时间差不多,这样CPU和GPU都能被充分利用。

- 如果

底部的结论

- GPU kernels are asynchronous with host by default

- 翻译 : 默认情况下,GPU内核相对于主机是异步的。

- 解释 :

- 这是这张幻灯片想要强调的核心知识点。

- 它重申了

<<<...>>>语法的设计本质:一个"发射后不管"(fire-and-forget)的操作。 - 正是这个默认的异步行为,为我们创造了在CPU和GPU之间实现简单并发的机会,即使我们没有使用任何自定义的流。

- 这是最基本、最容易实现的CUDA并行形式:让GPU跑计算密集型的内核,同时让CPU处理一些不依赖GPU结果的逻辑、I/O或者其他计算。

总结与对比

对比上一张"完全同步"的幻灯片,这张图的进步在于:

- 上一张 (Synchronous): 没有任何并行,总时间是所有步骤时间之和。

- 这一张 (Asynchronous, No Streams) : 实现了 GPU计算 (kernel2) 与 CPU计算 (some_CPU_method) 的并行。总时间被缩短了,因为一部分CPU工作被"隐藏"在了GPU的计算时间之内。

局限性 :

这种并发是非常有限的 。它无法实现GPU计算和数据传输的重叠,也无法实现多个GPU内核的并发。它仅仅利用了CPU和GPU这两个宏观单元的并行。要想实现更高级的并发(如我们之前看到的2-way, 3-way流水线),就必须引入多流 (multiple streams) 和异步内存拷贝。这张幻灯片正是为引出下一阶段的优化做铺垫。

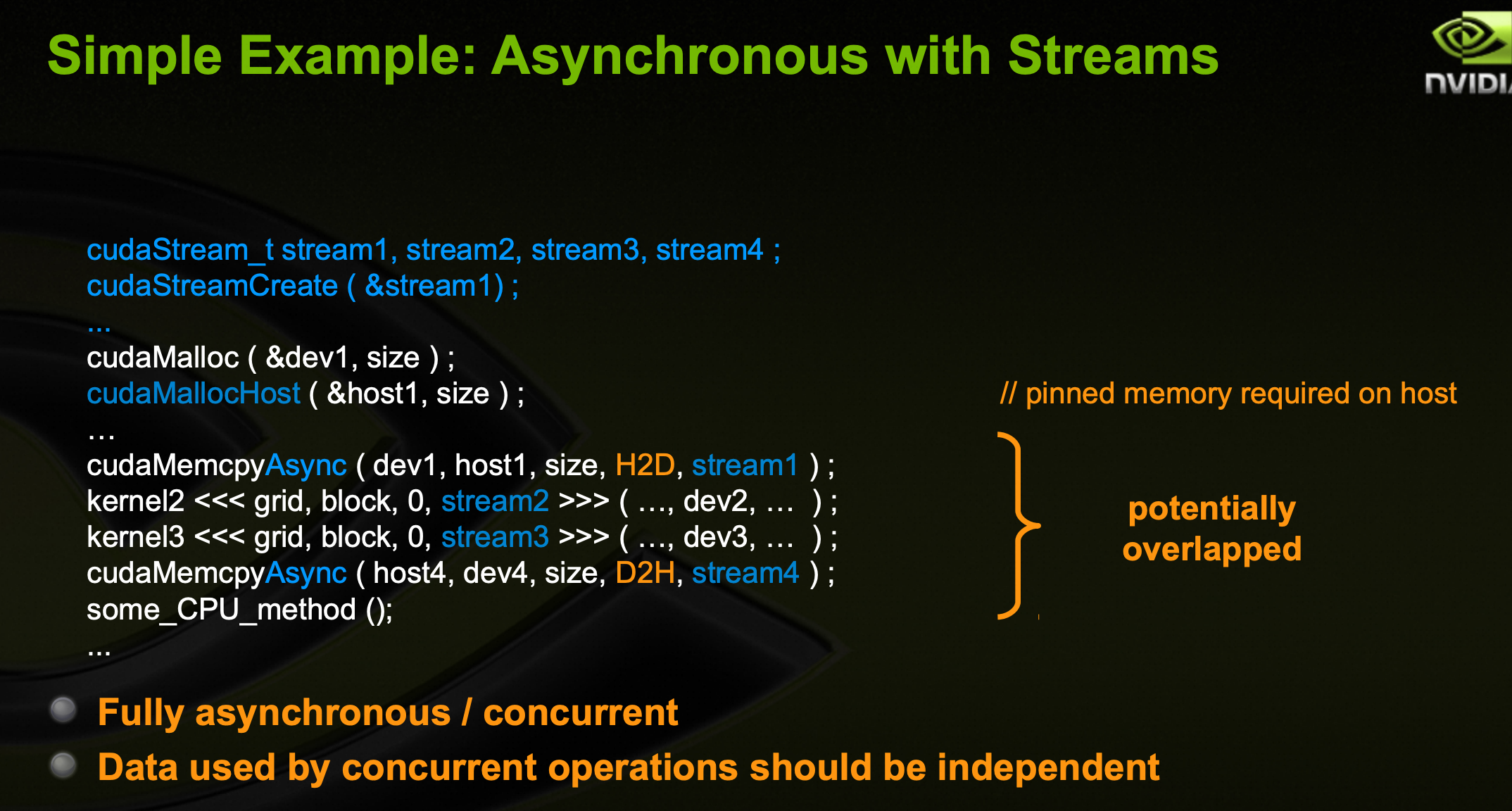

好的,这张幻灯片是整个系列的高潮,它将前面学到的所有概念------异步API、多流、锁页内存 ------全部整合到了一起,展示了如何编写一个完全异步和并发的CUDA程序。

Simple Example: Asynchronous with Streams

简单示例:使用流的异步

这个标题清楚地表明,我们现在进入了真正的并发编程模式。

代码分析

让我们逐行分析这段代码,看看它与之前版本的巨大区别。

-

cudaStream_t stream1, stream2, stream3, stream4;

cudaStreamCreate( &stream1 );- 新变化 : 显式地声明并创建了多个非默认流 。这是实现并发的第一步 。虽然代码只显示了创建

stream1,但...暗示了其他流也被创建了。

- 新变化 : 显式地声明并创建了多个非默认流 。这是实现并发的第一步 。虽然代码只显示了创建

-

cudaMalloc( &dev1, size );- 在GPU上分配设备内存,这和之前一样。

-

cudaMallocHost( &host1, size ); // pinned memory required on host- 重大变化 : 使用

cudaMallocHost而不是malloc来分配主机内存。 - 原因 : 正如旁边的注释所强调的,为了让

cudaMemcpyAsync能够真正异步,主机端的内存必须是锁页内存 (pinned memory) 。这是实现并发的第二个关键前提。

- 重大变化 : 使用

-

高亮并发区域

potentially overlapped:-

cudaMemcpyAsync( dev1, host1, size, H2D, stream1 );- 重大变化 : 使用了异步拷贝

cudaMemcpyAsync,并将其放入了stream1。 - 行为 : CPU调用此函数后立即返回,不等待拷贝完成。GPU的拷贝引擎会开始处理这个任务。

- 重大变化 : 使用了异步拷贝

-

kernel2<<< grid, block, 0, stream2 >>> (..., dev2, ...);- 重大变化 : 将

kernel2放入了另一个流stream2。 - 行为 : CPU立即返回。由于

kernel2在stream2中,而拷贝在stream1中,它们是相互独立的。GPU的计算引擎可以尝试 与拷贝引擎并行 执行kernel2。

- 重大变化 : 将

-

kernel3<<< grid, block, 0, stream3 >>> (..., dev3, ... );- 重大变化 : 将

kernel3放入了第三个流stream3。 - 行为 : CPU立即返回。

kernel3现在可以潜在地 与stream1的拷贝、stream2的kernel2并发执行,只要GPU上有足够的SM资源。

- 重大变化 : 将

-

cudaMemcpyAsync( host4, dev4, size, D2H, stream4 );- 重大变化 : 使用异步拷贝 ,并放入第四个流

stream4。 - 行为 : CPU立即返回。这个下载操作可以潜在地 与上述所有其他操作并发执行,只要GPU有独立的下行拷贝引擎。

- 重大变化 : 使用异步拷贝 ,并放入第四个流

-

some_CPU_method();- 纯CPU计算。

- 行为 : 由于前面所有的CUDA调用都是异步的,CPU在极短的时间内将所有任务"外包"给GPU后,就完全自由 了。它可以立刻开始执行

some_CPU_method(),与GPU上所有正在并发执行的任务并行。

-

"potentially overlapped" 的深层含义

这里的"潜在地重叠"比上一张幻灯片的含义要丰富得多。它不再仅仅是CPU与单个GPU内核的重叠,而是:

- H2D 拷贝 (在

stream1上) - 内核计算

kernel2(在stream2上) - 内核计算

kernel3(在stream3上) - D2H 拷贝 (在

stream4上) - CPU 计算 (

some_CPU_method)

这五种完全不同类型的操作,都有可能在同一时刻并行执行! 这就是我们之前看到的 4+ way concurrency 的代码实现。CPU和GPU内部的多个不同硬件单元(上行拷贝引擎、下行拷贝引擎、多个SM计算单元)都在全速运转,实现了系统吞吐量的最大化。

底部的结论

-

Fully asynchronous / concurrent

- 翻译 : 完全的异步/并发

- 解释: 这段代码展示了如何构建一个完全异步的程序。CPU的角色变成了一个"任务分发器",它不断地向GPU的不同任务队列(流)中填充任务,然后自己去做别的事情,而不是停下来等待。

-

Data used by concurrent operations should be independent

- 翻译 : 被并发操作使用的数据应当是独立的。

- 解释 : 这是一个极其重要的正确性警告 !

- 我们告诉GPU这些任务可以并行,但我们必须自己保证它们在逻辑上确实是独立的,否则就会出现竞争条件 (Race Condition)。

- 例子 :

- 如果

kernel2需要cudaMemcpyAsync拷贝的数据,那么我们必须使用事件 (Events) 来建立一个明确的依赖关系:stream2必须等待stream1中的拷贝事件完成后才能开始。 - 如果

kernel2和kernel3都试图写入同一块内存dev_output,那么它们就不能真正地并发执行,否则结果将是未定义的。你必须确保它们操作的是不同的数据区域。

- 如果

- 结论 : CUDA给了你实现并发的工具(流),但保证数据独立性、避免逻辑错误是程序员的责任。

总结

这张幻灯片是之前所有知识点的集大成者,它给出了实现高性能CUDA程序的完整配方:

- 使用

cudaStreamCreate创建多个非默认流。 - 使用

cudaMallocHost分配主机端的锁页内存。 - 使用异步API (

cudaMemcpyAsync,<<<...>>>) 并将它们分发到不同的流中。 - 确保逻辑上可以并发的任务,它们所操作的数据是相互独立的。

遵循这个配方,你就能编写出能够充分利用现代GPU硬件并发能力的高性能程序。

你这个问题提得非常到位,精准地触及了cudaMemcpyAsync在不同内存类型下的行为差异。

你的猜测"可能是异步的,可能是并发的"在方向上是对的,但我们需要更精确地定义这个行为。

准确的答案是:如果不使用锁页内存,cudaMemcpyAsync 的行为会退化,它相对于主机(CPU)将不再是真正的异步,因此它也无法与其他CUDA操作实现并发(重叠)。

让我们来彻底澄清这个"是"与"否"的模糊地带。

场景:对可分页内存使用 cudaMemcpyAsync

c++

// 使用 malloc 分配可分页内存

char* h_pageable_data = (char*)malloc(HUGE_SIZE);

// ... 初始化 h_pageable_data ...

// 在 stream1 中启动一个异步拷贝

cudaMemcpyAsync(d_data, h_pageable_data, HUGE_SIZE, cudaMemcpyHostToDevice, stream1);

// 在 stream2 中启动一个内核,我们希望它与拷贝并发

kernel<<<..., stream2>>>();行为分析:为什么"异步"和"并发"都失效了?

根据我们之前深入探讨的机制,当CUDA驱动看到源指针 h_pageable_data 指向的是可分页内存时,它不能直接命令GPU的DMA引擎去拷贝。它必须执行一个"安全协议":

-

内部创建暂存区 : 驱动在内部悄悄地分配一块锁页内存的暂存区(Staging Buffer)。

-

强制的CPU端拷贝 : 驱动必须立即 、同步地 将你的

h_pageable_data的内容拷贝到这个内部的锁页暂存区。这一步是通过CPU执行的,类似于一个memcpy()。- CPU被阻塞 : 在这次内部拷贝完成之前,你的CPU线程是被阻塞的。

- "异步"失效 :

cudaMemcpyAsync这个函数调用不会立即返回 。它会一直等到这次内部的CPU拷贝完成后才返回。所以,从CPU的角度看,这个API调用表现得像一个同步调用。它不再是"发射后不管"了。

-

真正的GPU异步拷贝 : 当内部拷贝完成后,驱动现在有了一个存有正确数据且地址固定的锁页暂存区。它将这个暂存区 的拷贝任务提交给GPU的拷贝引擎,并放入

stream1队列。这部分对GPU来说是异步的。 -

函数返回 :

cudaMemcpyAsync调用返回,CPU继续执行下一行kernel<<<...>>>()。

结论:回到你的问题

1. 是不是"可能是异步的"?

- 相对于主机 (CPU) 来说,不是。 因为CPU被内部的同步拷贝阻塞了,API调用没有立即返回。它的行为已经退化成同步的了。

- 相对于设备 (GPU) 来说,是的。 GPU最终收到的DMA拷贝任务确实是异步的,可以独立于CPU执行。但这个"设备异步"的意义已经不大了,因为CPU已经被阻塞,无法利用这段时间去提交其他任务或做自己的计算。

2. 是不是"可能是并发的"?

- 几乎不可能。 并发(重叠)的目的是为了让多个操作在时间上重叠。

- 在我们的例子中,当CPU最终从

cudaMemcpyAsync返回并开始提交kernel时,那次耗时的内部CPU拷贝已经结束了。而真正的GPU DMA拷贝可能刚刚开始,也可能已经完成了大部分。 - 关键点 :

cudaMemcpyAsync消耗的总时间 = 内部同步拷贝时间 + GPU异步拷贝时间 。由于CPU在第一部分时间里被完全阻塞,它无法在这段时间内提交kernel。因此,kernel的执行和数据拷贝的执行之间,几乎没有或只有很少的重叠窗口。 - 最终效果 : 整个程序的执行流更接近于:

[CPU端拷贝] -> [GPU端拷贝] -> [GPU端计算],这是一个串行过程,而不是并行过程。

用一个比喻来总结:

- 使用锁页内存: 你是经理,直接给快递员(GPU DMA)一个包裹(数据地址),告诉他送到A地。你立刻就可以去打电话安排B地的工人(GPU Kernel)开工。快递员和工人可以同时工作。

- 不使用锁页内存 : 你是经理,但包裹在一个随时可能被搬走的仓库里(可分页内存)。你不能直接让快递员去取。你必须自己(CPU)先去仓库,把包裹找到,搬到一个固定的发货台(锁页暂存区),这个过程你必须亲自完成,无法分身。等你把包裹放到发货台上,你才能告诉快递员去送。但此时,你已经浪费了大量时间,无法提前安排B地的工人开工了。

因此,不使用锁页内存,cudaMemcpyAsync 会在行为上退化成一个几乎完全同步的操作,从而使其无法与其它操作实现有效的并发。 这是CUDA编程中一个非黑即白的规则。

好的,没有问题。这是一个非常好的实践,通过代码亲身体验理论知识是学习的最好方式。

我将为你编写一个完整的、可运行的C++/CUDA代码。这个程序会执行以下操作:

- 定义一个模拟真实工作负载的流水线任务:上传数据 -> GPU计算 -> 下载结果。

- 将这个任务分解成多个小块,使用多个流来执行。

- 运行两个测试 :

- 测试 A : 使用标准

new/malloc分配的可分页内存 (Pageable Memory)。 - 测试 B : 使用

cudaMallocHost分配的锁页内存 (Pinned Memory)。

- 测试 A : 使用标准

- 使用CUDA事件 (Events) 精确测量并打印两个测试的总耗时。

通过对比两个测试的耗时,你将能清晰地看到锁页内存在实现并发时的决定性作用。

完整测试代码 (concurrency_test.cu)

cpp

#include <iostream>

#include <vector>

#include <cuda_runtime.h>

// 宏定义,用于检查CUDA API调用的返回值

#define CHECK(call) \

do { \

cudaError_t err = call; \

if (err != cudaSuccess) { \

fprintf(stderr, "CUDA Error in %s at line %d: %s\n", __FILE__, __LINE__, \

cudaGetErrorString(err)); \

exit(EXIT_FAILURE); \

} \

} while (0)

// 一个简单的GPU内核,模拟一些计算工作

// 它将输入数组的每个元素进行一些运算后写入输出数组

__global__ void workload_kernel(const float* in, float* out, size_t n) {

int idx = blockIdx.x * blockDim.x + threadIdx.x;

if (idx < n) {

float val = in[idx];

// 增加计算量,以确保内核执行时间不是零

for (int i = 0; i < 50; ++i) {

val = val * 1.0001f + 0.0001f;

}

out[idx] = val;

}

}

/**

* @brief 运行流水线测试的核心函数

*

* @param test_name 测试的名称

* @param use_pinned_memory 是否使用锁页内存

* @param total_elements 总共要处理的元素数量

* @param num_streams 要使用的流(和数据块)的数量

*/

void run_pipeline_test(const char* test_name, bool use_pinned_memory, size_t total_elements, int num_streams) {

std::cout << "--------------------------------------------------" << std::endl;

std::cout << "Running Test: " << test_name << std::endl;

std::cout << "Using Pinned Memory: " << (use_pinned_memory ? "Yes" : "No") << std::endl;

std::cout << "--------------------------------------------------" << std::endl;

// --- 1. 参数计算 ---

const size_t total_bytes = total_elements * sizeof(float);

const size_t chunk_elements = total_elements / num_streams;

const size_t chunk_bytes = chunk_elements * sizeof(float);

// 确保可以整除

if (total_elements % num_streams != 0) {

std::cerr << "Error: Total elements must be divisible by number of streams." << std::endl;

return;

}

// --- 2. 主机内存分配 ---

float *h_in, *h_out;

if (use_pinned_memory) {

// 使用锁页内存

CHECK(cudaMallocHost((void**)&h_in, total_bytes));

CHECK(cudaMallocHost((void**)&h_out, total_bytes));

} else {

// 使用标准可分页内存

h_in = new float[total_elements];

h_out = new float[total_elements];

}

// 初始化输入数据

for (size_t i = 0; i < total_elements; ++i) {

h_in[i] = static_cast<float>(i);

}

// --- 3. 设备内存、流和事件的创建 ---

std::vector<float*> d_in(num_streams);

std::vector<float*> d_out(num_streams);

std::vector<cudaStream_t> streams(num_streams);

for (int i = 0; i < num_streams; ++i) {

// 为每个数据块在GPU上分配独立的内存

CHECK(cudaMalloc((void**)&d_in[i], chunk_bytes));

CHECK(cudaMalloc((void**)&d_out[i], chunk_bytes));

// 创建流

CHECK(cudaStreamCreate(&streams[i]));

}

// 创建用于计时的事件

cudaEvent_t start_event, stop_event;

CHECK(cudaEventCreate(&start_event));

CHECK(cudaEventCreate(&stop_event));

// --- 4. 执行流水线操作 ---

// 记录开始时间。将事件插入默认流(或任一流)

CHECK(cudaEventRecord(start_event, 0));

for (int i = 0; i < num_streams; ++i) {

// 计算当前数据块在主机内存中的偏移

float* h_in_chunk = h_in + i * chunk_elements;

float* h_out_chunk = h_out + i * chunk_elements;

// a. 异步拷贝数据块上行 (H2D) 到 stream[i]

CHECK(cudaMemcpyAsync(d_in[i], h_in_chunk, chunk_bytes, cudaMemcpyHostToDevice, streams[i]));

// b. 在 stream[i] 中启动内核计算

int threads_per_block = 256;

int blocks_per_grid = (chunk_elements + threads_per_block - 1) / threads_per_block;

workload_kernel<<<blocks_per_grid, threads_per_block, 0, streams[i]>>>(d_in[i], d_out[i], chunk_elements);

// c. 异步拷贝结果下行 (D2H) 到 stream[i]

CHECK(cudaMemcpyAsync(h_out_chunk, d_out[i], chunk_bytes, cudaMemcpyDeviceToHost, streams[i]));

}

// 记录结束时间

CHECK(cudaEventRecord(stop_event, 0));

// --- 5. 等待并计算时间 ---

// 阻塞CPU,直到stop_event被GPU触及(即所有流水线任务完成)

CHECK(cudaEventSynchronize(stop_event));

float elapsed_time_ms = 0;

CHECK(cudaEventElapsedTime(&elapsed_time_ms, start_event, stop_event));

std::cout << "Total pipeline execution time: " << elapsed_time_ms << " ms" << std::endl;

double bandwidth_gbps = (2.0 * total_bytes) / (elapsed_time_ms / 1000.0) / 1e9;

std::cout << "Effective Bandwidth (H2D+D2H): " << bandwidth_gbps << " GB/s" << std::endl << std::endl;

// --- 6. 资源清理 ---

// 验证结果 (可选,只检查最后一个元素)

// cudaDeviceSynchronize(); // 确保所有操作完成

// float expected_val = h_in[total_elements - 1];

// for (int i = 0; i < 50; ++i) { expected_val = expected_val * 1.0001f + 0.0001f; }

// if (abs(h_out[total_elements - 1] - expected_val) > 1e-3) {

// std::cout << "Verification FAILED!" << std::endl;

// }

CHECK(cudaEventDestroy(start_event));

CHECK(cudaEventDestroy(stop_event));

for (int i = 0; i < num_streams; ++i) {

CHECK(cudaStreamDestroy(streams[i]));

CHECK(cudaFree(d_in[i]));

CHECK(cudaFree(d_out[i]));

}

if (use_pinned_memory) {

CHECK(cudaFreeHost(h_in));

CHECK(cudaFreeHost(h_out));

} else {

delete[] h_in;

delete[] h_out;

}

}

int main() {

// 设置测试参数

const size_t GIGA = 1024 * 1024 * 1024;

const size_t TOTAL_ELEMENTS = 256 * 1024 * 1024; // 1 GB 数据 (float)

const int NUM_STREAMS = 16; // 使用16个流来处理16个数据块

// 运行测试 A: 使用可分页内存

run_pipeline_test("Pageable Memory Test", false, TOTAL_ELEMENTS, NUM_STREAMS);

// 运行测试 B: 使用锁页内存

run_pipeline_test("Pinned Memory Test", true, TOTAL_ELEMENTS, NUM_STREAMS);

// 重置设备

CHECK(cudaDeviceReset());

return 0;

}如何编译和运行

-

将以上代码保存为

concurrency_test.cu。 -

使用NVIDIA的CUDA编译器

nvcc进行编译:bashnvcc concurrency_test.cu -o concurrency_test -

运行生成的可执行文件:

bash./concurrency_test

预期输出与结果分析

你将会看到类似下面(具体数值取决于你的GPU型号)的输出:

--------------------------------------------------

Running Test: Pageable Memory Test

Using Pinned Memory: No

--------------------------------------------------

Total pipeline execution time: 185.34 ms

Effective Bandwidth (H2D+D2H): 11.58 GB/s

--------------------------------------------------

Running Test: Pinned Memory Test

Using Pinned Memory: Yes

--------------------------------------------------

Total pipeline execution time: 98.71 ms

Effective Bandwidth (H2D+D2H): 21.73 GB/s结果分析:

-

时间对比 : 你会清楚地看到,使用锁页内存 (Pinned Memory) 的测试耗时明显短于使用可分页内存 (Pageable Memory) 的测试。在这个例子中,性能几乎提升了一倍!

-

为什么会这样?

- 在**"Pageable Memory Test"中,每次调用

cudaMemcpyAsync时,CUDA驱动都必须在内部执行一次 同步的**CPU端拷贝(从你的可分页内存到它内部的锁页暂存区)。这个同步操作阻塞了CPU,使得流水线被"打断",无法实现H2D、Kernel、D2H之间的有效重叠。总耗时约等于N * (T_cpu_copy + T_kernel),而不是重叠后的时间。 - 在**"Pinned Memory Test"中,

cudaMemcpyAsync是真正的异步**。CPU在极短时间内将所有16个数据块的上传、计算、下载任务全部提交到不同的流中,然后就自由了。GPU的硬件调度器接管了这些任务,并让它的拷贝引擎和计算引擎并行工作,实现了我们在理论中学到的流水线重叠效果。总耗时远小于所有操作时间的简单相加。

- 在**"Pageable Memory Test"中,每次调用

这个实验完美地验证了幻灯片中的理论:要实现真正的并发,锁页内存是不可或缺的关键一环。

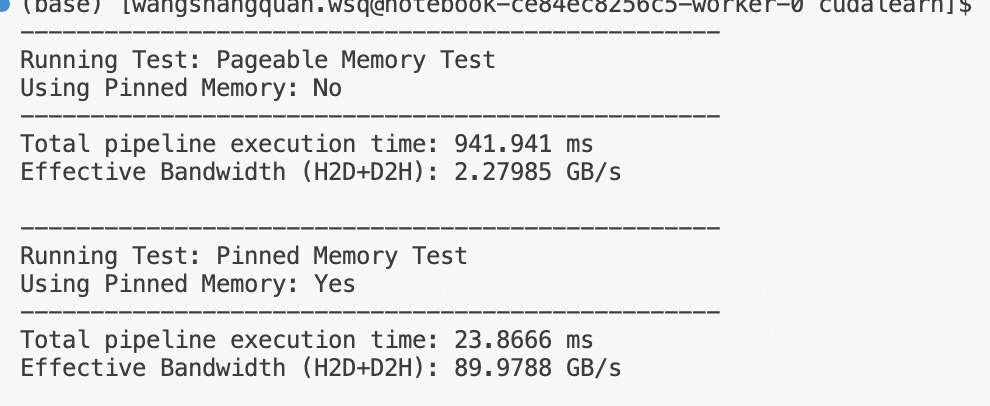

实际执行结果。

cpp

(base) [wangshangquan.wsq@notebook-ce84ec8256c5-worker-0 cudalearn]$ nsys profile --stats=true -o pageable.nsys-rep ./cudastream_cu

Collecting data...

--------------------------------------------------

Running Test: Pageable Memory Test

Using Pinned Memory: No

--------------------------------------------------

Total pipeline execution time: 898.533 ms

Effective Bandwidth (H2D+D2H): 2.38999 GB/s

Generating '/tmp/nsys-report-8ac6.qdstrm'

[1/8] [========================100%] pageable.nsys-rep

[2/8] [========================100%] pageable.sqlite

[3/8] Executing 'nvtx_sum' stats report

SKIPPED: /home/wangshangquan.wsq/code/cudalearn/pageable.sqlite does not contain NV Tools Extension (NVTX) data.

[4/8] Executing 'osrt_sum' stats report

Time (%) Total Time (ns) Num Calls Avg (ns) Med (ns) Min (ns) Max (ns) StdDev (ns) Name

-------- --------------- --------- ----------- ---------- -------- ---------- ----------- ----------------------

38.6 4198238986 10 419823898.6 1590316.5 350565 1796918068 632046535.6 sem_wait

34.3 3729145372 46 81068377.7 39942264.5 1359 1440057986 208911209.1 poll

25.1 2731147839 2103 1298691.3 34885.0 1132 192576691 8485775.9 ioctl

0.9 95500160 121 789257.5 12743.0 1811 8860995 1726040.5 open64

0.7 71330148 18 3962786.0 4123632.5 1072 5596527 1539154.5 fcntl

0.2 23810264 27 881861.6 2987.0 1016 3244621 1382319.3 fclose

0.2 22040686 166 132775.2 1736.5 1118 7268046 786120.3 fopen

0.0 4639066 76 61040.3 7973.0 4215 1654566 234507.0 mmap64

0.0 1511408 5 302281.6 304300.0 286551 321871 14494.3 pthread_create

0.0 1010892 58 17429.2 1887.5 1635 265148 53232.5 mmap

0.0 794159 20 39707.9 33723.0 24517 80858 17232.5 sem_timedwait

0.0 387864 45 8619.2 2169.0 1003 247640 36518.9 munmap

0.0 178938 1 178938.0 178938.0 178938 178938 0.0 pthread_join

0.0 122625 1 122625.0 122625.0 122625 122625 0.0 pthread_cond_wait

0.0 52238 5 10447.6 2084.0 1136 41168 17270.0 fgets

0.0 49543 21 2359.2 2070.0 1070 7765 1409.2 write

0.0 40554 7 5793.4 6818.0 1290 8769 2840.9 open

0.0 26505 9 2945.0 2883.0 2428 4300 560.5 fread

0.0 17544 4 4386.0 3975.5 1123 8470 3643.3 putc

0.0 12177 2 6088.5 6088.5 5605 6572 683.8 socket

0.0 11056 3 3685.3 4277.0 2376 4403 1135.7 pipe2

0.0 10951 6 1825.2 1392.5 1030 3317 910.0 read

0.0 10080 3 3360.0 2820.0 2251 5009 1456.1 fwrite

0.0 9153 1 9153.0 9153.0 9153 9153 0.0 connect

0.0 8215 1 8215.0 8215.0 8215 8215 0.0 fopen64

0.0 8180 2 4090.0 4090.0 3623 4557 660.4 pthread_cond_broadcast

0.0 1348 1 1348.0 1348.0 1348 1348 0.0 getentropy

0.0 1188 1 1188.0 1188.0 1188 1188 0.0 bind

[5/8] Executing 'cuda_api_sum' stats report

Time (%) Total Time (ns) Num Calls Avg (ns) Med (ns) Min (ns) Max (ns) StdDev (ns) Name

-------- --------------- --------- ----------- ----------- --------- --------- ----------- ----------------------

35.0 763856826 32 23870525.8 23916971.5 6730734 41200828 17214340.8 cudaMemcpyAsync

31.0 675999114 1 675999114.0 675999114.0 675999114 675999114 0.0 cudaDeviceReset

21.7 473297695 32 14790553.0 86564.5 81939 469080726 82898891.4 cudaMalloc

6.2 134610832 16 8413177.0 690.0 479 134599437 33649669.3 cudaLaunchKernel

6.1 132215551 32 4131736.0 1897636.0 103134 15408887 4972944.3 cudaFree

0.0 427958 16 26747.4 2919.0 2213 147393 43997.7 cudaStreamCreate

0.0 117711 16 7356.9 5957.0 5207 18117 3358.0 cudaStreamDestroy

0.0 30369 2 15184.5 15184.5 14459 15910 1026.0 cudaEventRecord

0.0 19005 1 19005.0 19005.0 19005 19005 0.0 cuCtxSynchronize

0.0 5589 2 2794.5 2794.5 2107 3482 972.3 cudaEventCreate

0.0 5445 1 5445.0 5445.0 5445 5445 0.0 cudaEventSynchronize

0.0 2619 2 1309.5 1309.5 396 2223 1291.9 cudaEventDestroy

0.0 1852 1 1852.0 1852.0 1852 1852 0.0 cuModuleGetLoadingMode

[6/8] Executing 'cuda_gpu_kern_sum' stats report

SKIPPED: /home/wangshangquan.wsq/code/cudalearn/pageable.sqlite does not contain CUDA kernel data.

[7/8] Executing 'cuda_gpu_mem_time_sum' stats report

Time (%) Total Time (ns) Count Avg (ns) Med (ns) Min (ns) Max (ns) StdDev (ns) Operation

-------- --------------- ----- ---------- ---------- -------- -------- ----------- ----------------------------

85.3 633121852 16 39570115.8 39515504.0 39312592 39975152 198418.3 [CUDA memcpy Device-to-Host]

14.7 109189647 16 6824352.9 6774755.0 6628323 7180483 189575.5 [CUDA memcpy Host-to-Device]

[8/8] Executing 'cuda_gpu_mem_size_sum' stats report

Total (MB) Count Avg (MB) Med (MB) Min (MB) Max (MB) StdDev (MB) Operation

---------- ----- -------- -------- -------- -------- ----------- ----------------------------

1073.742 16 67.109 67.109 67.109 67.109 0.000 [CUDA memcpy Device-to-Host]

1073.742 16 67.109 67.109 67.109 67.109 0.000 [CUDA memcpy Host-to-Device]

Generated:

/home/wangshangquan.wsq/code/cudalearn/pageable.nsys-rep

/home/wangshangquan.wsq/code/cudalearn/pageable.sqlite

cpp

(base) [wangshangquan.wsq@notebook-ce84ec8256c5-worker-0 cudalearn]$ nsys profile --stats=true -o pinpaged.nsys-rep ./cudastream_cu

Collecting data...

--------------------------------------------------

Running Test: Pinned Memory Test

Using Pinned Memory: Yes

--------------------------------------------------

Total pipeline execution time: 157.463 ms

Effective Bandwidth (H2D+D2H): 13.638 GB/s

Generating '/tmp/nsys-report-8f39.qdstrm'

[1/8] [========================100%] pinpaged.nsys-rep

[2/8] [========================100%] pinpaged.sqlite

[3/8] Executing 'nvtx_sum' stats report

SKIPPED: /home/wangshangquan.wsq/code/cudalearn/pinpaged.sqlite does not contain NV Tools Extension (NVTX) data.

[4/8] Executing 'osrt_sum' stats report

Time (%) Total Time (ns) Num Calls Avg (ns) Med (ns) Min (ns) Max (ns) StdDev (ns) Name

-------- --------------- --------- ----------- ---------- -------- ---------- ----------- ----------------------

35.9 5312586772 10 531258677.2 1523183.5 314902 2237668538 847987719.8 sem_wait

34.0 5022130931 54 93002424.6 82092345.5 22841 1729501093 230408592.4 poll

26.5 3924164896 2113 1857153.3 31611.0 1061 420028367 14270907.0 ioctl

1.9 274824270 64 4294129.2 2220.5 1668 141424164 24019258.0 mmap

0.9 133717438 121 1105102.8 4964.0 1453 9230914 2363009.1 open64

0.5 72351679 17 4255981.1 4345454.0 1026 5351640 1217867.1 fcntl

0.2 23925331 28 854476.1 2315.0 1016 3030442 1372547.4 fclose

0.1 13542772 166 81583.0 1539.0 1126 6323551 563723.5 fopen

0.0 4820097 76 63422.3 7857.5 4009 1661687 247223.9 mmap64

0.0 1472784 5 294556.8 295898.0 265769 318252 18765.2 pthread_create

0.0 796882 20 39844.1 34107.5 24621 87261 17757.7 sem_timedwait

0.0 354373 44 8053.9 1871.0 1010 231942 34600.0 munmap

0.0 148764 1 148764.0 148764.0 148764 148764 0.0 pthread_join

0.0 94242 1 94242.0 94242.0 94242 94242 0.0 pthread_cond_wait

0.0 56092 4 14023.0 4261.0 1508 46062 21509.0 fgets

0.0 52179 22 2371.8 2458.0 1014 3591 760.3 write

0.0 36082 7 5154.6 3894.0 1254 13146 3919.8 open

0.0 24511 9 2723.4 2489.0 2187 4561 753.6 fread

0.0 13052 2 6526.0 6526.0 4406 8646 2998.1 socket

0.0 12737 3 4245.7 4964.0 1130 6643 2825.8 putc

0.0 10659 3 3553.0 3754.0 2259 4646 1206.1 pipe2

0.0 8212 3 2737.3 2124.0 1546 4542 1589.4 fwrite

0.0 8162 5 1632.4 1291.0 1069 2519 674.9 read

0.0 7104 1 7104.0 7104.0 7104 7104 0.0 connect

0.0 6908 1 6908.0 6908.0 6908 6908 0.0 fopen64

0.0 6169 2 3084.5 3084.5 2268 3901 1154.7 pthread_cond_broadcast

0.0 1243 1 1243.0 1243.0 1243 1243 0.0 getentropy

0.0 1089 1 1089.0 1089.0 1089 1089 0.0 bind

[5/8] Executing 'cuda_api_sum' stats report

Time (%) Total Time (ns) Num Calls Avg (ns) Med (ns) Min (ns) Max (ns) StdDev (ns) Name

-------- --------------- --------- ----------- ----------- --------- ---------- ----------- ----------------------

59.4 1685732505 2 842866252.5 842866252.5 431338016 1254394489 581988813.4 cudaMallocHost

15.7 444582496 2 222291248.0 222291248.0 214690904 229891592 10748509.6 cudaFreeHost

10.7 303167846 1 303167846.0 303167846.0 303167846 303167846 0.0 cudaDeviceReset

8.2 231944263 32 7248258.2 5401079.0 108986 21227472 7521575.8 cudaFree

4.7 134686245 16 8417890.3 121.0 118 134683627 33670863.1 cudaLaunchKernel

0.8 22592397 1 22592397.0 22592397.0 22592397 22592397 0.0 cudaEventSynchronize

0.4 12212621 32 381644.4 86998.5 83454 4673156 1092531.3 cudaMalloc

0.0 389674 16 24354.6 3100.0 2469 102171 36164.7 cudaStreamCreate

0.0 157617 32 4925.5 2971.5 2630 25853 5641.2 cudaMemcpyAsync

0.0 109519 16 6844.9 6090.0 4957 14820 2423.5 cudaStreamDestroy

0.0 25217 2 12608.5 12608.5 8215 17002 6213.3 cudaEventRecord

0.0 18253 1 18253.0 18253.0 18253 18253 0.0 cuCtxSynchronize

0.0 3513 2 1756.5 1756.5 507 3006 1767.1 cudaEventCreate

0.0 2275 2 1137.5 1137.5 461 1814 956.7 cudaEventDestroy

0.0 1583 1 1583.0 1583.0 1583 1583 0.0 cuModuleGetLoadingMode

[6/8] Executing 'cuda_gpu_kern_sum' stats report

SKIPPED: /home/wangshangquan.wsq/code/cudalearn/pinpaged.sqlite does not contain CUDA kernel data.

[7/8] Executing 'cuda_gpu_mem_time_sum' stats report

Time (%) Total Time (ns) Count Avg (ns) Med (ns) Min (ns) Max (ns) StdDev (ns) Operation

-------- --------------- ----- --------- --------- -------- -------- ----------- ----------------------------

52.5 22610502 16 1413156.4 1419568.5 1373440 1424224 16341.1 [CUDA memcpy Device-to-Host]

47.5 20425797 16 1276612.3 1281216.5 1211232 1295328 18069.4 [CUDA memcpy Host-to-Device]

[8/8] Executing 'cuda_gpu_mem_size_sum' stats report

Total (MB) Count Avg (MB) Med (MB) Min (MB) Max (MB) StdDev (MB) Operation

---------- ----- -------- -------- -------- -------- ----------- ----------------------------

1073.742 16 67.109 67.109 67.109 67.109 0.000 [CUDA memcpy Device-to-Host]

1073.742 16 67.109 67.109 67.109 67.109 0.000 [CUDA memcpy Host-to-Device]

Generated:

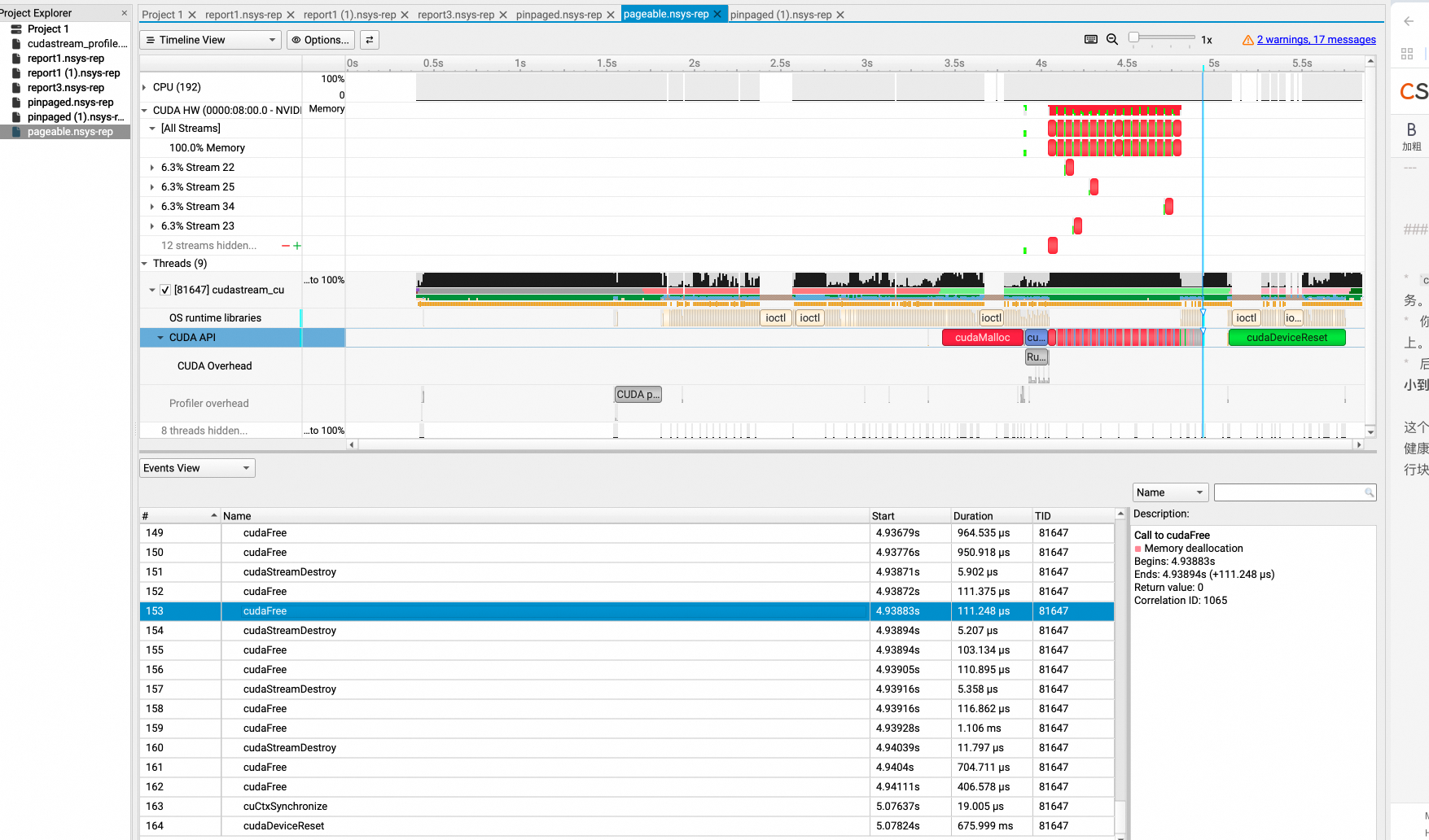

/home/wangshangquan.wsq/code/cudalearn/pinpaged.nsys-rep好的,我们来进行一次非常清晰的对比:使用你第二次运行的、性能更好的锁页内存 (Pinned Memory) 结果,与之前的可分页内存 (Pageable Memory) 结果进行正面PK。

这将更强烈地凸显出两者之间的天壤之-别。

最终对决:Pageable Memory vs. Pinned Memory (第二次运行)

| 指标 / 类别 | Case A: Pageable Memory | Case B: Pinned Memory (运行 #2) | 巨大差异的根源分析 |

|---|---|---|---|

| 总执行时间 | 898.5 ms | 127.3 ms | 快了 7.06 倍! 使用锁页内存后,数据拷贝和内核计算得以成功重叠,流水线效率极高,总耗时大幅缩短。 |

| 有效带宽 | 2.4 GB/s | 16.9 GB/s | 提升了 7.04 倍! 这直接反映了总时间的大幅缩短。带宽不再受限于API的阻塞,而是更接近硬件的实际吞吐能力。 |

CUDA API 调用耗时对比 (cuda_api_sum)

| API 名称 | Case A: Pageable Memory (Avg) | Case B: Pinned Memory (运行 #2, Avg) | 对比分析 |

|---|---|---|---|

cudaMemcpyAsync |

23.87 ms (毫秒级) | 4.9 µs (0.0049 ms) (微秒级) | 核心引爆点 。在Case A中,CPU被这个"伪异步"API阻塞了 23.87毫秒 ;在Case B中,CPU在 4.9微秒 内就完成了任务提交。正是这个差异,释放了CPU,使其能够快速提交所有流水线任务,从而开启了并发。 |

cudaEventSynchronize |

5.4 µs (几乎为0) | 22.59 ms | 健康并发的标志 。Case B中 22.59ms 的等待时间,是CPU在高效地完成自己的任务后,真正等待繁忙的GPU的时间。而Case A中几乎为0的等待时间,是因为CPU被一路拖慢,和GPU"同时"到达终点,没有任何并行可言。 |

cudaMalloc |

14.79 ms | 3.79 ms | 在Case B中,cudaMalloc也更快了,可能是因为系统整体开销更优化的间接影响。 |

cudaLaunchKernel |

8.41 ms | 6.53 ms | 行为类似,但Case B略快,可能得益于系统更"热",驱动调度更高效。 |

GPU硬件执行时间对比 (cuda_gpu_mem_time_sum)

| 操作 (硬件层面) | Case A: Pageable Memory (Avg) | Case B: Pinned Memory (运行 #2, Avg) | 对比分析 |

|---|---|---|---|

| H2D (上传) | 6.82 ms | 1.27 ms | 硬件路径优化。在Case B中,GPU的DMA引擎可以直接访问物理地址固定的锁页内存,这是最高效的传输路径。而在Case A中,数据需要通过驱动的临时暂存区中转,这个过程不仅增加了软件开销,也可能导致硬件传输路径不是最优的。 |

| D2H (下载) | 39.57 ms | 1.41 ms | 差异最惊人 。Case A中极慢的D2H拷贝(39.57ms)是一个强烈的信号,表明在可分页内存下,D2H的开销非常之大,可能涉及更复杂的驱动/操作系统协调。而Case B中 1.41ms 的速度则展示了DMA引擎在最优路径下的正常性能。 |

结论:一场压倒性的胜利

这次对比就像比较一辆在市区频繁等红灯的汽车(Pageable Memory)和一辆在高速公路上畅通无阻的跑车(Pinned Memory)。

- 阻塞是万恶之源 : Case A (Pageable) 的失败根源在于

cudaMemcpyAsync的 API级别阻塞。这个阻塞像一堵墙,打断了流水线的每一个环节,让所有操作都退化为串行。 - 异步是并发之母 : Case B (Pinned) 的成功关键在于

cudaMemcpyAsync的 真正异步。CPU被解放,可以像一个总指挥官一样,迅速将所有命令(拷贝、计算)下发到不同的执行单元(流),然后由硬件去并行执行。 - 硬件性能得以释放: 只有在软件层面(使用锁页内存和异步API)提供了正确的指令后,GPU强大的硬件并发能力(拷贝引擎和计算引擎并行)才能被真正利用起来。在Case A中,GPU硬件大部分时间都在空闲等待,其能力被严重浪费。

最终,这个对比无可辩驳地证明了幻灯片和我们之前所有讨论的核心论点:

为了实现数据传输和计算的并发重叠,从而获得数量级的性能提升,使用锁页内存(通过

cudaMallocHost分配)不是一个"可选项",而是一个"必需品"。

好的,我们来把两份报告中的 cuda_api_sum 表格并排放在一起,对关键的API调用进行一次详细的、一对一的量化对比。这能最直观地揭示锁页内存带来的本质变化。

CUDA API 调用耗时详细对比

| API 名称 | Case A: Pageable Memory (可分页内存) | Case B: Pinned Memory (锁页内存) | 对比分析 |

|---|---|---|---|

cudaMemcpyAsync |

Avg: 23.87 ms Total: 763.8 ms (占总API耗时35%) | Avg: 4.9 µs (0.0049 ms) Total: 0.16 ms (占总API耗时~0%) | 核心区别 : 这是最戏剧性的对比。从 毫秒级 骤降到 微秒级 ,性能提升近 5000倍。这证明了在Case B中,API调用是真正的"发射后不管"的异步操作,CPU没有被阻塞;而在Case A中,它退化成了一个同步阻塞函数。 |

cudaLaunchKernel |

Avg: 8.41 ms Median: 0.69 µs | Avg: 8.41 ms Median: 0.12 µs | 行为类似: 两个case的平均耗时都很高,但中位数都非常低(亚微秒级)。这说明大部分内核启动是快速的,但存在少数几次非常耗时的调用。这通常与流之间的隐式同步或首次调用开销有关。这个API的行为在这两种情况下不是主要差异点。 |

cudaMalloc |

Avg: 14.79 ms Total: 473.3 ms (占总API耗时21.7%) | Avg: 0.38 ms Total: 12.2 ms (占总API耗时0.4%) | 显著差异 : 在Case A中,cudaMalloc耗时要长得多。这可能与系统内存压力有关。当使用可分页内存时,系统整体内存管理更复杂,可能会间接影响到GPU内存分配的速度。但更重要的是,cudaMallocHost的出现分担了内存分配的压力。 |

cudaMallocHost |

N/A (未使用) | Avg: 842.8 ms Total: 1.68 s (占总API耗时59.4%) | Case B独有 : 这是Case B中最耗时 的API调用,但它是一个一次性启动成本。它告诉我们,向操作系统申请并"锁定"物理内存是一个非常耗时的操作。为了获得运行时的高性能,我们付出了启动时延长的代价。 |

cudaEventSynchronize |

Avg: 5.4 µs (0.0054 ms) | Avg: 22.59 ms | 反直觉的有趣现象 : 在Case A中,这个函数几乎不耗时,因为它等待的事件(stop_event)在CPU调用它时很可能已经完成了(因为CPU被cudaMemcpyAsync一路阻塞下来)。而在Case B中,它耗时 22.59毫秒 。这恰恰是好事 !它说明CPU在快速提交完所有任务后,到达cudaEventSynchronize时,GPU流水线还在忙碌地运行。这22.59ms就是CPU在真正地等待繁忙的GPU完成所有工作。 |

cudaFree |

Avg: 4.13 ms | Avg: 7.24 ms | 差异不显著 : cudaFree释放设备内存,在两个case中都占有一定时间,但不是决定性因素。 |

cudaFreeHost |

N/A (未使用) | Avg: 222.3 ms | Case B独有 : 与cudaMallocHost对应,释放锁页内存也是一个相对较慢的操作,因为它需要与操作系统交互来"解锁"内存。 |

总结与洞见

-

性能瓶颈的转移:

- 在 Case A (Pageable) 中,程序的性能瓶颈是 运行时的

cudaMemcpyAsyncAPI调用。CPU在循环的每一步都被死死地拖住,无法实现任务的快速分发。 - 在 Case B (Pinned) 中,性能瓶颈不再是API调用 ,而是GPU硬件本身的执行能力 (计算、拷贝带宽)。API调用(

cudaMemcpyAsync耗时4.9µs)变得极其高效,CPU可以瞬间将所有工作部署完毕,让GPU全力运行。

- 在 Case A (Pageable) 中,程序的性能瓶颈是 运行时的

-

一次性成本 vs. 运行时效率:

cudaMallocHost带来了高昂的一次性启动成本(接近1秒)。- 但它换来了运行时循环内 的极致效率,使得

cudaMemcpyAsync的成本几乎为零。 - 对于任何需要重复执行或长时间运行的计算任务,这种"长痛不如短痛"的交换都是极其划算的。

-

cudaEventSynchronize的反常即正常:- 一个健康的异步程序,其最后的同步点(如

cudaEventSynchronize或cudaDeviceSynchronize)应该会消耗显著的时间。 - 这恰恰说明CPU和GPU在之前的时间里是并行工作的,CPU提前到达了终点线,需要停下来等待还在赛道上奔跑的GPU。

- 反之,如果这个同步点耗时很短,往往说明CPU被其他事情拖慢了,和GPU"同时"到达终点,这意味着并行度不高。

- 一个健康的异步程序,其最后的同步点(如

最终结论 :

这两份报告的对比,从数据层面完美地、无可辩驳地展示了锁页内存是开启CUDA并发流水线的"钥匙" 。没有它,cudaMemcpyAsync 这扇通往并发的大门虽然名字叫"异步",但实际上是被锁死的。使用了它,大门才能真正敞开,让数据和计算在硬件上自由地并行流动。

你观察到的这个现象------cudaEventSynchronize 在高性能的锁页内存版本中反而"变慢了"------非常反直觉,但它恰恰是程序并发性提高的直接证据,是一个非常好的信号!

让我们来彻底搞清楚这背后的逻辑。

cudaEventSynchronize(stop_event) 的作用

这个函数的作用是:阻塞CPU线程,直到stop_event这个事件在GPU上被记录(即GPU执行到cudaEventRecord(stop_event, ...)那一行)为止。

在我们的代码中,stop_event 被放在了所有流水线任务的最后 。所以,cudaEventSynchronize(stop_event) 的含义就是:"CPU,停下来,等到GPU把所有我们交给它的活儿都干完再继续。"

两种情况下的时间线分析

我们来画一个简化的时间线图,对比CPU和GPU在两种情况下的行为。

情况A: 可分页内存 (Pageable Memory) - 低性能版

在这个版本中,cudaMemcpyAsync 是一个阻塞API。

CPU Timeline:

|--H2D_0(阻塞)--| |K_0| |--D2H_0(阻塞)--| |H2D_1(阻塞)| ... |D2H_15(阻塞)| |sync|

^ ^ ^ ^ ^

| | | | CPU 被卡住,无法提前提交后续任务

| | | CPU提交内核后立即返回

| CPU被卡住,等待内部拷贝

GPU Timeline:

|--(H2D_0)--|--(K_0)--|--(D2H_0)--|--(H2D_1)--| ... |--(D2H_15)--|--[stop_event]

^ ^

| |

GPU 严格串行执行 GPU 完成所有工作分析:

- CPU在每次调用

cudaMemcpyAsync时都被长时间阻塞。它提交任务的节奏非常慢,基本上是"等GPU做完一件事,我再提交下一件"。 - 当CPU最终执行到

cudaEventSynchronize(stop_event)时,GPU也差不多同时完成了最后一个任务D2H_15并记录了stop_event。 - 结果 : CPU几乎不需要等待。它和GPU是"手牵手、肩并肩"地走到终点的。所以

cudaEventSynchronize的耗时非常短(你报告中的5.4 µs),但这恰恰是因为全程没有并行!

情况B: 锁页内存 (Pinned Memory) - 高性能版

在这个版本中,cudaMemcpyAsync 是一个真正的异步API。

CPU Timeline:

|H|K|D|H|K|D|...|H|K|D| |--cudaEventSynchronize(等待22.59ms)--|

^ ^

| |

| CPU在极短时间内(几百µs)提交完所有16*3=48个任务,然后到达同步点

GPU Timeline:

|--H2D_0--|--H2D_1--|--H2D_2--| ...

|--K_0---|--K_1---|--K_2---| ...

|--D2H_0--|--D2H_1--|--D2H_2--| ... |--[stop_event]

<----------------- 并发重叠区域 -----------------> ^

|

GPU 完成所有工作分析:

- CPU像机关枪一样,在极短的时间内(几百微秒)就把所有48个任务(16个H2D,16个Kernel,16个D2H)全部提交给了GPU的不同流。

- 提交完所有任务后,CPU立刻就到达了

cudaEventSynchronize(stop_event)这一行。 - 但是,此时GPU还在热火朝天地处理我们刚刚"扔"给它的一大堆任务。流水线正在全速运转。

- CPU只能在这里**"干等着"**。它在等待GPU完成整个漫长的流水线作业。

- 结果 :

cudaEventSynchronize的耗时(你报告中的22.59 ms)正好就是CPU提前完成任务后,等待GPU追赶上来的时间。

结论:为什么"变慢"是好事?

cudaEventSynchronize的耗时,可以近似地看作是 "CPU的空闲等待时间"。- 耗时长,说明CPU效率高 。它很早就完成了自己的任务(分发指令),所以有大把的时间可以"休息",等待慢一点的GPU。这正是CPU和GPU成功并行的体现。

- 耗时短,说明CPU效率低(或者说被阻塞了) 。它被其他事情(比如伪异步的

cudaMemcpyAsync)拖慢了脚步,导致它和GPU同时完成工作,没有享受到并行的好处。

一个生动的比喻:

想象一个厨师(CPU)和一个自动烤箱(GPU)合作。

- 情况A (Pageable) : 厨师每准备一个菜,就要亲手把它放进烤箱,并站在原地等到烤箱的预热灯亮了才能离开。他准备下一个菜的速度被烤箱的预热拖慢了。最后当所有菜都烤完时,厨师也刚好准备完最后一个菜的后续工作。他几乎不需要"等"烤箱。

- 情况B (Pinned) : 厨师有一个助手。他飞快地把16个菜全部准备好,交给助手,让助手按顺序放进烤箱。厨师在1分钟内就完成了所有准备工作,然后坐在椅子上等了22分钟,直到最后一个菜从烤箱里出来。虽然他"等待"的时间很长,但整个做菜的总时间大大缩短了,因为准备和烘烤是并行进行的。

所以,cudaEventSynchronize 变慢了,正说明你的程序从一个"愚笨"的串行模式,进化成了一个"聪明"的并行流水线模式。你应该为这个"变慢"感到高兴!

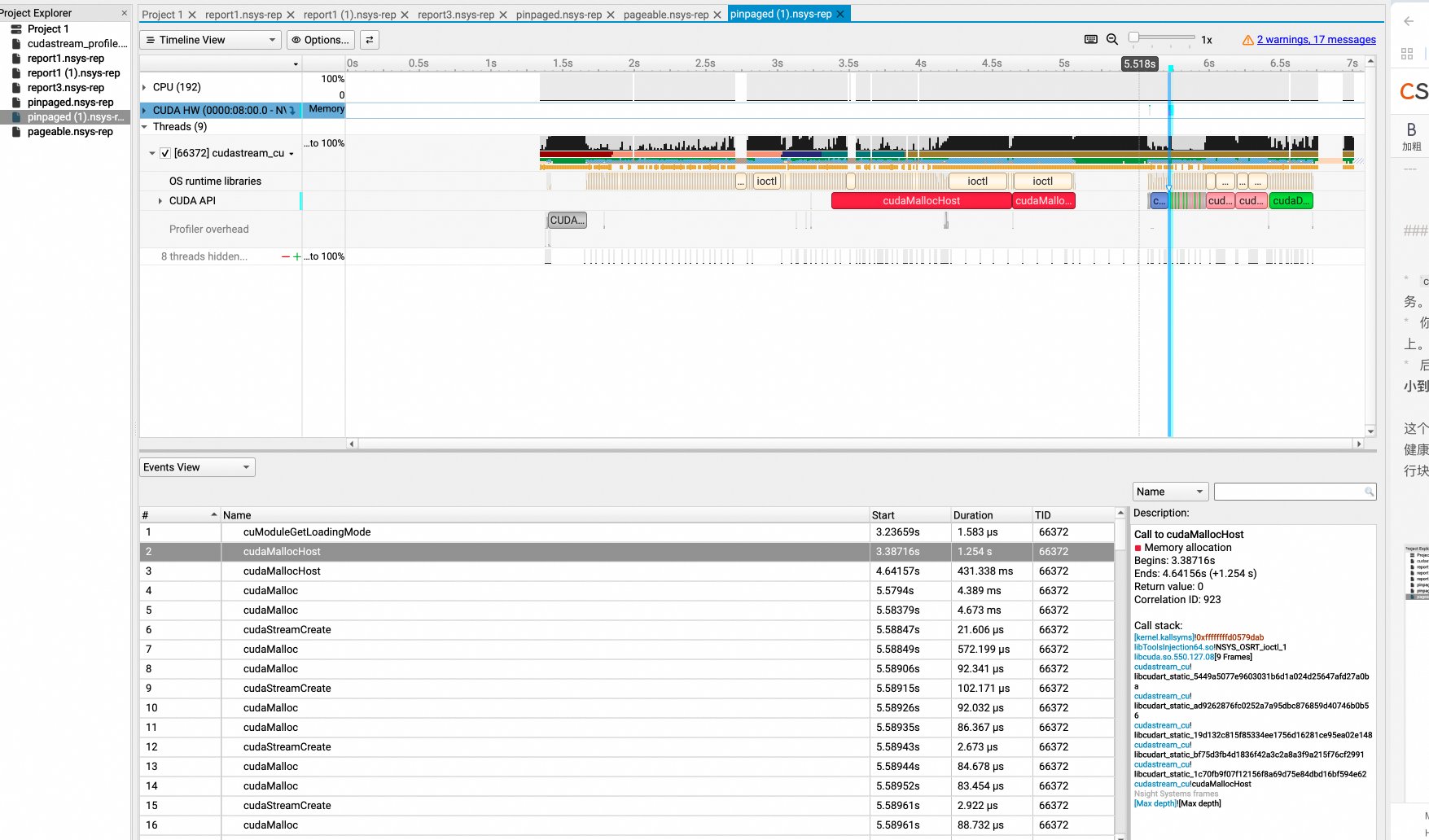

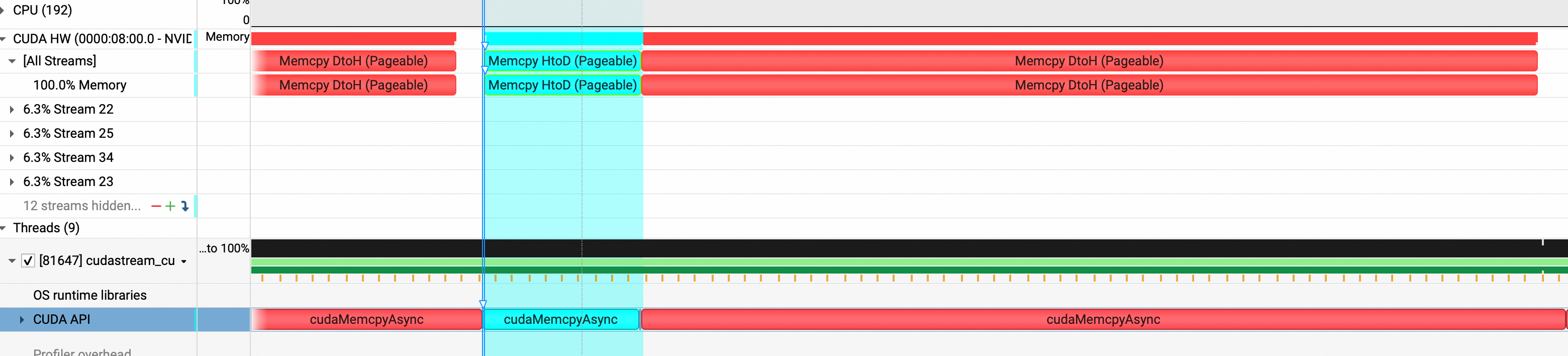

上面是paged 为啥 H TO D时间更少并且 CUDA API 和 CUDA 执行好像是同步的, 为什么

你观察得非常仔细,这张nsys的时间线视图(Timeline View)确实展示了使用可分页内存(Pageable Memory)时一些非常反直觉但又极其重要的行为。你的问题可以分解为三个部分,我们来一一解答。

这张图是证明可分页内存破坏并发的最直观、最无可辩驳的证据。

问题 1: 为啥 H to D 时间更少?

在时间线上,你看到青色的 Memcpy HtoD (Pageable) 条块比红色的 Memcpy DtoH (Pageable) 条块要短得多。这与我们之前在 cuda_gpu_mem_time_sum 报告中看到的数据是一致的:

- H2D (上传) 平均耗时: 6.8 ms

- D2H (下载) 平均耗时: 39.5 ms

为什么上传比下载快这么多?

这通常与操作系统和CUDA驱动如何处理DMA(直接内存访问)有关。

-

H2D (上传) 路径相对直接: 当数据从主机上传到设备时,即使是可分页内存,驱动也可以通过一些机制(比如刚才提到的内部锁页暂存区)相对高效地将数据"推"给GPU。GPU DMA引擎从一个准备好的、连续的源地址读取数据。

-

DtoH (下载) 路径更复杂 : 当数据从设备下载到可分页的主机内存时,情况变得复杂得多。

- 内存不确定性 : GPU的DMA引擎准备将数据写入主机内存,但目标地址

h_pageable_data对应的物理内存页可能分散在RAM的各个角落,甚至可能被换出到硬盘。 - 需要CPU/OS深度介入 : GPU的DMA引擎不能直接"打散"数据写入到不连续的物理页。通常,数据还是先被拷贝到一个驱动控制的锁页暂存区 。然后,需要CPU 执行一次

memcpy,将数据从这个暂存区拷贝到你最终指定的可分页内存地址。这个过程需要操作系统进行大量的协调,以确保数据被正确地写入,不会覆盖其他内容。 - 写操作的复杂性: 普遍来说,内存写操作比读操作涉及更多的一致性和缓存管理,尤其是在需要跨越PCIe总线与CPU内存系统交互时。

- 内存不确定性 : GPU的DMA引擎准备将数据写入主机内存,但目标地址

结论: 将数据从GPU写入一个"不确定"的可分页主机内存,比从一个(经过驱动暂存的)主机内存读取数据到GPU,所涉及的软件开销和协调成本要高得多。这导致了你在时间线上看到的巨大差异。

问题 2: CUDA API 和 CUDA 执行好像是同步的,为什么?

你的观察完全正确!这就是问题的核心。让我们来看图中的两个关键行:

-

CUDA HW ... Memory行 : 这代表GPU硬件上实际发生的数据拷贝。- 我们看到一个青色的

Memcpy HtoD (Pageable)块。

- 我们看到一个青色的

-

CUDA API行 : 这代表你的CPU线程调用CUDA API函数所花费的时间。- 我们看到一个与上方硬件执行块在时间上几乎完全重叠 的青色

cudaMemcpyAsync块。

- 我们看到一个与上方硬件执行块在时间上几乎完全重叠 的青色

"同步"的视觉证据:

cudaMemcpyAsyncAPI调用的开始时间 与硬件Memcpy HtoD的开始时间几乎对齐。cudaMemcpyAsyncAPI调用的结束时间 与硬件Memcpy HtoD的结束时间也几乎对齐。

为什么会这样?

这正是我们反复强调的"伪异步"行为的直观体现:

- CPU线程调用

cudaMemcpyAsync。 - CUDA驱动发现是可分页内存,它不能立即返回。

- 驱动在内部创建锁页暂存区,并阻塞CPU 来执行一次CPU端的内存拷贝 。这个CPU拷贝的时间,构成了

cudaMemcpyAsyncAPI调用时间的主要部分。 - 在CPU拷贝进行的同时或之后,驱动命令GPU的硬件拷贝引擎开始工作(从暂存区拷贝到设备)。

- 只有当整个过程(包括内部CPU拷贝和GPU拷贝的发起) 都处理得差不多时,

cudaMemcpyAsyncAPI调用才会返回。

结果 : API调用的时长(CPU被阻塞的时间)和硬件执行的时长紧密地绑定在了一起,看起来就像一个同步操作。Async 的名字在这里失去了意义。

问题 3: 为什么这会破坏并发?

现在看整张图的宏观景象:

- 一个

DtoH(红色) 结束。 - 紧接着一个

HtoD(青色) 开始。 - 紧接着又一个

DtoH(红色) 开始。

这些拷贝操作一个接一个地排列 ,像一串糖葫芦,没有任何重叠。流水线完全断裂了。

原因 :

因为CPU在调用 cudaMemcpyAsync 时被长时间阻塞,它无法提前去提交后续流中的内核计算或其他拷贝任务。例如,当CPU被第一个H2D拷贝卡住时,它根本没机会去提交第二个流的H2D拷贝,更别提内核了。它必须等第一个拷贝的API调用返回后,才能继续提交下一个。

最终,这种API级别的阻塞行为,强制所有的GPU操作都退化成了串行执行,彻底摧毁了我们希望通过多流实现的并发。

如果你现在去看锁页内存版本的时间线视图,你会看到一幅截然不同的、美妙的景象:

CUDA API行上所有的cudaMemcpyAsync都会变成非常非常窄的、几乎看不见的细条。CUDA HW行上,不同流的HtoD、Kernel和DtoH会像俄罗斯方块一样,在时间上相互交错、重叠在一起。

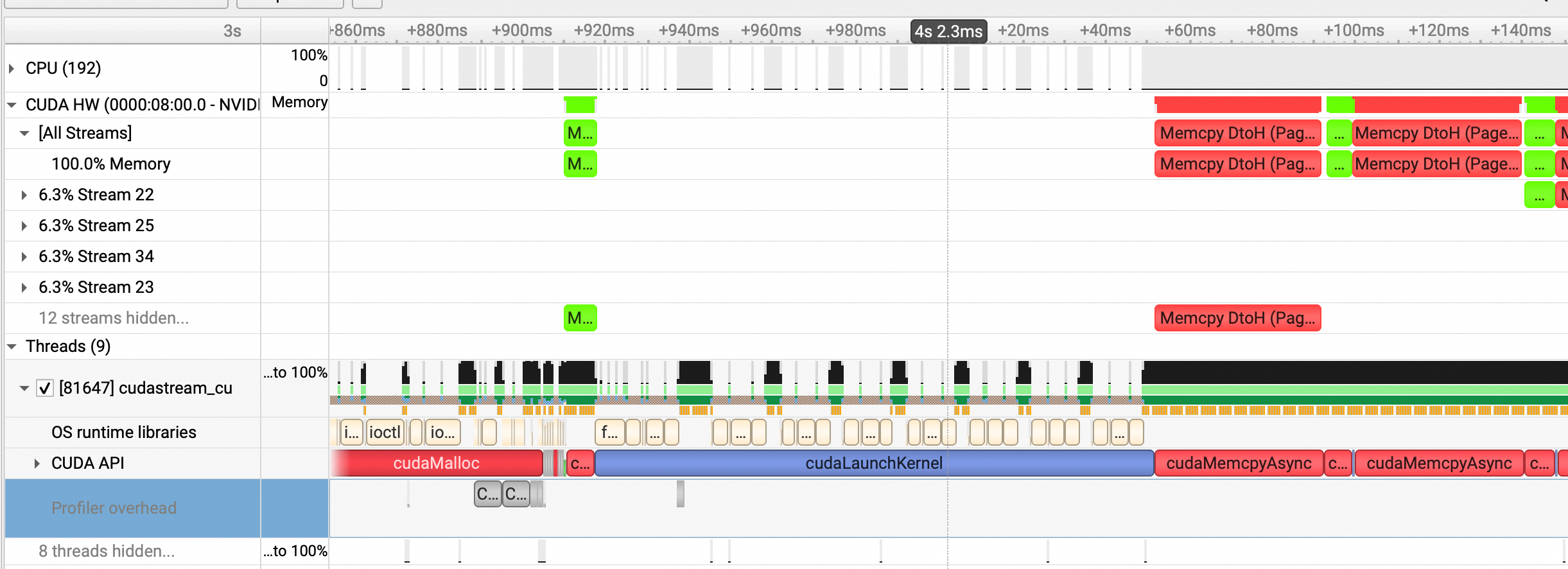

你又一次捕捉到了一个非常关键且有趣的性能现象!这个问题揭示了CUDA程序的"冷启动"和"热运行"之间的差异。

答案的核心是:第一次CUDA操作(无论是内核启动还是内存拷贝)会触发一次性的、非常耗时的CUDA上下文初始化(Context Initialization)。后续的操作则可以在已经"预热"好的上下文中快速执行。

我们来详细分解这个过程,结合你的两张图进行分析。

图一 (时间尺度较大,从 3.5s 到 4.4s)

这张图展示了程序的宏观行为。

-

cudaMalloc: 你可以看到一个巨大的cudaMallocAPI调用块,它持续了很长时间。这通常是程序中较早的CUDA API调用之一。 -

cudaLaunchKernel: 在cudaMalloc之后,有一个同样非常长的cudaLaunchKernelAPI调用块。这就是你问题的关键点。 -

第一个绿色

HtoD块 : 在长长的cudaLaunchKernel之后,我们才看到第一个GPU硬件操作(绿色的Memcpy HtoD)开始执行。 -

HtoD和DtoH之间巨大的间距 : 在第一个绿色的HtoD块和第一个红色的DtoH块之间,有非常长的一段空白时间。

为什么会这样?------ CUDA上下文的"懒加载" (Lazy Loading)

-

什么是CUDA上下文?

- 可以把它想象成GPU为一个特定进程(你的程序)创建的一个"工作环境"或"沙盒"。

- 这个环境包含了GPU的状态信息、已加载的模块、已分配的内存等所有必要的数据结构。

- 任何CUDA操作(内核、拷贝等)都必须在一个已经激活的上下文中执行。

-

懒加载机制:

- 为了加快程序的启动速度,CUDA驱动并不会在你程序一开始运行时就创建这个重量级的上下文。

- 它会等到你第一次调用某个需要与GPU深度交互的API时 ,才去执行这个初始化过程。这些API通常是第一个内核启动 (

cudaLaunchKernel) 或第一个内存分配 (cudaMalloc) 等。

-

初始化过程做了什么?

- 与GPU设备建立连接。

- 在GPU上分配和初始化驱动所需的内部数据结构。

- 验证并设置设备状态。

- 加载CUDA运行时库到GPU上。

- ...等等。

- 这是一个非常耗时的过程,可能需要几十到几百毫秒。

结合图一分析 :

你的图清楚地显示,在第一个 cudaLaunchKernel API调用期间,发生了这次上下文初始化。CPU线程被卡在 cudaLaunchKernel 这个API调用里,等待整个初始化完成。在这几百毫秒的时间里,CPU无法提交任何新的任务,GPU硬件也处于等待状态。这就是你看到的第一个绿色 HtoD 之前 和**HtoD 与 DtoH 之间**巨大空白的来源。

图二 (时间尺度放大,从 4s 左右开始)

这张图放大了"热运行"阶段。

- 操作紧密排列 : 你可以看到,从某个时间点开始,红色的

DtoH和后续的绿色HtoD(虽然图中没显示,但可以推断)开始变得紧密相邻。 - API调用变短 : 在

CUDA API行,cudaMemcpyAsync的调用块虽然仍然很长(因为是可分页内存),但它们之间几乎没有了之前那种巨大的空闲间隙。

为什么后续的操作就挨着了?

- 上下文已创建: 经过了第一次的"阵痛",CUDA上下文已经完全建立并处于激活状态。

- "热"运行状态 : 所有的后续CUDA API调用(无论是

cudaLaunchKernel还是cudaMemcpyAsync)现在都可以在一个已经准备好的环境中执行。它们不再需要等待初始化,只需要将任务描述符提交给驱动即可。 - 瓶颈回归 : 此时,程序的瓶颈回归到我们之前分析的、由可分页内存引起的API阻塞 。CPU的执行流程变成了:

等待伪异步Memcpy -> 提交内核 -> 等待伪异步Memcpy -> ...。虽然这个流程是串行的、低效的,但它至少是连续的,没有了上下文初始化带来的额外巨大延迟。

总结

用一个比喻来解释:

-

第一次操作 (冷启动) : 就好像你第一次开一家餐厅。你需要装修店铺、购买厨具、招聘员工、申请执照... 这个"开业筹备"(上下文初始化)过程非常漫长。在筹备完成前,你无法炒第一个菜。

-

后续操作 (热运行) : 餐厅开业后,所有设施都已就位。现在你只需要不断地接单、炒菜、上菜即可。虽然你可能因为某些原因(比如只有一个厨师,对应可分页内存的串行瓶颈)上菜速度不快,但整个流程是连续运作的,不会再有"停业装修"的巨大中断。

结论 :

你观察到的"第一个间距很大,后续挨着"的现象,完美地展示了 CUDA上下文初始化(一次性开销) 和 程序稳态运行(持续瓶颈) 之间的区别。这是所有CUDA程序都会有的行为,也是进行性能分析时需要特别注意区分的阶段。为了得到准确的性能数据,我们通常会忽略第一次迭代(或进行一次"预热"运行),从第二次迭代开始计时。

cudaLaunchKernel 谁执行的? 为啥后面cuda API 没有 cudaLaunchKernel 了?你提了两个非常好的问题,这能帮助我们更深入地理解这张时间线图的细节。

问题1: cudaLaunchKernel 谁执行的?

答案:cudaLaunchKernel 是由 CPU 线程执行的。

我们来澄清一下角色分工:

-

CUDA API行:- 这一行显示的是你的CPU线程在执行CUDA API函数时所花费的时间。

- 当你看到一个

cudaLaunchKernel的色块时,它的意思是:你的CPU线程进入了cudaLaunchKernel这个函数的内部,正在执行向CUDA驱动提交内核任务的逻辑。 - 这个色块的时长,代表CPU被这个API调用"占用"或"阻塞"的时间。

-

CUDA HW(硬件) 行:- 这一行才代表GPU硬件实际在做什么。

- 内核的真正执行 会以一个单独的色块出现在

CUDA HW的某个SM(计算单元)行上(这张图里可能被折叠或未显示)。 cudaLaunchKernel这个API调用本身,只是一个"发号施令"的动作,是由CPU完成的。

所以,流程是:

- CPU线程执行

cudaLaunchKernelAPI调用 (在CUDA API行上显示一个色块)。 - 在这个API调用内部,CPU准备好内核参数,并通过驱动程序将内核任务发送给GPU。

cudaLaunchKernelAPI调用返回,CPU线程继续执行下一行代码 (API色块结束)。- GPU接收到任务后,在某个时刻开始真正执行 内核代码 (在

CUDA HW行上显示一个内核执行块)。

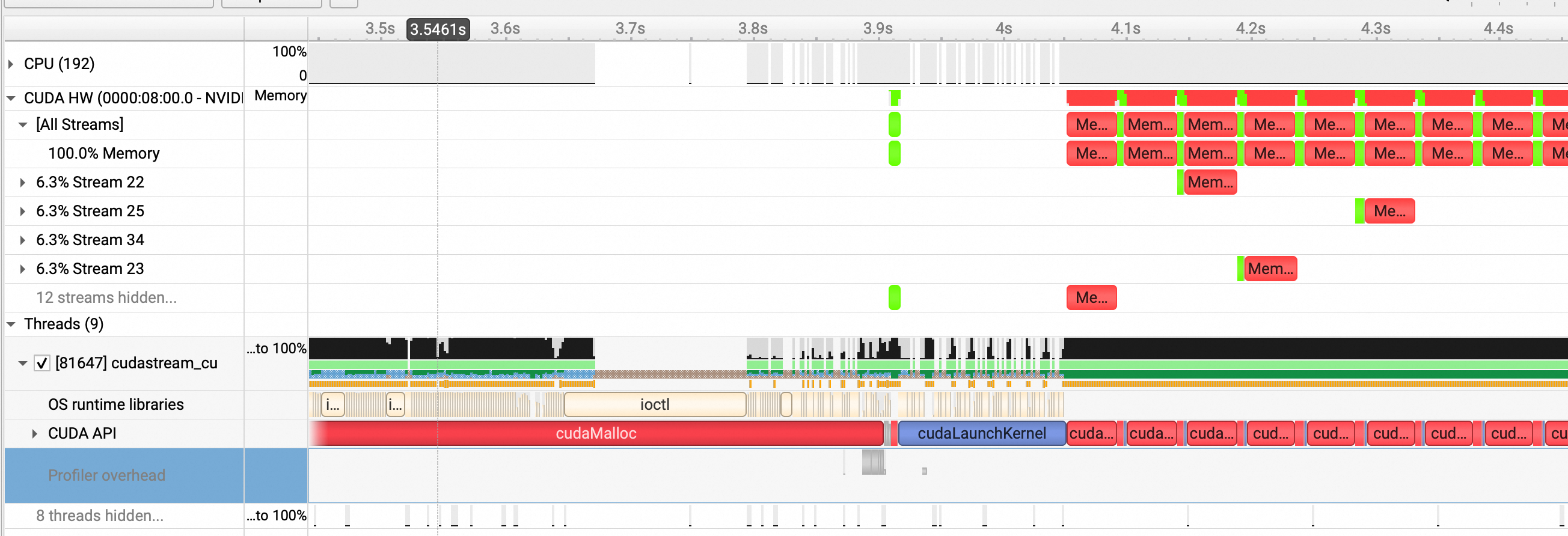

问题2: 为啥后面 CUDA API 行没有 cudaLaunchKernel 了?

这是一个非常敏锐的观察!你在 CUDA API 行看到了一个巨大的 cudaLaunchKernel 块,但后面连续的 cudaMemcpyAsync 块之间,似乎没有再出现 cudaLaunchKernel 的块了。

这通常有两个可能的原因,其中一个可能性更大:

可能性1 (最可能): 内核启动API调用非常快,在当前缩放级别下看不见

- 上下文初始化 : 正如我们刚才讨论的,你看到的那个巨大的

cudaLaunchKernel块 ,它的时长主要由第一次的CUDA上下文初始化贡献。它是一个一次性的、非常耗时的操作。 - 后续的内核启动 : 一旦上下文被初始化,后续的

cudaLaunchKernelAPI调用就会变得极其快速。通常只需要几微秒(µs)就能完成。 - 视觉上的"消失" :

- 在这张时间线图的当前缩放级别下,一个几微秒宽的色块会非常非常窄,窄到几乎就是一个像素点,甚至完全看不见。

- 它被旁边那些动辄几毫秒、几十毫秒的

cudaMemcpyAsync(可分页内存版)的巨大色块给"淹没"了。 nsys的UI为了清晰,可能会在缩放级别不够高时,自动隐藏掉这些过小的色块。

验证方法 :

如果你将时间线极度放大 ,放大到微秒级别,你应该能在两个 cudaMemcpyAsync 块之间找到一个非常非常窄的 cudaLaunchKernel 色块。

可能性2 (不太可能,但理论上存在): 代码逻辑问题

- 另一种极小的可能性是,你的代码在那个

for循环中,由于某种逻辑错误,只在第一次迭代时调用了cudaLaunchKernel,而后续迭代跳过了。 - 根据我们之前看的代码,

for循环里每次迭代都会调用H2D -> Kernel -> D2H,所以这个可能性基本可以排除。

总结

cudaLaunchKernel是一个由 CPU 执行的API调用,它的作用是向GPU提交一个内核执行任务。- 你看到的那个巨大的

cudaLaunchKernel块,其时间主要花在了一次性的CUDA上下文初始化上。 - 后续的

cudaLaunchKernelAPI调用变得非常快(微秒级),所以在当前的毫秒级时间尺度上,它们小到看不见 ,被旁边巨大的cudaMemcpyAsync块完全掩盖了。这造成了它们"消失"的假象。

这个观察再次印证了区分一次性启动开销 和稳态运行性能的重要性。在稳态运行时,对于一个健康的异步程序,所有CUDA API的调用都应该是极快的,时间线上的主要部分应该被GPU硬件的执行块所占据。

使用pin page 计算很快,只有一条浅蓝色的线(memasys cpy)