作者: Tao Wang, Chenyu Lin, Chenwei Tang, Jizhe Zhou, Deng Xiong, Jianan Li, Jian Zhao, Jiancheng Lv

亮点

- 自适应空间变换: 对图像进行自适应空间变换可以有效地放大物体细节。

- 框变换: 框变换使得检测器能够在图像变换的空间中进行训练和推理。

- 实验效果: 在多种无人机图像数据集上的实验表明,该方法以较小的代价获得了有效的增益。

- 灵活模块化设计: 灵活的模块化设计使其能够与其他方法和任务场景集成。

https://arxiv.org/pdf/2602.07512

摘要

由于物体尺寸较小,从无人机(UAV)拍摄的图像中检测物体具有挑战性。在这项工作中,我们探索了一种简单高效的自适应变焦框架,用于无人机图像的目标检测。主要动机是,前景物体通常比普通场景图像中的物体更小且更稀疏,这阻碍了有效目标检测器的优化。因此,我们的目标是自适应地放大物体,以便更好地捕捉用于检测任务的物体特征。为了实现这一目标,需要两个核心设计:i) 如何高效地对每张图像进行非均匀变焦?ii) 如何在变焦后的图像空间中实现目标检测的训练和推理?相应地,我们引入了一种轻量级的偏移预测方案,结合一种新颖的基于框的变焦目标函数,以学习输入图像上的非均匀变焦。基于学习到的变焦变换,我们提出了一种角点对齐的边界框变换方法。该方法将真实边界框(ground-truth bounding boxes)扭曲到变焦空间以学习目标检测,并在推理过程中将预测的边界框扭曲回原始空间。我们在三个具有代表性的无人机目标检测数据集(VisDrone、UAVDT 和 SeaDronesSee)上进行了广泛的实验。提出的 ZoomDet 与架构无关,可应用于任意目标检测架构。值得注意的是,在 SeaDronesSee 数据集上,ZoomDet 为 Faster R-CNN 模型带来了超过 8.48.48.4 的 mAP 绝对增益,而仅增加了约 333 ms 的延迟。代码地址:https://github.com/twangnh/zoomdet_code。

关键词: 图像处理,目标检测,无人机目标检测,光学遥感,自适应图像变换

1. 引言

无人机(UAV)拍摄图像的目标检测 [1, 2, 3] 一直是一个活跃的研究课题,因其在许多遥感应用中发挥着重要作用,例如无人机辅助的环境监测和灾害响应系统。受深度卷积神经网络(CNNs)发展的推动,近年来无人机目标检测取得了显著进展 [2, 4, 5, 6, 7, 8]。由于高观测姿态和不规则的观测角度 [2],无人机图像中的许多物体尺寸小、分布不均匀且稀疏,因此如何有效检测这些物体是一个主要的研究课题。

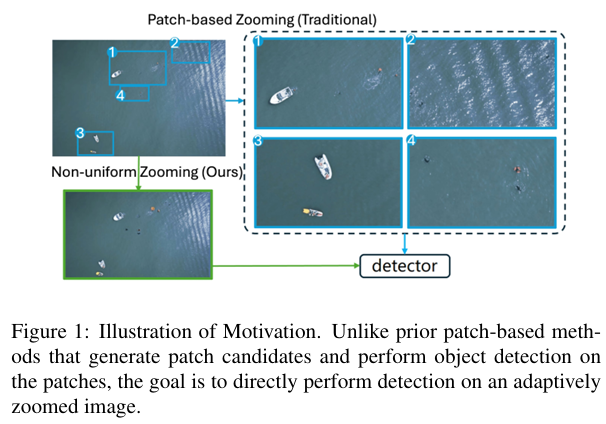

当前的最先进(SOTA)方法通过将图像均匀裁剪成图块(patches),并对每个图块独立应用检测来处理图像 [9, 10, 11, 12, 6, 2]。这些基于图块的方法提供了稳定且显著的检测精度增益。然而,它们仅有助于解决跨图块的分布方差问题,而图像图块内仍可能存在小型或稀疏的物体。此外,由于其复杂的流程和多次前向传播,基于图块的方法引入了显著的额外计算成本和延迟,这对于运行在无人机上的边缘计算设备来说是昂贵的。

受先前工作 [13] 的启发,该工作学习非均匀图像变焦以放大重要细节,从而获得改进的图像分类性能,我们旨在开发一个非均匀变焦框架,自适应地放大图像内的物体区域以改善检测优化,同时通过仅处理单张图像来保持效率。图 1 展示了这种用于无人机目标检测的非均匀变焦的总体思路。该框架的核心设计是图像变换,它将输出图像空间中的离散像素坐标映射到原始图像空间。这样的框架不仅直观,而且与基于图块的方法正交,可以结合使用以达到最佳性能。

然而,在设计用于目标检测的自适应变焦框架时,发现了两个独特的挑战:

- 基于显著性(saliency-based)的方法 [13] 通过图像显著性和预定义的高斯距离核 [13] 加权的相邻坐标平均值来计算坐标映射。这种公式不仅复杂且需要调整高斯核,而且由于显著性预测的尖峰特性,可能会导致物体及其周围上下文发生严重失真。

- 虽然物体被放大了,但图像变换会导致真实边界框(ground-truth bounding boxes)错位,从而阻碍了使用变焦图像进行检测器的训练和推理。

为了解决上述局限性并设计一个有效的变焦框架,我们引入了一种简单的基于偏移量(offset-based)的物体变焦,结合角点对齐的前向和后向边界框变换。

具体而言,使用一个轻量级的偏移量预测器来回归空间偏移量,这些偏移量改变原始的均匀网格坐标,可用于实例化图像变换的坐标映射。这部分灵感来源于可变形卷积(deformable convolution),后者预测空间偏移量以应用卷积操作 [14, 15];在这里,预测偏移量是为了应用图像变换操作。为了学习偏移量预测,我们开发了一种新颖的基于框的变焦目标函数,通过最大化变焦边界框面积与原始面积的比率来学习物体放大。与先前工作 [13] 中基于显著性的设计不同,该方法放大了边界框下的区域,从而有助于保护物体及其附近的上下文免受极端失真。

通过上述偏移量预测,输入图像现在可以自适应地变焦以聚焦于物体,但由于空间变换,原始的真实边界框标注不再有效。将边界框精确变换到变焦空间需要坐标映射的精确逆运算,这很困难。相反,我们开发了一种近似的框变换方案。具体而言,利用两个角点作为边界框的表示,并在变焦图像空间中找到它们最近的映射坐标,以获得变换后的边界框。这是通过将上述偏移变焦过程中计算的前向映射视为查找表,并在逆表上执行最近邻搜索来实现的。在推理过程中,预测的边界框同样被变换回原始图像空间进行评估。经验验证表明,这种变换引入的误差很小。这是通过计算原始边界框与先向前变换到变焦空间再向后变换回原始空间的边界框之间的 IoU(交并比)来进行的。

提出的图像变焦和框变换被集成到一个高效的"变焦并检测"框架中,命名为 ZoomDet 。为了验证该框架,我们在三个代表性的城市和海洋场景无人机目标检测数据集上进行了彻底的实验:VisDrone [4]、UAVDT [16] 和 SeaDroneSee [17]。对于检测架构,验证了两阶段 Faster R-CNN 检测器 [18] 和流行的单阶段 YOLOv8 检测器 [19]。ZoomDet 为基线检测器带来了显著的增益,且额外延迟极小。例如,配备 ZoomDet 的 Faster R-CNN 模型在 SeadroneSee 数据集上获得了惊人的 8.48.48.4 mAP 提升,而推理时间仅增加了 222ms。在类似的延迟开销下,ZoomDet 在 VisDrone 和 UAVDT 数据集上引入了约 2.02.02.0 的 mAP 提升。此外,ZoomDet 显示出与其他用于无人机目标检测的 SOTA 基于变焦的方法(例如基于图块的变焦和隐式变焦方法)的正交改进,在小物体上进一步提升了超过 1.01.01.0 AP。此外,我们展示了定性示例,表明变焦图像有助于改进大型空中视觉 - 语言模型 [20],这表明所提出的变焦机制在更高级的空中图像理解场景中具有进一步开发的潜力。

贡献总结如下:

- 深入分析了在无人机图像上设计基于非均匀变焦的目标检测框架的背景和挑战,揭示了坐标映射公式以及原始图像空间与变焦图像空间之间边界框变换的主要困难。

- 引入了一种由新颖的物体变焦目标函数监督的直接偏移量预测机制,将偏移量与物体放大联系起来,并学习自适应且准确的物体变焦。基于学习到的非均匀变焦,开发了一种角点对齐的边界框变换,以实现在变焦空间中灵活地进行检测器训练和推理。

- 首次展示了非均匀图像采样方法可应用于具有挑战性的无人机目标检测领域,在各种基准数据集和基线上带来了显著的性能增益,同时在参数、计算和延迟方面仅需极小的额外成本。

- 提出的"变焦并检测"框架显示出良好的通用性和可扩展性。它与各种检测架构(Faster R-CNN, YOLO)兼容。此外,它可以与其他变焦方法(如基于图块的方法和特征级增强)结合以获得进一步的增益。此外,它可以扩展到大型空中视觉 - 语言模型上的视觉问答任务,表明其潜力超越了纯检测任务。

2. 相关工作

2.1. 目标检测及其在无人机图像上的发展

目标检测是计算机视觉领域的一项基本任务。基于深度学习框架 [21] 的发展和 GPU 计算设备的迭代,深度卷积神经网络 [22] 极大地革新了目标检测任务。随着两阶段 Faster R-CNN 系列 [18, 23, 24] 的开创性模型出现,后续工作主要集中在两个方向:单阶段模型和多阶段级联模型。代表性的单阶段模型主要是 YOLO 系列 [25, ..., 32] 和 SSD 系列 [33, ..., 36]。在单阶段范式下,研究社区还探索了其他架构变体,如无锚框(anchor-free)框架 [37, 38, 39, 40],其中物体边界框直接从特征回归,无需先验边界框的帮助。检测模型发展的另一个分支是多阶段级联架构 [41, 42],它通过级联多阶段预测头来追求准确的边界框回归。与传统的一阶段和多阶段模型不同,近年来研究人员开发了一种基于 Transformer 网络的全端到端目标检测架构。基于 Transformer 的模型 [43, ..., 47] 不需要像传统模型那样的后处理,并展示了 SOTA 性能。

里程碑式的模型主要是使用通用目标检测数据集(如 COCO [48])开发的。受益于这一发展,许多先前的工作 [2, 49] 将里程碑模型迁移到无人机图像并取得了良好的性能。然而,无人机图像主要是在空中视角下拍摄的,因此域差距很大,例如汽车要小得多,外观也与自然图像不同。因此,无人机目标检测的研究工作主要集中在利用特定领域的设计来改进里程碑模型。例如,大量工作专注于基于图块的设计以改进大分辨率图像 [2, 10, ..., 52]。除了提高标准边界框检测精度外,一些工作还研究如何预测旋转边界框以更好地适应空中物体 [53, 54, 55]。与那些以模型为中心的设计不同,其他工作开发了针对数据分布变化 [56, 57]、应用领域数据 [58, ..., 60] 和模型学习效率 [61, ..., 63] 的鲁棒方法。这项工作受到空中物体尺寸和空间分布挑战的启发,专注于开发一种通用的非均匀图像采样方法以提高无人机目标检测的准确性。

2.2. 基于非均匀变焦的识别与检测方法

自适应图像扭曲(变换)首先在开创性的空间变换网络(Spatial Transformer Networks)[64] 中被探索,其中他们预测仿射变换参数来变换输入图像。后来的工作 [13] 探索了基于显著性的像素网格拉动公式来预测采样网格;这种公式有助于放大局部区域,并被证明能为细粒度图像分类和视线估计等识别任务提供高性能提升。一些后续工作尝试将基于显著性的采样 [13] 扩展到目标检测 [65, 66]。主要区别有三点:

-

- 由于计算逆变换的困难,它们要么通过将边界框映射回原始空间,要么通过将图像特征映射回原始空间,在原始图像空间中进行优化,这阻碍了在变焦图像空间中学习更准确的检测。

-

- 它们采用了图像变换的基于显著性的参数化 [13],这很繁琐并导致物体和周围上下文的严重失真。

-

- 它们只关注普通场景图像,而本研究研究了具有挑战性的无人机图像领域,其中物体通常小得多且在图像空间中随机分布(参见补充材料中的数据分布分析)。因此,对于变焦物体的学习信号被削弱且间接。本工作与这些工作相关,但研究了简单的基于偏移量的变换以及边界框变换,以便在变焦图像空间中进行训练和推理。

2.3. 基于均匀变焦的识别与检测方法

除了显式执行非均匀图像变焦以放大感兴趣物体的非均匀变焦方法外,其他工作在不同层面上探索了均匀变焦,包括全图、图块或特征,即它们保持输入图像的原始均匀网格结构并对物体进行全局增强。这些近期工作可分为基于图块的变焦 [49, ..., 69]、均匀变焦 [70, ..., 74] 和隐式特征变焦 [75, ..., 80]。

- 基于图块的变焦: 从输入图像生成图像图块,然后在均匀放大的图块上进行目标检测,以帮助更好地检测较小的物体。最终的检测结果通常是通过组合裁剪上的检测结果获得的 [69, 67]。

- 均匀图像变焦: 输入图像被超分辨率化为新版本,具有更清晰的细节或重建缺失的信息。新的变焦图像随后被送入目标检测模型。最近的方法使用任务驱动的感知损失训练超分辨率网络 [72]。此外,一些工作将其扩展到特征级别,通过建立特征到图像的重建管道 [74] 或特征到特征的重建 [70]。

- 隐式特征变焦: 这类方法不在图像上变焦,而是通过融合多尺度特征信息来模仿人类视觉变焦,例如,"学习变焦"[75] 提出了一种全局上下文聚合和局部特征增强方案,以改善小物体特征响应。类似地,其他工作开发了尺度内细节特征增强模块和跨尺度特征融合,以合并多尺度信息并放大小物体信号 [79, 80, 78, 77]。

2.4. 边界框变换

上述图像变焦变换非常多样且复杂,这是由图像内容的固有丰富性驱动的。相比之下,边界框表示更简单,只有几个坐标。因此,涉及边界框的变换主要集中在调整坐标表示 [81, 41]。例如,Faster R-CNN 通过学习偏移回归网络将初始粗略的边界框提议转换为最终检测框 [81]。后来,几位研究人员将变换扩展到多阶段,提出了级联检测架构 [41, 42],或用强化学习增强 [82]。除了常规边界框外,一些工作在定向框检测场景中建立了边界框变换方案 [83, 84, 85]。Kim 等人 [85] 开发了基本的变换方案,如缩放和旋转,以增强训练数据。Qian 等人 [84] 提出了一种在常规边界框回归目标和定向情况之间的通用变换方法,这使得更有效的定向框回归训练成为可能。除了增强训练信号外,其他工作还探索了角度回归变换 [83] 以提高精确的定向边界框预测。上述变换保留了坐标表示,而一些研究工作扩展了变换以获得其他格式。例如,引入了渐进变形和回归,将原始边界框转换为多点多边形以捕获物体掩码 [86]。与假设静态输入图像的当前发展不同,这项工作旨在寻求一种与图像变换相关联的边界框变换。框变换与图像变换相关联,以兼容检测器的训练和推理。

2.5. 利用神经网络进行空间偏移学习

图像空间偏移预测是基于深度学习的空间回归任务的基本组成部分,通过细化粗略提议或纠正离散化误差来实现精确定位。在目标检测中,像 Faster R-CNN [18] 和 YOLO [26, 32] 这样的方法回归边界框偏移量以调整锚框朝向真实坐标,通常使用归一化位移和对数缩放以保持稳定性。类似地,关键点估计网络预测关键点偏移量以实现细粒度定位 [87, 88, 39]。除了稀疏偏移预测外,逐像素偏移量还用于光流 [89] 和实例分割 [86, 90] 等密集预测任务,以对齐特征或细化边界。与上述用于显式回归任务预测的偏移量预测不同,一些研究工作与隐式偏移量相关。例如,可变形卷积(DCN)利用偏移量动态调整特征采样位置 [14, 15]。该方法后来在特定视觉任务(如目标检测 [44] 和姿态估计 [91])中得到探索,以改善特征提取。本工作探索了用于参数化图像变换的自适应偏移量预测,这也属于隐式偏移量预测,但与可变形卷积网络不同,因为它不涉及图像失真。

3. 提出的方法

我们首先介绍基于变焦的目标检测方法的概述并讨论关键的设计选择,然后展示实例化高效基于变焦的检测框架的详细设计。在其余部分中,粗体字符(如 x\mathbf{x}x)用于表示张量或向量变量,常规字符用于表示标量变量(如 xxx)。

3.1. 概述与动机

给定输入图像 III,目标是通过对输入图像执行非均匀空间变换来放大小物体:

I′(x,y)=I(u,v)(1) I'(x, y) = I(u, v) \quad (1) I′(x,y)=I(u,v)(1)

其中 I′I'I′ 表示输入图像的变焦版本,(x,y)(x, y)(x,y) 是输出图像空间(变焦空间)上的离散空间像素坐标,(u,v)(u, v)(u,v) 是输入图像空间(原始空间)上的连续空间像素坐标。这里,假设像素坐标已经归一化。连续空间坐标上的像素值通过双线性插值获得。变换基于映射 TTT,该映射将坐标映射为:

T:(x,y)→(u,v)(2) T: (x, y) \to (u, v) \quad (2) T:(x,y)→(u,v)(2)

通过适当的映射,图像变换放大了感兴趣的物体,从而有助于更好地检测它们。实例化这种基于变焦的目标检测框架的挑战性设计选择是:

- i) 映射 TTT 的参数化应充分捕捉物体的位置并在其上密集映射,以实现有效的放大。

- ii) 变换会导致边界框标签错位;因此,至关重要的是设计一种在原始空间和变焦空间之间的框标签变换方法,从而使目标检测模型能够进行有效的训练和推理过程。

先前的基于变焦的工作 [13] 使用复杂的显著性引导坐标拉动机制来参数化映射 TTT,以提升细粒度分类和视线估计任务。具体而言,给定由神经网络预测并捕获任务相关细节(如物体判别性部分)[13] 的显著性图 SSS,使用高斯距离核 k((x,y),(x′,y′))k((x, y), (x', y'))k((x,y),(x′,y′)) 进行加权平均以获得映射的空间坐标:

Tu(x,y)=∑x′,y′S(x′,y′)k((x,y),(x′,y′))x′∑x′,y′S(x′,y′)k((x,y),(x′,y′))(3) T_u(x, y) = \frac{\sum_{x', y'} S(x', y') k((x, y), (x', y')) x'}{\sum_{x', y'} S(x', y') k((x, y), (x', y'))} \quad (3) Tu(x,y)=∑x′,y′S(x′,y′)k((x,y),(x′,y′))∑x′,y′S(x′,y′)k((x,y),(x′,y′))x′(3)

Tv(x,y)=∑x′,y′S(x′,y′)k((x,y),(x′,y′))y′∑x′,y′S(x′,y′)k((x,y),(x′,y′))(4) T_v(x, y) = \frac{\sum_{x', y'} S(x', y') k((x, y), (x', y')) y'}{\sum_{x', y'} S(x', y') k((x, y), (x', y'))} \quad (4) Tv(x,y)=∑x′,y′S(x′,y′)k((x,y),(x′,y′))∑x′,y′S(x′,y′)k((x,y),(x′,y′))y′(4)

其中 (x,y)(x, y)(x,y) 定义高斯核的中心,(x′,y′)(x', y')(x′,y′) 遍历相邻的空间位置。显著性图的加权将变换坐标拉向显著的图像区域,高斯核降低了非中心位置的权重,从而避免了附近坐标折叠到同一空间位置的情况。

基于显著性的参数化的局限性: 尽管对于分类和视线估计等图像级理解任务有效,但基于显著性的参数化会导致物体和周围背景严重失真,这可能损害实例级目标检测。这是由于显著性倾向于在某些空间区域达到峰值,从而导致对附近位置的过度采样(根据公式 3 和 4)。此外,非均匀变焦导致边界框错位,由于逆映射 T−1T^{-1}T−1 难以求解,因此很难恢复;因此,将边界框标签变换到变焦空间是不可行的。这些局限性阻碍了变焦在无人机目标检测领域的应用,在该领域中物体通常规模较小,因此对图像失真和框标签方差敏感。

基于上述观察,在这项工作中,我们放弃了 TTT 的复杂基于显著性的参数化,并引入了基于偏移量的参数化以及一种新颖的边界框标签变换方案。基于偏移量的参数化学习预测坐标的空间偏移量,并具有基于框的变焦目标函数,从而引起较少的失真。边界框变换方案在训练期间有效地将真实边界框转换为变焦空间,并在推理期间将预测转换回原始空间。

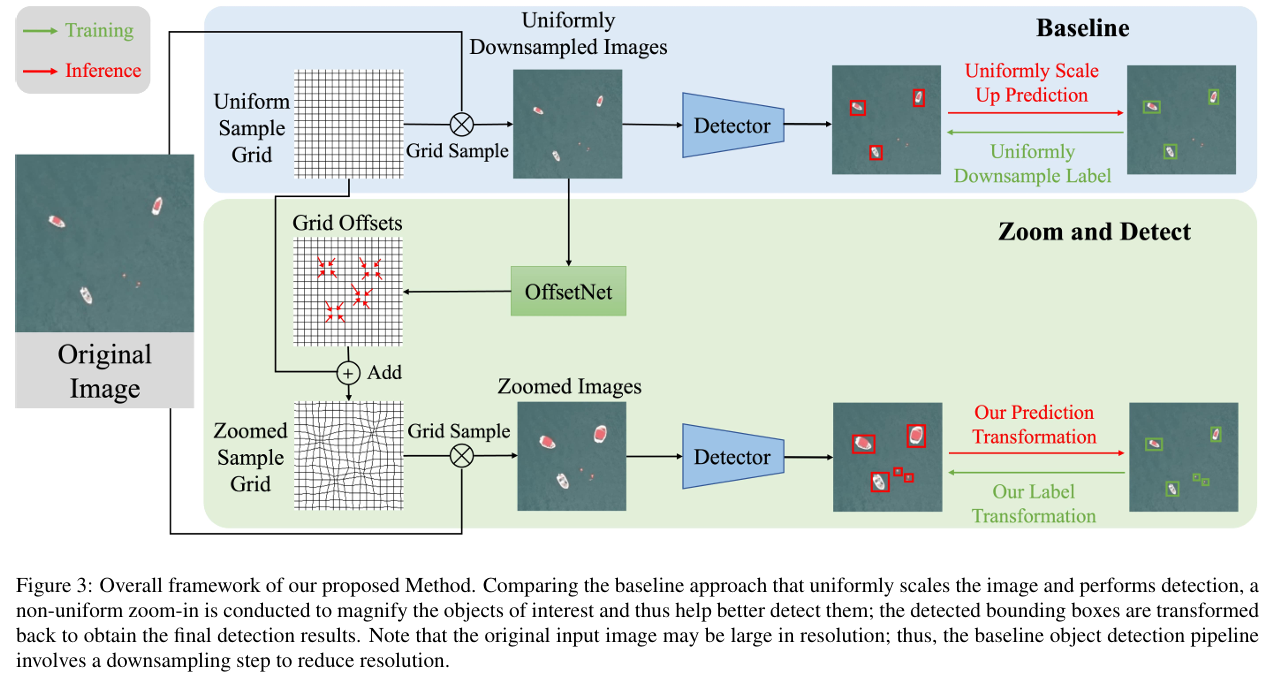

3.2. 基于偏移量的映射参数化

为了预测变换映射 TTT,使用一个小型卷积神经网络 fθf_\thetafθ 来预测每个像素位置的空间偏移量 (Δx,Δy)(\Delta x, \Delta y)(Δx,Δy),其中 θ\thetaθ 表示可学习参数。fθf_\thetafθ 被称为 OffsetNet。预测的偏移量被添加到像素坐标 (x,y)(x, y)(x,y),因此映射简单地参数化为:

Tu(x,y)=x+Δx(5) T_u(x, y) = x + \Delta x \quad (5) Tu(x,y)=x+Δx(5)

Tv(x,y)=y+Δy(6) T_v(x, y) = y + \Delta y \quad (6) Tv(x,y)=y+Δy(6)

与倾向于聚焦物体中心区域并导致严重失真的基于显著性的参数化不同,这种基于偏移量的变焦参数化同等地加权物体区域并减轻失真。此外,可以使用简单的权重衰减项 (12∣∣θ∣∣22\frac{1}{2}||\theta||_2^221∣∣θ∣∣22) 来正则化变换,以强制执行均匀图像采样,从而帮助减轻失真。

为了节省计算量,将输入图像下采样以获得较小版本 IdI_dId,并使用 fθf_\thetafθ 在 IdI_dId 上预测偏移量:

Δd=fθ(Id)(7) \Delta_d = f_\theta(I_d) \quad (7) Δd=fθ(Id)(7)

然后将输出偏移量 Δd\Delta_dΔd 插值到变焦图像大小以获得 Δ\DeltaΔ,它是二维的,对应于 Δx\Delta xΔx 和 Δy\Delta yΔy。

简单地通过从目标检测损失反向传播的梯度隐式学习 fθf_\thetafθ 是不够的,因为检测损失对于物体放大是间接的。因此,有必要设计有效的学习目标。然而,与可以容易地从物体边界框标注中学习的显著性预测不同,定义偏移量预测目标具有挑战性,因为采样偏移量与物体区域的放大没有直接关系。

3.3. 物体变焦损失

为了解决这一挑战,引入了物体变焦损失来学习映射偏移量预测。具体而言,对于输入图像上的每个边界框 bib_ibi,其框面积被视为输入图像空间上的掩码 aia_iai,然后对掩码执行与输入图像相同的图像变换(带有映射 TTT)以获得变焦掩码 ai′a'_iai′:ai′(x,y)=ai(u,v)a'_i(x, y) = a_i(u, v)ai′(x,y)=ai(u,v)。可以计算变焦比率:

mi=sum(ai′)/sum(ai)(8) m_i = \text{sum}(a'_i) / \text{sum}(a_i) \quad (8) mi=sum(ai′)/sum(ai)(8)

其中 sum\text{sum}sum 表示掩码的元素求和操作,即 sum(a)=∑h,wahw\text{sum}(a) = \sum_{h,w} a_{hw}sum(a)=∑h,wahw,其中 hhh 和 www 为空间掩码像素索引。该变焦比率有助于归一化不同物体的放大倍数。为了学习放大,利用对数函数设计了一个最大化变焦比率 mim_imi 的损失函数。直觉是,当 mim_imi 较小时,损失应该较大以强制变焦。损失函数设计为:

Lzoom=∑iNmax(log(α+ϵmi+ϵ),0)β(9) L_{\text{zoom}} = \sum_{i}^{N} \max\left(\log\left(\frac{\alpha + \epsilon}{m_i + \epsilon}\right), 0\right)^\beta \quad (9) Lzoom=i∑Nmax(log(mi+ϵα+ϵ),0)β(9)

其中 ϵ\epsilonϵ 是一个小常数,避免无限损失值。α,β\alpha, \betaα,β 是两个控制损失形状的超参数。具体而言,α\alphaα 控制放大阈值,即当 mi≥αm_i \ge \alphami≥α 时,损失为零,不再强制放大。β\betaβ 调整大放大样本的降权速率,类似于 Focal Loss [92] 中使用的指数超参数,有助于对简单样本降权。添加 max\maxmax 操作以截断值,从而避免负损失。

梯度通过 ai′a'iai′ 的双线性插值操作反向传播到偏移量 Δx\Delta xΔx 和 Δy\Delta yΔy:

∂Lzoom∂Δx=∑x,y∂Lzoom∂ai′(x,y)⋅∂ai′(x,y)∂u⋅∂u∂Δx(10) \frac{\partial L{\text{zoom}}}{\partial \Delta x} = \sum_{x,y} \frac{\partial L_{\text{zoom}}}{\partial a'i(x, y)} \cdot \frac{\partial a'i(x, y)}{\partial u} \cdot \frac{\partial u}{\partial \Delta x} \quad (10) ∂Δx∂Lzoom=x,y∑∂ai′(x,y)∂Lzoom⋅∂u∂ai′(x,y)⋅∂Δx∂u(10)

∂Lzoom∂Δy=∑x,y∂Lzoom∂ai′(x,y)⋅∂ai′(x,y)∂v⋅∂v∂Δy(11) \frac{\partial L{\text{zoom}}}{\partial \Delta y} = \sum{x,y} \frac{\partial L_{\text{zoom}}}{\partial a'_i(x, y)} \cdot \frac{\partial a'_i(x, y)}{\partial v} \cdot \frac{\partial v}{\partial \Delta y} \quad (11) ∂Δy∂Lzoom=x,y∑∂ai′(x,y)∂Lzoom⋅∂v∂ai′(x,y)⋅∂Δy∂v(11)

其中 ai′a'_iai′ 是通过 aia_iai 的网格掩码值的双线性插值获得的:

ai′(x,y)=(1−s)(1−t)ai(h1,w1)+s(1−t)ai(h1,w2)+(1−s)tai(h2,w1)+stai(h2,w2)(12) a'_i(x, y) = (1-s)(1-t)a_i(h_1, w_1) + s(1-t)a_i(h_1, w_2) + (1-s)t a_i(h_2, w_1) + st a_i(h_2, w_2) \quad (12) ai′(x,y)=(1−s)(1−t)ai(h1,w1)+s(1−t)ai(h1,w2)+(1−s)tai(h2,w1)+stai(h2,w2)(12)

其中 (h1,w1),(h1,w2),(h2,w1),(h2,w2)(h_1, w_1), (h_1, w_2), (h_2, w_1), (h_2, w_2)(h1,w1),(h1,w2),(h2,w1),(h2,w2) 是四个相邻的整数坐标。且 s=u−w1s = u - w_1s=u−w1, t=v−h1t = v - h_1t=v−h1 代表 uuu 和 vvv 的小数部分。关于双线性插值操作的梯度可以推导为:

∂ai′(x,y)∂u=(1−t)(ai(h1,w2)−ai(h1,w1))+t(ai(h2,w2)−ai(h2,w1))(13) \frac{\partial a'_i(x, y)}{\partial u} = (1-t)(a_i(h_1, w_2) - a_i(h_1, w_1)) + t(a_i(h_2, w_2) - a_i(h_2, w_1)) \quad (13) ∂u∂ai′(x,y)=(1−t)(ai(h1,w2)−ai(h1,w1))+t(ai(h2,w2)−ai(h2,w1))(13)

∂ai′(x,y)∂v=(1−s)(ai(h2,w1)−ai(h1,w1))+s(ai(h2,w2)−ai(h1,w2))(14) \frac{\partial a'_i(x, y)}{\partial v} = (1-s)(a_i(h_2, w_1) - a_i(h_1, w_1)) + s(a_i(h_2, w_2) - a_i(h_1, w_2)) \quad (14) ∂v∂ai′(x,y)=(1−s)(ai(h2,w1)−ai(h1,w1))+s(ai(h2,w2)−ai(h1,w2))(14)

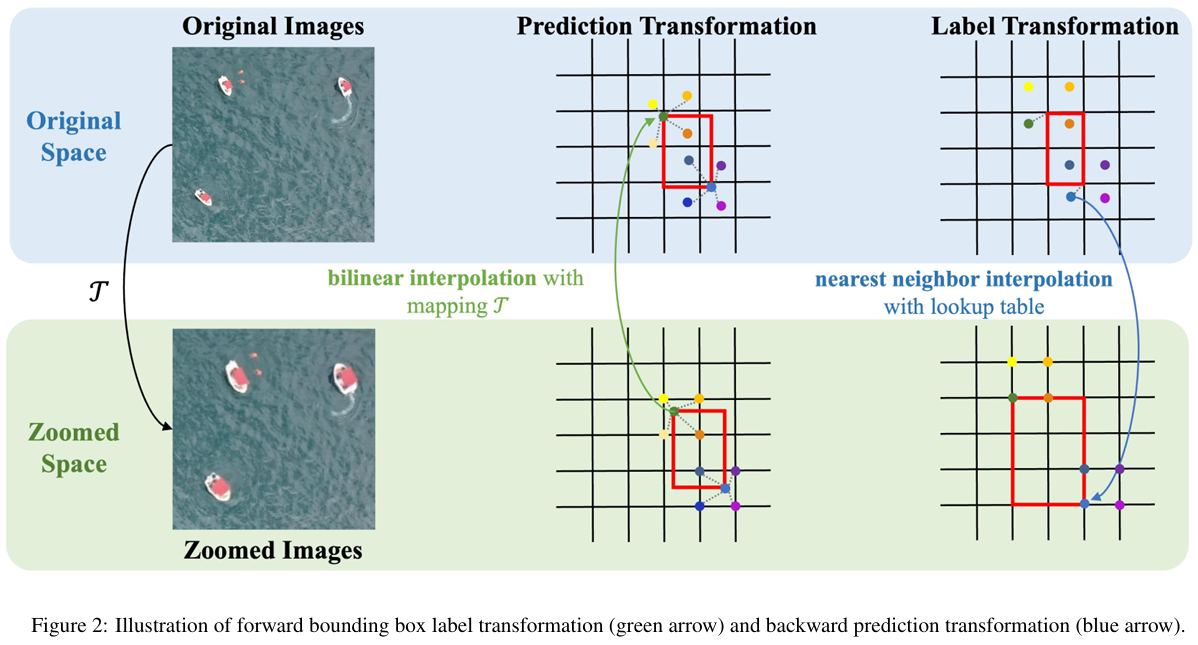

3.4. 角点对齐的框变换

通过上述基于偏移量的变焦,物体被放大了,但原始的边界框标注无效。因此,需要将原始框变换到变焦图像空间。然而,求解逆映射 T−1T^{-1}T−1 具有挑战性,因为 TTT 是非均匀且依赖于数据的。因此,我们提出了一种简单高效的角点对齐变换,以在不求解逆 T−1T^{-1}T−1 的情况下将边界框"转换"到变焦图像空间。

具体而言,给定原始图像空间中的边界框 bbb,我们的目标是将其左上角 c1=(u1,v1)c_1=(u_1, v_1)c1=(u1,v1) 和右下角 c2=(u2,v2)c_2=(u_2, v_2)c2=(u2,v2) 映射到变焦空间,并使用映射后的角点实例化一个新的边界框。这种基于角点的表示已在目标检测社区中广泛使用 [39]。为了实现变换,将在上述基于偏移量的变焦过程中计算的映射视为查找表:

<Φ:(xj,yj)→Ψ:(uj,vj)>(15) < \Phi: (x_j, y_j) \to \Psi: (u_j, v_j) > \quad (15) <Φ:(xj,yj)→Ψ:(uj,vj)>(15)

并将其反转为 <Ψ→Φ>< \Psi \to \Phi ><Ψ→Φ>。然后在 Ψ\PsiΨ 中搜索 c1c_1c1 和 c2c_2c2 的最近空间邻居,并使用逆查找表获得映射后的角点 c1′=(x1,y1)c'_1=(x_1, y_1)c1′=(x1,y1) 和 c2′=(x2,y2)c'_2=(x_2, y_2)c2′=(x2,y2):

c1′,c2′=Ψ(N(c1)),Ψ(N(c2))(16) c'_1, c'_2 = \Psi(N(c_1)), \Psi(N(c_2)) \quad (16) c1′,c2′=Ψ(N(c1)),Ψ(N(c2))(16)

其中 NNN 表示最近邻搜索操作:

N(c)=argmin(uj,vj)∈Ψ∣∣(uj,vj)−c∣∣2(17) N(c) = \arg\min_{(u_j, v_j) \in \Psi} ||(u_j, v_j) - c||_2 \quad (17) N(c)=arg(uj,vj)∈Ψmin∣∣(uj,vj)−c∣∣2(17)

因此,变换后的边界框为 b′=(c1′,c2′)b' = (c'_1, c'_2)b′=(c1′,c2′)。

通过提出的框变换,真实边界框现在与变焦物体对齐,并且可以照常进行目标检测器训练。

在推理过程中,预测的边界框以类似的方式变换回原始图像空间。由于 Φ\PhiΦ 处于均匀像素网格空间,因此节省了最近邻搜索,并采用双线性插值来获得推理期间的变换坐标。图 2 展示了带有空间网格的示例。

3.5. 框变换误差分析

为了严格分析上述角点对齐边界框变换引起的误差,我们推导了原始真实框 bbb 和向后变换框 b^\hat{b}b^ 之间的交并比(IoU)的下界。两者之间的位移可能来自三个方面:

- 前向变换: 坐标映射期间的最近邻量化,可能导致检测器训练中的误差。

- 检测器方差: 边界框预测中的定位不确定性。训练好的检测器可能对边界框具有预测方差。

- 后向插值: 逆框变换期间的双线性插值可能导致额外误差。

为简单起见,角点的最大位移距离记为 τ\tauτ。设原始边界框的宽度为 www,高度为 hhh。最坏情况的 IoU 发生在角点沿同一方向 θ\thetaθ 位移时,这导致交集面积减少并集面积增加。

交并比为:

IoU=(w−τcosθ)(h−τsinθ)2wh−(w−τcosθ)(h−τsinθ)(18) \text{IoU} = \frac{(w - \tau \cos\theta)(h - \tau \sin\theta)}{2wh - (w - \tau \cos\theta)(h - \tau \sin\theta)} \quad (18) IoU=2wh−(w−τcosθ)(h−τsinθ)(w−τcosθ)(h−τsinθ)(18)

通过代入 wsinθ+hcosθw\sin\theta + h\cos\thetawsinθ+hcosθ,可以证明当 θ=arctan(w/h)\theta = \arctan(w/h)θ=arctan(w/h) 时上述具有最小值:

IoU≥wh−τw2+h2wh+τw2+h2(19) \text{IoU} \ge \frac{wh - \tau \sqrt{w^2 + h^2}}{wh + \tau \sqrt{w^2 + h^2}} \quad (19) IoU≥wh+τw2+h2 wh−τw2+h2 (19)

对于 τ≪w,h\tau \ll w, hτ≪w,h,可以获得以下结果:

IoUmin≈1−2τ1w2+1h2(20) \text{IoU}_{\min} \approx 1 - 2\tau \sqrt{\frac{1}{w^2} + \frac{1}{h^2}} \quad (20) IoUmin≈1−2τw21+h21 (20)

实际意义: 该界限暗示了小物体对变换误差的敏感性,即边界框的尺寸越小,IoU 界限越高。IOU 误差在随后的实验中得到了经验验证。

3.6. 网络优化

结合上述物体变焦和边界框变换,获得了一个高效的目标检测框架,命名为 ZoomDet 。整体框架如图 3 所示。ZoomDet 与检测器无关,可应用于任意目标检测模型。整个框架使用目标检测损失(通常定义为物体分类和边界框回归目标)和提出的物体变焦损失进行优化:

L=Ldetection+Lzoom(21) L = L_{\text{detection}} + L_{\text{zoom}} \quad (21) L=Ldetection+Lzoom(21)

4. 实验

在本节中,使用几个代表性数据集进行了彻底的实验和分析。目标是检查以下方面:

- ZoomDet 跨数据集和目标检测架构带来的改进,并与接近的非均匀变焦检测方法进行比较。

- 与其他 SOTA 均匀变焦方法的比较,以及与这些方法(如基于图块的变焦方法和隐式特征变焦方法)集成时的兼容性。

- 对开发的物体变焦组件的经验分析,包括偏移量预测网络、基于框的变焦目标和边界框变换。

- 对模型预测、跨数据集框分布的定性可视化,以及扩展到检测以外的其他任务场景的讨论。

除非在后期的实验中另有说明,否则使用标准的目标检测训练和推理设置;不使用多尺度训练和推理等临时技术。

4.1. 实验设置

4.1.1. 数据集

我们使用三个公开发布的无人机目标检测基准数据集进行实验,包括 VisDrone [4]、UAVDT [16] 和 SeaDronesSee [17]:

- VisDrone: VisDrone [4] 数据集是在多个城市/郊区街道场景中收集的无人机目标检测和跟踪数据集。使用的是 VisDrone-2019 版本,包含 10,209 张图像(6,471 张用于训练,548 张用于验证,3,190 张用于测试)。该数据集标注了 10 个常见的街道物体类别,如行人和汽车。数据集的图像分辨率约为 2000×15002000 \times 15002000×1500 像素。由于测试服务器已关闭,按照先前的工作 [2],使用验证集来评估所提出的方法。

- UAVDT: UAVDT [16] 数据集是一个多样化的无人机目标检测数据集,在城市场景中收集,捕捉了不同的视角、时间和高度。使用的是 Benchmark-M 集,包含 24,143 张训练图像和 15,069 张测试图像。图像分辨率约为 1080×5401080 \times 5401080×540 像素。该数据集标注了 3 个物体类别:汽车、公交车和卡车。

- SeaDronesSee: SeaDronesSee [17] 数据集是在海域通过空中无人机视角收集的,旨在弥合陆地数据集和海事数据集之间的差距。该数据集捕捉了多样的观测角度和姿态。使用的是目标检测集,由 8,930 张训练图像、1,547 张验证图像和 3,750 张测试图像组成。使用了四个常见的海事无人机物体类别:游泳者、船、水上摩托艇、救生设备和浮标。由于测试标注未发布,使用验证集来评估我们的方法。

4.1.2. 实现细节

我们基于 mmdetection [93] 实现了 ZoomDet,这是一个广泛用于视觉对象感知任务(如目标检测和实例分割)的代码库。为了实例化偏移量预测器,我们移除了 ResNet-18 网络第二个块之后的层(对应于 ResNet 论文中的 conv_4, conv_5),并附加了一个单层卷积来预测二维输出。参数总数为 683,458(11 个卷积层,ResNet 占 10 个,偏移量预测占 1 个)。这样的卷积网络轻量级且实现了高效的偏移量预测。注意,没有应用额外的显式正则化;应用权重衰减项来正则化偏移量预测器,当权重正则化为零时,它预测零偏移量,从而正则化采样为均匀并保持原始内容。

使用了 Pytorch 库中实现的最近邻函数(torch-cluster-nearest-cuda.nearest)来实现框变换。除非另有说明,所有模型均训练 24 个 epoch,使用 SGD 优化器,学习率为 0.01,动量为 0.9,权重衰减为 0.0001。所有模型均使用四张 Nvidia-4090 GPU 卡进行训练。

在训练和推理期间,对于 Faster R-CNN 和 YOLO 模型,图像分别调整为 800×1333800 \times 1333800×1333 或 800×800800 \times 800800×800 的窗口大小。

4.2. 主要结果

4.2.1. 与非均匀变焦方法的比较结果

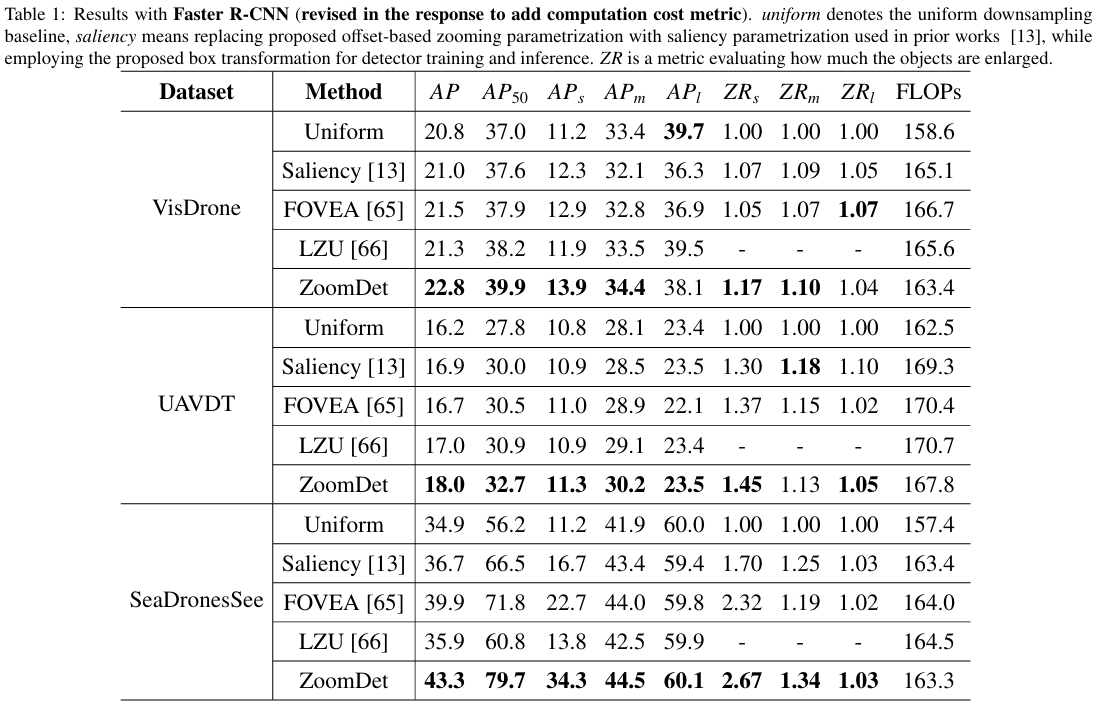

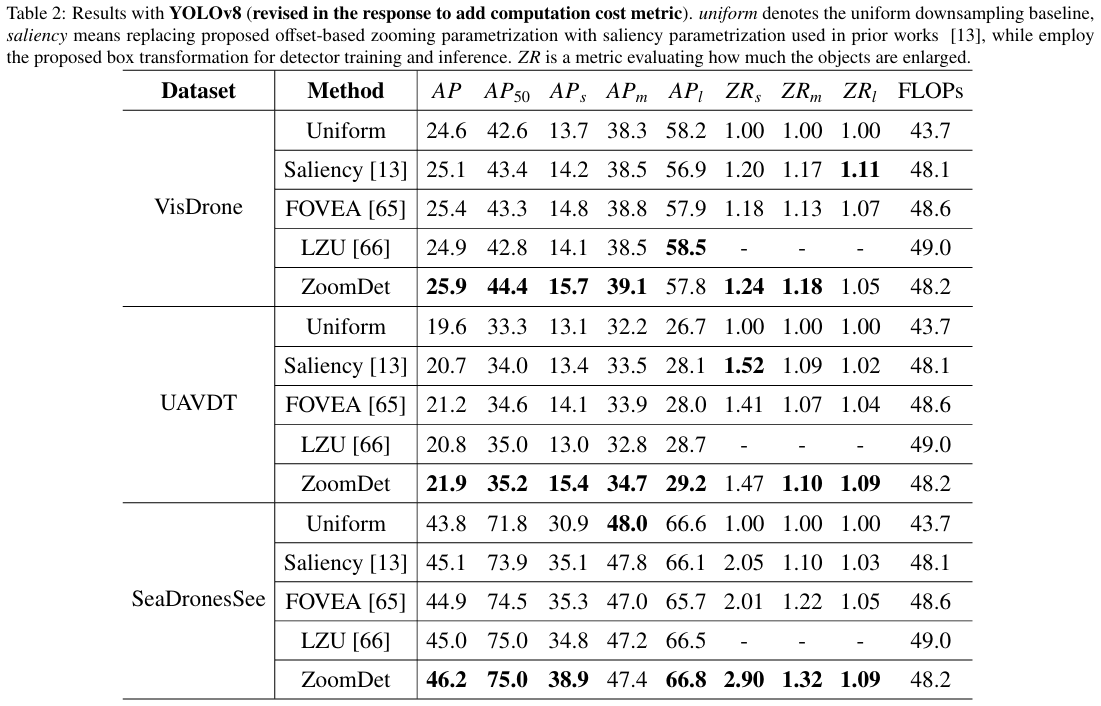

首先展示了 Faster R-CNN 和 YOLOv8-s 的主要实验结果。在评估集上计算变焦比率指标(ZR)以评估物体被放大的程度。具体而言,对于每个真实边界框,将变焦后的框面积除以原始框面积以获得比率。如表 1 所示,ZoomDet 在所有三个数据集上均显著优于具有均匀下采样的 Faster R-CNN 基线。值得注意的是,ZoomDet 在 SeaDronesSee 数据集上带来了 8.48.48.4 的 mAP 增益,特别是对于小物体(有 26.226.226.2 的绝对提升)。在使用 YOLOv8 模型时也观察到了类似的性能提升,如表 2 所示。对于 ZR 指标,所提出的方法显示了有效的放大能力,特别是对于小物体。例如,SeaDroneSee 中的小物体被放大了超过 2.6 倍;我们请读者参考后一节中的定性结果。

我们还比较了先前工作 [13, 65] 中基于显著性的参数化。建立了三个比较基线:

- Saliency: 采用先前工作 [13] 中的基于显著性的图像扭曲,并使用提出的框变换进行检测器训练和推理。

- FOVEA: 采用 FOVEA [65] 框架,该框架采用基于显著性的扭曲 [13],并在训练期间直接将预测的边界框映射回原始空间。为了与我们的方法进行比较,使用了学习到的不可分 [65] 设置,这能更好地预测小物体。

- LZU: 采用 LZU 框架 [66],该框架开发基于显著性的扭曲以在扭曲空间上提取图像特征,然后将特征映射回原始空间。

与这些方法相比,所提出的方法为均匀基线提供了更大的改进。对于不同物体尺度的物体放大比率也更大,即 ZR 指标。结果证明了所提出框架的优越性,正如 3.1 节中所讨论的,它提供了更好的映射参数化和灵活的框变换。同时,FOVEA [65] 和 LZU [66] 的间接学习范式阻碍了在变焦空间中进行有效的目标检测训练,因为它们要么在检测器学习期间将边界框预测映射回原始空间。

另一方面,在较大物体上观察到较少的改进或某些性能下降,即在 VisDrone 和 SeaDroneSee 数据集上 APl 和 APm 的下降。这主要是由于大物体已经足够大,而放大可能会导致对这些物体的识别精度产生干扰。

4.2.2. 与均匀变焦方法的比较结果

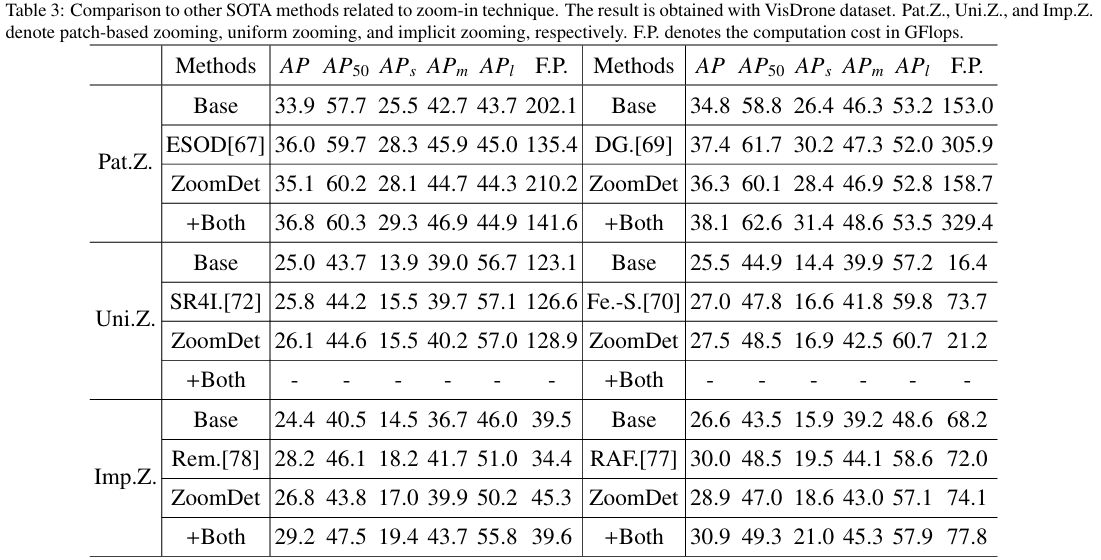

为了更全面地与非均匀变焦方法以及其他遵循变焦方法的 SOTA 方法进行比较,我们将其他近期的变焦相关方法分为基于图块的变焦 [49, ..., 69]、均匀变焦 [70, ..., 74] 和隐式特征变焦 [75, ..., 80] 并进行比较。为了公平比较,采用了这些比较工作的基础目标检测器。由于 ZoomDet 框架可以与隐式变焦方法和基于图块的变焦方法结合以提高检测精度,我们额外展示了用 ZoomDet 增强比较方法的结果。对于均匀变焦方法,由于变焦目标难以与重建目标结合,因此报告比较结果时不包含组合结果。

如表 3 所示,观察结果可以总结为:

- 对于基于图块的变焦和隐式变焦,ZoomDet 带来的改进小于比较方法。例如,与基于图块的 ESOD [67] 和 DG [69] 的 AP 提升 2.1 和 2.6 相比,ZoomDet 的 AP 提升为 1.2 和 1.5。这是因为它们关注不同的变焦视角,一个解决全局图块级物体尺度变化,另一个解决局部物体级物体尺度变化。因此,当结合使用时,可以实现最佳性能增益,例如,进一步将 ESOD [67] 和 DG [69] 的 AP 提升 0.8 和 0.7,APs 提升 1.0 和 1.2。对于隐式变焦方法也可以观察到类似的性能提升模式。组合效果也很好,因为隐式变焦方法侧重于特征级物体信号增强,而 ZoomDet 侧重于图像级物体放大。

- 对于均匀变焦方法,ZoomDet 提供了更高的改进,例如,与 Fe.-S. [70] 方法的 1.5 相比,AP 提升了 2.0。这两者实际上在整个输入图像的同一级别上工作。均匀变焦主要通过增强物体视觉属性(如判别性部分和边缘)来改善检测。而 ZoomDet 可以通过直接放大其空间尺寸来更好地增强物体信息,因此改进更大。

4.2.3. 自然场景图像数据集上的结果

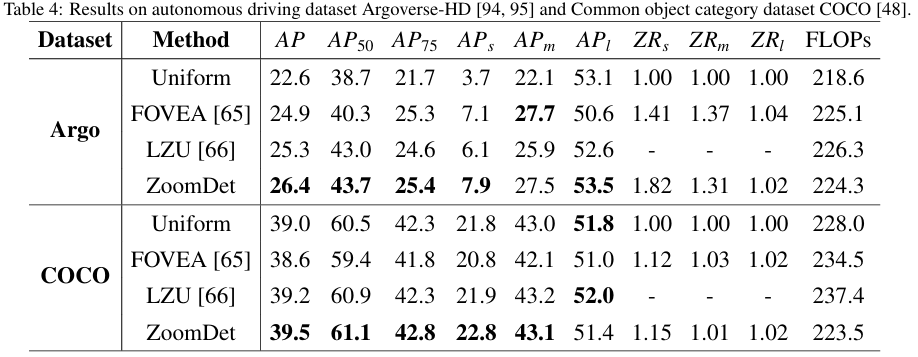

除了无人机图像领域外,还在常见的自然场景数据集上进行了进一步的实验,以测试 ZoomDet 的通用性。使用了通用物体类别数据集 COCO [48] 和自动驾驶数据集 Argoverse-HD [94, 95]。

一些先前的工作,如 FOVEA [65] 和 LZU [66],采用了基于显著性的图像变换 [13],并为自动驾驶场景中的目标检测开发了一种非均匀采样方法。遵循这些工作,我们采用 RetinaNet 作为目标检测器,并在 Argoverse-HD 数据集和广泛使用的 COCO 基准上报告了所提出方法的性能。结果如表 4 所示。所提出的方法优于它们,相对于均匀采样基线有 3.83.83.8 的 AP 绝对提升。值得注意的是,它们使用中央水平区域的静态空间先验来放大主要分布在这些区域的街景物体,或者利用前一帧的框预测作为空间先验,而本工作学习通用的基于图像的物体变焦并取得了更好的性能。

此外,还在 COCO 基准上进行了实验,这是最常见的自然物体数据集之一(80 个常见物体类别)。如表 4 所示,与上述结果不同,由于 COCO 图像中的物体通常大得多且彼此靠近(许多有遮挡),ZoomDet 的改进有限,即 AP 提升了 0.50.50.5。这一观察结果也与上述失败案例分析相对应,表明 ZoomDet 可能导致大物体和拥挤场景的性能下降。值得注意的是,所提出的方法为小物体带来了明显的性能提升,即 APs 有 1.01.01.0 的绝对增益,这在所有比较方法中是最好的。

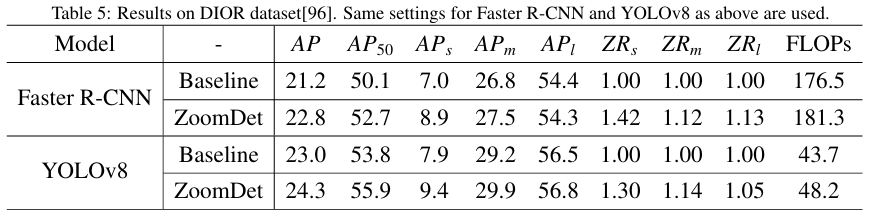

4.2.4. 遥感图像数据集上的结果

虽然这项工作专注于无人机目标检测,但正如论文标题所示,该方法是通用的。在这里,通过将结果添加到遥感小物体检测数据集 DIOR [96] 来进行更多实验。该数据集是一个大规模航空物体检测数据集,具有大范围物体尺寸变化和多样的视觉质量。图像分辨率为 800×800800 \times 800800×800,类别总数为 20。图像分为 5,862 张训练图像、5,863 张验证图像和 11,725 张测试图像。使用训练集和验证集的组合来训练模型,并在测试集上评估结果。基线模型与主实验中使用的相同,即 Faster R-CNN 和 YOLOv8 模型;训练设置和超参数也相同。如表 5 所示,虽然改进不如 SeaDroneSee 和 UAVDT 等无人机拍摄检测数据集中的那么大,但它仍然为检测提供了有效的提升,特别是在小物体上。例如,Faster R-CNN 的 AP 提升了 1.61.61.6,APs 提升了 1.91.91.9;YOLO 的 AP 提升了 1.31.31.3,APs 提升了 1.51.51.5。很可能是因为遥感数据集的背景更加混乱,导致偏移量预测网络的识别效果较差,从而对小物体的放大效果较弱。这也是未来工作的一个良好切入点。

4.3. 经验分析

4.3.1. 损失超参数的消融研究

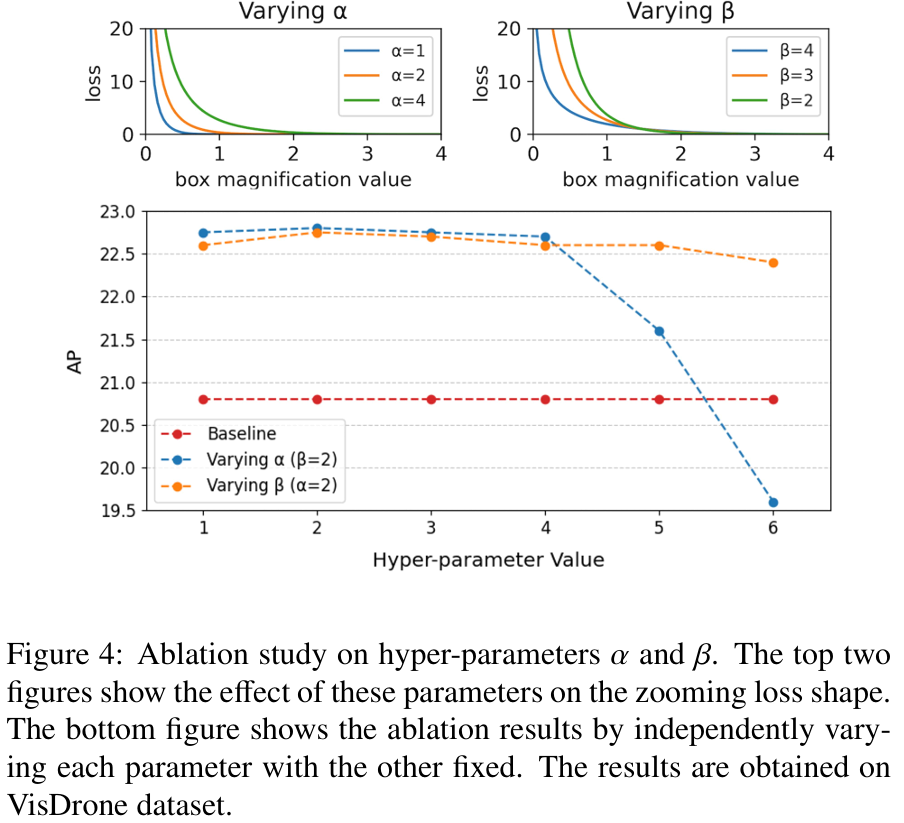

如图 4 所示,通过独立变化这些参数,对超参数 α\alphaα 和 β\betaβ 进行了全面的消融研究。首先,检查它们如何影响损失形状。如图 4 的前两个子图所示,可以观察到较大的 α\alphaα 导致较大的零损失阈值,而较大的 β\betaβ 导致更尖锐的损失曲线。这些观察结果与 3.3 节中的讨论非常吻合。然后,检查超参数如何直接影响性能。如图 4 的底图所示,一个变化而另一个固定。对于 α\alphaα,在 1-4 的值范围内性能保持在大约 22.7,并在 α=2\alpha=2α=2 时达到峰值,而在 4-6 之间急剧下降。这可能是因为过大的 α\alphaα 迫使放大崩溃并导致极端失真。对于 β\betaβ,性能提升相当稳定,在 1-6 之间有超过 1.71.71.7 的 AP 绝对提升(即从基线的 20.8 到 22.5),并在 β=2\beta=2β=2 时达到峰值。总之,虽然存在波动,但在这些超参数的宽值范围内可以实现良好的性能提升。

4.3.2. 偏移量预测网络的消融研究

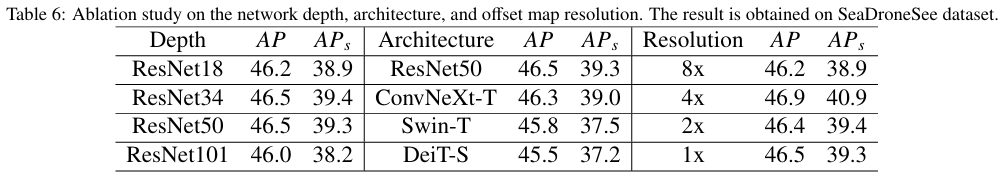

为了进一步检查偏移量预测分辨率、偏移量网络架构和深度的影响,进行了额外的消融研究。

对于网络深度,比较了具有 18、34、50 和 101 层的 ResNet;对于架构,比较了卷积网络和 Transformer 中的流行架构。这些包括 ResNet [97]、ConvNeXT [98]、Swin Transformer [99]、DeiT [100]。选择了具有相似参数量(约 20M)和计算成本(ImageNet 全分类模型约 25GFlops)的架构。对于分辨率,使用 U-net [101] 将默认的 8x 分辨率上采样到 4x、2x 和 1x 预测。

如表 6 所示,检查了具有不同深度、架构和输出分辨率的偏移量网络。

- 深度: 对于不同深度的 ResNet,性能变化不大,在更深的 ResNet34 和 ResNet50 上有 0.30.30.3 AP 的提升,而在 ResNet101 上下降了 0.20.20.2 AP。结果表明偏移量预测是一项低级任务,从更深的网络中获益不多。

- 架构: 卷积网络通常优于基于 Transformer 的骨干架构,即它们的平均性能分别为 46.4 和 45.7。结果表明,基于卷积的偏移量预测可能更擅长捕捉低级物体信息。

- 分辨率: 提高分辨率可以带来改进,例如,将 8x 输出分辨率提升到 4x 可将 AP 提高 0.70.70.7。然而,在 2x 时增益减小,仅有 0.20.20.2 的提升。鉴于更精细的分辨率可能会引入大量计算,结果表明默认的 8x 分辨率可能是权衡中的一个良好"甜点"。但我们想指出,当前的偏移量预测学习范式可能会有改进,从而在更高分辨率下带来更大的改进,例如考虑物体上下文或附近区域物体密度统计的复杂损失目标。这些留待未来研究。

4.3.3. 框变换的误差分析

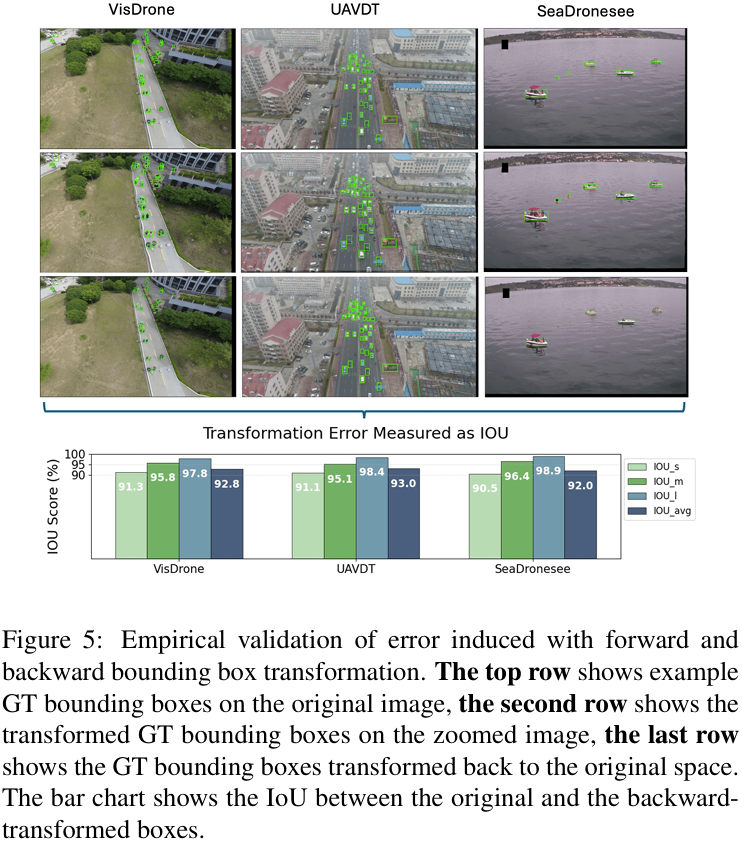

如主论文中所讨论的,计算了由提出的边界框标签变换方案引起的误差。给定学习到的变换,将真实边界框变换到变焦图像空间并变换回原始空间,以计算与原始边界框的 IoU。如图 5 所示,在所有三个无人机图像数据集中,提出的标签变换策略与原始标签的平均 IoU 超过 92%。同时,变换到变焦空间的框标签仍然很好地包围了目标物体,从而保持了监督信号的良好一致性。

4.3.4. 内存和计算的成本分析

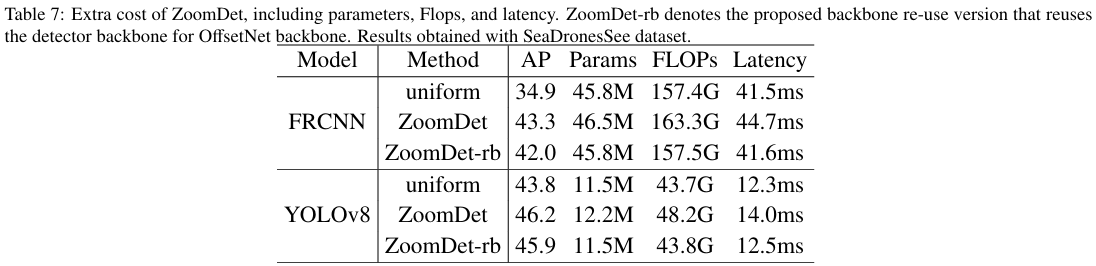

此外,表 7 显示了 ZoomDet 带来的参数、计算和延迟方面的额外成本,ZoomDet-rb 是一个简化版本,其中重用骨干网络作为 OffsetNet 的骨干。具体而言,移除了独立的 OffsetNet 以节省计算。相反,通过在目标检测器骨干模型后附加单层卷积来预测偏移量。因此,骨干网络被重用为 OffsetNet 的骨干并一起训练。现在使用图像特征而不是原始图像进行物体变焦。使用 ZoomDet-rb,性能略低于标准 ZoomDet,但参数、计算和延迟方面的额外成本显著降低,因为额外成本仅在于单个卷积层和变换。

4.4. 讨论

4.4.1. 预测可视化与失败案例

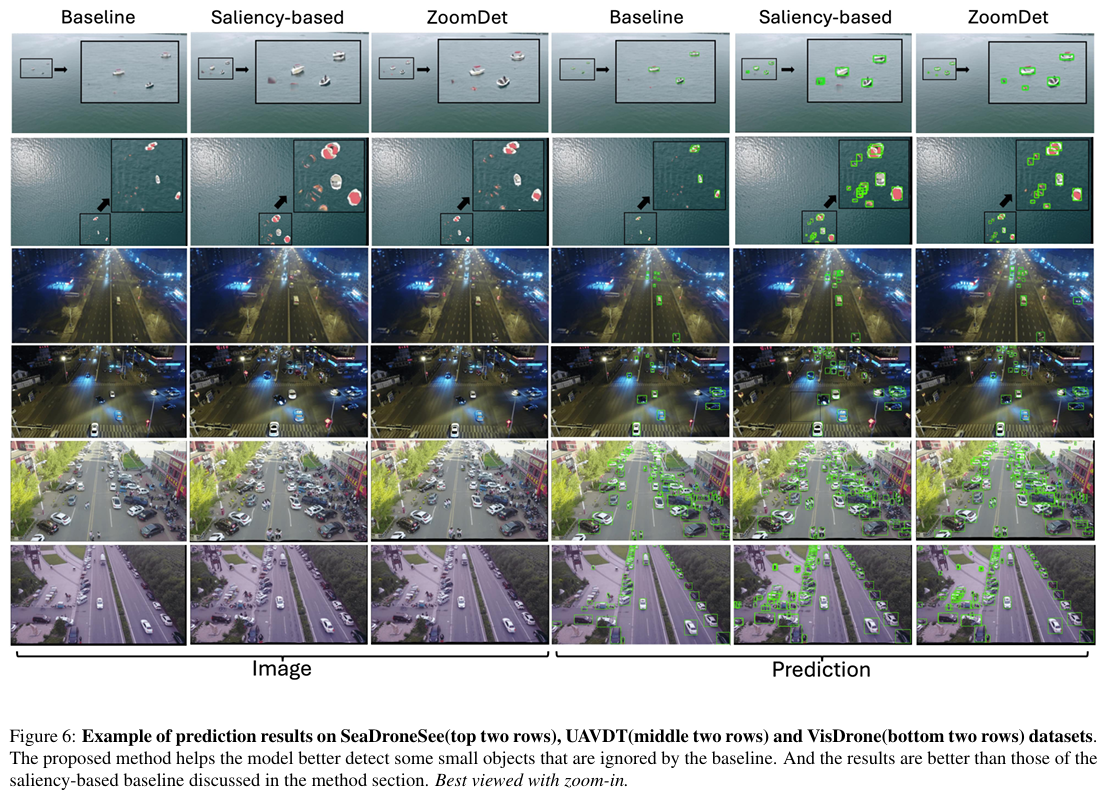

我们可视化了变焦图像和变焦空间中的检测结果。将这些图像和结果与没有任何变焦的基线以及方法部分讨论的基于显著性的变焦参数化进行了比较。如图 6 所示,所提出的方法有助于检测基线遗漏的小物体,例如 Seadronesee 数据集中前两行图像中的游泳者物体。而基于显著性的方法可能导致物体更严重的失真,检测结果也更差,例如漏检和重复检测。这一观察结果也适用于 UAVDT 数据集和 VisDrone 数据集的样本图像。

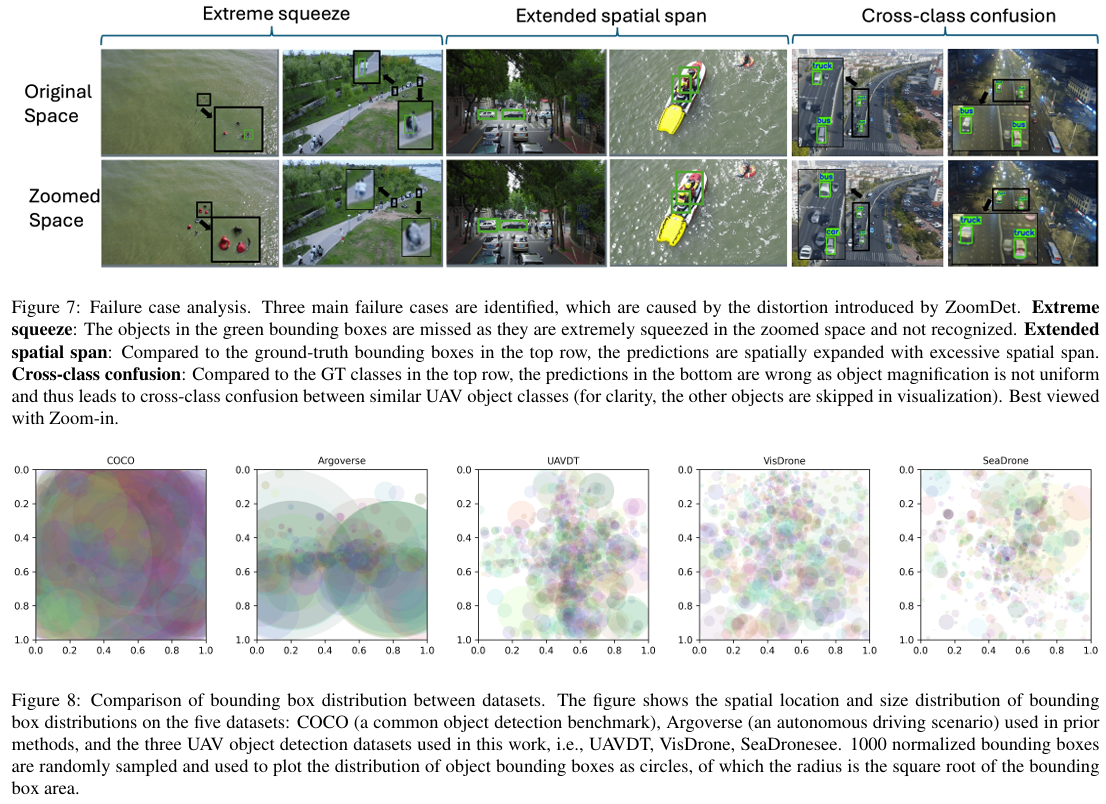

ZoomDet 放大了物体从而有助于提高检测性能;然而,"变焦"有时会失败并导致结果退化。如图 7 所示,总结了三种主要的失败原因,包括:

i) 物体的极端挤压: 图像变换有时会导致某些物体的极端放大,从而导致附近物体意外挤压。这些被挤压的物体可能会被随后的目标检测器遗漏。

ii) 扩展的空间跨度: 物体放大可能导致边界框预测的扩展,而实际空间跨度较小。如图 7 第四列所示,一个游泳者实例的边界框比 GT 框大得多。

iii) 跨类别混淆: 物体放大可能导致某些物体类别之间的混淆。例如,经过图像变换后,公交车和卡车类别的小物体实例可能更加相似,从而导致误分类。如图 7 最右列所示,两个公交车实例被 ZoomDet 误分类为卡车。

4.4.2. 边界框分布的比较

如主要结果中所讨论的,ZoomDet 在三个无人机图像数据集(即 Seadronesee, UAVDT, VisDrone)和自动驾驶数据集(即 Argoverse)中引入了更强的性能提升,但在通用目标检测数据集(即 COCO)上提供的改进较小。这可能是由这些数据集中不同的物体分布引起的。为了验证这一假设,进一步检查了这三个数据集的边界框分布。绘制了归一化边界框的分布。分布绘制为归一化图像坐标上的圆圈。边界框面积的平方根的一半绘制为每个圆的半径,这有助于显示边界框的尺寸分布。如图 8 所示,COCO 数据集包含大量大物体,而三个无人机图像数据集包含更多的小物体。特别是对于 SeaDronesee 数据集,有大量极小的物体,这解释了该数据集上更高的性能提升。Argoverse 数据集也包含比三个无人机图像数据集更多的大物体,但也包含大量小物体。最明显的是,由于自动驾驶的观测角度,物体主要分布在图像的中心水平区域。因此,ZoomDet 可以简单地学习放大中心水平区域以提升检测性能。这解释了与 COCO 数据集相比更好的性能提升。

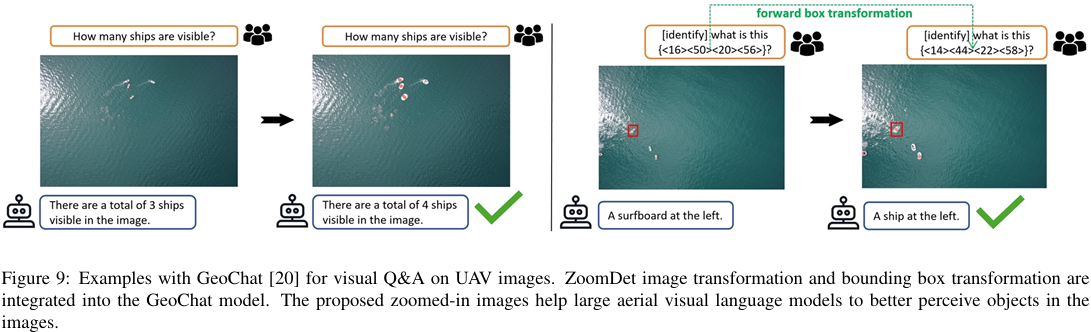

4.4.3. 在视觉 - 语言模型中的应用

由于我们的方法处理图像并获得物体放大的变焦版本,它可以用于执行基于图像的识别的其他场景。因此,我们探索将 ZoomDet 图像和边界框变换应用于最近的大型空中视觉 - 语言模型 GeoChat [20],用于视觉问答和基于区域的描述任务。定性结果显示了将所提出方法进一步扩展到这些场景的潜力。

这里展示了一些视觉示例。如图 9 所示,视觉问答结果得到了改善,具体而言:

i) 当任务是计算船只数量时,提出的变焦图像放大了有意义的前景区域,从而帮助模型感知物体;

ii) 当任务是在给定的边界框区域内识别物体时,用户给定的边界框通过提出的框变换进行变换,并将新图像以及变换后的边界框馈送给模型。同样,船只物体被正确识别,这可能表明变焦有助于增强类别判别信息。

5. 结论

这项工作介绍了一个用于无人机图像目标检测的"变焦并检测"框架,其中物体通常较小且稀疏分布。主要动机是对物体区域进行非均匀变焦,从而帮助后续的目标检测器更好地识别它们。为了实现高效的变焦过程并使目标检测器能够在变焦图像空间上学习,开发了一种偏移量预测机制来回归非均匀图像采样网格。基于基于偏移量的变焦,我们进一步引入了一种框变换方法,以帮助在训练和推理期间变换边界框。ZoomDet 在多个无人机目标检测数据集上显示出显著的性能增益,并产生了极小的额外成本。

局限性与未来工作: 虽然效率高,但 ZoomDet 目前仅支持目标检测;当前的标签变换方案不支持其他视觉对象感知任务,如实例分割和语义分割。因此,开发适用于其他任务的高效变换方法非常重要。此外,观察到 ZoomDet 的训练过程偶尔会不稳定,特别是在拥挤场景数据集上;这可能是由于物体变焦损失优化中相邻物体的竞争造成的。将探索多物体联合变焦目标等方法来改善这一方面。

致谢: 本工作得到国家自然科学基金(Grant 62506249)、四川省自然科学基金(Grant 2024NSFSC1462)、中央高校基本科研业务费(Grant YJ202342)、四川省自然科学基金(Grant 24NSFSC3404)、国家自然科学基金重大科学仪器设备开发项目(Grant 62427820)以及四川省自然科学基金创新研究群体科学基金(Grant 2024NSFTD0035)的支持。