一、神经网络(ANN)

神经网络,是一种模仿生物神经网络结构和功能的计算模型,广泛应用于机器学习和人工智能领域。它们通过模拟大脑中神经元的连接方式,能够学习和识别复杂的模式和数据。

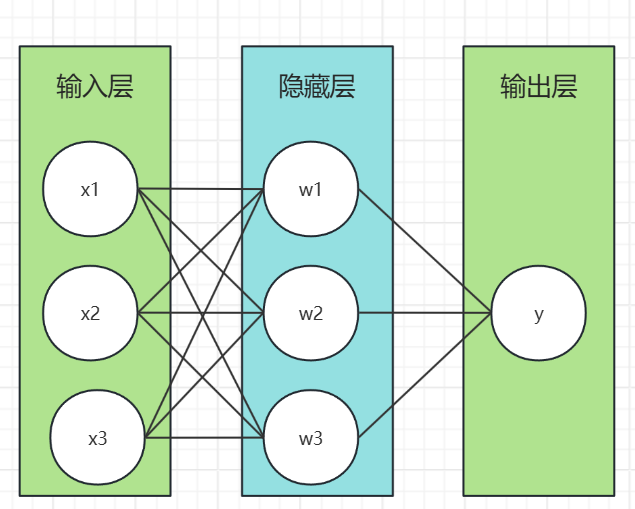

1、神经网络的基本结构

神经网络由多个层组成,包括输入层、一个或多个隐藏层以及输出层。每个层由多个节点(或称神经元)组成,节点之间通过权重连接。输入层接收外部数据,隐藏层负责处理数据,输出层产生最终结果。数据在网络中的传递是通过每个节点的加权和与激活函数计算实现的。当数据通过网络传递时,每个节点的输出会成为下一层节点的输入。

2、神经网络的训练过程

神经网络的训练涉及前向传播和反向传播两个主要过程。在前向传播中,数据从输入层流向输出层,并产生预测结果。在反向传播中,根据预测结果与实际结果之间的误差,通过梯度下降算法调整网络中的权重,以减少未来预测的误差。

3、神经网络的应用

神经网络在多个领域都有广泛应用,如图像和语音识别、自然语言处理、医学诊断等。它们能够处理和分析大量数据,识别复杂模式,提供准确的预测和决策支持。例如,Google的搜索算法就是一个著名的神经网络应用案例。

4、神经网络的类型

神经网络有多种类型,包括感知器、前馈神经网络、卷积神经网络(CNN)和循环神经网络(RNN)等。不同类型的神经网络适用于不同的问题和场景。例如,CNN通常用于图像处理,而RNN则适用于处理序列数据,如时间序列分析。

5、神经网络与深度学习

深度学习是指使用多层神经网络的机器学习方法。一个深度学习模型通常包含多个隐藏层,能够学习数据的高级特征和抽象表示。深度学习在近年来取得了显著的进展,推动了人工智能领域的发展。

神经网络的发展历史悠久,从最初的感知器到现代的深度学习模型,经历了多次技术革新和应用扩展。随着计算能力的提升和数据量的增加,神经网络在解决复杂问题方面展现出了巨大的潜力。

二、循环卷积神经网络(RNN)

RNN(循环神经网络,Recurrent Neural Network)是一种专门处理序列数据(如文本、时间序列、语音等)的神经网络,其核心原理是通过隐藏状态的循环传递来捕捉序列中的时序依赖关系。

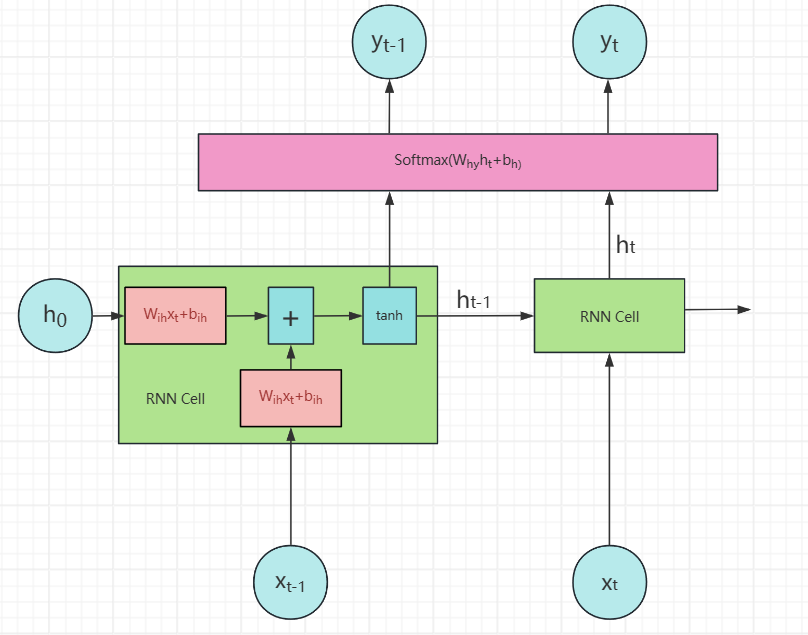

1、基本结构

RNN 的核心是一个循环单元(Recurrent Cell),它由以下部分组成:输入层:接收当前时间步的输入 x t x_t xt,(如单词、时间序列数据点)。隐藏层:维护一个隐藏状态 h t h_t ht ,作为序列的"记忆",传递到下一时间步。

输出层(可选):生成当前时间步的输出 y t y_t yt(如分类概率、预测值)。

2、训练过程

RNN(循环神经网络)的训练过程通过反向传播通过时间(BPTT, Backpropagation Through Time)实现,其核心是将序列展开为计算图,利用链式法则计算梯度并更新参数。

(1)训练目标:最小化损失函数

序列标注(如词性标注):每个时间步输出一个标签,损失为所有时间步的交叉熵损失之和。

序列生成(如语言模型):输出下一个词的概率分布,损失为预测词与真实词的负对数似然。

分类任务(如情感分析):仅用最后一个时间步的输出计算损失。

(2) 前向传播(Forward Pass)

- 初始化隐藏状态: h 0 h_0 h0=0(零向量)

- 按时间步展开序列:对每个时间步 t ∈ 1 , T t\in1,T t∈1,T:计算当前隐藏状态:

h t = t a n h ( W x h x t + W h h h t + b h ) h_t=tanh(W_{xh}x_t+W_{hh}h_t+b_h) ht=tanh(Wxhxt+Whhht+bh)

按需要计算输出:

y t = S o f t m a x ( W h y h t + b h ) y_t=Softmax(W_{hy}h_t+b_h) yt=Softmax(Whyht+bh) - 计算总损失

(3) 反向传播(Backward Pass, BPTT)

- 初始化梯度:

损失对最终输出的梯度: ∂ L ∂ y t \frac{\partial L}{\partial y_t} ∂yt∂L(根据任务类型计算)。

损失对最终隐藏状态的梯度: ∂ L ∂ h t \frac{\partial L}{\partial h_t} ∂ht∂L。 - 从后向前递归计算梯度。

- 参数更新:使用梯度下降或其变体(如 Adam、RMSProp)更新参数。

(4)关键挑战与解决方案

- 梯度消失/爆炸

问题:

深层递归导致梯度指数衰减(梯度消失)或增长(梯度爆炸)。

长期依赖难以学习(如句子开头的词对句尾的影响)。

解决方法:

梯度裁剪:限制梯度最大范值。

门控机制:使用 LSTM 或 GRU 通过门控单元控制梯度流动。

残差连接:在隐藏状态更新中加入残差项。 - 长序列训练效率低

问题:

BPTT 需要存储所有时间步的中间状态,内存消耗大。

反向传播路径长,计算耗时。

解决方法:

截断 BPTT:将序列分成固定长度的片段,仅在片段内反向传播。

并行化:使用 GPU 加速矩阵运算(如批量处理多个序列)。 - 参数初始化敏感

问题:

随机初始化可能导致梯度不稳定(如 W h h W_{hh} Whh初始值过大引发爆炸)。

解决方案:

正交初始化:用正交矩阵初始化 W h h W_{hh} Whh(保持梯度范数稳定)。

Xavier/Glorot 初始化:根据输入输出维度调整初始值范围。

(5)应用场景

- 自然语言处理(NLP)

文本分类(如情感分析)、命名实体识别(NER)、机器翻译(如 Seq2Seq 模型)。 - 时间序列预测

股票价格预测、传感器数据建模、天气预测。 - 语音识别

端到端语音合成(如 WaveNet)、语音命令识别。 - 视频分析

动作识别、场景理解、视频描述生成。

3、变种类型

(1) 基础 RNN

结构:单一隐藏状态循环传递。

问题:梯度消失/爆炸,难以处理长序列。

适用场景:短序列任务(如简单文本分类)。

(2) LSTM(长短期记忆网络)

结构:引入细胞状态(Cell State)和输入门、遗忘门、输出门。

优势:

通过门控机制控制信息流动,缓解梯度消失。

能学习长期依赖(如机器翻译中的长句处理)。

(3)GRU(门控循环单元)

结构:简化 LSTM,合并细胞状态和隐藏状态,仅用更新门和重置门。

优势:

计算效率更高(参数更少)。

性能接近 LSTM(如语音识别任务)。

(4) Bidirectional RNN(双向 RNN)

结构:结合正向和反向 RNN,拼接双向隐藏状态。

优势:捕捉双向上下文信息(如自然语言处理中的前后文依赖)。

三、长短期记忆网络(LSTM)

LSTM是一种特殊的RNN,通过引入门控机制和细胞状态(Cell State),有效解决了传统RNN的梯度消失和长期依赖问题。

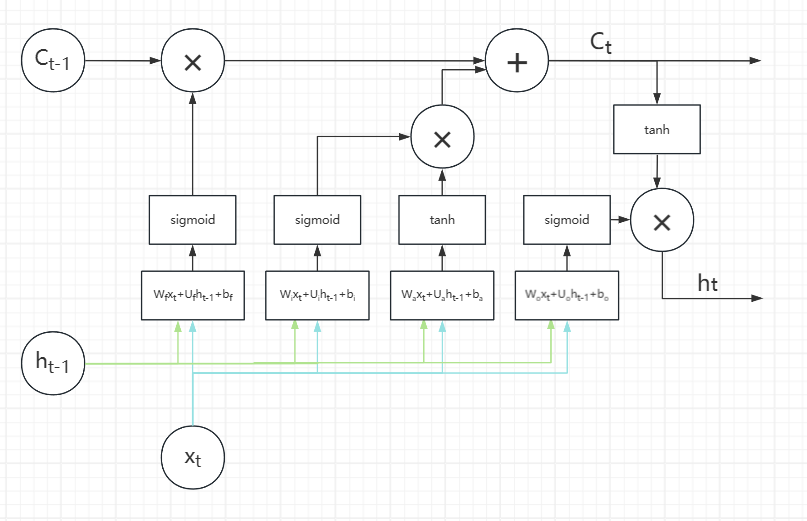

1、基本结构

(1)细胞状态(Cell State, C t C_t Ct)

贯穿整个序列的"信息高速公路",负责长期记忆的传递。通过加法更新(而非矩阵乘法)减少梯度消失风险。

(2)门控机制(Gates)

输入门(Input Gate, i t i_t it):控制当前输入信息有多少流入细胞状态。

遗忘门(Forget Gate, f t f_t ft):决定上一时刻细胞状态中有多少信息被保留或丢弃。

输出门(Output Gate, o t o_t ot):控制细胞状态中有多少信息输出到隐藏状态 h t h_t ht。

候选细胞状态(Candidate Cell State, C t ′ C^{'}_t Ct′)基于当前输入和上一时刻隐藏状态生成的临时新信息。

2、训练过程

(1) 训练目标

最小化损失函数:根据任务类型(如分类、回归、序列生成)定义损失函数 L(如交叉熵损失、均方误差)。

优化参数:所有时间步共享的权重矩阵 W f W_f Wf、 W i W_i Wi、 W C W_C WC、 W o W_o Wo和偏置项 b f b_f bf、 b i b_i bi、 b C b_C bC、 b o b_o bo。

(2)前向传播(Forward Pass)

对每个时间步 t(从 t=1 到 T):

- 计算遗忘门、输入门、候选细胞状态、输出门。

- 更新细胞状态。

- 计算隐藏状态。

- 根据任务计算输出 y t y_t yt(如分类任务中通过 softmax 层)和损失 L t L_t Lt。

(3)反向传播(Backward Pass, BPTT)

通过链式法则计算损失对各参数的梯度。由于LSTM的递归结构,梯度需从最后一个时间步 T 反向传播到 t=1。

- 初始化梯度:对 t = T t=T t=T,计算 ∂ L ∂ h T \frac{\partial L}{\partial h_T} ∂hT∂L和 ∂ L ∂ C T \frac{\partial L}{\partial C_T} ∂CT∂L。对其他时间步 t < T t<T t<T,梯度通过递归关系传播。

- 梯度计算。

- 门控梯度。

- 参数梯度。

- 参数更新:使用梯度下降(或其变体,如Adam、RMSProp)更新参数。

(4)关键挑战与解决方案

- 梯度消失/爆炸

问题:

BPTT中,梯度通过多个时间步的链式法则相乘,可能导致梯度指数级缩小或放大。

解决方案:

梯度裁剪(Gradient Clipping):限制梯度范数,防止爆炸。

门控机制:LSTM的遗忘门和输入门通过Sigmoid函数(输出 0,1)部分缓解梯度消失。

残差连接(Residual Connections):在深层LSTM中引入跳跃连接,辅助梯度流动。 - 长序列训练效率

问题:

BPTT需存储所有时间步的中间状态,内存消耗大。

解决方案:

截断时间反向传播(Truncated BPTT):将序列分成固定长度的片段,仅在片段内反向传播。

近似推理方法:如使用随机梯度变分推断(SGVB)近似梯度。 - 初始状态处理

问题:

初始隐藏状态 h 0 h_0 h0 和细胞状态 C 0 C_0 C0通常初始化为零,可能影响早期时间步的训练。

解决方案:

将 h 0 和 h_0和 h0和C_0$作为可学习参数。使用反向传播更新初始状态(需额外计算梯度)。

(5)应用场景

1) 自然语言处理(NLP)

LSTM通过捕捉上下文信息,有效处理语言中的长距离依赖问题,成为NLP任务的核心模型之一。

- 机器翻译

场景:

将一种语言的句子翻译为另一种语言(如英语→中文)。

应用:

早期序列到序列(Seq2Seq)模型使用LSTM作为编码器和解码器,处理变长输入输出。

例如:Google神经机器翻译(GNMT)系统曾基于LSTM构建,显著提升翻译质量。

优势:

LSTM的细胞状态可保留源语言的长距离语义信息,辅助目标语言生成。 - 文本生成

场景:、生成连贯的文本(如诗歌、新闻、代码)。

应用:

训练LSTM模型学习文本的统计规律,逐字符或逐词生成新内容。

例如:OpenAI的早期文本生成模型(如Char-RNN)使用LSTM堆叠实现长文本生成。

挑战:需结合注意力机制或Transformer改进长距离依赖问题。 - 情感分析

场景:

判断文本的情感倾向(如积极、消极)。

应用:

将句子输入LSTM,通过最终隐藏状态分类情感标签。

例如:分析电影评论的情感,或社交媒体帖子的情绪。

优势:

LSTM可捕捉否定词、转折词等对情感的关键影响。 - 命名实体识别(NER)

场景:识别文本中的实体(如人名、地名、组织名)。

应用:

使用LSTM+CRF(条件随机场)模型,结合序列标注任务。

例如:医疗文本中识别疾病名称或药物名称。

2) 时间序列预测

LSTM擅长处理具有时间依赖性的数据,如股票价格、传感器读数等。

- 股票价格预测

场景:

预测未来股价或市场趋势。

应用:

输入历史股价、交易量等数据,LSTM学习时间模式并预测未来值。

例如:使用多变量LSTM结合宏观经济指标预测股指。

挑战:金融市场受多种因素影响,模型需结合外部特征(如新闻情绪)。 - 能源消耗预测

场景:

预测家庭或工业的用电量、用水量。

应用:

输入历史消耗数据、天气、时间(如工作日/周末)等特征。

例如:智能电网中优化能源分配,降低峰值负荷。 - 交通流量预测

场景:

预测道路或地铁站的客流量。

应用:

结合历史流量、时间、天气、事件(如演唱会)等数据。

例如:滴滴出行用LSTM预测区域打车需求,动态调度车辆。 - 工业设备故障预测

场景:

通过传感器数据预测设备故障。

应用:

输入振动、温度等时序数据,LSTM检测异常模式。

例如:风电齿轮箱的剩余使用寿命(RUL)预测。

3) 语音处理

LSTM可处理语音信号的时序特性,应用于语音识别、合成等领域。

- 语音识别

场景:将语音转换为文本(如语音助手、字幕生成)。

应用:

早期系统(如DeepSpeech)使用LSTM+CTC(连接时序分类)模型。

例如:百度语音识别、苹果Siri的早期版本。

演进:现多被Transformer(如Conformer)取代,但LSTM仍用于轻量级场景。 - 语音合成(TTS)

场景:将文本转换为自然语音(如电子书朗读)。

应用:

Tacotron等模型使用LSTM生成梅尔频谱图,再通过声码器合成语音。

例如:谷歌WaveNet结合LSTM实现高质量语音合成。 - 说话人识别

场景:通过语音识别说话人身份。

应用:

输入语音特征(如MFCC),LSTM提取说话人特有的时序模式。

例如:智能门锁通过语音验证用户身份。

4)视频处理

LSTM可分析视频中的时序动态,应用于动作识别、视频描述生成等。

- 动作识别

场景:识别视频中的人体动作(如跑步、挥手)。

应用:

结合CNN提取帧特征,LSTM建模动作时序关系。

例如:Kinetics数据集上的动作分类任务。 - 视频描述生成

场景:为视频生成自然语言描述(如"一个人在踢足球")。

应用:

编码器-解码器结构:CNN编码视频帧,LSTM解码为文本。

例如:YouTube自动生成视频字幕。 - 视频异常检测

场景:检测视频中的异常事件(如打架、交通事故)。

应用:

输入正常视频训练LSTM,测试时检测偏离常规模式的行为。

例如:监控摄像头中的暴力行为识别。

5) 医学领域

LSTM可处理医疗时序数据,辅助诊断和预测。

- 电子健康记录(EHR)分析

场景:

预测患者疾病风险或住院时间。

应用:

输入患者历史就诊记录、实验室结果等时序数据。

例如:预测糖尿病患者未来30天再入院概率。 - 脑电信号(EEG)分类

场景:

识别脑电波中的异常模式(如癫痫发作)。

应用:

输入多通道EEG信号,LSTM检测发作前兆。

例如:可穿戴设备实时监测癫痫风险。 - 药物反应预测

场景:

预测患者对药物的反应(如疗效或副作用)。

应用:

结合患者基因组数据和用药历史,LSTM建模动态反应。

例如:个性化癌症治疗方案设计。

6) 其他领域

- 金融风控

场景:

检测信用卡欺诈或异常交易。

应用:

输入交易金额、时间、地点等时序数据,LSTM识别异常模式。

例如:PayPal的实时欺诈检测系统。 - 推荐系统

场景:

根据用户历史行为推荐商品或内容。

应用:

输入用户浏览、购买记录,LSTM预测未来兴趣。

例如:亚马逊的"猜你喜欢"功能。 - 机器人控制

场景:

让机器人学习时序依赖的动作策略。

应用:

输入传感器数据(如关节角度),LSTM输出控制指令。

例如:波士顿动力的Atlas机器人学习后空翻。

3、变种类型

(1)Peephole LSTM

允许门控单元"窥视"细胞状态(即门控计算中加入

C t − 1 C_{t-1} Ct−1)。

(2)GRU(Gated Recurrent Unit)

简化版LSTM,合并细胞状态和隐藏状态,仅保留更新门和重置门。参数更少,计算效率更高。

(3)双向LSTM(BiLSTM)

结合正向和反向LSTM,同时捕捉过去和未来的上下文信息。