1. 项目说明与整体架构

1.1 项目说明

本项目是一套基于 C++17 开发的工业级跨厂商大模型接入 SDK + 完整前后端对话系统,从底层大模型 API 适配、数据持久化、会话全生命周期管理,到上层 HTTP 服务封装、前端交互落地,形成了完整的端到端业务闭环。项目全程遵循面向对象设计原则与工业级 C++ 开发规范,兼顾了扩展性、稳定性、并发性能与可维护性,同时配套完整的测试体系与部署方案,既可以作为 SDK 嵌入业务系统,也可以直接部署为独立的对话服务使用。

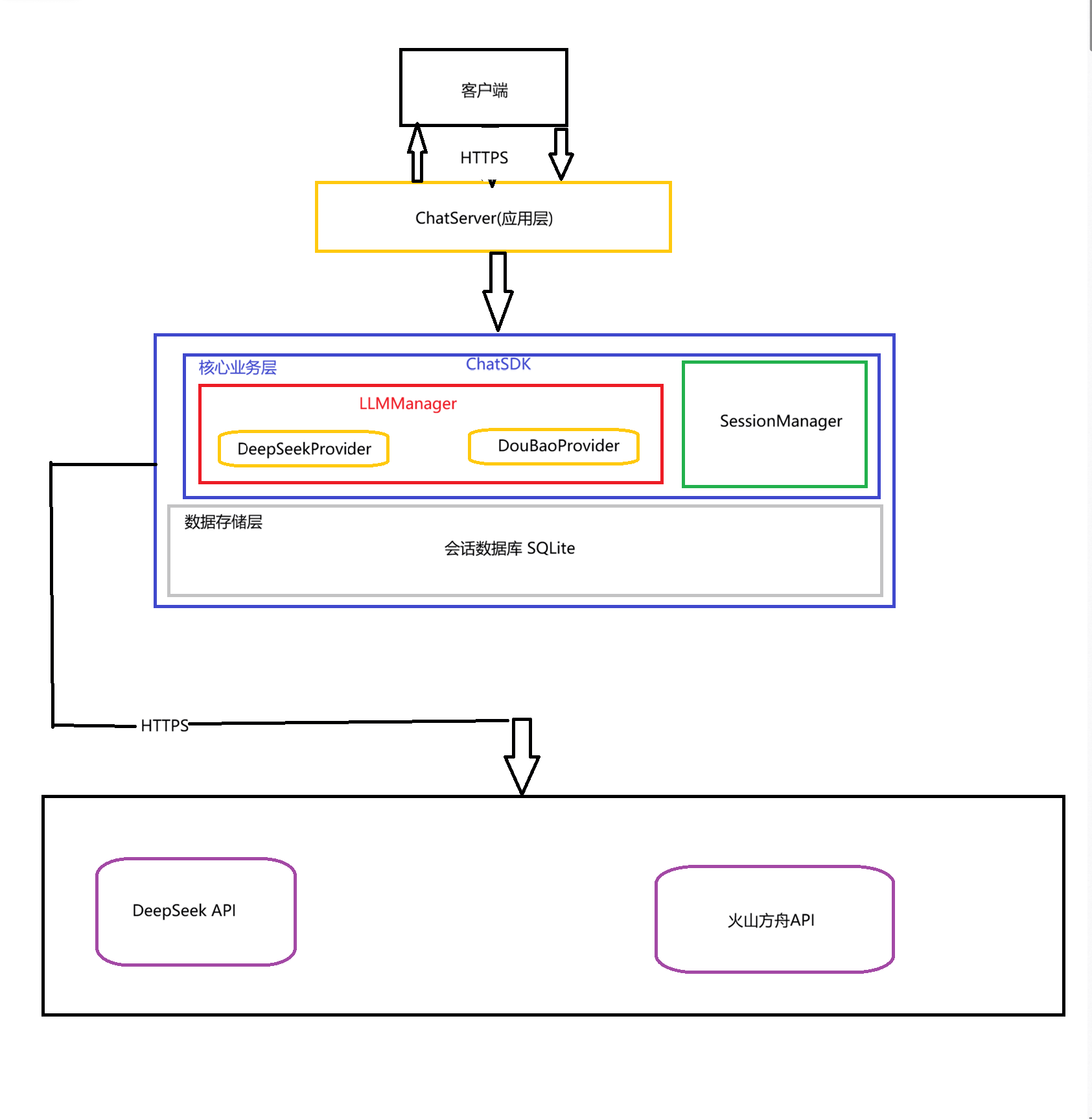

1.2 项目结构图

1.3 实现思路

- 分层设计:采用四层解耦模块化架构,落地门面 + 策略模式,层间职责单一,支持新厂商无侵入扩展,严格遵循开闭原则。

- 核心实现:基于 C++17 实现跨厂商大模型接入、会话管理等核心能力,通过双层存储、细化锁控、RAII 机制优化性能与内存安全。

- 全链路流程:覆盖 SDK 初始化到会话管理全场景,形成端到端闭环,极简接口屏蔽底层差异,大幅降低大模型接入成本。

- 稳定性保障:通过全链路校验、幂等设计、异常兜底保障运行稳定,基于配置驱动与模块化设计保障项目可扩展、可维护、易测试。

2. SDK层的实现(本项目核心)

2.1 接口定义层

2.1.1 common.h

这个文件是整个项目的根基,定义了所有模块共用的数据结构以及类型规范,设计核心是:用最精简的结构,承载全链路的核心数据,同时保证扩展性。

代码总览

cpp

#pragma once

#include <string>

#include <ctime>

#include <vector>

namespace ai_chat_sdk

{

// 消息结构

struct Message

{

std::string _messageId; // 消息ID

std::string _role; // 角色,如user、assistant等

std::string _content; // 消息内容

std::time_t _timestamp; // 消息发送时间戳

// 构造函数

Message(const std::string &role = "", const std::string &content = "")

: _role(role), _content(content), _timestamp(0)

{

}

};

// 模型的公共配置信息

struct Config

{

std::string _modelName; // 模型名称

double _temperature = 0.7; // 温度参数,用于控制生成文本的随机性

int _maxTokens = 2048; // 最大生成令牌数

virtual ~Config() = default; // 添加虚函数主要是为了实现:向下转型时的安全性

};

// 通过API方式接入云端模型

struct APIConfig : public Config

{

std::string _apiKey; // API密钥

std::string _endpoint; // 【新增】模型API基础地址(可选,不填则使用Provider默认地址)

};

// LLM信息

struct ModelInfo

{

std::string _modelName; // 模型名称

std::string _modelDesc; // 模型描述

std::string _provider; // 模型提供者

std::string _endpoint; // 模型API endpoint base url

bool _isAvailable = false; // 模型是否可用

ModelInfo(const std::string &modelName = "", const std::string &modelDesc = "", const std::string &provider = "", const std::string &endpoint = "")

: _modelName(modelName), _modelDesc(modelDesc), _provider(provider), _endpoint(endpoint)

{

}

};

// 会话信息

struct Session

{

std::string _sessionId; // 会话ID

std::string _modelName; // 会话使用的模型名称

std::vector<Message> _messages; // 会话中的消息列表

std::time_t _createdAt; // 会话创建时间戳

std::time_t _updatedAt; // 会话最后更新时间戳

// 构造函数

Session(const std::string &modelName = "")

: _modelName(modelName)

{

}

};

} // end ai_chat_sdk1. Message 结构体:对话消息的最小单元

cpp

struct Message

{

std::string _messageId; // 消息ID

std::string _role; // 角色,如user、assistant等

std::string _content; // 消息内容

std::time_t _timestamp; // 消息发送时间戳

// 构造函数

Message(const std::string &role = "", const std::string &content = "")

: _role(role), _content(content), _timestamp(0)

{

}

};设计思路:

_role(角色)、_content(内容)字段是主流大模型API的通用字段,保证了数据结构的通用性,后续新增厂商无需修改消息结构。_messageId(消息唯一 ID)、_timestamp(时间戳)是业务层常用的扩展字段,用于消息追踪、会话历史排序、数据持久化,虽然当前可能没完全用到,但提前预留了扩展性。。- 提供了带默认参数的构造函数,既可以方便地创建空消息,也可以快速初始化

role和content,提升开发效率。

2. Config 与 APIConfig:配置的分层设计,支持多类型模型接入

cpp

// 模型的公共配置信息

struct Config

{

std::string _modelName; // 模型名称

double _temperature = 0.7; // 温度参数,用于控制生成文本的随机性

int _maxTokens = 2048; // 最大生成令牌数

virtual ~Config() = default; // 添加虚函数主要是为了实现:向下转型时的安全性

};

// 通过API方式接入云端模型

struct APIConfig : public Config

{

std::string _apiKey; // API密钥

std::string _endpoint; // 【新增】模型API基础地址(可选,不填则使用Provider默认地址)

};设计思路:

1. 分层继承设计,支持多类型模型扩展:基类Config定义了所有模型通用的核心配置,子类APIConfig专门针对云端API模型,扩展了_apikey、_endpoint两个成员变量。

2. 虚函数的关键作用:这里将基类Config中的析构函数设计为虚函数 ,就是为了当使用基类指针删除子类对象的时候,能够正确地调用子类的析构函数,以避免内存泄漏的问题。

3. ModelInfo 结构体:对外暴露的模型信息

cpp

struct ModelInfo

{

std::string _modelName; // 模型名称

std::string _modelDesc; // 模型描述

std::string _provider; // 模型提供者

std::string _endpoint; // 模型API endpoint base url

bool _isAvailable = false; // 模型是否可用

ModelInfo(const std::string &modelName = "", const std::string &modelDesc = "", const std::string &provider = "", const std::string &endpoint = "")

: _modelName(modelName), _modelDesc(modelDesc), _provider(provider), _endpoint(endpoint)

{

}

};设计思路:

**1. 面向调用方的信息封装:**这个结构体式专门给SDK调用方看的,让调用方知道模型的具体信息,而不需要暴露内部的Config等敏感信息。

**2. _isAvailable状态管理:**标记模型是否可用(比如初始化失败、API Key 无效时设为 false),调用方可以根据这个字段做容错处理。

4. Session 结构体:会话的完整生命周期数据

设计思路:

1. 会话的核心数据承载:

_sessionId:会话的唯一标识,用于创建、获取、删除会话,是调用方操作会话的 "句柄"。

_modelName:会话绑定的模型,保证同一个会话里的所有消息都用同一个模型处理,避免模型切换导致的上下文混乱。

_messages:完整的对话历史,是实现多轮对话的核心 ------ 每次发送新消息时,会把历史消息一起发给大模型,保证上下文连贯性。

2. 时间戳的业务价值

_createdAt、_updatedAt用于会话列表的排序、会话的生命周期管理(比如清理长期未使用的会话),也是数据持久化时的必要字段。

2.1.2 LLMProvider.h

这是整个 SDK扩展性设计的灵魂,用抽象基类定义了所有大模型厂商的统一接口规范,不同厂商只需要实现这个接口,就能无缝接入 SDK,完全符合开闭原则(对扩展开放,对修改关闭)。

代码总览

cpp

#pragma once

#include <functional>

#include <string>

#include <map>

#include <vector>

#include "common.h"

namespace ai_chat_sdk

{

// LLMProvider 类(抽象类)

class LLMProvider

{

public:

// 初始化模型

virtual bool initModel(const std::map<std::string, std::string> &modelConfig) = 0;

// 检测模型是否有效

virtual bool isAvailable() const = 0;

// 获取模型名称

virtual std::string getModelName() const = 0;

// 获取模型描述

virtual std::string getModelDesc() const = 0;

// 发送消息 - 全量返回

virtual std::string sendMessage(const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam) = 0;

// 发送消息 - 增量返回 - 流式响应

virtual std::string sendMessageStream(const std::vector<Message> &messages,

const std::map<std::string, std::string> &requestParam,

std::function<void(const std::string &, bool)> callback) = 0; // callback: 对模型返回的增量数据如何处理,第一个参数为增量数据,第二个参数为是否为最后一个增量数据

protected:

bool _isAvailable = false; // 标记模型是否有效

std::string _apiKey; // API密钥

std::string _endpoint; // 模型API endpoint base url

};

} // end ai_chat_sdk抽象基类的核心设计

cpp

class LLMProvider

{

public:

// 初始化模型

virtual bool initModel(const std::map<std::string, std::string> &modelConfig) = 0;

// 检测模型是否有效

virtual bool isAvailable() const = 0;

// 获取模型名称

virtual std::string getModelName() const = 0;

// 获取模型描述

virtual std::string getModelDesc() const = 0;

// 发送消息 - 全量返回

virtual std::string sendMessage(const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam) = 0;

// 发送消息 - 增量返回 - 流式响应

virtual std::string sendMessageStream(const std::vector<Message> &messages,

const std::map<std::string, std::string> &requestParam,

std::function<void(const std::string &, bool)> callback) = 0;

protected:

bool _isAvailable = false; // 标记模型是否有效

std::string _apiKey; // API密钥

std::string _endpoint; // 模型API endpoint base url

};设计思路与相关亮点

1. 为什么用抽象基类(纯虚函数),而不是普通基类?

这里其实就是策略模式的核心所在了,LLManager是一个规范定义者,而不是一个具体实现者,这里设计所有函数都是纯虚函数就是为了让子类去实现这些函数接口,否则无法实例化,所以这就是在语法层面上保证了规范的强制执行,避免遗漏实现。

2. 接口设计的统一性:屏蔽厂商差异,对内提供一致体验

所有接口的参数和返回值都是统一的,上层调用方只需要和LLMProvider抽象基类交互,不需要知道底层是豆包、DeepSeek 还是其他厂商,完全解耦。

3. 流式返回的核心设计

sendMessageStream的第三个参数std::function<void(const std::string &, bool)> callback,是实现流式对话的关键:

这里就有一个问题,为什么不是直接返回,而必须使用回调机制呢?

这里关键就在于我们需要实现的是流式返回,流式返回是边生成边返回,不是一次性返回完整结果,用回调函数可以在每收到一段增量数据的时候,就立即通知上层处理,而不需要等待完整结果的生成,大大提升了用户体验。

回调参数的设计:第一个参数表示增量数据("你好"、"我是"、"豆包"),第二个参数bool是"是否为最后一段数据",上层可以根据这个标志判断流式返回是否结束,做收尾处理。

2.1.3 ChatSDK.h

这是SDK对外暴露的唯一统一接口,用门面模式吧内部所有复杂的模块封装起来,对外只提供极简的接口,让调用方"用最少的代码,就能完成所有操作"。

代码总览

cpp

#pragma once

#include <memory>

#include <string>

#include <map>

#include <vector>

#include <functional>

#include <unordered_map>

#include "LLMManager.h"

#include "SessionManager.h"

#include "common.h"

namespace ai_chat_sdk {

// ChatSDK 类

class ChatSDK {

public:

// 初始化模型

bool initModels(const std::vector<std::shared_ptr<Config>>& configs);

// 创建会话

std::string createSession(const std::string& modelName);

// 获取指定会话

std::shared_ptr<Session> getSession(const std::string& sessionId);

// 获取所有会话列表

std::vector<std::string> getSessionLists() const;

// 删除指定会话

bool deleteSession(const std::string& sessionId);

// 获取可用的模型信息

std::vector<ModelInfo> getAvailableModels() const;

// 发送消息 - 全量返回

std::string sendMessage(const std::string& sessionId, const std::string& message);

// 发送消息 - 流式返回

std::string sendMessageStream(

const std::string& sessionId,

const std::string& message,

std::function<void(const std::string&, bool)> callback);

private:

// 注册支持的模型(改成无参数)

void registerAllProvider();

// 初始化模型

void initProviders(const std::vector<std::shared_ptr<Config>>& configs);

// 初始化 API 模型

bool initAPIModelProviders(

const std::string& modelName,

const std::shared_ptr<APIConfig>& apiConfig);

private:

bool _initialized = false;

// key: 模型名 value: 配置

std::unordered_map<std::string, std::shared_ptr<Config>> _modelConfigs;

LLMManager _llmManager;

public:

SessionManager _sessionManager;

};

} // namespace ai_chat_sdk门面模式的核心设计:对外极简,对内复杂

cpp

class ChatSDK {

public:

// 初始化模型

bool initModels(const std::vector<std::shared_ptr<Config>>& configs);

// 创建会话

std::string createSession(const std::string& modelName);

// 获取指定会话

std::shared_ptr<Session> getSession(const std::string& sessionId);

// 获取所有会话列表

std::vector<std::string> getSessionLists() const;

// 删除指定会话

bool deleteSession(const std::string& sessionId);

// 获取可用的模型信息

std::vector<ModelInfo> getAvailableModels() const;

// 发送消息 - 全量返回

std::string sendMessage(const std::string& sessionId, const std::string& message);

// 发送消息 - 流式返回

std::string sendMessageStream(

const std::string& sessionId,

const std::string& message,

std::function<void(const std::string&, bool)> callback);

private:

// 注册支持的模型(改成无参数)

void registerAllProvider();

// 初始化模型

void initProviders(const std::vector<std::shared_ptr<Config>>& configs);

// 初始化 API 模型

bool initAPIModelProviders(

const std::string& modelName,

const std::shared_ptr<APIConfig>& apiConfig);

private:

bool _initialized = false;

// key: 模型名 value: 配置

std::unordered_map<std::string, std::shared_ptr<Config>> _modelConfigs;

LLMManager _llmManager;

public:

SessionManager _sessionManager;

};设计思路与相关亮点

1. 门面模式的应用:为什么需要这个类?

如果没有ChatSDK,调用方需要直接与LLManager、SessionManager、多个LLMProvider子类进行交互,这样一来,使用门槛就会提高很多。

而ChatSDK作为门面,可以屏蔽底层的复杂逻辑,调用方只需要:

调用initModels初始化模型。

调用createSession创建会话。

调用sendMessage或sendMessageStream发送消息。

三步就可以完成完整的对话,大大降低了使用的门槛,这就是门面模式的核心价值。

2. public 接口的设计:完全贴合调用方的使用流程

初始化阶段:initModels(初始化所有配置的模型)、getAvailableModels(查询有哪些模型可用)。

会话管理阶段:createSession(创建会话)、getSession(获取会话)、getSessionLists(获取所有会话)、deleteSession(删除会话)。

sendMessage(全量返回)、sendMessageStream(流式返回)。

3. private 成员函数的设计:内部逻辑的封装与解耦

registerAllProvider、initProviders、initAPIModelProviders是内部实现细节,对外隐藏,保证了接口的稳定性 ------ 后续内部初始化逻辑变了,只要 public 接口不变,调用方的代码就不需要修改。

同时,这三个函数的职责拆分也很清晰:

registerAllProvider:注册所有支持的厂商Provider,这里就是DeepSeek和豆包,这个函数会把这两个Provider注册到LLManager中。

initProviders:遍历调用方传入的配置,逐个初始化对应的 Provider。

initAPIModelProviders:专门初始化 API 类型的模型,和后续可能的本地模型初始化逻辑解耦,这里说明一下,受限于硬件条件,本项目没有接入本地模型。

4. 成员变量的设计:核心模块的组合与状态管理

_initialized:初始化状态标志,防止重复初始化,保证SDK的状态安全。

_modelConfigs:用unorder_map来存储模型名到配置信息的映射,可以快速查找某个模型的配置,哈希表的查询效率是O(1)。

_llmManager:大模型管理模块,负责管理所有 Provider 的生命周期、请求分发。

_sessionManager:会话管理模块,负责会话的创建、获取、删除、历史消息维护。

注意:这里用的组合而不是继承,这是一个比较关键的思路,也符合"优先使用组合而不是继承"的设计原则,让ChatSDK可以灵活地组合不同的管理模块,避免了被继承关系所束缚。

小结

我们把这三个文件串起来,理清楚整个 SDK 的核心交互链路:

调用方传入Config配置->ChatSDK::initModels->内部调用LLMManager初始化对应的LLMProvider子类。

调用方调用ChatSDK::createSession->内部调用SessionManager创建会话,返回sessionId。

调用方调用ChatSDK::sendMessage->内部通过sessionId从SessionManager获取会话历史->调用LLMManager分发请求给对应的LLMProvider->返回结果给调用方。

2.2 核心实现层

2.2.1 ChatSDK.cpp

整体代码结构概览:

cpp

#include "../include/ChatSDK.h"

#include "../include/DeepSeekProvider.h"

#include "../include/DouBaoProvider.h"

#include "../include/util/myLog.h"

#include <memory>

namespace ai_chat_sdk {

// =============================

// 初始化模型

// =============================

bool ChatSDK::initModels(const std::vector<std::shared_ptr<Config>>& configs)

{

if (configs.empty()) {

ERR("ChatSDK::initModels: configs 为空,初始化失败");

return false;

}

registerAllProvider();

initProviders(configs);

_initialized = true;

return true;

}

// =============================

// 注册 Provider(只做一次)

// =============================

void ChatSDK::registerAllProvider()

{

// DeepSeek

if (!_llmManager.isModelAvailable("deepseek-chat")) {

auto deepseekProvider = std::make_unique<DeepSeekProvider>();

_llmManager.registerProvider("deepseek-chat", std::move(deepseekProvider));

INFO("deepseek-chat provider registered succeeded");

}

// DouBao

if (!_llmManager.isModelAvailable("doubao-seed-2-0-lite-260215")) {

auto doubaoProvider = std::make_unique<DouBaoProvider>();

_llmManager.registerProvider("doubao-seed-2-0-lite-260215", std::move(doubaoProvider));

INFO("doubao-seed-2-0-lite provider registered succeeded");

}

}

// =============================

// 初始化 Provider

// =============================

void ChatSDK::initProviders(const std::vector<std::shared_ptr<Config>>& configs)

{

for (const auto& config : configs)

{

if (!config) {

WARN("ChatSDK::initProviders: 跳过空的配置指针");

continue;

}

if (config->_modelName.empty()) {

WARN("ChatSDK::initProviders: 跳过模型名为空的配置");

continue;

}

auto apiConfig = std::dynamic_pointer_cast<APIConfig>(config);

if (!apiConfig) {

ERR("Config for model {} is not APIConfig", config->_modelName);

continue;

}

if (apiConfig->_modelName != "deepseek-chat" &&

apiConfig->_modelName != "doubao-seed-2-0-lite-260215") {

ERR("Model {} is not supported", apiConfig->_modelName);

continue;

}

initAPIModelProviders(apiConfig->_modelName, apiConfig);

}

}

// =============================

// 初始化 API 模型

// =============================

bool ChatSDK::initAPIModelProviders(const std::string& modelName,

const std::shared_ptr<APIConfig>& apiConfig)

{

if (modelName.empty()) {

ERR("ChatSDK::initAPIModelProviders: modelName is empty");

return false;

}

if (!apiConfig || apiConfig->_apiKey.empty()) {

ERR("ChatSDK::initAPIModelProviders: apiKey is empty");

return false;

}

if (_modelConfigs.find(modelName) != _modelConfigs.end()) {

INFO("Model {} already initialized", modelName);

return true;

}

std::map<std::string, std::string> modelParams;

modelParams["api_key"] = apiConfig->_apiKey;

modelParams["endpoint_id"] = "ep-m-20260218004248-cf9qd";

if (!apiConfig->_endpoint.empty()) {

modelParams["endpoint"] = apiConfig->_endpoint;

}

if (!_llmManager.initModel(modelName, modelParams)) {

ERR("Init model {} failed", modelName);

return false;

}

_modelConfigs[modelName] = apiConfig;

INFO("Model {} init succeeded", modelName);

return true;

}

// =============================

// 创建会话

// =============================

std::string ChatSDK::createSession(const std::string& modelName)

{

if (!_initialized) {

ERR("SDK not initialized");

return "";

}

if (modelName.empty()) {

ERR("modelName is empty");

return "";

}

return _sessionManager.createSession(modelName);

}

// =============================

// 获取会话

// =============================

std::shared_ptr<Session> ChatSDK::getSession(const std::string& sessionId)

{

if (!_initialized || sessionId.empty())

return nullptr;

return _sessionManager.getSession(sessionId);

}

// =============================

// 删除会话

// =============================

bool ChatSDK::deleteSession(const std::string& sessionId)

{

if (!_initialized || sessionId.empty())

return false;

return _sessionManager.deleteSession(sessionId);

}

// =============================

// 会话列表

// =============================

std::vector<std::string> ChatSDK::getSessionLists() const

{

if (!_initialized)

return {};

return _sessionManager.getSessionLists();

}

// =============================

// 可用模型

// =============================

std::vector<ModelInfo> ChatSDK::getAvailableModels() const

{

return _llmManager.getAvailableModels();

}

// =============================

// 普通发送

// =============================

std::string ChatSDK::sendMessage(const std::string& sessionId,

const std::string& message)

{

if (!_initialized || sessionId.empty() || message.empty())

return "";

auto session = _sessionManager.getSession(sessionId);

if (!session)

return "";

Message userMsg("user", message);

_sessionManager.addMessage(sessionId, userMsg);

auto history = _sessionManager.getHistroyMessages(sessionId);

auto it = _modelConfigs.find(session->_modelName);

if (it == _modelConfigs.end())

return "";

std::map<std::string, std::string> requestParam;

requestParam["temperature"] = std::to_string(it->second->_temperature);

requestParam["max_tokens"] = std::to_string(it->second->_maxTokens);

auto response = _llmManager.sendMessage(session->_modelName,

history,

requestParam);

if (response.empty())

return "";

Message assistantMsg("assistant", response);

_sessionManager.addMessage(sessionId, assistantMsg);

_sessionManager.updateSessionTimestamp(sessionId);

return response;

}

// =============================

// 流式发送

// =============================

std::string ChatSDK::sendMessageStream(

const std::string& sessionId,

const std::string& message,

std::function<void(const std::string&, bool)> callback)

{

if (!_initialized || sessionId.empty() || message.empty())

return "";

auto session = _sessionManager.getSession(sessionId);

if (!session)

return "";

Message userMsg("user", message);

_sessionManager.addMessage(sessionId, userMsg);

auto history = _sessionManager.getHistroyMessages(sessionId);

auto it = _modelConfigs.find(session->_modelName);

if (it == _modelConfigs.end())

return "";

std::map<std::string, std::string> requestParam;

requestParam["temperature"] = std::to_string(it->second->_temperature);

requestParam["max_tokens"] = std::to_string(it->second->_maxTokens);

auto response = _llmManager.sendMessageStream(

session->_modelName,

history,

requestParam,

callback);

// 只存储有效的助手回复(非空且不包含错误关键词)

if (!response.empty() &&

response.find("error") == std::string::npos &&

response != "(模型返回空回复)") {

Message assistantMsg("assistant", response);

_sessionManager.addMessage(sessionId, assistantMsg);

_sessionManager.updateSessionTimestamp(sessionId);

} else {

WARN("ChatSDK: 丢弃无效的助手回复: {}", response);

}

return response;

}

} // namespace ai_chat_sdk这部分按照功能可以分为4个核心模块:

- **初始化模块:**initModels、registerAllProvider、initProviders、initAPIModelProviders

- **会话管理模块:**createSession、getSession、deleteSession、getSessionLists

- **对话交互模块:**sendMessage(全量)、sendMessageStream(流式)

- **辅助查询模块:**getAvailableModels

下面我们来依次分析每个模块;

初始化模块:SDK 的启动流程,工程化细节的集中体现

设计思路:

1. initModels:对外统一初始化入口

cpp

bool ChatSDK::initModels(const std::vector<std::shared_ptr<Config>>& configs)

{

// 【工程化亮点1:前置参数校验】

// 入口处先做最基础的参数检查,快速失败,避免后续无效逻辑

if (configs.empty()) {

ERR("ChatSDK::initModels: configs 为空,初始化失败"); // 【工程化亮点2:日志分级记录】

return false;

}

// 【内部调用1:注册所有支持的厂商Provider】

registerAllProvider();

// 【内部调用2:根据配置初始化对应模型】

initProviders(configs);

// 【工程化亮点3:状态标记】

_initialized = true;

return true;

}这里涉及了前置参数的校验,是防御性编程的核心思想,将错误的参数在函数入口处就被拦截;其次就是日志分级,这里项目中统一封装了日志功能,出问题时便于快速检索问题。

2. registerAllProvider:注册所有支持的厂商(策略模式的落地)

cpp

void ChatSDK::registerAllProvider()

{

// DeepSeek 注册

// 【工程化亮点1:幂等性检查】

// 先检查模型是否已经注册过,避免重复注册,保证函数的幂等性

if (!_llmManager.isModelAvailable("deepseek-chat")) {

// 【工程化亮点2:智能指针 + 移动语义】

// 1. 用 std::make_unique 创建独占智能指针,自动管理内存,避免内存泄漏

auto deepseekProvider = std::make_unique<DeepSeekProvider>();

// 2. 用 std::move 把智能指针的所有权转移给 LLMManager,避免拷贝,提升性能

_llmManager.registerProvider("deepseek-chat", std::move(deepseekProvider));

INFO("deepseek-chat provider registered succeeded");

}

// DouBao 注册(逻辑完全一致)

if (!_llmManager.isModelAvailable("doubao-seed-2-0-lite-260215")) {

auto doubaoProvider = std::make_unique<DouBaoProvider>();

_llmManager.registerProvider("doubao-seed-2-0-lite-260215", std::move(doubaoProvider));

INFO("doubao-seed-2-0-lite provider registered succeeded");

}

}- 函数幂等性检查

这里做幂等性检查,就是为了防止调用方重复调用initModels,导致重复注册 Provider,浪费内存,甚至出现状态混乱。

- unique_ptr+move的常见组合

首先是unique_ptr,它是独占智能指针,是RAII(资源获取即初始化)的典型应用,可以很好地避免内存泄漏的问题,同一时间智能有一个unique_ptr指向同一个对象,避免了多个指针共享所有权带来的混乱。

其次就是move函数的使用,它的作用在于告诉编译器,某个资源是可以被移动的,因为unique_ptr是禁止拷贝的,所以这里只能进行所有权的转移,移动语义只转移对象的 "控制权"(比如指针的指向),不存在任何拷贝,效率是非常理想的。

3. initProviders:遍历配置,逐个初始化模型

cpp

void ChatSDK::initProviders(const std::vector<std::shared_ptr<Config>>& configs)

{

// 遍历调用方传入的所有配置

for (const auto& config : configs)

{

// 【工程化亮点1:多层级的参数校验】

// 每一步都做检查,跳过无效配置,保证程序的健壮性

if (!config) {

WARN("ChatSDK::initProviders: 跳过空的配置指针");

continue;

}

if (config->_modelName.empty()) {

WARN("ChatSDK::initProviders: 跳过模型名为空的配置");

continue;

}

// 【核心:安全的向下转型】

// 用 std::dynamic_pointer_cast 把基类 Config 安全地向下转型为子类 APIConfig

auto apiConfig = std::dynamic_pointer_cast<APIConfig>(config);

if (!apiConfig) {

ERR("Config for model {} is not APIConfig", config->_modelName);

continue;

}

// 【工程化亮点2:白名单校验】

// 只支持注册过的模型,避免非法模型名,保证安全性

if (apiConfig->_modelName != "deepseek-chat" &&

apiConfig->_modelName != "doubao-seed-2-0-lite-260215") {

ERR("Model {} is not supported", apiConfig->_modelName);

continue;

}

// 【内部调用:初始化具体的API模型】

initAPIModelProviders(apiConfig->_modelName, apiConfig);

}

}这里值得注意的一个点就是std::dynamic_pointer_cast的使用,这是C++智能指针的安全向下转型工具,它会在运行时检查类型是否匹配,如果匹配则返回转型后的智能指针;否则返回nullptr,整体是很安全的。

4. initAPIModelProviders:初始化具体的 API 模型

cpp

bool ChatSDK::initAPIModelProviders(const std::string& modelName,

const std::shared_ptr<APIConfig>& apiConfig)

{

// 【工程化亮点:继续前置参数校验】

if (modelName.empty()) {

ERR("ChatSDK::initAPIModelProviders: modelName is empty");

return false;

}

if (!apiConfig || apiConfig->_apiKey.empty()) {

ERR("ChatSDK::initAPIModelProviders: apiKey is empty");

return false;

}

// 【幂等性检查:避免重复初始化同一个模型】

if (_modelConfigs.find(modelName) != _modelConfigs.end()) {

INFO("Model {} already initialized", modelName);

return true;

}

// 【核心:把结构化的APIConfig,转成Provider需要的map格式】

// 这里是为了适配LLMProvider::initModel的接口(用map传递配置,更灵活)

std::map<std::string, std::string> modelParams;

modelParams["api_key"] = apiConfig->_apiKey;

modelParams["endpoint_id"] = "ep-m-20260218004248-cf9qd"; // 豆包的endpoint_id

// 【扩展性设计:支持自定义endpoint】

// 如果调用方传了自定义的endpoint,就用调用方的;否则用Provider的默认值

if (!apiConfig->_endpoint.empty()) {

modelParams["endpoint"] = apiConfig->_endpoint;

}

// 【内部调用:让LLMManager完成具体的模型初始化】

if (!_llmManager.initModel(modelName, modelParams)) {

ERR("Init model {} failed", modelName);

return false;

}

// 【核心:缓存模型配置,方便后续快速查找】

// 用std::unordered_map存储,查找时间复杂度O(1)

_modelConfigs[modelName] = apiConfig;

INFO("Model {} init succeeded", modelName);

return true;

}- 为什么要把APIConfig转成std::map<std::string, std::string>?

这里是为了灵活性与扩展性,如果后续有新的厂商,那么直接添加键值对即可,不需要修改LLMProvider的接口,符合开闭原则。

会话管理模块:门面模式的典型应用,完全复用 SessionManager 的能力

核心代码示例:

cpp

// 创建会话

std::string ChatSDK::createSession(const std::string& modelName)

{

// 【工程化亮点:所有接口都先检查初始化状态】

if (!_initialized) {

ERR("SDK not initialized");

return "";

}

if (modelName.empty()) {

ERR("modelName is empty");

return "";

}

// 【内部调用:直接复用SessionManager的能力】

return _sessionManager.createSession(modelName);

}

// 发送消息(全量)里的会话操作

std::string ChatSDK::sendMessage(const std::string& sessionId, const std::string& message)

{

// 前置校验

if (!_initialized || sessionId.empty() || message.empty())

return "";

// 【内部调用1:获取会话】

auto session = _sessionManager.getSession(sessionId);

if (!session)

return "";

// 【内部调用2:添加用户消息到会话历史】

Message userMsg("user", message);

_sessionManager.addMessage(sessionId, userMsg);

// 【内部调用3:获取完整的历史消息】

auto history = _sessionManager.getHistroyMessages(sessionId);

// ... 中间是LLM调用逻辑 ...

// 【内部调用4:添加助手回复到会话历史】

Message assistantMsg("assistant", response);

_sessionManager.addMessage(sessionId, assistantMsg);

// 【内部调用5:更新会话的最后活跃时间】

_sessionManager.updateSessionTimestamp(sessionId);

return response;

}这部分代码非常简洁诶,完全体现了门面模式与组合的核心价值:ChatSDK不会去做会话管理的逻辑,只是**做前置状态检查,**然后直接调用_sessionManager的方法,对外提供统一的入口。

设计思路总结:

ChatSDK在会话管理上,完全是一个"转发者+校验者"的角色:

先做统一的前置校验,然后调用_sessionManager封装好的方法,完成具体的对话操作,对外只暴露自己的极简接口,完全屏蔽了SessionManager的存在。

对话交互模块:全链路的核心,组合两个管理模块的能力

这是SDK对外提供的核心能力,代码逻辑是比较清晰的,完全体现了组合的思想:ChatSDK组合了SessionManager和LLMManager的能力,完成端到端的对话。

1. sendMessage:全量返回(非流式)

cpp

std::string ChatSDK::sendMessage(const std::string& sessionId, const std::string& message)

{

// 【步骤1:前置统一校验】

if (!_initialized || sessionId.empty() || message.empty())

return "";

// 【步骤2:从SessionManager获取会话和历史消息】

auto session = _sessionManager.getSession(sessionId);

if (!session)

return "";

// 【步骤3:把用户的新消息加入会话历史】

Message userMsg("user", message);

_sessionManager.addMessage(sessionId, userMsg);

// 【步骤4:获取完整的对话历史,用于多轮对话】

auto history = _sessionManager.getHistroyMessages(sessionId);

// 【步骤5:从缓存里获取模型的配置(temperature、max_tokens)】

auto it = _modelConfigs.find(session->_modelName);

if (it == _modelConfigs.end())

return "";

// 【步骤6:把结构化配置转成map,适配LLMProvider的接口】

std::map<std::string, std::string> requestParam;

requestParam["temperature"] = std::to_string(it->second->_temperature);

requestParam["max_tokens"] = std::to_string(it->second->_maxTokens);

// 【步骤7:内部调用LLMManager,分发请求给对应厂商】

auto response = _llmManager.sendMessage(session->_modelName, history, requestParam);

// 【步骤8:把大模型的回复加入会话历史,更新上下文】

if (response.empty())

return "";

Message assistantMsg("assistant", response);

_sessionManager.addMessage(sessionId, assistantMsg);

_sessionManager.updateSessionTimestamp(sessionId);

// 【步骤9:返回结果给调用方】

return response;

}2. sendMessageStream:流式返回(核心亮点在于对大模型特性的理解)

cpp

std::string ChatSDK::sendMessageStream(

const std::string& sessionId,

const std::string& message,

std::function<void(const std::string&, bool)> callback)

{

// 【步骤1-7:和全量返回完全一致,前置校验、获取历史、准备参数】

if (!_initialized || sessionId.empty() || message.empty())

return "";

auto session = _sessionManager.getSession(sessionId);

if (!session)

return "";

Message userMsg("user", message);

_sessionManager.addMessage(sessionId, userMsg);

auto history = _sessionManager.getHistroyMessages(sessionId);

auto it = _modelConfigs.find(session->_modelName);

if (it == _modelConfigs.end())

return "";

std::map<std::string, std::string> requestParam;

requestParam["temperature"] = std::to_string(it->second->_temperature);

requestParam["max_tokens"] = std::to_string(it->second->_maxTokens);

// 【核心亮点:流式调用,传入回调函数】

// 把调用方传入的callback,直接透传给LLMManager,再透传给具体的Provider

// Provider每收到一段增量数据,就调用callback通知上层,实现打字机效果

auto response = _llmManager.sendMessageStream(

session->_modelName,

history,

requestParam,

callback);

// 【工程化亮点:对最终结果做有效性校验,只存储有效回复】

// 避免把错误信息、空回复加入会话历史,污染上下文

if (!response.empty() &&

response.find("error") == std::string::npos &&

response != "(模型返回空回复)") {

Message assistantMsg("assistant", response);

_sessionManager.addMessage(sessionId, assistantMsg);

_sessionManager.updateSessionTimestamp(sessionId);

} else {

WARN("ChatSDK: 丢弃无效的助手回复: {}", response);

}

return response;

}- 为什么流式返回要用std::function回调?

这个问题我们在前面提到过,其实本质就是流式返回的时候是"边生成边返回",这也是现在所有主流大模型的统一回复方式,用回调函数,就是可以在每收到一段增量数据的时候,就立即通知上层处理,而不需要等到完整结果生成,大大提升了用户的体验。

2.2.2 SessionManager.h/.cpp

代码总览

- SessionManager.h

cpp

#pragma once

#include <atomic>

#include <unordered_map>

#include <mutex>

#include <memory>

#include "DataManager.h"

#include "common.h"

namespace ai_chat_sdk {

class SessionManager{

public:

SessionManager(const std::string& dbName = "chatDB.db");

// 创建会话,提供模型名称

std::string createSession(const std::string& modelName);

// 通过会话ID获取会话信息

std::shared_ptr<Session> getSession(const std::string& sessionId);

// 往某个会话中添加消息

bool addMessage(const std::string& sessionId, const Message& message);

// 获取某个会话的所有历史消息

std::vector<Message> getHistroyMessages(const std::string& sessionId)const;

// 更新会话时间戳

void updateSessionTimestamp(const std::string& sessionId);

// 获取会话所有会话列表

std::vector<std::string> getSessionLists()const;

// 删除某个会话

bool deleteSession(const std::string& sessionId);

// 清空所有会话

void clearAllSessions();

// 获取会话总数

size_t getSessionCount()const;

private:

std::string generateSessionId();

std::string generateMessageId(size_t messageCounter);

private:

// 管理所有会话信息,key: 会话ID,value: 会话信息

std::unordered_map<std::string, std::shared_ptr<Session>> _sessions;

mutable std::mutex _mutex;

std::atomic<int64_t> _sessionCounter = {0}; // 记录所有会话总数

DataManager _dataManager;

};

} // end ai_chat_sdk- SessionManager.cpp

cpp

#include "../include/SessionManager.h"

#include <iomanip>

#include <sstream>

#include <vector>

#include "../include/util/myLog.h"

namespace ai_chat_sdk {

SessionManager::SessionManager(const std::string& dbName)

: _dataManager(dbName)

{

auto sessions = _dataManager.getAllSessions();

for(auto& session : sessions){

_sessions[session->_sessionId] = session;

}

}

std::string SessionManager::generateSessionId(){

_sessionCounter.fetch_add(1);

std::time_t time = std::time(nullptr);

std::ostringstream os;

os<<"session_"<<time<<"_"<<std::setw(8)<<std::setfill('0')<<_sessionCounter;

return os.str();

}

std::string SessionManager::generateMessageId(size_t messageCounter){

messageCounter++;

std::time_t time = std::time(nullptr);

std::ostringstream os;

os<<"msg_"<<time<<"_"<<std::setw(8)<<std::setfill('0')<<messageCounter;

return os.str();

}

std::string SessionManager::createSession(const std::string& modelName){

std::string sessionId;

{

std::lock_guard<std::mutex> lock(_mutex);

sessionId = generateSessionId();

auto session = std::make_shared<Session>(modelName);

session->_sessionId = sessionId;

session->_createdAt = std::time(nullptr);

session->_updatedAt = session->_createdAt;

_sessions[sessionId] = session;

}

// 数据库操作不加锁

auto session = std::make_shared<Session>(modelName);

session->_sessionId = sessionId;

session->_createdAt = std::time(nullptr);

session->_updatedAt = session->_createdAt;

_dataManager.insertSession(*session);

return sessionId;

}

std::shared_ptr<Session> SessionManager::getSession(const std::string& sessionId){

// 先在内存中查找

{

std::unique_lock<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it != _sessions.end()){

auto session = it->second;

lock.unlock();

session->_messages = _dataManager.getSessionMessages(sessionId);

return session;

}

}

auto session = _dataManager.getSession(sessionId);

if(session){

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it == _sessions.end()){

_sessions[sessionId] = session;

}

}

session->_messages = _dataManager.getSessionMessages(sessionId);

return session;

}

WARN("sessionId = {} not found", sessionId);

return nullptr;

}

bool SessionManager::addMessage(const std::string& sessionId, const Message& message){

std::shared_ptr<Session> session;

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it == _sessions.end()){

return false;

}

session = it->second;

}

Message msg(message._role, message._content);

msg._messageId = generateMessageId(session->_messages.size());

msg._timestamp = std::time(nullptr);

INFO("message Info: content {} timestamap {}", msg._content, msg._timestamp);

{

std::lock_guard<std::mutex> lock(_mutex);

session->_messages.push_back(msg);

session->_updatedAt = std::time(nullptr);

}

INFO("add message success, sessionId = {}, message.content = {}", sessionId, msg._content);

_dataManager.insertMessage(sessionId, msg);

return true;

}

// ==================== 修改点:过滤错误消息 ====================

std::vector<Message> SessionManager::getHistroyMessages(const std::string& sessionId) const {

std::vector<Message> rawMessages;

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it != _sessions.end()){

rawMessages = it->second->_messages;

} else {

rawMessages = _dataManager.getSessionMessages(sessionId);

}

}

std::vector<Message> filtered;

for (const auto& msg : rawMessages) {

// 如果是用户消息,无条件保留

if (msg._role == "user") {

filtered.push_back(msg);

continue;

}

// 如果是助手消息,进行过滤

if (msg._role == "assistant") {

// 检查内容是否为空或错误

if (msg._content.empty() ||

msg._content == "(模型返回空回复)" ||

msg._content.find("Failed to parse") != std::string::npos ||

msg._content.find("control character") != std::string::npos ||

msg._content.find("error") != std::string::npos ||

msg._content.find("fail") != std::string::npos ||

msg._content.find("invalid") != std::string::npos ||

msg._content.find("denied") != std::string::npos ||

msg._content.find("unavailable") != std::string::npos ||

msg._content.find("Authentication Fails") != std::string::npos ||

msg._content.find("rate limit") != std::string::npos) {

WARN("过滤掉错误消息: {}", msg._content);

continue;

}

// 如果内容以 '{' 开头(可能是 JSON 错误),也过滤

if (!msg._content.empty() && msg._content[0] == '{') {

WARN("过滤掉疑似 JSON 错误的消息: {}", msg._content);

continue;

}

}

filtered.push_back(msg);

}

return filtered;

}

// ==================== 结束修改 ====================

void SessionManager::updateSessionTimestamp(const std::string& sessionId){

std::time_t timestamp;

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it != _sessions.end()){

it->second->_updatedAt = std::time(nullptr);

timestamp = it->second->_updatedAt;

} else {

return;

}

}

_dataManager.updateSessionTimestamp(sessionId, timestamp);

}

std::vector<std::string> SessionManager::getSessionLists() const {

auto sessions = _dataManager.getAllSessions();

std::lock_guard<std::mutex> lock(_mutex);

std::vector<std::pair<std::time_t, std::shared_ptr<Session>>> temp;

temp.reserve(_sessions.size() + sessions.size());

for(const auto& pair : _sessions){

temp.emplace_back(pair.second->_updatedAt, pair.second);

}

for(const auto& session : sessions){

if(_sessions.find(session->_sessionId) == _sessions.end()){

temp.emplace_back(session->_updatedAt, session);

}

}

std::sort(temp.begin(), temp.end(), [](const auto& a, const auto& b){

return a.first > b.first;

});

std::vector<std::string> sessionIds;

for(const auto& pair : temp){

sessionIds.push_back(pair.second->_sessionId);

}

return sessionIds;

}

bool SessionManager::deleteSession(const std::string& sessionId){

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it == _sessions.end()){

return false;

}

_sessions.erase(it);

}

_dataManager.deleteSession(sessionId);

return true;

}

void SessionManager::clearAllSessions(){

{

std::lock_guard<std::mutex> lock(_mutex);

_sessions.clear();

}

_dataManager.clearAllSessions();

}

size_t SessionManager::getSessionCount() const {

std::lock_guard<std::mutex> lock(_mutex);

return _sessions.size();

}

} // end ai_chat_sdk头文件(SessionManager.h):核心设计亮点先看

头文件中定义的成员变量,直接体现了这个模块的核心实现思路;

cpp

class SessionManager{

private:

// 【核心设计1:内存+数据库双层存储】

// 内存层:std::unordered_map,O(1)查找,高性能

std::unordered_map<std::string, std::shared_ptr<Session>> _sessions;

// 【核心设计2:线程安全三件套】

mutable std::mutex _mutex; // 互斥锁,保护内存操作

std::atomic<int64_t> _sessionCounter; // 原子计数器,生成唯一ID

// 【核心设计3:数据持久化】

DataManager _dataManager; // 数据库管理模块,负责落地存储

};1. 为什么使用"内存+数据库"双层存储?

- 内存层(_sessions):使用unordered_map,增删查改的效率都是非常高的,用于高频热数据访问。

- 数据库层(_dataManager):用于持久化存储,保证重启后数据不会丢失,用于数据备份。

2. mutable的作用

-

首先需要明确一点,就是const成员函数里是不允许修改成员变量的;但是在这个场景下,后面的成员函数都是需要加锁的(修改_mutex的状态),而它们又是const成员函数,所以这里就产生了冲突。

-

那么mutable的作用就是**允许const成员函数去修改被mutable修饰的成员变量,**这样一来就可以解决这个矛盾了。

3. std::atomic的作用

- std::atomic是C++11中的原子类型,对它的操作是原子的,不可竞争的,不需要加锁,atomic的效率比锁要高不少,_sessionCounter只是一个简单的计数器,完全没必要去加锁保护。

构造函数:程序启动时的数据恢复

cpp

SessionManager::SessionManager(const std::string& dbName)

: _dataManager(dbName) // 【初始化列表:先初始化数据库管理模块】

{

// 【核心:启动时从数据库恢复所有会话到内存】

auto sessions = _dataManager.getAllSessions();

for(auto& session : sessions){

_sessions[session->_sessionId] = session;

}

}设计思路:

- 程序启动时,先把数据库中所有会话加载到内存中,这样后续访问历史会话就非常高效,因为都是内存操作,不涉及访问数据库的操作。

- 这是"冷启动预热"的典型代表。

ID 生成器:唯一 ID 的生成逻辑

cpp

std::string SessionManager::generateSessionId(){

// 【原子操作:无锁自增,线程安全】

_sessionCounter.fetch_add(1);

// 【ID格式:session_时间戳_8位计数器】

std::time_t time = std::time(nullptr);

std::ostringstream os;

os<<"session_"<<time<<"_"<<std::setw(8)<<std::setfill('0')<<_sessionCounter;

return os.str();

}- fetch_add(1)是atomic的原子自增操作,线程安全、无锁、性能拉满,这里就需要区别于++_sessionCounter,我们要清楚一个点,++操作并不是原子的,在多线程的情况下会存在数据不一致问题,而atomic这里提供的自增方法在底层规避了这个问题。

核心功能函数:线程安全 + 锁粒度控制的典范

createSession:创建会话(锁粒度控制的典范)

cpp

std::string SessionManager::createSession(const std::string& modelName){

std::string sessionId;

// 【锁的范围1:只保护内存操作,锁粒度极小】

{

std::lock_guard<std::mutex> lock(_mutex); // RAII锁,离开作用域自动释放

sessionId = generateSessionId();

auto session = std::make_shared<Session>(modelName);

session->_sessionId = sessionId;

session->_createdAt = std::time(nullptr);

session->_updatedAt = session->_createdAt;

_sessions[sessionId] = session;

} // 锁在这里自动释放了!

// 【关键:数据库操作不加锁!】

// 数据库操作是慢IO,不应该在锁里做,否则会严重影响并发性能

auto session = std::make_shared<Session>(modelName);

session->_sessionId = sessionId;

session->_createdAt = std::time(nullptr);

session->_updatedAt = session->_createdAt;

_dataManager.insertSession(*session);

return sessionId;

}1. 为什么用std::lock_guard?

这是一个经典的RAII(资源获取即初始化)应用,std::lock_guard在构造的时候自动加锁,在离开作用域时自动解锁,这样就可以避免忘记解锁导致死锁的问题。

2. 为什么锁的范围这么小?为什么数据库操作不加锁?

这里就是锁粒度优化的核心思想:

- **锁的范围越小,并发性能越高:**只把必须保护的内存操作放在锁里,其他操作都放在锁外面。

- **数据库操作是慢IO:**一次数据库写入需要几毫秒到几十毫秒,这样的操作如果放在锁里面,其他线程都会被阻塞,并发性能就会被严重影响。

addMessage:添加消息(同样的锁粒度控制)

cpp

bool SessionManager::addMessage(const std::string& sessionId, const Message& message){

std::shared_ptr<Session> session;

// 【锁1:只保护查找会话的内存操作】

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it == _sessions.end()){

return false;

}

session = it->second; // 拿到shared_ptr,引用计数+1,延长生命周期

} // 锁释放

// 【无锁区域:生成消息ID、打日志,都不需要加锁】

Message msg(message._role, message._content);

msg._messageId = generateMessageId(session->_messages.size());

msg._timestamp = std::time(nullptr);

INFO("message Info: content {} timestamap {}", msg._content, msg._timestamp);

// 【锁2:只保护修改内存消息列表的操作】

{

std::lock_guard<std::mutex> lock(_mutex);

session->_messages.push_back(msg);

session->_updatedAt = std::time(nullptr);

} // 锁释放

// 【无锁区域:数据库慢IO操作,不加锁】

INFO("add message success, sessionId = {}, message.content = {}", sessionId, msg._content);

_dataManager.insertMessage(sessionId, msg);

return true;

}设计思路总结:

这个函数将锁粒度的控制做得比较到位;

- 锁1:只保护查找会话的操作,拿到shared_ptr就释放锁;

- 无锁:生成消息 ID、打日志,这些操作不需要保护;

- 锁2:只保护修改内存消息列表的操作。

- 无锁:数据库慢IO,完全不加锁。

getHistroyMessages:获取历史消息(带错误过滤的业务逻辑)

cpp

std::vector<Message> SessionManager::getHistroyMessages(const std::string& sessionId) const {

std::vector<Message> rawMessages;

// 【锁:保护内存查找操作】

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _sessions.find(sessionId);

if(it != _sessions.end()){

rawMessages = it->second->_messages;

} else {

rawMessages = _dataManager.getSessionMessages(sessionId);

}

}

// 【核心业务逻辑:过滤错误消息,保证多轮对话质量】

std::vector<Message> filtered;

for (const auto& msg : rawMessages) {

// 用户消息:无条件保留

if (msg._role == "user") {

filtered.push_back(msg);

continue;

}

// 助手消息:严格过滤

if (msg._role == "assistant") {

// 过滤空回复、错误关键词、JSON错误

if (msg._content.empty() ||

msg._content == "(模型返回空回复)" ||

msg._content.find("error") != std::string::npos ||

msg._content[0] == '{') {

WARN("过滤掉错误消息: {}", msg._content);

continue;

}

}

filtered.push_back(msg);

}

return filtered;

}这个函数是业务质量保障的核心:

- 大模型可能返回错误信息、空回复、JSON格式的错误响应。

- 如果这些错误信息被加入对话历史,会污染多轮对话的上下文,导致后续对话质量无法保证。

- 这里消息经过过滤,只会留下有效的、正常的消息,保证多轮对话的上下文质量。

2.2.3 DataManager.h/.cpp

代码总览:

- DataManager.h

cpp

#pragma once

#include <memory>

#include <sqlite3.h>

#include <string>

#include <mutex>

#include "common.h"

namespace ai_chat_sdk {

class DataManager{

public:

DataManager(const std::string& dbName);

~DataManager();

// Session相关操作

// 插入新会话

bool insertSession(const Session& session);

// 获取指定会话信息

std::shared_ptr<Session> getSession(const std::string& sessionId)const;

// 更新指定会话的时间戳

bool updateSessionTimestamp(const std::string& sessionId, std::time_t timestamp);

// 删除指定会话--注意:删除会话时,也需要删除该会话中管理的所有的消息

bool deleteSession(const std::string& sessionId);

// 获取所有会话id

std::vector<std::string> getAllSessionIds()const;

// 获取所有会话信息

std::vector<std::shared_ptr<Session>> getAllSessions()const;

// 删除所有会话

bool clearAllSessions();

// 获取会话总数

size_t getSessionCount()const;

////////////////////////////////////////////////////////////////////

// Message相关操作

// 插入新消息--注意:插入消息时,需要更新会话的时间戳

bool insertMessage(const std::string& sessionId, const Message& message);

// 获取指定会话的历史消息

std::vector<Message> getSessionMessages(const std::string& sessionId)const;

// 删除指定会话的所有消息

bool deleteSessionMessages(const std::string& sessionId);

private:

// 初始化数据库 -- 创建数据库表

bool initDataBase();

// 执行SQL语句的工具函数

bool executeSQL(const std::string& sql);

private:

// 【核心修改】交换了 _dbName 和 _db 的声明顺序

// 让声明顺序和构造函数初始化列表的顺序保持一致

std::string _dbName;

sqlite3* _db = nullptr;

mutable std::mutex _mutex;

};

}// end ai_chat_sdk- DataManager.cpp

cpp

#include "../include/DataManager.h"

#include "../include/util/myLog.h"

#include <memory>

#include <mutex>

#include <vector>

namespace ai_chat_sdk {

DataManager::DataManager(const std::string& dbName)

: _dbName(dbName)

, _db(nullptr)

{

// 创建并打开数据库

int rc = sqlite3_open(dbName.c_str(), &_db);

if(rc != SQLITE_OK){

ERR("打开数据库失败:{}", sqlite3_errmsg(_db));

}

INFO("打开数据库成功:{}", dbName);

// 初始化数据库表 - 创建会话表和消息表

if(!initDataBase()){

sqlite3_close(_db);

_db = nullptr;

ERR("初始化数据库表失败");

}

}

DataManager::~DataManager(){

if(_db){

sqlite3_close(_db);

}

}

// 初始化数据库

bool DataManager::initDataBase(){

// 创建会话表

std::string createSessionTable = R"(

CREATE TABLE IF NOT EXISTS sessions (

session_id TEXT PRIMARY KEY,

model_name TEXT NOT NULL,

create_time INTEGER NOT NULL,

update_time INTEGER NOT NULL

);

)";

// 执行创建Sessions表的SQL语句

if(!executeSQL(createSessionTable)){

return false;

}

// 创建消息表

std::string createMessageTable = R"(

CREATE TABLE IF NOT EXISTS messages (

message_id TEXT PRIMARY KEY,

session_id TEXT NOT NULL,

role TEXT NOT NULL,

content TEXT NOT NULL,

timestamp INTEGER NOT NULL,

FOREIGN KEY (session_id) REFERENCES sessions(session_id) ON DELETE CASCADE

);

)";

// 执行创建Messages表的SQL语句

if(!executeSQL(createMessageTable)){

return false;

}

return true;

}

bool DataManager::executeSQL(const std::string& sql){

if(!_db){

ERR("数据库未初始化");

return false;

}

char* errMsg = nullptr;

int rc = sqlite3_exec(_db, sql.c_str(), nullptr, nullptr, &errMsg);

if(rc != SQLITE_OK){

ERR("执行SQL语句失败: {}", errMsg);

sqlite3_free(errMsg);

return false;

}

return true;

}

// 插入会话

bool DataManager::insertSession(const Session& session){

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string insertSQL = R"(

INSERT INTO sessions (session_id, model_name, create_time, update_time)

VALUES (?, ?, ?, ?);

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, insertSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("insertSession - 准备语句失败:{}", sqlite3_errmsg(_db));

return false;

}

// 绑定参数

sqlite3_bind_text(stmt, 1, session._sessionId.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_text(stmt, 2, session._modelName.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_int64(stmt, 3, static_cast<int64_t>(session._createdAt));

sqlite3_bind_int64(stmt, 4, static_cast<int64_t>(session._updatedAt));

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("insertSession - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 释放语句

sqlite3_finalize(stmt);

INFO("insertSession - 插入会话成功:{}", session._sessionId);

return true;

}

// 获取指定sessionId的会话信息

std::shared_ptr<Session> DataManager::getSession(const std::string& sessionId)const{

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string selectSQL = R"(

SELECT model_name, create_time, update_time FROM sessions WHERE session_id = ?;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, selectSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("getSession - 准备语句失败:{}", sqlite3_errmsg(_db));

return nullptr;

}

// 绑定参数

sqlite3_bind_text(stmt, 1, sessionId.c_str(), -1, SQLITE_TRANSIENT);

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("getSession - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return nullptr;

}

// 从结果集中提取数据

std::string modelName = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 0));

int64_t createTime = sqlite3_column_int64(stmt, 1);

int64_t updateTime = sqlite3_column_int64(stmt, 2);

// 创建会话对象

auto session = std::make_shared<Session>(modelName);

session->_sessionId = sessionId;

session->_createdAt = static_cast<std::time_t>(createTime);

session->_updatedAt = static_cast<std::time_t>(updateTime);

// 释放语句

sqlite3_finalize(stmt);

INFO("getSession - 获取会话成功:{}", sessionId);

// 获取该会话的所有消息

session->_messages = getSessionMessages(sessionId);

return session;

}

// 更新指定会话的时间戳

bool DataManager::updateSessionTimestamp(const std::string& sessionId, std::time_t timestamp){

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string updateSQL = R"(

UPDATE sessions SET update_time = ? WHERE session_id = ?;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, updateSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("updateSessionTimestamp - 准备语句失败:{}", sqlite3_errmsg(_db));

return false;

}

// 绑定参数

sqlite3_bind_int64(stmt, 1, static_cast<int64_t>(timestamp));

sqlite3_bind_text(stmt, 2, sessionId.c_str(), -1, SQLITE_TRANSIENT);

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("updateSessionTimestamp - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 释放语句

sqlite3_finalize(stmt);

INFO("updateSessionTimestamp - 更新会话时间戳成功:{}", sessionId);

return true;

}

// 删除指定会话

bool DataManager::deleteSession(const std::string& sessionId){

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string deleteSQL = R"(

DELETE FROM sessions WHERE session_id = ?;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, deleteSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("deleteSession - 准备语句失败:{}", sqlite3_errmsg(_db));

return false;

}

// 绑定参数

sqlite3_bind_text(stmt, 1, sessionId.c_str(), -1, SQLITE_TRANSIENT);

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("deleteSession - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 释放语句

sqlite3_finalize(stmt);

INFO("deleteSession - 删除会话成功:{}", sessionId);

return true;

}

// 获取所有会话id

std::vector<std::string> DataManager::getAllSessionIds()const{

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string selectSQL = R"(

SELECT session_id FROM sessions ORDER BY update_time DESC;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, selectSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("getAllSessionIds - 准备语句失败:{}", sqlite3_errmsg(_db));

return {};

}

std::vector<std::string> sessionIds;

while(sqlite3_step(stmt) == SQLITE_ROW){

std::string sessionId = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 0));

sessionIds.push_back(sessionId);

}

// 释放语句

sqlite3_finalize(stmt);

INFO("getAllSessionIds - 获取所有会话id成功, 会话总数:{}", sessionIds.size());

return sessionIds;

}

// 获取所有session信息,并按照更新时间降序排列

std::vector<std::shared_ptr<Session>> DataManager::getAllSessions()const{

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string selectSQL = R"(

SELECT session_id, model_name, create_time, update_time FROM sessions ORDER BY update_time DESC;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, selectSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("getAllSessionIds - 准备语句失败:{}", sqlite3_errmsg(_db));

return {};

}

std::vector<std::shared_ptr<Session>> sessions;

while(sqlite3_step(stmt) == SQLITE_ROW){

std::string sessionId = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 0));

std::string modelName = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 1));

int64_t createTime = sqlite3_column_int64(stmt, 2);

int64_t updateTime = sqlite3_column_int64(stmt, 3);

auto session = std::make_shared<Session>(modelName);

session->_sessionId = sessionId;

session->_createdAt = static_cast<std::time_t>(createTime);

session->_updatedAt = static_cast<std::time_t>(updateTime);

sessions.push_back(session);

// 历史消息暂时不获取,需要时再通过会话id来进行获取

}

// 释放语句

sqlite3_finalize(stmt);

INFO("getAllSessions - 获取所有会话信息成功, 会话总数:{}", sessions.size());

return sessions;

}

// 获取会话总数

size_t DataManager::getSessionCount()const

{

std::lock_guard<std::mutex> lock(_mutex);

// 准备SQL语句

std::string selectSQL = R"(

SELECT COUNT(*) FROM sessions;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, selectSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("getSessionCount - 准备语句失败:{}", sqlite3_errmsg(_db));

return 0;

}

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_ROW){

ERR("getSessionCount - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return 0;

}

// 获取会话总数

size_t count = sqlite3_column_int64(stmt, 0);

// 释放语句

sqlite3_finalize(stmt);

INFO("getSessionCount - 获取会话总数成功:{}", count);

return count;

}

// 删除所有会话

bool DataManager::clearAllSessions(){

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string deleteSQL = R"(

DELETE FROM sessions;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, deleteSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("clearAllSessions - 准备语句失败:{}", sqlite3_errmsg(_db));

return false;

}

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("clearAllSessions - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 释放语句

sqlite3_finalize(stmt);

INFO("clearAllSessions - 删除所有会话成功");

return true;

}

/////////////////////////////////////////////////////////////Messages///////////////////////////////////////

// 插入新消息--注意:插入消息时,需要更新会话的时间戳

bool DataManager::insertMessage(const std::string& sessionId, const Message& message){

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string insertSQL = R"(

INSERT INTO messages (message_id, session_id, role, content, timestamp)

VALUES (?, ?, ?, ?, ?);

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, insertSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("insertMessage - 准备语句失败:{}", sqlite3_errmsg(_db));

return false;

}

// 绑定参数

sqlite3_bind_text(stmt, 1, message._messageId.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_text(stmt, 2, sessionId.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_text(stmt, 3, message._role.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_text(stmt, 4, message._content.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_int64(stmt, 5, static_cast<int64_t>(message._timestamp));

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("insertMessage - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 同时更新session的update_time

std::string updateSQL = R"(

UPDATE sessions SET update_time = ? WHERE session_id = ?;

)";

// 准备SQL语句

sqlite3_stmt* updateStmt;

rc = sqlite3_prepare_v2(_db, updateSQL.c_str(), -1, &updateStmt, nullptr);

if(rc != SQLITE_OK){

ERR("insertMessage - 准备语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 绑定参数

sqlite3_bind_int64(updateStmt, 1, static_cast<int64_t>(message._timestamp));

sqlite3_bind_text(updateStmt, 2, sessionId.c_str(), -1, SQLITE_TRANSIENT);

// 执行SQL语句

rc = sqlite3_step(updateStmt);

if(rc != SQLITE_DONE){

ERR("insertMessage - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(updateStmt);

return false;

}

// 释放语句

sqlite3_finalize(stmt);

sqlite3_finalize(updateStmt);

INFO("insertMessage - 插入消息成功:{}", message._messageId);

return true;

}

// 获取会话中的所有消息

std::vector<Message> DataManager::getSessionMessages(const std::string& sessionId)const

{

std::lock_guard<std::mutex> lock(_mutex);

// 准备SQL语句

std::string selectSQL = R"(

SELECT message_id, role, content, timestamp FROM messages WHERE session_id = ?;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, selectSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("getSessionMessages - 准备语句失败:{}", sqlite3_errmsg(_db));

return {};

}

// 绑定参数

sqlite3_bind_text(stmt, 1, sessionId.c_str(), -1, SQLITE_TRANSIENT);

// 执行SQL语句

std::vector<Message> messages;

while((rc = sqlite3_step(stmt)) == SQLITE_ROW){

Message message;

message._messageId = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 0));

message._role = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 1));

message._content = reinterpret_cast<const char*>(sqlite3_column_text(stmt, 2));

message._timestamp = static_cast<std::time_t>(sqlite3_column_int64(stmt, 3));

messages.push_back(message);

}

if(rc != SQLITE_DONE){

ERR("getSessionMessages - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return {};

}

// 释放语句

sqlite3_finalize(stmt);

return messages;

}

// 删除制定会话的历史消息

bool DataManager::deleteSessionMessages(const std::string& sessionId){

std::lock_guard<std::mutex> lock(_mutex);

// 构建SQL语句

std::string deleteSQL = R"(

DELETE FROM messages WHERE session_id = ?;

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, deleteSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK){

ERR("deleteSessionMessages - 准备语句失败:{}", sqlite3_errmsg(_db));

return false;

}

// 绑定参数

sqlite3_bind_text(stmt, 1, sessionId.c_str(), -1, SQLITE_TRANSIENT);

// 执行SQL语句

rc = sqlite3_step(stmt);

if(rc != SQLITE_DONE){

ERR("deleteSessionMessages - 执行语句失败:{}", sqlite3_errmsg(_db));

sqlite3_finalize(stmt);

return false;

}

// 释放语句

sqlite3_finalize(stmt);

INFO("deleteSessionMessages - 删除会话消息成功:{}", sessionId);

return true;

}

} // end ai_chat_sdk这个模块的核心作用就在于消息的持久化存储,是整个SDK层的数据底座(大家可以看一下上面的项目结构图)。提供完整的 CRUD 操作,支持会话 / 消息的生命周期管理,保证程序重启后数据不丢失;同时通过外键约束、参数化查询、线程安全控制,保障数据的一致性、安全性与并发访问稳定性。

头文件设计:职责清晰的接口分层

cpp

class DataManager{

public:

// 【Session相关操作】:会话元信息的增删改查

bool insertSession(const Session& session);

std::shared_ptr<Session> getSession(const std::string& sessionId)const;

bool updateSessionTimestamp(const std::string& sessionId, std::time_t timestamp);

bool deleteSession(const std::string& sessionId);

std::vector<std::string> getAllSessionIds()const;

std::vector<std::shared_ptr<Session>> getAllSessions()const;

bool clearAllSessions();

size_t getSessionCount()const;

// 【Message相关操作】:会话消息的增删改查

bool insertMessage(const std::string& sessionId, const Message& message);

std::vector<Message> getSessionMessages(const std::string& sessionId)const;

bool deleteSessionMessages(const std::string& sessionId);

private:

// 【工具函数】:初始化表、执行SQL

bool initDataBase();

bool executeSQL(const std::string& sql);

private:

// 【核心成员】

std::string _dbName; // 数据库文件名

sqlite3* _db = nullptr; // SQLite数据库连接指针

mutable std::mutex _mutex; // 互斥锁(mutable保证const函数也能加锁)

};核心实现拆解

构造与析构:RAII 管理数据库连接

cpp

// 构造函数:打开数据库 + 初始化表

DataManager::DataManager(const std::string& dbName)

: _dbName(dbName), _db(nullptr)

{

// 打开数据库

int rc = sqlite3_open(dbName.c_str(), &_db);

if(rc != SQLITE_OK){

ERR("打开数据库失败:{}", sqlite3_errmsg(_db));

}

// 初始化表(如果不存在则创建)

if(!initDataBase()){

sqlite3_close(_db);

_db = nullptr;

ERR("初始化数据库表失败");

}

}

// 析构函数:自动关闭数据库连接

DataManager::~DataManager(){

if(_db){

sqlite3_close(_db);

}

}**设计亮点:**用 RAII(资源获取即初始化)管理数据库连接,构造时打开,析构时自动关闭,完全避免资源泄漏。

数据库表设计:外键约束保证数据一致性

cpp

// 会话表:存储会话元信息

CREATE TABLE IF NOT EXISTS sessions (

session_id TEXT PRIMARY KEY, // 会话唯一标识

model_name TEXT NOT NULL, // 绑定的模型名

create_time INTEGER NOT NULL, // 创建时间戳

update_time INTEGER NOT NULL // 更新时间戳

);

// 消息表:存储会话消息

CREATE TABLE IF NOT EXISTS messages (

message_id TEXT PRIMARY KEY,

session_id TEXT NOT NULL,

role TEXT NOT NULL,

content TEXT NOT NULL,

timestamp INTEGER NOT NULL,

// 【核心亮点】外键约束 + 级联删除

FOREIGN KEY (session_id) REFERENCES sessions(session_id) ON DELETE CASCADE

);ON DELETE CASCADE:删除会话时,自动删除该会话下的所有消息,无需手动清理,保证数据一致性;

时间戳字段:支持会话按活跃时间排序,提升用户体验。

核心函数:参数化查询防 SQL 注入

以insertSession为例,所有 SQL 操作都使用参数化查询,而非字符串拼接:

cpp

bool DataManager::insertSession(const Session& session){

std::lock_guard<std::mutex> lock(_mutex);

// 【参数化查询】用?占位符,而非字符串拼接

std::string insertSQL = R"(

INSERT INTO sessions (session_id, model_name, create_time, update_time)

VALUES (?, ?, ?, ?);

)";

// 准备SQL语句

sqlite3_stmt* stmt;

int rc = sqlite3_prepare_v2(_db, insertSQL.c_str(), -1, &stmt, nullptr);

if(rc != SQLITE_OK) return false;

// 【绑定参数】安全替换占位符

sqlite3_bind_text(stmt, 1, session._sessionId.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_text(stmt, 2, session._modelName.c_str(), -1, SQLITE_TRANSIENT);

sqlite3_bind_int64(stmt, 3, static_cast<int64_t>(session._createdAt));

sqlite3_bind_int64(stmt, 4, static_cast<int64_t>(session._updatedAt));

// 执行SQL + 释放语句

rc = sqlite3_step(stmt);

sqlite3_finalize(stmt);

return rc == SQLITE_DONE;

}设计思路:

- 参数化查询:完全防止了SQL注入,保证数据安全。

- SQLITE_TRANSIENT:SQLite 自动管理绑定的字符串内存,无需手动释放。

线程安全:mutable mutex 保证 const 正确性

所有数据库操作都用std::lock_guard加锁,且_mutex声明为mutable:

cpp

// const成员函数也能加锁

std::vector<std::string> DataManager::getAllSessionIds()const{

std::lock_guard<std::mutex> lock(_mutex); // mutable mutex允许在const函数中修改

// ... 执行SQL ...

}设计思路:

- mutable:可以让const成员函数修改成员变量_mutex(进行加锁),保证线程安全。

- std::lock_guard:RAII自动管理锁,自动释放,避免死锁。

2.2.4 LLMManager.h/.cpp

代码总览:

LLMManager.h

cpp

#pragma once

#include <map>

#include <memory>

#include <mutex>

#include "LLMProvider.h"

namespace ai_chat_sdk

{

class LLMManager

{

public:

// 注册LLM提供者

bool registerProvider(const std::string &modelName, std::unique_ptr<LLMProvider> provider);

// 初始化指定模型

bool initModel(const std::string &modelName, const std::map<std::string, std::string> &modelParam);

// 获取可用模型

std::vector<ModelInfo> getAvailableModels() const;

// 检查模型是否可用

bool isModelAvailable(const std::string &modelName) const;

// 发送消息给指定模型

std::string sendMessage(const std::string &modelName, const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam);

// 发送消息流给指定模型

std::string sendMessageStream(const std::string &modelName, const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam, std::function<void(const std::string &, bool)> &callback);

private:

mutable std::mutex _mutex; // 新增互斥锁

// key: 模型名称 value: 模型提供器

std::map<std::string, std::unique_ptr<LLMProvider>> _providers;

// key: 模型名称 value: 模型信息

std::map<std::string, ModelInfo> _modelInfos;

};

}LLMManager.cpp

cpp

#include "../include/LLMManager.h"

#include "../include/util/myLog.h"

#include "../include/common.h"

namespace ai_chat_sdk

{

bool LLMManager::registerProvider(const std::string &modelName, std::unique_ptr<LLMProvider> provider)

{

if (!provider) {

ERR("cannot register nullptr provider, modelName = {}", modelName);

return false;

}

std::lock_guard<std::mutex> lock(_mutex);

_providers[modelName] = std::move(provider);

_modelInfos[modelName] = ModelInfo(modelName);

INFO("register provider success, modelName = {}", modelName);

return true;

}

bool LLMManager::initModel(const std::string &modelName, const std::map<std::string, std::string> &modelParam)

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _providers.find(modelName);

if (it == _providers.end()) {

ERR("model provider not found, modelName = {}", modelName);

return false;

}

bool isSuccess = it->second->initModel(modelParam);

if (!isSuccess) {

ERR("init model failed, modelName = {}", modelName);

} else {

INFO("init model success, modelName = {}", modelName);

_modelInfos[modelName]._modelDesc = it->second->getModelDesc();

_modelInfos[modelName]._isAvailable = true;

}

return isSuccess;

}

std::vector<ModelInfo> LLMManager::getAvailableModels() const

{

std::lock_guard<std::mutex> lock(_mutex);

std::vector<ModelInfo> models;

for (const auto &pair : _modelInfos) {

if (pair.second._isAvailable) {

models.push_back(pair.second);

}

}

return models;

}

bool LLMManager::isModelAvailable(const std::string &modelName) const

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _modelInfos.find(modelName);

if (it == _modelInfos.end()) return false;

return it->second._isAvailable;

}

std::string LLMManager::sendMessage(const std::string &modelName, const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam)

{

LLMProvider* provider = nullptr;

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _providers.find(modelName);

if (it == _providers.end()) {

ERR("model provider not found, modelName = {}", modelName);

return "";

}

if (!it->second->isAvailable()) {

ERR("model not available, modelName = {}", modelName);

return "";

}

provider = it->second.get();

}

return provider->sendMessage(messages, requestParam);

}

std::string LLMManager::sendMessageStream(const std::string &modelName, const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam, std::function<void(const std::string &, bool)> &callback)

{

LLMProvider* provider = nullptr;

{

std::lock_guard<std::mutex> lock(_mutex);

auto it = _providers.find(modelName);

if (it == _providers.end()) {

ERR("model provider not found, modelName = {}", modelName);

return "";

}

if (!it->second->isAvailable()) {

ERR("model not available, modelName = {}", modelName);

return "";

}

provider = it->second.get();

}

return provider->sendMessageStream(messages, requestParam, callback);

}

}核心作用:

作为整个 SDK 的策略模式容器与请求分发核心,负责管理所有LLMProvider子类实例,根据模型名动态路由请求到对应的 Provider 实现;同时通过双 map 设计、极致锁粒度控制,兼顾扩展性、性能与线程安全。

头文件设计:职责分离的双 map 存储

cpp

class LLMManager

{

public:

// 【Provider管理】注册、初始化模型

bool registerProvider(const std::string &modelName, std::unique_ptr<LLMProvider> provider);

bool initModel(const std::string &modelName, const std::map<std::string, std::string> &modelParam);

// 【查询接口】获取可用模型、检查状态

std::vector<ModelInfo> getAvailableModels() const;

bool isModelAvailable(const std::string &modelName) const;

// 【请求分发】发送消息(全量/流式)

std::string sendMessage(const std::string &modelName, const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam);

std::string sendMessageStream(const std::string &modelName, const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam, std::function<void(const std::string &, bool)> &callback);

private:

// 【线程安全】mutable保证const函数也能加锁

mutable std::mutex _mutex;

// 【双map职责分离】

std::map<std::string, std::unique_ptr<LLMProvider>> _providers; // 存储"干活的人"

std::map<std::string, ModelInfo> _modelInfos; // 存储"人的信息"

};设计思路:

- 双map职责分离:_providers存Provider实例(负责API调用),_modelInfos存模型元信息(方便快速查询)。

核心实现拆解

registerProvider:智能指针 + 移动语义的典范

cpp

bool LLMManager::registerProvider(const std::string &modelName, std::unique_ptr<LLMProvider> provider)

{

// 前置校验:防止注册空指针

if (!provider) {

ERR("cannot register nullptr provider, modelName = {}", modelName);

return false;

}

// 加锁:保护双map的修改

std::lock_guard<std::mutex> lock(_mutex);

// 【核心】std::move转移unique_ptr所有权

// 把Provider的所有权从调用方转移到LLMManager的_providers map里

_providers[modelName] = std::move(provider);

// 同步初始化ModelInfo

_modelInfos[modelName] = ModelInfo(modelName);

return true;

}设计思路:

- unique_ptr禁止拷贝,使用std::move转移所有权,不涉及拷贝,性能极高。

- 双 map 同步更新:注册 Provider 时同步初始化 ModelInfo,保证数据一致性。

initModel:多态调用的典范

cpp

bool LLMManager::initModel(const std::string &modelName, const std::map<std::string, std::string> &modelParam)

{

std::lock_guard<std::mutex> lock(_mutex);

// 步骤1:根据模型名找到对应的Provider

auto it = _providers.find(modelName);

if (it == _providers.end()) return false;

// 【核心】多态调用Provider的initModel

// it->second是unique_ptr<LLMProvider>(基类指针)

// 实际调用的是子类实现(DouBaoProvider::initModel或DeepSeekProvider::initModel)

bool isSuccess = it->second->initModel(modelParam);

// 步骤3:根据结果更新ModelInfo

if (isSuccess) {

_modelInfos[modelName]._modelDesc = it->second->getModelDesc();

_modelInfos[modelName]._isAvailable = true;

}

return isSuccess;

}设计思路:

- 多态调用:通过基类指针调用虚函数,运行时动态选择子类实现,完美落地策略模式;

sendMessage/sendMessageStream:极致锁粒度控制的典范

两个函数的逻辑是一致的,这里我们以sendMessage为例;

cpp

std::string LLMManager::sendMessage(const std::string &modelName,

const std::vector<Message> &messages,

const std::map<std::string, std::string> &requestParam)

{

LLMProvider* provider = nullptr;

// 【锁的范围:极小!只保护查找Provider和检查可用性】

{

std::lock_guard<std::mutex> lock(_mutex);

// 步骤1:找到Provider

auto it = _providers.find(modelName);

if (it == _providers.end()) return "";

// 步骤2:检查可用性

if (!it->second->isAvailable()) return "";

// 步骤3:拿到Provider的裸指针(所有权不转移)

provider = it->second.get();

} // 锁在这里释放了!

// 【关键:实际的API请求调用,完全不加锁!】

// 大模型API是慢IO(可能几秒),绝对不能在锁里做

// Provider本身无共享状态(或已自己加锁),可以安全调用

return provider->sendMessage(messages, requestParam);

}设计思路:

- 极致锁粒度:只保护查找Provider、检查可用性的内存操作,API请求属于慢IO,不加锁,这样就提高的并发性能。

2.2.5 Provider 实现

代码总览:

DeepSeekProvider.cpp

cpp

#include "../include/DeepSeekProvider.h"

#include "../include/util/myLog.h"

#include <string>

#include <map>

#include <vector>

#include <functional>

#include <sstream>

#include <algorithm>

#include <curl/curl.h>

#include <jsoncpp/json/json.h>

#include <jsoncpp/json/reader.h>

namespace ai_chat_sdk {

// 符合 JSON 规范的字符串转义

static std::string escapeJsonString(const std::string &str) {

std::string result;

for (char c : str) {

switch (c) {

case '"': result += "\\\""; break;

case '\\': result += "\\\\"; break;

case '/': result += "\\/"; break;

case '\b': result += "\\b"; break;

case '\f': result += "\\f"; break;

case '\n': result += "\\n"; break;

case '\r': result += "\\r"; break;

case '\t': result += "\\t"; break;

default:

if (c >= 0 && c < 32) {

char hex[7];

snprintf(hex, sizeof(hex), "\\u%04x", (unsigned char)c);

result += hex;

} else {

result += c;

}

break;

}

}

return result;

}

bool DeepSeekProvider::initModel(const std::map<std::string, std::string> &modelParam) {

auto it = modelParam.find("api_key");

if (it == modelParam.end() || it->second.empty()) {

ERR("DeepSeekProvider initModel: api_key为空");

return false;

}

_apiKey = it->second;

it = modelParam.find("endpoint");

_endpoint = (it == modelParam.end() || it->second.empty()) ? "https://api.deepseek.com" : it->second;

if (!_endpoint.empty() && _endpoint.back() == '/')

_endpoint.pop_back();

_isAvailable = true;

INFO("DeepSeekProvider initModel成功,endpoint: {}", _endpoint);

return true;

}

bool DeepSeekProvider::isAvailable() const { return _isAvailable; }

std::string DeepSeekProvider::getModelName() const { return "deepseek-chat"; }

std::string DeepSeekProvider::getModelDesc() const { return "DeepSeek大模型(官方API接入)"; }

// 全量发送(请保留你原有的实现)

std::string DeepSeekProvider::sendMessage(const std::vector<Message> &messages, const std::map<std::string, std::string> &requestParam) {

// ... 你的实现 ...

return "";

}

// libcurl 写回调:将解析出的纯文本内容传递给上层回调,并累积纯文本到 full_response

struct WriteContext {

std::function<void(const std::string&, bool)>* callback;

std::string* full_text; // 累积纯文本内容,用于返回

std::string buffer; // 行缓冲

bool has_sent_content;

};

static size_t WriteCallback(void *contents, size_t size, size_t nmemb, void *userp) {

size_t total = size * nmemb;

WriteContext* ctx = static_cast<WriteContext*>(userp);

std::string chunk(static_cast<char*>(contents), total);

// 按行处理

ctx->buffer += chunk;

size_t pos;

while ((pos = ctx->buffer.find('\n')) != std::string::npos) {

std::string line = ctx->buffer.substr(0, pos);

ctx->buffer.erase(0, pos + 1);

// 去除行尾可能有的 \r

if (!line.empty() && line.back() == '\r') line.pop_back();

if (line.substr(0, 6) == "data: ") {

std::string data = line.substr(6);

if (data == "[DONE]") {

// 流结束,但由主函数发送结束标记,这里不重复发送

continue;

}

if (!data.empty()) {

Json::Value root;

Json::CharReaderBuilder reader;

std::string errs;

std::istringstream s(data);

if (Json::parseFromStream(reader, s, &root, &errs)) {

if (root.isMember("error")) {

std::string errorMsg = root["error"].toStyledString();

ERR("DeepSeek API 返回错误: {}", errorMsg);

(*(ctx->callback))("{\"error\":\"API 错误:" + root["error"]["message"].asString() + "\"}", true);

return 0; // 终止传输

}

if (root.isMember("choices") && root["choices"].isArray() && !root["choices"].empty()) {

auto choice = root["choices"][0];

if (choice.isMember("delta")) {

std::string delta_content;

if (choice["delta"].isObject() && choice["delta"].isMember("content")) {

delta_content = choice["delta"]["content"].asString();

} else if (choice["delta"].isString()) {

delta_content = choice["delta"].asString();

} else if (choice["delta"].isInt()) {

delta_content = std::to_string(choice["delta"].asInt());