前言:

当四足机器狗在宁波舟山港的集装箱间灵活穿行,凭借高清相机精准识别箱号与铅封;当家政机器人通过视觉感知稳稳拿起桌面水杯,清洁后准确归位 ------ 这些具身智能的落地场景背后,相机正扮演着最关键的 "感知中枢" 角色。作为具身智能与物理世界交互的首要数据入口,相机不仅是简单的 "图像采集工具",更是智能体实现环境理解、决策执行的核心基础设施,堪称具身智能最重要的感知载体。

一、感知革命:相机如何定义具身智能的 "认知边界"

具身智能的核心特质是 "物理嵌入性"------ 智能体必须依托物理载体,在与环境的动态交互中完成感知、决策与行动闭环。而相机的价值,正是为这一闭环提供最丰富、最关键的多维度信息,构建起智能体认知世界的 "数据地基"。

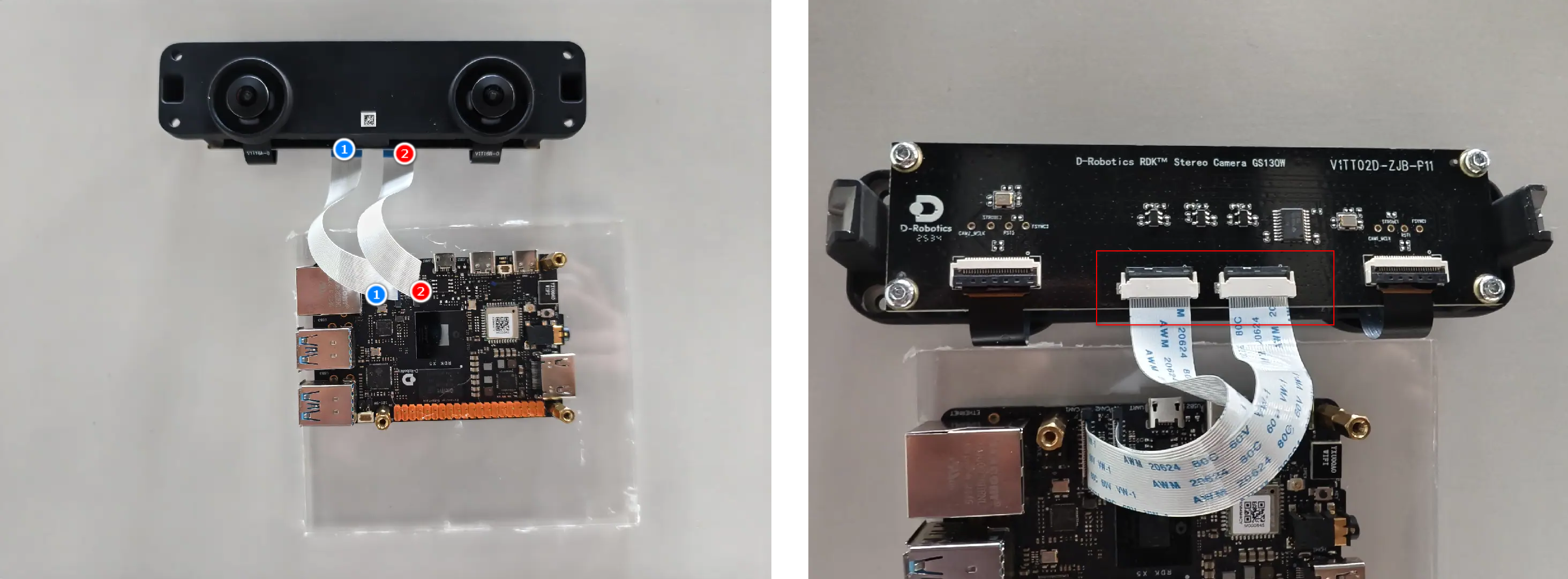

从技术本质来看,相机为具身智能提供了三重核心感知能力。其一,三维空间感知能力。通过单目视觉的尺度估算或双目视觉的立体匹配技术,相机能精准还原物理世界的空间结构与距离关系。中科院上海微系统所提出的全新双目立体深度估计方法,借助频率滤波技术提升视差预测精度,让机器人能准确判断物体位置与大小,为抓取、避障等动作提供精准数据支撑。其二,动态目标捕捉能力。无论是港口机器狗追踪移动的集装箱,还是自动驾驶车辆识别突发路况,高帧率相机结合毫秒级 AI 推理,能实现对动态目标的实时锁定与轨迹预测,赋予智能体类生物本能的快速反应能力。其三,多模态信息融合能力。现代智能相机已突破单一图像采集局限,通过与激光雷达、毫米波雷达协同,将三维几何结构、纹理颜色、运动速度等信息叠加融合,形成 "4D-plus" 机器视觉表达,让智能体 "既看得见形状,又能理解属性"。

这种感知能力的突破,彻底改变了具身智能的发展路径。不同于依赖预设程序的传统机器人,搭载先进相机的智能体能够自主适应复杂环境 ------ 在强光、颠簸等极端工况下,工业级鲁棒性相机可保持稳定感知;在大范围场景中,188° 超广角相机能消除感知盲区,实现全域信息覆盖。相机的感知边界,正是具身智能的认知边界。

二、场景落地:相机驱动具身智能渗透千行百业

从工业生产到日常生活,相机的技术演进正推动具身智能从实验室走向规模化应用,在关键场景中释放巨大价值。

在工业与物流领域,相机成为提升效率的核心利器。宁波舟山港引入的查验辅助机器人,凭借高清相机与 AI 识别算法,自主完成集装箱箱号、铅封号的自动拍摄与识别,替代了人工逐个核查的传统模式,破解了港区吞吐量增长与人力资源紧张的矛盾。而在智能制造车间,单目立体相机通过高精度图像测量技术,可对零部件尺寸、表面缺陷进行实时监测,或为 AGV 机器人提供视觉导引,实现生产流程的全自动化。这些应用的核心突破,在于相机将 "视觉感知" 转化为 "生产效率",让具身智能成为产业升级的直接动力。

在服务与消费领域,相机赋予智能体 "人性化交互" 能力。家政机器人通过视觉识别区分不同物品,精准完成清洁、收纳任务;咖啡机器人借助视觉定位技术,将做好的咖啡稳稳递到顾客手中;医疗康复机器人则通过相机捕捉患者动作,提供个性化康复指导。这些场景中,相机让智能体不仅能 "完成任务",更能 "理解需求",实现从 "工具" 到 "伙伴" 的角色转变。

在特殊环境应用中,相机的定制化设计拓展了具身智能的应用边界。在高空作业场景,低空智能系统搭载的仿生相机能抵抗强风干扰,实现精准巡检;在危险救援场景,消防机器人的耐高温相机可穿透烟雾,定位被困人员;在太空探索领域,抗辐射相机为航天器提供环境感知,助力无人探测任务完成。相机的环境适应性,决定了具身智能的应用广度。

三、核心接口技术:MIPI 与 GMSL 的传输革命

如果说感知技术是相机的 "眼睛",那么接口技术就是连接 "眼睛" 与 "大脑"(智能体处理器)的 "神经通路"。在具身智能场景中,MIPI(移动行业处理器接口)与 GMSL(千兆多媒体串行链路)两大主流接口,分别以 "低功耗紧凑" 与 "高可靠远距离" 的特性,支撑起不同场景的传输需求,成为相机技术落地的关键支撑。

(一)MIPI:小型化智能体的 "低功耗神经"

MIPI 接口(以 CSI-2 规范为核心)是为移动设备与小型智能体设计的标准化接口,凭借 "低功耗、小尺寸、高带宽" 的特性,成为人形机器人、便携设备等场景的首选。其核心优势体现在三方面:

一是极致能效比。MIPI CSI-2 v4.0 版本新增的 Always-On 通道技术,通过低功耗 I3C 总线实现 "永久在线" 感知,仅在检测到有效事件时唤醒主 CPU,大幅降低静态功耗,完美适配人形机器人、便携巡检设备等对续航敏感的场景。例如,搭载 MIPI 接口相机的口袋式巡检机器人,可连续工作 8 小时以上,远超传统接口设备的续航水平。

二是高带宽与压缩优化。针对高分辨率相机的数据洪流,MIPI 引入多像素压缩(MPC)技术,能高效处理四合一、九合一像素传感器的输出数据,在不损失画质的前提下缓解传输压力。配合 RAW28 色深编码,可捕捉极致动态范围,满足工业检测等对细节要求严苛的场景需求。在智能制造车间,搭载 MIPI 接口的单目立体相机,可实现 4K 分辨率图像的实时传输,精准检测零部件微米级缺陷。

三是紧凑化集成。MIPI 接口采用少引脚设计,简化了 PCB 布线与设备集成,让相机模块更小巧轻便。例如,CM2001M 编码板的 MIPI 输入接口可直接对接摄像模组,无需额外转接设备,为水下机器人等空间受限的智能体节省了宝贵的安装空间。英特尔信步 HB03 平台更是提供 8 路 MIPI-CSI 通道,支持 4 路相机同时接入,满足多视角感知需求。

(二)MIPI CSI-2 速率规范与像素 - 型号适配详解

MIPI CSI-2 的速率性能直接决定相机的分辨率、帧率上限,其速率规范随协议版本迭代不断升级,且需结合通道数(Lane)、像素格式综合匹配。以下是具身智能场景中最常用的速率等级、像素适配逻辑及主流相机型号:

- 核心速率等级(按协议版本划分)

MIPI CSI-2 的速率以 "单通道速率(Gbps/Lane)× 通道数(Lane)" 为核心指标,不同协议版本支持的速率上限差异显著:

注:实际可用带宽需扣除 1.2~1.3 倍的协议开销(含包头、校验、空行等),例如 2.5 Gbps/Lane 的 4 Lane 配置,实际有效带宽约 7.5~8.0 Gbps。

- 速率 - 像素适配逻辑(工程实用公式)

MIPI CSI-2 的速率需求可通过公式精准计算:

单通道速率(Gbps)=(分辨率 × 帧率 × 像素位宽 ×1.25)÷ 通道数 ÷10⁹

其中 1.25 为协议开销系数,像素位宽按格式不同取值:YUV422-8bit(16bit / 像素)、RAW10(10bit / 像素)、RGB888(24bit / 像素)。

典型适配案例:

- 1080p@60fps(YUV422-8bit):需单通道速率 =(1920×1080×60×16×1.25)÷2÷10⁹≈1.19 Gbps,选用 2 Lane×1.0 Gbps/Lane 即可满足;

- 4K@30fps(RAW10):需单通道速率 =(3840×2160×30×10×1.25)÷4÷10⁹≈0.73 Gbps,4 Lane×1.0 Gbps/Lane 完全覆盖;

- 4K@60fps(RGB888):需单通道速率 =(3840×2160×60×24×1.25)÷8÷10⁹≈1.46 Gbps,需 8 Lane×2.5 Gbps/Lane 或 4 Lane×5.0 Gbps/Lane 配置;

- 720p@180fps(RAW8):需单通道速率 =(1280×720×180×8×1.25)÷2÷10⁹≈0.83 Gbps,2 Lane×1.0 Gbps/Lane 适配高帧率场景。

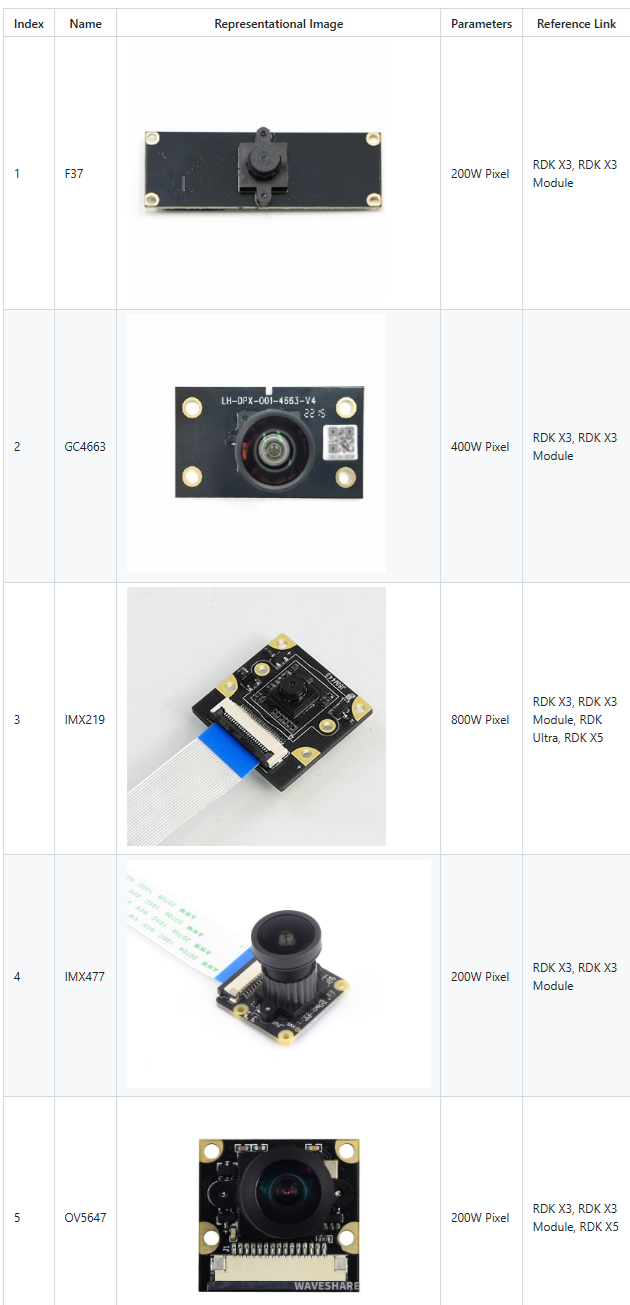

- 主流相机型号与速率 - 像素适配表

注:部分模组支持速率自适应调整,例如 IMX219 可在 2 Lane×0.912 Gbps 与 4 Lane×0.755 Gbps 间切换,适配不同算力的智能体处理器。

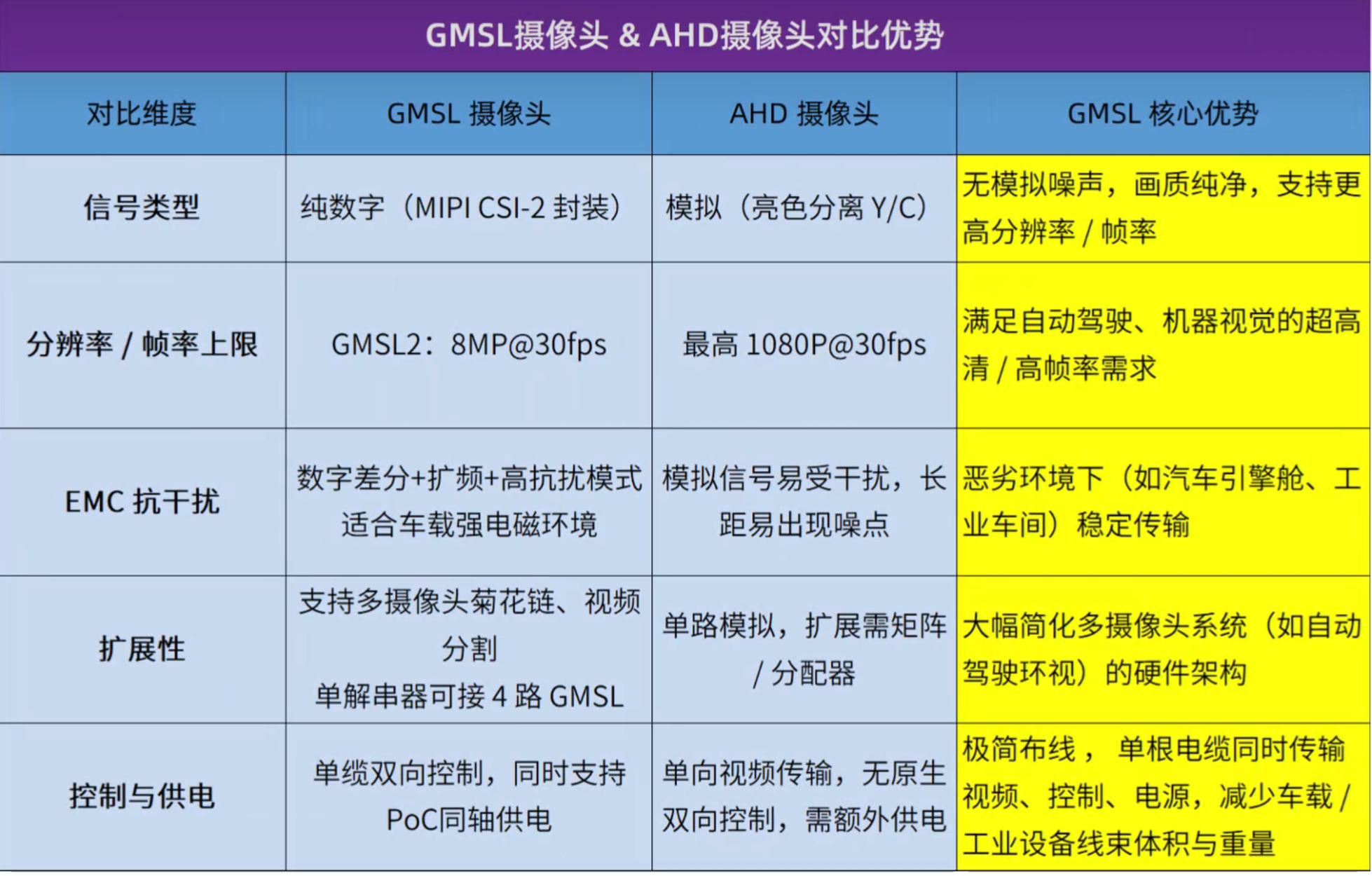

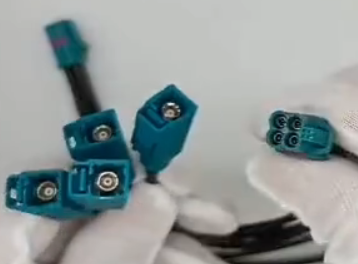

(三)GMSL:复杂环境的 "高可靠链路"

GMSL 接口(以 GMSL3 为最新一代)专为工业、车载等复杂场景设计,以 "远距离、抗干扰、高稳定" 为核心优势,解决了恶劣环境下的高清数据传输难题。其技术特性精准匹配具身智能的极端应用需求:

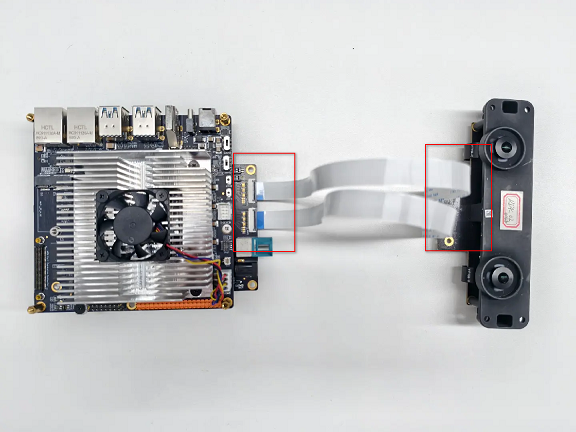

一是超远距离传输能力。GMSL3 采用 PAM4 编码技术,实现 12Gbps 的超高传输速率,通过同轴电缆或屏蔽双绞线,可在百米范围内稳定传输 4K 高清视频与深度数据,且支持电源与数据同步传输(PoE),大幅简化工业场景的布线复杂度。在宁波舟山港,搭载 GMSL2 接口相机的查验机器人,可在集装箱堆场复杂环境中,实现 50 米外的箱号精准识别与数据传输。

二是工业级抗干扰性能。GMSL 接口具备极强的电磁干扰(EMI)抑制能力,配合前向纠错(FEC)技术,可实现 10⁻³⁰以下的极低误码率,在强振动、多电磁干扰的工业车间、港口码头等场景中保持稳定传输。奥比中光 Gemini 330 系列相机搭载 GMSL2 接口后,可在 - 40℃~85℃的宽温范围、IP67 防护等级下长期工作,适配极端工业环境。

三是多设备协同优化。GMSL 支持多相机同步触发与数据传输,通过精确时间协议(PTP)实现无缆同步,满足多视角拼接、360° 全域感知等需求。英特尔信步 HB03 平台的 GMSL 扩展卡,可支持多路相机协同工作,为 AMR 自主移动机器人提供全方位环境感知能力,确保在复杂堆场中精准导航。

(四)接口选型逻辑:场景决定技术路径

MIPI 与 GMSL 并非替代关系,而是根据具身智能的应用场景形成互补:

- 当智能体追求 "小型化、低功耗"(如人形机器人、便携设备),且传输距离在 10 米以内时,MIPI 接口是最优选择;

- 当智能体面临 "远距离、强干扰"(如工业机器人、港口设备、自动驾驶车辆),且需稳定传输高清数据时,GMSL 接口更具优势;

- 高端解决方案已实现双接口兼容,如奥比中光 Gemini 系列相机同时支持 GMSL2 与以太网接口,英特尔 HB03 平台兼顾 MIPI 与 GMSL 扩展,让用户可根据场景灵活切换。

GMSL 作为工业级远距离传输接口,其速率性能直接决定复杂环境下高清图像的传输稳定性,速率规范随版本迭代持续升级,需结合传输介质、通道数与像素格式综合适配。以下是具身智能场景中核心速率参数、像素适配逻辑及主流相机型号:

- 核心速率等级(按接口版本划分)

GMSL 的速率以 "单通道传输速率(Gbps)" 为核心指标(主流为单通道单方向传输),不同版本在速率、传输距离与抗干扰性上差异显著:

注:实际可用带宽需扣除 1.15~1.2 倍的协议开销(含 FEC 纠错、同步信号、链路管理等),例如 GMSL2 的 6.0 Gbps 速率,实际有效带宽约 5.0~5.2 Gbps。

- 速率 - 像素适配逻辑(工业级实用公式)

GMSL 的速率需求计算需兼顾远距离传输的稳定性,公式优化为:

单通道速率(Gbps)=(分辨率 × 帧率 × 像素位宽 ×1.3)÷10⁹

其中 1.3 为工业场景协议开销系数(含抗干扰冗余),像素位宽取值与 MIPI 一致:YUV422-8bit(16bit / 像素)、RAW10(10bit / 像素)、RGB888(24bit / 像素)。

典型适配案例:

- 1080p@60fps(YUV422-8bit):需速率 =(1920×1080×60×16×1.3)÷10⁹≈2.54 Gbps,GMSL1(3.12 Gbps)完全覆盖,适配车载环视相机;

- 4K@30fps(RAW12):需速率 =(3840×2160×30×12×1.3)÷10⁹≈4.67 Gbps,GMSL2(6.0 Gbps)适配,满足港口机器人箱号识别;

- 4K@60fps(RGB888):需速率 =(3840×2160×60×24×1.3)÷10⁹≈18.68 Gbps,需 GMSL4(24.0 Gbps)或双链路 GMSL3(12×2 Gbps),适配高端工业检测;

- 8K@30fps(RAW10):需速率 =(7680×4320×30×10×1.3)÷10⁹≈12.84 Gbps,GMSL4(24.0 Gbps)适配,满足远距离高清巡检场景。

- 主流 GMSL 相机型号与速率 - 像素适配表

注:GMSL 相机多支持 "速率自适应",例如 Gemini 330 可在 4K@30fps(6.0 Gbps)与 1080p@120fps(3.0 Gbps)间切换,适配不同传输距离需求;部分工业级型号支持双 GMSL 链路绑定,速率翻倍(如双 GMSL2 实现 12 Gbps),满足更高分辨率需求。

四、AI 模型算法:赋予相机 "理解" 能力的核心引擎

如果说接口技术是相机与智能体 "大脑" 的 "神经通路",那么 AI 模型算法就是让 "神经通路" 传递的 "数据" 转化为 "认知" 的核心引擎。相机采集的原始图像数据,需通过一系列 AI 算法完成 "感知 - 解析 - 决策" 的转化,才能支撑具身智能的自主交互。以下是具身智能场景中相机依赖的核心 AI 模型算法,及与硬件、场景的适配逻辑:

(一)基础感知算法:从 "像素" 到 "特征" 的转化

基础感知算法是 AI 理解图像的第一步,核心目标是从原始像素数据中提取有意义的特征(如边缘、纹理、形状),为后续高级任务提供支撑。

- 图像预处理算法

- 核心功能:解决相机采集图像的噪声、光照不均、畸变等问题,优化输入数据质量;

- 关键技术:

- 噪声抑制:高斯滤波、双边滤波(保留边缘的同时去除噪声,适配工业场景的低光照图像);

- 光照校正:Gamma 校正、Retinex 算法(解决强光 / 阴影导致的图像过曝 / 欠曝,如港口机器人在正午 / 傍晚的拍摄场景);

- 畸变矫正:张正友标定法(修正相机镜头畸变,确保空间定位精度,如 AGV 机器人的视觉导航);

- 适配硬件:可在相机端 ISP 芯片或端侧 NPU 中实现,低延迟处理不占用传输带宽(与 MIPI/GMSL 接口的低延迟特性互补)。

- 特征提取算法

- 核心功能:从预处理后的图像中提取关键特征,为目标识别、分割提供基础;

- 关键技术:

- 传统算法:SIFT(尺度不变特征变换)、SURF(加速稳健特征),适用于低算力设备的简单匹配场景(如教育机器人的物体识别);

- 深度学习算法:CNN 卷积神经网络(如 ResNet、MobileNet),通过多层卷积提取高阶语义特征,适配复杂场景(如港口机器人的集装箱箱号识别,抗遮挡、模糊);

- 场景适配:MobileNet、EfficientNet 等轻量化模型,专为 MIPI 接口的小型智能体设计(低功耗、低算力占用);ResNet-50 等高精度模型,适配 GMSL 接口的工业机器人(有充足算力支撑,追求识别精度)。

(二)核心任务算法:从 "特征" 到 "认知" 的升级

核心任务算法基于基础特征,完成对图像的语义理解(如 "这是什么物体""它在哪里""它在做什么"),是具身智能交互的核心。

- 目标检测算法:"找到并识别目标"

- 核心功能:同时完成目标的定位( bounding box 坐标)与分类(目标类别),是具身智能最常用的算法;

- 主流模型与适配场景:

- YOLO 系列(YOLOv5、YOLOv8):实时性强,检测速度达 30~100 FPS,适配高帧率相机场景(如工业机器人的动态零件检测、服务机器人的人体跟踪);

- SSD(单次多框检测器):轻量化设计,适合低算力设备(如低成本家政机器人的物品识别);

- Faster R-CNN:精度高(mAP 达 80% 以上),但速度较慢,适配静态高精度场景(如智能制造的零部件缺陷检测);

- 技术优化:结合 MIPI 接口的多相机输入,可实现多视角目标检测融合(如人形机器人的 360° 环境感知);配合 GMSL 接口的远距离传输,可实现大范围场景的目标追踪(如港口机器人的集装箱定位)。

- 语义分割算法:"精准划分目标边界"

- 核心功能:将图像像素级划分为不同类别(如 "桌子""杯子""地面"),实现目标与背景的精准分离;

- 主流模型与适配场景:

- Mask R-CNN:在目标检测基础上增加实例分割,可精准获取物体轮廓(如家政机器人抓取水杯时,区分水杯与桌面);

- U-Net 及其变体:轻量化设计,适配医疗康复机器人的人体动作分割(如捕捉患者关节运动轨迹);

- SegNet:低延迟特性,适合工业 AGV 机器人的道路分割(实时区分可行区域与障碍物);

- 硬件协同:与支持 RAW12/14 编码的 MIPI 相机配合,可获取更高动态范围图像,提升分割精度;GMSL 接口的抗干扰传输,确保分割算法输入数据的稳定性(如工业车间的强电磁环境)。

- 深度估计算法:"还原三维空间信息"

- 核心功能:从 2D 图像中计算目标的深度(距离)信息,支撑具身智能的空间交互(如抓取、避障);

- 主流模型与适配场景:

- 单目深度估计:MobileNet+DepthNet 轻量化模型,适配单相机的小型智能体(如口袋式巡检机器人的距离测量);

- 双目深度估计:SGBM(半全局块匹配)算法,配合双目相机(如 IMX219 双目模组),实现高精度距离测量(如工业机器人抓取零件的毫米级定位);

- 多目深度估计:结合 8 路 MIPI-CSI 通道的多相机输入,实现 360° 全域深度感知(如高端人形机器人的避障与导航);

- 与接口适配:高分辨率深度图(如 4K)需依赖 MIPI CSI-2 v3.0 的 5.0 Gbps/Lane 速率,或 GMSL3 的 12 Gbps 速率,确保数据实时传输。

- 行为识别算法:"理解目标动作与意图"

- 核心功能:分析图像序列中目标的动作(如 "行走""抓取""跌倒"),支撑具身智能的人性化交互;

- 主流模型与适配场景:

- 3D CNN(如 C3D):基于视频序列的动作识别,适配高帧率相机(如 180fps 的 IMX219 模组),捕捉快速动作(如工业机器人的装配动作检测);

- Transformer-based 模型(如 Vision Transformer):长序列依赖建模,适合服务机器人的人体行为理解(如识别用户 "挥手""指点" 等指令);

- 场景落地:医疗康复机器人通过行为识别算法,判断患者康复动作是否标准;消防救援机器人通过行为识别,定位被困人员的求救动作(如挥手、移动)。

(三)高阶融合算法:从 "单一任务" 到 "多任务协同"

具身智能的复杂场景(如港口机器人的集装箱查验、人形机器人的自主导航),需多个 AI 算法协同工作,形成 "多任务融合" 能力。

- 多任务学习算法

- 核心逻辑:一个模型同时完成检测、分割、深度估计等多个任务,减少算力占用与延迟;

- 典型模型:YOLOv8-seg(检测 + 分割)、EfficientDet-Depth(检测 + 深度估计);

- 适配场景:人形机器人的全身感知(同时识别物体、分割环境、测量距离),配合 MIPI 接口的低功耗特性,延长续航时间。

- 多模态融合算法

- 核心逻辑:融合相机图像与激光雷达、触觉、听觉等传感器数据,提升认知鲁棒性;

- 关键技术:注意力机制(Attention)、Transformer 融合模块;

- 适配场景:自动驾驶机器人(融合相机图像与激光雷达点云,抗极端天气干扰)、精密装配机器人(融合视觉与触觉数据,实现 "柔和抓取");

- 接口支撑:GMSL 接口的多相机同步传输,确保不同视角图像的时间戳一致性,提升融合精度。

(四)算法 - 硬件 - 场景适配速查表

四、技术演进:从 "能看见" 到 "看得懂" 的未来方向

随着具身智能向更高阶的通用智能演进,相机正朝着 "高分辨率、低功耗、可扩展" 的方向突破,同时面临着新的技术挑战与发展机遇。

当前,相机技术的创新聚焦于三大方向。一是芯片化与集成化。北京大学团队研制的仿生相干激光雷达芯片,采用 "微并行" 架构,通过按需调度光谱与通道资源,在 100 米距离内可分辨硬币大小的物理间隔,实现 "全局覆盖 + 局部高分辨" 的精准感知,同时摆脱了硬件堆砌导致的功耗与成本困境。这种芯片化趋势让相机更小巧、更节能,适配人形机器人等小型化具身载体的需求。二是端侧智能深化。新一代智能相机内置高性能 NPU 算力,实现 SLAM 算法与 AI 识别的端侧内闭环,无需依赖云端算力即可完成数据处理,大幅降低响应时延,让智能体在无网络环境下也能自主工作。三是多传感器协同优化。通过与触觉、听觉等传感器融合,相机将构建更全面的感知体系 ------ 例如,在精密装配任务中,视觉感知提供定位信息,触觉传感器反馈压力数据,两者协同实现 "精准且柔和" 的操作。

但技术演进之路仍面临多重挑战。一方面,复杂环境的感知鲁棒性有待提升,极端光照、遮挡、动态干扰等场景仍会影响相机的感知精度;另一方面,数据标注成本高昂,具身智能所需的动态交互数据难以通过传统方式大规模获取;此外,硬件接口与数据格式的标准化缺失,也制约了不同厂商相机与智能体的兼容适配。这些挑战的解决,不仅需要相机技术的持续迭代,更依赖整个具身智能产业生态的协同发展。

相机 ------ 通往通用人工智能的 "感知桥梁"

从阿兰・图灵构想的 "配备最好传感器的机器",到如今大规模落地的具身智能产品,相机始终是智能体连接物理世界的核心纽带。它不仅是 "眼睛",更是具身智能的 "感知大脑"------ 通过捕捉光影,还原三维世界;通过解析图像,理解环境语义;通过动态感知,支撑自主决策。

随着集成光子学、端侧 AI、多模态融合等技术的不断突破,相机将实现从 "能看见" 到 "看得懂、看得远、看得全" 的跨越,为具身智能提供更强大的感知支撑。未来,当相机具备昆虫复眼的视场与鹰眼的精度,当智能体能够像人类一样通过视觉感知学习新知识、适应新环境,具身智能将真正走进生产生活的每个角落,成为驱动新一轮科技革命的核心力量。而相机,始终是这场革命中最关键的感知基石。

基于相机的AI模型算法有哪些?