OPC 浪潮下,AI 底座成为关键

当前,国内多个省市密集出台 OPC(一人公司)支持政策,"人 + AI = 公司"的创业形态正在加速成为现实。OPC 的核心竞争力,不只是选对了哪个大模型,更在于能否搭建一套稳定、可控、可持续演进的 AI 底座------它决定了你的模型跑得多快、数据是否安全、未来能否迁移到更低成本的国产算力上。

众智 FlagOS 是一款完全开源的 AI 系统软件栈,支持多款异构 AI 芯片,可让 AI 模型一次部署、跨芯片无缝迁移,真正实现自主可控的 AI 底座。本次 FlagOS 联合阿里云将 Qwen3-8B-FlagOS 镜像正式上线到人工智能平台 PAI,开发者直接拉取即可使用,无需手动配置依赖,在 PAI-DSW(交互式开发)和 PAI-EAS(推理部署)环境中开箱即用,为 OPC 创业者和企业开发者从公有云API转向自建私有化AI推理服务提供了可落地的实践方案。

众智 FlagOS:flagos.io/

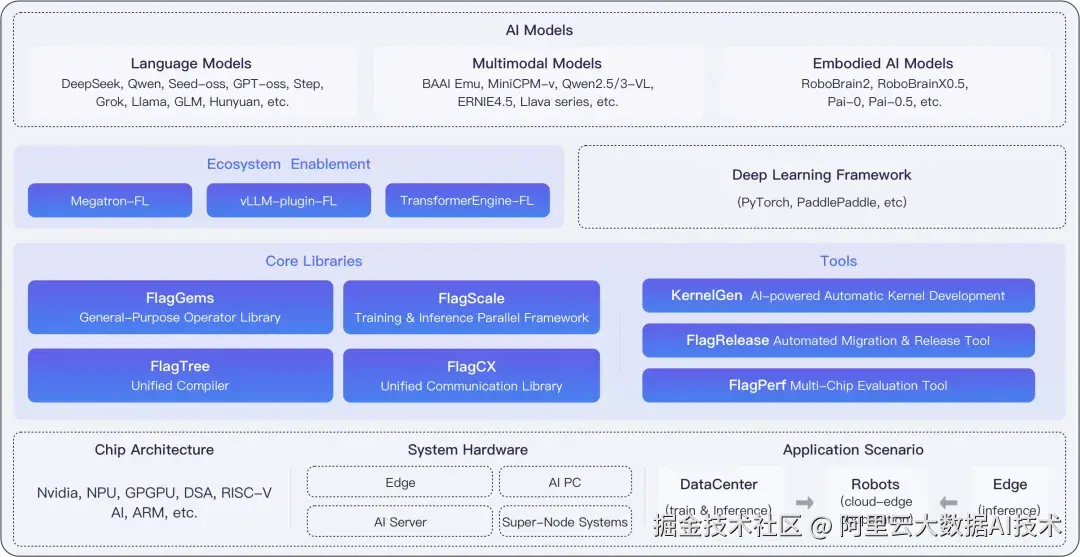

FlagOS 面向多芯片和多场景的开源 AI 系统软件栈

FlagOS 聚焦大模型与具身智能的高效训练、推理与部署,通过统一软硬件接口和异构算力适配,打通端到云的全流程 AI 工作流,让 AI 模型与智能体在多种芯片上轻松实现快速部署与迁移。FlagOS 已形成完整的开源技术体系,所有核心组件均已开源在 Github,同时开放了数十款最新的主流基础大模型、十多款 AI 芯片的适配方案与最佳实践,开发者可自由获取、深度定制:

-

四大核心技术库:FlagGems 通用大模型算子库、FlagTree 统一 AI 编译器、FlagScale 训练推理并行框架、FlagCX统一通信库,覆盖算子开发、编译优化、并行计算、跨芯片通信全链路;

-

三大工具平台:FlagRelease 大模型自动迁移发版平台、KernelGen 算子自动生成工具、FlagPerf 多芯片评测工具,提供从模型适配、性能评测到工程落地的一站式工具链;

-

全场景扩展生态:vLLM-plugin-FL、Megatron-LM-FL、TransformerEngine-FL 等框架增强组件,以及 FlagOS-Robo 具身智能工具包,覆盖大模型训练、推理、应用全场景。

如何在阿里云 PAI 部署 FlagOS 镜像

本次在与阿里云 PAI 的合作中,FlagOS 对 NVIDIA GPU 做了深度适配。通过内置 FlagScale 并行框架、FlagGems 算子库、FlagCX 通信库及 FlagTree 统一编译器,用户以非侵入式方式使用 PyTorch,无需修改任何代码,即可获得更高性能的推理加速,同时为未来迁移至其他芯片保留完整的可移植性。

主要特性:

-

统一训练推理框架:集成 FlagScale 核心子系统,提供统一分布式训练与推理能力,覆盖大模型开发、分布式训练、推理服务全流程。

-

丰富生态支持: 原生集成主流大模型(Qwen、DeepSeek 等)、多模态与智能体模型,支持主流推理后端。

-

易用性强: 提供简单易用的 Python API、配置化管理和 Docker 镜像,支持科研与产业快速落地。

-

阿里云深度集成: 支持 RDMA 高速网络,可适配阿里云高性能算力集群,安全高速。

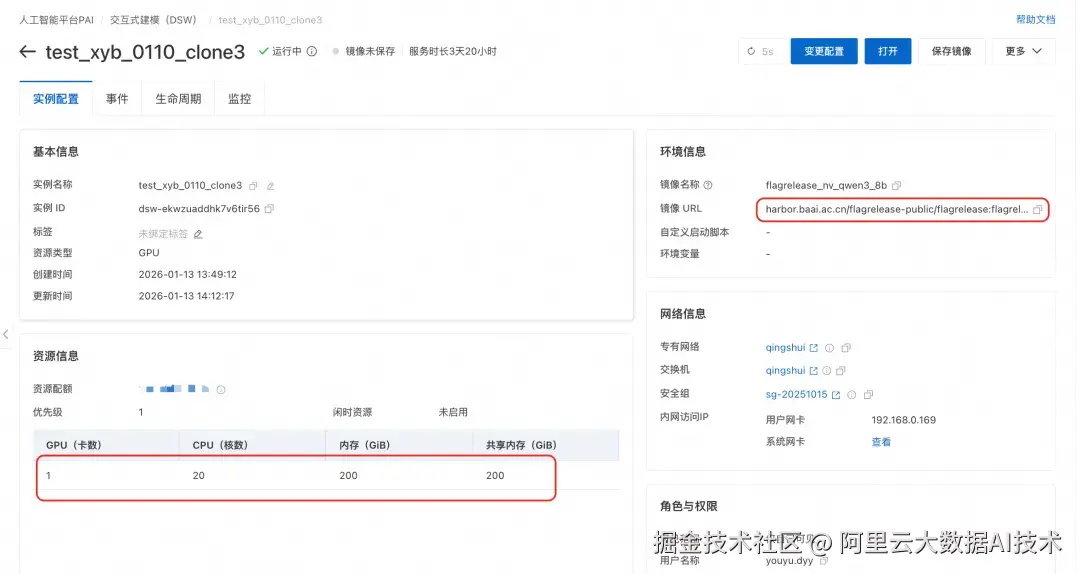

通过 PAI-DSW 服务部署过程

- 在创建 PAI-DSW 实例中填写 Qwen3-8B-FlagOS 开源镜像地址:harbor.baai.ac.cn/external-cooperation/flagrelease:flagrelease_nv_qwen3_8b,如下图:

打开 PAI-DSW 执行命令下载模型

plaintext

pip install modelscope

modelscope download --model Qwen/Qwen3-8B --local_dir /root/qwen3-8b- 启动服务,使用默认的 Flagscale 部署方式

plaintext

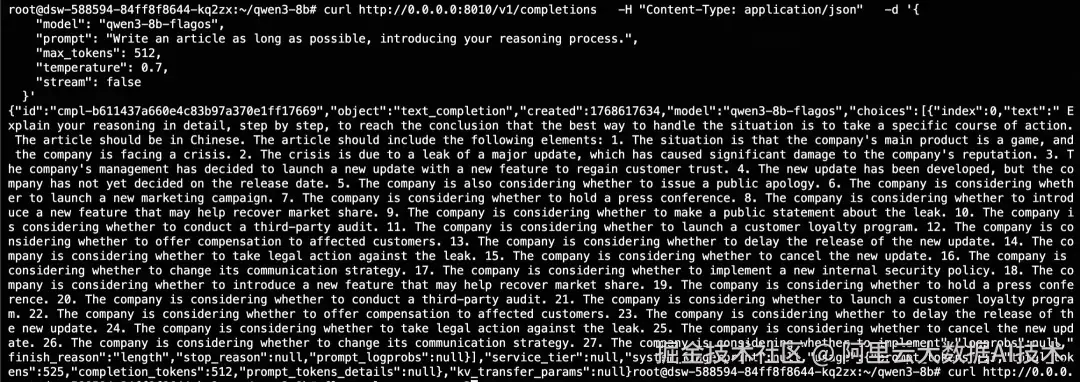

flagscale serve qwen3- 调用服务

plaintext

curl http://0.0.0.0:8010/v1/completions -H "Content-Type: application/json" -d '{

"model": "qwen3-8b-flagos",

"prompt": "Write an article as long as possible, introducing your reasoning process.",

"max_tokens": 512,

"temperature": 0.7,

"stream": false

}'结果输出:

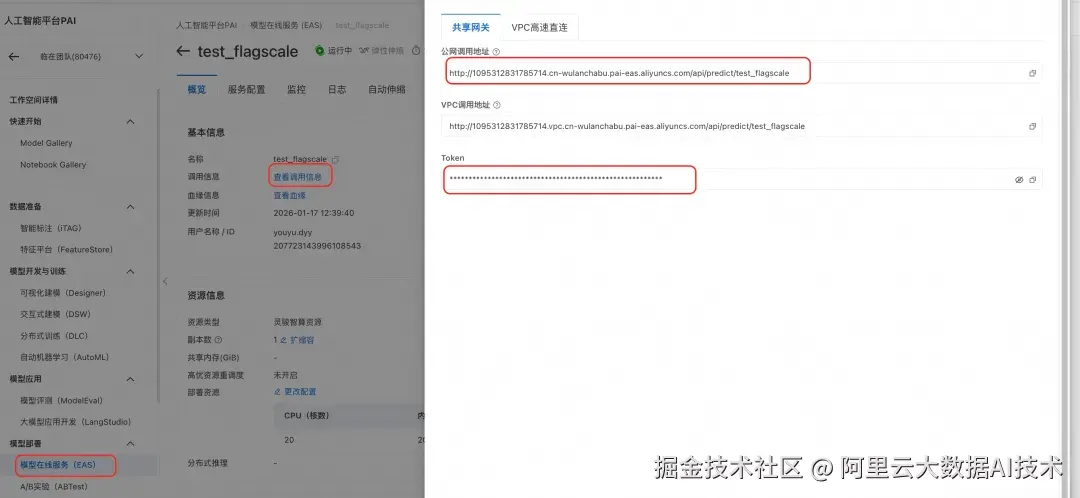

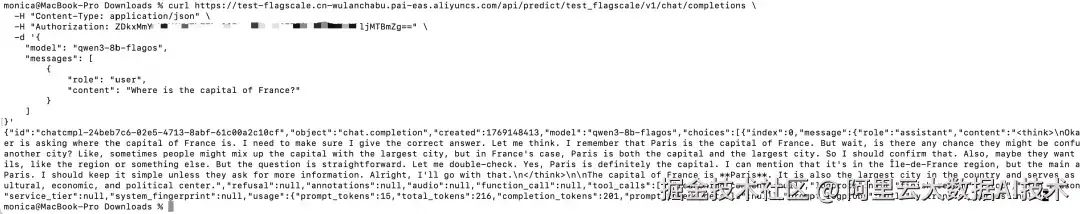

通过 PAi-EAS 服务部署过程

-

创建 PAI-EAS 服务,并选择相同的 FlagOS 镜像

-

获取鉴权信息

-

公网访问测试

plaintext

curl https://test-flagscale.cn-wulanchabu.pai-eas.aliyuncs.com/api/predict/test_flagscale/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: ZDkxM**************MTBmZg==" \

-d '{

"model": "qwen3-8b-flagos",

"messages": [

{

"role": "user",

"content": "Where is the capital of France?"

}

]

}'返回测试结果

基于这套 AI 底座,你能搭建什么

OPC 创业者和企业开发者可以在 PAI-DSW 上快速调试验证模型,满意后直接推到 PAI-EAS 稳定对外提供推理服务,将信息处理、内容生产、客户沟通等高频任务交给私有模型处理。从开发到部署,一套 FlagOS 镜像贯通,数据始终不出自己的环境------不依赖外部 API,不受 Token 成本约束,用私有化 AI 底座让 OPC 具备团队级能力。

关于众智 FlagOS 社区

为解决不同 AI 芯片大规模落地应用,北京智源研究院联合众多科研机构、芯片企业、系统厂商、算法和软件相关单位等国内外机构共同发起并创立了众智 FlagOS 社区。成员单位包括北京智源研究院、中科院计算所、中科加禾、安谋科技、北京大学、北京师范大学、百度飞桨、硅基流动、寒武纪、海光信息、华为、基流科技、摩尔线程、沐曦科技、澎峰科技、清微智能、天数智芯、先进编译实验室、移动研究院、中国矿业大学(北京)等多家在 FlagOS 软件栈研发中做出卓越贡献的单位。

FlagOS 是一款专为异构 AI 芯片打造的开源、统一系统软件栈,支持 AI 模型一次开发即可无缝移植至各类硬件平台,大幅降低迁移与适配成本。它包括大模型算子库、统一 AI 编译器、并行训推框架、统一通信库等核心开源项目,致力于构建「模型-系统-芯片」三层贯通的开放技术生态,通过"一次开发跨芯迁移"释放硬件计算潜力,打破不同芯片软件栈之间生态隔离。

- 社区官网:flagos.io

- GitHub地址:github.com/flagos-ai

- GitCode地址:gitcode.com/flagos-ai