一、引言

随着大模型、RAG、Agent等AI技术的爆发式发展,人工智能已渗透到各行业,企业对AI人才的需求呈现"井喷式"增长,但人才市场也良莠不齐。部分求职者通过包装简历、堆砌技术名词、夸大项目成果等方式伪装资深人才,导致企业"招错人、用错人",造成人力成本浪费和项目延误。传统评估模式依赖简历初筛和简单技术提问,缺乏对人才核心能力的系统性考察,无法适配AI领域"理论+实践+创新"的复合型要求。基于此,本文提出"技术面试+代码评审+项目复盘"三位一体的评估方案,结合2026年市场趋势、CAIE注册人工智能工程师认证及实际案例,为企业提供可落地的AI人才选型指南。

二、AI人才简历评估选型的核心痛点与现存问题

当前企业AI人才评估面临"识别难、匹配难、落地难"三大核心痛点,具体表现为:

(一)简历包装泛滥,真实能力难以识别

AI领域技术名词繁杂,部分求职者堆砌TensorFlow、PyTorch、RAG等热门词汇,夸大项目角色,甚至伪造项目经历、篡改成果。例如,某企业招聘时发现,声称"主导金融智能客服大模型微调,准确率95%"的求职者,仅参与过数据标注。同时,ATS系统的普及让部分求职者生硬堆砌关键词,加剧了简历与真实能力的脱节,初筛候选人质量参差不齐。

(二)评估维度单一,缺乏综合能力考察

传统评估多聚焦技术理论,忽视工程实践、问题解决和项目复盘能力,导致招聘到的人才"纸上谈兵"。部分企业过度依赖认证、学历等,陷入"唯认证论""唯学历论"误区,录用的高认证人才因缺乏落地经验,无法适配业务场景。

(三)岗位需求模糊,人才与岗位错配严重

部分企业JD描述模糊,未明确岗位层级、业务场景和核心职责,混淆"算法研究岗"与"算法工程岗"等需求,导致高级人才做基础工作、初级人才承担核心任务。同时,部分企业盲目跟风招聘大模型人才,未明确场景适配要求,导致人才无法对接实际业务。

(四)评估流程不规范,缺乏标准化体系

多数企业评估流程无标准,技术面试提问随意,代码评审和项目复盘缺乏系统框架,不同面试官标准不一,影响评估公正性。且未建立"评估-反馈-优化"闭环,同类错配问题反复出现。

三、AI人才简历评估选型的核心原则

针对上述痛点,构建三位一体评估方案需遵循四大原则:

(一)能力导向原则

打破"唯简历、唯学历、唯证书"局限,以实际能力为核心,通过实操考察验证求职者"能做什么、做过什么、做得怎么样",避免"纸上谈兵"型人才录用。

(二)岗位适配原则

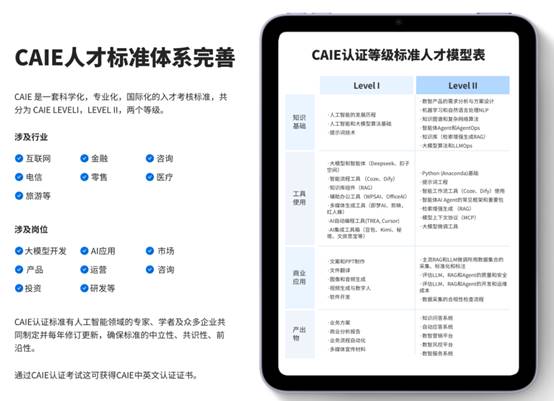

结合业务场景和岗位需求,制定差异化评估标准:初级岗侧重基础能力和学习力,中级岗侧重工程实践和问题解决,高级岗侧重创新、统筹和业务理解;算法研究岗重理论,工程岗重落地,大模型应用岗重前沿技术实操。可参考认证等级,提升适配度。

(三)协同联动原则

技术面试(理论+逻辑)、代码评审(实操+规范)、项目复盘(经验+解决能力)三个环节相互补充,评估结果相互印证,形成完整人才画像,避免单一环节的片面性。

(四)标准化、可落地原则

制定标准化评估流程、标准和评分体系,明确各环节考察内容和时间,确保面试官快速掌握方法,提升评估效率和公正性。

四、AI人才简历评估选型:技术面试、代码评审与项目复盘的综合运用方案

本方案以"简历初筛→技术面试→代码评审→项目复盘→综合评分→人才选型"为核心流程,融合三大考察环节,结合行业标准和案例,确保实用性和前沿性。

(一)前置环节:简历初筛------奠定评估基础,过滤无效简历

简历初筛核心是过滤无效简历,为后续环节铺垫,重点关注三点:

-

基础信息筛选:查看学历、工作年限、技能与岗位的契合度,过滤不符合基本要求的简历,优先选择技能描述具体(如"熟练用PyTorch实现大模型LoRA微调")的候选人。

-

项目经历筛选:关注项目规模、场景、候选人角色、核心职责和量化成果,谨慎筛选描述模糊、无成果的简历,结合认证筛选候选人,但不盲目依赖。

-

技能匹配度筛选:结合岗位需求,筛选具备核心技能的候选人,关注技能更新速度,优先选择了解前沿技术的候选人。

初筛后,借助AI智能寻源工具提升效率,同时人工复核避免遗漏优质人才。

(二)核心环节一:技术面试------考察理论功底与逻辑思维

技术面试由资深AI工程师担任面试官,时长40-60分钟,分为三个模块,结合行业高频题和认证重点考察:

1. 基础理论提问(15-20分钟)

初级岗重点提问机器学习范式、过拟合、基础算法等基础概念;中高级岗重点提问CNN、Transformer、大模型微调、RAG等深度理论,通过追问"为什么""怎么做"考察逻辑思维。

2. 技术深度提问(15-20分钟)

结合岗位类型和业务场景提问,如算法工程师考察模型选择、梯度问题解决,大模型应用工程师考察RAG搭建、Prompt优化,结合行业案例考察业务适配能力。

3. 逻辑思维提问(10-20分钟)

以开放性问题考察逻辑、分析和沟通能力,如"描述最复杂的AI技术问题及解决过程""如何规划AI项目并规避风险"等。

4. 技术面试评分标准

总分100分,基础理论(30分)、技术深度(40分)、逻辑思维(30分),按优秀(85+)、良好(70-84)、合格(60-69)、不合格(60-)分级,不合格者淘汰。

(三)核心环节二:代码评审------考察实操能力与编码规范

代码评审采用"现场编码+代码复盘"模式,时长60-90分钟,重点考察实操能力和编码素养。

1. 现场编码任务设计

初级岗设计基础任务(如Python实现线性回归、数据预处理);中高级岗设计复杂任务(如CNN模型实现、大模型LoRA微调、RAG核心开发),贴合实际业务场景。

2. 代码评审核心评估维度

重点关注5个维度:编码规范(缩进、命名、注释)、逻辑完整性(功能实现、边界条件)、性能优化(无冗余、效率提升)、异常处理(稳定性)、可读性与可维护性(模块化、注释清晰)。

3. 代码复盘与追问

候选人讲解编码思路和问题解决过程,面试官追问优化方向,考察分析能力和优化意识。

4. 代码评审评分标准

总分100分,编码规范(20分)、逻辑完整性(30分)、性能优化(20分)、异常处理(15分)、可读性(15分),分级淘汰不合格者。

(四)核心环节三:项目复盘------考察项目经验与问题解决能力

项目复盘时长40-60分钟,围绕简历核心项目,采用STAR法则,通过细节追问验证经验真实性,考察核心能力。

1. 项目复盘核心提问框架

围绕6个维度提问:项目背景与目标、候选人角色与职责、核心技术与实现过程、项目难点与解决方案、项目成果与量化指标、复盘与总结,结合具体场景避免泛泛而谈。

2. 项目复盘评估重点

重点关注三点:真实性(细节追问验证)、能力匹配度(与岗位和业务场景契合)、核心能力(问题解决、复盘、业务理解、协作能力)。

3. 项目复盘评分标准

总分100分,项目真实性(25分)、角色清晰度(20分)、技术应用(25分)、项目成果(15分)、复盘能力(15分),分级淘汰不合格者。

(五)收尾环节:综合评分与人才选型

结合三大环节评分,按权重计算综合得分,结合岗位需求和人才潜力选型。

1. 综合评分权重设计

初级岗:技术面试(40%)、代码评审(35%)、项目复盘(25%);中级岗:三者各35%、35%、30%;高级岗:技术面试(30%)、代码评审(25%)、项目复盘(45%)。综合得分=各环节得分×对应权重。

2. 人才选型标准

优秀(85+):重点录用,作为核心人才培养;良好(70-84):备选录用,结合岗位缺口考虑;合格(60-69):可作为储备人才,岗前培训后上岗;不合格(60-):直接淘汰。

3. 选型注意事项

避免"唯分数论",注重职业素养和价值观契合;关注人才潜力,培养储备人才;结合业务场景,优先录用行业相关经验者;建立评估反馈机制,持续优化体系。

五、方案实施保障措施

从面试官培养、标准优化、工具支撑三方面,确保方案落地:

(一)加强面试官团队建设

选拔资深AI工程师和技术负责人作为面试官,定期开展评估标准、提问技巧等培训,结合前沿技术和认证更新培训内容,建立面试官考核机制,挂钩绩效提升评估质量。

(二)完善评估标准与流程优化

动态更新评估标准,适配技术迭代和业务需求;优化评估流程,简化初级岗流程、强化核心岗考察;建立评估案例库,助力面试官提升"伪能力"识别能力。

(三)强化工具支撑,提升评估效率

借助ATS系统实现简历初筛自动化,利用在线编码平台辅助代码评审,通过评估管理工具规范评估过程、留存数据,降低面试官负担。

六、案例分析

结合某互联网企业大模型应用工程师招聘案例,验证方案有效性:

(一)企业背景与招聘需求

该企业计划招聘5名中级大模型应用工程师,要求掌握LoRA微调、RAG等技术,有落地经验。此前传统招聘模式导致录用人才实操薄弱、经验夸大,项目延误。

(二)方案实施过程

- 简历初筛:筛选30名符合要求的候选人,优先选择 Level II认证且项目贴合的候选人;2. 技术面试:淘汰12名理论薄弱者,剩余18人进入代码评审;3. 代码评审:设计RAG系统开发任务,淘汰7名实操不合格者,剩余11人进入项目复盘;4. 项目复盘:淘汰4名经验夸大者,剩余7人进入综合评分;5. 选型:按中级岗权重计算得分,录用5名80分以上候选人。

(三)方案实施效果

录用人才快速适配岗位,3人可主导核心项目,项目推进效率提升40%,人才留存率达80%,企业建立标准化评估体系,招聘效率和质量显著提升。

七、结论与展望

本文提出的三位一体评估方案,打破"唯简历论",有效解决AI人才招聘痛点,具备较强实操性,可帮助企业精准选型、降低成本。未来,需结合AI技术优化评估效率,加强与高校、协会合作,结合CAIE认证建立人才培养与评估一体化体系,实现人才与企业共生共赢。