一:增量快照

在 1.15 之前,只有RocksDB 支持增量快照。不同于产生一个包含所有数据的全量备份,增量快照中只包含自上一次快照完成之后被修改的记录,因此可以显著减少快照完成的耗时。

Rocksdb状态后端启用增量checkpoint:

EmbeddedRocksDBStateBackend backend = new EmbeddedRocksDBStateBackend(true);从 1.15 开始,不管hashmap还是rocksdb 状态后端都可以通过开启changelog实现通用的增量checkpoint。

1:执行过程

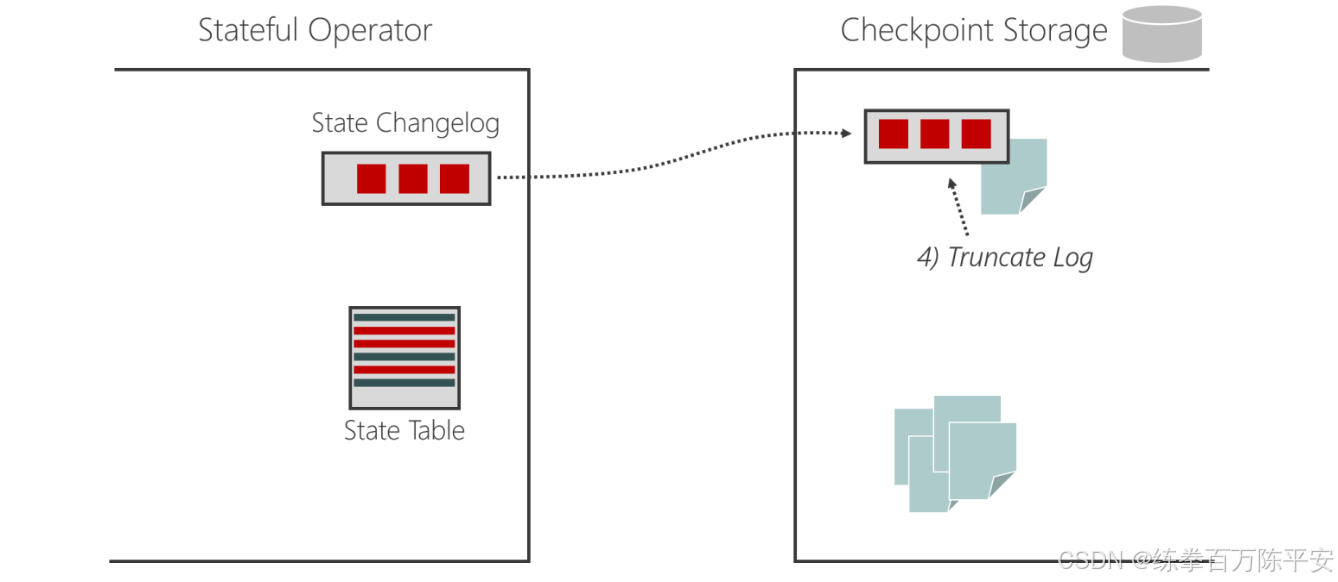

带状态的算子将状态内容写到两个地方,第一个是状态变更日志、第二个是状态表。状态变更日志是持续性的往磁盘中写,状态表不是,状态表是大概十分钟写一次。当我们状态表

状态物化:状态表定期保存,独立于检查点。状态物化完成后,状态变更日志就可以被截断到相应的点

这种方式,会出现很多很多的小文件。

2:使用方式

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-statebackend-changelog</artifactId>

<version>${flink.version}</version>

<scope>runtime</scope>

</dependency>

开启changelog:

env.enableChangelogStateBackend(true);二:最终检查点

如果数据源是有界的,就可能出现部分Task已经处理完所有数据,变成finished状态,不继续工作。从 Flink 1.14 开始,这些finished状态的Task,也可以继续执行检查点。自 1.15 起默认启用此功能,并且可以通过功能标志禁用它:

Configuration config = new Configuration();

config.set(ExecutionCheckpointingOptions.ENABLE_CHECKPOINTS_AFTER_TASKS_FINISH, false);

StreamExecutionEnvironment env =StreamExecutionEnvironment.getExecutionEnvironment(config);有界数据,某个算子已经处理完毕所有数据,这个将不会再做检查点备份。后边的算子可能仍然会运行。

有这么一个设置可以关闭,但是我们生产中不会关闭。

config.set(ExecutionCheckpointingOptions.ENABLE_CHECKPOINTS_AFTER_TASKS_FINISH, false);