目录

[1.1、输入嵌入层(Text & Position Embedding)](#1.1、输入嵌入层(Text & Position Embedding))

一、预训练模型

1、概述

早期的自然语言处理需为每个任务单独训练模型,严重依赖人工标注数据,存在两大局限:语言知

识难以复用导致训练成本高;专业领域标注数据获取困难。为此研究者提出"预训练+微调"范式:

先在大规模未标注语料上学习通用语言规律,再通过少量标注数据适配具体任务。

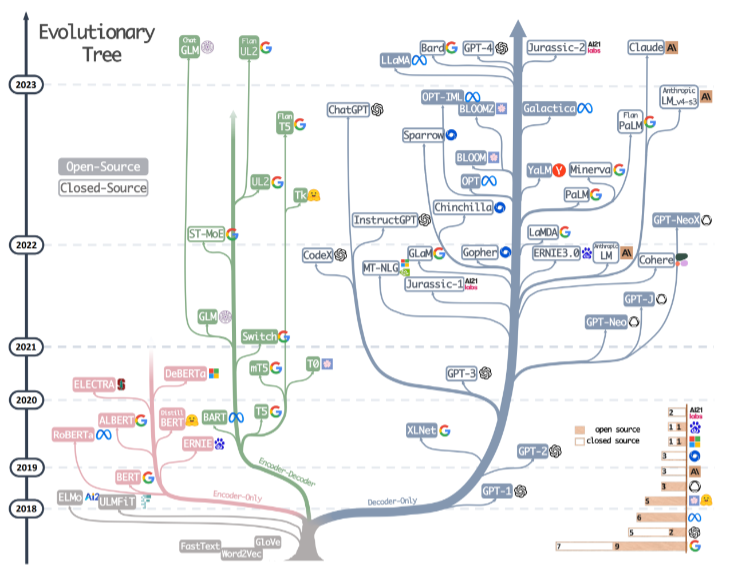

2、分类

预训练语言模型多基于Transformer架构,因其相比传统RNN具有并行计算效率高、长距离建模能

力强、结构灵活通用、易于扩展迁移等优势。

根据使用方式,Transformer预训练模型分为三类:

-

解码器模型:仅用解码器,代表为GPT(OpenAI,2018.6)。

-

编码器模型:仅用编码器,代表为BERT(Google,2018.10)。

-

编码器-解码器模型:同时使用编码器和解码器,代表为T5(Google,2019.10)。

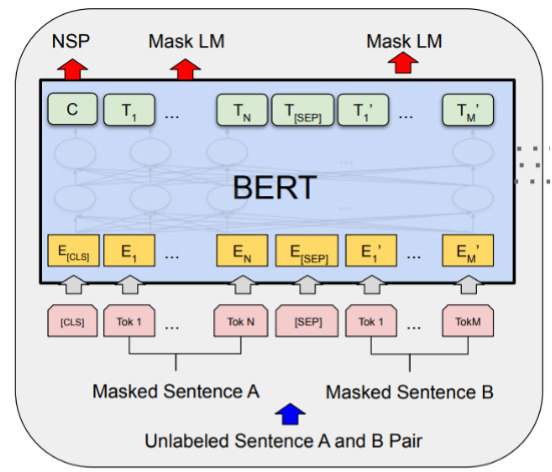

二、GPT

GPT(Generative Pre-trained Transformer)是首个系统提出"预训练+微调"范式的语言模型。其核

心是通过大规模无监督语料进行生成式(有mask机制)预训练------根据左侧上下文预测下一个

词,学习语言的通用规律;再通过微调适配具体下游任务。

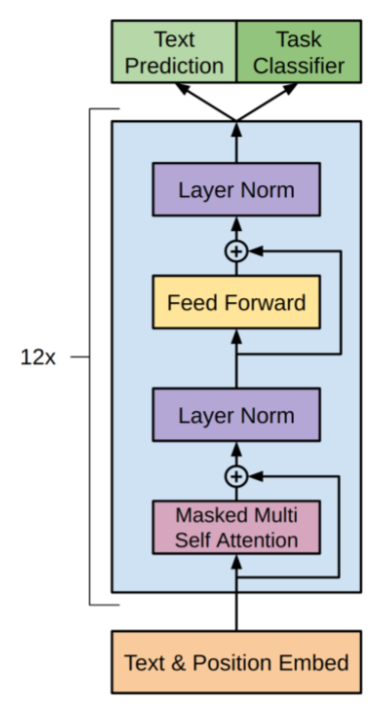

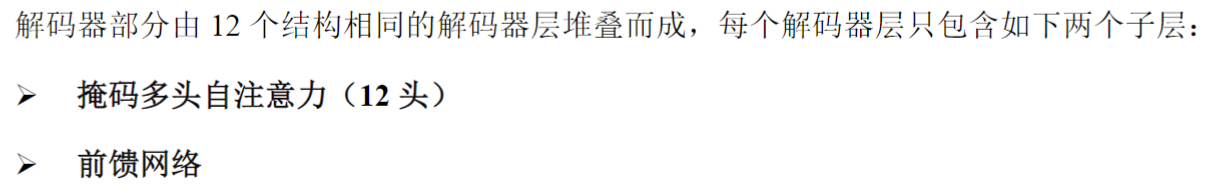

1、模型结构

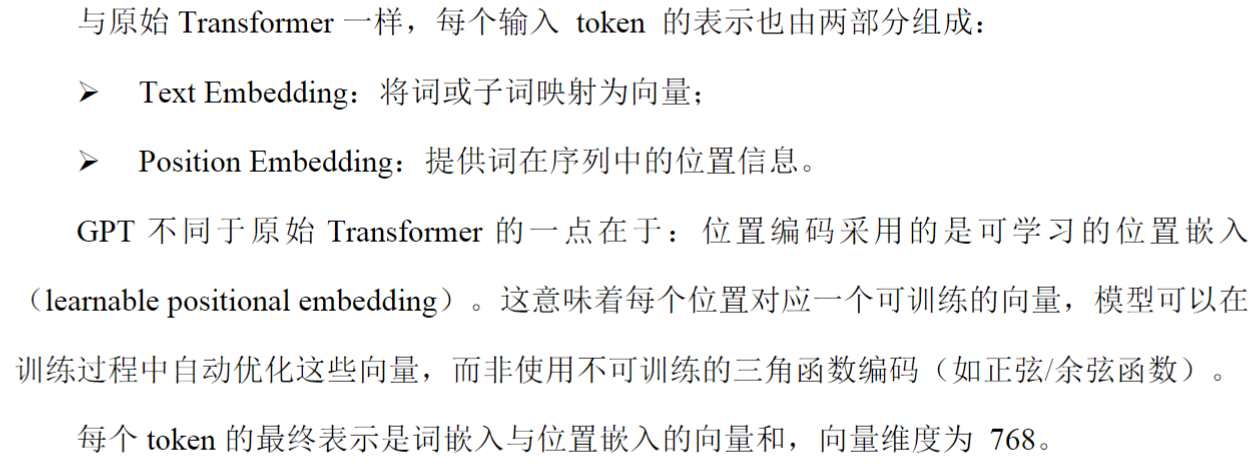

1.1、输入嵌入层(Text & Position Embedding)

1.2、解码器

1.3、输出层

GPT模型根据任务类型接入不同的任务头:

-

文本预测头(Text Prediction) :输出词表大小的概率分布(经Softmax获得),用于下一个词生成,预训练阶段使用。

-

任务分类器头(Task Classifier) :提取特定位置表示(如最后一个token)对整个文本分类,用于微调阶段适配下游任务(如情感分析、话题识别)。

2、预训练

GPT的预训练采用生成式语言建模 (根据前文预测下一个词),在无监督文本上进行自监督学习,无需人工标注,大幅降低数据成本。

其Transformer架构 通过全局自注意力机制 有效建模长距离依赖,同时并行计算特性提升了训练效率,使得大规模语料预训练成为可能。

3、微调

GPT的微调阶段是在预训练基础上,使用有监督数据 对模型进行端到端优化,使其适应具体任务,

实现知识迁移:

-

添加任务输出层:在模型顶部引入线性层(Linear Head),将隐藏状态映射为任务标签。

-

统一输入格式:将各类下游任务重构为连续的文本序列,适配自回归模型的输入要求。

三、BERT

BERT(Bidirectional Encoder Representations from Transformers)核心在于采用Transformer编

码器 结构,通过双向自注意力机制,在建模每个token时同时整合左右两侧的上下文信息,从而获

得更准确、丰富的语义表示。

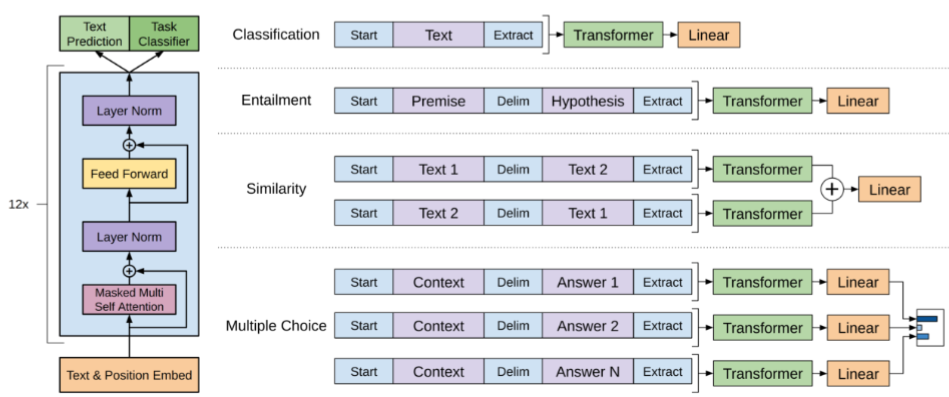

1、模型结构

1.1、输入表示层

BERT的每个输入Token表示由以下三部分嵌入相加而成:

-

Token Embedding:词本身的语义表示。

-

Position Embedding:表示Token在序列中的位置,为可学习向量。

-

Segment Embedding:用于区分句子对任务中的两个句子(如NSP任务),分别用可学习的向量表示。

在BERT的输入序列中,还包含两个特殊符号:

-

CLS (句首标志):其对应的输出向量常被用作整个输入序列的汇总表示(整句语义向量),特别适用于下游的文本分类任务。

-

SEP (分隔符):用于标记句子的结束,通常出现在每个句子的末尾,在句子对任务(如问答、自然语言推断)中用于区分两个句子。

1.2、编码器

和原始Transformer相同

1.3、输出层

根据下游任务类型,BERT接入不同的任务输出头:

-

Token-Level任务 (如命名实体识别):使用每个位置对应的输出表示进行分类。

-

Sequence-Level任务 (如文本分类、句子对分类):使用特殊Token CLS 的输出表示(输入时位于序列开头),该向量专门用于汇总整个序列的语义信息。

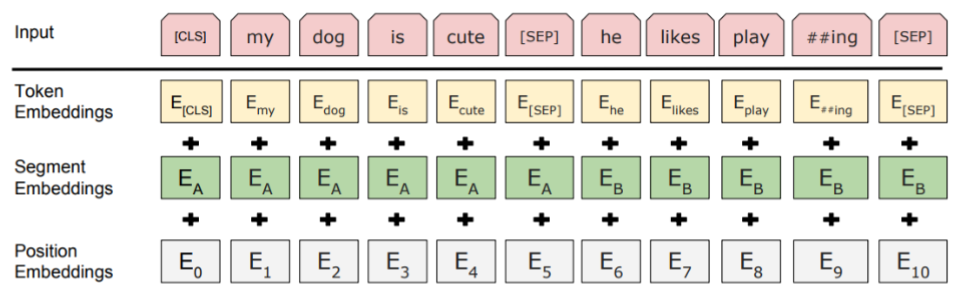

2、预训练

BERT的预训练包含两个核心任务:

-

掩码语言模型(MLM) :为实现双向建模,随机遮盖15%的token进行预测。遮盖策略为:80%替换为

[MASK],10%替换为随机词,10%保持不变。这使得模型能够融合左右两侧上下文进行预测。 -

下一句预测(NSP):为理解句间关系,模型需判断第二句是否为第一句的真实后续句。其中50%为正例(相邻句子),50%为反例(随机采样)。

3、微调

在预训练完成后,BERT可通过少量微调适配多种下游任务(如文本分类、句子匹配、问答系统、

序列标注等)。微调时,模型主体结构保持不变,仅在顶部添加一个任务特定的输出层,并使用下

游任务数据对整个模型进行端到端训练。

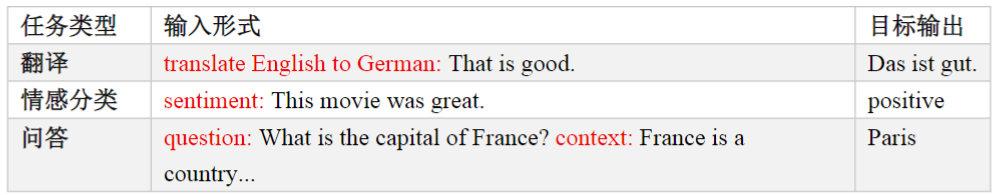

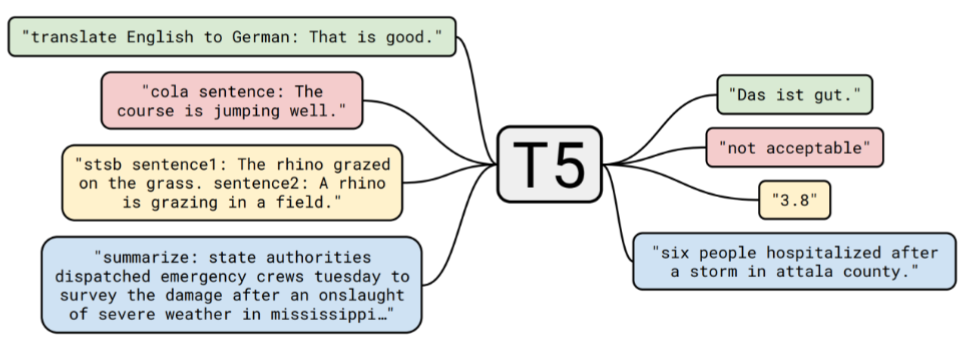

四、T5

T5(Text-to-Text Transfer Transformer)首次在完整的Transformer编码器-解码器结构上实现预训

练语言模型。其核心思想是将所有自然语言处理任务统一表示为"文本到文本"的转换问题。即无论

任务是文本分类、问答还是翻译,模型的输入和输出均是自然语言形式的字符串。

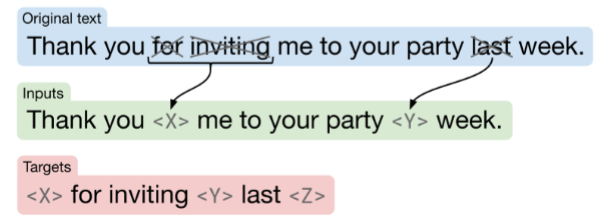

1、预训练

T5模型的预训练目标称为Corrupted Span Prediction(破坏跨度预测),具体过程如下:

-

随机遮盖 :在输入文本中随机选择若干段**连续片段(span)**进行破坏。

-

替换标记 :将每个被遮盖的连续片段替换为一个特殊的哨兵Token (如

<extra_id_0>),而非使用[MASK]。 -

生成目标 :模型以编码器-解码器的方式运行,令解码器自回归地生成这些被遮盖的连续片段内容(以哨兵Token分隔)作为输出序列。

2、微调