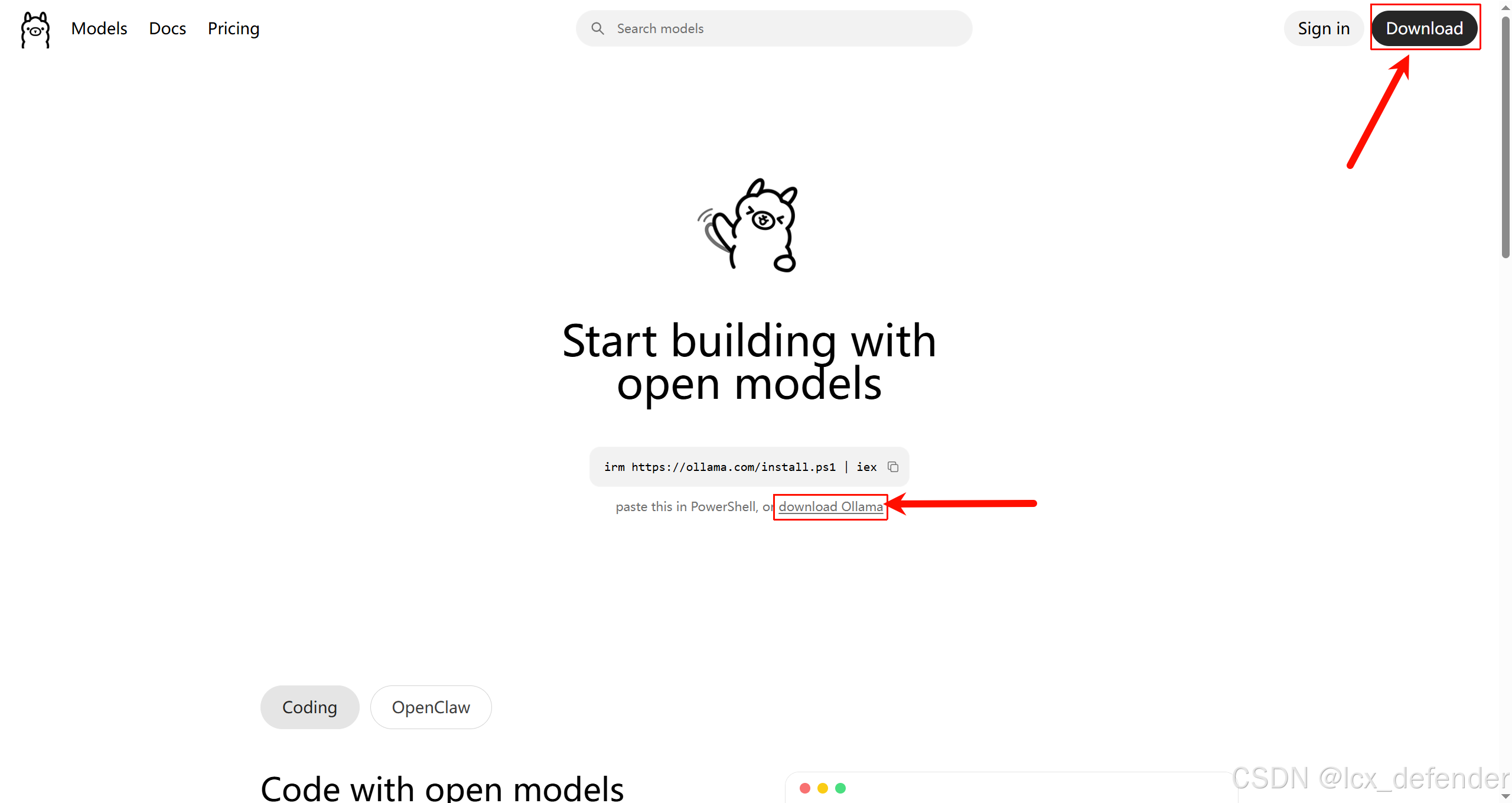

下载安装Ollama

Ollama 官网下载

https://ollama.com/ 箭头所指按钮任意一个都可以

选择下载方式

使用上方指令,或者点击按钮都可以,此处选择点击按钮

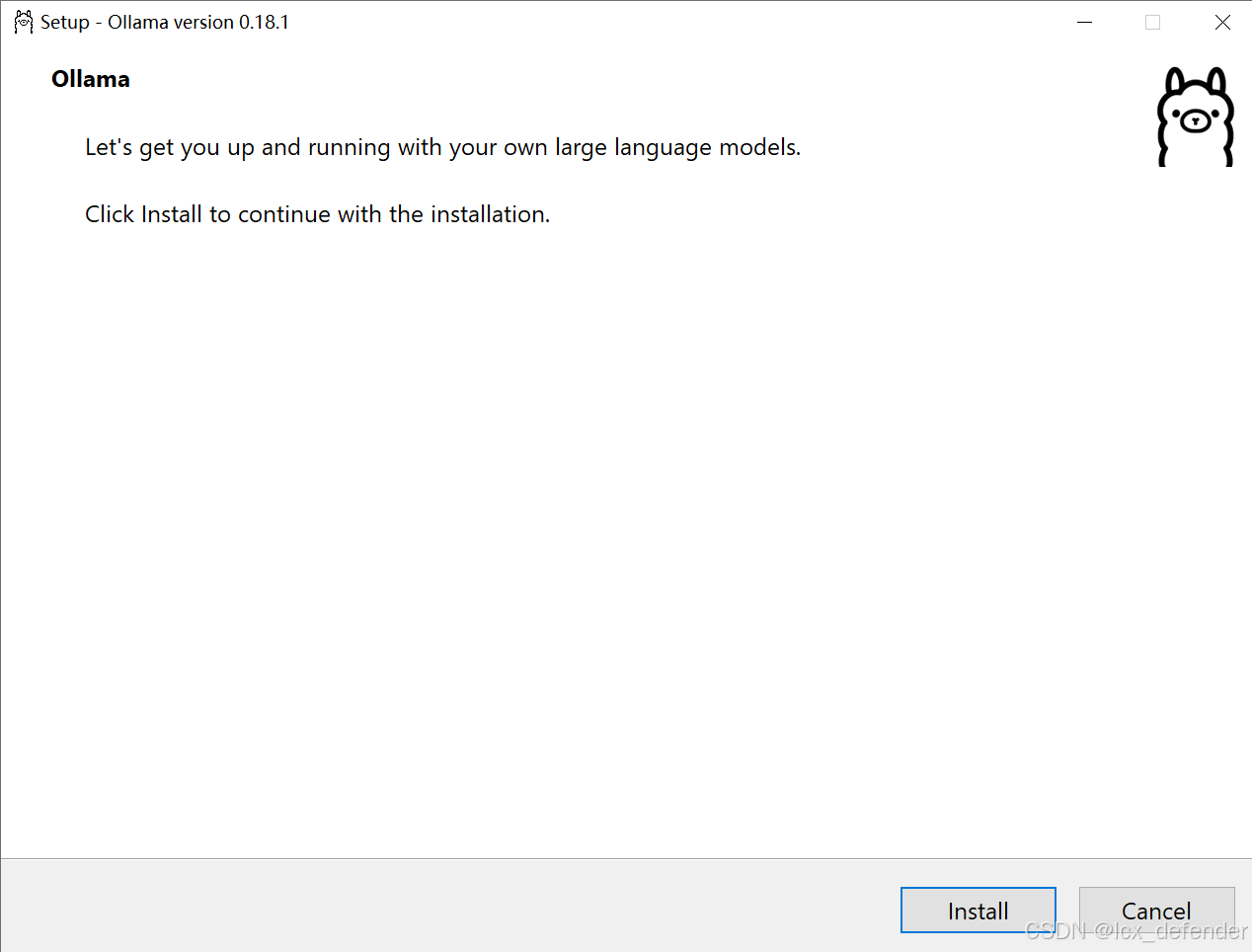

双击运行下载的exe文件

点击 install 等待安装完毕

下载模型

方法一

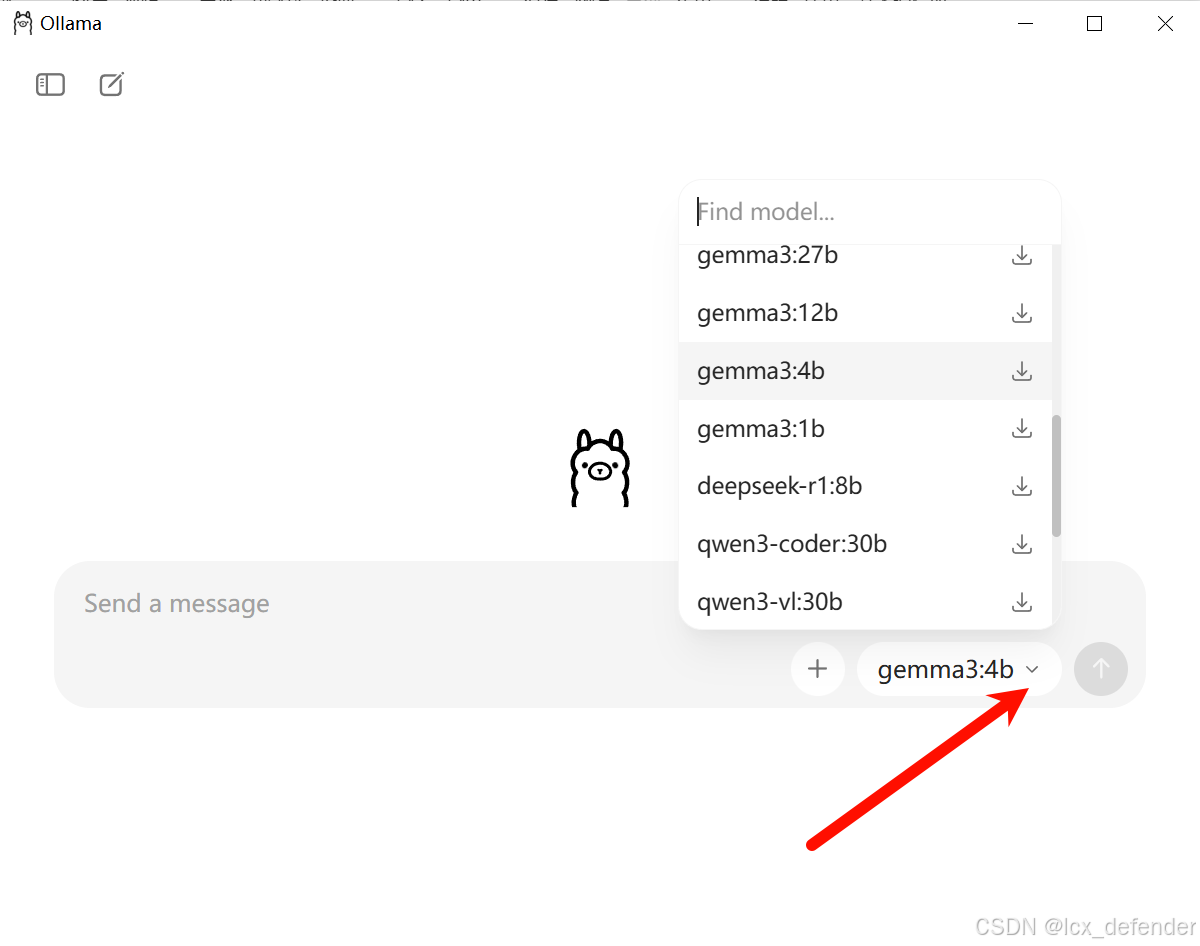

安装完毕后弹出的对话框里有ollama平台能够下载的所有大模型,从中选择你需要的模型

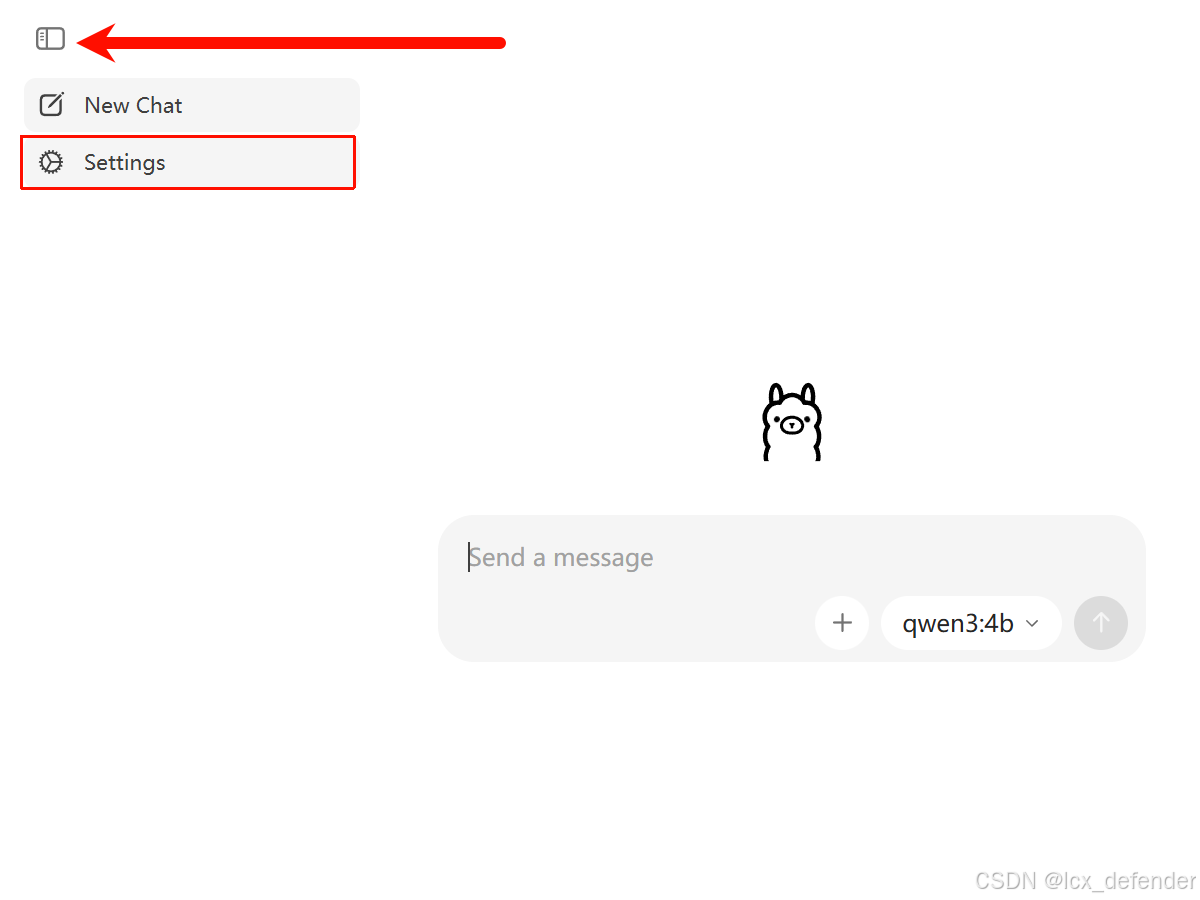

点击展开侧窗,点击settings,可以修改下载模型本地存储地址。第一次对话没有对应模型就会自动去下载

方法二:使用指令下载

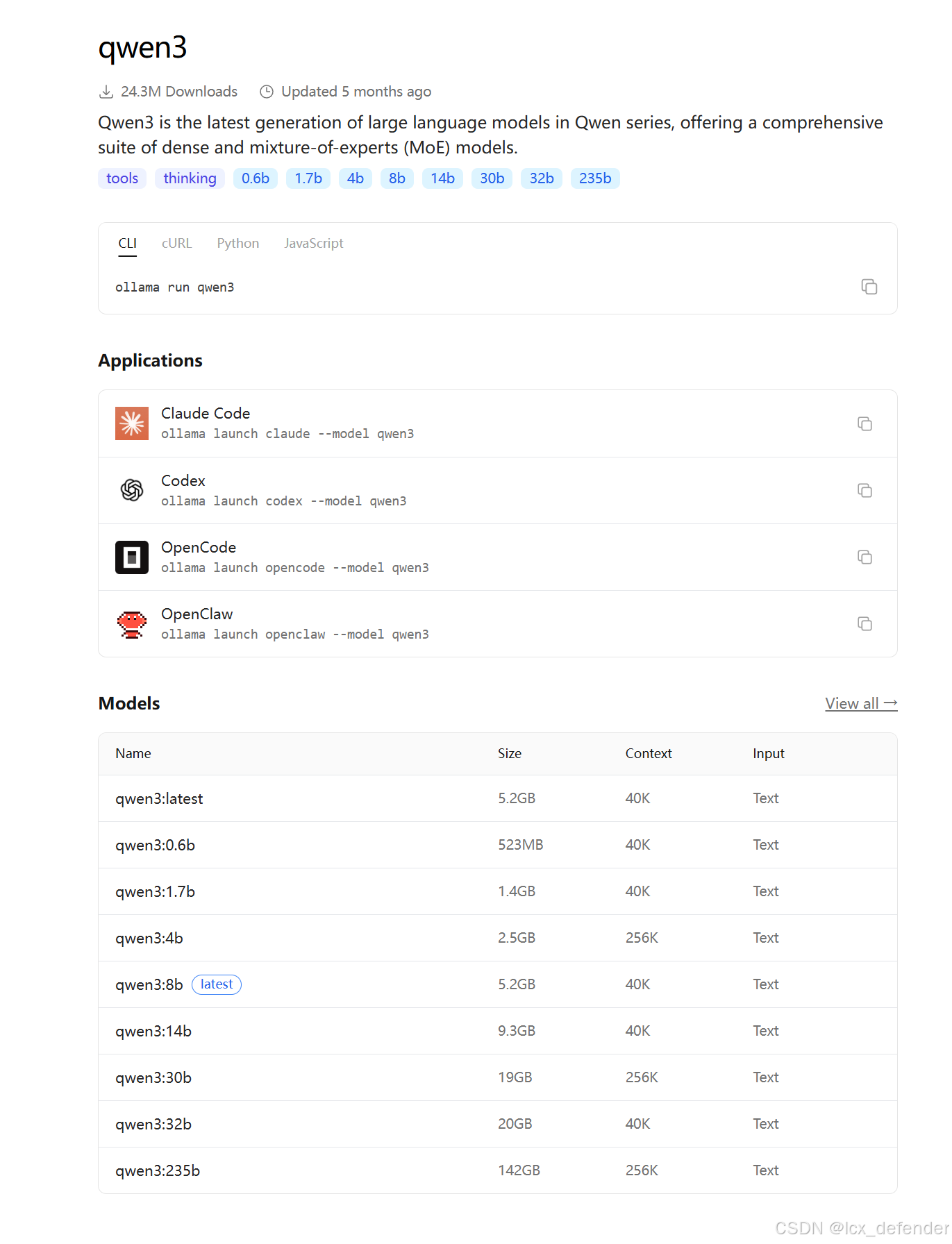

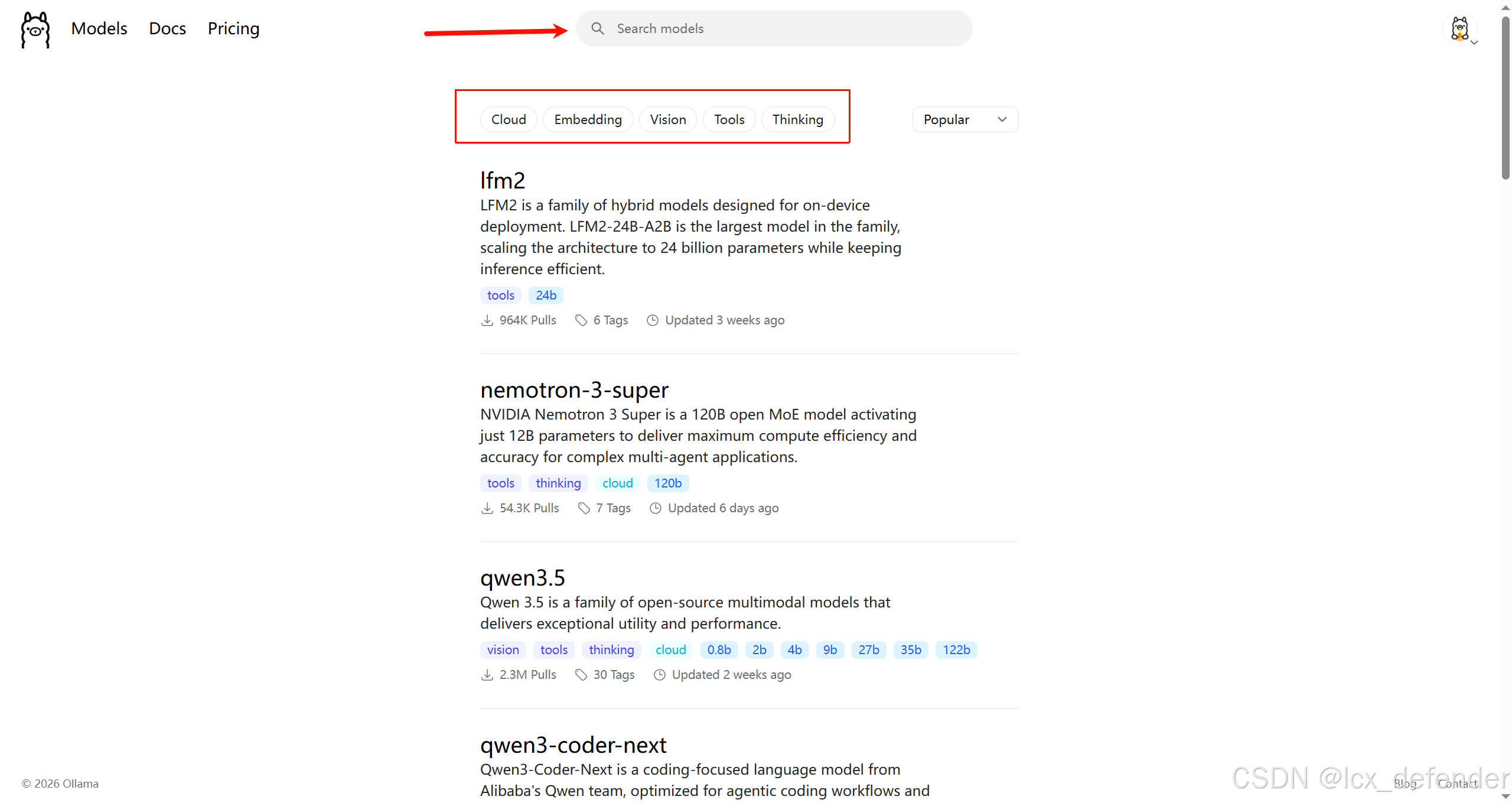

在官网中,点击 Models 进入模型选择界面 https://ollama.com/search,根据想找的模型类型或者自己根据模型名称去搜索想要的模型。其中只有 cloud 标签的模型,只能使用 ollama 云端部署版本。其他模型,点击进入可以选择对应合适的体量去部署,以 qwen3.5 为例

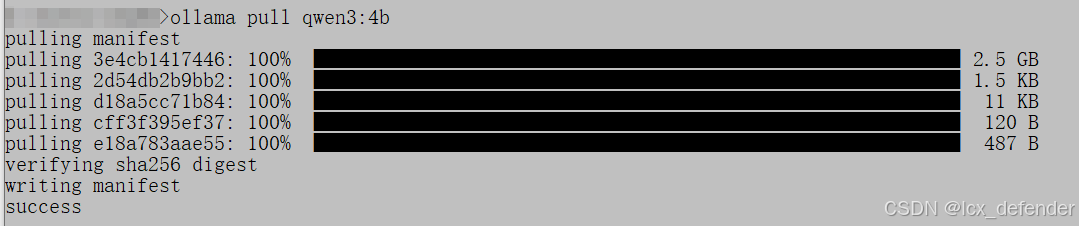

可以通过以下指令下载,Windows上直接在CMD或powshell上执行:

bash

# 基本格式

ollama pull 模型名称

# 以qwen3示例,中括号里的规模大小可选,如果不填默认为最新版

ollama pull qwen3[:4b]

# 拉取后直接运行

ollama run 模型名称