一、说明

对于线性方程组同时存在多种解释,几何解释和代数变换的解释。线性代数中蕴含着一种微妙而深刻的对偶性,这种对偶性很少被明确指出。同一个方程、同一个矩阵,根据我们解释的方式不同,可以代表两个截然不同的数学概念。

二、线性方程组的对偶性

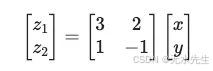

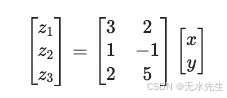

考虑以下简单的矩阵方程:

这个简单的方程可以有两种截然不同的解释,每一种都揭示了不同类型的"线性"。理解这种二元性对于理解线性代数在不同领域的应用至关重要------从解决工程问题到理解神经网络。

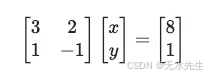

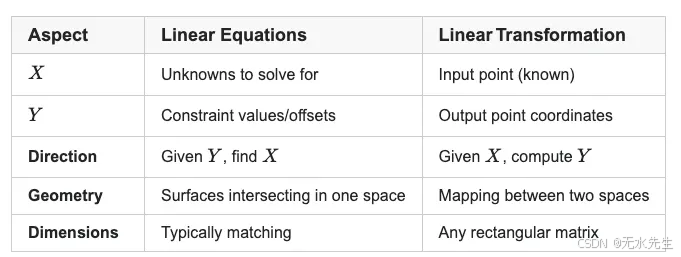

图 1:同一个方程代表了两个截然不同的概念------约束交集(左)与空间变换(右)

在上图中有两个解释方法:

1 几何解释:俩个直线的交集是一个点,即直线方程的解。

2 代数解释:对点(2,1)进行矩阵变换,映射到另一个点(8,1)

三、第一线性性质:以线性方程组作为约束条件

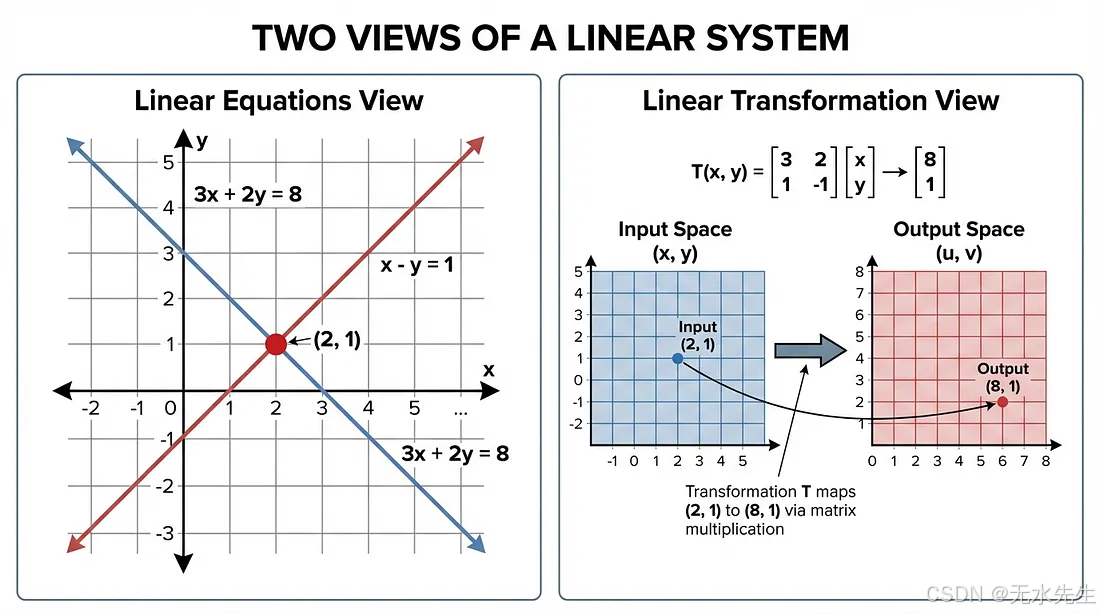

我们初次学习线性方程组时,会发现它们以约束系统的形式出现:

在这种解释中,"线性"意味着每个方程都是一个一次多项式。没有像x²这样的平方项,没有像xy这样的乘积项,也没有指数函数或三角函数。只有变量乘以常数并相加。

从几何角度来看,每个方程都定义了一个平面约束曲面。在二维空间中,每个方程代表一条直线;在三维空间中,代表一个平面;在更高维度中,代表一个超平面。该方程组的解是所有这些约束曲面的交点。在我们的例子中,两条直线相交于点 ( x , y ) = (2, 1)。

3.1 偏移量的作用

在这种解释中,变量 ( x , y ) 是我们试图找到的未知数。矩阵A中的系数定义了每个约束曲面的方向(平面的法向量)。右侧的值 (8, 1) 是偏移参数,用于确定每个平面相对于原点的偏移量。

关键在于,值 8 和 1并非与 ( x , y )处于同一几何空间中的坐标。它们是标量参数,用于控制约束曲面的位置。如果我们把 8 改为 0,第一条线会移动到原点,但 0 并不会变成 xy 空间中的一个"点"------它仍然是一个标量偏移参数。

图 2:约束视图显示在同一空间内相交的曲面(上图),而变换视图则在不同空间之间映射(下图)

这种解释在物理和工程中的方程组求解、电路分析、结构分析以及任何需要同时满足多个约束条件的问题中都占据主导地位。

3.2 第二线性性:线性变换作为映射

现在考虑同样的方程,但改写成:

在这种解释中,我们不是求解未知数,而是将输入点 ( x , y )转换为输出点 ( z1 , z2 )。当我们代入输入 (2, 1) 时,就得到了输出 (8, 1)。

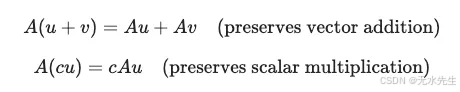

此处,"线性"的含义在几何上有所不同。线性变换满足:

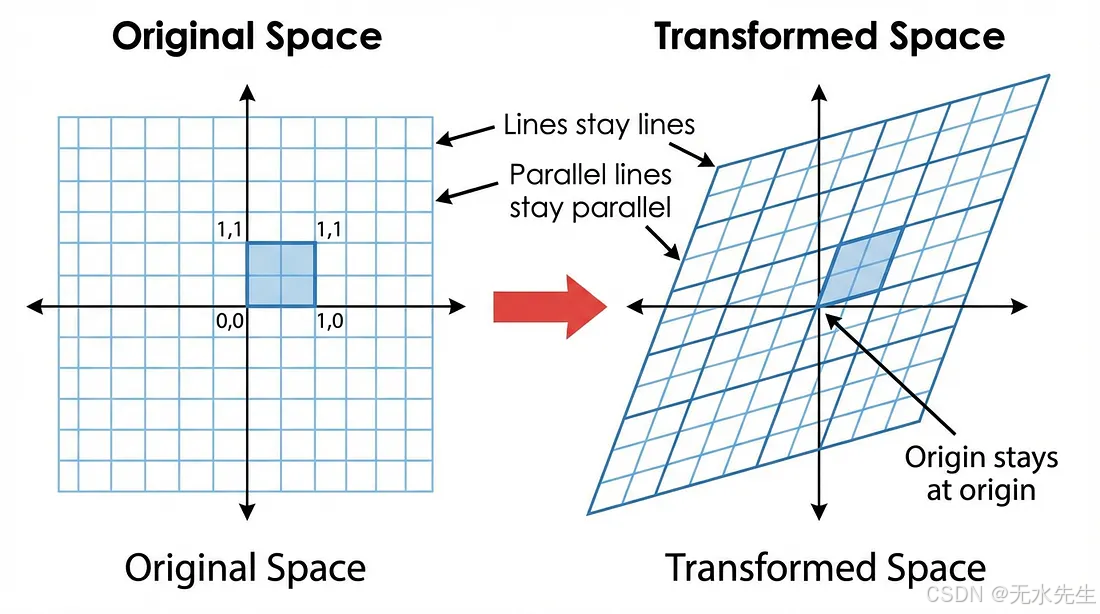

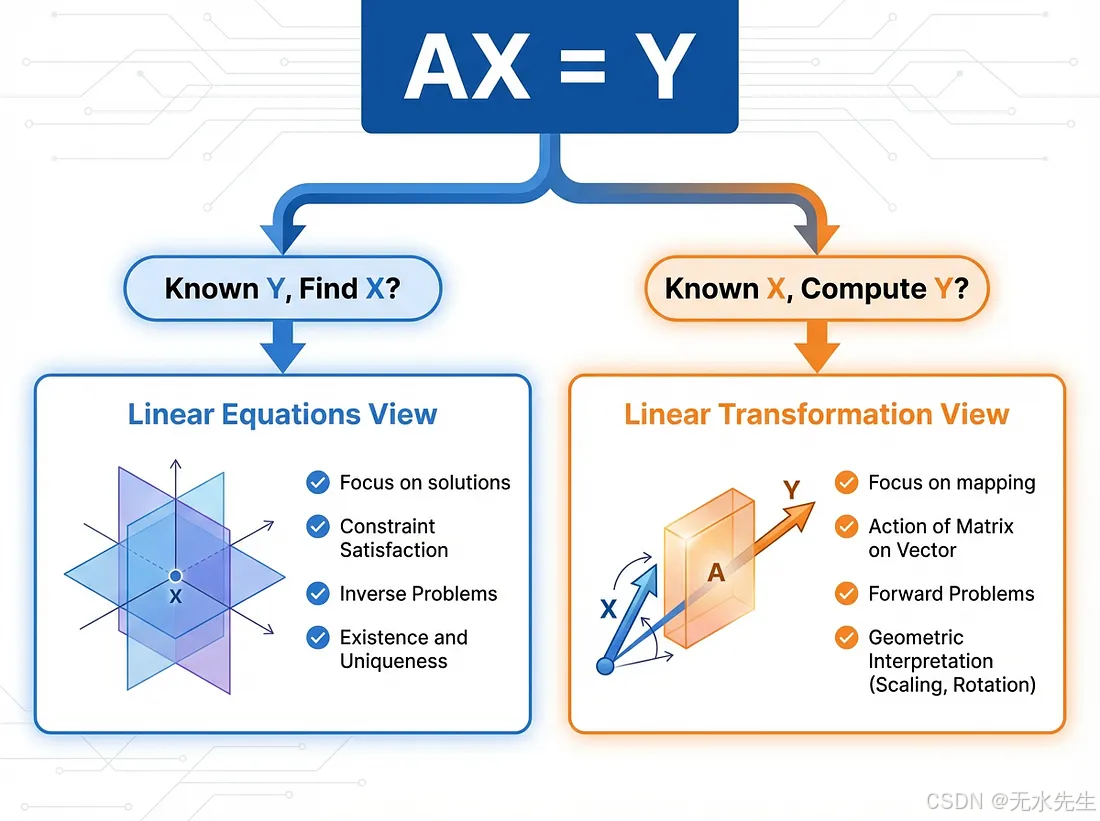

这造就了强大的几何特性:直线仍然是直线,平行线仍然平行,原点映射到原点,沿同一方向的相对距离保持不变。这种变换可以旋转、拉伸、压缩、剪切和投影空间,但不能弯曲或折叠空间。

一个熟悉的性质:成对线性

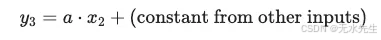

理解变换中"线性"的含义还有另一种方法,它与我们从基础代数中获得的直觉相联系。在y = Ax中,当所有其他输入保持不变时,任何特定的输出分量与任何特定的输入分量都具有纯粹的线性关系。

例如,如果我们观察输出y3如何依赖于输入x2(同时固定所有其他输入),我们总是会得到:

这是二维图中常见的直线关系------没有曲线,没有x²项,只有一个恒定的斜率a (即矩阵A的 (3,2) 元素)。这一性质适用于每一对输入和输出分量。矩阵中的每个元素Aij都代表了输出yi如何响应输入xj的变化的斜率。

这就是为什么我们称之为"线性"------任何单个输入和输出分量之间的关系始终是一条直线。

图 3:线性变换保持直线和平行性------想象一张带有网格的橡胶片,它可以拉伸和扭转,但永远不会弯曲或折叠。

想象一下,一张印有网格的橡胶片------你可以拉伸和扭转这张橡胶片,但网格线仍然保持笔直。

3.3 组件的作用

在变换解释中,输入 ( x , y ) 是输入空间中的一个点(不是待求解的未知数)。输出 ( z1 , z2 ) 是输出空间中的一个点(不是约束参数)。矩阵A描述了如何将整个输入空间变形为输出空间。

关键在于,输入和输出本质上是同一类事物:它们都是向量空间中的点,只是可能存在于不同的维度空间中。

四、不同维度

与约束视图不同,变换视图自然地处理不同的输入和输出维度:

这种变换将二维输入空间映射到三维输出空间。整个xy平面被嵌入并变形到三维空间中。输出维度由矩阵A的行数决定。这在变换视角下完全自然,但在约束方程框架下却显得有些笨拙。

4.1 根本区别:Y 是什么?

核心区别在于等式AX = Y中输出 Y的性质。

在线性方程视图中, Y的值是平移参数或约束值。它们决定每个约束曲面的位置,但它们本身并非与X处于同一几何空间中的坐标。例如,当您输入3x +2y = 8 时,数字 8 表示直线从原点平移的距离------它并非 xy 空间中的坐标。

在线性变换视图中, Y中的值构成输出空间中的一个点。它们是坐标,就像X包含坐标一样。X和Y都是几何点------同一种类型的对象,只是可能位于不同维度的空间中。当你写出Z = AX并从输入X = (2,1)得到Z = (8,1) 时,点 (8,1) 是输出空间中的一个真实位置。

4.2 同样的方程式,两种解释

这种二元性尤其令人困惑的地方在于,同一个符号方程式同时代表了这两种性质:

解释一:求解未知数

• (x,y)是待求的未知数

• (8,1)是目标值(标量,不是 xy 空间中的点)

• 几何:xy空间中两条直线相交

• 方向:已知输出,求输入(逆输入)

解释 2:正向变换

• (x,y)是输入坐标(一个已知点)

• (z1,z2)是输出坐标(输出空间中的一个点)

• 当 ( x , y ) = (2, 1) 时,它映射到 (8, 1)。

• 方向:给定输入,计算输出(正向)

在约束视图中,我们已知右侧,然后反向推导以找到左侧。在变换视图中,我们已知输入,然后正向推导以计算输出。同样的代数运算,方向相反。

图 4:选择 AX = Y正确解释的决策指南

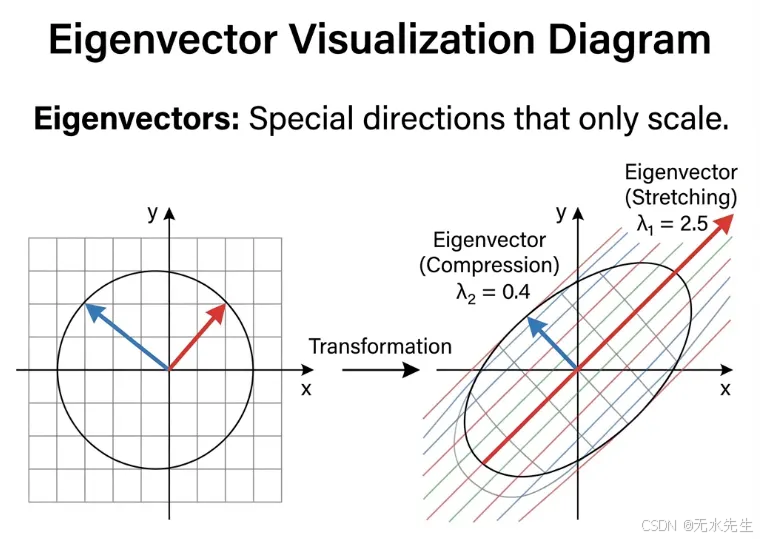

4.3 特征值何时重要:一个特例

特征值和特征向量属于变换解释的一个特例------当变换将一个空间映射回自身时。

图 5:特征向量是特殊的方向,它们在变换过程中只会发生缩放(而不会发生旋转)。

特征值分解要求矩阵A为方阵(n×n),这意味着输入空间和输出空间具有相同的维度。当我们写出A = Q Λ Q −1 时,它揭示了特征向量(仅被缩放的特殊方向)和特征值(缩放因子)。

特征向量的概念要求Av = λv ,这只有在v和Av位于同一空间时才有意义。如果A是矩形的(例如 128×784),则输入是 784 维的,而输出是 128 维的------它们不可能互为标量倍数。

对于像Yn + 1 = AYn 这样的迭代系统,特征值分解至关重要。这需要平方A,以便输出可以作为输入反馈。特征值控制着系统的长期行为:

如果 | λi |<1,则该方向上的分量衰减

• 如果 ∣λi ∣ >1,它们就会增长

• 如果 ∣ λi ∣=1,则它们持续存在

例如人口动力学、马尔可夫链和稳定性分析。

特征值分解并不能告诉我们约束平面相交的情况。它纯粹是关于将A理解为一种几何算子,该算子会变形空间,并且仅适用于空间能够映射回自身的情况。实际上,大多数变换矩阵都是矩形的,并且没有标准的特征值分解。

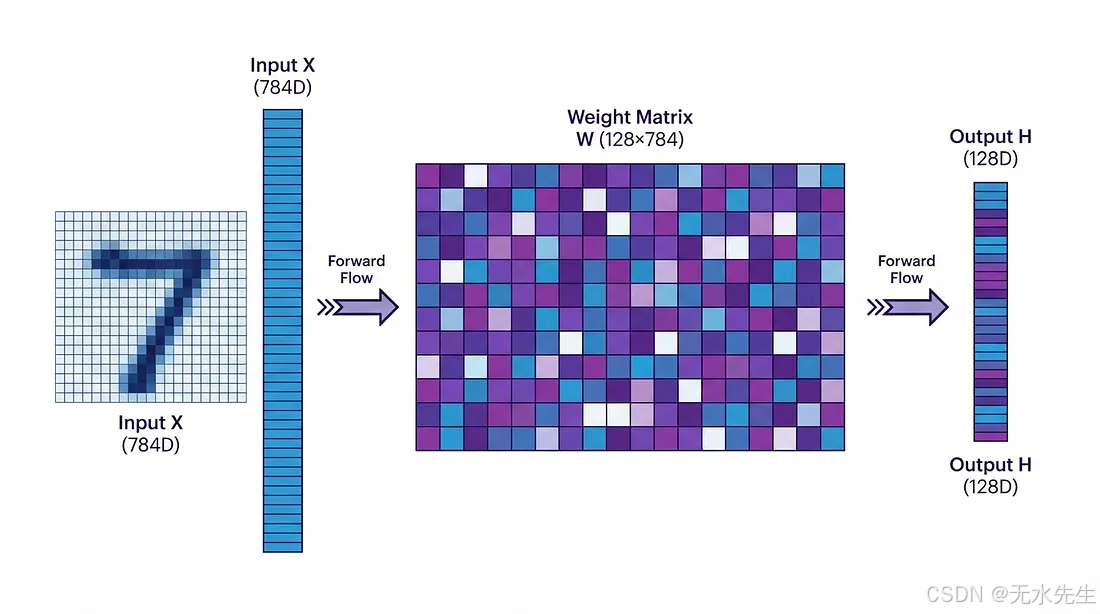

4.4 神经网络:纯粹的转换思维

神经网络清晰地展示了这种变换的解释。一个典型的线性层计算如下:

H=WX+bH = WX + bH=WX+b

其中X可能是一个 784 维向量(扁平化的 28×28 图像),W是 128×784,H是 128 维的。

图 6:神经网络层执行维度变换,将高维输入空间映射到逐渐降低的维度。

这并非解方程。我们并非在寻找满足约束条件的X。相反, X是已知的输入数据,W将其从 784 维空间变换到 128 维空间,H是由此产生的输出点。下一层将H进行进一步变换。

典型的网络具有维度变换:784→128→64→10。每一层都会在不同维度的空间之间进行旋转、拉伸和投影。原始的784维数据形成一个纠缠的点云,其中不同的数字类别混合在一起。每一层逐步解开这个点云,直到不同的类别被分离出来。

这纯粹是变换几何------"旋转和拉伸"的解释。约束方程的视角并不适用。我们从不问"什么输入满足这些约束?",我们总是问"这个输入映射到哪里?"权重矩阵是矩形的,所以它们没有标准意义上的特征值。我们通过维度改变的变换进行前向传播。

六、物理角度的解释

6.1 物理学与数据科学:侧重点不同

物理学通常从标量定律出发,并通过自然对称性将其扩展到多维空间。例如,一维空间中的牛顿第二定律F = ma 在三维空间中仍然成立。这是因为物理空间是各向同性的------x、y 和 z 方向是等价的。矢量符号通常是对各个方向上相同的标量方程的简洁表示。

数据科学始于高维空间。一个包含 1000 人、每人 50 个测量值的数据集,从一开始就是一个矩阵。这些维度(年龄、收入、血压)没有对称性------单位、尺度和含义各不相同。操作本质上是转换视图:

• 降维投影发生在不同的维度空间之间

• 神经网络通过不同维度的层进行映射

• 发现本质上多元的数据中的结构

6.2 概括范围的局限性

线性关系可以很好地从标量推广到向量。二次关系也可以通过二次型X^TAX合理地推广。但是三次及更高阶多项式面临着维度诅咒------需要n³或更多系数,这使得直接推广变得不切实际。

这就是机器学习使用神经网络的原因:通过简单的线性变换和简单的非线性项的组合,无需显式构造高次多项式项即可逼近任意函数。线性代数在这里扮演着构建模块的角色,而非直接的概括框架。

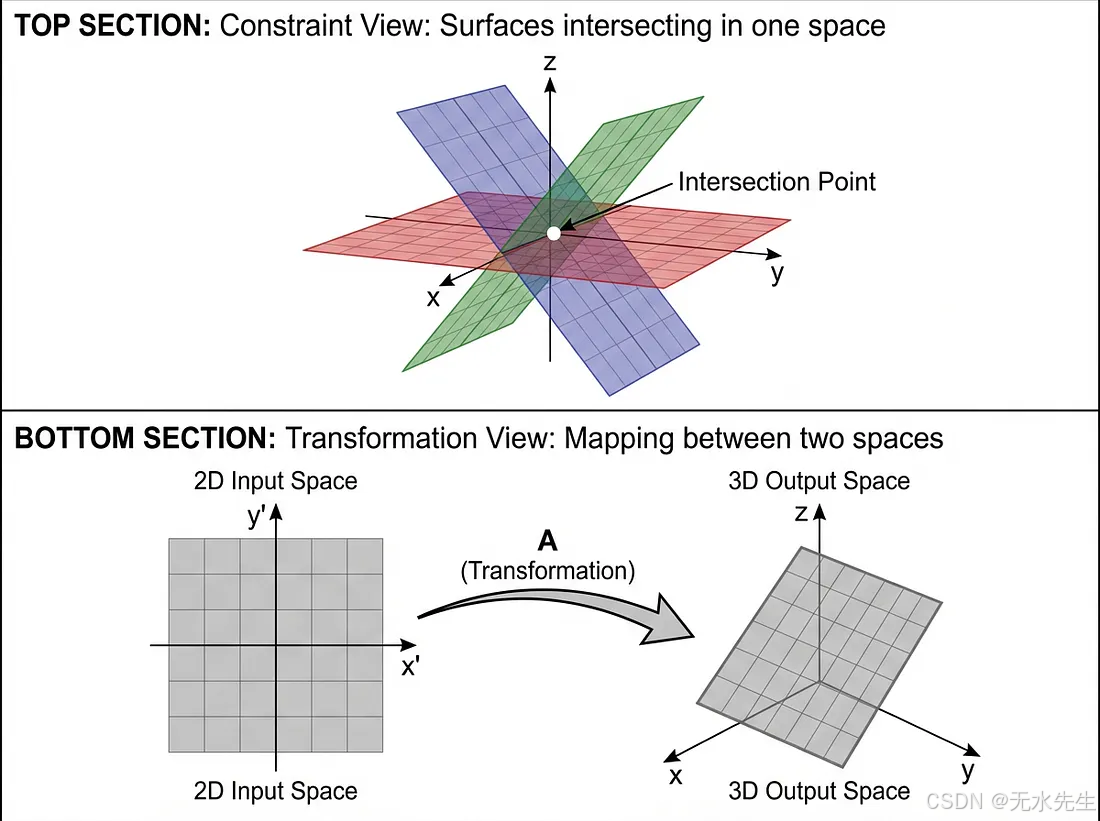

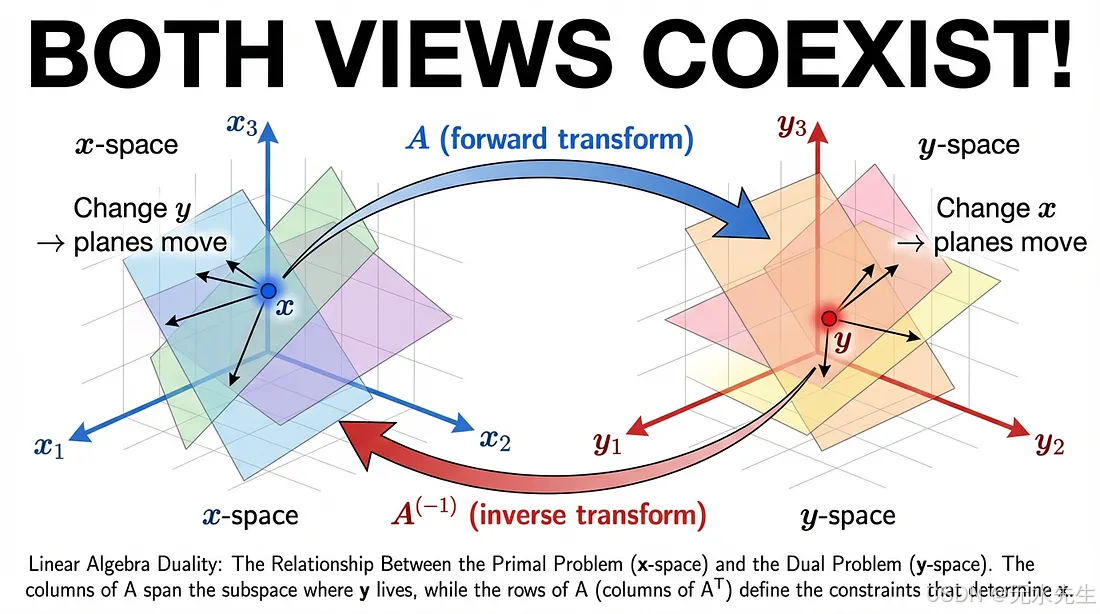

6.3 弥合两种观点之间的鸿沟:统一图景

这里有一个贯穿始终的深刻洞见:这两种解释并非彼此分离------它们在两个空间中同时存在。"约束"和"变换"的观点并非看待同一方程的不同方式;它们是两个空间之间单一几何关系的互补方面。

6.4 两种几何形状同时存在

考虑方程y = Ax,其中x和y都位于三维空间中(因此A是 3×3 的满秩矩阵)。以下是同时发生的情况:

图7:两种解释并存!在x空间中,A定义了变换到y空间时的约束平面。在y空间中,A^T定义了变换回x空间时的约束平面。

在 x 空间中:

• 矩阵A定义约束平面(A的每一行都是一个平面的法向量)

• 这三个平面相交于点x。

• 改变y 值 会使这些平面在 x 空间中移动,从而改变它们的相交位置。

• 同时,变换A正在进行从 x 空间到 y 空间的旋转/拉伸。

在y轴空间中:

• 矩阵AT定义约束平面(AT的每一行= A的每一列都是一个法向量)

• 这三个平面相交于点y。

• 改变x 值 会使这些平面在 y 空间中移动,从而改变它们的相交位置。

• 同时,变换A^ −1正在进行从 y 空间到 x 空间的旋转/拉伸。

6.5 完美的二元性

当你在 x 空间时,你会看到:

- 约束平面,其交点定义了x

- 变换A向 y 空间外作用

当你在y轴空间时,你会看到: - 约束平面(通过A^T),其交点定义了y

- 变换A^ −1 作用于 x 空间之外

平面和漩涡并不是不同的诠释------它们是同一几何结构的双重方面!

6.6 为什么这能统一一切

这种视角揭示了为什么同一个方程Ax = y似乎有两种解释:

这不是"非此即彼",而是"两者兼顾"!

同时存在的所有线性系统:

- 在一个空间中定义约束曲面(它们的交点确定该点)

- 对另一个空间进行变换(整个空间如何变形)

- 通过对称性,还可以在另一个空间中定义约束曲面(通过转置)。

- 执行逆变换(通过A^ −1 或伪逆)

当你认为自己是在"约束视图"和"变换视图"之间做出选择时,实际上你只是在选择站在哪个空间中。两种几何形状始终存在------你只是决定在思考中优先考虑哪一个。