1.概述

在使用 ImageNet 等各类图像数据集进行具有条件信息的图像训练生成模型时,通常会根据类别标签或一段描述性文本生成条件样本。本文进一步展开介绍条件生成。

2. Classifier Guided Diffusion

为了将类别信息明确地纳入扩散过程,Dhariwal 和 Nichol (2021) 在噪声图像上 训练了一个分类器

。基于梯度

,通过改变噪声预测来引导扩散采样过程向条件信息

(目标类别标签)靠拢。Review预测模型:

可以写出联合分布的得分函数如下:

因此,一种新的 classifier-guided predictor 形式如下:

为了控制分类器引导的强度,我们可以添加权重 到梯度计算部分,由此得到:

由此得到的消融扩散模型 (ablated diffusion model (ADM ))和带有附加分类器指导的模型(ADM-G)能够取得比 SOTA 生成模型比如 BigGAN 更好的结果。

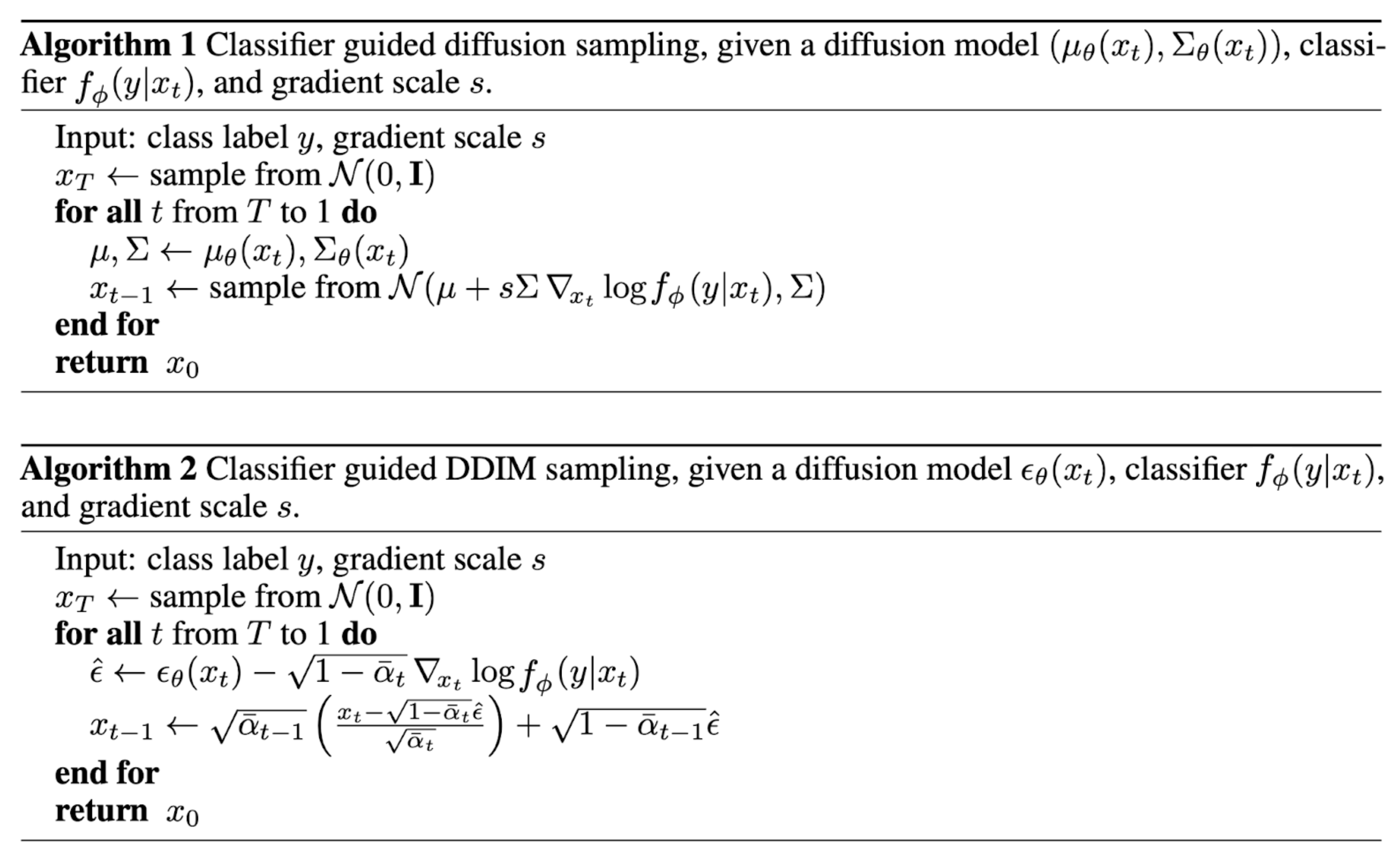

图1 利用分类器的引导实现DDPM和DDIM进行条件生成

此外, Dhariwal 和 Nichol (2021)对 U-Net 架构进行了一些改进,结果表明其性能优于使用扩散模型的 GAN。这些架构改进包括更大的模型深度/宽度、更多的注意力头、多分辨率注意力机制、用于上采样/下采样的 BigGAN 残差块、残差连接缩放以及自适应组归一化(AdaGN)。

3. Classifier-Free Guidance

没有独立分类器尽管如此,仍然可以通过结合条件扩散模型和非条件扩散模型的得分来运行条件扩散步骤(Ho & Salimans,2021)。令非条件去噪扩散模型通过得分估计器进行参数化以及条件模型通过参数化这两个模型可以通过单个神经网络进行学习。具体来说,就是条件扩散模型。使用配对数据进行训练其中,条件信息会周期性地随机丢弃,这样模型也知道如何无条件地生成图像,即:

隐式分类器的梯度可以用条件得分估计器和非条件得分估计器来表示。一旦代入分类器引导的修正得分,该得分就不再依赖于单独的分类器。

实验结果表明,CFG可以在 FID(区分合成图像和生成图像)和 IS(质量和多样性)之间取得良好的平衡。

引导扩散模型 GLIDE(Nichol、Dhariwal 和 Ramesh 等人,2022)探索了两种引导策略:CLIP 引导和无分类器引导,并发现后者更受欢迎。他们推测,这是因为 CLIP 引导利用对抗样本来改进 CLIP 模型,而不是优化生成更匹配的图像。