视频压缩编码

- 一、问题小解答

-

- [1. 为什么视频要压缩](#1. 为什么视频要压缩)

- [2. 视频压缩的目标](#2. 视频压缩的目标)

- [3. 手机图像传感器](#3. 手机图像传感器)

- [4. 单位像素面积](#4. 单位像素面积)

- [5. 焦段](#5. 焦段)

- 二、视频的采样

-

- [1. 时间采样](#1. 时间采样)

- [2. 空间采样](#2. 空间采样)

- 三、视频信号预处理

-

- [1. 色彩插值](#1. 色彩插值)

- [2. 伽马校正](#2. 伽马校正)

- [3. 直方图均衡](#3. 直方图均衡)

- [4. 色温与白平衡](#4. 色温与白平衡)

- 四、参考资料

一、问题小解答

1. 为什么视频要压缩

-

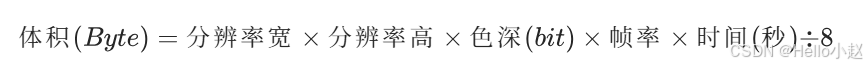

原始视频体积大到离谱: 不压缩的 1080P 视频:1 分钟------1920 × 1080 × 24bit × 30fps × 60s / 8 / 1024 /1024 ≈ 10GB

4K 视频 1 分钟 ≈ 几十 GB,你手机、电脑根本存不下,也传不动。

-

带宽不够,不压缩根本看不了在线视频: 带宽 = 每秒能传多少数据,不压缩的视频:1080P 需要 几百 Mb/s~1Gb/s , 家庭宽带一般才 10~100Mb/s,根本带不动,会一直卡、加载、卡顿。

-

视频里大量信息是重复、没用的

-

存储成本太高

2. 视频压缩的目标

- 必须压缩在一定的带宽内,即视频编码器应该具有足够的压缩比。

- 视频信号压缩之后,经过解压重建应该保持一定的视频质量。这个视频质量有两个标准,一个是主观认为视觉评定,另一个是信噪比。

3. 手机图像传感器

- CMOS(互补金属氧化物半导体)图像传感器(CIS) 是智能手机的绝对主流,CCD 早已退出手机市场;其主流架构为堆栈式背照(Stacked BSI),这是当前中高端机型的标配。

- 主流厂商与旗舰型号

| 手机型号 | 主摄 | 传感器尺寸 | 像素 | 影像联名/自研方案 |

|---|---|---|---|---|

| iPhone 17 Pro/Pro Max | 索尼 IMX903/IMX927 | 1/1.3" | 4800万 | 苹果自研影像算法 |

| 三星 Galaxy S26 Ultra | 三星 ISOCELL HP2 | 1/1.3" | 2亿 | 三星自研影像 |

| 小米 17 Ultra | 豪威 OV50X | 1" | 5000万 | 徕卡联名影像 |

| 华为 Pura 80 Ultra | 思特威 SC5A0CS | 1" | 5000万 | 华为XMAGE影像 |

| OPPO Find X9 Ultra | 索尼 LYT-900 | 1/0.98" | 5000万 | 哈苏联名影像 |

| vivo X300 Ultra | 索尼 LYT-901 | 1/1.12" | 2亿 | 蔡司联名影像 |

| 荣耀 Magic8 Pro | 索尼 IMX906 | 1/1.28" | 5000万 | 荣耀鹰眼AI相机 |

- 常见图像传感器尺寸对照表

| 传感器规格 | 实际尺寸 (mm) | 等效焦距裁剪系数 | 典型应用 |

|---|---|---|---|

| 1/3" | 4.8×3.6 | 6.0 | 监控、手机副摄 |

| 1/2.3" | 6.2×4.6 | 4.5 | 手机主摄、运动相机 |

| 1/1.7" | 7.6×5.7 | 3.7 | 高端手机主摄 |

| 1" | 13.2×8.8 | 2.7 | 便携相机、无人机 |

| M4/3 | 17.3×13.0 | 2.0 | 微型单电相机 |

| APS‑C | 23.5×15.6 | 1.5 | 主流单反 / 微单 |

| 全画幅 | 36.0×24.0 | 1.0 | 专业摄影相机 |

| 中画幅 | 44.0×33.0 | 0.79 | 高端商业摄影 |

- 底大一级压死人 :传感器尺寸越大,进光量越多,画质天然更强,在夜景、噪点、动态范围、画面质感上,大底对小底是碾压级优势,哪怕像素更低、算法再好,也很难弥补物理尺寸的差距。

4. 单位像素面积

- 单位像素面积 是指手机图像传感器(CMOS)上单个感光单元(像素)的物理尺寸,核心单位为微米(μm,如 1.6μm、2.0μm)。单位像素面积 ≈ 传感器总面积 ÷ 总像素数(同尺寸传感器,总像素越少,单位像素面积越大)。

- 同尺寸传感器下,像素高低直接决定「解析力」和「单位像素面积」,两者呈反向关系,无绝对优劣,适配不同需求。

| 类型 | 代表像素 | 核心优势 | 核心短板 |

|---|---|---|---|

| 高像素 | 1亿、2亿像素 | 解析力强,细节丰富,远景、裁剪后依然清晰 | 单位像素面积小,进光量少,弱光/夜景噪点多,需像素合并弥补 |

| 低像素 | 4800万、5000万像素 | 单位像素面积大,进光量充足,弱光/夜景纯净,噪点少、动态范围好 | 解析力相对较弱,远景或放大裁剪时细节表现一般 |

5. 焦段

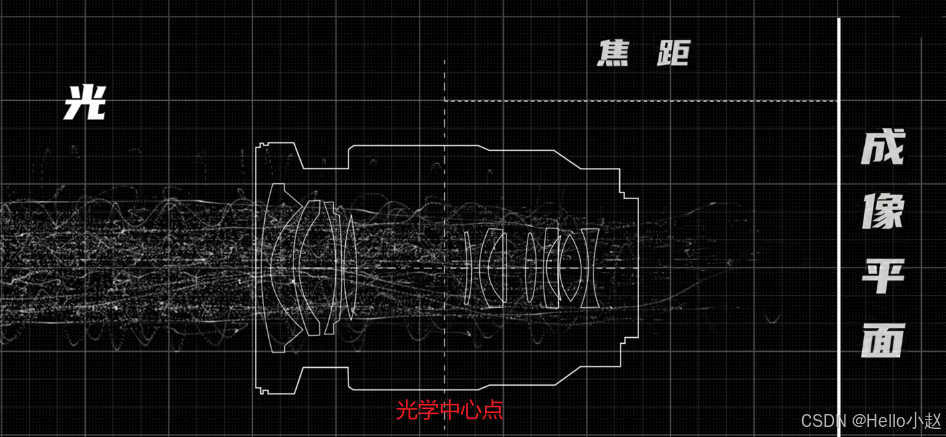

什么是焦距:镜头的光学中心点到成像平面称之为焦距

二、视频的采样

1. 时间采样

时间采样是在时间维度上对运动进行离散化,决定了画面有多流畅,简单理解:每秒拍多少张连续图片 。按照视频信号在时间与空间上的扫描采样方式分类 ,可以将扫描方式分为隔行扫描 和逐行扫描 。

- 隔行扫描(Interlaced Scan) :是一种将单帧图像拆分为两场 进行依次扫描的显示与传输方式,通常分为奇数场和偶数场 。奇数场仅扫描画面中所有奇数行像素,偶数场仅扫描偶数行像素,两场在时间上先后采样并传输,最终合成一帧完整画面。这种方式可以在相同带宽下传输更高分辨率的画面 ,早期模拟电视、广播信号广泛采用隔行扫描以节约传输资源。但由于两场存在时间差,在快速运动场景下容易出现行间闪烁、锯齿拉丝和运动伪影,画面稳定性较差。

- 逐行扫描(Progressive Scan) :是对画面所有行像素按照从上到下的顺序一次性完成扫描 、采样与显示的方式。每一帧画面在同一时刻完整呈现,不存在场分割与时间错位,像素行同步刷新。逐行扫描画面清晰稳定,无明显闪烁,运动物体边缘平滑无锯齿,能够更真实地还原动态细节,是目前数字视频、显示器、相机、手机等设备的主流采样与显示标准。相比隔行扫描,逐行扫描对带宽和处理性能要求更高,但整体画质与流畅度显著更优。

2. 空间采样

空间采样是在空间维度上对画面进行离散化,决定了画面有多清晰、分辨率多大,下面是具体分辨率及含义:

三、视频信号预处理

视频信号在采集、传输或数字化过程中,会不可避免地引入噪声、失真、干扰以及与后续处理模块不匹配 的问题,因此必须进行预处理,以提升信号质量、保证系统稳定工作。

视频信号预处理的核心目的是:降噪、校正失真、增强有效信息、统一数据格式,为后续的压缩、传输、识别、显示等环节提供高质量、标准化的信号。

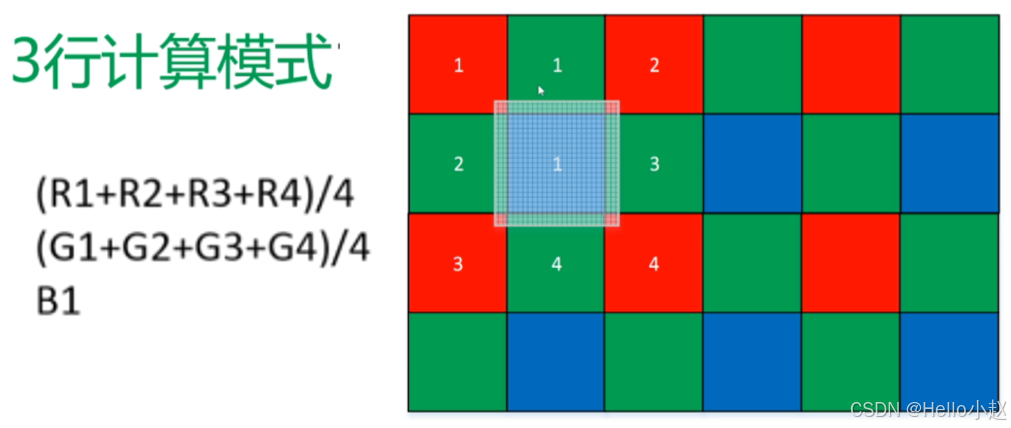

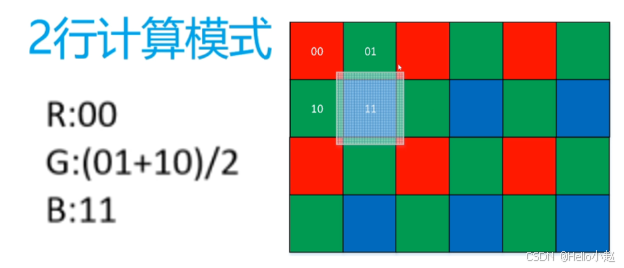

1. 色彩插值

色彩插值,也叫去马赛克 (Demosaicing)。绝大多数图像传感器的每个像素只记录一种颜色,色彩插值就是利用相邻像素的颜色信息 ,通过算法估算出当前像素缺失的两个通道数值 。

2. 伽马校正

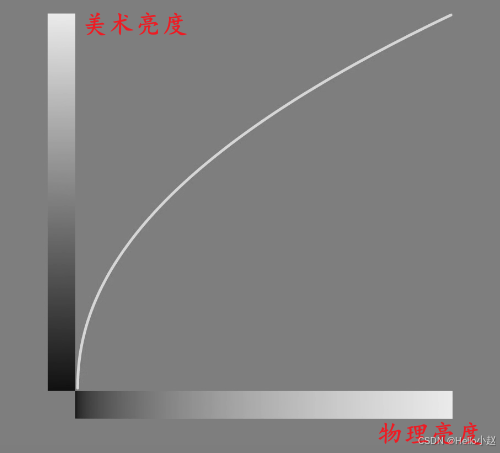

伽马校正(Gamma Correction)通过幂函数非线性变换,解决人眼感知、设备响应与数据存储的非线性矛盾。

1. 为什么要进行伽马校正?

-

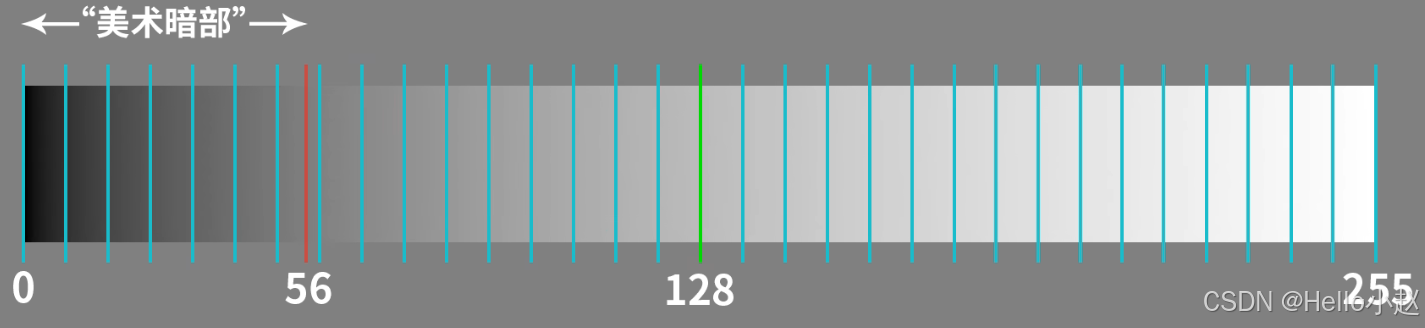

人眼感知非线性:人眼对暗部亮度变化更敏感,对亮部变化迟钝。 线性数据会浪费大量比特在人眼不敏感的亮部,暗部细节易丢失。 数值中点 128 在视觉上偏白,暗部(0~128)视觉占比小,比特大多浪费在人眼不敏感的亮部,暗部细节易丢失。

-

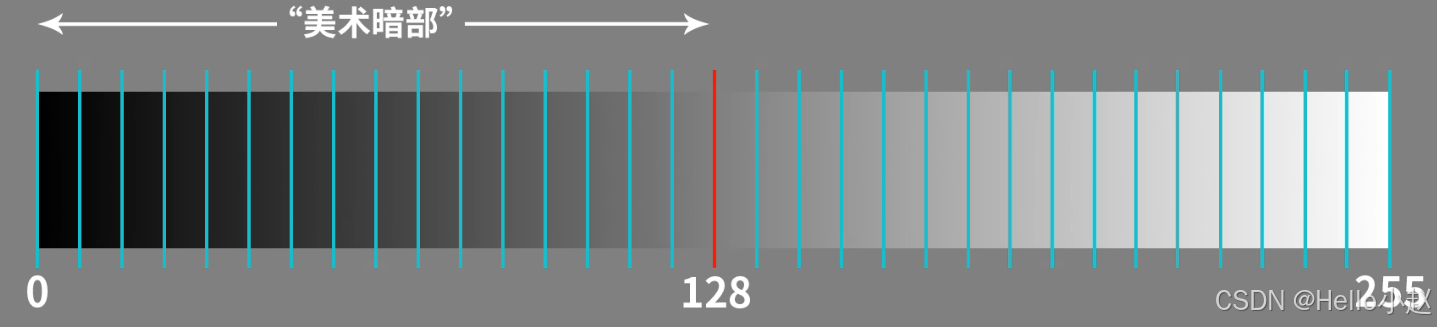

伽马校正的本质,就是通过非线性映射 ,把更多的编码比特分配给暗部,让视觉上的亮度变化更均匀。数值 56 在视觉上接近上方 128 的亮度,伽马校正提亮了暗部;数值 128 更接近视觉中点,暗部获得更多比特,细节更完整,观感更自然。

- 如何做?

伽马校正通过伽马函数,把更多数据比特分配给人眼敏感的暗部,让 0~255 的灰度在视觉上更均匀,解决了线性数据 "亮部浪费、暗部丢细节" 的问题,从物理亮度映射为美术亮度。

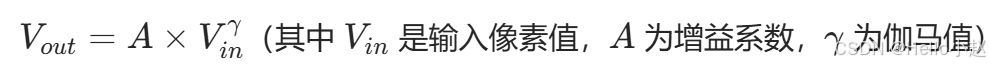

伽马函数核心公式为:

| γ值 | 效果 | 典型场景 |

|---|---|---|

| γ < 1(如 0.45) | 提亮暗部、压缩亮部,图像变亮 | 相机编码、sRGB 编码、欠曝校正 |

| γ = 1 | 线性,无变化 | 理想物理渲染、线性空间计算 |

| γ > 1(如 2.2) | 压暗整体、增强暗部细节 | 显示解码、过曝校正、打印(γ≈1.8) |

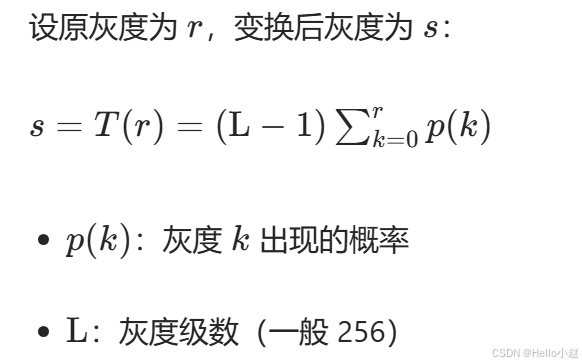

3. 直方图均衡

通过把图像的灰度直方图 "拉平",让亮度分布更均匀,从而提升暗部、亮部细节,基本原理:

-

统计图像中每个灰度级(0~255)出现的像素数量,得到灰度直方图。

-

计算累积分布函数(CDF),用它对原灰度做映射变换。

-

把原本集中在某一段亮度的像素,均匀分散到 0~255 整个范围。

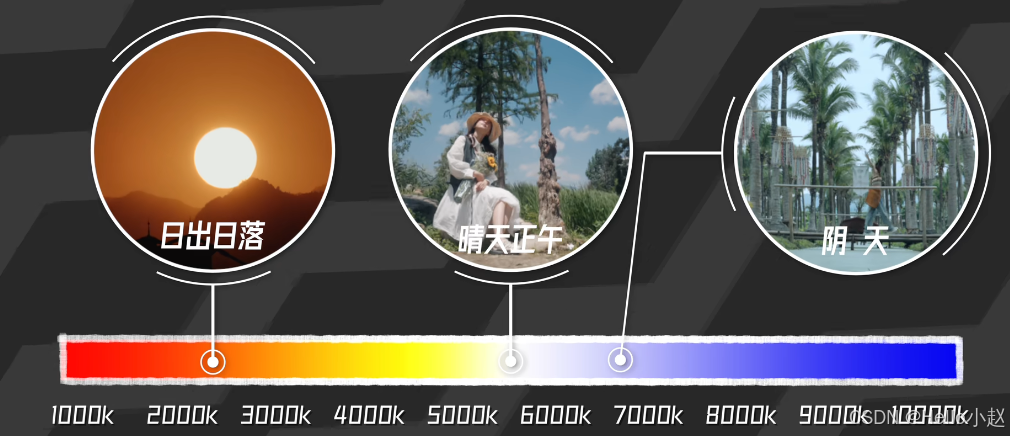

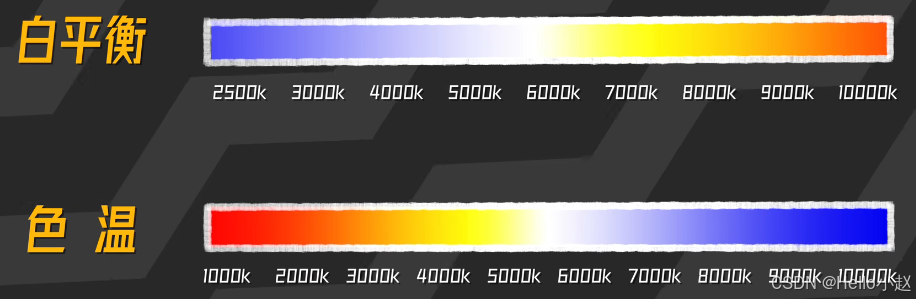

4. 色温与白平衡

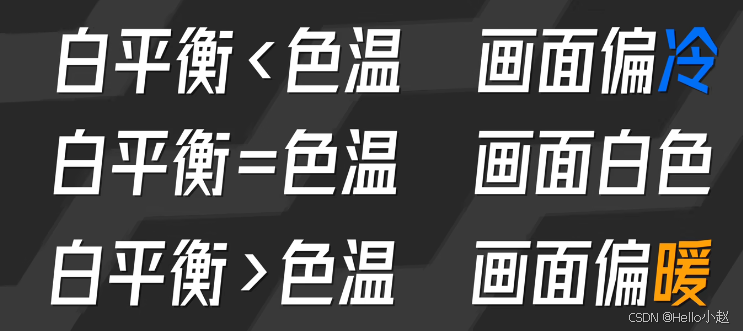

- 色温:环境中客观存在的光源颜色,数值越高越偏冷(蓝),越低越偏暖(黄)。

- 白平衡:人为控制的相机设置,让白色在照片里真正显示为白色的校正过程,抵消环境光的色偏。

四、参考资料

-

时间取样: 你知道什么是逐行扫描与隔行扫描吗?

-

Bayer转RGB: 图像预处理Bayer转RGB

-

伽马校正: 伽马校正

-

直方图均衡: 直方图均衡

-

色温和白平衡: 色温和白平衡