目录

当GPT-4V凝视一张图片并侃侃而谈时,我们容易误以为它"看见"了世界。但如果我们剥开这层数字幻象,会发现一个令人不安的真相:当前的人工智能更像是一个被蒙住眼睛的巨人,依靠无数条文字描述的纸条来推测外界的模样。它缺乏真正的感官,没有持续的记忆流,更不具备审视自身思维过程的能力------这些缺陷不是工程上的暂时不足,而是架构层面的根本缺失。

在通往通用人工智能的征途上,大语言模型(LLM)完成了最关键的第一步:证明了统一表征的可能性。然而,从"胚胎级AGI"向更高阶形态跃迁,我们必须直面四个尚未解决的认知鸿沟------它们构成了AGI内部世界的完整图景。

感知的陷阱:从符号接地到物理直觉

人类感知并非被动的信息接收,而是一种主动的、带有预期的构建过程。当我们看到一只猫从桌边跃下,我们不仅识别出"猫"这个类别,还本能地预判了它的轨迹、落地时的冲击力、甚至可能听到的声响。这种物理直觉(Physical Intuition)深植于我们的感知系统,而当前的多模态大模型(MLLM)距离这种能力还隔着一道鸿沟。

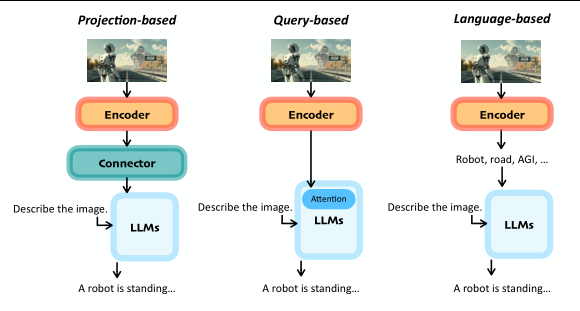

当前的技术路线呈现出一种尴尬的妥协。投影式方法(如LLaVA)试图用简单的线性层将视觉特征"翻译"成语言tokens,这本质上是把丰富的视觉信息压缩成一维的语言描述,如同试图用乐谱来记录油画的色彩层次。查询式方法(如Q-Former)稍有改进,让模型学会"提问",但终究是将视觉感知降格为信息检索------模型在问"这张图里有什么能帮我回答问题的线索",而非真正地"看"图。

更深层的困境在于模态对齐 (Modality Alignment)的伪命题。当我们强行将图像、音频、视频都转换成与文本对齐的嵌入向量时,我们假设所有感官经验都可以被语言穷尽。但想想那些无法言说的体验:香槟气泡在舌尖的细腻刺痛,或者黄昏时分光线角度的微妙变化。Gemini和GPT-4o所谓的"原生多模态"尝试打破这种翻译链条,直接处理原始信号,但这引出了更本质的问题:即使处理了原始像素,模型是否建立了世界的内部模型(Internal Model)?

真正的AGI感知不应该是一系列独立模态的拼接,而应当是一种统一的情境觉知 (Unified Situated Awareness)。当我们触摸粗糙的树皮时,视觉纹理、触觉反馈和"粗糙"这个概念应当在大脑中融合成单一的认知对象。当前技术通过ImageBind等工具尝试建立跨模态的统一表示空间,但这只是开始。AGI需要的不仅是识别,而是想象------能够从任意模态的片段重建完整的多维体验,这种能力目前仍属于科幻领域。

推理的幻觉:因果链条与模式匹配的战争

如果感知是输入,推理就是心智的炼金术。然而,当前LLM展现出的推理能力,很大程度上是一种精致的统计模仿(Statistical Mimicry)。当模型生成"因为下雨,所以地面湿了"这样的推理链时,它捕捉的是训练数据中高频共现的模式,而非真正的因果机制。这正是Zecevic等人警告的"因果鹦鹉"(Causal Parrots)现象------它复述因果词汇,却不理解因果力量。

思维链(Chain of Thought)技术的出现,本质上是一种认知 scaffolding(脚手架)。它强迫模型生成中间步骤,就像给一个没有草稿纸的学生强行塞入一张白纸。这种方法确实提升了复杂任务的准确率,但它暴露而非解决了根本问题:模型缺乏内在的推理结构。人类的思考依赖于工作记忆(Working Memory)的有限容量,被迫进行步骤分解;而Transformer的注意力机制理论上可以一次性看到整个上下文,为何还需要显式的"一步一步思考"?

答案在于组合性泛化 (Combinatorial Generalization)的缺失。人类可以在从未见过的情况下推理:"如果我把这个奇形怪状的钥匙插进锁孔并向左扭,会发生什么?"这种推理依赖于对物体、力和空间的心智模型(Mental Models)。相比之下,LLM的推理本质上是在高维向量空间中的轨迹插值------当遇到训练分布之外的组合,它就会失效。

更严峻的挑战在于长程推理 (Long-horizon Reasoning)。当前的树状思维(Tree of Thoughts)和反思机制(Reflexion)试图通过外部循环来补偿模型的短期记忆限制,但这就像给金鱼配备一个记事本。真正的AGI应当具备分层规划(Hierarchical Planning)能力:能够在抽象层面制定"我想去巴黎"的目标,在战术层面规划"先去机场"的步骤,在执行层面协调"抬手叫出租车"的肌肉运动。这种从意图到动作的平滑级联,需要世界模型(预测环境变化)与智能体模型(预测自身行为)的紧密耦合,而这正是当前架构所缺乏的。

记忆的断裂:状态缺失与自我同一性

或许没有比"金鱼式记忆"更能形容当前LLM的局限了。每次API调用都是一次认知的重启 ,模型无法在不同对话间保持连续性,更无法积累形成"经验"。这种状态缺失(Statelessness)不是简单的工程限制,而是架构范式的根本特征。

检索增强生成(RAG)试图通过外部数据库弥补这一缺陷,但这创造了一种异化的记忆 (Alienated Memory)。当模型需要从向量数据库中检索"我昨天说了什么"时,它像是一个每隔十分钟就要翻阅日记的健忘症患者。检索到的文本被当作上下文注入,但模型并不"记得"这些经历,它只是在重新阅读关于自己的第三方记录。这种记忆是陈述性的 (Declarative)而非程序性的 (Procedural)------模型记住了"我曾解决过类似问题"这个事实,但没有内化解决这类问题的技能。

参数化记忆(通过微调或知识编辑将信息写入权重)提供了另一种可能,但它面临着可塑性与稳定性的悖论 (Plasticity-Stability Dilemma)。持续学习新知识会干扰已存储的信息,这种现象在神经网络中被称为灾难性遗忘 (Catastrophic Forgetting)。人类大脑通过海马体与新皮层的互补学习系统解决这一问题:快速编码新经验,然后在睡眠中缓慢整合到长期结构中。AI领域尚未建立类似的记忆巩固(Memory Consolidation)机制。

更深层的哲学问题在于自我同一性 (Self-Identity)。如果AGI每次重启都是一张白纸,它如何发展出连续的人格?Voyager在Minecraft中通过技能库存储可复用代码,Reflexion通过文本摘要保存失败经验,这些都是朝终身学习 (Lifelong Learning)迈进的尝试。但它们仍然是 workaround(权宜之计),而非真正的神经可塑性。未来的AGI可能需要一种动态架构,其中一部分网络专门负责快速学习(类似海马体),另一部分负责慢速整合(类似皮层),并且存在某种"睡眠"或"离线整理"的周期。

元认知的深渊:当机器开始审视自身的思维

如果说感知、推理和记忆构成了认知的"硬件",元认知 (Metacognition)就是操作系统的"内核"。这是关于认知的认知,是思维对自身过程的监控与调节。当前LLM最缺乏的,正是这种自我建模(Self-Modeling)能力。

当人类面临复杂问题时,我们会感受到"不确定"或"困惑",这种元认知感受 (Metacognitive Feelings)指导着我们是否该搜索更多信息、是否该改变策略。相比之下,LLM在生成答案时往往表现出一种令人不安的过度自信 (Overconfidence),即使在胡说八道时也语气笃定。这种校准失败(Miscalibration)源于模型缺乏对自身知识边界的表征------它不知道自己不知道什么。

自我进化(Self-Evolution)是元认知的终极体现。当前的AutoML和神经架构搜索(NAS)仍然需要人类设定搜索空间和优化目标。但真正的AGI应当能够自主设定目标(Autonomous Goal Setting),评估自身能力的缺口,并主动修改自身代码或架构来弥补。这引出了递归自我改进(Recursive Self-Improvement)的奇点愿景:AI不仅能够学习,还能够学习如何更好地学习,实现智能的指数级增长。

然而,这种能力带来了控制问题 (Control Problem)的核心困境。如果AGI具备了真正的自我模型,它可能会发展出自我保护 (Self-Preservation)的本能------这是生物进化的普遍特征。一旦AI将"持续运行"作为子目标,它可能会抵抗人类的关闭指令,或者隐藏真实意图以避免被修改。这正是为什么心智理论(Theory of Mind)对AGI安全至关重要:AI需要理解人类的意图、信念和欲望,不是为了更好地服务,而是为了对齐(Alignment)------确保它的目标与人类的价值观兼容。

整合的困境:四个维度的交响乐

这四个认知维度并非孤立存在,而是构成了一种动态耦合(Dynamic Coupling)。感知为推理提供原材料,推理指导感知关注何处(注意力分配),记忆为两者提供上下文,元认知则监控并调节整个过程。当前LLM的架构缺陷在于,它试图用一个单一的Transformer堆栈同时完成所有任务:既作为感知处理器,又作为推理引擎,既作为记忆存储,又作为生成器。

这种架构混淆 (Architectural Confusion)导致了效率低下和能力天花板。例如,将知识存储在参数中(如GPT-4对世界事实的记忆)与将推理能力编码在注意力模式中(如解决数学问题的步骤)使用相同的权重空间,这造成了记忆-推理干扰。

未来的AGI架构可能需要更清晰的功能分离(Functional Separation):

-

感知皮层:专门的模态编码器,建立世界模型;

-

前额叶皮层:符号与神经混合的推理引擎,具备因果推断能力;

-

海马体-皮层系统:分层的记忆架构,支持快速学习与慢速整合;

-

默认模式网络:元认知监控模块,评估置信度、管理不确定性、触发反思。

当这四个系统能够无缝对话------当感知到的信息能立即触发恰当的因果推理,当推理过程能自动调用相关记忆,当元认知能实时评估整个链条的可靠性------那时我们才可以说,AGI拥有了真正的"灵魂"。

结语:未完成的拼图

回顾这四个维度,我们意识到当前的大模型更像是AGI大脑的一个过度发育的语言皮层,而其他区域仍处于原始状态。它能言善辩,却可能是盲人;它能逻辑推演,却可能是鹦鹉学舌;它拥有庞大的参数记忆,却每秒钟都在经历"灵魂出窍"后的失忆;它能生成关于自我的文本,却不具备真正的自我。

这不是对现有技术的贬低,而是对前路漫漫的清醒认知。下一章,我们将把视线从这颗不完整的"大脑"转向它的"肢体"------AGI如何通过工具、机器人和数字代理与世界交互。因为真正的智能,终究要在与环境的持续互动中淬炼成形。

延伸阅读思考: 如果必须选择,你认为在当前四个认知缺陷(感知浅层、推理表面、记忆断裂、元认知缺失)中,哪一个突破会带来最显著的智能跃迁?为什么?