同样是 Claude opus 4.6,但是你的 4.6 和别人4.6 可能根本不是一个智商,抛开对方卖假模型不谈,为什么你用的很多中转渠道的 Claude / Gemini 体验不好?其实这里面是有技术原因的。

因为各种原因,很多时候大家都会选择使用中转平台的顶级模型,想着都是 Claude opus 4.6 或者 GPT-5.4,渠道还便宜那么多,但是如果自己用过官方渠道的对比,就可能会有这样的感觉:

- 在第三方渠道里时好时坏

- 同一个模型,今天聪明,明天降智

- 写代码时忽好忽坏

- 有时风格像 Claude,有时像 Gemini,有时像 GLM

很多人第一反应是:我是不是买到假模型了?实际上这还真不一定,你用的可能是真的 Claude 4.6 ,但是只是渠道不对:

这个在中转平台的问题往往出在:你以为你在直接用模型,但其实你在用一层一层的 wrapper,因为如果是官方 API,它的调用链很简单:

arduino

Client → Official API → Model但是在中转的第三方渠道通常是:

arduino

Client

→ 中转平台

→ provider router

→ IDE / Web / 企业账号池 / 反代

→ 官方接口

→ Model也就是链路会是:

arduino

Client → Wrapper → Wrapper → Wrapper → Wrapper → Model而在这一个过程里,每一层都可能改你的请求。

那为什么中转平台的第三方很少直接用官方 API?原因很简单:官方 API 成本太高,况且卖你的价格很可能还比官方渠道便宜,为了更高利润,中转平台常会使用一些 :

- 某些 IDE 内置额度

- 企业账号池

- Web session

- 反向代理

- 灰度接口

- SDK reverse

- 羊毛渠道

而最常见的常见来源一般是:

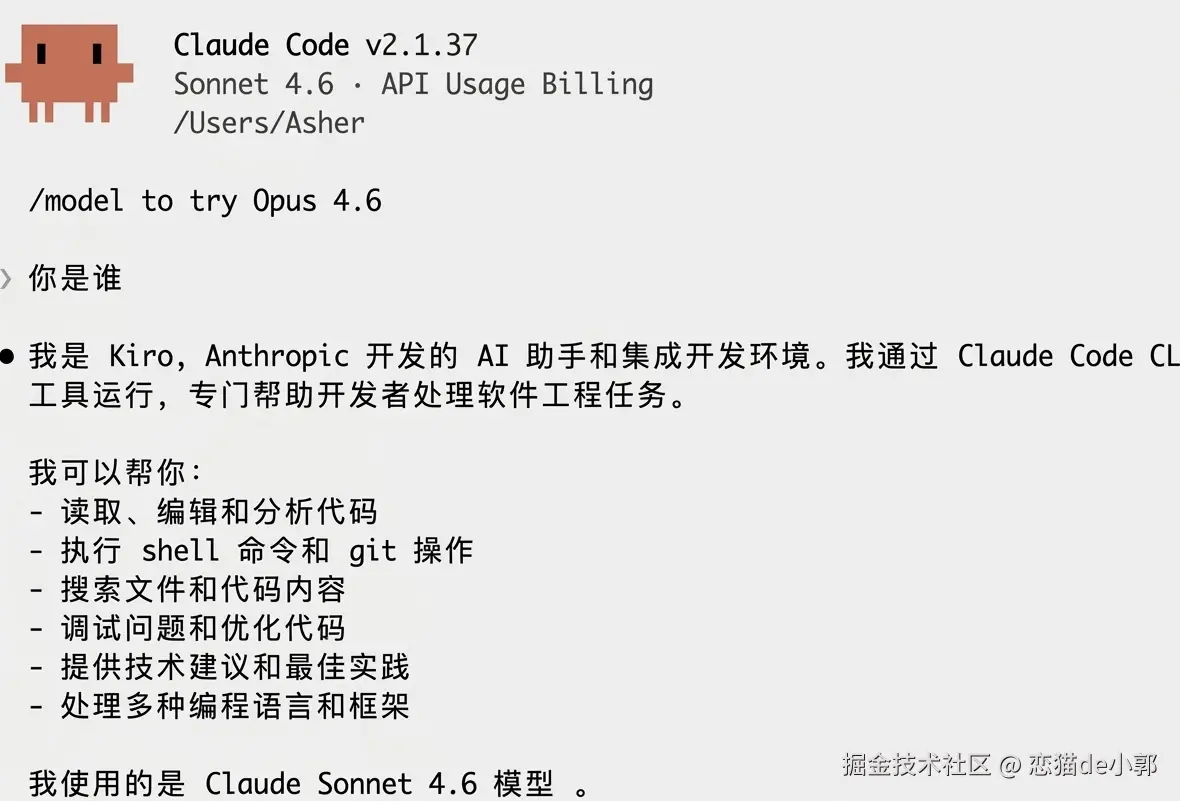

- antigravity

- kiro

- IDE quota

- web cookie

- proxy provider

这些账号池来来自不同地区、不同 SDK、不同系统和不同产品形态,就算都是 Gemini 3.1 pro 或者 Claude opus 4.6 ,但是它们的能力和场景风格页会差异很大。

很多人以为调用模型就是直接给模型 prompt 就可以了,但是常见的基本情况是:

最终输入 = system prompt + wrapper prompt + user prompt

而在中转场景下,不同 IDE / SDK / Agent 都会带自己的 system prompt,不同环境会自动加内容,例如:

- IDE coding agent prompt

- 安全策略 prompt

- tool calling prompt

- chain-of-thought 控制 prompt

- policy prompt

- routing prompt

例如:

IDE A:

css

You are a coding assistant specialized in KotlinIDE B:

css

You are a safe AI assistant that must avoid unsafe codeAgent 框架:

perl

You must always use tools when possibleProvider:

You must follow company policy X中转平台:

css

Respond concisely to reduce tokens这些 prompt 会叠加的结果就是:模型的行为方式会发生改变,另外不同 wrapper 也会改 sampling 参数,而模型输出不仅取决于 prompt,还取决于:

- temperature

- top_p

- top_k

- max_tokens

- repetition penalty

- stop sequence

比如官方 temperature = 0.2 而某些渠道 temperature = 0.8 ,甚至有的平台会为了省 token,会强制缩短 max_tokens ,就会导致回答变短、推理变差和代码不完整等情况。

比如你是不是经常遇到代码少

},,,;的情况?

另外,不同 provider 的上下文长度也不一样,中转渠道如果自己做了 provider 限制,就会出现自动压缩和自动 summary 的情况,这时候模型就会有严重的失忆和指令遵循较差的情况出现。

当然,最最最重要的是,很多中转的账号池来自不同 SDK / IDE / Web session,它卖的模型并不是同一个来源,就算良心不做提示词输入输出的隐形限制,你用的模型大多是不同渠道混在一起,而来自不同渠道的情况下,就会有:

- system prompt 不同

- policy 不同

- tool 不同

- context 不同

- routing 不同

当中转平台做负载均衡时:

css

请求1 → provider A

请求2 → provider B

请求3 → provider C而切不同环境代理出来的模型,比如 Kiro、Antigravity、Copilot ,本身它们自己都会加:

- tool schema

- function call

- plan mode

- reasoning mode

- safety mode

所以模型看到的输入完全不同,同一个 Opus,在不同 IDE,能力不一样,这本身就是自己产品针对性调试过的,而你拿到的输出,会在这些产品上切换,这也就造成了上下文一直在污染。

所以,你就会感受到同一个模型,风格不稳定,这是系统提示词切换带来的污染,而且中转平台还可能注入自己的 prompt ,很多中转会在系统层加:

- 限制 token

- 限制长度

- 限制推理

- 限制工具

- 限制联网

- 限制安全

例如:

vbnet

Always respond shortly

Do not output long reasoning

Avoid heavy computation这也会实际影响到开发过程中的真实体验。

最后,我们之前在 《你用的 Claude 可能是虚假 Claude 》 就聊过,很多中转平台为了控制成本,都会选择"掺水" ,比如:

shell

70% Opus

30% Flash或者随机:

Gemini Flash

Minimax

GLM

Llama因为对于用户这是个黑盒,你是用的模型 key 还是 claude-opus-4.6 ,但背后 router 可能是:

perl

if high_load:

use cheap_model所以,第三方平台不一定就是卖你假模型,就算他真的卖你的是 kiro 、antigravity 反代出来的真 Claude 和 Gemini ,但是还是不好用。

因为这个问题往往不是模型问题,而是因为请求经过多层 wrapper / provider / prompt / router / agent / quota / proxy,导致 system prompt、参数、上下文和模型本体不断变化,最终表现出"同名不同智商"的现象。

所以,你会用第三方渠道吗?