目录

[捷径连接的 "零成本" 特性](#捷径连接的 “零成本” 特性)

[3. 下采样方式(把特征图的「空间尺寸变小」(高度 H、宽度 W 缩小),同时保留关键特征,是 CNN 里的核心操作。压缩空间分辨率、扩大感受野、降低计算量,让网络关注更全局的语义特征)](#3. 下采样方式(把特征图的「空间尺寸变小」(高度 H、宽度 W 缩小),同时保留关键特征,是 CNN 里的核心操作。压缩空间分辨率、扩大感受野、降低计算量,让网络关注更全局的语义特征))

研究背景

- 深度对 CNN 的重要性 :CNN 的特征表达能力随网络深度提升(低 / 中 / 高层特征由堆叠层数决定),VGG/GoogLeNet 等证明「更深的网络」是视觉任务的核心方向;

- 深度学习的长期难题 :并非层数越多性能越好 ------ 当网络深度超过一定阈值后,会出现退化问题(Degradation) :训练误差和测试误差均显著上升,且不是过拟合导致(加层后训练误差直接升高);

- 传统方法的局限性 :归一化初始化、BatchNorm 等已解决梯度消失 / 爆炸 问题,让深层网络能收敛,但退化问题仍未解决,成为阻碍 CNN 继续加深的核心瓶颈;

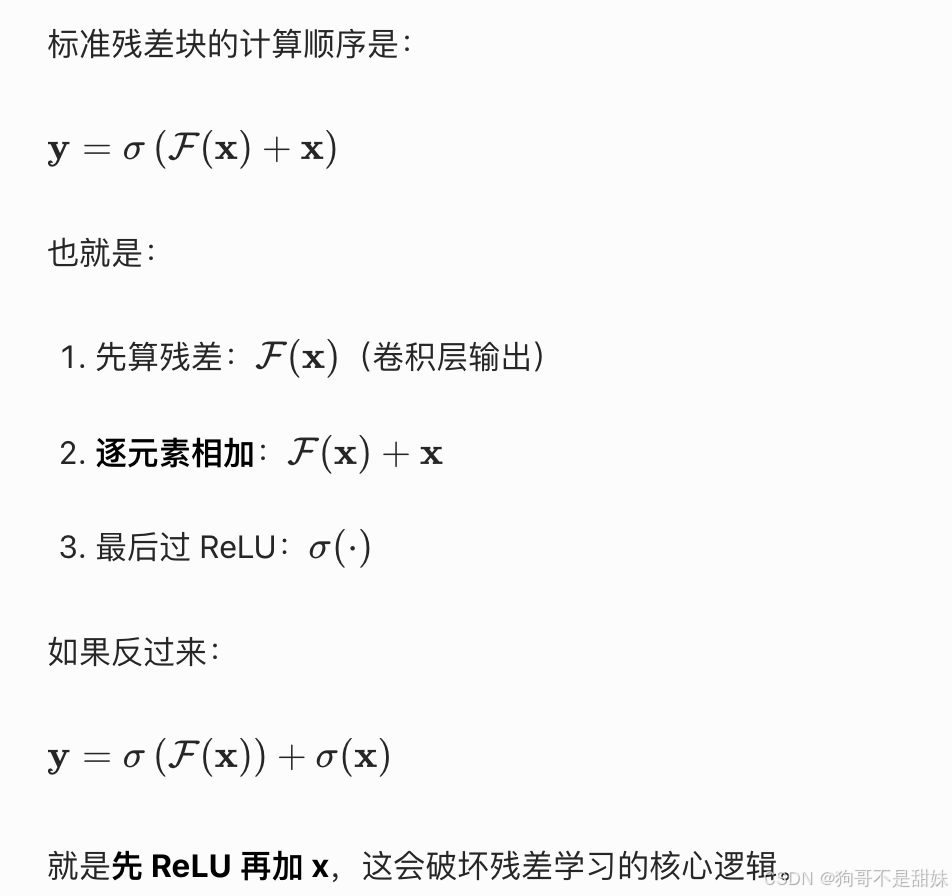

明确一个道理,多层线形=单层线性,神经网络必须靠非线形才能学习到复杂世界,因此采用非线性,但是要是非线性要是表示恒等映射,就是把权重,偏置,激活都调节到刚好抵消

普通网络学的是「从输入到最终输出的完整映射」,ResNet 学的是「最终输出和原始输入的差值(残差)」

捷径连接的 "零成本" 特性

- 无额外参数:恒等捷径连接只是将输入 x 直接传递,不需要学习任何新权重。

- 无额外计算:逐元素相加是极低成本的操作,在工程上可忽略不计。

- 这保证了 ResNet 与同结构的普通网络在参数规模、计算量上完全公平可比,实验结论更有说服力。

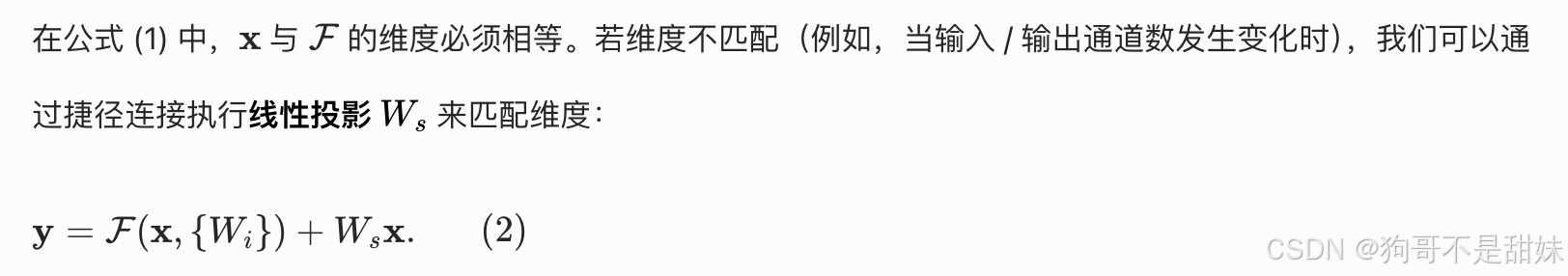

维度匹配问题与线性投影

- 维度相等时:直接用恒等捷径 y=F+x,最简单高效。

- 维度不等时 (如通道数变化、特征图尺寸下采样):

- 无法直接逐元素相加,需要对 x 做线性投影 Ws 来对齐维度。

- Ws 通常用 1×1 卷积实现(既改变通道数,又可实现下采样),会引入少量参数和计算量,但仍是高效的。

- 公式 (2) 是维度不匹配时的通用形式。

模型结构设计

继承 VGG 的核心思想:全部使用 3×3 小卷积核,保证感受野与特征表达能力

规则 目的 同尺寸特征图 → 同卷积核数 保证特征表达的一致性,避免通道数混乱 特征图尺寸减半 → 卷积核数翻倍 平衡计算量:空间尺寸减半 → 通道数翻倍,保证每层计算量(H×W×C)基本不变 3. 下采样方式(把特征图的「空间尺寸变小」 (高度 H、宽度 W 缩小),同时保留关键特征,是 CNN 里的核心操作。压缩空间分辨率、扩大感受野、降低计算量,让网络关注更全局的语义特征)

- 直接用步长为 2 的卷积层实现下采样,替代池化层,避免池化带来的信息丢失;

- 下采样时同步翻倍卷积核数,保证计算效率。

- Max Pooling:在 2×2 窗口里只保留最大值,丢弃其他 3 个值;

- Average Pooling:把 2×2 窗口里 4 个值取平均,相当于模糊化。

- 卷积下采样:用一个 3×3 卷积核去扫,每个 2×2 块的输出是 "加权和",会综合考虑所有像素的贡献,而不是只留一个。

4. 末端结构 - 全局平均池化(

- **GAP: 网络末端接全局平均池化层和 1000 类的全连接 + Softmax 层,**替代传统全连接层,将特征图压缩为一维向量,大幅减少参数量,抑制过拟合;

- 1000 类全连接 + Softmax:适配 ImageNet 1000 分类任务。