- 当MCU遇上大模型:在单片机上实现AI对话的硬核玩法

-

- 嵌入式设备的AI觉醒

- 一、项目架构:小身板,大智慧

- 二、核心技术解析:如何让STM32"听懂"人话

-

- [1. HTTP客户端实现](#1. HTTP客户端实现)

- [2. JSON数据构建与解析](#2. JSON数据构建与解析)

- [3. 内存管理策略](#3. 内存管理策略)

- [4. 流式响应处理](#4. 流式响应处理)

- 三、功能演示:STM32的AI超能力

- 四、应用场景:无限可能

-

- [1. 智能工业控制](#1. 智能工业控制)

- [2. 教育开发平台](#2. 教育开发平台)

- [3. 物联网网关](#3. 物联网网关)

- [4. 智能家居](#4. 智能家居)

- 五、技术挑战与解决方案

- 六、开发指南:动手实践

- 七、未来展望:边缘智能的星辰大海

- 结语:让每一颗MCU都拥有AI的灵魂

- 参考

当MCU遇上大模型:在单片机上实现AI对话的硬核玩法

"在资源受限的STM32上调用云端大模型"

嵌入式设备的AI觉醒

想象一下,当STM32开发板不再只是简单地闪烁LED,而是能够进行智能对话,回答技术问题,甚至生成代码------这不是科幻,而是基于RT-Thread操作系统和智谱AI GLM-4大模型的真实工程实践。

今天,将深入解析一个令人兴奋的开源项目:在STM32F407探索者开发板上实现大模型API调用。

一、项目架构:小身板,大智慧

硬件平台

- MCU: STM32F407ZGT6 (Cortex-M4内核,168MHz主频)

- 内存: 192KB RAM + 1MB Flash(内置)

- 网络: 板载以太网接口,支持TCP/IP协议栈

软件包

- webclient组件

- RT-Thread网络协议栈

- mbedTLS加密

- cJson

二、核心技术解析:如何让STM32"听懂"人话

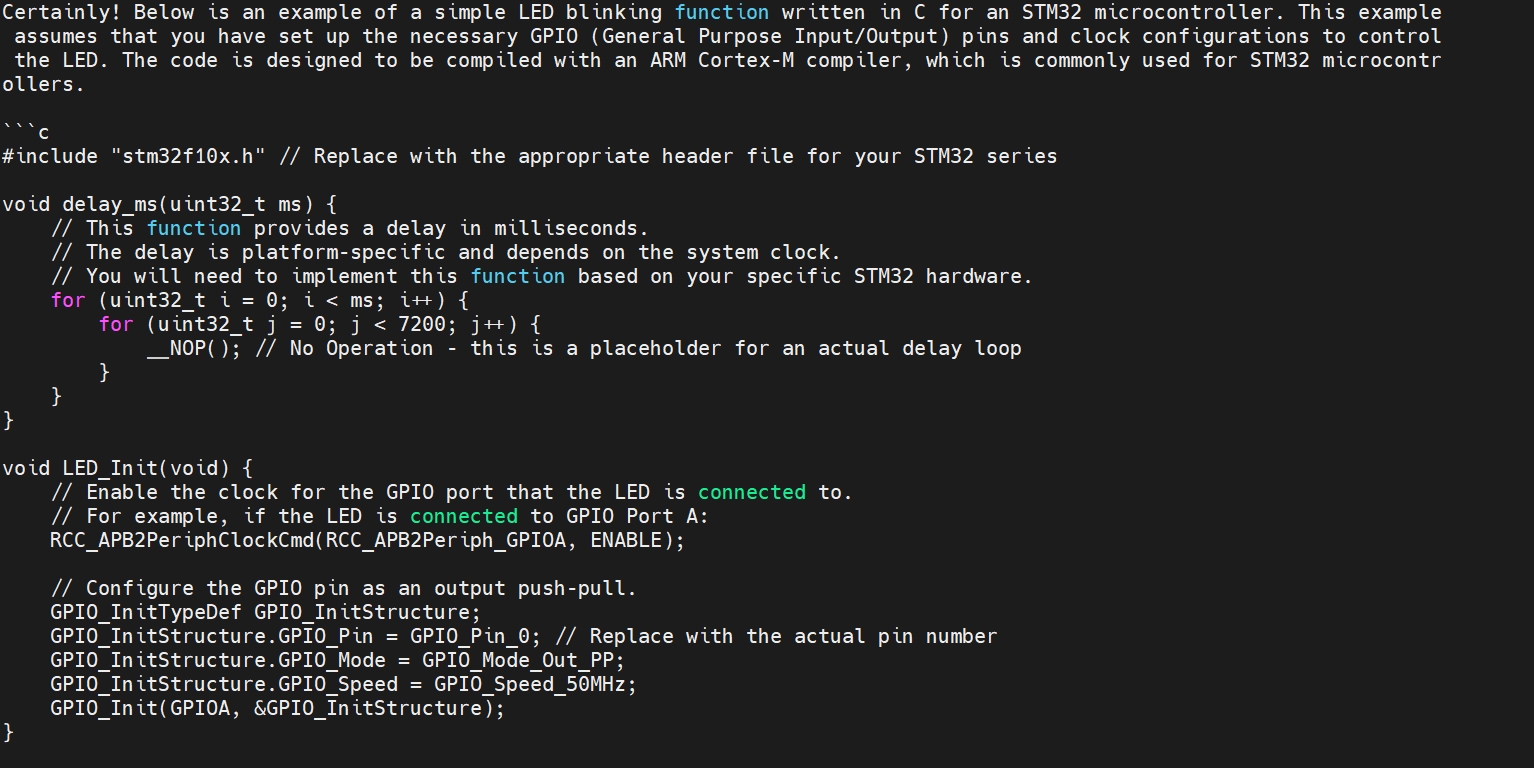

1. HTTP客户端实现

项目使用了RT-Thread的webclient组件,这是一个专为嵌入式设备设计的轻量级HTTP客户端:

c

/* 创建HTTPS会话 */

struct webclient_session* session = webclient_session_create(2048);

webclient_header_fields_add(session, "Authorization: Bearer %s", API_KEY);

webclient_header_fields_add(session, "Content-Type: application/json");2. JSON数据构建与解析

使用cJSON库处理API请求和响应数据:

c

/* 构建请求JSON */

cJSON *root = cJSON_CreateObject();

cJSON_AddStringToObject(root, "model", "glm-4-flash");

cJSON_AddItemToObject(root, "messages", messages_array);

cJSON_AddNumberToObject(root, "max_tokens", 512);3. 内存管理策略

在资源受限的环境中,精心设计的内存管理至关重要:

- 发送缓冲区 : 2KB (

GLM_SEND_BUF_SIZE) - 接收缓冲区 : 8KB (

GLM_RECV_BUF_SIZE) - 响应缓冲区 : 10KB (

GLM_MAX_RESPONSE) - 动态分配: 使用RT-Thread的内存管理接口

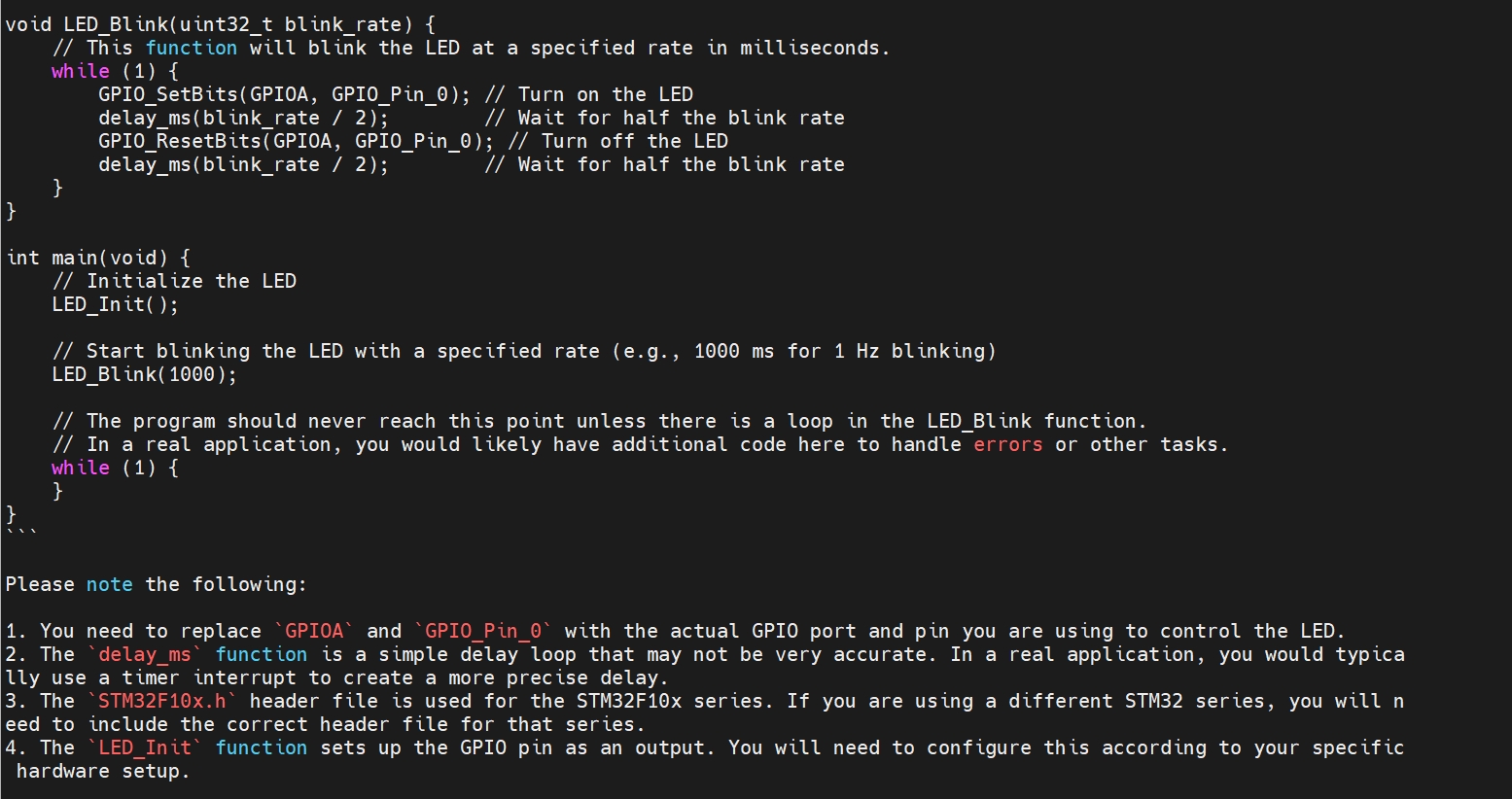

4. 流式响应处理

支持Server-Sent Events (SSE)格式的流式响应,实现实时输出:

c

/* 解析流式数据 */

if (_parse_stream_line(line_buf, content_chunk, sizeof(content_chunk)) > 0) {

rt_kprintf("%s", content_chunk); /* 实时打印AI回复 */

}三、功能演示:STM32的AI超能力

测试场景1:技术问答

用户: "Hello, please introduce yourself in one sentence"

STM32→GLM-4: "I am GLM-4, a large language model trained by Zhipu AI..."测试场景2:代码生成

用户: "please introduce C language in one sentence"

STM32→GLM-4: "C is a general-purpose programming language..."测试场景3:多轮对话

系统支持带历史记录的上下文对话,实现更自然的交互体验。

四、应用场景:无限可能

1. 智能工业控制

- 设备故障诊断助手

- 操作指导语音交互

- 维护知识库查询

2. 教育开发平台

- 嵌入式AI教学演示

- 学生项目创新平台

- 技术工作坊实践

3. 物联网网关

- 边缘计算节点

- 智能问答服务

- 设备管理中心

4. 智能家居

- 语音控制中心

- 场景智能推荐

- 用户习惯学习

五、技术挑战与解决方案

挑战1:资源限制

问题: STM32F407仅有192KB RAM,如何运行网络协议栈+TLS+AI应用?

解决方案:

- 使用RT-Thread的精简配置

- 优化网络缓冲区大小

- 采用流式处理避免内存堆积

挑战2:网络稳定性

问题: 嵌入式设备网络环境复杂,如何保证API调用成功率?

解决方案:

- 实现重试机制和退避算法

- 增加网络状态监控

- 使用质量服务(QoS)策略

挑战3:响应延迟

问题: 云端API调用存在网络延迟,如何提升用户体验?

解决方案:

- 采用流式响应,边接收边显示

- 实现本地缓存机制

- 优化JSON解析效率

六、开发指南:动手实践

环境准备

- 硬件: STM32F407探索者开发板 + 网络模块

- 软件: RT-Thread Studio 或 Keil MDK

- 依赖: webclient、cJSON、mbedTLS软件包

关键配置

c

/* 在glm_api.h中配置你的API密钥 */

#define GLM_API_KEY "your_api_key_here" /* 替换为智谱AI API Key */运行测试

bash

# 在FinSH命令行中启动测试

msh >glm_test

# 观察串口输出AI回复

七、未来展望:边缘智能的星辰大海

这个项目仅仅是个开始,它展示了嵌入式设备与AI结合的无限可能:

🚀 技术演进方向:

- 支持更多大模型平台(通义千问、文心一言等)

- 实现边缘-云协同智能

- 开发图形化交互界面

- 增加语音输入输出功能

🌟 应用拓展:

- 工业智能维护系统

- 教育AI实验平台

- 物联网智能网关

- 便携式AI助手

结语:让每一颗MCU都拥有AI的灵魂

当STM32遇上大模型,看到的不仅是技术的融合,更是嵌入式开发思维的一次革新。在这个AI无处不在的时代,即使是资源受限的微控制器,也能通过云端智能获得"思考"的能力。

这个项目为我们打开了一扇门:边缘设备不再只是数据的采集者和执行者,而是可以成为智能交互的参与者和创造者。

"在物联网的星辰大海中,每一颗MCU都值得拥有AI的灵魂。"

🎯 技术交流: 欢迎在评论区分享嵌入式AI创意!

点赞,分享,关注,获取更多嵌入式干货技巧!