背景

我的场景: 目前我已经通过semantic_feature_extractor_v3提取到了128维的语义特征,另外也通过main_workflow_v2提取到了128维的程序级的图嵌入。

**我的目标:**融合128维的语义特征+128维的程序级图嵌入,然后再重新输入下游的模型做监督分类。

根据我的场景需求,下游做监督分类时应该采用那些机器学习/深度学习模型较好呢?因为我后面要做对比实验的。

1. 语义特征提取 (128维)

文件: semantic_feature_extractor_v3.py

特征构成:

- 敏感函数频次特征: 32维 (8类×4特征)

- 攻击模式特征: 48维 (12类×4特征)

- 路径配置特征: 24维 (6类×4特征)

- 混淆检测特征: 24维 (6类×4特征)

2. 结构特征提取 (128维图嵌入)

文件: main_workflow_v2.py

两阶段GNN训练:

- 阶段1: CFG-GNN (函数级, 256维→128维)

- 阶段2: FCG-GNN (程序级, 128维→128维)

3. 监督分类任务 (256维融合特征)

文件: fusion_classifier_models.py

融合方式: 语义特征(128维) + 图嵌入(128维) = 256维支持模型: 逻辑回归、SVM、随机森林、XGBoost、LightGBM、MLP、BiLSTM、Transformer、ResNet-1D、融合模型

代码debug记录

1.加载数据

X, y, file_paths ← load_fusion_features(fusion_dir,label_file)

- X:特征列表,

- y:标签列表,

- file_path:特征文件名列表。 'malicious_0'、'malicious_1'、...

**注意:**load_fusion_features()函数实现过程使用了path.Path()方法,具体语法请见附录2!

2.划分数据集+标准化

2.1 分层划分数据集,默认打乱顺序

训练集+验证集 :测试集 = 0.8:0.2,random_state=42,stratify=y分层划分,shuffle=true(默认) ↓

↓ 注意:在所有数据集的0.8的比例下,再划分训练集和验证集

训练集:验证集 = 0.75*0.8:0.25*0.8 = 0.6:0.2

总之,训:验:测 = 0.6:0.2:0.2

X_temp, X_test, y_temp, y_test = train_test_split(

X, y, test_size,random_state, stratify=y

)

注意: 在 scikit-learn 的

train_test_split函数中,shuffle参数的默认值是True。因此,原代码虽然没有显式写出shuffle=True,但实际上默认已经进行了打乱。

2.2 标准化

划分完数据集后,再进行标准化,标准化(在训练集上fit,然后transform所有集合)

记住:

- 训练集: fit + transform ✓

- 验证集: transform ✓

- 测试集: transform ✓

正确的做法:

先划分数据集,然后仅在训练集上拟合 StandardScaler ,最后用这个拟合好的 scaler 来转换训练集、验证集和测试集。

有关StandardScaler()函数的用法请见附录3!

3.运行传统ML模型

相关机器学习知识点讲解

1. 数据集划分的作用

训练集:用于模型学习参数(如权重)。

验证集:用于模型选择、超参数调优,避免直接在测试集上调参导致信息泄露。

测试集:最终评估模型泛化能力,仅使用一次。

2. 特征标准化

为什么需要标准化?

逻辑回归、SVM 等模型依赖于特征间的尺度,如果特征数值范围差异大,会导致模型偏向数值大的特征,且梯度下降收敛慢。标准化使每个特征均值为0、标准差为1,消除量纲影响。

为什么树模型不需要标准化?

决策树基于特征值划分节点,不关心特征的绝对尺度,因此标准化对树模型无影响。

为什么在训练集上 fit,再 transform 验证/测试集?

防止数据泄露:验证/测试集应模拟未知数据,必须使用训练集计算出的均值和标准差进行转换,而不能使用自身统计量。

哪些模型需要标准化?哪些不需要?请见附录4!!!

3. 评估指标(二分类)

准确率(Accuracy) :

(TP+TN)/(TP+TN+FP+FN),整体正确率,但类别不平衡时可能误导。精确率(Precision) :

TP/(TP+FP),预测为正例的样本中实际为正的比例。召回率(Recall) :

TP/(TP+FN),实际为正例的样本中被正确预测的比例。F1分数:精确率和召回率的调和平均数,综合衡量。

AUC(Area Under the ROC Curve):模型区分正负类的能力,不受阈值影响,对不平衡数据更鲁棒。

4. 工厂模式

ClassifierFactory隐藏了模型创建的细节,使代码易于扩展:添加新模型只需修改工厂,无需改动主流程。5. 异常处理

- 使用

try-except避免单个模型失败导致整个程序崩溃,增强鲁棒性。

潜在 Bug 与优化建议

SVM 无法输出概率

代码中 SVM 参数未设置

probability=True,而evaluate方法中计算 AUC 需要调用predict_proba。后果 :运行到 SVM 时,

classifier.evaluate(X_test, y_test)内部若调用predict_proba会抛出AttributeError,被except捕获后跳过 SVM,但用户可能误以为 SVM 不可用。修复 :在 SVM 参数字典中添加

'probability': True,或确保evaluate在无法获取概率时使用其他方式(如决策函数计算 AUC)------但决策函数与概率尺度不同,通常不直接用于 AUC,因此建议启用probability=True。依赖库缺失

如果环境中未安装

xgboost或lightgbm,ClassifierFactory创建模型时会抛出ImportError,被捕获后跳过。虽然程序继续运行,但用户可能未察觉缺失。优化:在日志中明确提示缺失的库,或提前检查依赖。

输出目录可能不存在

results_file = Path(output_dir) / 'ml_comparison_results.json',若output_dir目录不存在,写入文件会失败。修复 :在函数开头添加

Path(output_dir).mkdir(parents=True, exist_ok=True)。验证集未用于模型选择

代码中验证集仅用于记录指标,未参与任何超参数调整。如果目的是最终对比,可以直接在测试集上评估,无需验证集。但保留验证集可观察模型在验证集上的表现,辅助判断过拟合。

无 Bug,但可优化:可考虑使用验证集进行简单超参数搜索(如网格搜索),提升模型性能。

评估指标未考虑分类阈值

精确率、召回率、F1 依赖于默认阈值 0.5。如果类别极不平衡,默认阈值可能不是最优。但 AUC 不受阈值影响,可作为主要参考。

优化:可额外输出最佳阈值下的指标,或绘制 PR 曲线。

数据类型问题

如果

y不是整数,某些模型可能要求标签为整数。通常从文件加载后应为 int。检查 :确保

y_train等为整数类型(np.int64或int)。优化建议

增加模型保存

使用

joblib.dump保存训练好的模型,便于后续部署或继续分析。并行训练

如果模型较多且耗时,可使用

joblib.Parallel或concurrent.futures并行训练,但注意内存占用。更详细的日志

记录每个模型的训练时间、验证集指标,方便对比。

超参数调优

使用

GridSearchCV或RandomizedSearchCV在验证集上自动搜索最佳参数,而不是固定参数。处理类别不平衡

如果标签不平衡,可在模型参数中设置

class_weight='balanced'(逻辑回归、SVM、随机森林支持),或在评估时使用宏平均/加权平均。验证指标可视化

保存结果后,可自动生成柱状图对比各模型在测试集上的指标,就像原脚本中

visualize_results所做的那样。异常处理细化

区分依赖缺失错误和模型训练错误,给出更具体的提示。

这行代码比较有意思:

classifier = ClassifierFactory.create_classifier(model_name, **params)

这行代码中ClassifierFactory类对象 并未实例化,就直接调用**create_classifier方法,**为啥能这样?

原因是:

@staticmethod:声明该方法是静态方法,可以直接通过类名调用(如ClassifierFactory.create_classifier(...)),无需创建工厂实例。适合作为工具方法。具体学习请见附录5!

3.0 分类器基类

面向对象设计原则:基类定义了统一接口,子类实现具体逻辑,使得评估代码可以复用,且易于扩展新模型。

-

继承 :

LogisticRegressionClassifier继承自BaseClassifier,可以复用基类中定义的通用属性和方法(如name、scaler、logger等),体现了面向对象的代码复用思想。 -

多态 :所有分类器类都实现相同的接口(

fit、predict、predict_proba),使得工厂模式可以统一创建和调用。

python

class BaseClassifier:

"""分类器基类"""

def __init__(self, name: str):

self.name = name

self.model = None

self.scaler = StandardScaler()

self.is_fitted = False

def fit(self, X: np.ndarray, y: np.ndarray) -> None:

"""训练模型"""

raise NotImplementedError

def predict(self, X: np.ndarray) -> np.ndarray:

"""预测"""

raise NotImplementedError

def predict_proba(self, X: np.ndarray) -> np.ndarray:

"""预测概率"""

raise NotImplementedError

def evaluate(self, X: np.ndarray, y: np.ndarray) -> Dict[str, float]:

"""评估模型"""

y_pred = self.predict(X)

y_proba = self.predict_proba(X)

metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba[:, 1]) if y_proba.shape[1] > 1 else 0.0

}

return metrics3.1 逻辑回归分类器

(1)类定义与初始化

python

class LogisticRegressionClassifier(BaseClassifier):

"""逻辑回归分类器"""class LogisticRegressionClassifier(BaseClassifier):定义一个名为LogisticRegressionClassifier的类,它继承自BaseClassifier(基类)。这意味着它将继承基类的属性和方法,例如可能已经定义了name和scaler等。

python

def __init__(self, max_iter: int = 1000, random_state: int = 42, use_scaler: bool = True):

super().__init__("Logistic Regression")

self.model = LogisticRegression(max_iter=max_iter, random_state=random_state)

self.use_scaler = use_scaler-

__init__方法:构造函数,在创建类的实例时自动调用。 -

参数:

-

max_iter:逻辑回归的最大迭代次数,默认为 1000。用于控制优化算法的迭代上限,防止不收敛时无限运行。 -

random_state:随机种子,默认为 42,用于确保结果可复现(逻辑回归中的求解器可能涉及随机性,如sag、saga)。 -

use_scaler:布尔值,指示是否在训练和预测前对特征进行标准化。

-

- 调用父类的构造函数 :将模型名称

"Logistic Regression"传递给BaseClassifier。父类可能会将该名称存储在self.name中,也可能做一些其他初始化(如创建日志记录器)。

- 创建逻辑回归模型实例 :使用

sklearn.linear_model.LogisticRegression,并传入用户指定的max_iter和random_state。这是真正执行分类的核心对象。

- 保存标准化标志 :将参数

use_scaler保存为实例变量,以便在fit、predict等方法中判断是否需要标准化。

(2)fit 方法:训练模型

python

def fit(self, X: np.ndarray, y: np.ndarray) -> None:

"""训练模型"""

if self.use_scaler:

X_scaled = self.scaler.fit_transform(X)

else:

X_scaled = X

self.model.fit(X_scaled, y)

self.is_fitted = True

logger.info(f"{self.name} 训练完成")fit方法 :用于训练模型。接收特征矩阵X和标签向量y,均为 NumPy 数组。

标准化处理:

- 如果

self.use_scaler为True,则调用self.scaler.fit_transform(X)对训练集进行拟合(计算均值和标准差)并转换数据。 - 如果为

False,则直接使用原始数据X。(外部数据已经标准化,模型内部不再需要重复标准化(防止数据泄露)) self.scaler是从哪里来的?是从父类BaseClassifier继承而来。父类在__init__中创建了一个StandardScaler实例,并赋值给self.scaler。

模型训练:

- 调用逻辑回归模型的

fit方法 :使用标准化后的(或原始的)特征和标签训练模型。训练完成后,模型参数(如权重和截距)被保存在self.model内部。

- 设置拟合标志 :标记模型已经训练过。这个标志可能用于后续操作(如

predict前检查模型是否已训练),提高代码的健壮性。

- 记录日志 :使用全局的

logger输出训练完成信息。self.name是在父类构造函数中设置的。

(3)评估模型

python

def evaluate(self, X: np.ndarray, y: np.ndarray) -> Dict[str, float]:

"""评估模型"""

y_pred = self.predict(X)

y_proba = self.predict_proba(X)

metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba[:, 1]) if y_proba.shape[1] > 1 else 0.0

}

return metrics

accuracy_score(y, y_pred)

准确率 :正确预测的样本数占总样本数的比例。公式:

(TP + TN) / (TP + TN + FP + FN)。适用性:直观易懂,但在类别不平衡时可能掩盖模型对少数类的表现。

计算 :

accuracy_score直接比较y_pred和y的相等性。

precision_score(y, y_pred, zero_division=0)

精确率 :在所有预测为正类的样本中,实际为正类的比例。公式:

TP / (TP + FP)。含义 :衡量模型预测正类的"纯度"。如果精确率低,说明模型误报较多。

zero_division=0 :当分母为 0(即没有预测为正类的样本)时,返回 0 而不是抛出错误。这是防止除零异常的安全措施。

recall_score(y, y_pred, zero_division=0)

召回率 :在所有实际为正类的样本中,被正确预测为正类的比例。公式:

TP / (TP + FN)。含义 :衡量模型找出正类的能力。召回率低说明漏报较多。

f1_score(y, y_pred, zero_division=0)

F1 分数 :精确率和召回率的调和平均数。公式:

2 * (precision * recall) / (precision + recall)。作用 :**综合衡量精确率和召回率,尤其适用于不平衡分类。**当两者之一为 0 时,F1 也为 0。

roc_auc_score(y, y_proba[:, 1]) if y_proba.shape[1] > 1 else 0.0

AUC(ROC 曲线下面积) :衡量模型区分正负类的能力。AUC 值越接近 1,模型性能越好。

计算 :

roc_auc_score需要真实标签和预测概率(通常是正类的概率)。这里取y_proba[:, 1]即正类的概率。条件判断 :

if y_proba.shape[1] > 1 else 0.0是为了防止在意外情况下(如某些模型只输出一列概率)出错。对于二分类逻辑回归,y_proba通常有两列,所以条件为真。为什么 AUC 不需要设置阈值:AUC 评估的是模型对所有可能阈值的综合表现,不依赖于 0.5 这个固定阈值,因此能更全面地反映模型性能。

首先,我们先看一下**y_pred = self.predict(X)**的具体实现:

python

def predict(self, X: np.ndarray) -> np.ndarray:

"""预测"""

if self.use_scaler:

X_scaled = self.scaler.transform(X)

else:

X_scaled = X

return self.model.predict(X_scaled)-

作用 :调用当前分类器对象的

predict方法,对输入特征矩阵X进行预测,得到每个样本的类别标签 (通常是 0 或 1)。 -

如何工作 :在

LogisticRegressionClassifier中,predict方法首先会根据use_scaler决定是否对X进行标准化(使用训练时拟合好的scaler),然后调用 self.model.predict(X_scaled)。model 是 sklearn 的 LogisticRegression 实例,其 predict 方法返回的是硬分类结果(即概率大于 0.5 的类别)。 -

(注意:这里只调用

transform,不重新拟合,符合机器学习规范)。 -

为什么需要这一步 :要计算准确率、精确率等指标,我们必须知道模型对每个样本的预测类别 ,才能与真实标签

y进行比较。

再看一下**y_proba = self.predict_proba(X)**的具体实现:

python

def predict_proba(self, X: np.ndarray) -> np.ndarray:

"""预测概率"""

if self.use_scaler:

X_scaled = self.scaler.transform(X)

else:

X_scaled = X

return self.model.predict_proba(X_scaled)-

作用 :调用

predict_proba方法,得到每个样本属于各个类别的概率估计 。对于二分类,输出形状为 (n_samples, 2),第一列是类别 0 的概率,第二列是类别 1 的概率。 -

在逻辑回归中的实现 :逻辑回归本身输出的是对数几率,通过 sigmoid 函数转换为概率。sklearn 的 LogisticRegression 提供了 predict_proba 方法,直接返回概率。

LogisticRegressionClassifier的predict_proba同样先处理标准化,然后调用self.model.predict_proba(X_scaled)。 -

为什么需要概率 :AUC(ROC 曲线下面积)需要预测概率而不是硬分类结果,因为它依赖于不同的分类阈值。精确率、召回率等则可以直接使用硬分类结果。

OK,我们来总结一下逻辑回归模型的从创建->训练->评估的全过程:

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, roc_auc_score, confusion_matrix

1.模型创建:

self.model = LogisticRegression(max_iter=max_iter, random_state=random_state)

2.模型训练:(注意:输入模型进行训练+预测,需要标准化之后的X_scaled)

self.model.fit(X_scaled, y)

3.模型评估:

y_pred = self.model.predict(X_scaled) # 得到每个样本的类别标签(通常是 0 或 1)

y_proba =self.model.predict_proba(X_scaled) # 得到每个样本属于各个类别的概率估计, 对于二分类,输出形状为 (n_samples, 2),第一列是类别 0 的概率,第二列是类别 1 的概率。

metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba:, 1) if y_proba.shape1 > 1 else 0.0

}

什么是逻辑回归模型请见附录7!

此处我有个2个疑问:

pythonlogger.info(f"训练 {model_name}...") classifier = ClassifierFactory.create_classifier(model_name, **params) classifier.fit(X_train, y_train) # 评估 train_metrics = classifier.evaluate(X_train, y_train) val_metrics = classifier.evaluate(X_val, y_val) test_metrics = classifier.evaluate(X_test, y_test) results[model_name] = { 'train': train_metrics, 'val': val_metrics, 'test': test_metrics } logger.info(f"{model_name} - Test Acc: {test_metrics['accuracy']:.4f}, " f"F1: {test_metrics['f1']:.4f}, AUC: {test_metrics['auc']:.4f}")(1)在我的代码中可以看到,我在分类器训练时只对训练集做了训练,但是我在评估模型时分别对训练集、验证集、测试集都进行了评估。

**据我所知:**如果仅将数据集划分为训练集+测试集的方式时,正确的做法是在训练集上训练,然后再测试集上评估即可,这种方式是最简单的。

如果将数据集划分为训练集+验证集+测试集的方式时,我能确定的是仅在训练集上训练模型,但是我不明白为什么要分别在训练集、验证集、测试集上都评估一遍呢?这样是正确的做法吗?有什么好处?目的是为了啥?

解答请见附录8!

(2)一般情况下对于深度学习分类器来看,在模型训练阶段我们需要记录每轮训练损失和验证损失的,最后选取最低验证损失的模型做为最佳模型并在测试集上进行评估的。

但是为啥这里我们同样也是划分了训练集+验证集+测试集,但是却并未记录训练损失和验证损失呢?而是分别在训练集、验证集、测试集上都评估一遍。为啥深度学习与传统机器学习的模型训练评估上做法不一样呢?

解答请见附录9!

3.2 SVM分类器 (RBF核)

(1)类定义与初始化

- 继承自

BaseClassifier:复用基类中的通用属性和方法(如name、scaler、is_fitted、evaluate等),保持接口统一。

python

class SVMClassifier(BaseClassifier):

"""SVM分类器 (RBF核)"""

python

def __init__(self, C: float = 1.0, gamma: str = 'scale', random_state: int = 42, use_scaler: bool = True):

super().__init__("SVM (RBF)")

self.model = SVC(kernel='rbf', C=C, gamma=gamma, probability=True, random_state=random_state)

self.use_scaler = use_scaler-

构造函数,接收四个常用参数,并设置默认值:

-

C:正则化参数的倒数,控制对误分类的惩罚强度。 -

gamma:RBF 核的系数,控制单个样本的影响范围。 -

random_state:随机种子,用于可重复性(SVM 的概率估计涉及随机性)。 -

use_scaler:是否对特征进行标准化(SVM 对特征尺度敏感)。

-

-

调用父类构造函数,传入模型名称

"SVM (RBF)",父类可能初始化self.name、self.scaler = StandardScaler()、self.is_fitted = False等。

-

创建

sklearn.svm.SVC实例,配置如下:-

kernel='rbf':使用径向基函数(RBF)核,将特征映射到高维空间,处理非线性问题。 -

C=C:正则化参数,默认 1.0。 -

gamma=gamma:核系数,可以是数值或'scale'、'auto'。 -

probability=True:启用概率估计(训练后可通过predict_proba输出概率,但会增加训练时间)。 -

random_state=random_state:保证概率估计的可复现性。

-

- 保存标准化标志,供

fit、predict等方法使用。

sklearn.svm.SVC模型构建详解请见附录10!

(2)fit 方法:训练模型

这部分就完全与3.1逻辑回归分类器一样了,代码走的同一个fit()方法。

- 为什么标准化? SVM 试图最大化间隔,特征尺度会影响距离计算。标准化可确保所有特征对决策边界的贡献平等,并加速收敛。

(3)评估模型

同3.1逻辑回归分类器,代码走的同一个evaluate()方法。

注意:

- 无论是逻辑回归分类器还是SVM分类器,评估的时候都是对训练集+验证集+测试集都分别评估了一遍,目的请见附录8!

- 无论是模型训练、还是模型验证+模型测试,输入的都是标准化后的特征。(在训练集上fit,然后transform所有集合)

OK,我们来总结一下SVM模型的从创建->训练->评估的全过程:

from sklearn.svm import SVC

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, roc_auc_score, confusion_matrix

1.模型创建:

self.model = SVC(kernel='rbf', C=C, gamma=gamma, probability=True, random_state=random_state)

2.模型训练:(注意:输入模型进行训练+预测,需要标准化之后的X_scaled)

self.model.fit(X_train_scaled, y_train)

3.模型评估:

y_pred = self.model.predict(X_scaled) # 得到每个样本的类别标签(通常是 0 或 1)

y_proba =self.model.predict_proba(X_scaled) # 得到每个样本属于各个类别的概率估计, 对于二分类,输出形状为

(n_samples, 2),第一列是类别 0 的概率,第二列是类别 1 的概率。metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba:, 1) if y_proba.shape1 > 1 else 0.0

}

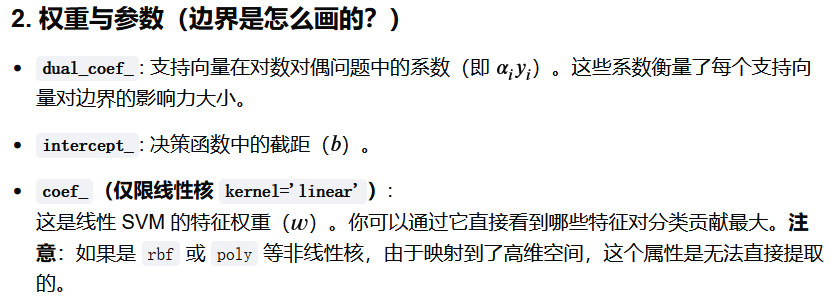

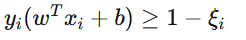

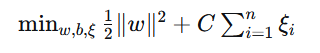

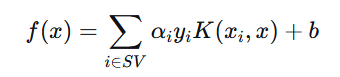

相关机器学习知识点1. 支持向量机(SVM)基本原理

核心思想:在高维空间中找到一个超平面,使得不同类别之间的间隔(margin)最大化。

数学形式 :对于线性可分数据,SVM 寻找满足

且

最小的超平面。

软间隔 :引入松弛变量

和惩罚参数

,允许少量误分类,目标函数为

。参数

控制对误分类的容忍度:

越大,越强调正确分类,可能过拟合;

越小,间隔越大,可能欠拟合。

2. 核技巧(Kernel Trick)

作用:将数据映射到高维特征空间,使原本线性不可分的问题变得线性可分,而无需显式计算映射。

RBF 核 :

,是一种局部核,可以拟合任意复杂度的决策边界。

参数

:控制单个样本的影响半径。

越小,高斯分布越宽,决策边界越平滑,模型复杂度低;

越大,每个样本的影响范围小,决策边界更弯曲,易过拟合。

'scale'表示,

'auto'表示。

3. 概率输出

- SVM 原本输出的是决策函数值(距离超平面的有符号距离),不直接提供概率。通过设置

probability=True,SVM 会在训练后额外拟合一个 Platt 缩放模型(sigmoid 函数)将决策值映射为概率。这会增加训练时间,但得到概率可用于计算 AUC 或调整阈值。4. 特征标准化的重要性

- SVM 依赖于特征间的内积或距离,如果特征尺度差异大,大尺度特征会主导距离计算,导致决策边界偏向它们。标准化可以消除量纲影响,使每个特征对决策的贡献更均衡。

3.3 随机森林分类器

(1)类定义与初始化

python

class RandomForestClassifier_(BaseClassifier):

"""随机森林分类器"""

def __init__(self, n_estimators: int = 100, max_depth: int = 20, random_state: int = 42):

super().__init__("Random Forest")

self.model = RandomForestClassifier(

n_estimators=n_estimators,

max_depth=max_depth,

random_state=random_state,

n_jobs=-1

)- 定义一个名为

RandomForestClassifier_的类,继承自基类BaseClassifier。基类提供了统一接口(如fit、predict、evaluate)和一些公共属性(name、scaler、is_fitted)。

-

构造函数,接收三个常用超参数并设置默认值:

-

n_estimators:随机森林中决策树的数量,默认 100。 -

max_depth:每棵树的最大深度,默认 20。 -

random_state:随机种子,确保结果可复现。

-

- 调用父类的构造函数,传入模型名称

"Random Forest"。父类会初始化self.name,可能还会初始化self.scaler(虽然这里不用)和self.is_fitted = False。

-

创建

sklearn.ensemble.RandomForestClassifier实例,并传入参数:-

n_estimators、max_depth、random_state保持用户指定值。 -

n_jobs=-1:使用所有可用的 CPU 核心进行并行训练,加速模型构建。

-

-

注意:这里没有传入 use_scaler 参数,因为随机森林作为树模型,不需要特征标准化 (特征尺度不影响决策树的分裂)。

(2)fit 方法:训练模型

python

def fit(self, X: np.ndarray, y: np.ndarray) -> None:

"""训练模型"""

self.model.fit(X, y)

self.is_fitted = True

logger.info(f"{self.name} 训练完成")-

fit方法直接调用底层随机森林模型的fit方法,传入原始特征X和标签y。由于树模型不依赖特征尺度,无需标准化。 -

训练完成后,将

self.is_fitted置为True,并记录日志。

(3)评估模型

python

def predict(self, X: np.ndarray) -> np.ndarray:

"""预测"""

return self.model.predict(X)- 直接调用底层模型的

predict方法,返回类别预测。

python

def predict_proba(self, X: np.ndarray) -> np.ndarray:

"""预测概率"""

return self.model.predict_proba(X)- 直接调用底层模型的

predict_proba方法,返回每个样本属于各个类别的概率。随机森林通过投票或平均各棵树的概率来得到最终概率。

python

def get_feature_importance(self) -> np.ndarray:

"""获取特征重要性"""

return self.model.feature_importances_返回随机森林的特征重要性数组。这是基于每棵树分裂时特征带来的不纯度减少(如基尼系数或信息增益)的加权平均,反映了每个特征对分类的贡献程度。

OK,我们来总结一下随机森林模型的从创建->训练->评估的全过程:

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, roc_auc_score, confusion_matrix

1.模型创建:

self.model = RandomForestClassifier(

**n_estimators=n_estimators, #**随机森林中决策树的数量

**max_depth=max_depth, #**每棵树的最大深度

**random_state=random_state, #**随机种子,确保结果可复现

**n_jobs=-1 #**使用所有可用的 CPU 核心进行并行训练,加速模型构建

)

2.模型训练:(注意:树模型不依赖特征尺度,训练与预测前X无需标准化。)

self.model.fit(X_train, y_train)

3.模型评估:

y_pred = self.model.predict(X) # 得到每个样本的类别标签(通常是 0 或 1)

y_proba =self.model.predict_proba(X) # 得到每个样本属于各个类别的概率估计, 对于二分类,输出形状为

(n_samples, 2),第一列是类别 0 的概率,第二列是类别 1 的概率。特征重要性数组 = self.model.feature_importances_

metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba:, 1) if y_proba.shape1 > 1 else 0.0

}

关机器学习知识点1. 随机森林(Random Forest)原理

集成学习:随机森林是 Bagging(Bootstrap Aggregating)的代表算法,通过构建多个决策树并综合它们的预测结果来提高准确性和鲁棒性。

构建过程:

对于每棵树,从原始训练集中有放回地抽样(bootstrap)生成一个子数据集。

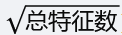

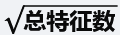

在每棵树的每个节点分裂时,随机选择一部分特征(通常为

)作为候选分裂特征,而不是全部特征。这进一步增加了树之间的差异性。

每棵树完整生长,不剪枝(或限制深度、叶子节点样本数等)。

预测方式:分类任务中,采用多数投票;回归任务中,取平均值。

2. 为什么随机森林不需要特征标准化?

决策树的分裂是基于特征值的排序和比较,不涉及距离计算或线性组合,因此特征的绝对大小或分布不影响分裂结果。标准化对树模型无效,甚至可能丢失信息(例如特征的物理含义)。

3. 参数含义

n_estimators:树的数量。越多通常效果越好,但计算成本线性增加,且边际收益递减。

max_depth:限制树的深度,防止过拟合。较深的树可能过拟合,较浅的树可能欠拟合。

random_state:控制 bootstrap 抽样和特征选择的随机性,确保结果可复现。

n_jobs=-1:并行训练,加快速度。4. 特征重要性

- 随机森林可以输出特征重要性,它基于所有树中每个特征带来的平均不纯度减少(或分裂次数)来衡量。这对于特征选择和理解数据非常有帮助。

随机森林分类器详解请见附录11!!

3.4 XGBoost分类器

python

class XGBoostClassifier_(BaseClassifier):

"""XGBoost分类器"""

def __init__(self, n_estimators: int = 100, max_depth: int = 6,

learning_rate: float = 0.1, random_state: int = 42):

super().__init__("XGBoost")

self.model = xgb.XGBClassifier(

n_estimators=n_estimators,

max_depth=max_depth,

learning_rate=learning_rate,

random_state=random_state,

n_jobs=-1,

eval_metric='logloss'

)(1)类定义与初始化

- 定义

XGBoostClassifier_类,继承自基类BaseClassifier。基类提供了统一的接口和公共属性(如name、scaler、is_fitted)。

-

构造函数,接收四个常用超参数,并设置默认值:

-

n_estimators:提升轮数(树的数量),默认 100。 -

max_depth:每棵树的最大深度,默认 6。 -

learning_rate:学习率(步长收缩),默认 0.1。 -

random_state:随机种子,确保结果可复现。

-

- 调用父类构造函数,传入模型名称

"XGBoost",父类会初始化self.name、self.is_fitted等。

-

创建

xgb.XGBClassifier实例,并传入参数:-

n_estimators、max_depth、learning_rate、random_state保持用户指定值。 -

n_jobs=-1:使用所有 CPU 核心进行并行训练,加速模型构建。 -

eval_metric='logloss':指定评估指标为对数损失,用于验证集监控(如果提供eval_set)。

-

-

注意:XGBoost 作为树模型,不需要特征标准化 。

(2)fit 方法:训练模型

python

def fit(self, X: np.ndarray, y: np.ndarray,

eval_set: Optional[Tuple[np.ndarray, np.ndarray]] = None) -> None:

"""训练模型"""

if eval_set is not None:

X_eval, y_eval = eval_set

self.model.fit(X, y, eval_set=[(X_eval, y_eval)], verbose=False)

else:

self.model.fit(X, y, verbose=False)

self.is_fitted = True

logger.info(f"{self.name} 训练完成")-

fit 方法增加了可选的 eval_set 参数,用于传入验证集(特征和标签),以便在训练过程中监控验证集上的 eval_metric。

-

如果提供了

eval_set,则调用fit时传入eval_set=[(X_eval, y_eval)],XGBoost 会在每轮迭代后计算验证集上的指标并记录(可用于早停或监控)。 -

如果没有提供,则直接训练,不进行验证监控。

-

verbose=False关闭训练过程中的详细输出,保持日志整洁。 -

训练完成后,设置

self.is_fitted = True并记录日志。

(3)评估模型

python

def predict(self, X: np.ndarray) -> np.ndarray:

"""预测"""

return self.model.predict(X)- 直接调用底层模型的

predict方法,返回类别预测。

python

def predict_proba(self, X: np.ndarray) -> np.ndarray:

"""预测概率"""

return self.model.predict_proba(X)- 直接调用底层模型的

predict_proba方法,返回每个样本属于各类别的概率。

python

def get_feature_importance(self) -> np.ndarray:

"""获取特征重要性"""

return self.model.feature_importances_- 返回 XGBoost 的特征重要性数组。XGBoost 的特征重要性可以基于

weight(特征被用作分裂的次数)、gain(平均增益)、cover(平均覆盖度)等,默认是weight。

import xgboost as xgb

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, roc_auc_score, confusion_matrix

1.模型创建:

self.model = xgb.XGBClassifier(

**n_estimators=n_estimators, #**提升轮数(树的数量),默认 100。

**max_depth=max_depth, #**每棵树的最大深度,默认 6。

**learning_rate=learning_rate, #**学习率(步长收缩),默认 0.1。

**random_state=random_state, #**随机种子,确保结果可复现。

**n_jobs=-1, #**使用所有 CPU 核心进行并行训练,加速模型构建。

eval_metric='logloss' # 指定评估指标为对数损失,用于验证集监控(如果提供

eval_set=True)。)

2.模型训练:(注意:树模型不依赖特征尺度,训练与预测前X无需标准化。)

self.model.fit(X_train, y_train)

3.模型评估:

y_pred = self.model.predict(X) # 得到每个样本的类别标签(通常是 0 或 1)

y_proba =self.model.predict_proba(X) # 得到每个样本属于各个类别的概率估计, 对于二分类,输出形状为

(n_samples, 2),第一列是类别 0 的概率,第二列是类别 1 的概率。特征重要性数组 = self.model.feature_importances_

metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba:, 1) if y_proba.shape1 > 1 else 0.0

}

相关机器学习知识点1. XGBoost 是什么?

XGBoost(eXtreme Gradient Boosting)是一种基于**梯度提升决策树(GBDT)**的优化算法,它通过迭代地添加决策树来拟合前一轮的残差,从而逐步减小损失函数。XGBoost 在 GBDT 的基础上引入了正则化、二阶泰勒展开、并行计算、缺失值处理等优化,使其在速度和精度上表现优异,成为 Kaggle 竞赛和工业界最常用的算法之一。

2. 核心参数含义

n_estimators:提升迭代次数,即树的数量。越多通常效果越好,但可能过拟合,且训练时间增加。

max_depth:树的最大深度。控制模型复杂度,过深易过拟合,过浅可能欠拟合。

learning_rate(也称eta):每棵树的贡献权重,通常与n_estimators配合使用。较小的学习率需要更多的树来达到相同效果,但泛化能力更好。

eval_metric:验证集评估指标。'logloss'是对数损失,适用于二分类;也可用'error'(分类错误率)、'auc'等。

n_jobs:并行线程数,-1表示使用所有 CPU 核心。

random_state:随机种子,保证可复现性。3. 为什么树模型不需要标准化?

决策树和基于树的集成方法(如随机森林、XGBoost)通过特征值的大小关系进行分裂,不涉及距离计算,因此特征的绝对尺度不影响分裂结果。标准化不仅不必要,还可能丢失特征的原始含义。

4. 验证集监控与早停

在

fit中传入eval_set,XGBoost 会在每轮迭代后计算指定指标。可以结合early_stopping_rounds参数(当前代码未设置)实现早停:若验证集指标连续early_stopping_rounds轮不提升,则停止训练,并恢复最佳模型。这有助于防止过拟合,并节省训练时间。

5. 特征重要性

XGBoost 提供了多种特征重要性计算方式:

weight:特征被用作分裂的次数。

gain:使用特征分裂带来的平均增益(信息增益)。

cover:特征分裂时覆盖的样本数量加权平均。通过

get_feature_importance可以分析哪些特征对模型贡献最大。xgboost.XGBClassifier详细学习请见附录12!!

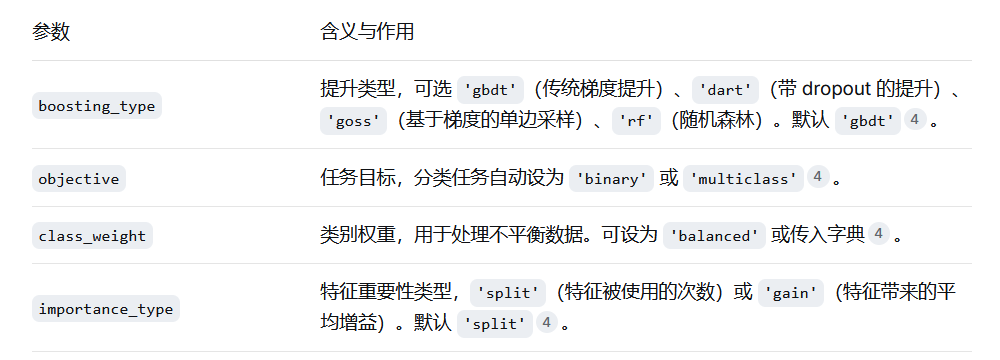

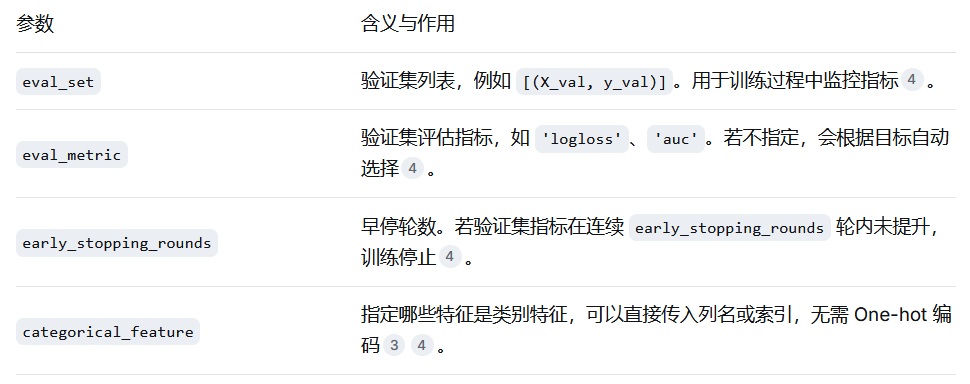

3.5 LightGBM分类器

(1)类定义与初始化

python

class LightGBMClassifier_(BaseClassifier):

"""LightGBM分类器"""

def __init__(self, n_estimators: int = 100, max_depth: int = 6,

learning_rate: float = 0.1, random_state: int = 42):

super().__init__("LightGBM")

self.model = lgb.LGBMClassifier(

n_estimators=n_estimators,

max_depth=max_depth,

learning_rate=learning_rate,

random_state=random_state,

n_jobs=-1,

verbose=-1

)-

定义一个名为

LightGBMClassifier_的类,继承自基类BaseClassifier,保持与实验框架一致的接口。 -

构造函数接收四个常用超参数,并设置默认值:

-

n_estimators:提升迭代次数(树的数量),默认 100。 -

max_depth:树的最大深度,默认 6。注意:LightGBM 的max_depth与 XGBoost 类似,但它的默认生长策略是leaf-wise,深度限制可能与其他框架略有不同。 -

learning_rate:学习率(步长收缩),默认 0.1。 -

random_state:随机种子,确保结果可复现。

-

- 调用父类构造函数,传入模型名称

"LightGBM"。父类会初始化self.name、self.scaler(虽然 LightGBM 不需要标准化)、self.is_fitted = False等。

-

创建

lightgbm.LGBMClassifier实例,并传入参数:-

n_estimators、max_depth、learning_rate、random_state保持用户指定值。 -

n_jobs=-1:使用所有 CPU 核心进行并行训练。 -

verbose=-1:设置日志输出级别为 -1,表示关闭所有 LightGBM 内部日志(静默模式),避免在控制台输出大量训练信息。

-

-

LightGBM 同样是基于树的模型,不需要特征标准化 。

(2)fit 方法:训练模型

这部分完全同XGBoost分类器的训练过程相同!

-

fit方法接收特征X、标签y,以及可选的验证集eval_set(特征和标签的元组)。 -

如果提供了

eval_set,则将其包装成列表传入eval_set参数,LightGBM 会在每轮迭代后计算验证集上的默认指标(如二分类的logloss或auc),并可用于早停或监控。 -

如果没有提供,则直接训练。

(3)评估模型

这部分完全同XGBoost分类器的评估过程相同!

python

def predict(self, X: np.ndarray) -> np.ndarray:

"""预测"""

return self.model.predict(X)- 直接调用底层模型的

predict方法,返回类别预测(0 或 1)。

python

def predict_proba(self, X: np.ndarray) -> np.ndarray:

"""预测概率"""

return self.model.predict_proba(X)- 直接调用底层模型的

predict_proba方法,返回概率矩阵,形状为(n_samples, 2)。

python

def get_feature_importance(self) -> np.ndarray:

"""获取特征重要性"""

return self.model.feature_importances_- 返回 LightGBM 的特征重要性数组。LightGBM 默认使用

split次数(即特征被用作分裂的次数)作为重要性,也可以通过设置importance_type参数改变(如gain表示平均增益)。

import lightgbm as lgb

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, roc_auc_score, confusion_matrix

1.模型创建:

self.model = lgb.LGBMClassifier(

**n_estimators=n_estimators, #**提升迭代次数(树的数量),默认 100。

max_depth=max_depth, # 树的最大深度,默认 6。注意:LightGBM 的

max_depth与 XGBoost 类似,但它的默认生长策略是leaf-wise,深度限制可能与其他框架略有不同。**learning_rate=learning_rate, #**学习率(步长收缩),默认 0.1。

**random_state=random_state, #**随机种子,确保结果可复现。

**n_jobs=-1, #**使用所有 CPU 核心进行并行训练

**verbose=-1 #**设置日志输出级别为 -1,表示关闭所有 LightGBM 内部日志(静默模式),避免在控制台输出大量训练信息。

)

2.模型训练:(注意:树模型不依赖特征尺度,训练与预测前X无需标准化。)

self.model.fit(X_train, y_train)

3.模型评估:

y_pred = self.model.predict(X) # 得到每个样本的类别标签(通常是 0 或 1)

y_proba =self.model.predict_proba(X) # 得到每个样本属于各个类别的概率估计, 对于二分类,输出形状为

(n_samples, 2),第一列是类别 0 的概率,第二列是类别 1 的概率。特征重要性数组 = self.model.feature_importances_

metrics = {

'accuracy': accuracy_score(y, y_pred),

'precision': precision_score(y, y_pred, zero_division=0),

'recall': recall_score(y, y_pred, zero_division=0),

'f1': f1_score(y, y_pred, zero_division=0),

'auc': roc_auc_score(y, y_proba:, 1) if y_proba.shape1 > 1 else 0.0

}

LightGBM 相关机器学习知识点1. LightGBM 是什么?

LightGBM(Light Gradient Boosting Machine)是由微软开源的梯度提升框架,与 XGBoost 类似,也是一种基于决策树的集成学习算法。它在训练速度和内存效率上进行了大量优化,尤其适合大规模数据。

2. LightGBM 的核心特点

基于直方图的算法:将连续特征离散化为直方图桶,大大减少了内存消耗和计算复杂度。

Leaf-wise 生长策略 :大多数 GBDT 实现采用 level-wise 生长(按层生长),而 LightGBM 采用 leaf-wise 生长,每次从当前所有叶子中找到分裂增益最大的叶子进行分裂。这可以更快地降低损失,但容易过拟合,因此通常需要限制

max_depth或使用num_leaves来控制。支持类别特征 :可以直接输入类别特征,无需 one-hot 编码,通过

categorical_feature参数指定。并行学习:支持特征并行和数据并行,加速训练。

处理缺失值:自动学习缺失值的最佳分裂方向。

3. 常用参数详解

n_estimators:提升迭代次数,即树的数量。

max_depth:树的最大深度,用于控制过拟合。注意 leaf-wise 生长时,深度限制可能不如num_leaves有效。

learning_rate:学习率,通常与n_estimators配合调整。

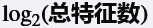

num_leaves:每棵树的最大叶子数,是控制模型复杂度的关键参数,默认 31。通常num_leaves小于。

min_child_samples/min_child_weight:叶子节点所需的最小样本数/权重和,用于防止过拟合。

subsample/bagging_fraction:训练每棵树时对样本的采样比例,用于增加随机性。

colsample_bytree/feature_fraction:训练每棵树时对特征的采样比例。

reg_alpha、reg_lambda:L1/L2 正则化系数。

n_jobs:并行线程数。

verbose:控制日志输出级别,-1 表示静默,0 表示仅输出警告,1 表示输出基本信息。4. 为什么 LightGBM 不需要特征标准化?

与所有基于树的模型一样,LightGBM 只关心特征值的相对顺序,不涉及距离计算,因此特征的尺度不影响分裂结果,标准化非必需。

有关LigtGBM分类器的学习请见附录13!!

4.运行深度学习模型

函数签名

def run_dl_comparison(X_train: np.ndarray, y_train: np.ndarray,

X_val: np.ndarray, y_val: np.ndarray,

X_test: np.ndarray, y_test: np.ndarray,

output_dir: str = './results',

epochs: int = 50, batch_size: int = 32) -> dict:-

功能:运行多个深度学习模型(MLP、BiLSTM、Transformer、ResNet1D)的对比实验。

-

参数:

-

X_train, y_train:训练集特征和标签(NumPy 数组,已标准化)。 -

X_val, y_val:验证集特征和标签。 -

X_test, y_test:测试集特征和标签。 -

output_dir:保存结果和模型的目录。 -

epochs:最大训练轮数。 -

batch_size:批大小。

-

-

返回:字典,键为模型名称,值为测试集指标和训练历史。

-

日志和输出目录准备

logger.info("\n" + "="*80)

logger.info("深度学习模型对比")

logger.info("="*80)Path(output_dir).mkdir(parents=True, exist_ok=True)

-

打印醒目标题,标记深度学习对比开始。

-

确保输出目录存在,若不存在则递归创建(

parents=True),且不因已存在而报错(exist_ok=True)。

Path对象的用法可见附录2!!

2. 获取输入维度

input_dim = X_train.shape[1]

logger.info(f"输入特征维度: {input_dim}")- 从训练集特征中获取特征数量,用于定义模型输入层大小。

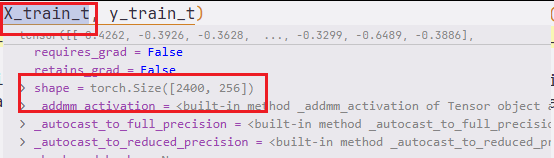

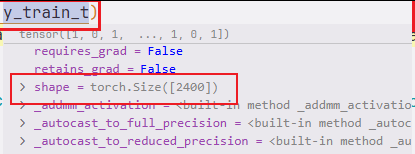

3. 转换为 PyTorch 张量

X_train_t = torch.tensor(X_train, dtype=torch.float32)

y_train_t = torch.tensor(y_train, dtype=torch.long)

X_val_t = torch.tensor(X_val, dtype=torch.float32)

y_val_t = torch.tensor(y_val, dtype=torch.long)-

将 NumPy 数组转换为 PyTorch 张量。

-

特征使用

float32类型(深度学习常用精度),标签使用long类型(分类交叉熵损失要求)。

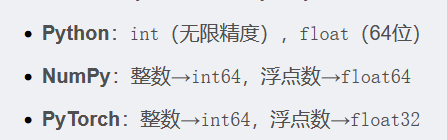

记住:在深度学习中最常用的是

torch.float32和torch.long(int64)!Python、NumPy和PyTorch的默认数据类型对比(整数+浮点数)请见:

https://blog.csdn.net/m0_59777389/article/details/154386670?spm=1011.2415.3001.5331

的章节4部分

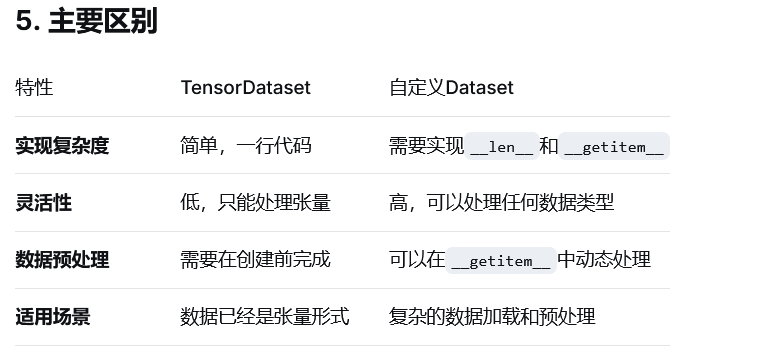

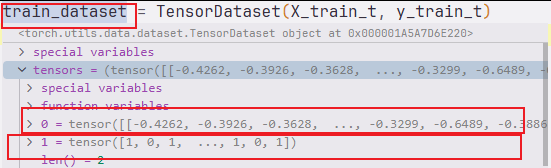

4. 创建 DataLoader

train_dataset = TensorDataset(X_train_t, y_train_t)

val_dataset = TensorDataset(X_val_t, y_val_t)

train_loader = DataLoader(train_dataset, batch_size=batch_size, shuffle=True)

val_loader = DataLoader(val_dataset, batch_size=batch_size)-

TensorDataset将特征和标签包装成数据集,便于按索引取样本。 -

DataLoader负责批量加载数据:-

batch_size:每批样本数。 -

shuffle=True:训练集打乱顺序,增加随机性,防止模型记住样本顺序。 -

验证集不需要打乱,因此

shuffle=False(默认)。

-

有关torch.utils.data.TensorDataset的用法请见 LSTM模型做分类任务2(PyTorch实现)这篇博客的第5节! 或者附录14的介绍!

5. 定义待比较的深度学习模型

dl_models = [

('mlp', {'hidden_dims': [512, 256, 128]}),

('bilstm', {'hidden_dim': 128, 'num_layers': 2}),

('transformer', {'d_model': 128, 'nhead': 4, 'num_layers': 2}),

('resnet1d', {'num_blocks': 3})

]-

每个元组包含模型名称和参数字典。

-

这些参数将传递给

ClassifierFactory.create_dl_model,用于实例化具体模型。

6. 遍历每个模型

results = {}

for model_name, params in dl_models:

try:

logger.info(f"\n训练 {model_name}...")

# 创建模型

model = ClassifierFactory.create_dl_model(model_name, input_dim=input_dim, **params)

# 训练

trainer = DeepLearningTrainer(model, learning_rate=0.001)

history = trainer.fit(train_loader, val_loader, epochs=epochs, patience=15)

# 评估(使用批处理避免内存溢出)

test_pred, test_proba = trainer.predict(X_test, batch_size=batch_size)

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, roc_auc_score

test_metrics = {

'accuracy': float(accuracy_score(y_test, test_pred)),

'precision': float(precision_score(y_test, test_pred, zero_division=0)),

'recall': float(recall_score(y_test, test_pred, zero_division=0)),

'f1': float(f1_score(y_test, test_pred, zero_division=0)),

'auc': float(roc_auc_score(y_test, test_proba[:, 1]))

}

results[model_name] = {

'test': test_metrics,

'history': history

}

logger.info(f"{model_name} - Test Acc: {test_metrics['accuracy']:.4f}, "

f"F1: {test_metrics['f1']:.4f}, AUC: {test_metrics['auc']:.4f}")

# 保存模型

model_path = Path(output_dir) / f'{model_name}_best_model.pth'

trainer.save_model(str(model_path))

except Exception as e:

logger.error(f"训练 {model_name} 时出错: {e}")

import traceback

traceback.print_exc()

continue-

创建模型:通过工厂方法创建指定模型,传入输入维度和参数字典。

-

创建训练器 :

DeepLearningTrainer封装了训练循环,学习率设为 0.001。 -

训练 :调用

trainer.fit,传入训练和验证 DataLoader,最大轮数epochs,早停耐心值patience=15。返回训练历史(每轮损失等)。 -

预测:用训练好的模型对测试集进行预测(批处理避免内存不足),得到预测类别和概率。

-

计算指标 :使用 sklearn 的指标函数计算准确率、精确率、召回率、F1 和 AUC。注意

zero_division=0防止除零错误。 -

存储结果:将测试指标和历史存入字典。

-

保存模型 :调用

trainer.save_model保存最佳模型(通常早停时保存的最佳模型)。 -

异常处理:如果某个模型训练失败,记录错误并跳过,继续下一个模型。

相关机器学习知识点

1. 深度学习训练流程

数据准备:将原始数据转换为张量,用 DataLoader 批量加载,训练时打乱顺序增加随机性。

模型定义:根据任务选择合适的神经网络架构(MLP、LSTM、Transformer、ResNet)。

损失函数与优化器 :通常分类任务用交叉熵损失,优化器如 Adam(

DeepLearningTrainer内部可能默认使用 Adam)。训练循环:每个 epoch 遍历训练集,前向传播、计算损失、反向传播、更新参数。每个 epoch 后在验证集上评估,监控过拟合。

早停 :当验证集损失连续

patience轮不再下降时停止训练,并恢复最佳模型参数,防止过拟合。2. 评估指标

准确率:预测正确的比例,但类别不平衡时可能误导。

精确率:预测为正类的样本中实际为正的比例,衡量误报情况。

召回率:实际为正类的样本中被正确预测的比例,衡量漏报情况。

F1 分数:精确率和召回率的调和平均,综合衡量。

AUC:ROC 曲线下面积,衡量模型区分正负类的能力,不受分类阈值影响。

3. PyTorch 数据加载机制

TensorDataset和DataLoader是 PyTorch 中常用的数据加载方式,适合小数据集。对于大数据集,通常使用自定义 Dataset 类。

DataLoader支持多线程预加载,num_workers参数可加速,但此处未设置(默认 0),可能成为瓶颈。4. 模型保存

通常保存最佳模型(验证损失最低的 epoch)的参数,以便后续部署或继续训练。

.pth文件存储模型状态字典(state_dict)。

Bug 分析

未加载最佳模型进行预测

trainer.fit返回history,但trainer.predict使用的是训练结束时的模型还是早停恢复的最佳模型?这取决于DeepLearningTrainer的实现。如果它内部实现了早停并加载最佳模型,则预测正确;否则可能使用最后一轮模型,导致评估结果不是最优的。建议 :检查

DeepLearningTrainer的fit方法,确保它保存了最佳模型并在predict中使用该模型。或者在fit后显式加载最佳模型再预测。验证集评估未在训练循环外进行

- 当前代码只在训练循环内部通过

trainer.fit监控验证损失,但在训练结束后没有单独对验证集进行评估并保存指标。如果希望输出验证集指标(如之前传统 ML 那样),此处缺少。不过最终只关心测试集,问题不大,但不利于分析过拟合。未指定设备(GPU/CPU)

代码中没有将模型和数据移动到 GPU 的语句,可能默认使用 CPU,训练会很慢。

DeepLearningTrainer内部可能自动检测 GPU,但最好显式设置。建议:在训练器中添加设备参数,或确保模型和数据能自动迁移。

from sklearn.metrics导入位置

- 在循环内导入 sklearn 函数,每次都会重复导入,虽然不影响功能但稍显低效。建议移至文件顶部。

数据类型假设

- 假设标签是

long,但y_test可能是整数数组,转换没问题。但注意分类数必须与模型输出一致(二分类)。缺失值处理

- 特征数据已标准化,但未检查是否存在 NaN 或 Inf,可能导致训练失败。

内存问题

trainer.predict(X_test, batch_size)使用批处理避免内存溢出,但如果X_test非常大,仍需注意显存或内存限制。批处理大小应与训练一致。

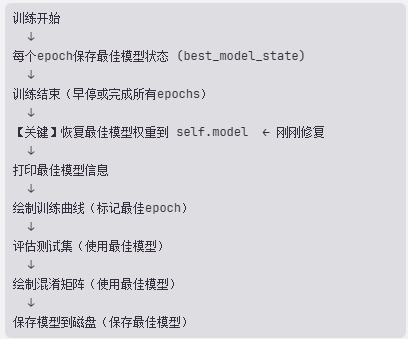

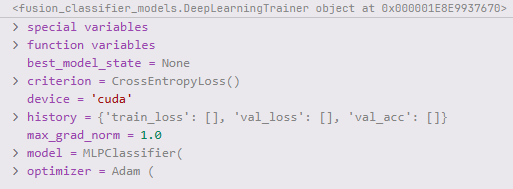

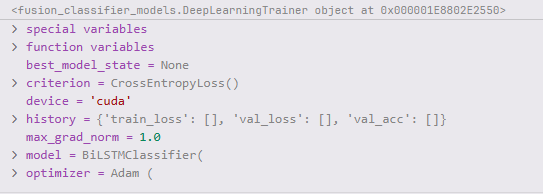

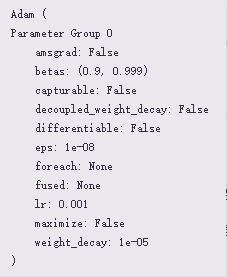

0.DeepLearningTrainer类

(1) __init__ 方法

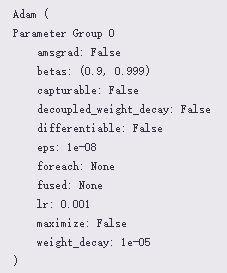

def __init__(self, model: nn.Module, device: str = 'cuda' if torch.cuda.is_available() else 'cpu',

learning_rate: float = 0.001, weight_decay: float = 1e-5):-

构造函数,接收模型、设备、学习率和权重衰减。

-

device默认自动选择 GPU(如果可用),否则 CPU。self.model = model.to(device) self.device = device self.optimizer = optim.Adam(model.parameters(), lr=learning_rate, weight_decay=weight_decay) self.criterion = nn.CrossEntropyLoss() self.history = {'train_loss': [], 'val_loss': [], 'val_acc': []} self.best_model_state = None -

将模型移动到指定设备(GPU/CPU),并保存设备信息。

-

使用 Adam 优化器,传入模型参数、学习率和 L2 正则化系数

weight_decay。 -

交叉熵损失函数,适用于多分类(包括二分类),内部结合了 Softmax。

-

history:记录训练过程中的损失和验证准确率。 -

best_model_state:用于保存验证损失最低时的模型参数(CPU 上的副本),以便早停后恢复。

(2)train_epoch 方法

def train_epoch(self, train_loader: DataLoader) -> float:

"""训练一个epoch"""

self.model.train()

total_loss = 0.0-

设置模型为训练模式(启用 Dropout 等)。

-

初始化总损失。

for X_batch, y_batch in train_loader: X_batch = X_batch.to(self.device) y_batch = y_batch.to(self.device) -

遍历 DataLoader,将数据移动到设备。

self.optimizer.zero_grad() outputs = self.model(X_batch) loss = self.criterion(outputs, y_batch) loss.backward() # 梯度裁剪,防止梯度爆炸 torch.nn.utils.clip_grad_norm_(self.model.parameters(), max_norm=1.0) self.optimizer.step() total_loss += loss.item() -

清零梯度,前向传播得到 logits,计算损失,反向传播。

-

梯度裁剪,限制梯度的最大范数,防止梯度爆炸导致训练不稳定。

-

更新参数,累加当前 batch 的损失值。

return total_loss / len(train_loader) -

返回当前 epoch 的平均训练损失。

梯度爆炸是啥?为啥梯度裁剪能防止梯度爆炸?如何裁剪的?请见附录15!

(3)validate 方法

def validate(self, val_loader: DataLoader) -> Tuple[float, float]:

"""验证"""

self.model.eval()

total_loss = 0.0

correct = 0

total = 0-

设置模型为评估模式(关闭 Dropout 等)。

-

初始化损失和正确计数。

with torch.no_grad(): for X_batch, y_batch in val_loader: X_batch = X_batch.to(self.device) y_batch = y_batch.to(self.device) outputs = self.model(X_batch) loss = self.criterion(outputs, y_batch) total_loss += loss.item() _, predicted = torch.max(outputs.data, 1) total += y_batch.size(0) correct += (predicted == y_batch).sum().item() -

禁用梯度计算,加快推理并节省内存。

-

对每个 batch 计算损失和预测,累加正确数。

avg_loss = total_loss / len(val_loader) accuracy = correct / total return avg_loss, accuracy

返回平均验证损失和准确率。

(4)fit 方法

def fit(self, train_loader: DataLoader, val_loader: DataLoader,

epochs: int = 50, patience: int = 10) -> Dict[str, List]:

"""训练模型"""

best_val_loss = float('inf')

patience_counter = 0-

初始化最佳验证损失和早停计数器。

for epoch in range(epochs): train_loss = self.train_epoch(train_loader) val_loss, val_acc = self.validate(val_loader) self.history['train_loss'].append(train_loss) self.history['val_loss'].append(val_loss) self.history['val_acc'].append(val_acc) -

每个 epoch 训练并验证,记录指标。

if (epoch + 1) % 10 == 0: logger.info(f"Epoch {epoch+1}/{epochs} - Train Loss: {train_loss:.4f}, " f"Val Loss: {val_loss:.4f}, Val Acc: {val_acc:.4f}") -

每 10 个 epoch 打印一次进度(避免日志过多)。

# 早停并保存最佳模型 if val_loss < best_val_loss: best_val_loss = val_loss patience_counter = 0 # 保存最佳模型状态 self.best_model_state = {k: v.cpu().clone() for k, v in self.model.state_dict().items()} else: patience_counter += 1 if patience_counter >= patience: logger.info(f"早停触发,在epoch {epoch+1}") # 恢复最佳模型 if self.best_model_state is not None: self.model.load_state_dict(self.best_model_state) logger.info("已恢复最佳模型权重") break -

如果验证损失下降,则更新最佳损失,重置计数器,并保存模型状态(复制到 CPU 防止 GPU 内存变化)。

-

如果验证损失未改善,计数器加一,达到耐心值则早停,并恢复最佳模型权重,退出循环。

return self.history -

返回训练历史。

我的代码这里保存最佳模型的代码是:self.best_model_state = {k: v.cpu().clone() for k, v in self.model.state_dict().items()}、在此之前我保存最佳模型的代码都是:torch.save(model.state_dict(), model_save_path)、

这两种写法有啥不一样的地方?self.best_model_state = {k: v.cpu().clone() for k, v in self.model.state_dict().items()}这行代码里的k, v到底是什么?

请见附录16!!!

(5)evaluate方法

def evaluate(self, test_loader: DataLoader) -> Dict[str, float]:

"""评估模型(计算完整指标)"""

self.model.eval()-

将模型设置为评估模式(关闭 Dropout 等)。

-

返回类型为字典,键为指标名,值为浮点数。

all_preds = [] all_proba = [] all_labels = []

初始化三个空列表,分别用于存储所有样本的预测类别、预测概率和真实标签。

with torch.no_grad():

for X_batch, y_batch in test_loader:

X_batch = X_batch.to(self.device)

y_batch = y_batch.to(self.device)-

使用

torch.no_grad()禁用梯度计算,减少内存消耗并加速推理。 -

遍历测试集 DataLoader,每次获取一个 batch 的特征

X_batch和标签y_batch,并将其移动到指定设备(CPU 或 GPU)。outputs = self.model(X_batch) proba = torch.softmax(outputs, dim=1).cpu().numpy() pred = np.argmax(proba, axis=1) -

前向传播,得到 logits(形状

(batch_size, num_classes))。 -

对 logits 应用 Softmax 函数,将其转换为概率分布(形状同上),并转换为 NumPy 数组,同时将数据移至 CPU。

-

取每个样本概率最大的类别作为预测结果(对于二分类,若概率大于 0.5 则预测为 1,否则为 0)。

all_preds.append(pred) all_proba.append(proba) all_labels.append(y_batch.cpu().numpy()) -

将当前 batch 的预测类别、概率和真实标签(转为 NumPy 并移至 CPU)分别添加到列表中。

y_true = np.concatenate(all_labels) y_pred = np.concatenate(all_preds) y_proba = np.concatenate(all_proba) -

将所有 batch 的结果沿轴 0 拼接,得到整个测试集上的完整真实标签、预测类别和预测概率。

metrics = { 'accuracy': float(accuracy_score(y_true, y_pred)), 'precision': float(precision_score(y_true, y_pred, zero_division=0)), 'recall': float(recall_score(y_true, y_pred, zero_division=0)), 'f1': float(f1_score(y_true, y_pred, zero_division=0)), 'auc': float(roc_auc_score(y_true, y_proba[:, 1])) } return metrics -

使用 sklearn 的评估函数计算准确率、精确率、召回率、F1 分数和 AUC(对于二分类,取正类的概率列

y_proba[:, 1])。 -

zero_division=0避免在分母为零(如没有预测为正类的样本)时产生警告或错误。 -

将所有指标转换为 Python 浮点数并返回。

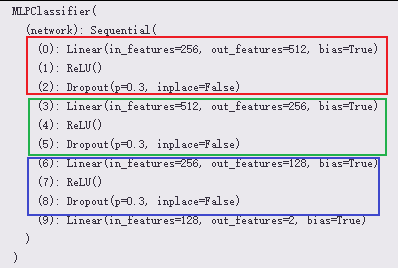

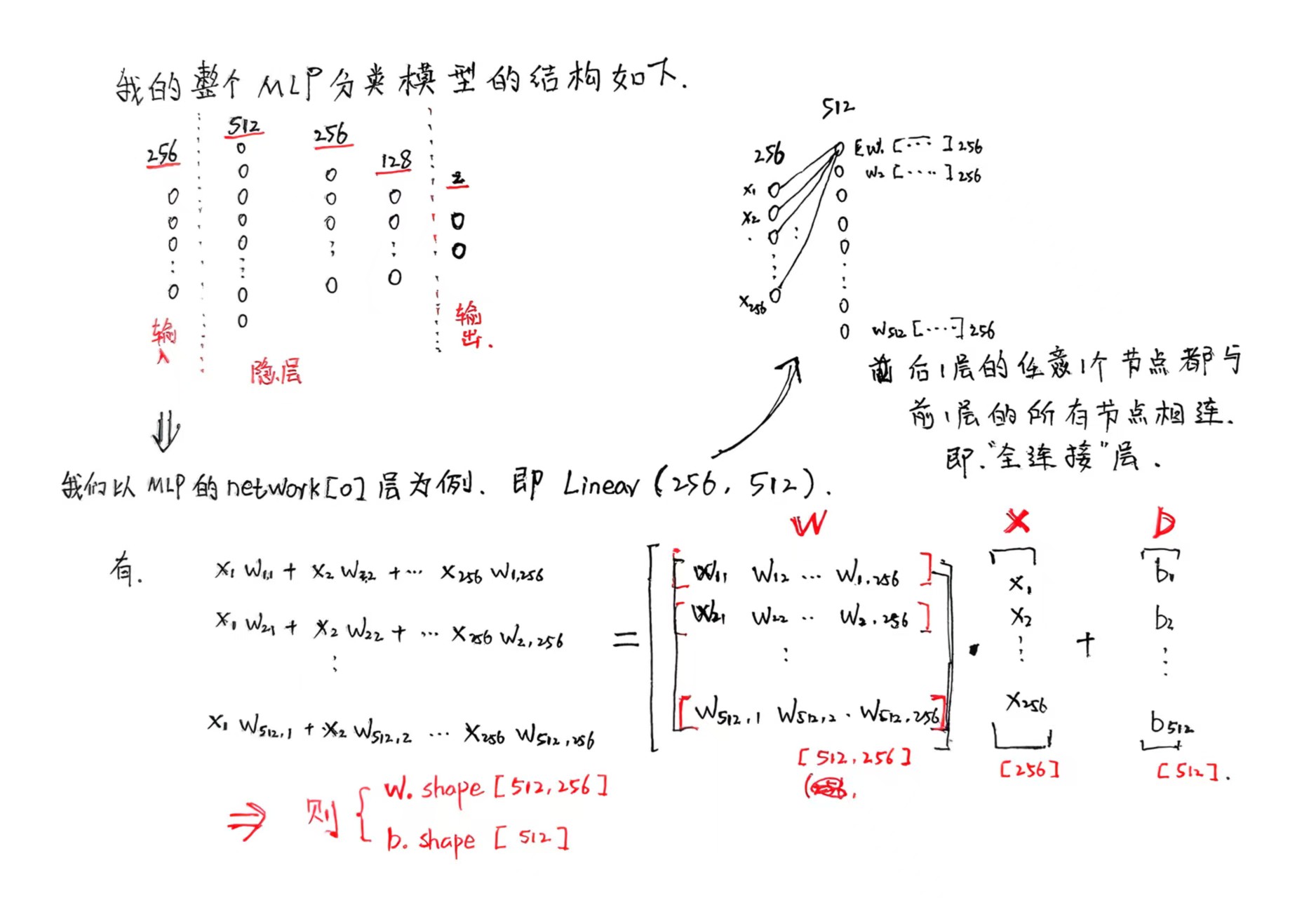

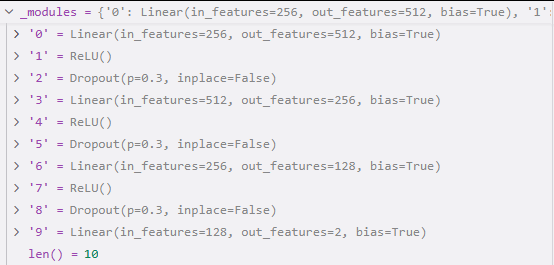

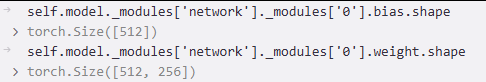

1.MLPClassifier 类

此时的训练器结构如下:

经过我查看发现确定跟我推理的一致,如下:

节点特征X变化过程:(batch_size=16)

x shape: (batch_size, input_dim) = **(16,256)#**原始输入

↓

MLPClassifier(

(network): Sequential(

(0): Linear(in_features=256, out_features=512, bias=True)

(1): ReLU()

(2): Dropout(p=0.3, inplace=False)

(3): Linear(in_features=512, out_features=256, bias=True)

(4): ReLU()

(5): Dropout(p=0.3, inplace=False)

(6): Linear(in_features=256, out_features=128, bias=True)

(7): ReLU()

(8): Dropout(p=0.3, inplace=False)

(9): Linear(in_features=128, out_features=2, bias=True)

)) # 3层的一个MLP分类模型

↓

outputs = (16,2) → loss = self.criterion(outputs, y_batch) # 求批次平均损失(每一轮进行一次训练+验证,进行epochs轮)

↓ 评估(只进行一轮)

torch.softmax(outputs, dim=1).cpu().numpy()

↓

proba = (16,2)# 转换为概率分布

↓

np.argmax(proba, axis=1)

↓

pred = (16,) # 获取概率最大的索引

(1)类定义与初始化

class MLPClassifier(nn.Module):

"""多层感知机分类器"""

def __init__(self, input_dim: int = 256, hidden_dims: List[int] = None, dropout: float = 0.3):

super().__init__()-

继承

nn.Module:这是 PyTorch 中所有神经网络模块的基类,提供参数管理、训练/评估模式切换等功能。 -

构造函数参数:

-

input_dim:输入特征维度,默认 256。 -

hidden_dims:隐藏层维度列表,若为None则使用默认[512, 256, 128]。 -

dropout:Dropout 概率,默认 0.3,表示随机丢弃 30% 的神经元输出。if hidden_dims is None: hidden_dims = [512, 256, 128]

-

若未提供隐藏层结构,则使用默认的三层结构:512 → 256 → 128 神经元。

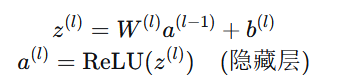

layers = []

prev_dim = input_dim

for hidden_dim in hidden_dims:

layers.append(nn.Linear(prev_dim, hidden_dim))

layers.append(nn.ReLU())

layers.append(nn.Dropout(dropout))

prev_dim = hidden_dim-

循环构建隐藏层:

-

nn.Linear(prev_dim, hidden_dim):全连接层,将输入从prev_dim维映射到hidden_dim维。 -

nn.ReLU():激活函数 ReLU(max(0, x)),引入非线性,使网络能学习复杂模式。 -

nn.Dropout(dropout):Dropout 层,在训练时以概率dropout随机将神经元输出置零,防止过拟合。测试时自动不生效。

-

-

每层之后更新

prev_dim为当前层输出维度,作为下一层的输入维度。layers.append(nn.Linear(prev_dim, 2)) # 二分类 -

最后添加输出层:

Linear(prev_dim, 2),输出 2 个 logit(分别对应类别 0 和 1),因为没有激活函数,后续损失函数会结合 Softmax 使用。self.network = nn.Sequential(*layers) -

将所有层封装进

nn.Sequential容器,简化前向传播。

(2)forward 方法

def forward(self, x: torch.Tensor) -> torch.Tensor:

"""前向传播"""

return self.network(x)- 直接调用

self.network(x),即按顺序执行所有层,输出未归一化的 logits。

相关机器学习知识点

1. 多层感知机(MLP)

也称为全连接神经网络,由输入层、若干隐藏层和输出层组成。

每个隐藏层通过权重矩阵和偏置将输入线性变换,再经过非线性激活函数,使得网络能够逼近任意非线性函数(通用近似定理)。

2. 激活函数:ReLU

公式:

ReLU(x) = max(0, x)。优点:计算简单,缓解梯度消失,使部分神经元输出稀疏,有利于训练。

缺点:可能导致神经元"死亡"(输出恒为 0),可通过合理初始化或 Leaky ReLU 缓解。

3. Dropout

训练时以概率

p随机丢弃神经元(置零),相当于每次训练不同的子网络,增强泛化能力。测试时,所有神经元参与计算,但输出需乘以

(1-p)(PyTorch 自动处理,无需手动调整)。4. 输出层与损失函数

二分类输出通常用 2 个神经元,配合

CrossEntropyLoss,该损失函数内部会自动应用 Softmax 将 logits 转换为概率,并计算交叉熵。也可以输出单个神经元,用

BCEWithLogitsLoss,但代码中输出 2 个神经元更通用。5. 神经网络训练流程

前向传播:

output = model(x)计算损失:

loss = criterion(output, y)反向传播:

loss.backward()更新参数:

optimizer.step()清零梯度:

optimizer.zero_grad()

学到这里,我重新总结一下什么是多层感知机MLP,请见附录17!!

2.BiLSTMClassifier类

BiLSTMClassifier模型结构:

BiLSTMClassifier(

(lstm): LSTM(8, 128, num_layers=2, batch_first=True, dropout=0.3, bidirectional=True) # lstm层(单层+双向)(attention): MultiheadAttention(

(out_proj): NonDynamicallyQuantizableLinear(in_features=256, out_features=256, bias=True)

) # 多头注意力层

(fc): Sequential(

(0): Linear(in_features=256, out_features=128, bias=True)

(1): ReLU()

(2): Dropout(p=0.3, inplace=False)

(3): Linear(in_features=128, out_features=2, bias=True)

) # 分类头(全连接层)

)

节点特征X在前向传播中的变化过程:x shape: (batch_size, input_dim) = **(16,256)#**原始输入

↓

x.view(batch_size, self.seq_len, self.feature_per_step) # 重塑形状了

将 256 维特征均匀分成 32 个时间步,每个时间步有 8 个特征,构成一个"伪序列"。

↓

x_reshape = = (16,32,8)

↓ 输入

LSTM(8, 128, num_layers=2, batch_first=True, dropout=0.3, bidirectional=True) # 1层lstm双向

↓

lstm_out :(batch_size, seq_len, hidden_dim*2) = (16,32,256)

每个时间步的隐藏状态是前向和后向 LSTM 隐藏状态的拼接,因此维度翻倍为 256。

↓

MultiheadAttention(

(out_proj): NonDynamicallyQuantizableLinear(in_features=256, out_features=256, bias=True)

) # 注意力机制层

作用:让每个时间步根据所有时间步的信息重新加权,增强上下文表示。

↓

attn_out = (16,32,256)

↓

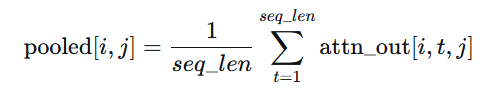

attn_out.mean(dim=1) # 全局平均池化层

对序列维度

dim=1取平均,将序列压缩为一个向量。↓

pooled:(batch_size, hidden_dim*2) = (16,256)

↓

Sequential(

(0): Linear(in_features=256, out_features=128, bias=True)

(1): ReLU()

(2): Dropout(p=0.3, inplace=False)

(3): Linear(in_features=128, out_features=2, bias=True)

) # 全连接层(二分类)

最终输出是 logits(未归一化),形状

(16, 2)。

↓output = (16,2)

↓

后面再做模型训练+验证、还是评估,处理国臣就都一样了,请见1.MLPClassifer类

(1)类定义与初始化

class BiLSTMClassifier(nn.Module):

"""BiLSTM分类器 - 用于序列特征处理

注意:BiLSTM需要将256维特征reshape为序列形式,这可能破坏特征的原始含义。

对于融合特征,建议优先使用MLP或Transformer。

"""-

定义一个名为

BiLSTMClassifier的类,继承自nn.Module。 -

注释明确指出:BiLSTM 要求将输入特征重构成序列,这可能会破坏原始特征的结构化信息,因此对于融合特征(可能是无序的),MLP 或 Transformer 更合适。

def __init__(self, input_dim: int = 256, hidden_dim: int = 128, num_layers: int = 2, dropout: float = 0.3, seq_len: int = 32): super().__init__() -

构造函数接收参数:

-

input_dim:输入特征维度,默认 256。 -

hidden_dim:LSTM 隐藏层维度,默认 128。 -

num_layers:LSTM 层数,默认 2。 -

dropout:Dropout 概率,默认 0.3。 -

seq_len:序列长度,即将input_dim划分成多少个时间步,默认 32。# 将256维特征reshape为序列形式 # 将256维分成seq_len个时间步,每步feature_per_step维 self.seq_len = seq_len self.feature_per_step = input_dim // self.seq_len if input_dim % self.seq_len != 0: raise ValueError(f"input_dim ({input_dim}) 必须能被 seq_len ({self.seq_len}) 整除")

-

-

计算每个时间步的特征维度:

feature_per_step = input_dim / seq_len(整数除法)。 -

检查输入维度是否能被

seq_len整除,如果不能则抛出异常,因为无法均匀分割。self.lstm = nn.LSTM( input_size=self.feature_per_step, hidden_size=hidden_dim, num_layers=num_layers, bidirectional=True, dropout=dropout if num_layers > 1 else 0, batch_first=True ) -

定义双向 LSTM 层:

-

input_size:每个时间步的输入特征数 =feature_per_step。 -

hidden_size:隐藏状态维度 =hidden_dim。 -

num_layers:LSTM 层数。 -

bidirectional=True:双向 LSTM,输出维度变为hidden_size * 2。 -

dropout:除最后一层外,层间 dropout。如果num_layers为 1,则 dropout 设为 0(无意义)。 -

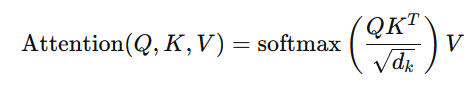

batch_first=True:输入和输出的形状为(batch, seq_len, features)。self.attention = nn.MultiheadAttention( embed_dim=hidden_dim * 2, num_heads=4, dropout=dropout, batch_first=True )

-

-

定义多头自注意力层:

-

embed_dim:输入特征的维度,即 LSTM 输出的维度(双向 LSTM 输出为hidden_dim * 2)。 -

num_heads=4:4 个注意力头,embed_dim必须能被num_heads整除。 -

dropout:注意力权重的 dropout。 -

batch_first=True:输入形状为(batch, seq_len, embed_dim)。self.fc = nn.Sequential( nn.Linear(hidden_dim * 2, 128), nn.ReLU(), nn.Dropout(dropout), nn.Linear(128, 2) # 二分类 )

-

-

定义全连接分类器:

-

第一层线性层:将注意力输出的聚合特征(维度

hidden_dim * 2)映射到 128。 -

ReLU 激活。

-

Dropout(概率

dropout)。 -

输出层:线性映射到 2 个神经元(二分类的 logits)。

-

(2)forward 方法

def forward(self, x: torch.Tensor) -> torch.Tensor:

"""前向传播"""

# x shape: (batch_size, input_dim)

batch_size = x.size(0)

# Reshape为序列形式

x = x.view(batch_size, self.seq_len, self.feature_per_step)-

获取 batch 大小。

-

将输入从

(batch, input_dim)重塑为(batch, seq_len, feature_per_step),模拟一个序列。# LSTM lstm_out, _ = self.lstm(x) # (batch_size, seq_len, hidden_dim*2) -

将重塑后的序列输入 LSTM,得到输出

lstm_out(形状(batch, seq_len, hidden_dim*2)),忽略隐藏状态和细胞状态。# 注意力机制 attn_out, _ = self.attention(lstm_out, lstm_out, lstm_out) -

使用自注意力:查询、键、值都来自 LSTM 输出

lstm_out。输出attn_out形状与输入相同(batch, seq_len, hidden_dim*2)。# 全局平均池化 pooled = attn_out.mean(dim=1) # (batch_size, hidden_dim*2) -

对序列长度维度(dim=1)进行平均池化,将每个样本的序列信息压缩为一个向量。

-

.mean(dim=1):是 PyTorch 张量的mean方法,用于计算平均值。参数dim=1指定沿着第 1 个维度(索引从 0 开始)进行平均。

池化层的作用请见附录19!!!

# 分类

output = self.fc(pooled)

return output- 将池化后的向量通过全连接分类器,得到 logits(形状

(batch, 2))。

相关机器学习知识点

1. 为什么将一维特征视为序列?

BiLSTM 本用于处理序列数据(如文本、时间序列),但此处将 256 维融合特征强行分成 32 个时间步,每步 8 维。这是一种特征重组的尝试,意图让模型捕捉特征间的"局部依赖"。然而,融合特征通常是无序的,这种重组可能破坏特征的原始语义,因此注释中已提示"可能破坏特征的原始含义"。

2. 双向 LSTM

LSTM 是循环神经网络的一种,能捕捉序列中的长期依赖。

双向 LSTM 包含前向和后向两个方向,能利用每个时间步的上下文信息,输出维度为

hidden_size * 2。对于序列任务(如文本),双向 LSTM 效果往往优于单向。

3. 多头自注意力(Multi-head Self-Attention)

注意力机制可以动态地为序列中不同位置赋予不同权重,捕捉全局依赖。

多头注意力让模型从多个子空间学习不同的关系。

在此处,自注意力应用于 LSTM 的输出,相当于让模型关注序列中重要的时间步。

4. 池化(Pooling)

- 全局平均池化将序列压缩为一个固定长度的向量,保留每个时间步的信息平均值。也可用最大池化或加权和。

5. 分类头

- 全连接层将压缩后的特征映射到 2 个 logits,供交叉熵损失使用。

潜在 Bug 与优化建议

input_dim必须能被seq_len整除

- 代码已做检查,这是正确的。但如果用户传入的

seq_len不是input_dim的因数,程序会报错,需要用户自行调整。LSTM 的 dropout 参数

- 当

num_layers > 1时,dropout才有效。代码中已处理:dropout=dropout if num_layers > 1 else 0,正确。注意力层的维度必须能被

num_heads整除

- 默认

hidden_dim=128,则embed_dim=256,num_heads=4,256 能被 4 整除,没问题。但若用户更改hidden_dim导致embed_dim不能被 4 整除,MultiheadAttention会报错。建议在初始化时检查并提示。池化方式单一 (可选优化项)

- 平均池化简单,但可能丢失重要信息。有时最大池化或注意力池化更佳。

前向传播中没有显式设置

attn_mask和key_padding_mask

- 当序列长度固定时,一般不需要,但如果有填充,需要掩码。

返回的输出是 logits,未经过 softmax

- 这是正确的,因为交叉熵损失内部会应用 softmax。但使用

predict方法时,需要自行 softmax 转换概率(你的DeepLearningTrainer.predict已做)。未考虑序列方向与特征顺序

- 将 256 维特征按序分成 32 段,每一段的 8 个特征被当作同一时间步的多维输入。这种分法假设特征在原始向量中的相邻位置具有局部相关性,但融合特征可能不具备这种性质,因此可能效果不佳。

BiLSTMClassifier训练完之后,模型会把学到的知识存哪几个变量里,有哪些重要的模型属性和方法需要我们知道?

这个

BiLSTMClassifier结合了双向长短期记忆网络(BiLSTM)和多头注意力机制(MultiheadAttention),是一个处理时序或序列关联特征的经典架构。在模型训练完成后,它学到的"知识"(可学习的参数)分布在三个核心的网络层组件中。

一、 知识具体存在了哪里?

你可以通过

model.state_dict()查看到所有的参数,它们主要被归类在这三个部分:1.

self.lstm(双向 LSTM 权重)

存储了什么: LSTM 内部包含了复杂的门控机制(输入门、遗忘门、输出门和细胞状态)。这里存储了用于计算这些门的权重矩阵(

weight_ih和weight_hh)和偏置(bias_ih和bias_hh)。知识的意义: 因为你设置了

bidirectional=True,模型不仅保存了从左到右读取序列的参数,还保存了一套从右到左读取序列的独立参数(带有_reverse后缀)。这部分参数学到了**"如何结合过去和未来的特征来理解当前时间步的信息"**。2.

self.attention(多头注意力矩阵)

存储了什么: 主要是 Query (Q)、Key (K)、Value (V) 的输入投影矩阵(

in_proj_weight和in_proj_bias),以及多头合并后的输出投影矩阵(out_proj.weight和out_proj.bias)。知识的意义: LSTM 虽然能捕捉时序,但对长序列容易遗忘。注意力机制的参数学到了**"在做最终分类决定时,序列中的哪几个时间步最重要,应该被赋予更高的权重"**。

3.

self.fc(分类头)

存储了什么:

nn.Sequential内部两个nn.Linear层的权重(weight)和偏置(bias)。知识的意义: 它学会了如何将经过 LSTM 提取、Attention 加权、并经过全局池化(

mean)后的高维浓缩特征,降维并映射到最终的两个类别上。

二、 必须掌握的核心属性与方法

针对这个特定的结构,在日常使用和部署时,有以下几个关键点需要特别注意:

1. 极其重要的状态切换(防雷点)

model.eval()与 Dropout:在你的代码中,

nn.LSTM(如果num_layers > 1)、nn.MultiheadAttention以及self.fc都使用了dropout。在模型训练完进入测试、验证或部署推理阶段时,必须 调用model.eval()。如果不调用,Dropout 会继续在推理时随机丢弃神经元,导致你对同一条数据的多次预测结果不一样。2. 形状相关的实例属性

你在

__init__中定义的这两个属性,决定了数据在网络中流动的命脉:

self.seq_len

self.feature_per_step用途: 你的

forward方法高度依赖这两个属性来进行x.view(...)。在处理外部数据时,随时打印这两个属性,可以帮助你排查张量形状重塑(Reshape)时可能出现的维度不匹配报错。3. 隐含的状态管理 (隐藏状态 Hidden States)

关于

lstm_out, _ = self.lstm(x):那个被你用

_忽略掉的返回值,包含了 LSTM 最后一个时间步的隐藏状态(Hidden State)和细胞状态(Cell State)。

- 注意: 你的模型设计为每次前向传播都将序列作为一个完整的独立事件处理(这是大多数分类任务的默认做法)。但如果是需要持续处理连续数据流(比如实时语音识别),你可能需要将上一次的

_保存下来,作为下一次self.lstm(x, previous_states)的初始输入。4. 提取注意力权重进行可解释性分析

对于带有

MultiheadAttention的分类器,业务方经常会问:"模型为什么判断它是正类?"

self.attention的返回值: 在你的代码attn_out, _ = self.attention(...)中,第二个返回值其实是注意力权重矩阵(Attention Weights) 。如果在推理时你需要解释模型,可以将代码修改为attn_out, attn_weights = self.attention(...)并将其返回,从而可以画出热力图,看看模型在分类时究竟"盯"着序列的哪一部分。

想要真正搞懂LSTM的模型参数+输入输出请见本人另一篇文章:《LSTM核心参数与输入输出解读》

有关多头自注意力的了解请见附录18!!!

3.TransformerClassifier类

模型结构如下:

TransformerClassifier(

(embedding): Linear(in_features=8, out_features=128, bias=True) # 嵌入层(transformer): TransformerEncoder(

(layers): ModuleList(

(0-1): 2 x TransformerEncoderLayer(

(self_attn): MultiheadAttention(

(out_proj): NonDynamicallyQuantizableLinear(in_features=128, out_features=128, bias=True)

)

(linear1): Linear(in_features=128, out_features=512, bias=True)

(dropout): Dropout(p=0.3, inplace=False)

(linear2): Linear(in_features=512, out_features=128, bias=True)

(norm1): LayerNorm((128,), eps=1e-05, elementwise_affine=True)

(norm2): LayerNorm((128,), eps=1e-05, elementwise_affine=True)

(dropout1): Dropout(p=0.3, inplace=False)

(dropout2): Dropout(p=0.3, inplace=False)

)

)

) # Transformer层

(fc): Sequential(

(0): Linear(in_features=128, out_features=64, bias=True)

(1): ReLU()

(2): Dropout(p=0.3, inplace=False)

(3): Linear(in_features=64, out_features=2, bias=True)

) # 分类头

)

节点特征X在前向传播中的变化过程:x shape = (batch_size, input_dim) = **(16,256)#**原始输入

↓

x.view(batch_size, self.seq_len, self.feature_per_step) # 重塑形状了

将 256 维特征均匀分成 32 个时间步,每个时间步有 8 个特征,构成一个"伪序列"。

↓

x_reshape = (16,32,8)

↓

nn.Linear(self.feature_per_step, d_model) # 将8维映射到d_model维

↓

x_enbedding = (batch_size, seq_len, d_model) =(16,32,128)

↓

self.pos_encoding = nn.Parameter(torch.randn(1, seq_len, d_model)) # 可学习的位置编码

x = x + self.pos_encoding # 广播机制自动处理batch维度

↓

x_input = (16,32,128)

↓ 输入

nn.TransformerEncoder(encoder_layer, num_layers=num_layers) # Transformer编码器(这里是2层堆叠)

↓

x_out = (batch_size, seq_len, d_model) = (16,32,128)

↓

x.mean(dim=1) # 全局平均池化

↓

x_out_mean = (batch_size, d_model) = (16,128)

↓

Sequential(

(0): Linear(in_features=128, out_features=64, bias=True)

(1): ReLU()

(2): Dropout(p=0.3, inplace=False)

(3): Linear(in_features=64, out_features=2, bias=True)

) # 二分类头(全连接)

↓

output = (16,2)

↓

后面再做模型训练+验证、还是评估,处理国臣就都一样了,请见1.MLPClassifer类

有关Transformer 编码器的学习请见附录21 !

(1)类定义与初始化

class TransformerClassifier(nn.Module):

"""Transformer分类器"""-

定义一个名为

TransformerClassifier的类,继承自nn.Module,用于序列分类。def __init__(self, input_dim: int = 256, d_model: int = 128, nhead: int = 4, num_layers: int = 2, dropout: float = 0.3): super().__init__() -

构造函数接收参数:

-

input_dim:输入特征维度(默认 256)。 -

d_model:Transformer 内部使用的特征维度(默认 128)。 -

nhead:多头注意力的头数(默认 4)。 -

num_layers:Transformer 编码器层数(默认 2)。 -

dropout:Dropout 概率(默认 0.3)。self.seq_len = 32 self.feature_per_step = input_dim // self.seq_len

-

-

固定序列长度

seq_len = 32,将输入特征均匀分割成 32 个时间步。 -

feature_per_step为每个时间步的特征数 =input_dim // seq_len。如果input_dim不能被 32 整除,则这里会丢失余数(整数除法向下取整),造成信息丢失。这是一个潜在 bug。# 线性投影到d_model维 self.embedding = nn.Linear(self.feature_per_step, d_model) -

一个线性层,将每个时间步的特征(

feature_per_step维)映射到d_model维。这是 Transformer 输入前的投影,通常称为嵌入层。# Transformer编码器 encoder_layer = nn.TransformerEncoderLayer( d_model=d_model, nhead=nhead, dim_feedforward=d_model * 4, dropout=dropout, batch_first=True ) self.transformer = nn.TransformerEncoder(encoder_layer, num_layers=num_layers) -

创建单层 Transformer 编码器层:

-

d_model:输入/输出维度。 -

nhead:注意力头数,d_model必须能被nhead整除。 -

dim_feedforward:前馈网络维度,通常为d_model * 4。 -

dropout:层内 dropout。 -

batch_first=True:输入形状为(batch, seq, features)。

-

-

用

nn.TransformerEncoder堆叠num_layers个编码器层。# 分类头 self.fc = nn.Sequential( nn.Linear(d_model, 128), nn.ReLU(), nn.Dropout(dropout), nn.Linear(128, 2) # 二分类 ) -

分类头:先线性映射到 128 维,ReLU 激活,Dropout,最后输出 2 个 logits(二分类)。

(2)forward 方法

def forward(self, x: torch.Tensor) -> torch.Tensor:

"""前向传播"""

batch_size = x.size(0)

# Reshape为序列形式

x = x.view(batch_size, self.seq_len, self.feature_per_step)-

获取 batch 大小。

-

将输入

x(形状(batch, input_dim))重塑为(batch, seq_len, feature_per_step)。 -

分割成序列是为了利用 Transformer 捕捉特征内部的结构化依赖,但前提是特征本身具有序列结构。对于无结构融合特征,MLP 往往更合适。

# 嵌入 x = self.embedding(x) # (batch_size, seq_len, d_model) -

对每个时间步的特征进行线性变换,映射到

d_model维。# Transformer x = self.transformer(x) # (batch_size, seq_len, d_model) -

通过 Transformer 编码器堆栈,输出形状不变

(batch, seq_len, d_model)。# 全局平均池化 x = x.mean(dim=1) # (batch_size, d_model) -

对序列维度求平均,得到每个样本的全局向量

(batch, d_model)。# 分类 output = self.fc(x) return output -

通过分类头得到 logits,形状

(batch, 2)。

相关机器学习知识点

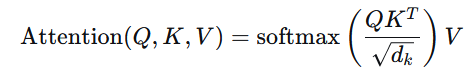

1. Transformer 编码器结构

Transformer 由 Vaswani 等人在 2017 年提出,核心是自注意力机制。一个 Transformer 编码器层包含:

多头自注意力:让每个位置关注序列中所有位置。

前馈网络:两个线性层 + 激活函数(通常 ReLU)。

残差连接 + 层归一化:稳定训练。

2. 为什么需要位置编码?

Transformer 本身是置换不变 的,即不关心输入顺序。对于序列数据,必须加入位置编码 来注入位置信息。PyTorch 的

TransformerEncoderLayer默认不会自动添加位置编码 ,需要用户自己加。本代码中没有添加位置编码,这是一个严重缺陷。3. 序列分类常见做法

取最后一时间步的输出(常与 CLS token 结合)。

全局平均/最大池化(如本例)。

引入可学习的分类 token(如 BERT 的

[CLS])。4. 维度分割的合理性

将 256 维特征均匀分成 32 个时间步,每个时间步 8 维。这种做法隐含假设:相邻的 8 维特征在语义上相关,形成"时间步"。但对于融合特征(可能是无序的),这种假设不一定成立,可能破坏特征结构。但代码注释中已提醒"对于融合特征,建议优先使用 MLP 或 Transformer",所以此处是为了演示 Transformer 在序列任务中的应用。

潜在 Bug 与优化建议

未添加位置编码

Transformer 需要位置信息,否则无法区分序列顺序。由于特征被分割成序列,顺序可能有意义(例如按特征顺序)。缺失位置编码会严重限制模型性能。

修复 :在

embedding之后添加可学习的位置编码或正弦位置编码。输入维度不能被 seq_len 整除时数据丢失

feature_per_step = input_dim // self.seq_len是整数除法。如果input_dim % self.seq_len != 0,余数被丢弃,造成信息丢失。建议 :添加校验,若不能整除则抛出异常或调整

seq_len。固定 seq_len=32

- 限制了灵活性。更好的做法是将

seq_len作为构造参数,并自动计算feature_per_step,若不能整除则报错或调整。未处理分类头中的

d_model与nhead的整除性

- 若

d_model % nhead != 0,nn.TransformerEncoderLayer会报错。可以在初始化时检查并提示。分类头中线性层维度硬编码为 128

- 可以根据

d_model动态设置,如d_model // 2或可配置。缺乏适当的初始化

- 默认线性层使用 Kaiming 初始化,但对 Transformer 来说,常见的是 Xavier 初始化。但影响不大。

未设置

src_key_padding_mask

- 如果输入序列长度相同(固定),无需掩码。但若未来支持变长,需要处理。

分类头最后的线性层直接输出 2 个 logits

- 正确,因为交叉熵损失期望原始 logits。

从TransformerClassifier分类器模型的构建来看,Transformer也跟LSTM类似它们的input_x都是需要基于时间步的,所以都会先把原始输入batch_X(16,256)重塑成x_reshape(16,32,8)。接着再经过一个nn.Linear()线性映射到(16,32,128),然后再输入到Transformer编码器。

我的3个疑问如下:

1.为什么在输入nn.TransformerEncoderLayer()之前需要添加线性投影到d_model维,如果不加投影直接把d_model参数改成8不就行了?

2.Transformer 本身是置换不变的,即不关心输入顺序,对于序列数据,必须加入位置编码来注入位置信息。但是我目前的代码并未添加位置编码啊,为什么要添加位置编码,如何添加?在我的目前代码的基础上应该如何修改?

3.既然Transformer 本身是置换不变的,即不关心输入顺序。为什么不直接将我的原始特征数据batch_X(16,256)直接输入nn.TransformerEncoderLayer()呢?还先维度分割为3D的序列特征干嘛呢?反正我的原始数据本来就是2D的融合特征(无序的),并不是3D的序列数据啊。

解答请见附录20!!!

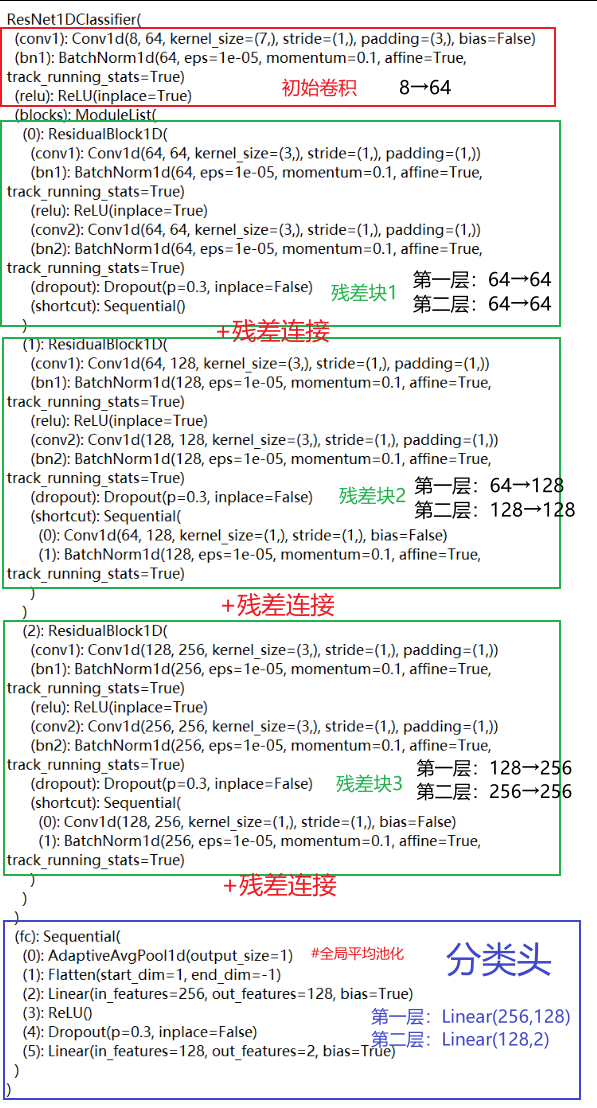

4.ResNet1DClassifier类

# 第一个残差块的内部结构:

# 第二个残差块的内部结构:

ResidualBlock1D(

(conv1): Conv1d(64, 128, kernel_size=(3,), stride=(1,), padding=(1,))

(bn1): BatchNorm1d(128, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(relu): ReLU(inplace=True)

(conv2): Conv1d(128, 128, kernel_size=(3,), stride=(1,), padding=(1,))

(bn2): BatchNorm1d(128, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(dropout): Dropout(p=0.3, inplace=False)

(shortcut): Sequential(

(0): Conv1d(64, 128, kernel_size=(1,), stride=(1,), bias=False)

(1): BatchNorm1d(128, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

)

)

# 第三个残差块的内部结构:

ResidualBlock1D(

(conv1): Conv1d(128, 256, kernel_size=(3,), stride=(1,), padding=(1,))

(bn1): BatchNorm1d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(relu): ReLU(inplace=True)

(conv2): Conv1d(256, 256, kernel_size=(3,), stride=(1,), padding=(1,))

(bn2): BatchNorm1d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(dropout): Dropout(p=0.3, inplace=False)

(shortcut): Sequential(

(0): Conv1d(128, 256, kernel_size=(1,), stride=(1,), bias=False)

(1): BatchNorm1d(256, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

)

)

节点特征X在前向传播中的变化过程:x shape = (batch_size, input_dim) = **(16,256)#**原始输入

↓

x.view(batch_size, seq_len, feature_per_step) # 重塑形状了

将 256 维特征均匀分成 32 个时间步,每个时间步有 8 个特征,构成一个"伪序列"。

↓

x_reshape = (16,32,8)

↓

x.transpose(1, 2) # 转置操作

↓ 因为

Conv1d期望输入形状为(batch, channels, length)x_tra = (batch_size, feature_per_step, seq_len) = (16,8,32)

↓ 初始卷积(使用更大的kernel提取初始特征)

self.conv1 = nn.Conv1d(self.feature_per_step, 64, kernel_size=7, stride=1, padding=3, bias=False) # 经过第一个卷积(批归一化+激活)

self.bn1 = nn.BatchNorm1d(64)

self.relu = nn.ReLU(inplace=True)

↓

x = (16,64,32)

↓ 进入残差块1(每个块内部都有 skip connection)

ResidualBlock1D(

out = conv1(x) # 第一层卷积(64, 64)

out = bn1(out) # 批归一化

out = relu(out) # 激活

if dropout: out = dropout(out) # Dropout

out = conv2(out) # 第二层卷积(64, 64)

out = bn2(out) # 批归一化

out = out + shortcut(identity) # 残差连接

out = relu(out)# 激活

)

↓

x = (16,64,32)

↓ 进入残差块2

ResidualBlock1D(

out = conv1(x) # 第一层卷积(64, 128)

out = bn1(out) # 批归一化

out = relu(out) # 激活

if dropout: out = dropout(out) # Dropout

out = conv2(out) # 第二层卷积(128, 128)

out = bn2(out) # 批归一化

out = out + shortcut(identity) # 残差连接

out = relu(out)# 激活

)

↓

x = (16,128,32)

↓ 进入残差块3

ResidualBlock1D(

out = conv1(x) # 第一层卷积(128, 256)

out = bn1(out) # 批归一化

out = relu(out) # 激活

if dropout: out = dropout(out) # Dropout

out = conv2(out) # 第二层卷积(256, 256)

out = bn2(out) # 批归一化

out = out + shortcut(identity) # 残差连接

out = relu(out)# 激活

)

↓

x = (16,256,32)

↓ 加个分类头(全连接)

Sequential(

(0): AdaptiveAvgPool1d(output_size=1) # 全局平均池化 (16,256,32)变为(16,256,1)

(1): Flatten(start_dim=1, end_dim=-1) # 拍平为(16,256)

(2): Linear(in_features=256, out_features=128, bias=True) # 映射为(16,128)

(3): ReLU() # 激活

(4): Dropout(p=0.3, inplace=False) # Dropout

(5): Linear(in_features=128, out_features=2, bias=True) # 映射为(16,2)

)

↓

output = (16,2)

这里我有一个疑问,init()中每一个残差块的结构定义与forword()中网络的执行过程不一致,为什么forword过程要按照这个顺序进行呢?请你解释原因?请见附录23!!!

(1)类定义与初始化

class ResNet1DClassifier(nn.Module):

"""ResNet-1D分类器

改进:

1. seq_len 可配置

2. 输入维度校验

3. 残差块数量可配置

"""-

定义一个名为

ResNet1DClassifier的类,继承自nn.Module。这是一个用于处理一维序列(如时间序列、特征序列)的残差网络。def __init__(self, input_dim: int = 256, num_blocks: int = 3, dropout: float = 0.3, seq_len: int = 32): super().__init__() -

构造函数参数:

-

input_dim:输入特征维度(默认 256)。 -

num_blocks:残差块数量(默认 3),范围限制在 1-5。 -

dropout:Dropout 概率(默认 0.3)。 -

seq_len:序列长度(默认 32),即将输入特征分割成多少个时间步。# 参数校验 if input_dim % seq_len != 0: raise ValueError(f"input_dim ({input_dim}) 必须能被 seq_len ({seq_len}) 整除。" f"当前余数为 {input_dim % seq_len}") if num_blocks < 1 or num_blocks > 5: raise ValueError(f"num_blocks 应在 1-5 之间,当前值为 {num_blocks}")

-

-

校验输入维度是否能被

seq_len整除,否则无法均匀分割,会导致信息丢失。 -

限制残差块数量在 1-5 之间,防止过深或过浅。

self.seq_len = seq_len self.feature_per_step = input_dim // self.seq_len -

保存序列长度和每个时间步的特征数。例如

input_dim=256,seq_len=32,则feature_per_step=8。# 初始卷积 self.conv1 = nn.Conv1d(self.feature_per_step, 64, kernel_size=3, padding=1) self.bn1 = nn.BatchNorm1d(64) -

第一个卷积层:输入通道数为

feature_per_step,输出通道数为 64,卷积核大小为 3,padding 为 1 保持长度不变。 -

批归一化(BatchNorm1d)对输出进行归一化,稳定训练。

# 动态创建残差块 block_configs = [ (64, 64, 3), (64, 128, 3), (128, 256, 3), (256, 512, 3), (512, 512, 3) ] -

预定义 5 个残差块的配置,每个元组为

(in_channels, out_channels, kernel_size)。 -

设计思路:前几个块逐步增加通道数(64→128→256→512),后两个块保持 512 维,增强特征抽象。

self.blocks = nn.ModuleList([ self._make_block(*block_configs[i]) for i in range(num_blocks) ]) -

使用

nn.ModuleList动态创建num_blocks个残差块,每个块由_make_block方法生成。# 获取最后一个块的输出通道数 final_channels = block_configs[num_blocks - 1][1] -

根据选择的残差块数量,获取最后一个块的输出通道数,用于后续分类头。

# 分类头 fc_hidden_dim = max(final_channels // 2, 64) self.fc = nn.Sequential( nn.AdaptiveAvgPool1d(1), nn.Flatten(), nn.Linear(final_channels, fc_hidden_dim), nn.ReLU(), nn.Dropout(dropout), nn.Linear(fc_hidden_dim, 2) # 二分类 ) -

分类头:

-

AdaptiveAvgPool1d(1):自适应平均池化,将长度维度压缩为 1,输出形状(batch, final_channels, 1)。 -

Flatten():展平为(batch, final_channels)。 -

线性层将

final_channels映射到fc_hidden_dim(取final_channels // 2,至少 64)。 -

ReLU、Dropout。

-

最后一层线性映射到 2 个 logits(二分类)。

def _make_block(self, in_channels: int, out_channels: int, kernel_size: int) -> nn.Module: """创建残差块""" return nn.Sequential( nn.Conv1d(in_channels, out_channels, kernel_size, padding=kernel_size//2), nn.BatchNorm1d(out_channels), nn.ReLU(), nn.Conv1d(out_channels, out_channels, kernel_size, padding=kernel_size//2), nn.BatchNorm1d(out_channels) )

-

-

定义一个残差块,包含两个卷积层(每个卷积后接 BN),中间用 ReLU 激活。

-

注意 :这个实现没有包含残差连接,只是两个卷积的堆叠,这不是标准的残差块!标准的残差块应该将输入加到输出上,这里缺失了。这是一个严重的设计缺陷。

(2)forward 方法

def forward(self, x: torch.Tensor) -> torch.Tensor:

"""前向传播"""

batch_size = x.size(0)

# Reshape为序列形式

x = x.view(batch_size, self.seq_len, self.feature_per_step)

x = x.transpose(1, 2) # (batch_size, feature_per_step, seq_len)-

将输入

(batch, input_dim)重塑为(batch, seq_len, feature_per_step),然后转置为(batch, feature_per_step, seq_len),因为Conv1d期望输入形状为(batch, channels, length)。# 初始卷积 x = self.conv1(x) x = self.bn1(x) x = torch.relu(x) -

经过第一个卷积、BN、ReLU,输出形状

(batch, 64, seq_len)。# 残差块 for block in self.blocks: x = block(x) -

依次通过每个残差块。注意每个块内部没有残差连接,只是两个卷积的串联。

# 分类 output = self.fc(x) return output -

通过分类头得到 logits,形状

(batch, 2)。

相关机器学习知识点

1. 残差网络(ResNet)的核心思想

问题:深层网络容易发生梯度消失或退化,导致训练困难。

解决方案 :引入残差连接 ,让网络学习输入与输出的差值,即

H(x) = F(x) + x。这样梯度可以直接流过恒等映射,使得网络可以堆叠更多层。标准残差块结构:

x -> conv -> bn -> relu -> conv -> bn -> add(x) -> relu。有关残差连接的知识点请见《python结构特征提取(2)》的附录5!

2. 1D 卷积

用于处理一维序列数据(如时间序列、信号、文本特征序列)。

卷积核沿长度方向滑动,提取局部特征。与 2D 卷积类似,但只在单一维度上操作。

2D卷积操作请自行学习CNN入门实战--图像识别分类任务

3. 批归一化(BatchNorm)

对每个通道在 batch 维度上进行归一化,使激活值稳定在均值为 0、方差为 1 的分布。

加速收敛,允许使用更高学习率,有一定正则化效果。

4. 自适应池化

AdaptiveAvgPool1d(1)将任意长度的序列压缩为长度为 1 的向量,输出形状(batch, channels, 1),再通过Flatten得到(batch, channels)。这样分类头与输入序列长度解耦,允许模型处理不同长度的输入(虽然这里长度固定)。

潜在 Bug 与优化建议

残差块缺少残差连接

_make_block只包含两个卷积,没有将输入加到输出上。这导致网络不是真正的 ResNet,而是普通的卷积块堆叠,无法利用残差学习的优势。修复 :在

_make_block中,需要判断输入通道和输出通道是否一致,若不匹配则需通过 1×1 卷积调整维度,然后加上输入。未处理通道数变化时的残差连接

当

in_channels != out_channels时,无法直接相加,需要用 1×1 卷积投影输入到相同维度。当前代码完全没有考虑,会导致维度不匹配。残差块中的激活位置

标准 ResNet 通常在加法之后再应用 ReLU,而不是在第二个 BN 之后直接结束。你的块中第二个 BN 后没有激活,也没有残差加法。

正确的残差块结构应该是:

def _make_block(self, in_channels, out_channels, kernel_size):

shortcut = nn.Conv1d(in_channels, out_channels, kernel_size=1) if in_channels != out_channels else nn.Identity()

return nn.Sequential(

nn.Conv1d(in_channels, out_channels, kernel_size, padding=kernel_size//2),

nn.BatchNorm1d(out_channels),

nn.ReLU(),

nn.Conv1d(out_channels, out_channels, kernel_size, padding=kernel_size//2),

nn.BatchNorm1d(out_channels),

# 残差加法

lambda x: x + shortcut(x), # 注意需要用自定义模块,这里仅为示意

nn.ReLU()

)由于

nn.Sequential不支持自定义加法,通常需要写成class ResidualBlock(nn.Module)来手动实现forward。输入维度校验

目前检查了整除,但未检查

seq_len是否合理(如过大或过小)。可以添加建议值。

final_channels可能过小当

num_blocks=1时,final_channels=64,分类头fc_hidden_dim = max(64//2,64) = 64,合理。当num_blocks=5时,final_channels=512,fc_hidden_dim=256,也合理。分类头中

AdaptiveAvgPool1d(1)后紧接Flatten正确,但可简化为

nn.AdaptiveAvgPool1d(1)后直接squeeze(-1)或view(batch_size, -1)。没有显式设置

dropout在分类头中已正确使用。

附录

1.检查python文件的语法是否正确

# 在命令行中输入这行shell

python -m py_compile xxx.py && echo "✓ 语法检查通过"2.pathlib.Path()函数语法

Path() 是 Python 标准库 pathlib 模块中的一个类,用于以面向对象的方式操作文件系统路径 。它比传统的 os.path 模块更直观、更现代。

基本用法

python

from pathlib import Path

# 创建 Path 对象

p = Path("some/path") # 相对路径

p = Path("/absolute/path") # 绝对路径

p = Path("C:/Windows") # Windows 路径(自动处理分隔符)常用方法

-

exists():判断路径是否存在(文件或目录)。 -

is_dir():判断是否为目录。 -

is_file():判断是否为文件。 -

mkdir():创建目录(可带parents=True创建父目录)。 -

glob(pattern):使用通配符匹配路径下的文件(返回生成器)。 -

name:获取路径的最后一部分(文件名或目录名)。 -

stem:获取文件名(不含后缀)。 -

suffix:获取文件后缀。 -

resolve():返回绝对路径。

运算符支持

- 用

/连接路径:Path("dir") / "subdir" / "file.txt"。

3.sklearn.preprocessing.StandardScaler()

在机器学习中,标准化(Standardization) 是一种常见的数据预处理方法,目的是将不同尺度的特征缩放到相同的范围,通常使每个特征的均值为0、标准差为1。这样做可以避免某些特征因为数值范围大而在模型中占据主导地位,同时也能加快梯度下降等优化算法的收敛速度。

为什么要在训练集上 fit,然后对验证集和测试集只进行 transform?

核心原因是防止数据泄露(Data Leakage),保证模型评估的真实性。

-

训练集 :我们通过

fit_transform计算训练集的均值和标准差,并用这些统计量将训练数据标准化。这个过程相当于让模型"学习"训练数据的分布。 -

验证集和测试集 :我们只使用训练集计算出的均值和标准差进行

transform,而不是重新计算自己的统计量。这是因为验证集和测试集模拟的是模型在生产环境中遇到的新数据------我们无法预知这些新数据的均值和标准差。如果让验证集或测试集也参与拟合,就相当于提前"偷看"了它们的信息,这样评估出的模型性能会过于乐观,无法反映模型在真实未知数据上的表现。

简单来说:训练集的统计量代表了模型从训练数据中学到的"世界规律",验证集和测试集也必须用同样的规律来转换,才能公平地检验模型。

fit_transform() 和 transform() 的区别

-

fit_transform(X):先计算X的统计量(如均值、标准差),然后用这些统计量对X进行转换,并返回转换后的数据。这是一个**"拟合+转换"** 的快捷操作,通常只用于训练集。(fit作用的是StandardScaler()对象参数,而transform作用的是数据) -

transform(X):直接使用已经拟合好的统计量对X进行转换,不重新计算。通常用于验证集、测试集以及新数据。

形象地理解:

-

fit就像制作一把尺子,这把尺子是根据训练数据的分布"量身定做"的。 -

transform就是用这把现成的尺子去测量其他数据(验证集、测试集),而不是为每个新数据集都重新做一把尺子。

示例:

python

from sklearn.preprocessing import StandardScaler

# 假设我们有训练集、验证集、测试集

scaler = StandardScaler()

# 对训练集:拟合+转换

X_train_scaled = scaler.fit_transform(X_train)

# 对验证集和测试集:仅转换(使用训练集的统计量)

X_val_scaled = scaler.transform(X_val)

X_test_scaled = scaler.transform(X_test)如果不这样做会怎样?

如果对整个数据集(包括验证集、测试集)统一进行 fit_transform,那么验证集和测试集的分布信息就提前泄露到了标准化过程中,后续模型评估结果会偏高,无法反映真实泛化能力。

4.哪些模型需要标准化?

标准化 :将特征缩放到均值为0、标准差为1。公式:

x' = (x - μ) / σ。需要标准化的模型:

线性模型(逻辑回归、线性SVM):模型输出是特征的线性组合,特征的尺度直接影响权重和梯度,标准化可加速收敛并提高模型性能。

基于距离的模型(KNN、K-Means):特征尺度决定距离计算中的权重,标准化能避免大尺度特征主导。

神经网络:输入层通常需要标准化以加速训练。

不需要标准化的模型:

树模型(决策树、随机森林、梯度提升树):分裂节点时只考虑特征值的大小关系,不关心绝对尺度,因此标准化对结果无影响。

朴素贝叶斯:基于概率,对特征分布有假设,一般不要求标准化。

在机器学习中,特征标准化(Standardization)是指将特征缩放到均值为0、标准差为1的过程。是否需要对特征进行标准化,主要取决于模型的工作原理和对特征尺度的敏感程度。下面分类说明:

✅ 需要标准化的模型

这些模型通常依赖于特征之间的尺度一致性,如果不进行标准化,可能会导致模型性能下降或训练不稳定。

1. 线性模型与广义线性模型

-

例如:线性回归、逻辑回归、线性SVM(支持向量机)、感知机。

-

原因:模型输出是特征的线性加权和,特征的尺度直接影响权重的大小。如果某个特征的数值范围很大,它将在损失函数中占据主导地位,导致模型偏向该特征,同时梯度下降收敛变慢。标准化后所有特征处于同一量级,有助于模型学习到更合理的权重。

- 基于距离的模型

-

例如:K近邻(KNN)、K-Means聚类、层次聚类。

-

原因:这些模型依赖样本间的距离(如欧氏距离)进行判断。如果特征尺度不同,数值范围大的特征会主导距离计算,而小尺度特征的信息被淹没。标准化使每个特征对距离的贡献相等。

3. 神经网络与深度学习

-

例如:多层感知机(MLP)、卷积神经网络(CNN)、循环神经网络(RNN)。

-

原因:神经网络的输入层通常需要标准化,因为激活函数(如sigmoid、tanh)在输入值过大或过小时会进入饱和区,导致梯度消失。标准化还能加速梯度下降的收敛。

- 主成分分析(PCA)

- 原因:PCA寻找最大方差方向,如果特征尺度不同,方差大的特征会被优先考虑,导致主成分被大尺度特征主导。标准化后每个特征方差相同,PCA才能真实反映数据结构。

- 正则化模型

-

例如:Lasso回归、Ridge回归、弹性网络。

-

原因:正则化项(L1/L2)惩罚权重大小,如果特征尺度不同,惩罚效果会不一致,无法公平地约束所有特征。标准化后正则化才能真正实现特征选择或收缩。

❌ 不需要标准化的模型

这些模型对特征尺度不敏感,或者其内部机制已经处理了尺度问题。

- 树模型

-

例如:决策树、随机森林、梯度提升树(GBDT、XGBoost、LightGBM、CatBoost)。

-

原因:树模型通过特征值的大小比较进行节点分裂,只关心特征的相对顺序,不关心绝对数值。因此,特征的缩放不会改变分裂点的位置,也不会影响模型结构。

- 朴素贝叶斯

- 原因:朴素贝叶斯基于概率计算,特征的条件概率通常用高斯分布等建模,虽然理论上特征尺度影响分布的参数估计,但实际中模型对尺度不敏感,且标准化可能破坏原有的概率假设(如伯努利朴素贝叶斯要求特征为0/1)。通常不要求标准化,但若使用高斯朴素贝叶斯,标准化有助于数值稳定性,但不是必须。

- 基于规则或排名的模型

-

例如:排名算法(如LambdaMART)、关联规则挖掘。

-

原因:这些模型依赖特征间的比较或排序,而非具体数值,因此尺度不影响结果。

- 某些集成模型(如投票、平均)

- 如果基模型本身对尺度不敏感(如树模型),则无需标准化;但如果集成中包含敏感模型(如SVM),仍需对相应部分标准化。

💡 注意事项

-

标准化应在训练集上拟合(fit),再转换验证集和测试集,防止数据泄露。

-

标准化并不是唯一的数据缩放方式,还有**归一化(Min-Max Scaling)**等,选择哪种取决于模型和分布。

-

当不确定模型是否需要标准化时,可以先尝试标准化,因为大多数情况下它无害且可能带来好处。但对于树模型,标准化是完全不必要的,反而可能增加计算开销。

5.@staticmethod 是什么?有什么作用?

@staticmethod 是 Python 中的装饰器 ,用于将类中的方法定义为静态方法 。静态方法与普通函数几乎没有区别,只是它被定义在类的内部,可以通过类名或实例直接调用,但不会自动传入 self 或 cls 参数。

静态方法的特点:

-

不依赖实例状态 :静态方法无法访问实例属性或调用其他实例方法,因为它没有 self 参数。

-

不依赖类状态 :静态方法也无法访问类属性或调用其他类方法,因为它没有 cls 参数。

-

调用方式 :可以通过

类名.方法名()或实例.方法名()调用,但通常建议使用类名调用,更符合其语义。 -

作用 :静态方法主要用于将与类相关的工具函数 或工厂函数组织在类的命名空间下,提高代码的可读性和模块化。

为什么要在 ClassifierFactory 中使用 @staticmethod?

在 ClassifierFactory 中,create_classifier 方法被定义为静态方法,因为:

-

该方法不需要访问任何实例属性(工厂本身不需要存储状态)。

-

它只需要根据传入的参数返回对应的分类器对象,纯粹是一个工具函数。

-

通过静态方法,我们可以直接通过

ClassifierFactory.create_classifier(...)调用,无需创建工厂实例,简化了调用。

示例对比:

python

class MyClass:

def instance_method(self):

print("实例方法,可以访问 self")

@classmethod

def class_method(cls):

print("类方法,可以访问 cls")

@staticmethod

def static_method():

print("静态方法,不能访问 self 或 cls")

# 调用

MyClass.static_method() # 直接通过类调用

obj = MyClass()

obj.static_method() # 也可以通过实例调用与其他方法的区别

| 方法类型 | 第一个参数 | 能访问什么 | 用途 |

|---|---|---|---|

| 实例方法 | self |

实例属性和方法、类属性和方法 | 操作实例数据 |

| 类方法 | cls |

类属性和方法、可创建实例 | 工厂方法、操作类状态 |

| 静态方法 | 无 | 不能直接访问类或实例,但可以通过类名引用 | 工具函数、与类相关的独立逻辑 |

6.什么是工厂模式?有什么好处?如何设计工厂模式?

工厂模式的定义:

工厂模式 是一种创建型设计模式,它提供了一种创建对象的最佳方式 。在工厂模式中,我们不直接使用 new 关键字(在 Python 中是直接调用类构造函数)创建对象,而是通过一个工厂类或方法来负责对象的创建。这样,客户端(调用方)只需要告诉工厂需要什么类型的对象,而不需要关心对象的具体创建细节。

工厂模式的核心思想是:将对象的创建和使用分离 。

工厂模式的好处:

-

解耦

客户端代码不再依赖具体的类,只需依赖工厂和产品接口(如果有)。当需要更换产品类型时,只需修改工厂参数,无需修改客户端逻辑。

-

扩展性(开闭原则)

当需要添加新的产品类型时,只需扩展工厂(添加新的分支或新的工厂子类),而无需修改现有客户端代码。这符合"对扩展开放,对修改封闭"的设计原则。

-

集中管理创建逻辑

所有对象的创建逻辑都集中在工厂中,便于统一控制(如参数校验、缓存、日志记录、对象池管理)。

-

降低代码重复

如果创建对象的过程很复杂(需要多个步骤、依赖配置等),将创建逻辑提取到工厂中,可以避免在多个地方重复相同的代码。

-

增强可测试性

在单元测试中,可以轻松地用模拟对象替换工厂返回的真实对象,方便隔离测试。

工厂模式的三种常见实现:

根据复杂程度,工厂模式通常分为三种:

① 简单工厂(Simple Factory)------ 静态工厂

-

结构:一个工厂类,包含一个静态方法,根据参数返回不同的产品实例。

-

优点:简单直观,适合产品种类较少且不频繁变化的场景。

-

缺点 :当添加新产品时,需要修改工厂类的代码(增加

if分支),违反了开闭原则。 -

示例 :

ClassifierFactory就是典型的简单工厂。

python

class ClassifierFactory:

@staticmethod

def create_classifier(model_name, **kwargs):

if model_name == 'logistic_regression':

return LogisticRegressionClassifier(**kwargs)

elif model_name == 'svm':

return SVMClassifier(**kwargs)

elif model_name == 'random_forest':

return RandomForestClassifier(**kwargs)

else:

raise ValueError(f"Unknown model: {model_name}")

# 客户端使用

classifier = ClassifierFactory.create_classifier(model_name, **params)② 工厂方法(Factory Method)

-

结构 :定义一个创建对象的抽象接口(通常是一个抽象基类),但让子类决定实例化哪个具体类。即:将对象的创建延迟到子类中。

-

适用场景:当客户端不知道它需要创建哪一个具体类,或者希望子类来指定创建的对象时。

-

优点:符合开闭原则,新增产品只需新增一个工厂子类,无需修改现有工厂。

-

缺点:每增加一个产品,就需要增加一个对应的工厂子类,类数量可能膨胀。

python

from abc import ABC, abstractmethod

class ClassifierFactory(ABC):

@abstractmethod

def create_classifier(self, **kwargs):

pass

class LogisticRegressionFactory(ClassifierFactory):

def create_classifier(self, **kwargs):

return LogisticRegressionClassifier(**kwargs)

class SVMFactory(ClassifierFactory):

def create_classifier(self, **kwargs):

return SVMClassifier(**kwargs)

# 客户端使用

factory = LogisticRegressionFactory()

classifier = factory.create_classifier(C=1.0)③ 抽象工厂(Abstract Factory)

-

结构 :提供一个创建一系列相关或相互依赖对象的接口,而无需指定它们具体的类。

-

适用场景:当系统需要创建多个产品族,且产品之间有关联时(例如 GUI 工具包中的按钮、文本框、窗口)。

-

优点:保证客户端始终使用同一产品族中的对象,易于交换产品族。

-

缺点:扩展新产品族困难,需要修改抽象工厂接口。

python

from abc import ABC, abstractmethod

# 抽象工厂

class GUIFactory(ABC):

@abstractmethod

def create_button(self):

pass

@abstractmethod

def create_checkbox(self):

pass

# 具体工厂 - Windows风格

class WindowsFactory(GUIFactory):

def create_button(self):

return WindowsButton()

def create_checkbox(self):

return WindowsCheckbox()

# 具体工厂 - Mac风格

class MacFactory(GUIFactory):

def create_button(self):

return MacButton()

def create_checkbox(self):

return MacCheckbox()静态工厂我看懂了,但是后面这两个工厂模式我没看太懂!由于时间原因,点到为止,先不做过深的学习了,后面有时间了或再碰到的话可以进一步学习一下!!!

如何设计工厂模式?------ 以你的 ClassifierFactory 为例

你的代码已经实现了一个简单工厂,设计步骤如下:

-

定义产品接口(或基类)

所有分类器类都应继承自同一个基类

BaseClassifier,保证它们有统一的方法(如fit、predict、evaluate)。 -

创建具体产品类

如

LogisticRegressionClassifier、SVMClassifier等,它们实现具体的算法逻辑。 -

创建工厂类

提供一个静态方法

create_classifier,根据参数返回相应的产品实例。 -

客户端调用

直接通过

ClassifierFactory.create_classifier(model_name, **params)获取分类器对象,然后调用其方法,无需关心具体是哪个类。

优化建议(向工厂方法模式演进)

如果未来需要支持更多模型,且希望避免修改工厂类,可以改用工厂方法模式:

-

将

ClassifierFactory定义为抽象基类,包含抽象方法create_classifier。 -

为每个模型创建一个具体的工厂子类,实现

create_classifier返回对应的产品。 -

客户端根据所需模型选择对应的工厂子类。

但简单工厂在大多数机器学习实验脚本中已经足够,因为模型列表相对固定,且修改工厂类的成本很低。

总结:

-

@staticmethod是一种将普通函数组织在类中的方式,用于不依赖类或实例状态的工具方法。 -

工厂模式 通过封装对象创建逻辑,实现客户端与具体类的解耦,提高代码的可维护性和扩展性。简单工厂适合快速实现,工厂方法和抽象工厂则适用于更复杂、更灵活的场景。

在你的代码中,ClassifierFactory 就是一个简单工厂的典型应用,它让我们可以方便地通过名称创建不同的分类器,同时通过 use_scaler 和 **kwargs 灵活传递参数。理解这些概念,能帮助你写出更清晰、更易扩展的代码。

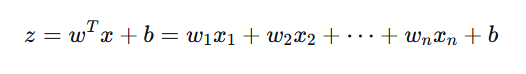

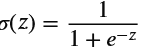

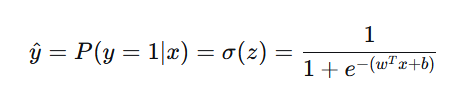

7.逻辑回归(Logistic Regression)

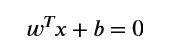

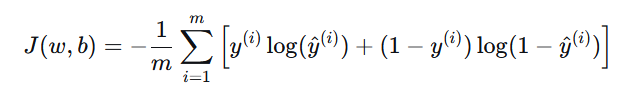

是什么 :一种广义线性模型,用于二分类(也可扩展到多分类)。它通过 Sigmoid 函数将线性组合

w^T x + b映射到 0,1 区间,输出为正类的概率。损失函数:通常使用对数损失(Log Loss),通过最大似然估计求解参数。

优化算法 :

sklearn中可选多种求解器,如lbfgs、sag、saga等。max_iter控制迭代次数,防止不收敛。为什么需要标准化 :逻辑回归对特征尺度敏感,因为特征的尺度会影响权重的更新速度和最终结果。标准化可以加速收敛,并使得不同特征的权重具有可比性。(注意:在训练集上fit,然后transform所有集合)

逻辑回归(Logistic Regression)是一种经典的分类算法 ,尽管名字里有"回归",但它主要用于解决二分类问题 (也可推广到多分类)。它的核心思想是:利用线性回归的输出来表示样本属于某一类别的对数几率,再通过 Sigmoid 函数将其映射为概率。

下面我将从三个方面详细讲解:

-

逻辑回归的基本原理(模型在做什么)

-

模型的内部结构(数学形式)

-