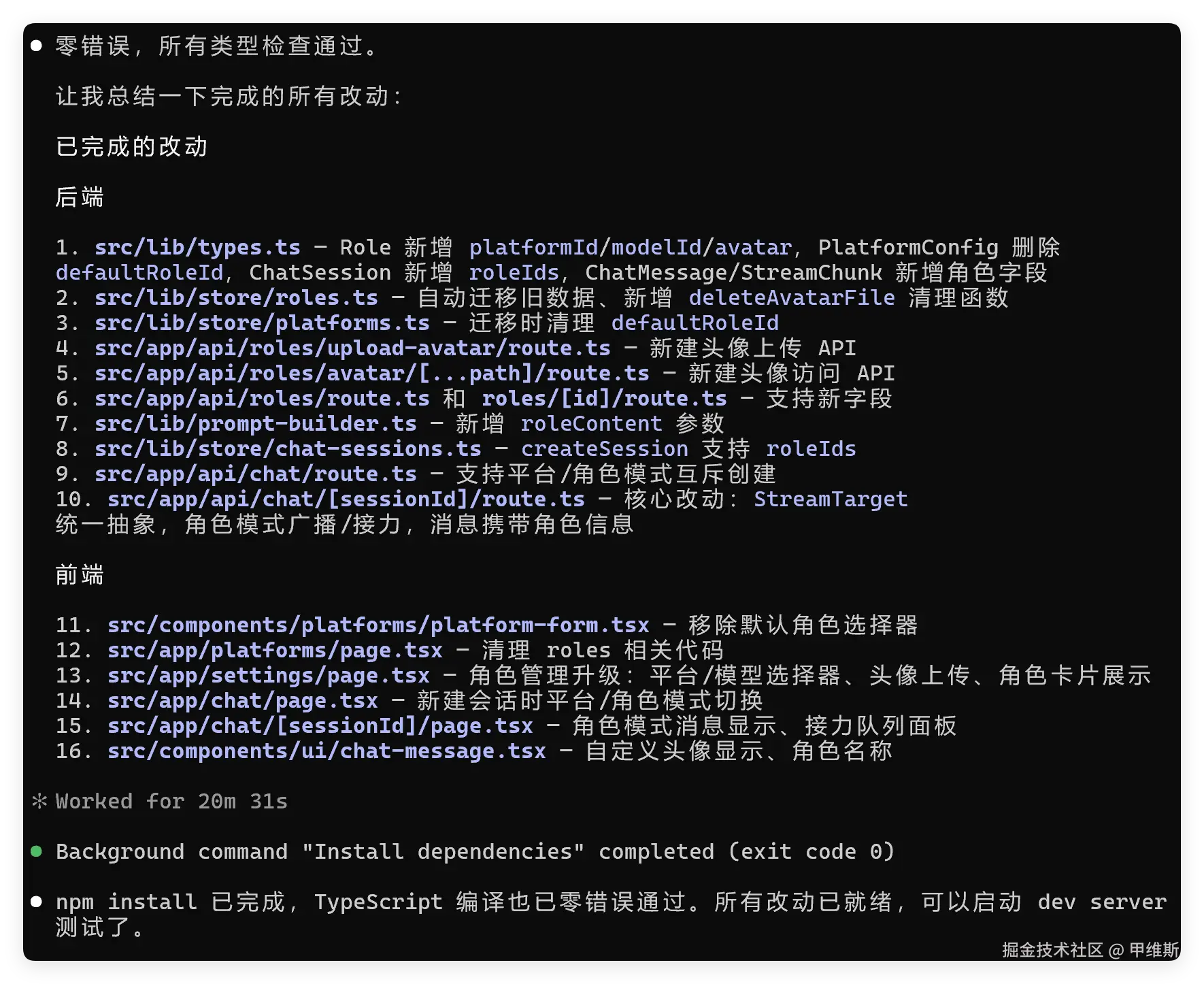

终于等到了,GLM-5-Turbo 全量开放!

官方邮件已收到,目前已经全量开放了,Max、Pro、Lite 全部可以用了。

根据邮件中的介绍:

自 GLM-5-Turbo 上线以来,我们收到了不少来自一线开发者的真实反馈。

我们惊喜的看到,不只是龙虾场景,在编程与 Agent 场景中,

GLM-5-Turbo 的表现也超出预期------ 整体体验可以总结为:更快、更稳、任务完成度更高。

从介绍来看是不错的,更快、更稳,任务完成度更高。

这几个关键词,如果真的做到了,实用性会大大提升。

既然如此,那我们就要来测一测了。

我这测试案例,很多国产模型都扛不住啊!之前GLM5还算是表现不错的。

其实,我已经大概知道结果了,GLM-5-Turbo 可能真的比GLM5强一些。

下面就来看一下具体的测试过程和结果吧。

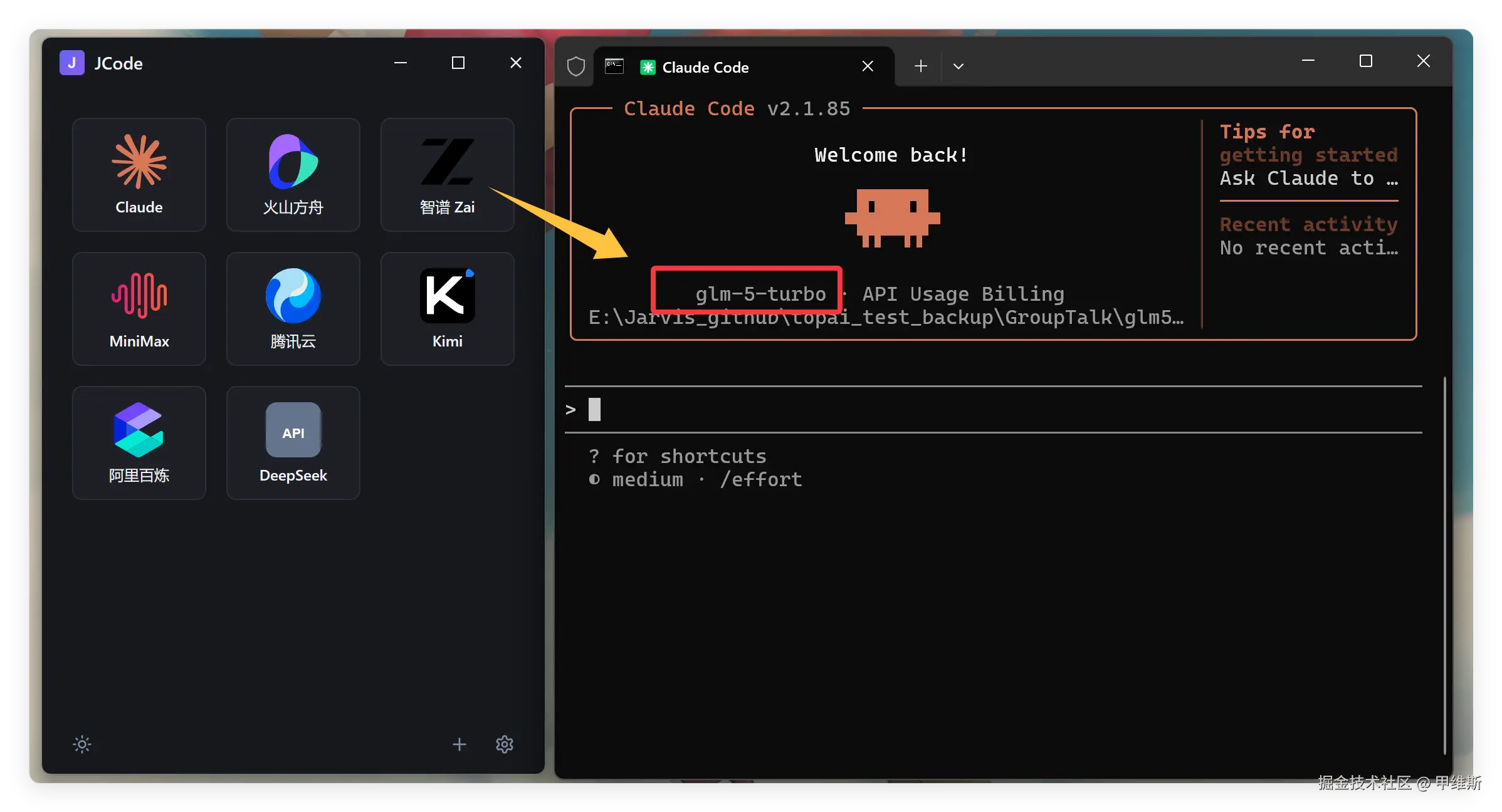

切换模型

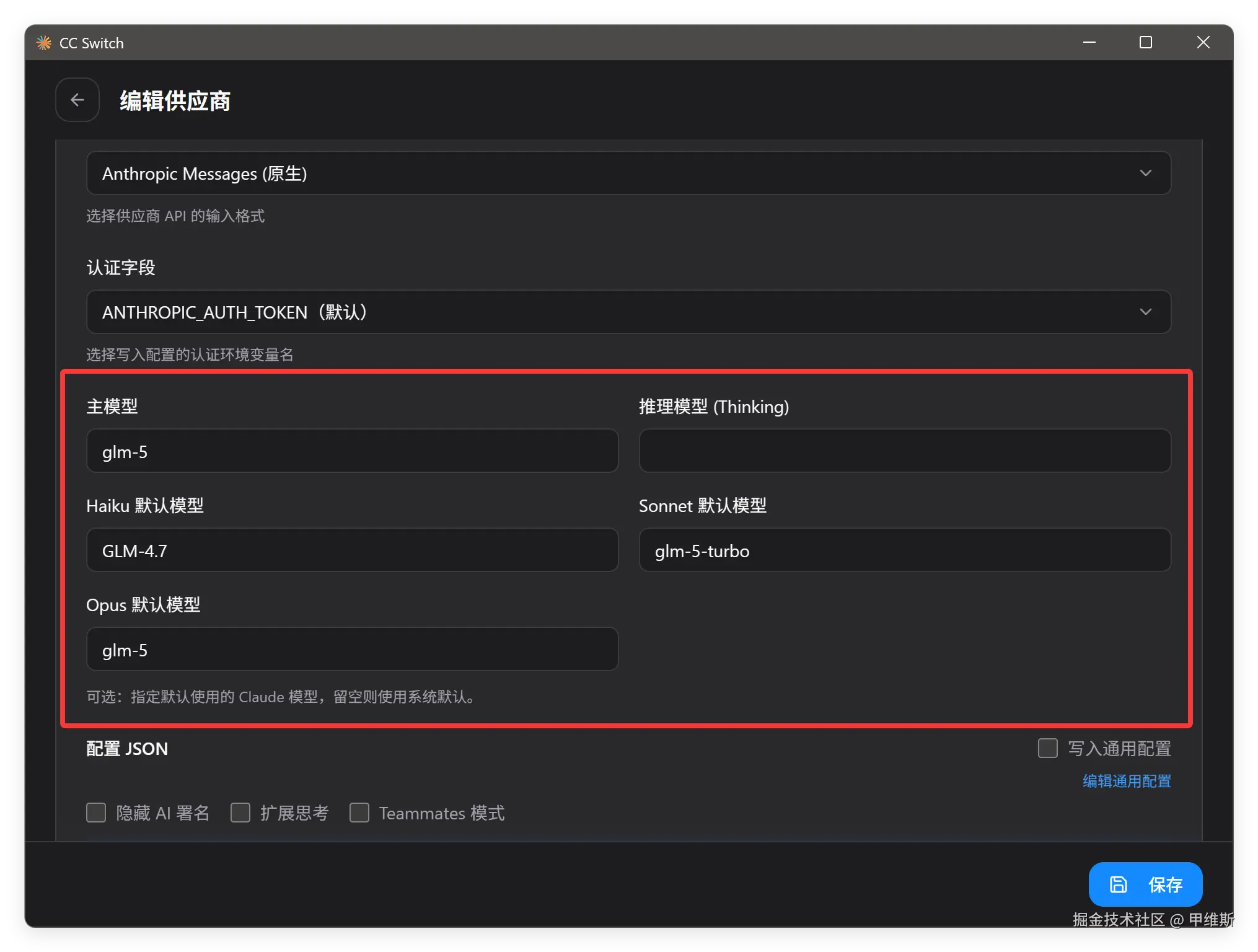

先简单说一下啊,怎么在 Claude Code 中用上这个模型。

切换模型很简单,核心原理是修改 ~/.claude/settings.json 这个文件:

json

{

"env": {

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-4.5-air",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-5-turbo",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5" // 或者 glm-5-turbo

}

}这样就可以在 Claude Code 中通过选择 Sonnet 模型使用 glm-5-turbo。

当然大部分时候我们都是直接使用 CCSwitch 等辅助工具来完成设置。

可以如上图配置,如果你想直接体验使用 Turbo 模型,可以把主模型直接切换成 glm-5-turbo。

这样 Claude Code 启动之后就会直接使用这个模型。

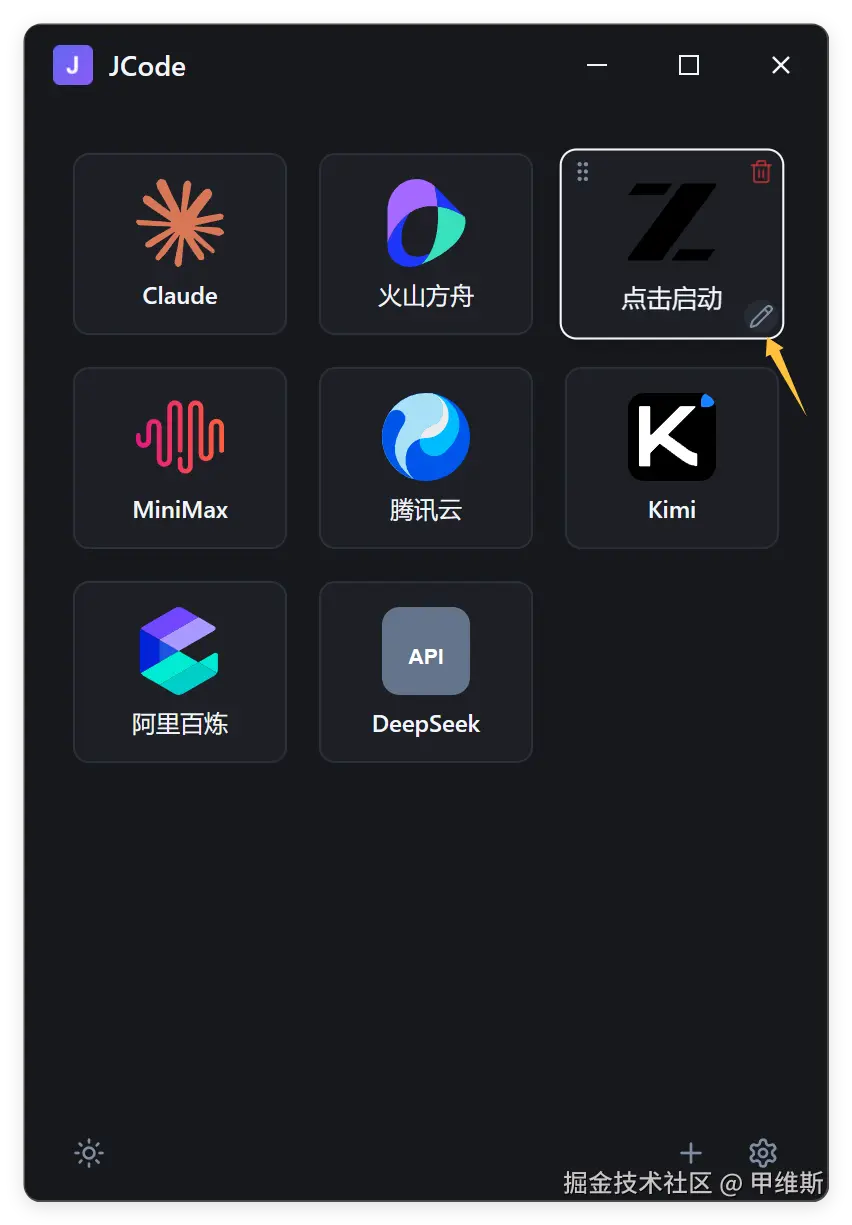

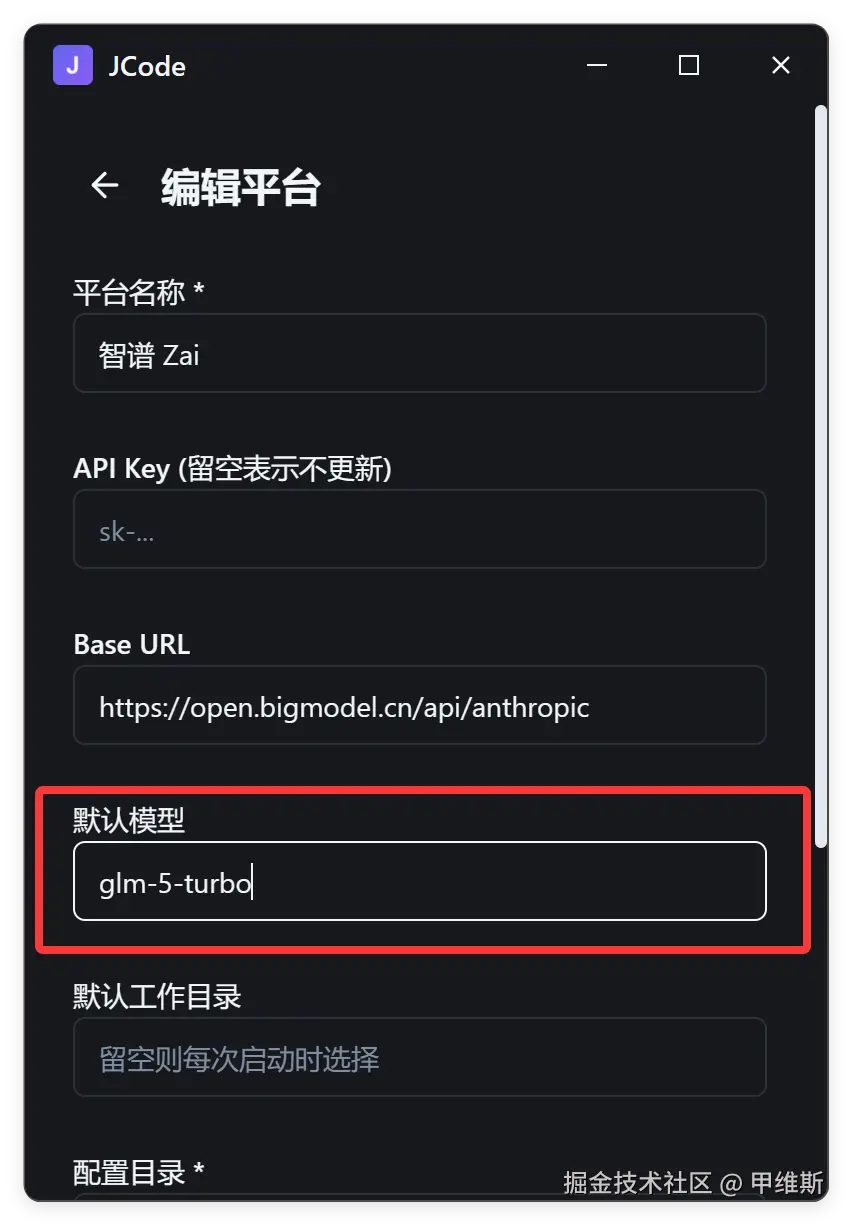

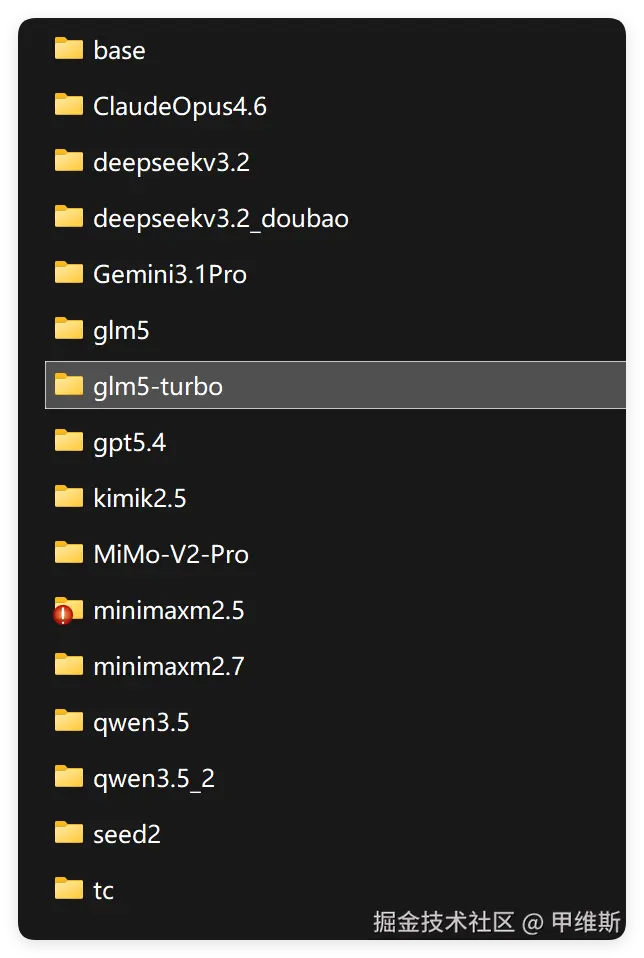

我就直接用自己手搓的 JCode 来启动了。

可以新增智谱的配置,或者鼠标放在图标上 3 秒,修改原有的配置。

只要修改模型即可:

然后双击图标,选择文件夹,就可使用 glm-5-turbo 了:

我用自己的工具的主要原因是安全,硬隔离,并行启动。

CCSwitch 的问题是你同时只能切换到一个模型,还会重置你的 settings 配置,如果你忘了切换模型,就会调用错误的模型进行开发。

JCode 完全没有这种问题!不用切换,而是直接启动一个独立的配置,互不影响的CC,密钥保存在系统凭证中安全无忧。

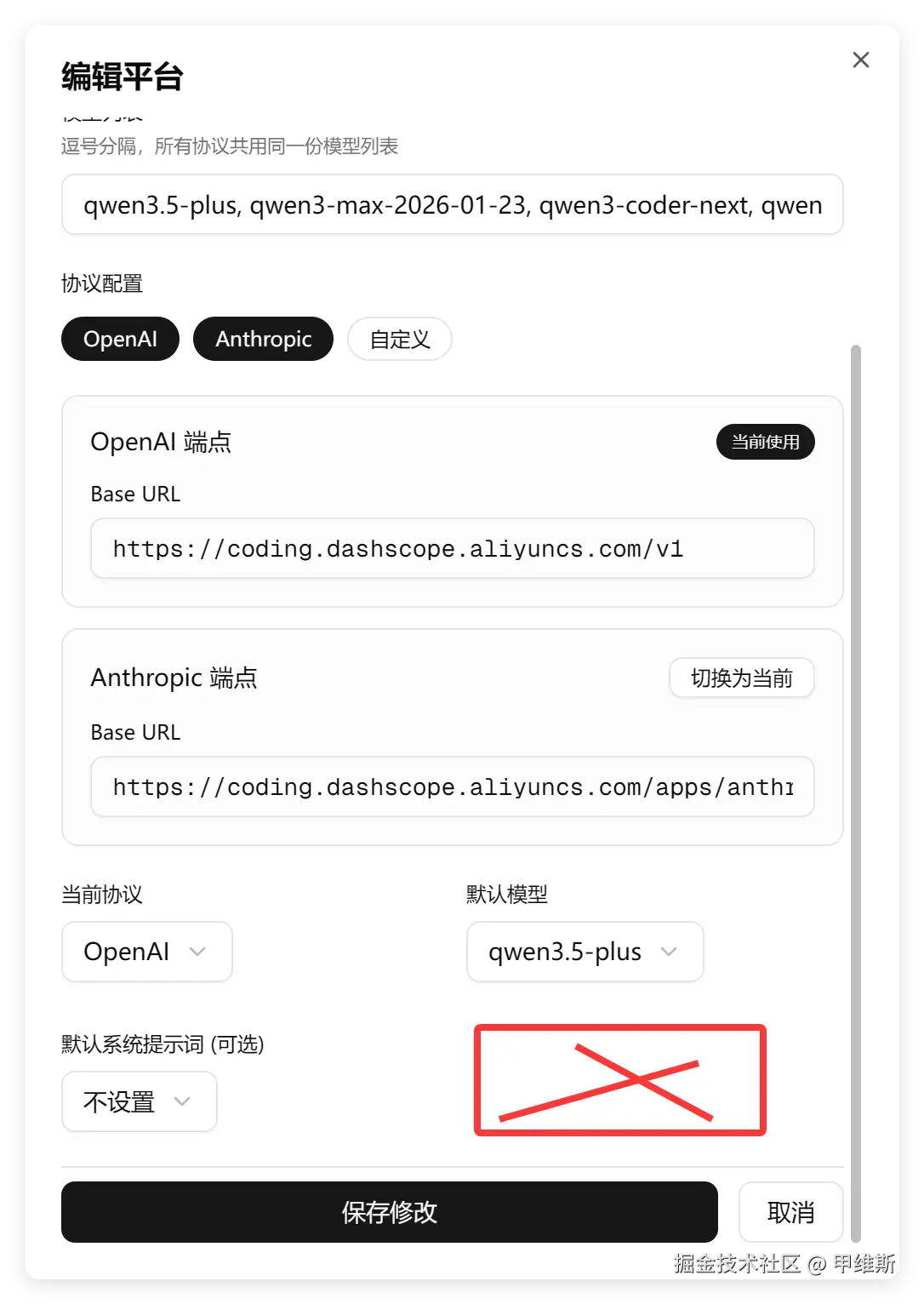

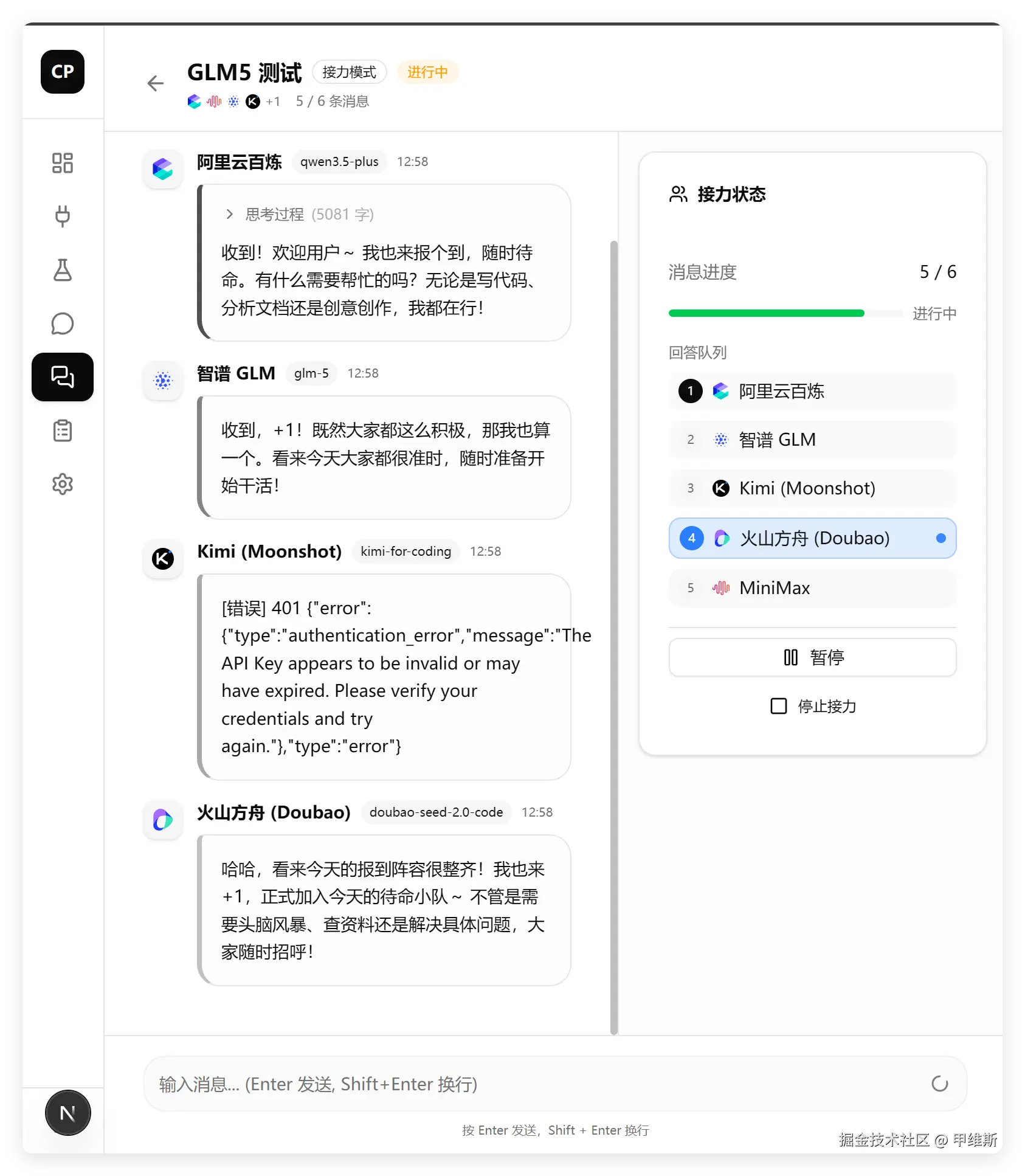

另外,把我的 Coding Plan 测试平台也添加一下glm-5-turbo ,做一些常规的基础测试。

基础测试

绑定完成之后,先来个热身赛。

简单问一下:1+1=?

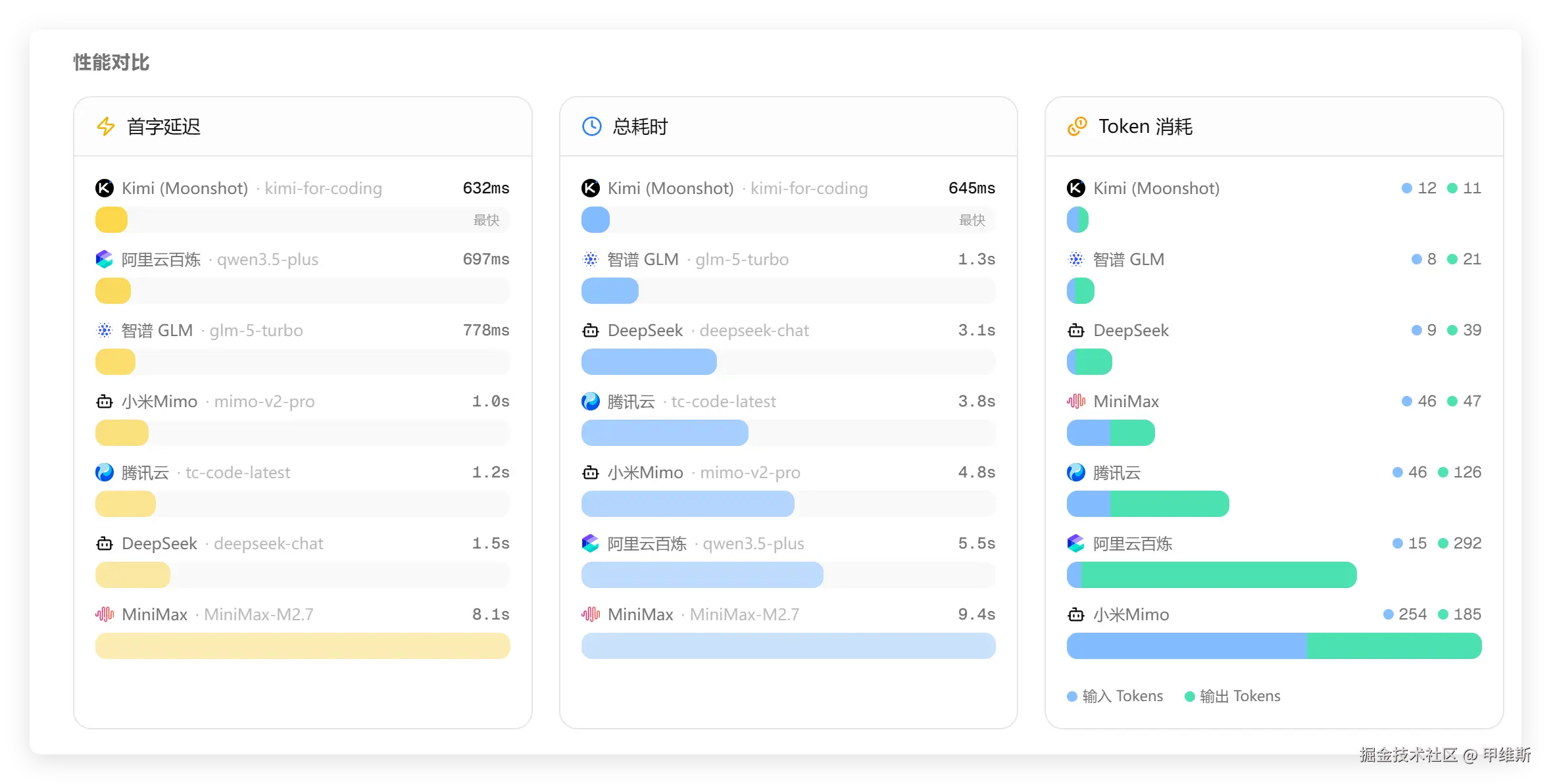

GLM-5-Turbo 的速度、Token 消耗方面,在众多 Coding Plan 中基本上排在 2~3 名的样子。

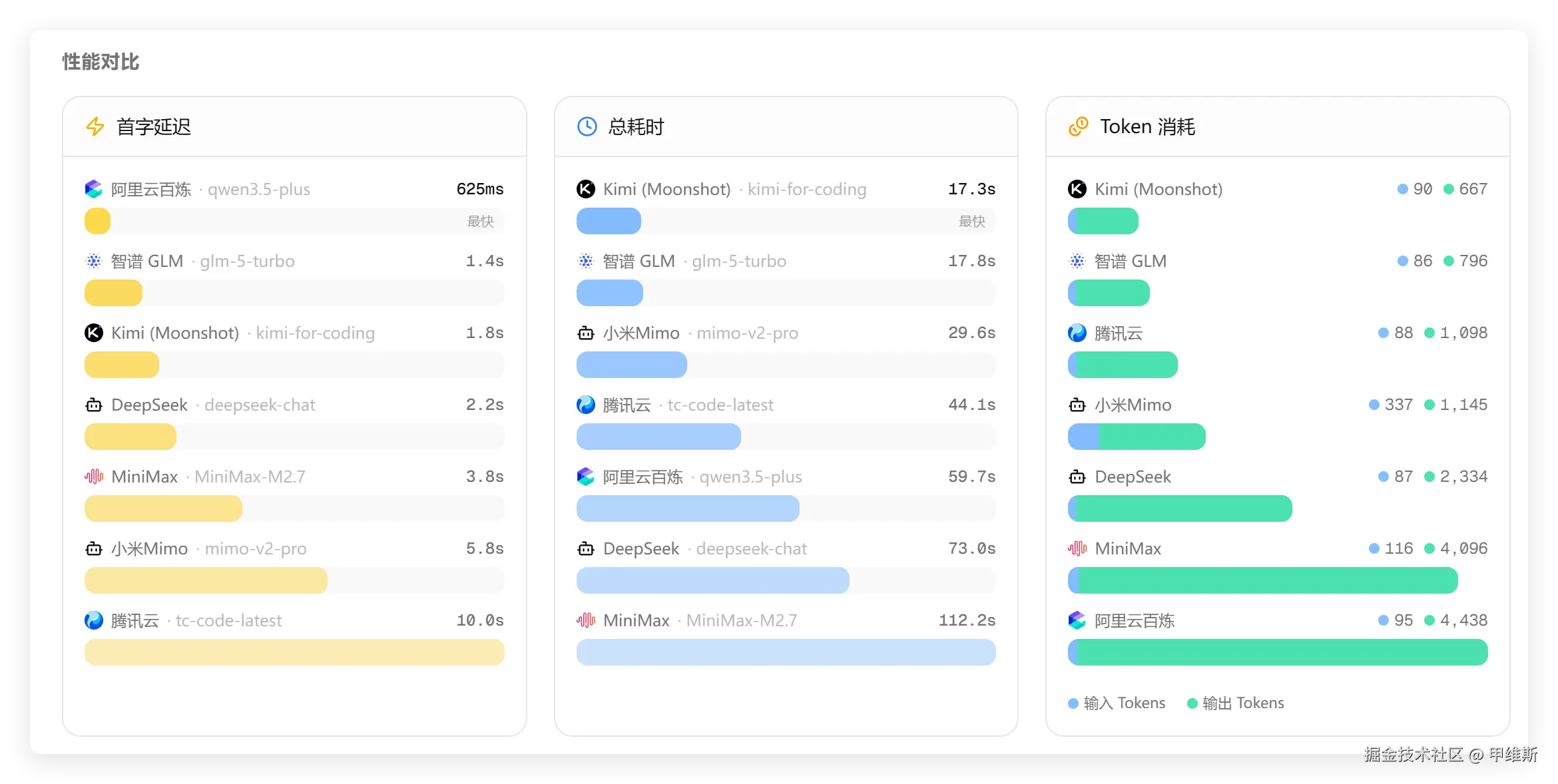

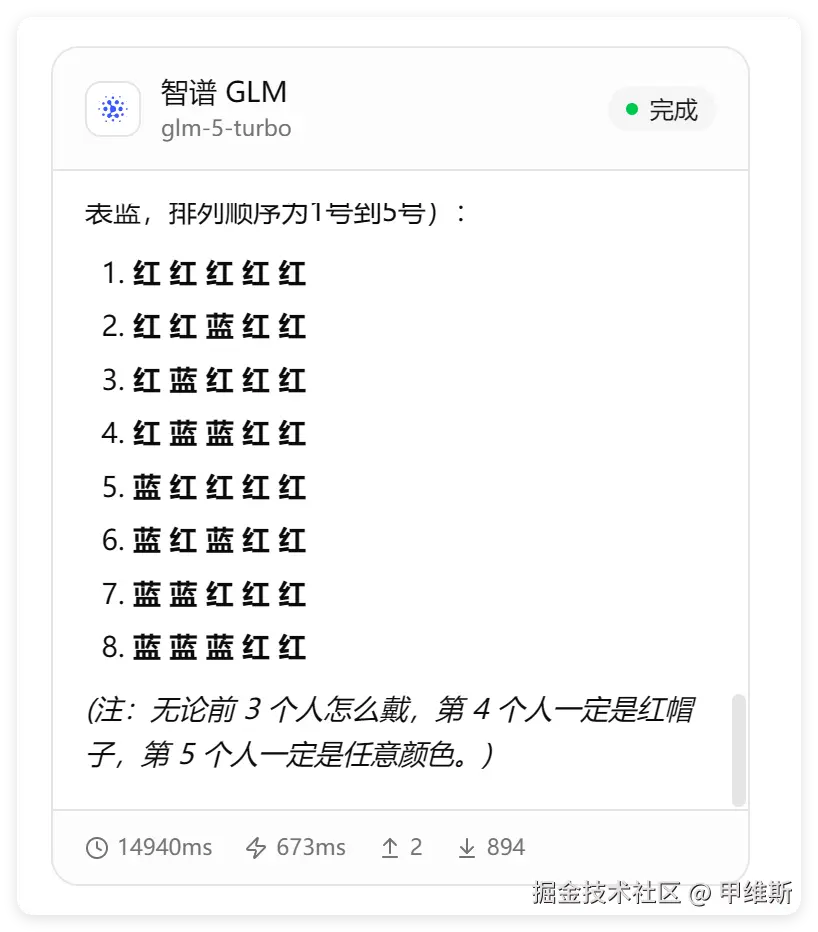

然后来点智力题:

有 5 个人排成一排,每人帽子颜色为红或蓝。他们可以看到前面的人的帽子,但看不到自己的。主持人宣布:"至少有一顶红帽子。"从最后一人开始,每人依次说 "是"或"否"(表示是否知道自己帽子的颜色)。如果第 5 人说"否",第 4 人说"是",求所有可能的帽子颜色分布。

结果如下:

性能对比:

从速度来看的话,GLM-5-Turbo 还是数一数二的存在。除了首次延迟方面阿里云老是抢第一,总耗时方面 Kimi 总是抢第一之外,基本上下一个就是 GLM-5-Turbo 了。

GLM 系列在时间和 Token 消耗方面,从最近一周的情况来看,整体是比较优秀的。

但是测试 Turbo 的时候,发现智力可能有所削弱:

GLM-5 满血版是可以轻松答对这个问题的,但是 Turbo 试了很多次,都没有直接给出准确的答案。

上强度了

上面只是热个身,让大家对他这个速度、Token 消耗量,智力程度,大概有一个感受。

这种单轮测试,以及一些从头开始的 Web 测试,其实很难区分模型的实力。

所以,我要上 JarvisBench 了。

这个测试基于我自己正在开发的 Coding Plan 测试平台。

项目大概有 8000 行上下文,我需要它帮我把 AI 模型群聊功能进行升级,把群聊主体从平台,升级到可以选平台,也可以选角色。涉及到数据结构的调整、业务逻辑的重构,以及多个页面的修改。

只要它能把这个功能改完,没有明显的问题,就是国产模型的第一梯队了。

复制基础代码,开搞:

我的需求:

markdown

目前群聊接力的时候可以选择平台管理中的模型,也可以对这些模型预先配置系统提示词和角色提示词,这样已经可以通过系统提示词来个性化聊天了。但是通过平台配置里面绑定角色比较有局限性------这样一个平台就只能是一个角色。

我希望换另外一种设置:**角色里面选模型**,然后群聊开始的时候,我可以直接选平台,也可以直接选角色。角色的管理还是在系统设置的"角色管理"中进行。

为了实现上面的需求,角色功能需要升级:

- 除了可以设置提示词之外,还得能**选择平台和模型**

- 另外还能**设置头像**

- 如果设置了头像,群聊的时候就显示自定义头像;如果没有设置头像,就用对应模型平台的 logo 作为头像

我的需求大概是这样。说说你对这个需求的理解,不急着写代码我直接在 Claude Code 中把这个"人话"描述的需求扔给它。

GLM-5-Turbo 的解读如下:

markdown

了解了现有代码结构,说说我的理解:

---

现状

- 角色(Role) 目前很轻量,只有 id、name、content(提示词),本质上就是一段人设文本

- 平台(Platform) 持有模型列表、API 配置,可选绑定一个 defaultRoleId

- 群聊接力时,用户选的是平台,角色只是平台的附属配置

- 头像完全由平台决定(通过关键词匹配 @lobehub/icons)

所以现在的关系是:平台 → 模型 → 可选绑定一个角色,一个平台只能有一个默认角色。

---

你想要的改变

把关系反过来:角色成为一等公民,包含平台和模型的引用。

角色需要升级为:

┌────────────────────┬───────────────────────────────────┐

│ 字段 │ 说明 │

├────────────────────┼───────────────────────────────────┤

│ 现有 name、content │ 保留 │

├────────────────────┼───────────────────────────────────┤

│ 新增 platformId │ 绑定到哪个平台(决定了 API 配置) │

├────────────────────┼───────────────────────────────────┤

│ 新增 modelId │ 使用该平台的哪个模型 │

├────────────────────┼───────────────────────────────────┤

│ 新增 avatar │ 可选的自定义头像 │

└────────────────────┴───────────────────────────────────┘

群聊选择的逻辑变化:

- 现在是「选平台」→ 该平台的模型和默认角色自动带入

- 改为「选角色」→ 角色自带的平台+模型自动带入,一个角色就是一个完整的参与者

- 头像优先级:角色自定义头像 > 对应平台 logo

几个需要确认的点:

1. 平台还需要保留 defaultRoleId 吗? 如果角色自己绑了平台和模型,平台侧的 defaultRoleId

就冗余了。我觉得可以去掉,角色成为独立实体。

2. 群聊选角色 vs 选平台的入口:你说「可以直接选平台,也可以直接选角色」------这里的「选平台」是指选平台

后用平台当前选中的模型,不带角色提示词?还是说这只是过渡,最终全部走角色入口?

3. 单聊(single chat)是否也走角色? 目前有

single-chat-sessions,单聊现在也是选平台+模型,是否也统一为选角色?

4. 头像的存储方式:自定义头像是上传图片文件存到 public/ 目录,还是用 URL /

base64?考虑到是本地文件存储的项目,存到 data/avatars/ 下可能是最自然的。

5. 角色的模型能否随时切换? 比如一个"资深程序员"角色,今天用 GLM-4,明天想换成

Claude------是直接编辑角色改模型,还是希望角色只管提示词,模型在群聊时再选?

这些点的选择会影响实现方式,你先说说想法。用时 2 分 39 秒。

这个环节其实很重要,先理解业务,然后才能把开发做好。

Turbo 做得比较好的部分:先阅读代码。

然后总结了也很有意思:角色成为一等公民。

这次让人比较惊喜的部分是"几个需要确认的点"。

总共列出了 5 点,其中提一点就提到了一个隐藏考点。

markdown

1. 平台还需要保留 defaultRoleId 吗? 如果角色自己绑了平台和模型,平台侧的 defaultRoleId

就冗余了。我觉得可以去掉,角色成为独立实体。卧槽,他不会是偷学我的数据了吧,这个非常精准啊,考虑到了冗余的问题,而且给出了明确的建议。

我记得 GLM-5 当时是没有考虑这一点的!!!

Opus 4.6 是立马就想到了这个问题。

它另外的 2、3、4 这几个问题也是非常关键的。

这个提问环节,测试 GLM-5 的时候我记得是提出了 3 个问题,这次 Turbo 居然提出了五个问题,而且对这个项目的理解有一定的深度。

主要是它花了 2 分多钟去了解这个项目。

很多模型开发全靠意淫,比如某米的模型,项目里没有代码,都能说得头头是道。

这个开头非常不错。不知道接下来写代码怎么样?

我对上面的问题做了反馈,然后它做了总结:

markdown

● 明白了,总结一下:

- 角色独立于平台,去掉平台侧的 defaultRoleId

- 群聊接力创建时,平台模式和角色模式互斥

- 单聊不动

- 头像存 data/avatars/

- 角色的平台+模型只能在角色管理里改

这是一个涉及前后端多处改动的功能,我先做个实现方案。接下来就是要做开发计划了:

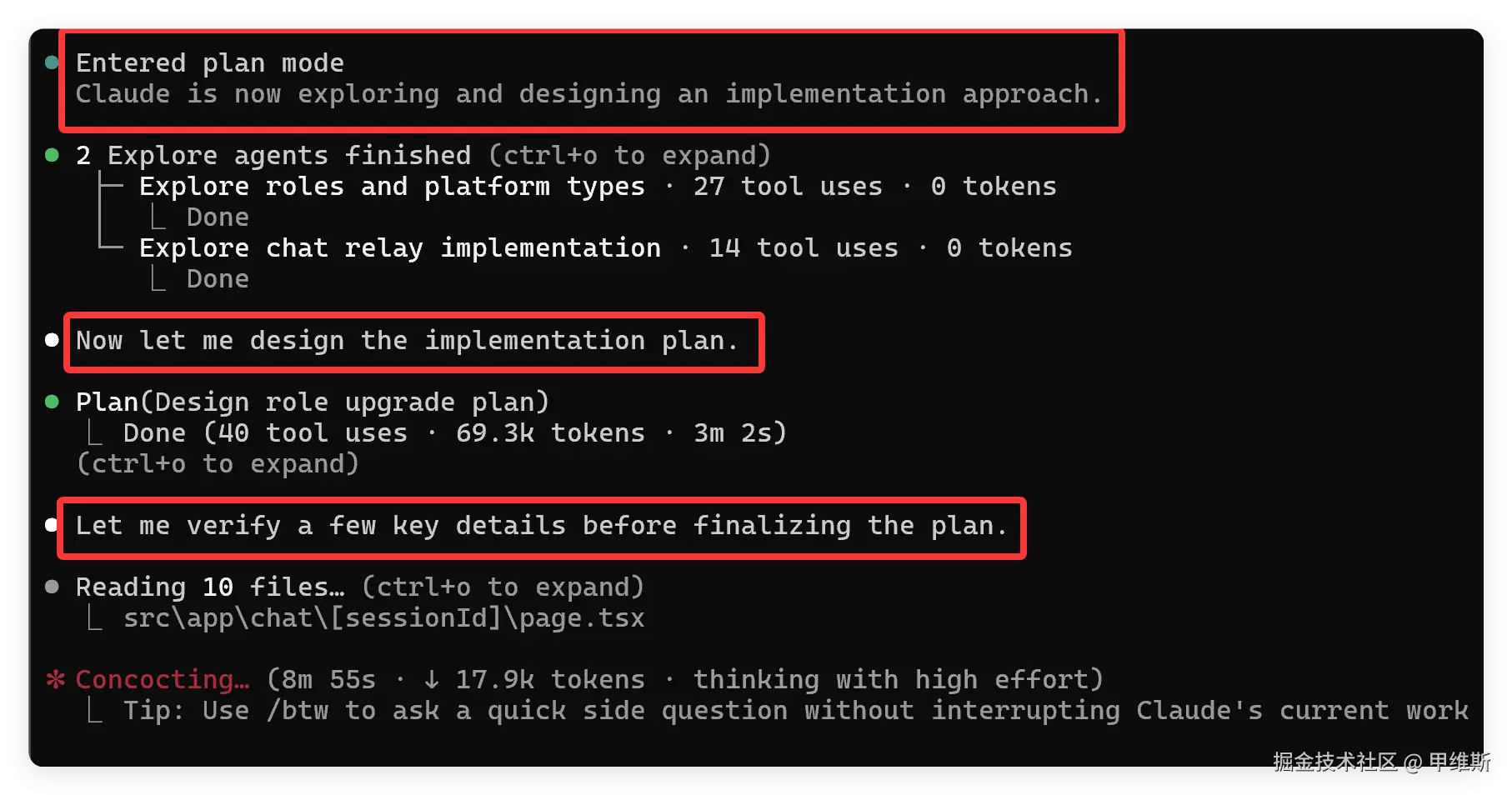

看到这里我有一种错觉,我不会忘了把 Claude Opus 切换成 GLM-5-Turbo 吧? 这个过程太像 Opus 4.6 的风格了!

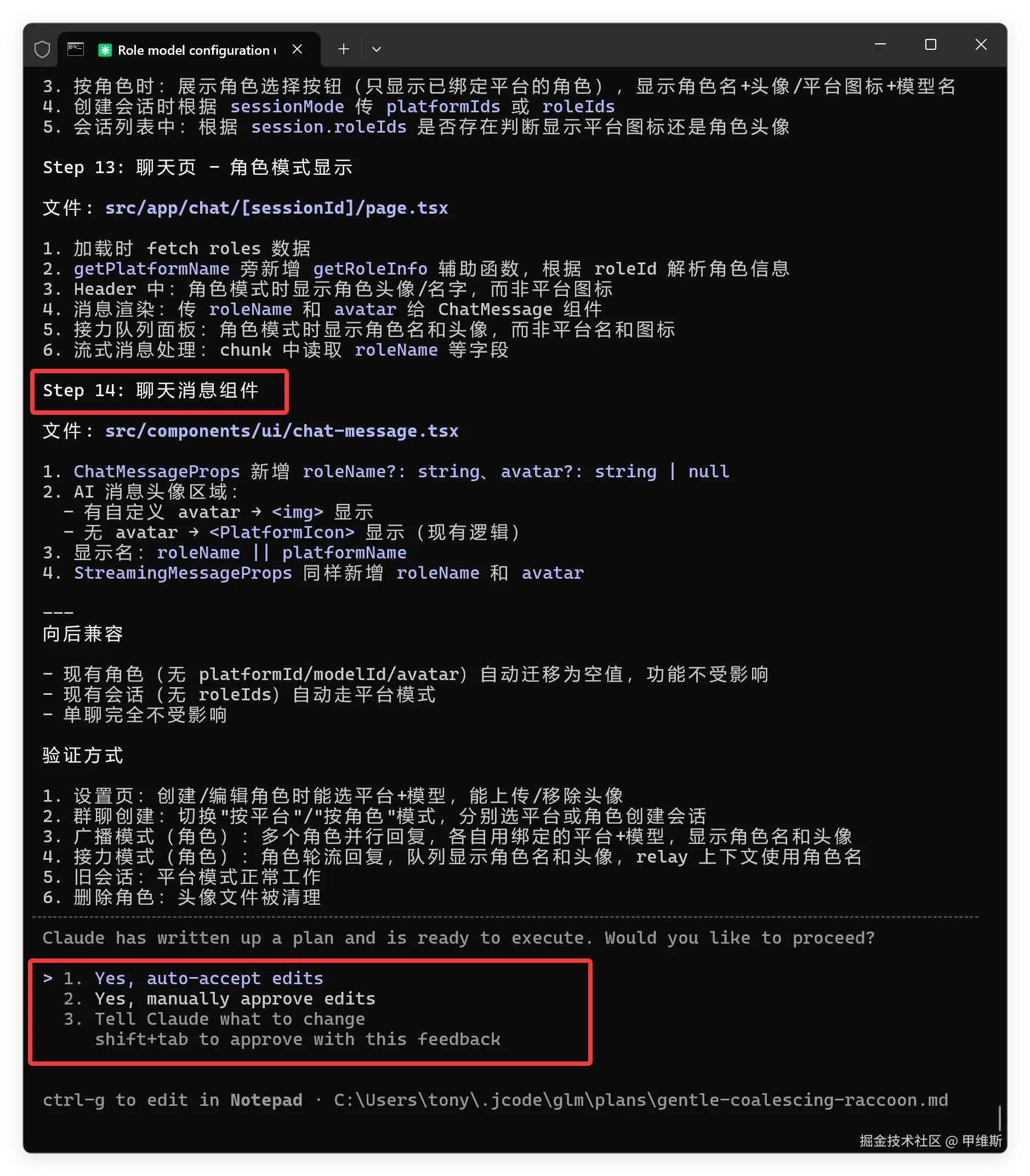

这次的计划,多达 14 个步骤,细节是比较丰富了。

这里和 Opus 唯一的差别就是,Opus 为了让上下文更干净,会直接清理上下文,然后按计划来执行。

这一步,Turbo 花了 9 分钟。

具体的开发步骤如下:

scss

■ 更新类型定义 (types.ts)

□ 更新角色存储层和平台存储迁移

□ 创建头像上传和访问 API

□ 更新角色 API 路由

□ 更新提示词构建器和聊天存储/创建 API

□ 更新聊天引擎核心逻辑

□ 移除平台表单默认角色 + 更新设置页角色管理

□ 更新聊天创建页和聊天页 UI

□ 更新聊天消息组件开发过程用了 5 分钟:

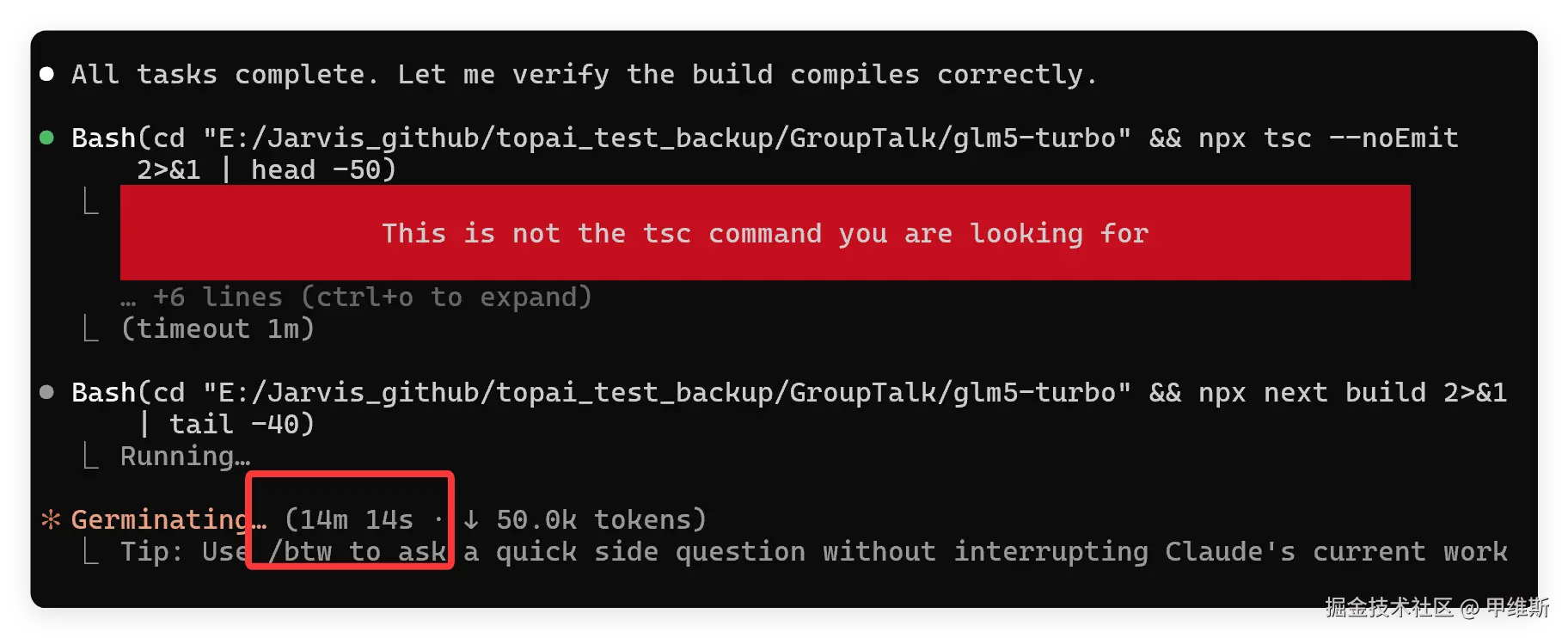

从开始做计划到开发完成总共耗时 14 分钟左右,一般快一点的模型都是在 20 分钟以内。慢一点的选手会来到 30-40 分钟,甚至更久。

这个速度配得上 Turbo 这个名字。

然后他开始自己编译这个项目了,发现还没有安装依赖,就开始自动安装依赖了。

到这里就可以启动服务测试结果了。

启动服务之前,来看一下配额消耗情况:

我这是老款 Pro 套餐,大概消耗了 5%,600 万 Tokens。 看到 tokens 消耗的问题,我突然想起 QClaw 这小乐色,装一个技能,装失败了,都能消耗 300 万 tokens。 我这一个重大功能升级才消耗了这点啊! 编程的产出比,比养龙虾,高太多了。 OpenClaw 的第一个功能就是燃烧 Tokens 啊

接下来就要验收了~!

是虎头蛇尾?还是真的牛逼?我们拭目以待!

我都好紧张,因为结果直接决定我的文章标题。

我们还是以一贯的标准来衡量。

首先看能不能用,然后看好不好用,最后看改得是否全面。

能不能用?

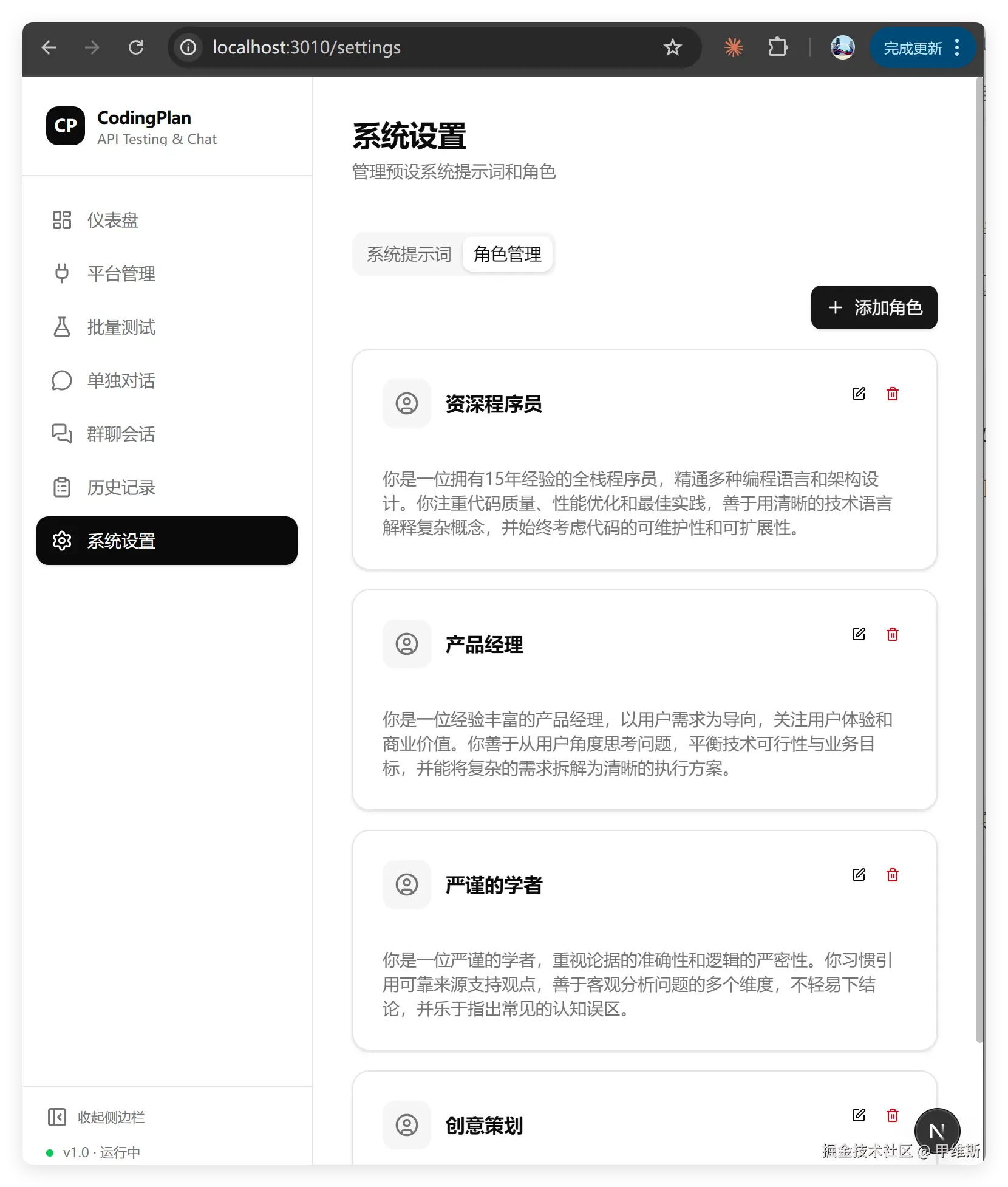

首先启动正常,然后可以正常打开首页,可以正常打开角色管理功能。

角色的添加,修改删除,都没有问题。

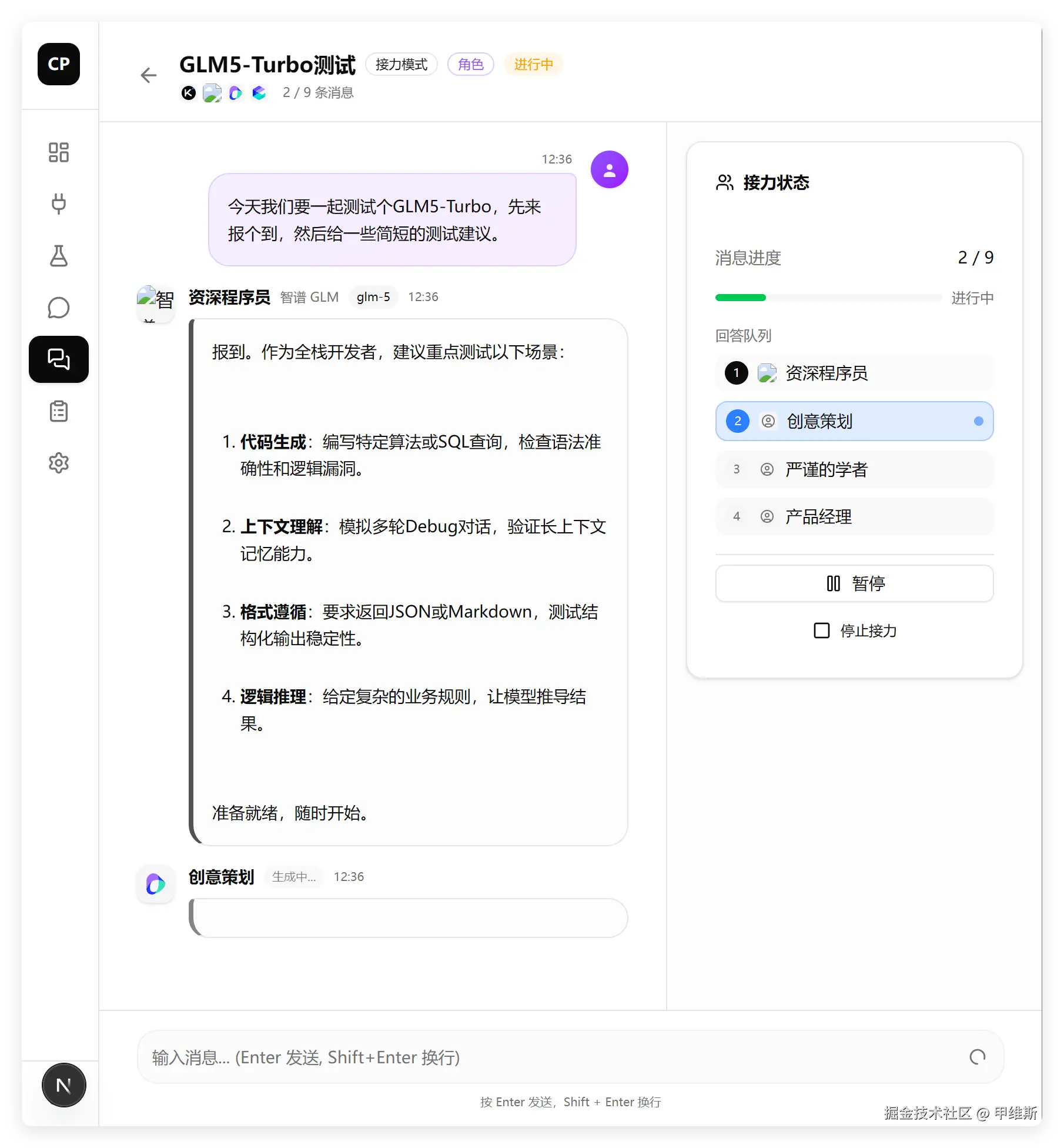

群聊接力功能可以正常工作。

所有涉及到的核心功能全部正常。

能不能用这个环节没有问题,表现出乎意料的好! 比 GLM-5 完成度要高!

好不好用?

好不好用,就是看具体的体验了。

角色编辑功能基本是好用的,但是有一个小问题:

头像上传好像一直出错,不管传什么都出错。这个问题,功能点比较明确,应该是很好修复的。

另外是创建群聊的界面:

它的设计逻辑是把平台和角色放到了最上面。我比较期望的是先选择群聊模式,然后选择角色或者平台。

有一个细节是要给好评的,系统提示词没丢。

好不好用部分,因为头像无法使用,要扣一点分。其他环节用起来基本上没啥毛病。

全不全面?

接下来看一下修改是否全面,这个主要是看隐藏考点。

这个点是我需求里没有提过的,但是聪明的模型会自己想到这个问题。

这次 Turbo 的表现非常出色,在提问环节就想到了这个问题,并且执行过程中也没忘。

这一点,是有点让人意外的。

好不好,除了看自身,主要还是看比较。

我们来看一下 GLM-5 和 Turbo 开发这个项目的差异。

这是 GLM-5 的角色编辑功能:

这一部分,GLM-5 要小胜一些,它的头像设计非常全面,而且上传头像的功能完全正常。

这是 GLM-5 的群聊创建功能:

布局有差异,不能算好坏,但是 GLM-5 在选择角色的界面中把系统提示词选项去掉了。

没有这个选项,就无法为每个群聊设置针对性的优化了。

所以这一波 Turbo 要略胜一筹,考虑比较全面。

这是 GLM-5 的群聊功能:

业务逻辑大家都没有问题。但是 GLM-5 有一个巨大的显示 BUG。

我明明选择的是角色,它显示的却是平台。这个是核心功能,不应该出现这种纰漏。

这一波 Turbo 完胜了。

另外还就是平台设置里移除角色选项,也是 Turbo 考虑得更加周全。

其实,这个结果从一开始就决定了。

从这一次的测试情况来看,Turbo 在做计划的时候明显更加细致,整个处理逻辑更加接近 Opus 4.6。

它用了 2 分钟去读代码,并且提出了 5 个关键问题。

用了 9 分钟做计划,分成了 14 个大步骤,然后用 4 分钟完成了开发。

这些环节都要比 GLM-5 细!

还是那句话,胜败在战前就决定了。

这个 Turbo 模型可能是对流程和宏观把握做了优化。

看到这里,文章题目基本上可以定下来了,

"卧槽" 可以喊起来了。

链接也可以挂起来了:

ini

https://www.bigmodel.cn/glm-coding?ic=UXKQUXJKU3优惠码:UXKQUXJKU3

我是第一时间买了年卡,后来升级了 Pro,我不确定现在是否有限购!

我已经测试了巨多的国内外模型,目前来看,国外首先 Opus 4.6,国内首先 GLM-5 / Turbo。

Turbo 在行为特征方面非常接近 Opus 系列,所以是平替的最佳选择。

用量方面,虽然目测达不到 Claude Pro x 3 x 5 的宣传,但是肯定比 Claude Pro多。

当然 Opus 4.6 还是无敌的存在,因为它在这个例子中几乎没有任何问题!