前言:为什么要选择DeerFlow 2.0?

最近字节跳动开源的DeerFlow 2.0在GitHub上火了,几天时间收获45,000+星。作为一名技术开发者,我第一时间研究了这个项目。经过深入测试,我发现它解决了传统AI Agent框架在生产环境中的几个关键痛点。

本文将从工程实践角度,带你完整掌握DeerFlow 2.0的核心功能和部署方法。

一、核心技术架构解析

1.1 Docker隔离机制

传统框架的问题:多个任务共享进程,一个任务崩溃影响全局。

DeerFlow 2.0的解决方案:每个任务独立Docker容器。

核心代码实现:

python

# 任务容器创建函数

def create_task_container(task_id, skill_config):

container = docker_client.containers.run(

image="deerflow-agent-base:latest",

command=f"python task_executor.py --task {task_id}",

environment={

"SKILL_CONFIG": json.dumps(skill_config),

"MEMORY_BACKEND": "redis://redis:6379"

},

network="deerflow-network",

name=f"deerflow-task-{task_id}",

detach=True

)

return container.id技术优势:

- ✅ 安全隔离:独立文件系统和网络命名空间

- ✅ 依赖管理:不同任务可使用不同Python版本

- ✅ 资源控制:cgroups限制CPU、内存使用

- ✅ 快速清理:任务完成即销毁容器

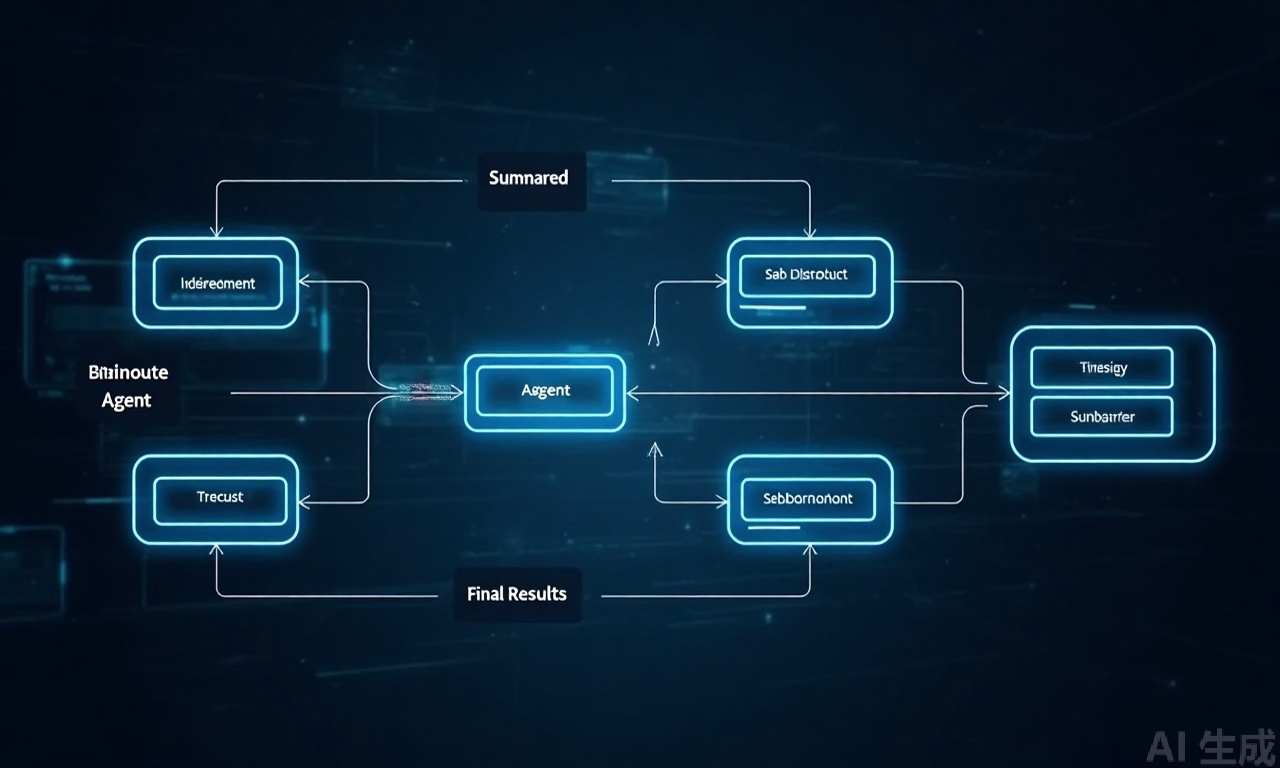

1.2 并行子Agent编排

复杂业务场景需要多个Agent协作。DeerFlow 2.0通过工作流DAG实现并行编排。

工作流定义示例:

yaml

workflow:

name: "customer_service_flow"

steps:

- name: "understand_intent"

agent: "nlp_agent"

input: "{{user_query}}"

- name: "query_order"

agent: "db_agent"

depends_on: "understand_intent"

input: "{{intent.order_id}}"

- name: "check_policy"

agent: "rule_agent"

depends_on: "query_order"

input: "{{order.status}}"

- name: "generate_response"

agent: "llm_agent"

depends_on: ["query_order", "check_policy"]

input: "{{all_data}}"

1.3 渐进式技能加载

Token成本是LLM应用的关键考量。DeerFlow 2.0的三级加载策略显著降低消耗。

三级加载机制:

- 元技能层:~100 tokens,用于任务分类

- 轻量技能层:~500 tokens,用于任务细化理解

- 完整技能层:~2000 tokens,包含完整示例,用于具体执行

成本优化效果:

- Token消耗减少60-80%

- 响应时间缩短30-50%

- 准确度提升

1.4 持久化内存系统

三层架构设计,满足不同存储需求:

- 短期记忆:Redis,快速读写

- 长期记忆:PostgreSQL,复杂查询

- 外部记忆:向量数据库,语义检索

二、项目结构与配置

2.1 项目目录结构

deerflow-2.0/

├── core/ # 核心模块

│ ├── agent/ # Agent基类

│ ├── container/ # 容器管理

│ ├── memory/ # 内存系统

│ └── workflow/ # 工作流引擎

├── skills/ # 技能库

├── deployments/ # 部署配置

├── examples/ # 使用示例

└── docs/ # 文档2.2 核心配置文件deerflow.yaml

yaml

deerflow:

version: "2.0"

container:

base_image: "deerflow/agent-base:2.0.0"

resource_limits:

cpu: "0.5"

memory: "512Mi"

memory:

short_term: "redis://localhost:6379/0"

long_term: "postgresql://user:pass@localhost/deerflow"

skills:

loading_strategy: "progressive"三、三种部署模式实战

3.1 本地开发环境部署

适合学习和小规模实验:

bash

# 克隆项目

git clone https://github.com/bytedance/deerflow.git

cd deerflow-2.0

# 安装依赖

pip install -r requirements.txt

# 启动服务

docker-compose -f deployments/docker-compose.dev.yml up -d

# 运行示例

python examples/basic_agent.py3.2 Docker生产环境部署

适合中小型项目:

yaml

# docker-compose.prod.yml

version: '3.8'

services:

deerflow-master:

image: deerflow/master:2.0.0

ports:

- "8080:8080"

depends_on:

- deerflow-redis

- deerflow-postgres

deerflow-redis:

image: redis:7-alpine

volumes:

- redis-data:/data

deerflow-postgres:

image: postgres:15-alpine

environment:

- POSTGRES_DB=deerflow

- POSTGRES_USER=deerflow

- POSTGRES_PASSWORD=password

volumes:

- postgres-data:/var/lib/postgresql/data部署命令:

bash

docker-compose -f docker-compose.prod.yml up -d

docker-compose logs -f deerflow-master

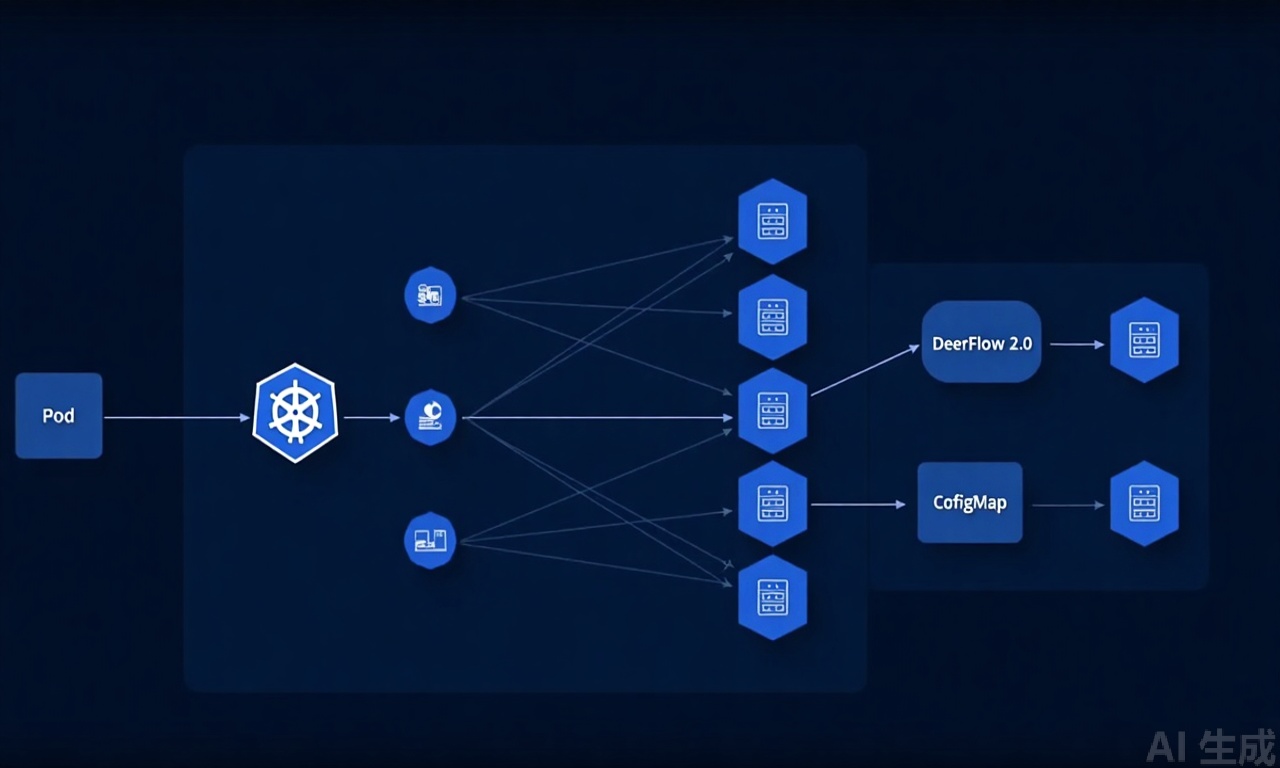

docker-compose up -d --scale deerflow-worker=33.3 Kubernetes云原生部署

适合大规模生产环境:

Helm values.yaml:

yaml

deerflow:

replicaCount: 3

resources:

limits:

cpu: "1"

memory: "1Gi"

requests:

cpu: "200m"

memory: "256Mi"

autoscaling:

enabled: true

minReplicas: 2

maxReplicas: 10

部署步骤:

bash

# 添加Helm仓库

helm repo add deerflow https://charts.deerflow.io

helm repo update

# 安装DeerFlow

helm install deerflow deerflow/deerflow \

--namespace deerflow \

--create-namespace \

--values values.yaml

# 验证部署

kubectl get pods -n deerflow四、性能对比与成本分析

| 部署模式 | 启动时间 | 并发能力 | 运维复杂度 | 适用场景 |

|---|---|---|---|---|

| 本地开发 | <1分钟 | 10-100任务 | 低 | 个人学习/小团队 |

| Docker生产 | 2-5分钟 | 100-1000任务 | 中 | 中小型企业 |

| Kubernetes | 5-10分钟 | 1000+任务 | 高 | 中大型企业 |

成本分析:

- 本地开发:$0-50/月

- Docker生产:$50-500/月

- Kubernetes:$500+/月

五、最佳实践与常见问题

5.1 技能开发指南

- 技能目录结构:

python

skills/

├── __init__.py

├── web/

│ ├── browse.py # 网页浏览技能

│ └── scrape.py # 数据抓取技能

├── file/

│ ├── read.py # 文件读取技能

│ └── write.py # 文件写入技能

└── api/

└── call.py # API调用技能- 技能模板示例:

python

from deerflow.core.agent import Skill

class FileReadSkill(Skill):

def __init__(self):

super().__init__(

name="file.read",

description="读取文件内容",

parameters={

"file_path": {

"type": "string",

"description": "文件路径"

}

}

)

async def execute(self, file_path: str, context: dict) -> str:

with open(file_path, 'r', encoding='utf-8') as f:

return f.read()5.2 性能优化建议

- 容器镜像优化:

dockerfile

# 使用多阶段构建减小镜像体积

FROM python:3.11-slim AS builder

COPY requirements.txt .

RUN pip install --user -r requirements.txt

FROM python:3.11-slim

COPY --from=builder /root/.local /root/.local

COPY . /app

WORKDIR /app

ENV PATH=/root/.local/bin:$PATH

CMD ["python", "main.py"]- 内存使用优化:

- 设置合理的Redis TTL

- 定期清理长期未使用的记忆

- 使用连接池管理数据库连接

5.3 监控与日志配置

yaml

logging:

level: "INFO"

format: "json"

handlers:

file:

filename: "/var/log/deerflow/deerflow.log"

maxBytes: 10485760 # 10MB

backupCount: 5

console:

level: "WARNING"

monitoring:

metrics_port: 9090

health_check: "/health"

readiness_check: "/ready"六、总结与展望

DeerFlow 2.0作为一个生产级AI Agent框架,在以下几个方面表现出色:

- 工程化设计:从开发到部署的全流程支持

- 成本控制:渐进式技能加载有效降低Token消耗

- 扩展性:支持从单机到集群的平滑扩展

- 可维护性:清晰的代码结构和配置管理

对比其他框架:

- LangChain:更适合快速原型开发

- AutoGPT:更适合探索性任务

- DeerFlow 2.0:更适合生产环境部署

学习建议:

- 从官方示例开始,理解基础概念

- 尝试自定义技能开发

- 在不同部署模式下测试性能

- 关注GitHub Issues和PR,了解最新进展

AI Agent技术的工程化之路刚刚开始,DeerFlow 2.0提供了一个很好的起点。希望本文能帮助你快速上手这个框架,在实际项目中发挥价值。

相关资源: