近日,悬镜安全旗下新一代 AI 原生安全治理产品"问境 AIST "首发通过中国信通院"可信AI云"大模型安全扫描产品能力评估。该结果表明,悬镜安全在面向大模型、智能体与 AI 应用的安全扫描、风险识别和治理能力建设方面,已形成可验证、可落地的产品化能力,也标志着悬镜在 AI 驱动的数字供应链安全治理方向取得进一步突破。

悬镜安全·大模型安全扫描产品能力检验证书

近期行业内接连出现供应链安全事件,也再次印证 AI 原生安全与供应链安全已进入深水区。2026 年 3 月 25 日,Apifox 官方发布安全通告,其公网 SaaS 版桌面客户端因外部 JS 文件被恶意篡改,遭遇供应链攻击。在 2026 年 3 月 4 日--22 日期间使用该客户端的用户,存在本地 SSH 密钥、Shell 历史、Git 凭证等高敏感信息被窃取并上报至恶意域名的风险。 此类事件表明:现代开发工具、AI 应用、依赖链与插件生态一旦被突破,将直接导致密钥泄露、权限失守、代码与配置被窃取等严重后果,企业亟需覆盖开发、构建、部署、运行全流程的 AI 原生安全体系。

值得关注的是,这是面向大模型安全扫描产品的一次系统性检验。随着大模型、智能体、MCP 服务和 AI Skills 加速进入企业研发、交付与业务运行环节,AI 安全问题已不再只是传统的软件漏洞问题,而是迅速扩展到模型来源与血缘、组件依赖、提示词注入、密钥泄露、影子模型接入、工具调用失控以及运行阶段越权执行等一系列 AI 原生风险。企业真正需要的,也不再是单一的检测工具,而是一套能够覆盖开发、部署、运行与治理全过程的安全能力体系。

正是在这一背景下,中国信通院结合大模型安全实践经验,牵头撰写《大模型安全扫描产品能力要求》标准,并围绕可部署性、隔离与运维能力、报告与告警治理流程、IDE 与开发流程集成、CI/CD 与自动化运维能力、修复与闭环能力、AI 红队安全测试、AI 供应链风险审查、AI 智能体代码审查以及权限认证与审计等多个维度展开综合评估。相比传统安全能力评测,这一评估更加贴近企业真实落地场景,对产品完整性、技术系统性和工程化能力都提出了更高要求,也因此具备更强的行业参考价值。

《大模型安全扫描产品能力要求》标准部分

首创多模态 AIST 技术体系

AI 原生场景构建系统化安全检测与治理能力

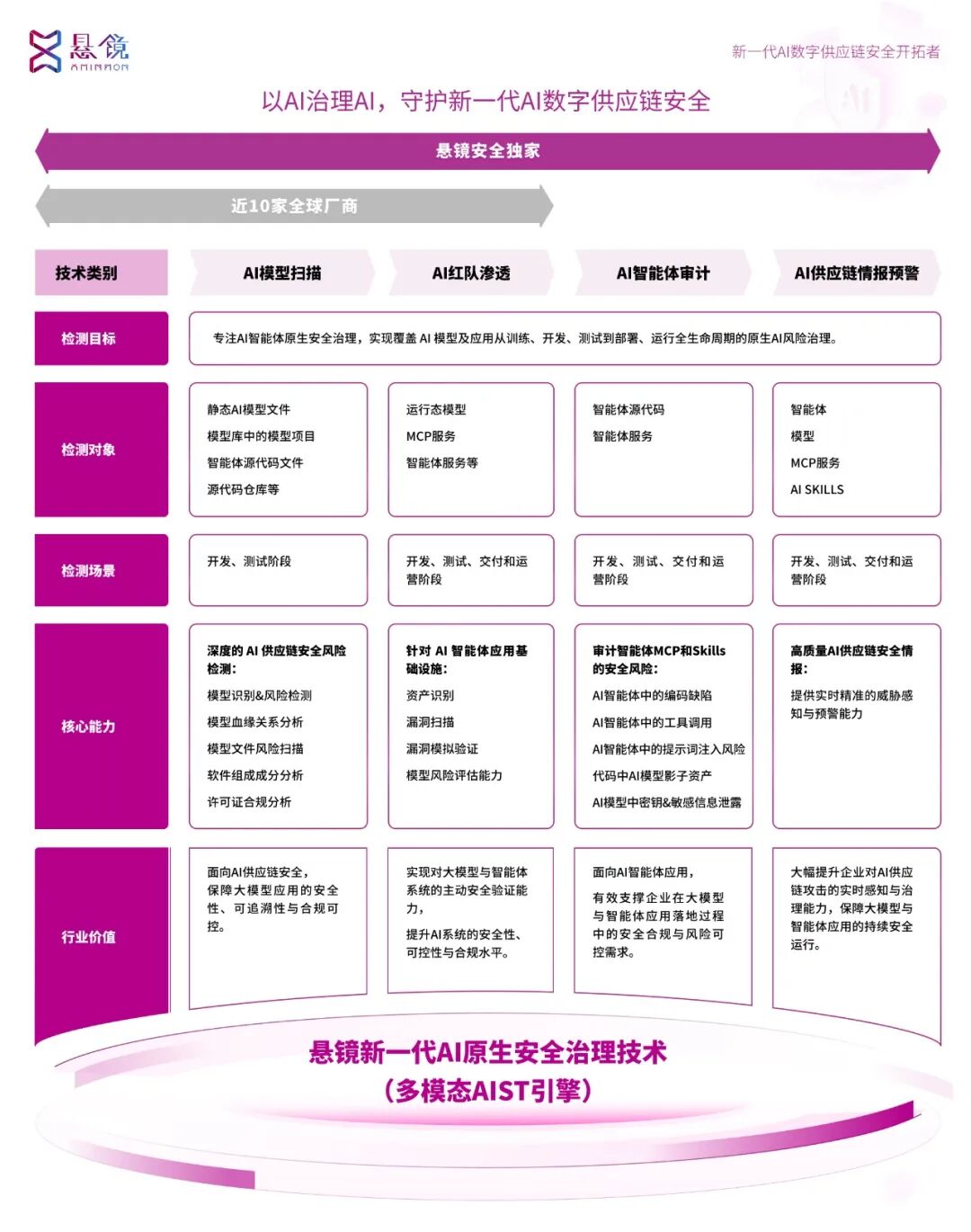

面对 AI 应用安全边界持续外扩的现实,悬镜安全围绕 AI 数字供应链安全,持续推进从风险发现、验证到预警、治理的全流程能力建设。作为 AI 原生安全治理的核心平台,**问境 AIST 基于首创多模态 AIST 技术,**面向 AI 模型文件、模型项目、智能体代码、运行态模型、MCP 服务及 AI Skills 等对象开展安全检测与风险识别,覆盖 AI 模型扫描、AI 代码安全护栏、AI 红队渗透、AI 智能体审计和 AI 供应链情报预警五大方向。

不同于传统安全工具侧重单点漏洞发现,问境 AIST 更强调对模型、代码、组件、提示词、工具链和运行环境的联合审查与全局分析,帮助企业从 AI 原生视角识别、关联并治理分散风险,建立更完整的安全可视能力。

悬镜安全首创多模态 AIST 技术

在模型治理层面,平台可识别模型来源、血缘关系、组件依赖、模型文件风险及许可证合规问题,帮助企业厘清模型"从哪里来、依赖了什么、是否可控、是否合规",补齐 AI 供应链治理短板。

随着 Vibe Coding、智能编程协作等新型开发模式快速进入研发流程,安全问题也进一步前移。围绕这一变化,问境 AIST 将代码安全护栏嵌入 AI 原生开发过程,针对提示词拼接、模型调用、插件接入、外部 API 使用和敏感信息管理等关键环节建立安全边界,为 Vibe Coding 筑牢安全底座。

当 AI 应用进一步走向 Agentic 化,企业面临的挑战已不只是代码漏洞,更在于智能体是否会以不安全的方式调用工具、访问资源并执行高风险任务。基于这一判断,问境 AIST 将审查对象延展到智能体源代码、MCP 与 Skills 的调用关系及上下游依赖,重点识别提示词注入、敏感信息泄露、影子模型接入、不安全工具调用、外部 API 滥用等 AI 原生风险。

与此同时,悬镜安全也在 AI 红队渗透方向形成了接近真实攻击环境的安全验证能力。通过对越权调用、提示词操控、数据泄露等典型问题进行主动验证,平台帮助企业在 AI 系统上线前尽早识别高风险点,推动安全能力从"事后修补"转向"前置验证"。

AI 智能代码漏洞挖掘

推动安全治理前移至开发与构建阶段

如果说多模态 AIST 解决的是 AI 应用整体风险识别与治理问题,那么 AI 智能代码漏洞挖掘能力,则进一步将安全治理前移到开发与构建阶段。

在 AI 原生开发模式下,越来越多风险不是在上线后才暴露,而是在编码阶段就已埋下。提示词拼接不当、模型调用失控、插件接入过宽、外部 API 滥用、敏感信息硬编码、影子模型混入项目等问题,都会随着构建、测试和交付被持续放大。尤其随着 AI 辅助开发、Agentic Coding、Vibe Coding 等新模式快速普及,企业面对的已不只是"代码有没有漏洞",而是"AI 生成或参与生成的代码、配置与调用链是否安全"。

围绕这一趋势,悬镜安全持续深化 AI 智能代码漏洞挖掘能力建设。相关能力基于 AI 模型推理开展未知漏洞挖掘、逻辑漏洞检测、风险分析与验证,并结合自动化修复和误报控制机制,进一步提升漏洞发现与处置效率。相比传统规则匹配式检测,这种能力更适合应对 AI 原生开发环境下复杂、多变、强上下文关联的新型安全问题。

这一能力的价值,不仅在于提升漏洞发现率,更在于帮助企业更早识别那些传统工具难以捕捉、却会在 AI 应用场景中持续放大的风险,真正把安全能力前移到编码、构建和交付之前。

AI 供应链安全情报体系

构建持续预警与治理能力闭环

AI 安全的复杂性,还在于其风险来源并不只存在于应用本身,而是大量分布在模型、组件、框架、依赖、插件和外部服务组成的供应链体系中。企业要真正建立 AI 安全能力,就不能只做单次扫描,而必须形成持续感知、持续预警、持续治理的能力闭环。

为此,悬镜安全在 AI 供应链风险预警方向持续深耕,形成了面向 AI 数字供应链的安全情报体系。悬镜云脉 AI 数字供应链安全情报平台融合多类情报渠道,并结合 AI、策略与专家运营体系,对漏洞、投毒、许可风险、组件断供等安全事件进行持续跟踪、分析与分发,可实现漏洞与投毒信息预警、修复建议提供、组件安全评估、SBOM 关联分析和风险优先级重定义,帮助企业持续提升 AI 供应链风险感知与治理效率。

这一能力的核心价值,在于将 AI 安全从"发现问题"推进到"持续运营问题"。当企业引入的模型、框架、开源组件、插件和外部服务不断变化时,真正重要的已不再是某一次扫描报告,而是能否持续掌握风险变化、识别高优先级威胁,并将这些风险及时纳入修复与治理流程。悬镜安全构建的 AI 供应链安全情报体系,正是在为企业提供这样一套持续性的安全底座。