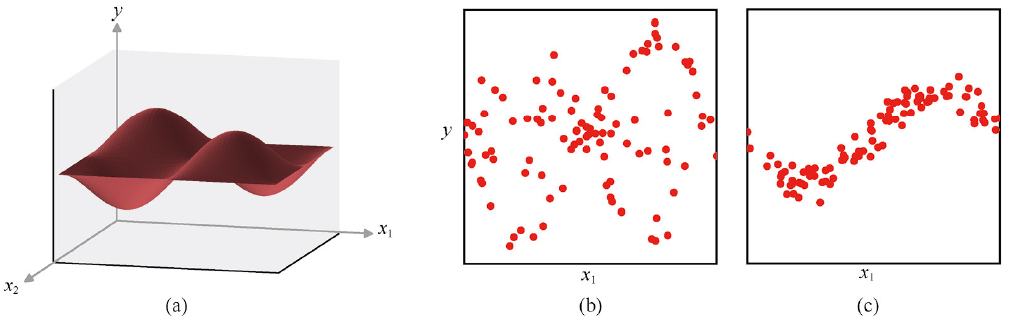

系统不确定性 源自有限的数据集大小,随着数据集增多,系统可以更好的预测新样本的类别。随机不确定性 源自噪声,即使数据集无限大,也无法达到完美的准确率。从源头减小这种不确定性的方法是收集不同类型的数据 。图(a)y(x1,x2)=sin(2πx1)sin(2πx2)y(x_1,x_2)=sin(2πx_1)sin(2πx_2)y(x1,x2)=sin(2πx1)sin(2πx2)的曲线图,并加入了高斯噪声;(b)100个数据点,位观测到x2x_2x2的图示,数据点看上去杂乱无章,显然噪声很大;(c)同样是100个数据点,将x2x_2x2固定为π/2π/2π/2,可以发现噪声水平明显降低了,能看出是一个正弦曲线。这说明收集不同类型的数据来训练模型是很有必要的。

这两种不确定性都可以用概率论的框架来处理。

加和法则和乘积法则

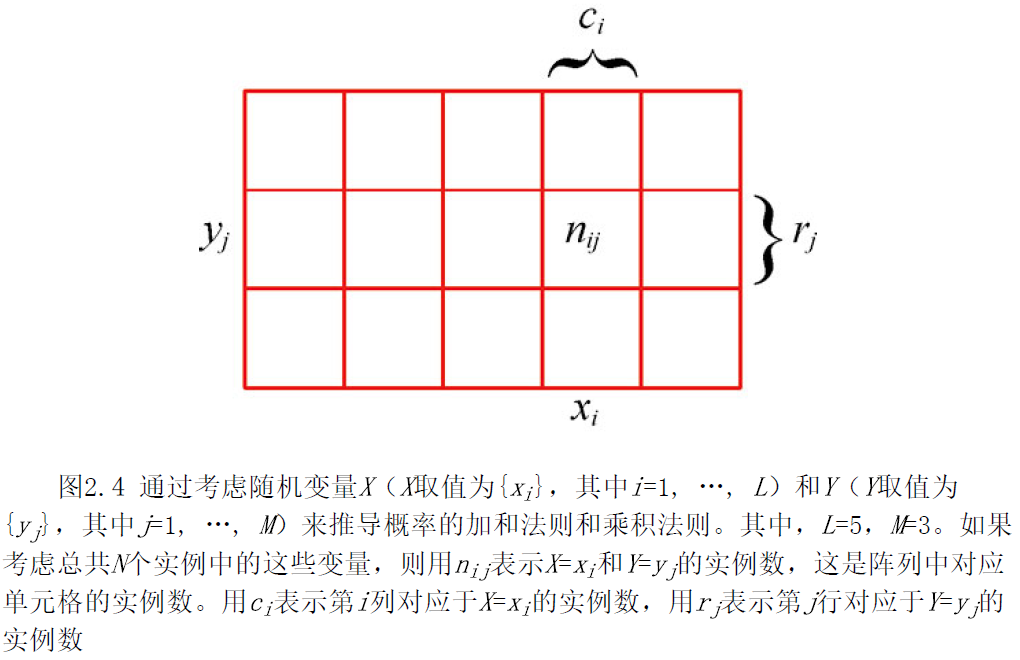

定义两个随机变量X,YX,YX,Y,∀xi∈X,∀yj∈Y,i=1,⋯,L;j=1,⋯,M∀x_i∈X,∀y_j∈Y,i=1,⋯,L;j=1,⋯,M∀xi∈X,∀yj∈Y,i=1,⋯,L;j=1,⋯,M。在癌症检查例子中XXX表示癌症存在与否,YYY表示检查结果。假设实验总共执行NNN次,同时对X,YX,YX,Y采样,

- 将X=xiX=x_iX=xi且Y=yjY=y_jY=yj的实验次数记为nijn_{ij}nij

- 将X=xiX=x_iX=xi(不考虑YYY)的实验次数记为cic_ici

- 将Y=yjY=y_jY=yj(不考虑XXX)的实验次数记为rjr_jrj

X,YX,YX,Y的联合概率分布为p(X=xi,Y=yj)=nijNp(X=x_i,Y=y_j)=\frac{n_{ij}}{N}p(X=xi,Y=yj)=Nnij在不考虑YYY的情况下,XXX取值为xix_ixi的概率p(X=xi)=ciNp(X=x_i)=\frac{c_i}{N}p(X=xi)=Nci又∑i=1Lp(X=xi)=1\sum_{i=1}^Lp(X=x_i)=1i=1∑Lp(X=xi)=1于是得到加和法则(也称边缘概率) p(X=xi)=∑j=1Mp(X=xi,Y=yj)p(X=x_i)=\sum_{j=1}^Mp(X=x_i,Y=y_j)p(X=xi)=j=1∑Mp(X=xi,Y=yj)在给定X=xiX=x_iX=xi下Y=yjY=y_jY=yj的条件概率记为p(Y=yj∣X=xi)=nijcip(Y=y_j|X=x_i)=\frac{n_{ij}}{c_i}p(Y=yj∣X=xi)=cinij综上,乘积法则 记为p(X=xi,Y=yj)=nijN=nijci⋅ciN=p(Y=yj∣X=xi)p(X=xi)p(X=x_i,Y=y_j)=\frac{n_{ij}}{N}=\frac{n_{ij}}{c_i}·\frac{c_i}{N}=p(Y=y_j|X=x_i)p(X=x_i)p(X=xi,Y=yj)=Nnij=cinij⋅Nci=p(Y=yj∣X=xi)p(X=xi)上诉写法过于复杂,可以简单记忆:

加和法则(通过求和其他变量得到):p(X)=∑Yp(X,Y)p(X)=\sum_Yp(X,Y)p(X)=Y∑p(X,Y)乘法法则:p(X,Y)=p(Y∣X)p(X)p(X,Y)=p(Y|X)p(X)p(X,Y)=p(Y∣X)p(X)

贝叶斯定理(后验概率)

从乘积法则出发,结合对称性p(X,Y)=p(Y,X)p(X,Y)=p(Y,X)p(X,Y)=p(Y,X)可得贝叶斯定理p(Y∣X)=p(X∣Y)P(Y)p(X)p(Y|X)=\frac{p(X|Y)P(Y)}{p(X)}p(Y∣X)=p(X)p(X∣Y)P(Y)再利用加和法则可得p(X)=∑Yp(X∣Y)p(Y)p(X)=\sum_Yp(X|Y)p(Y)p(X)=Y∑p(X∣Y)p(Y)

医学筛查示例

| 200名检查者 | 实际患癌(C=1C=1C=1) | 实际未患癌(C=0C=0C=0) |

|---|---|---|

| 检测阳性(T=1T=1T=1) | 真阳性(TP):90人 | 假阳性(FP):3人 |

| 检测阴性(T=0T=0T=0) | 假阴性(FN):10人 | 真阴性(TN):97人 |

由上述混淆矩阵可以列出4种条件概率

p(T=1∣C=1)=90/100=0.90p(T=1|C=1)=90/100=0.90p(T=1∣C=1)=90/100=0.90p(T=0∣C=1)=10/100=0.10p(T=0|C=1)=10/100=0.10p(T=0∣C=1)=10/100=0.10p(T=1∣C=0)=3/100=0.03p(T=1|C=0)=3/100=0.03p(T=1∣C=0)=3/100=0.03p(T=0∣C=0)=97/100=0.97p(T=0|C=0)=97/100=0.97p(T=0∣C=0)=97/100=0.97

问题1:若对人群进行筛查,某人检查结果呈阳性的概率是多少?

p(T=1)=p(T=1∣C=0)p(C=0)+p(T=1∣C=1)p(C=1)=3100×99100+90100×1100=38710000=0.0387\begin{align*} p(T=1)&=p(T=1|C=0)p(C=0)+p(T=1|C=1)p(C=1) \\ &=\frac{3}{100}×\frac{99}{100}+\frac{90}{100}×\frac{1}{100}\\ &=\frac{387}{10000}=0.0387 \end{align*} p(T=1)=p(T=1∣C=0)p(C=0)+p(T=1∣C=1)p(C=1)=1003×10099+10090×1001=10000387=0.0387

问题2:若某人的检查结果呈阳性,那么他确实患有癌症的概率是多少?

p(C=1∣T=1)=p(T=1∣C=1)p(C=1)p(T=1)=90100×1100×10000387=90387≈0.23\begin{align*} p(C=1|T=1)&=\frac{p(T=1|C=1)p(C=1)}{p(T=1)} \\ &=\frac{90}{100}×\frac{1}{100}×\frac{10000}{387}\\ &=\frac{90}{387}≈0.23 \end{align*} p(C=1∣T=1)=p(T=1)p(T=1∣C=1)p(C=1)=10090×1001×38710000=38790≈0.23